基于元学习的多视图对比融合冷启动推荐算法

摘 要:针对当前冷启动推荐模型在处理异质信息网络时难以充分挖掘结构与语义信息,以及忽略网络中用户行为属性的问题,提出了一种基于元学习的多视图对比融合冷启动推荐算法(MVC-ML)。该算法在模型层和数据层双重作用下,有效缓解了冷启动问题。在MVC-ML算法框架中,首先通过元路径视图提取异质信息网络的高阶语义信息;其次,利用网络模式视图捕获网络的结构特征;再接着,通过聚类视图分析用户行为属性信息;最后,运用对比学习方法,将上述三个视图中提炼的信息进行综合融合,以生成准确的表示向量。通过在DBook等三个数据集上的实验验证,MVC-ML模型在冷启动场景下相较MetaHIN等传统异质信息网络模型,在MAE上降低了1.67%,在RMSE上降低了2.06%,同时nDCG@K提高了1.48%。这些数据充分证实了MVC-ML算法的合理性和有效性。

关键词:异质信息网络; 对比学习; 网络模式; 冷启动

中图分类号:TP391.3 文献标志码:A 文章编号:1001-3695(2024)07-015-2025-08

doi:10.19734/j.issn.1001-3695.2023.11.0547

Multi-view contrast fusion cold start recommendation algorithmbased on meta-learning

Abstract:Addressing the challenges faced by current cold start recommendation models in effectively mining structural and semantic information in heterogeneous information networks, and their tendency to overlook user behavior attributes within these networks, this paper introduced a meta-learning-based multi-view contrast fusion cold start recommendation algorithm(MVC-ML) . This algorithm effectively tackled the cold start problem at both the model and data layers. Within the MVC-ML framework, it firstly extracted higher-order semantic information from heterogeneous information networks using a meta-path view. Subsequently, it captured the network’s structural features using a network pattern view. Following this, the algorithm analyzed user behavior attribute information through a clustering view. Finally, MVC-ML employed a contrast learning method to integrate the information extracted from these three views, thus generating accurate representation vectors. Experimental validations on datasets, including DBook, demonstrate that the MVC-ML model, in a cold start scenario, reduces MAE by 1.67%, lowers RMSE by 2.06%, and increases nDCG@K by 1.48% compared to traditional heterogeneous information network models such as MetaHIN. These results fully confirm the rationality and effectiveness of the MVC-ML algorithm.

Key words:heterogeneous information network; contrast learning; network mode; cold start

0 引言

随着信息技术的快速发展,互联网信息数量呈指数级增长,人们想要获得自己想要的信息的难度越来越大。为了解决用户信息过载问题,推荐系统[1]被广泛部署在各种在线服务当中,例如电子商务平台和新闻门户。在这些服务当中,推荐系统会根据用户的习惯和兴趣给他们推荐合乎用户心意的信息。传统推荐系统的核心是协同过滤,主要是根据用户的历史动作(如点击、购买等)来估计用户对某物品的感兴趣概率。但是对于一个新用户或者新物品,它们之间的交互信息是稀疏的,如何在数据稀疏的情况下有效地学习新用户和新物品的表示,这就是推荐系统冷启动问题[2]。

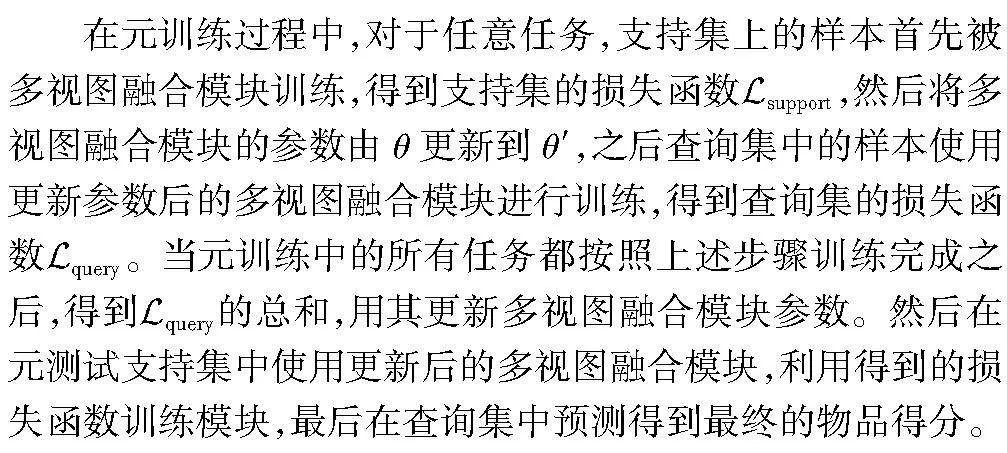

为了缓解冷启动问题,常见的方法是借助额外信息来对新用户和新物品的表示进行增强[3]。近年来,将异构信息网络和推荐系统进行结合的研究越来越多,异构信息网络独特的网络结构能够丰富用户-物品之间的交互信息,从而加强用户和物品的表示。异构信息网络在生活中广泛存在,例如社交网络、知识图谱等[4]。图1(a)就是个典型的异质信息网络,它不仅描述了用户和电影之间的关系,还能捕获用户、电影与导演、演员之间的关系,图1(b)是通过异构信息网络构成的元路径,它可以有效地表示异质信息网络的高阶结构和语义信息。例如,UMAM就表示了两部电影具有相同的演员,而用户已经和其中一部电影有过交互。

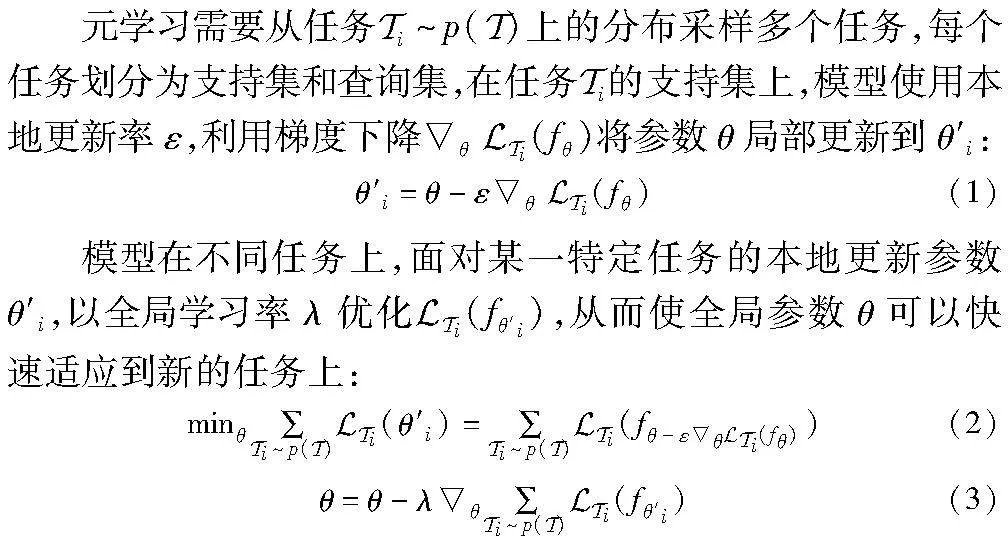

在模型层面,元学习框架[5]为冷启动推荐问题提供了新的研究路径。元学习注重获取一般性知识(即先验知识),以便利用先验和少量训练数据快速适应新的学习任务。在某种程度上,冷启动推荐问题可以变换为元学习问题,其中每个任务是学习一个用户的偏好。元学习从现有用户的任务中学习到具有强泛化能力的先验知识,使得它可以在元测试期间快速适应到新任务上,即为交互数据稀疏的冷启动用户推荐物品。图1(c)中,冷启动用户u3(仅具有一个电影评级)可以从元测试的先验知识θ中被适配,其中先验知识是通过学习如何在元训练中适配现有用户u1和u2而得出的。一些研究[6~8]采用元学习来解决冷启动问题,并取得了一定的成果。

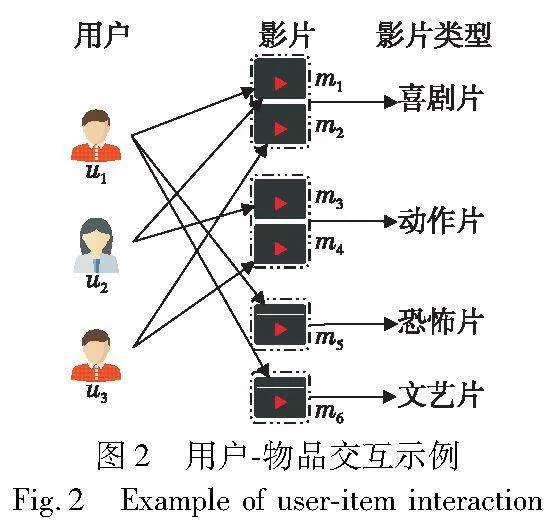

然而,这些研究通常是直接采用元学习框架,忽略了探索异质信息网络中独特的异质图结构和语义信息。一些模型[9,10]探索了异质信息网络的高阶结构和语义信息,但是这些模型并没有利用异质信息网络本身的网络结构,这种网络结构直接刻画了节点之间的联系,能够提供大量的辅助信息[11]。另一方面,利用元路径描述异质信息网络的高阶信息时会存在这样一个问题:如图2所示,用户u1和u2的偏好分布并不相似,但是他们都与m1有过交互,元路径可以描述这种联系,从而认为他们是相关的。再来看用户u2和u3,他们虽然没有观看过同样的影片,但是他们有一个相似的偏好分布,即他们都喜欢看喜剧片和动作片,这种偏好分布很可能不被元路径所描述出来。

针对上述问题,本文提出了基于元学习的多视图对比融合冷启动推荐算法(MVC-ML),旨在解决下面的几个挑战:a)单一元路径描述异质信息网络的网络结构和语义信息略显不足,如何更具质量地描述异质信息网络的结构和语义信息?b)如何识别元路径难以描述的偏好信息,提高用户的特征表示质量?

针对第一个问题,本文考虑到了异质信息网络的元模板——网络模式。网络模式作为异质信息网络的本地结构信息,它清晰直观地展现出了节点之间的联系。而元路径作为描述异质信息网络结构和语义信息的常用方式,如果将网络模式视图与元路径视图得到的信息进行融合,对刻画异质信息网络结构和语义信息有很大的作用。

针对第二个问题,考虑到用户会带有一些行为属性简档,简档相似的用户在一定程度上会具有相同的兴趣,因此本文采用集群的方式,将具有相似行为属性的用户分到一个集群,增强用户的关联性。最后,对元路径视图、网络模式视图和聚类视图进行对比学习[12],整合三个视图的信息,最终得到用户和物品的表示向量。

本文的贡献总结如下:

a)提出了基于元学习的多视图对比融合冷启动推荐算法,构建了元路径、网络模式和聚类三个视图,更准确描述了异质信息网络高阶信息,增强元学习过程中的用户和物品表示,从而在数据和模型两个方面解决冷启动问题。

b)构建了对比学习模块,采用自监督训练的方法,充分挖掘整合三个视图中的信息,从而更深入地挖掘异质信息网络中无标签数据的信息。

c)对不同冷启动场景下的三个真实数据集进行了广泛的实证研究,证明了MVC-ML的合理性、有效性。

1 相关工作

1.1 冷启动推荐

基于深度学习的推荐算法[13]在提高推荐精度方面表明了其优越性。但是,上述基于深度学习的推荐算法由于其历史数据有限,以及个人差异导致的用户偏好的偏差,很难对预测模型训练后出现的新用户和新物品作出像样的推荐。以上冷启动问题一般存在推荐系统中,为了缓解缺乏历史数据的问题,在推荐系统中使用了辅助信息来描述新用户和新物品。Li等人[14]介绍了行为密集型神经网络,该网络还利用项目的文本内容来学习语义潜在项目向量,并通过聚合其交互的项目来表示新用户。除了上述基于文本特征的推荐系统之外,为了更好地学习特征嵌入之间的关系,Cheng等人[15]开发了自适应分解网络 (AFN)。AFN提出了一种对数变换网络,以有效地从数据中学习任意阶交叉特征。但是,即使用户具有不同的历史交互数据,上述基于内容的推荐系统始终为具有465249457ef61a65ebb26d3faa7709c2eaf512d67f11fd8b44c79ab1e824a8f3相同侧面信息的用户提供相同的建议。这些推荐系统忽略了用户交互中的个体差异,无法准确提供个人推荐。同时,跨域推荐(CDR)利用来自外部域的数据来提供目标域中不足的交互。CDR被视为缓解缺乏互动问题的有前途的解决方案。按照这一思路,文献[16,17]作出了一些改进。例如,文献[16]采用了领域对抗学习来隐式地将交互模式从支持领域(support domain)转移到目标领域(target domain)。当公共用户或物品跨域存在时,诸如文献[17]明确地将转移用户和物品的嵌入作为先验知识。上述这些方法只是在数据层面缓解冷启动推荐问题, 对数据的可靠性有很大的依赖。

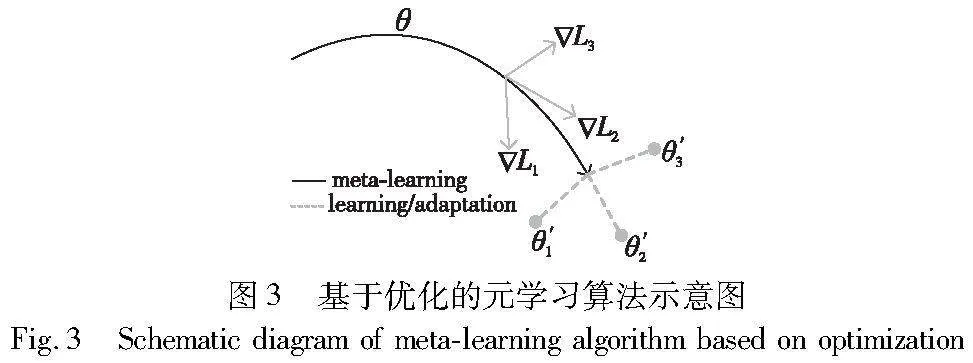

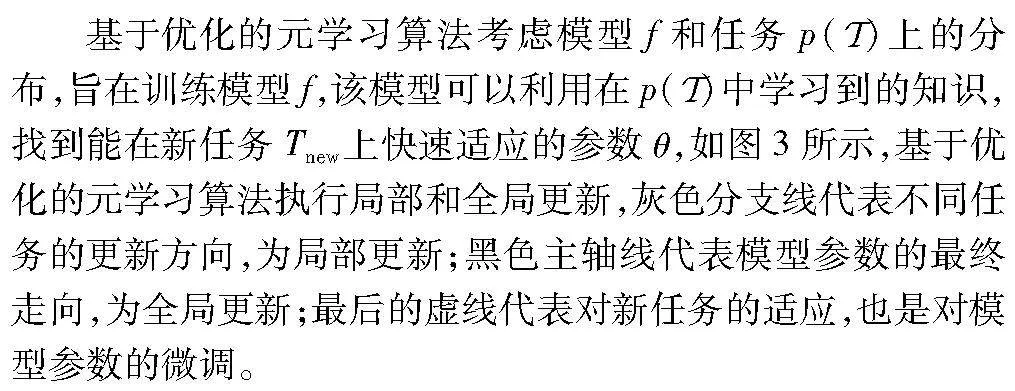

1.2 元学习

近年来研究人员将基于优化的元学习[5]引入到了推荐系统当中,以缓解推荐系统冷启动问题。基于优化的参数初始化的基本思想是将元知识w定义为基础推荐模型的初始参数,然后以双层优化的形式更新参数初始化。在这个基础上,Lee等人[6]首先将MAML框架引入冷启动推荐,并提出了MeLU,目的是学习基于神经网络的推荐模型的全局参数初始化作为先验知识。借鉴多个冷启动任务全局学习模型初始化参数的思想,Chen等人[7]在MeLU的基础上提出了一种多先验元学习方法MPML,该方法配备了多组初始化参数,要分配哪一组初始化参数取决于在本地更新后哪个性能优于其支持集。MetaEDL[18]采用MAML框架来通过置信学习增强推荐模型的初始化参数。考虑到任务的异质性问题,MAMO[8]通过面对不同任务定制特定任务的初始化,在初始化推荐模型参数时提供了个性化的偏差项。遵循自定义特定任务初始化的相同想法,Wang等人[19]还认为具有相似偏好的用户应该共享相似的先验知识,并提出了一种偏好自适应元学习方法PAML,通过应用外部元模型,将全局共享的先验初始化调整为偏好特定的初始化。除了基于推荐模型的参数初始化之外,一些工作还利用元学习来学习不同冷启动任务的自适应超参数。例如,MetaCS[20]采用类似MeLU的双层优化,并在执行全局优化时附加本地更新的学习率的值。MetaHIN[9]采用了元路径来刻画异质网络的语义和结构信息, 并整合在元学习框架中。RPMLG-Rec[21]将本地不同偏好连接起来,构成显式偏好图,然后按照元学习训练策略快速适应。但是上述这些方法都忽视了一定的结构和语义信息, 且完全忽视了异质信息网络中大量的信息。

1.3 异质信息网络表示学习

传统异质信息网络的核心技术是基于元路径, 通过不同的机制来刻画节点与元路径之间的关系。metapath2vec[22]采用了异质word2vec技术, 将上下文的窗口限制为一个特定的类型。HIN2vec[23]采用元路径与节点之间的Hadamard乘积来捕获网络特征。近来, 基于图神经网络的异质信息网络表示屡被提出。Het-GNN[24]首先聚合同一类型的节点特征, 然后采用注意力机制聚合不同的类型特征。HAN[25]首先采用注意力机制聚合元路径的特征, 然后采用注意力机制聚合不同的元路径。MetaHIN模型[9]通过在元学习环境中捕获异质信息网络的语义信息,并利用协同适应元学习器处理每个任务中不同的语义方面。MNRec[26]通过基于元路径和交换矩阵的异构信息网络嵌入方法得到用户和项目的嵌入,最后将其导入到双路径MLP中进行评级预测。HSG[27]通过三种不同类型的子图,将其组合构建成异构图,之后通过元路径随机游走进行网络嵌入。但是上述方式忽略了异质信息网络的本地结构,没有考虑到网络模式作为异质信息网络的元模板刻画了节点之间的直接联系。

2 基础知识

本文方法主要是异质信息网络上的基于元学习的冷启动推荐,下面对异质信息网络、元路径、元学习和网络模式的相关概念和基础知识进行介绍。

2.1 异质信息网络

异质信息网络[28]可表示为G=(V,E,A,L),其中V表示节点集,E表示边集。V中的节点(或E中的边)有多种类型。因此,每一个节点v∈V(或每一个边e∈E)与一个映射函数φ(v):V→A(ψ(e):E→L)相关联,其中A(或L)表示节点类型(边类型)的集合。|A|+|L|>2代表该网络为异质信息网络。

2.2 网络模式

网络模式[11]可表示为TG=(A,L),是一个由节点类型和边类型组成的图,能够描述节点之间的联系,刻画网络本地结构。例如,图1(d)是图1(a)的网络模式。

2.3 元路径

写为V1V2…Vl+1。如图1(b)所示,存在两种元路径UMAM、UMDM,分别代表了不同的语义,即某用户看了某电影,这个电影与另一个电影有着相同的导演或演员。因此,元路径能够抽象出异质信息网络当中的高阶结构信息。

2.4 元学习

3 模型

3.1 模型总体架构

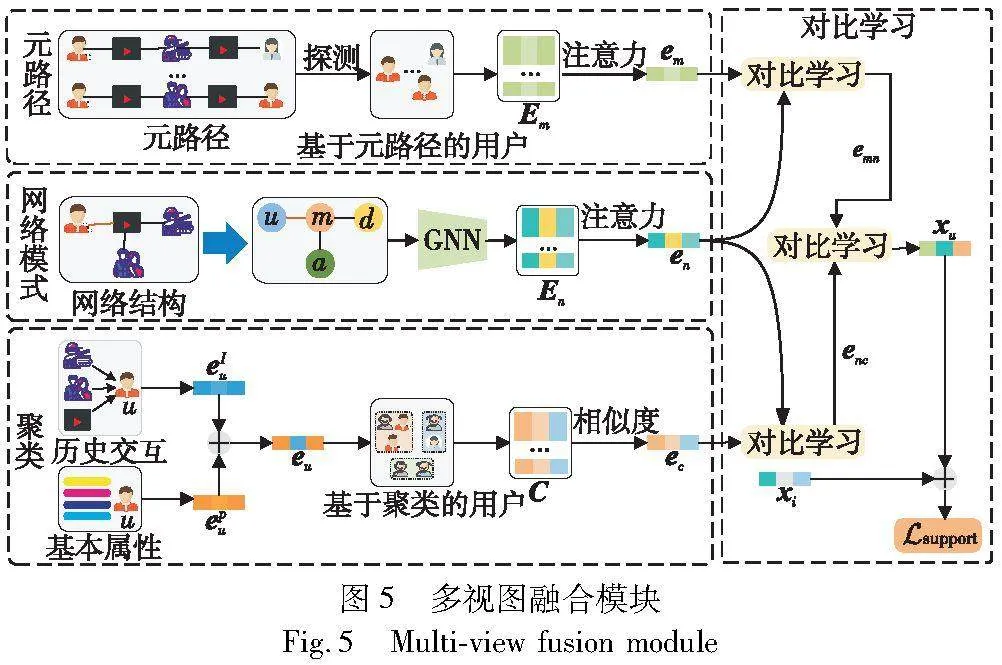

3.2 多视图融合模块

图5是图4中多视图融合模块的详细架构,本文从元路径、网络模式和聚类三个视图中分别挖掘异质信息网络的特征信息和用户的行为属性简档,元路径主要针对网络的高阶信息,网络模式主要针对网络的自身结构,聚类主要针对用户本身的行为属性简档。最后利用对比学习的方法,将三个视图所获得的信息进行融合。

3.2.1 元路径视图

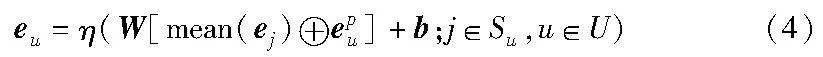

根据研究[6, 9],本文使用用户和物品的初始特征来初始化向量,epu和ei分别表示用户u和物品i的初始化向量,最后用户u基于物品的偏好,可以通过汇总用户的历史交互来计算,如下所示。

其中:Su是u的支持集;mean是合并平均操作;W和b是可学习参数;η是LeakyReLU激活函数。

对于用户u,在计算u和他所有基于元路径的相关用户的关联强度后,本文选择与用户u关联强度较高的部分用户参与到模型运算当中,这些用户表示为Um。随后利用公式学习这些用户基于物品的偏好,如下所示。

其中:W和b是可学习参数。通过上式,模型获取了Um中的每个用户基于物品的偏好,但是由于不同用户对目标用户u的贡献不同,本文将所有eum堆叠起来获得矩阵Em,利用注意力机制获取用户u基于元路径视图的用户表示,如式(8)所示。

em=Em softmax(ETmeu)(8)

3.2.2 网络模式视图

异质信息网络的网络结构可以看作其元模板,其中包含了不同节点之间的直接联系,将网络结构融入到模型当中,能够提供大量辅助信息,提高用户表示的准确性。在网络模式的视角下,对于一个给定的用户u,他与K个其他类型的节点相连,可以表示为{z1,z2,…,zk}。则与节点u相连的类型为zn的邻居节点可以表示为Nznu,那么对于同一种类型的邻居节点可以聚合如下:

其中:σ是ReLU激活函数;ej是节点j的特征向量。

其中:wn和bn是可学习参数;an是注意力向量;εzn即为各个类型节点的权重。

3.2.3 聚类视图

用户本身是带着一些行为属性(如观看、点击、评论),具有相同行为属性的用户可能不会出现在同一条元路径上,但是他们本身是具有一定关联性的。为了挖掘这类具有关联性的用户,本文采用基于聚类的策略,通过聚类过程将由式(4)得到的用户表示进行线性投影,获得对应用户的聚类查询向量,公式如下:

tu=Wteu+bt(13)

其中:β为t分布的自由度,这里取值为1。最后融合聚类信息的用户表示ec可以计算如下:

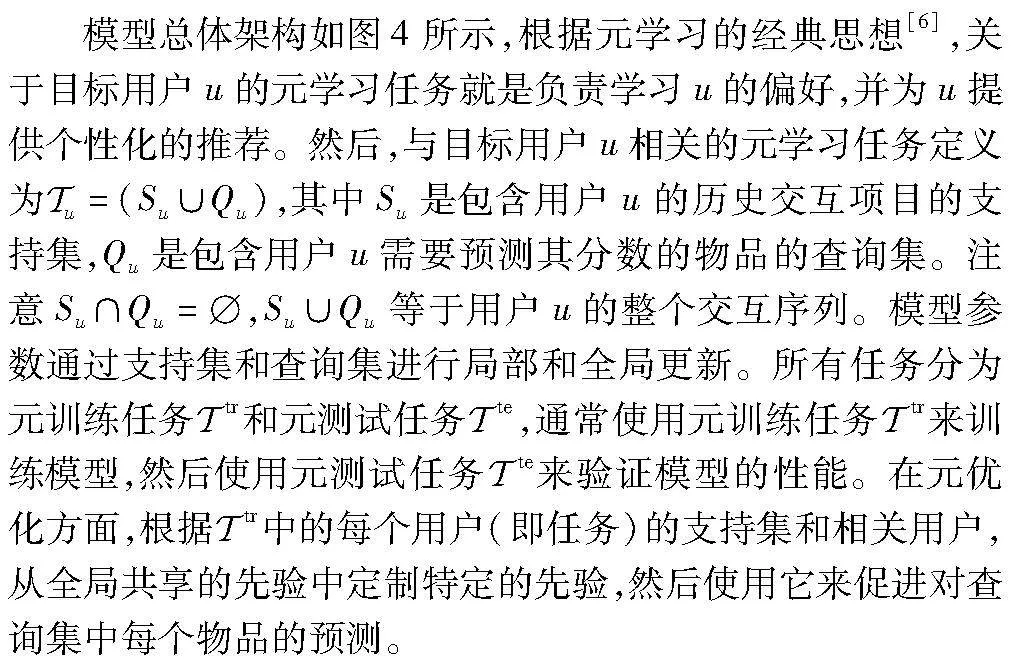

3.2.4 对比融合和得分预测

通过上述的运算过程,模型生成了用户u的三种向量表示,分别是基于元路径视图的用户表示em、基于网络模式视图的用户表示en和基于聚类视图的用户表示ec。为了进一步增强用户表示的鲁棒性,本文采用对比学习来将这三种向量表示进行融合,更深层次地挖掘用户潜在信息。具体而言,就是先将em和en进行对比学习,生成emn,再将en和ec进行对比学习生成enc,最后将emn和enc进行对比学习生成用户最终表示xu。具体而言就是同一节点u的不同视图下的表示为正例时,其余节点的表示为负例。各步骤的目标函数如下:

其中:sim()表示为sim()=e(g(),g()),g()是多层感知器,e()是相似度函数,这里采用余弦相似度进行计算;τ代表温度系数。

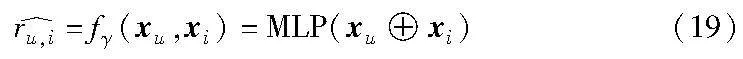

同理,物品向量表示xi也可以得到,那么就可以预测用户u对物品i的偏好得分:

最后最小化如下损失函数以学习用户u的偏好:

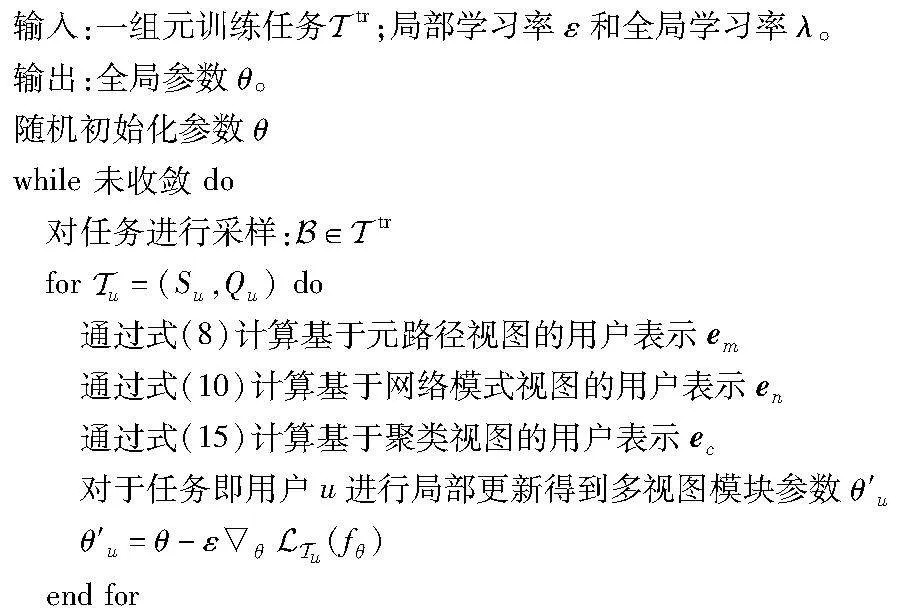

根据上述流程,模型总的训练过程如算法1所示。

算法1 MVC-ML训练算法

通过式(21)计算模型整体的损失

4 实验与结果分析

4.1 数据集

本文在DBook、MovieLens和Yelp三个基准数据集上进行实验,它们的数据统计信息如表1所示。

对于每个数据集,本文根据用户加入时间(或第一次用户操作时间)和物品发布时间,将用户和物品分为现有用户(物品)和新用户(物品)两组,新出现的用户(物品)和已存在的用户(物品)的比例大致为2∶8。然后将每个数据集分为元训练和元测试数据。元训练数据仅包含现有物品的现有用户评级,本文随机选择其中的10%作为验证集,其余为元测试数据。模型训练对应三种冷启动场景:用户冷启动(UC),即为新用户推荐现有物品;物品冷启动(IC),即为现有用户推荐新物品;用户物品冷启动(UIC),即为新用户推荐新物品。

在元学习设置中,本文构建支持集和查询集(即Su和Qu)。具体来说,在每个数据集中找出一些交互次数在15~100的用户,然后为每个用户随机选择10个历史交互项目作为查询集(即|Qu=10|),其余部分用作支持集。在元路径的构建上,凡是长度小于4的元路径都会被构建。

4.2 评价指标及基准模型

本文采用平均绝对误差(MAE)、均方根误差(RMSE)和K级归一化折扣累积增益(nDCG@K)三种广泛使用的评价指标。

平均绝对误差(MAE)是回归模型的度量之一,它计算的是预测值与真值之间的绝对值之和。MAE值越小,预测精度越高。

均方根误差(RMSE)对异常值非常敏感,其结果与数据本身在同一尺度上,比均方误差(MSE)更能描述误差。RMSE值越小,模型的性能越好,误差越小。

K级归一化折扣累积增益(nDCG@K)评估推荐系统中排名列表的准确性。本文设置K=5,并注意到nDCG@K值越高,推荐模型的准确率越高。

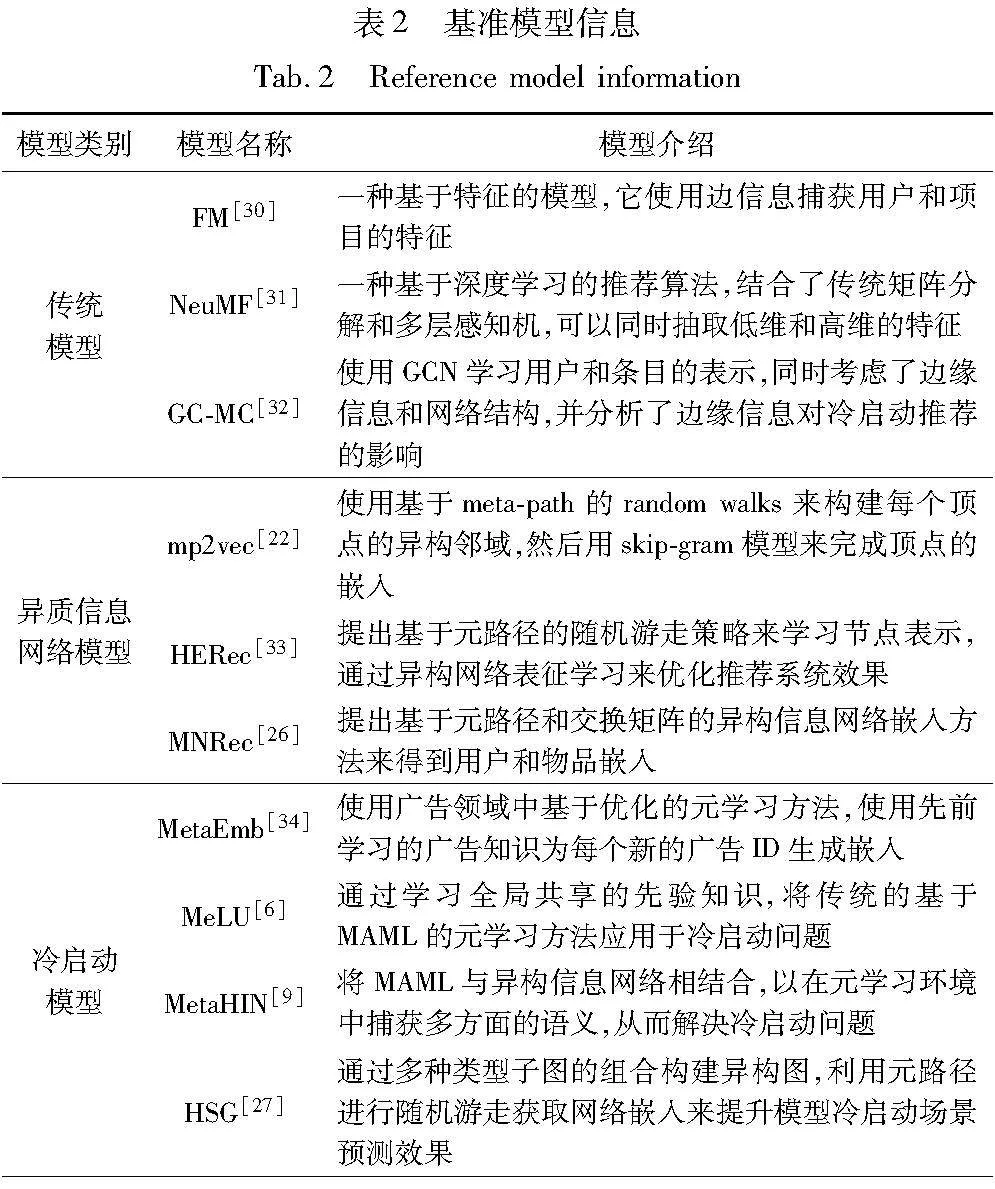

在基准模型的选择上,本文将基准模型分为传统模型、基于异质信息网络的模型和冷启动模型三大类,具体信息如表2所示。

4.3 实验结果与分析

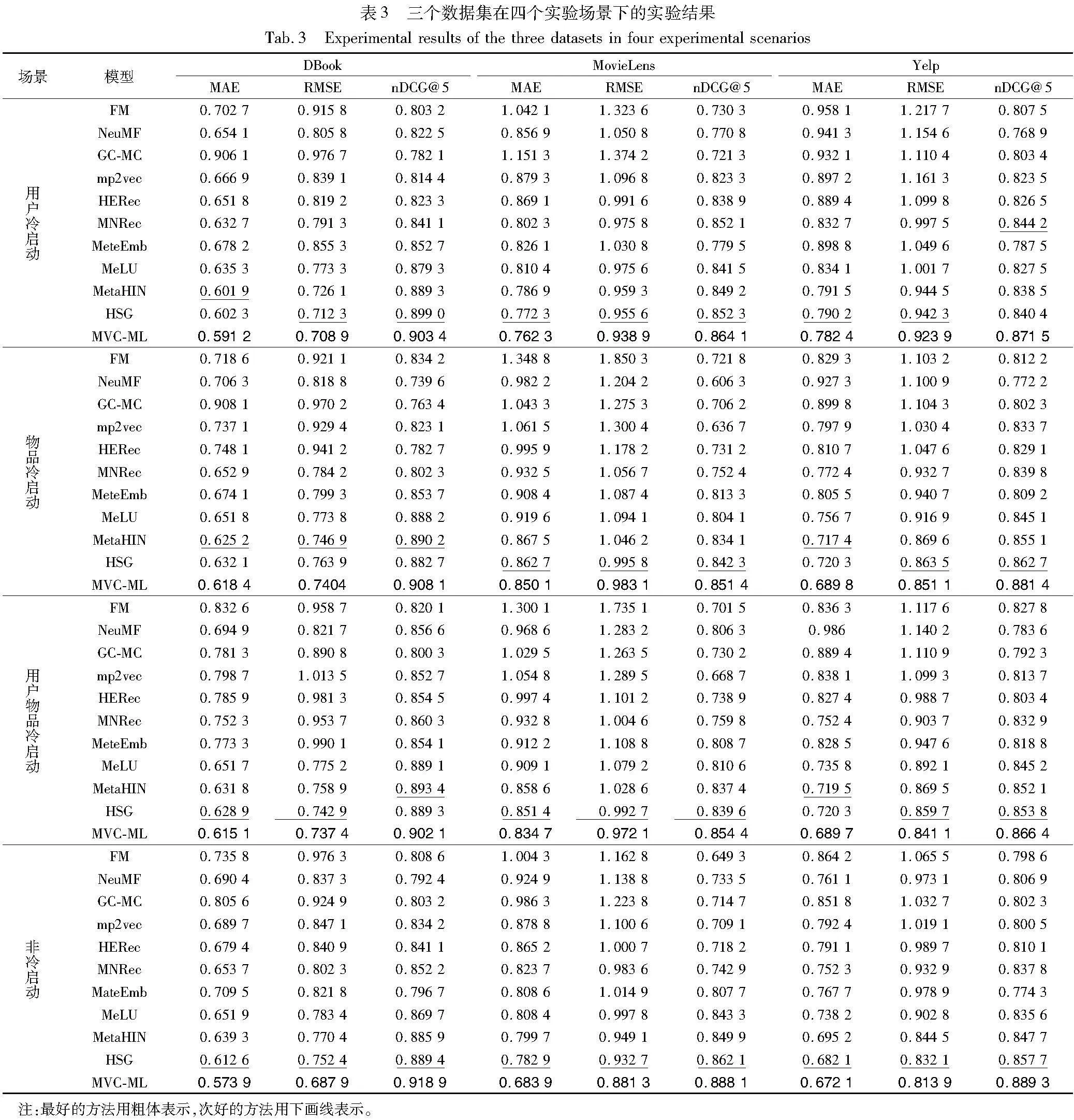

从表3可以看到,在所有场景下,MVC-ML相较于基线模型都取得了很好的结果。在冷启动场景下,传统模型由于架构所限,只能够提取异质信息网络简单的内容特征,对于异质信息网络所蕴涵的语义信息和高阶结构信息均不能有效提取,所以这类模型在冷启动场景下表现很差。而基于异质信息网络的模型可以在一定程度上提取到网络的语义和高阶结构信息,因此这类模型相较于传统模型在推荐效果上有不少的提升,HERec基于元路径的游走策略可以获取网络的语义和高阶结构信息,MNRec更进一步采用元路径和交换矩阵的异质信息网络嵌入方式来获取用户和物品的嵌入,进一步提升了推荐效果,表明了使用元路径能够在一定程度上提升非同构网络下推荐系统的性能。

基于元学习的冷启动推荐模型相较于传统模型和异质信息网络模型均有一定的提升,这是因为元学习本身的少样本学习特性对于推荐系统冷启动问题具有天然的优势。其中由于MateEmb模型是针对广告场景,所以相较于其他模型而言,推荐效果并不是很好。

MetaHIN模型采用了多层元路径思想来获取多方面的异质信息网络语义信息,因此它的效果要比其他模型的效果好。但是由于MetaHIN并没有考虑到异质信息网络的网络模式和用户的行为属性简档,导致MetaHIN的推荐效果要差于MVC-ML。HSG通过元路径随机游走获取由多子图构建的异质信息网络的复杂异构数据,相较于MetaHIN的多层元路径方式能够更充分地挖掘异质信息网络中的隐含信息。多子图构建的方法也在一定程度上有着和网络模式一样的作用,但是它和MetaHIN有着相同的劣势,并没有考虑到用户的行为属性简档,所以HSG相比MetaHIN有着一定的提升,但是推荐效果要弱于MVC-ML。MVC-ML使用元路径、网络模式和聚类三个视图描述异质信息网络的语义和结构信息,同时也高效融合了用户本身的行为属性简档信息,实验充分表明了多视图的信息融合使得MVC-ML的推荐效果有很大的提升。

在非冷启动场景下,MVC-ML的推荐效果也是要好于其他模型的。根据表2所示,数据集本身是很稀疏的,说明这些数据集中存在相当一部分的无监督信息,MVC-ML能在这些数据集下取得很好的推荐效果,说明MVC-ML也是适用于稀疏数据集的,表明了MVC-ML的多视图融合策略能够很好地挖掘稀疏数据集中的信息,使得处理稀疏性数据更为高效。

4.4 消融实验

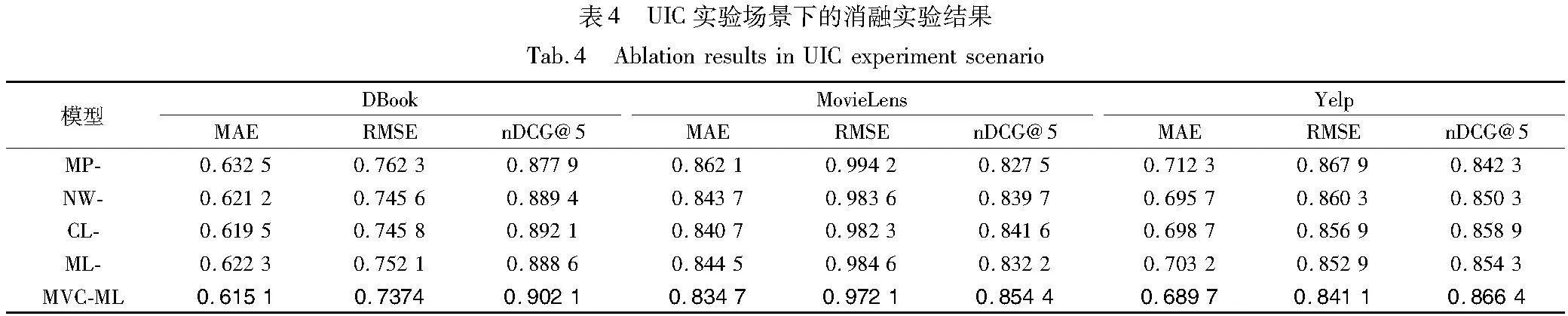

为了验证模型中不同视图模块的贡献,本文进行了消融实验,设计了三个模型变种,分别是:a)MP-去除了元路径视图;b)NW-去除了网络模式视图;c)CL-去除了聚类视图。同时为了验证元学习的有效性,本文采用一个变种ML-,它只采用多视图融合模块进行训练,不采用元学习框架。在实验场景选择上,考虑到在用户物品冷启动(UIC)场景下能够包含用户冷启动和物品冷启动两种场景,因此单独选择用户物品冷启动场景进行消融实验,在一定程度上也能描述了用户冷启动和物品冷启动的情况。

消融实验结果如表4所示。从不同模块贡献的角度上来看,三种视图所获得的信息都对MVC-ML有影响,其中去掉元路径视图对MVC-ML的影响最大,这是因为本文针对的是异质信息网络,而元路径在异质信息网络中对提取语义信息和网络结构具有很大的作用,去掉元路径视图对于高阶信息的提取很不利,从而导致推荐效果的减退。网络模式视图和聚类视图对模型的影响相似,表明网络模式视图下的本地结构信息和用户行为属性简档在异质信息网络下具有同等重要的地位。这三个视图的消融实验充分证实了MVC-ML综合利用元路径的高阶信息、网络模式下的本地结构和用户行为属性简档的优势。ML-变体的效果也不是很理想,仅仅略好于MP-变体,表明了元学习框架在冷启动推荐问题上具有很大的优势。

4.5 参数分析

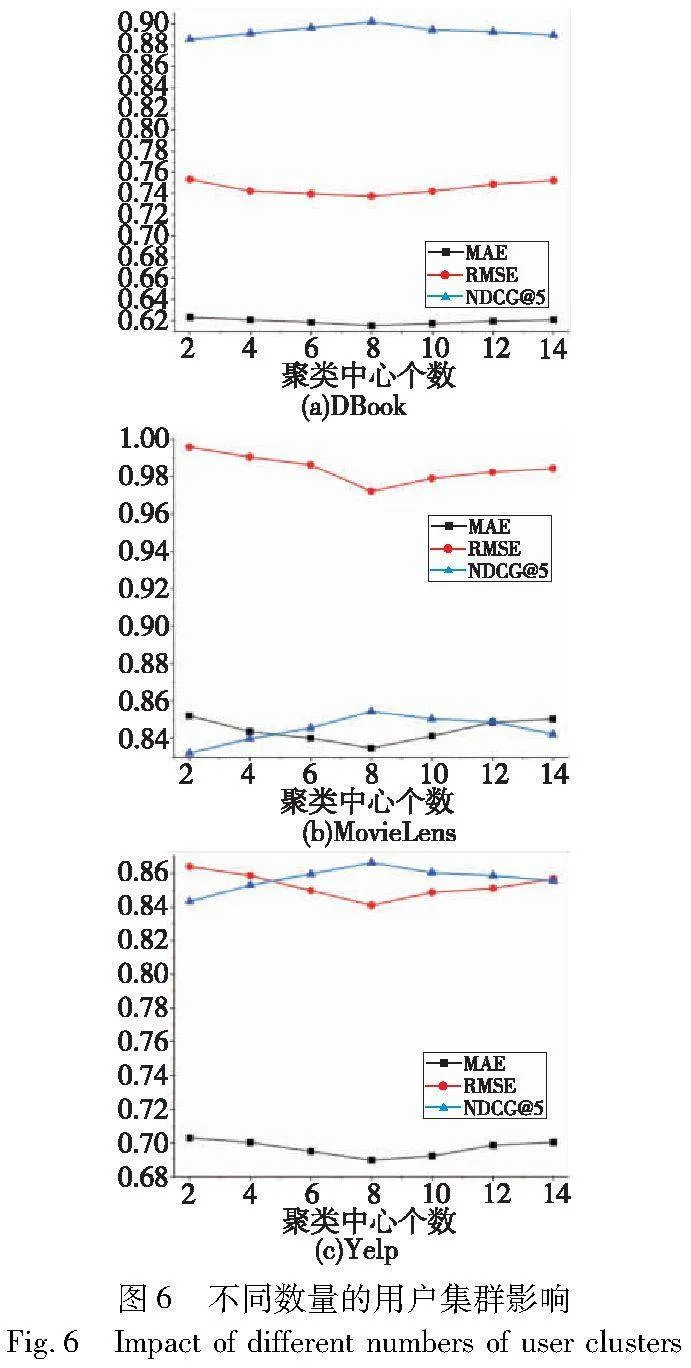

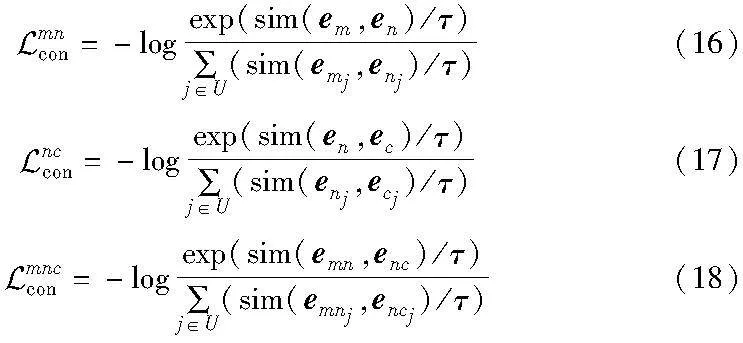

本文研究用户集群数量(K)的影响,实验场景仍然选择用户物品冷启动场景。图6描述了改变DBook、MovieLens和Yelp数据集上的用户集群数量的结果。可以观察到,当K<8时,性能随着用户集群数量的增加而增加,然后当K=8时,MVC-ML达到最佳性能。之后,当K>8时,MVC-ML的性能随着聚类数量的增加而略有下降,这表明选择较小的K是合理的,当使用的特征数量增加时,可能需要较大的K。

5 结束语

本文提出了基于元学习的多视图对比融合冷启动推荐算法来解决异质信息网络下推荐系统中的冷启动问题。针对目前冷启动模型无法高效地刻画异质信息网络中的结构和语义信息以及忽视了用户行为属性简档等问题,本文提出了多视图融合模块,设计了元路径、网络模式和聚类这三个视图,挖掘高阶和本地的结构与语义信息;而后, 在元路径、网络模式和聚类三个视图中使用对比学习整合三个视图,获得用户和物品的表示; 最后, 将该模块整合在元学习框架中, 有效解决了冷启动推荐问题。在三个公开基准数据集上进行了三个冷启动场景下的对比实验,MVC-ML的实验结果优于所有基线模型,验证了所提模型的有效性。

未来的研究有以下几个方向:a)目前网络模式只是把异质信息网络本地结构给刻画出来,下一步可以考虑根据节点类型的不同来构造同构信息网络,结合异质信息网络本地结构来增强异质信息网络的结构刻画;b)采用对比学习挖掘无标签信息是自监督学习的一种方法,后面可以联合生成式学习来进一步挖掘深层次无标签信息。

参考文献:

[1]Resnick P,Varian H R. Recommender systems[J]. Communications of the ACM, 1997, 40(3): 56-58.

[2]Zhu Yu, Lin Jinghao, He Shibi, et al. Addressing the item cold-start problem by attribute-driven active learning[J]. IEEE Trans on Knowledge and Data Engineering, 2019,32(4): 631-644.

[3]Narducci F, Basile P, Musto C, et al. Concept-based item representations for a cross-lingual content-based recommendation process[J]. Information Sciences, 2016,374:15-31.

[4]Shi Chuan, Li Yitong, Zhang Jiawei, et al. A survey of heterogeneous information network analysis[J]. IEEE Trans on Knowledge and Data Engineering, 2016, 29(1): 17-37.

[5]Finn C, Abbeel P, Levine S. Model-agnostic meta-learning for fast adaptation of deep networks[C]//Proc of the 34th International Conference on Machine Learning. New York:ACM Press, 2017: 1126-1135.

[6]Lee H, Im J, Jang S, et al. MeLU: meta-learned user preference estimator for cold-start recommendation[C]//Proc of the 25th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York: ACM Press, 2019: 1073-1082.

[7]Chen Zhengyu, Wang Donglin, Yin Shiqian. Improving cold-start re-commendation via multi-prior meta-learning[C]//Proc of the 43rd European Conference on Information Research. Cham: Springer, 2021: 249-256.

[8]Dong Manqing,Yuan Feng,Yao Lina,et al. MAMO:memory-augmented meta-optimization for cold-start recommendation[C]//Proc of the 26th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York: ACM Press, 2020: 688-697.

[9]Lu Yuanfu, Fang Yuan, Shi Chuan. Meta-learning on heterogeneous information networks for cold-start recommendation[C]//Proc of the 26th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York: ACM Press, 2020: 1563-1573.

[10]Xu Jia, Zhang Hongming, Wang Xin, et al. AdaML: an adaptive meta-learning model based on user relevance for user cold-start recommendation[J]. Knowledge-Based Systems, 2023, 279:110925.

[11]Sun Yizhou, Han Jiawei. Mining heterogeneous information networks: a structural analysis approach[J]. ACM SIGKDD Explorations Newsletter, 2013, 14(2): 20-28.

[12]邴睿, 袁冠, 孟凡荣, 等. 多视图对比增强的异质图结构学习方法[J]. 软件学报, 2023, 34(10): 4477-4500. (Bing Rui, Yuan Guan, Meng Fanrong, et al. Multi-view contrast enhanced learning method for heterogeneous graph structure[J]. Journal of Software, 2023, 34(10): 4477-4500.)

[13]Liang Dawen, Krishnan R G, Hoffman M D, et al. Variational autoencoders for collaborative filtering[C]//Proc of World Wide Web Conference. New York:ACM Press, 2018: 689-698.

[14]Li Zhi, Zhao Hongke, Liu Qi, et al. Learning from history and pre-sent: next-item recommendation via discriminatively exploiting user behaviors[C]//Proc of the 24th ACM SIGKDD International Confe-rence on Knowledge Discovery & Data Mining. New York: ACM Press, 2018: 1734-1743.

[15]Cheng Weiyu, Shen Yanyan, Huang Linpeng. Adaptive factorization network: learning adaptive-order feature interactions[C]//Proc of AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2020: 3609-3616.

[16]Krishnan A, Das M, Bendre M, et al. Transfer learning via context-ual invariants for one-to-many cross-domain recommendation[C]//Proc of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2020: 1081-1090.

[17]Liu Meng, Li Jianjun, Li Guohui, et al. Cross domain recommendation via bi-directional transfer graph collaborative filtering networks[C]//Proc of the 29th ACM International Conference on Information & Knowledge Management. New York: ACM Press, 2020: 885-894.

[18]Neupane K P, Zheng E, Yu Qi. MetaEDL: meta evidential learning for uncertainty-aware cold-start recommendations[C]//Proc of IEEE International Conference on Data Mining. Piscataway, NJ: IEEE Press, 2021: 1258-1263.

[19]Wang Li, Jin Binbin, Huang Zhenya, et al. Preference-adaptive meta-learning for cold-start recommendation[C]//Proc of the 30th International Joint Conference on Artificial Intelligence. San Francisco,CA:Margan Kaufmann Publishers, 2021: 1607-1614.

[20]Bharadhwaj H.Meta-learning for user cold-start recommendation[C]//Proc of International Joint Conference on Neural Networks. Piscataway, NJ: IEEE Press, 2019: 1-8.

[21]Liu Huiting, Wang Lei, Li Peipei, et al. Relation-propagation meta-learning on an explicit preference graph for cold-start recommendation[J]. Knowledge-Based Systems, 2023, 272: 110579.

[22]Dong Yuxiao, Chawla N V, Swami A. metapath2vec: scalable representation learning for heterogeneous networks[C]//Proc of the 23rd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM Press, 2017: 135-144.

[23]Fu Taoyang, Lee W C, Lei Zhen. HIN2vec: explore meta-paths in heterogeneous information networks for representation learning[C]//Proc of ACM Conference on Information and Knowledge Management. New York: ACM Press, 2017: 1797-1806.

[24]Zhang Chuxu, Song Dongjin, Huang Chao, et al. Heterogeneous graph neural network[C]//Proc of the 25th ACM SIGKDD International Conference on Knowledge Discovery & Data Mining. New York: ACM Press, 2019: 793-803.

[25]Wang Xiao, Ji Houye, Shi Chuan, et al. Heterogeneous graph attention network[C]//Proc of the World Wide Web Conference. New York: ACM Press, 2019: 2022-2032.

[26]Tan Lei, Gong Daofu, Xu Jinmao, et al. Meta-path fusion based neural recommendation in heterogeneous information networks[J]. Neurocomputing, 2023, 529: 236-248.

[27]Li Meizi, Que Weiqiao, Geng Ziyao, et al. Cold-start item recommendation for representation learning based on heterogeneous information networks with fusion side information[J]. Future Generation Computer Systems, 2023, 149: 227-239.

[28]石川, 王睿嘉, 王啸. 异质信息网络分析与应用综述[J]. 软件学报, 2021,33(2): 598-621. (Si Chuan, Wang Ruijia, Wang Xiao. Heterogeneous information network analysis and application review[J]. Journal of Software, 2021, 33(2): 598-621.)

[29]Xie Junyuan, Girshick R, Farhadi A. Unsupervised deep embedding for clustering analysis[C]//Proc of the 33rd International Conference on Machine Learning. New York:ACM Press, 2016: 478-487.

[30]Rendle S, Gantner Z, Freudenthaler C, et al. Fast context-aware re-commendations with factorization machines[C]//Proc of the 34th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2011: 635-644.

[31]Wang Xiang, He Xiangnan, Wang Meng, et al. Neural graph colla-borative filtering[C]//Proc of the 42nd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2019: 165-174.

[32]Berg R V D, Kipf T N, Welling M. Graph convolutional matrix completion [EB/OL]. (2017-10-25). https://arxiv.org/abs/1706.02263.

[33]Shi Chuan, Hu Binbin, Zhao W X, et al. Heterogeneous information network embedding for recommendation[J]. IEEE Trans on Know-ledge and Data Engineering, 2018, 31(2): 357-370.

[34]Pan Feiyang, Li Shuokai, Ao Xiang, et al. Warm up cold-start advertisements: improving CTR predictions via learning to learn ID embeddings[C]//Proc of the 42nd International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2019: 695-704.