航迹先验融合特征的车载雷达实例分割算法

曾大治 郑 乐 曾雯雯 张 鑫 黄 琰 田瑞丰,

(1.北京理工大学雷达技术研究院,北京 100081;2.北京理工雷科电子信息技术有限公司,北京 100097;3.北京理工大学重庆创新中心,重庆 401135;4.北京理工睿行电子科技有限公司,北京 100081;5.理工雷科智途(北京)科技有限公司,北京 100081)

1 引言

自动驾驶技术提出于智能交通系统(Intelligent Transportation System,ITS)[1],旨在解放驾驶员双手,让车辆能自主的在道路上行驶。自动驾驶的关键技术包括环境感知、定位导航、路径决策与规划等[2],其中环境感知是关键点。随着技术的发展,车载雷达的分辨率越来越高,利用车载毫米波雷达观测得到的散射点云[3-4]对交通参与者进行环境感知,成为目前国内外研究的热点之一[5]。实例分割(Instance Segmentation)是环境感知中极具挑战性的任务,不仅需要区分出同一类别的不同实例,还要给出其准确的语义类别,细粒度要求较高。

根据散射点的处理方式不同,基于点云的实例分割方案可分为以下三类[5]——基于点云体素化的分割方案、基于卷积神经网络的分割方案和基于聚类的分割方案。其中,点云体素化(Voxelization)是对整个分割场景进行单元格划分,每个单元格也称为体素(Voxel)[5],可以包含零个或多个散射点。分割算法后续以体素为单位完成实例分割[6-7]。该方案适用于密集点云,如激光雷达点云常使用的OpenPCDet[8],但对内存和计算能力的要求高。此外,点与体素的转换过程中也引入了量化误差[9-10],不利于稀疏点云的分割;基于卷积神经网络的方案则直接处理散射点生成用于实例分割的特征,散射点的物理坐标也作为特征的一部分参与分割[2,11-12]。最早有Charles R.Qi 等人提出的PointNet 算法[10]。该方案由于直接处理散射点,避免了转换中的量化误差。此后,Charles R.Qi 等人又在PointNet 算法基础上参考卷积神经网络(Convolutional Neural Networks,CNN)中“感受野”的思想,对单个散射点周围若干散射点进行加权求和完成散射点特征的逐层提取,提出了PointNet++算法[11],提高了分割模型的泛化能力;基于聚类的分割方案是使用聚类(Clustering)算法估计哪些散射点属于同一实例,如基于密度的空间聚类算法(Density-Based Spatial Clustering of Applications with Noise,DBSCAN)将具有足够密度的区域划分为一个实例[13],然后使用随机森林(Random Forest,RF)等算法对每个实例进行分类[14]。相较于前两类,该方法的性能有限,但由于计算量小,常被用于实时数据处理[9,15-18]。

在散射点处理的基础上,利用散射点特征直接计算散射点之间的特征相似度和分类矩阵完成分割[19-23]的方式,称为端到端分割。但该分割方式在同一实例中的相邻散射点之间相距较远[6,15]和交通区域内多个实例空间密集分布[6,24-27]的情况下,分割性能表现不佳。2022年,Liu Jianan等人提出了一种面向毫米波雷达散射点观测的非端到端分割方案。该方案计算实例内的各散射点到实例中心的偏移矢量(Center Shifted Vector,CSV)[9],利用CSV 对原始散射点观测进行补偿,意图克服上述问题。然而上述方案没有考虑遮挡情况,在路面障碍物或交通参与者对实例造成部分遮挡情况时,分割性能有限。

受启发于Akshay Dudhane 提出的“伪特征”概念[28],即从每个相邻图像中提取预处理的特征,经过边缘对齐模块来匹配后,使用多尺度上下文信息融合相邻图像特征,创建并丰富“伪特征”。原作的目的是通过合并来自快速连续捕获的同一场景的(降级)帧集合的期望信息来合成高质量图像,从而缓解图像多噪点和颜色失真的问题。因此在Liu Jianan 等人的基础上,本文将Akshay Dudhane 从图像领域引入雷达点云,将边缘对齐模块通过航迹先验构造的帧间匹配模块实现,从而提出了一种利用航迹先验融合特征的车载雷达实例分割算法。

本文的其余部分组织如下:第2 节详细介绍了所提算法的构成模块,包括特征提取、帧间匹配、特征融合、分割网络模块和损失函数。第3 节为实验及参数设置,分别展示了实验设置、对比算法和实验结果。最后,结束语载于第4节。

2 基于航迹先验融合的实例分割算法

算法由以下四个模块组成,包括特征生成、帧间匹配、特征融合和分割网络模块。各模块详细介绍见第2节各小节内容。

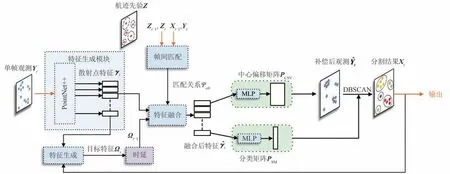

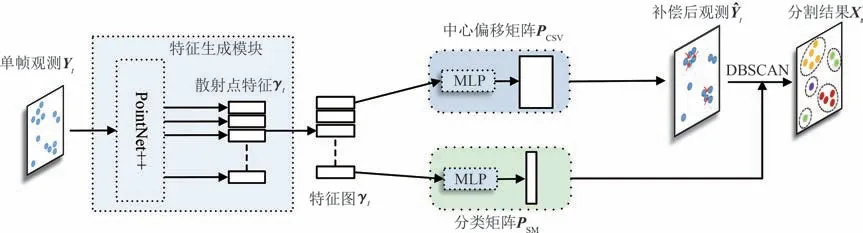

图1 展示了所提算法的架构。其中,雷达传感器在t帧观测得到的结果为Yt,Yt表示为Mt个散射点的集合,即,yt,m表示第m个散射点的物理信息,包括位置和速度信息,Dy表示物理信息维度。Yt通过特征生成模块得到散射点高维语义特征γt,与上一时刻的实例特征Ωt-1进行特征融合,得到融合后特征。经过多任务网络分支后,得到用于表征各散射点语义类别的分类矩阵PSM和用于补偿原始散射点的中心偏移矢量PCSV。补偿后的观测通过DBSCAN 得到各散射点的实例编号,结合分类矩阵得到的类别信息即可完成实例分割,分割结果Xt表征实例中心的物理信息。上述过程中,特征融合依赖的匹配关系Ψab通过帧间匹配模块计算得到,表征实例中心Xt-1与散射点Yt之间的映射关系。上一时刻的实例特征Ωt-1基于γt-1和实例编号计算得到。

图1 基于航迹先验的点云实例分割架构图Fig.1 The overall architecture of proposed method

2.1 特征生成

特征生成模块包括t帧的散射点特征生成和t-1帧的实例特征生成。

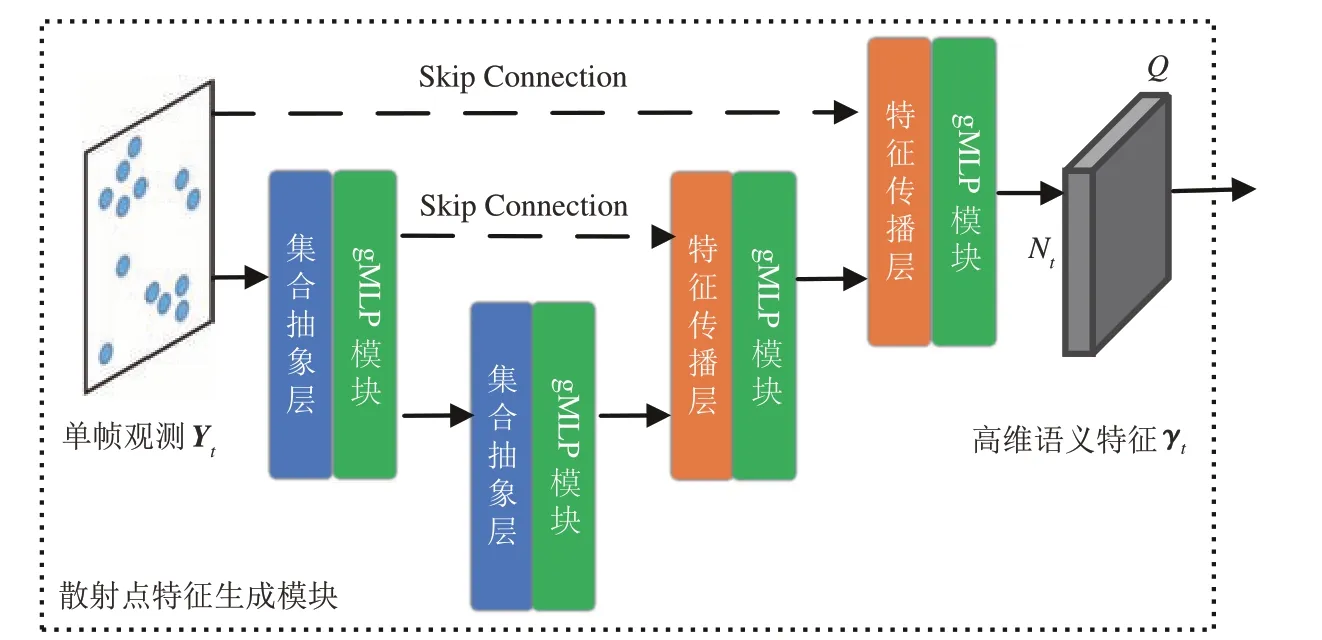

散射点特征生成如图2所示,输入t帧的雷达散射点集合Yt,PointNet++网络基于集合抽象(Set Abstraction,SA)层设定的采样半径和采样点数为每个散射点划分采样范围,采样范围内的散射点通过特征传播(Feature Propagation,FP)层得到高维语义特征γt,γt∈RQ×Mt。其中,Q表示语义特征维度。

图2 散射点特征生成模块Fig.2 Point-wise feature generation

本研究方案参考了Liu Jianan 等人的特征提取方案[9],即在每个SA 层和FP 层加入一种视觉多层感知机(gating Multi-Layer Perceptron,gMLP)模块,通过门控单元控制采样半径内散射点的通过率。因此模块一方面在采样半径等参数设置方面更具鲁棒性,另一方面能自适应的检索到高价值散射点的信息。

实例特征生成过程如下,假设在t-1 帧,各散射点的实例编号已知,对同一实例编号的散射点物理信息和特征分别取均值近似该实例中心的物理信息Xt-1和实例特征图Ωt-1。公式如下:

2.2 帧间匹配

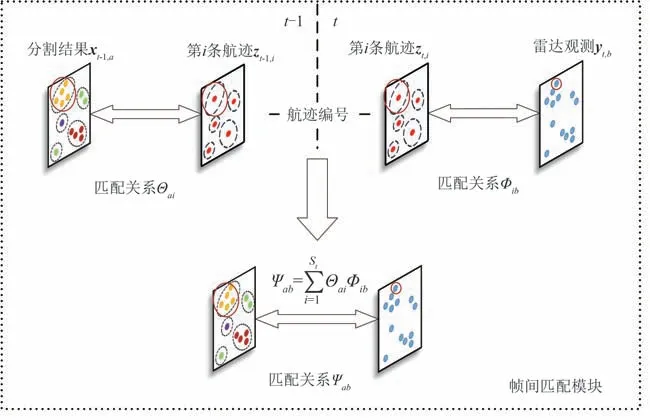

传统实例分割只使用单帧散射点信息,忽略了相邻帧之间的关联信息。为了进一步提升分割效果,本算法通过建立实例中心Xt-1与散射点Yt之间的映射关系挖掘相邻帧之间的关联信息,完成帧间匹配。由于上述关系的直接建立较为困难,因此算法引入航迹先验作为两者之间的桥梁,帧间匹配的具体示意图见图3。

图3 帧间匹配示意图Fig.3 Frame-frame match

航迹先验为探测目标运动的先验信息,定义第t帧的航迹先验为Zt=[zt,1,zt,2,…zt,Nt]∈RDz×Nt,其中zt,s=[xt,s,yt,s,vt,s…]T∈RDz×1表示第s条航迹的位置和速度等,s∈[1,St],Dz为航迹先验维度,St为第t帧的航迹条数。此时,t-1 帧的航迹先验Zt-1与t-1 帧的实例中心Xt-1具有相同的物理信息,t帧的航迹先验Zt和t帧的散射点Yt同理。此外,Zt-1和Zt的对应关系由航迹编号s直接获得。因此,该模块将Xt-1和Yt的匹配问题转化为Xt-1和Zt-1、Zt和Yt的匹配问题。

Xt-1和Zt-1的匹配问题通过最近邻算法[25]求解,定义Θai表示第a个实例中心xt-1,a和第i条航迹zt-1,i的匹配关系,Θai=1表示匹配成功,反之Θai=0。

Yt和Zt的匹配问题通过门限法求解。求解步骤如下:

步骤1:计算第b个散射点yt,b与第i条航迹zt,i的余弦相似度ωi,b,公式如下:

步骤2:找到第b个散射点余弦相似度最大值对应的航迹先验编号Γb:

步骤3:基于下述判决准则建立表示第i条航迹和第b个散射点的匹配关系Φib:

其中,Φib=1表示匹配成功,反之Φib=0。

步骤4:实例中心Xt-1与散射点Yt之间的映射关系Ψab由Θai和Φib计算得到:

其中,Ψab=1表示匹配成功,反之Ψab=0。

2.3 特征融合

基于上述匹配关系Ψab即可融合t帧散射点特征γt和t-1 帧的实例特征Ωt-1,得到网络分割模块的最终输入,其中,第b个散射点的融合后特征由第b个散射点特征γt,b和匹配成功的实例特征Ωt-1,a计算得到:

当没有匹配所属实例中心的散射点存在时,算法认为该散射点属于为t帧新进入雷达观测的实例。使用原始高维语义特征作为融合后特征即可,即=γt,b。

2.4 分割网络

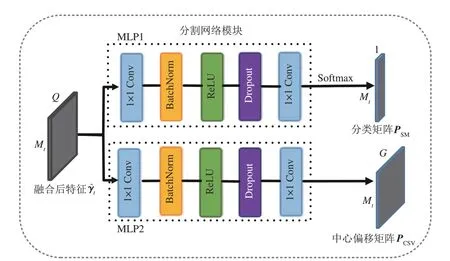

图4 展示了分割网络具体实现模块。在t帧特征融合模块得到的特征图分别通过2个多层感知机(Multi-Layer Perceptron,MLP),即MLP1和MLP2处理,得到散射点分类矩阵PSM和中心偏移矢量PCSV。

图4 分割网络模块Fig.4 Segmentation network

MLP1 和MLP2 模块均由卷积核为1×1 卷积层conv 实现。激活函数选择ReLU(Rectified Linear Unit),搭配使用批归一化(Batch Normalization)和随机失活(Dropout)缓解模型过拟合。网络不同分支的头部结构如下所示:

其中,公式(8)中第一行的常量4表征该散射点属于各类别的概率;D为原始散射点的物理信息维度,包括散射点的x坐标偏移量和y坐标偏移量和速度偏移量等。PSM对应每个散射点的类别,PCSV后续用于原始散射点补偿,补偿后的散射点再经过DBSCAN算法聚类。各散射点的聚类结果结合分类结果为该帧下的实例分割结果。

2.5 损失函数

网络的损失函数由分类损失函数LSEM和中心偏移矢量的直接损失函数LSHIFT加权计算得到,即L=LSEM+αLSHIFT,其中α为加权系数。假设第m个散射点的类别真值为lm,其网络预测的散射点所属类别为,则散射点类别的分类误差LSEM可通过计算lm和的交叉熵得到,。假设Δxgt为各观测点的真实中心偏移矢量,Δxpred为网络计算的用于补偿其位置的中心偏移矢量,则中心偏移矢量的预测误差LSHIFT是表征矢量Δxgt和Δxpred之间的角度损失LCS和表征两个矢量之间的长度损失LNIP的组合,LSHIFT=LCS+LNIP。其中,LCS和LNIP分别计算如下:

其中cos(Δxpred,i,Δxgt,i)表示Δxpred和Δxgt第i(1 ≤i≤f)维特征的矢量夹角的余弦值,ε一般取10-5,保证分母不为0。

3 实验分析

为验证特征融合后的分割算法精度,本文基于搭建的交通十字路口场景下的仿真数据集完成了实验验证。实验对比了所提算法与不使用融合特征的算法,后者包括传统分割算法、基于神经网络的分割算法。对于使用神经网络的算法,首先在训练集上完成算法的训练,然后利用数据驱动模型(卷积神经网络)在测试集进行了和传统方法分割性能的对比试验。本节主要介绍了验证算法所使用的数据集、算法参数设置、对比算法和实验结果。

3.1 实验设置

数据集基于MATLAB 软件Driving Scenario Designer(DSD)生成。软件通过在探测车辆上安装毫米波雷达,能直接得到连续时间下的散射点云数据。该数据包含各散射点在直角坐标系和极坐标系下的位置、速度、方位角,所属类别编号和所属实例编号。

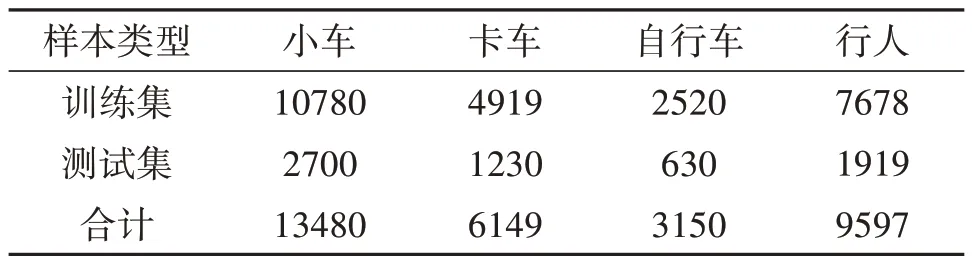

车载雷达的参数参考Radarscenes数据集设置。雷达采用77 GHz 近场毫米波雷达,其距离、速度和方位角分辨率分别为15 cm、0.36 m/s 和2°,方位角FOV 为±60°,帧周期为70 ms。场景设置为100 m×100 m 的交通十字路口,模拟了各类实例的运动情况。实例种类共计4 类:小车、大型车、二轮车和行人,占比约为0.46∶0.17∶0.09∶0.28。数据集按照4∶1划分训练集和测试集,具体样本分布如表1所示。

表1 仿真数据集样本分布Tab.1 Detail of dataset division

所有对比实验的参数设置为相同的值:训练批次大小为5,初始学习率为10-2,优化器为Adam。使用余弦退火迭代器,学习率每25个训练轮次重新启动一次。为了解决每一帧的散射点个数Nt不同的问题,我们对每个场景的每一帧散射点数目进行统计,得到max(Nt)和mean(Nt),以确定样本量。参考了文献[19]的处理方式,在训练和测试时将散射点数目固定设置为200,略大于mean(Nt),保证保留了大部分样本信息外不增加计算成本。

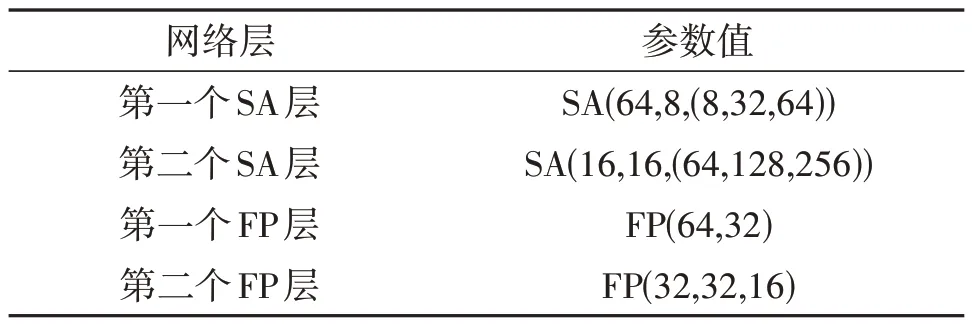

基于单帧散射点数目和场景大小,我们要求PointNet++网络具有两个SA 层和两个对应的FP层。第一个SA 层的采样点数设置为64,采样半径为8 m。这些参数的设计使得所有采样周期将覆盖整个视场,并有适当的重叠。其他各层的网络参数见表2。SA 层参数SA(Nsample,Rsample,(c1,…cd))表示在每个散射点的采样半径Rsample内选取Nsample个采样点,通过d层卷积核为1×1,输出通道数为[c1,…cd]的卷积层完成采样;FP 层参数FP(c1,…cd)表示d层卷积核为1×1,输出通道数为(c1,…cd)的卷积层。此外,BatchNorm 和ReLU 在两个连续的卷积层之间使用,gMLP块不改变输出特征向量的维数,因此可以直接附加在每个SA或FP的后面。

表2 网络参数Tab.2 Network parameter

3.2 对比算法

传统实例分割方案:方案原理图如图5 所示。该方案对单帧散射点观测进行聚类,然后将每个聚类后的实例发送给分类器得到预测的类别。分类器可选择支持向量机(Support Vector Machine,SVM)或RF 等。本次对比实验选择的聚类和分类算法分别为DBSCAN 和RF。使用DBSCAN 估计得到每个散射点的实例编号,相同实例的散射点物理特征经过简单统计处理后作为随机森林分类器的输入。统计处理参考文献,具体包括计算距离、方位角、径向速度的平均值、极值和偏差等[14]。

图5 传统实例分割方案Fig.5 Traditional instance segmentation method

PointNet++分割方案:图6为方案架构图。该方案[9]基于PointNet++的语义分割版本设计,新加入了一个网络计算分支,用于估计每个散射点到其对应实例的几何中心在潜在空间中的偏移量CSV。算法首先利用CSV 将每个散射点偏移到对应的预测实例中心。接着使用DBSCAN 算法对偏移后的散射点进行聚类,得到每个散射点的实例编号。最后,配合分类矩阵预测得到的散射点语义类别完成实例分割。

图6 基于PointNet++的分割方案架构图Fig.6 Segmentation method based on PointNet++and CSV

3.3 实验结果

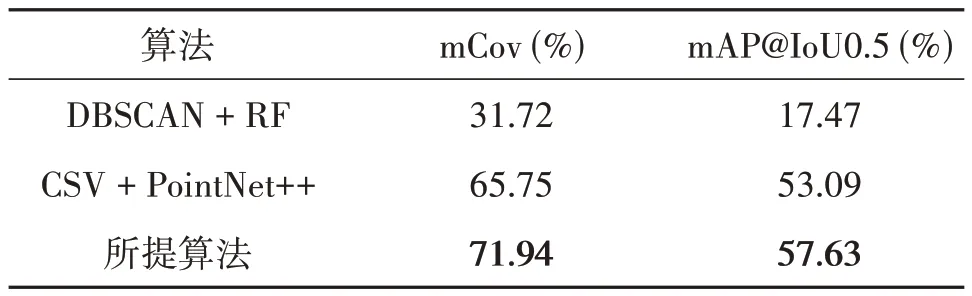

基于上述仿真数据集开展实验,实验设置中保持各算法的参数和损失函数一致。测试的50个交通场景中,每个场景均存在同一实例的散射点相距较远和多个实例密集分布导致遮挡的复杂情况。因此本节从典型场景的分割可视化图和测试集的评价指标表两方面定性和定量地对实验结果展示和分析。其中,典型场景的分割可视化图见图7、图8 和图9,经典算法的评价指标结果见表3,消融实验结果见表4。这些实验结果强调了我们提出的算法在应对复杂车载毫米波雷达场景时的潜在优势。

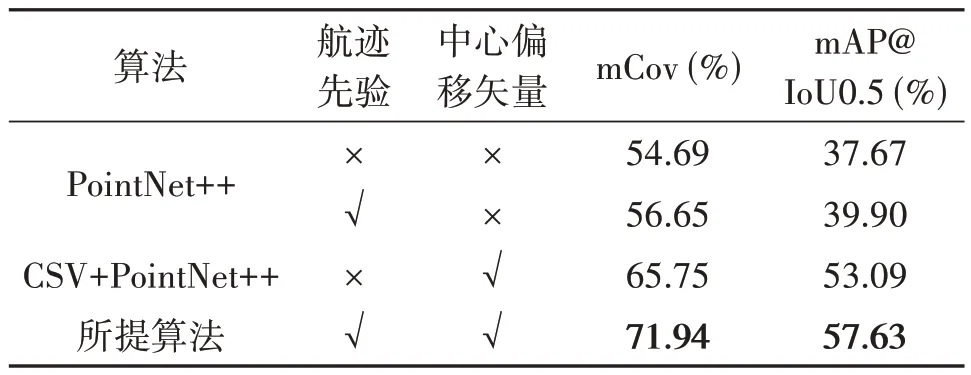

表3 算法对比结果Tab.3 Comparison of mCov and mAP on test data

表4 消融实验结果对比Tab.4 Comparison of different models on test data

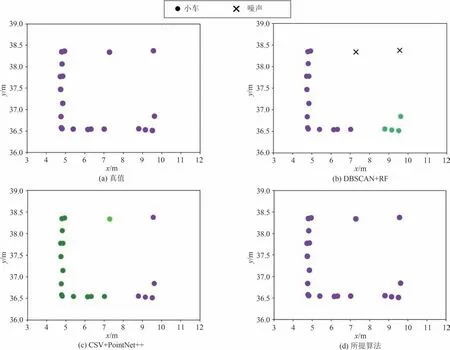

图7 典型实例分割结果可视化对比图Fig.7 Comparison of segmentation results in typical instance

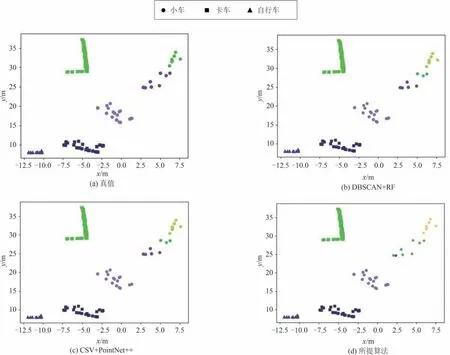

图8 典型场景分割结果可视化对比图Fig.8 Comparison of segmentation results in typical scene

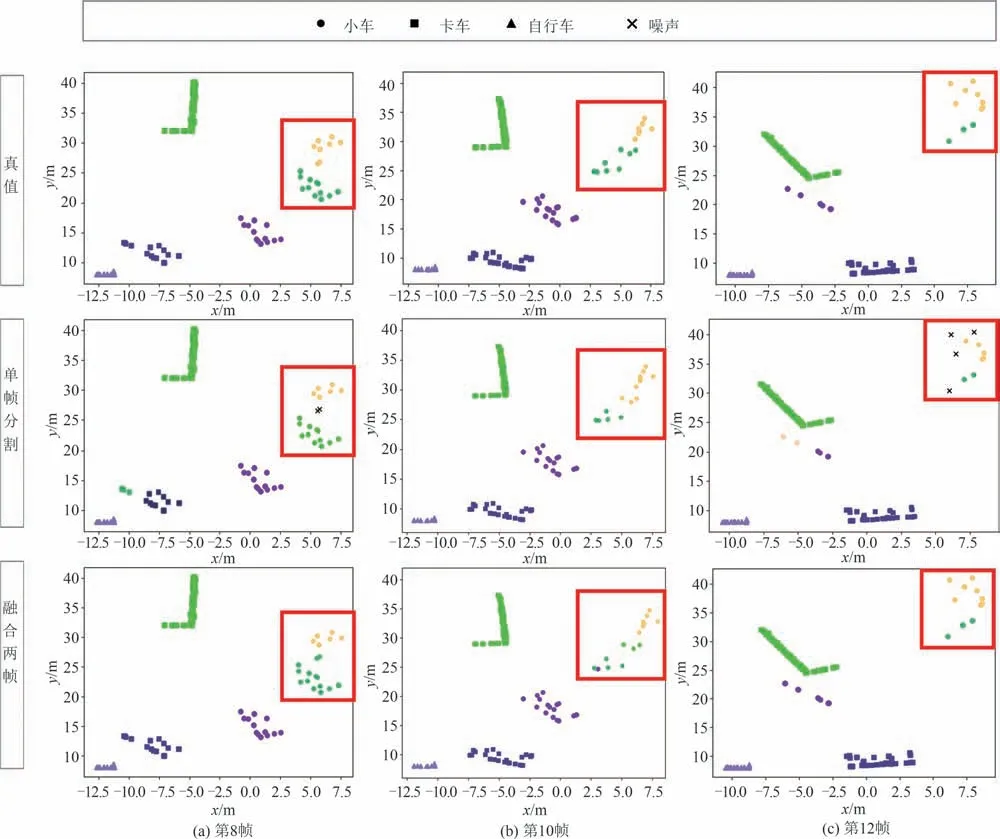

图9 连续时间分割结果可视化图Fig.9 Visualization of continuous timestep segmentation results

为分析算法对复杂交通场景的分割情况,图7和图8分别是利用不同算法对单个小车和密集分布多目标场景分割的可视化结果。目标类别见图最上方,其中×代表算法标记该散射点为噪声,(a)为实例的真值;(b)为不使用偏移矢量补偿散射点的传统分割算法(DBSCAN+RF);(c)为不使用航迹先验的PointNet++算法;(d)为本文所提算法。

可以观察到,由于目标被行人遮挡,因此x坐标8 m 附近无散射点。经典算法均无法正确分割,导致目标“ID 分裂”,小车被分割为多个目标及噪声,而所提算法由于引入CSV,将目标边缘的散射点聚集至目标质心,可以避免上述“分裂”出现。此外,交通区域内多个实例空间密集分布对分割算法带来极大挑战。在图8 的(b)和(c)中,右上角的小车实例被分割成为两个。(d)能有效应对相邻实例的分割问题,但由于所提算法只联合了一个历史帧,因此对于分布在边缘的散射点仍然存在分割错误的情况。

为体现使用航迹先验的效果,增加了单帧和联合两帧的可视化对比结果,如图9 所示。(a)~(c)分别为场景第8、10 和12 帧的可视化对比结果。在第12 帧,雷达右前方视野存在卡车的遮挡,因此右前方的散射点数量大大减小。但是由于航迹先验的约束,算法仍能完全正确的分割出两个空间位置相邻的真实实例。可见引入航迹先验后,算法能有效克服上述遮挡问题,提高分割准确率。

此外,本文使用实例分割指标——平均覆盖率(Mean Coverage,mCov)和平均精度(Mean Average Precision,mAP)评价最终实例预测值和真值,其中平均精度mAP 是在交并比(Intersection Over Union,IoU)阈值为0.5 时计算得到,下文统一表示为mAP@IoU0.5。

表3展示了不同的分割算法在仿真数据集上的对比结果。传统分割方案的mCov 和mAP 仅为31.72% 和17.47%;基于PointNet++的分割方案mCov 和mAP 分别达到65.75%和53.09%;而所提算法利用航迹先验融合上一帧的实例特征,CSV 计算效果更好,指标分别提升了6.19%和4.54%,进一步提高了聚类效果,证明了所提适用于稀疏雷达观测的实例分割。

为证明融合历史特征的有效性,我们增加了纯基于PointNet++的分割方案和仅使用航迹先验基于PointNet++的分割方案作为对比,结果如表4 所示。在没有中心偏移矢量的纯分割方案中,融合历史特征后的mCov 有提升但仅提升了1.96%,而融合带来的网络参数量大大增加。从算法性能提升方面评价,所提的融合方案更适用于使用了中心偏移矢量的分割网络。

综上,基于聚类的分类方法可能会得到错误的实例和语义估计,而基于偏移矢量补偿散射点的PointNet++算法纠正了部分估计,但无法应对分布在目标轮廓边缘的单个散射点。本文所提算法在航迹先验的约束下提供了更好的估计,对这种特定情况能实现更好的分割。

4 结论

复杂行车场景中,交通参与物尺寸及空间分布各异且遮挡频繁发生,导致实例分割性能大大降低,严重影响智能驾驶中的环境感知。本文利用实际行车场景的时间连续性,引入包含上一时刻和当前时刻探测目标运动的先验信息辅助分割,进而提出了一种新的车载雷达实例分割策略,即利用航迹先验融合上一帧的实例特征增强不同实例的特征差异性,再基于PointNet++和DBSCAN完成实例分割。在仿真数据集中测试所提算法的有效性,平均覆盖率mCov 达到71.94%,平均精度mAP 在IoU 阈值为0.5时达到57.63%,优于其他文献所提算法。典型场景的可视化结果也表明所提算法的有效性。相较于单帧,所提算法在航迹先验的约束下,融合后的散射点特征不仅信息更丰富,不同实例间的特征差异更明显,而且能弥补由于遮挡导致的实例信息缺失,更好的实现复杂行车环境感知。然而,算法性能也存在局限性。考虑到算法的时间与空间复杂度随联合帧数增加而增加,因此所提算法只联合了一个历史帧。这导致算法对于分布在边缘的单个散射点仍然存在分割错误的情况。后续可以采用迁移学习或自监督学习来更好地利用多帧数据。