基于全局响应的多级融合监督显著性目标检测

陈 慧,彭 力

1.江南大学 物联网工程学院,江苏 无锡 214122

2.无锡职业技术学院 物联网技术学院 江苏 无锡 214121

显著性目标检测是目标检测领域的一个重要分支,有别于凭借相似特性划分全图区域的图像分割任务,显著性目标检测旨在从图像中寻找最吸引人眼注意力的主体目标,即显著性区域。随着深度学习的不断发展,卷积神经网络在显著性目标检测中得到了广泛应用,并取得了很大的进展。作为计算机视觉的前序任务,显著性目标检测算法的合理应用能够高效处理当前呈爆炸式增长的图像资源,更快地获取关键信息。

传统的显著性目标检测方法主要分为使用内部线索的基于块的检测模型、使用图像内部线索的基于区域的检测模型和引入图像外部线索的检测模型,其主要受鲜明的颜色对比和方向差异等显著性物体特征启发,靠手工制作的特征来计算显著区域。然而这些方法依赖于大量的先验信息,具有很大的局限性,而且泛化能力差。为了更好地适应不同复杂场景,显著性检测算法开始使用深度学习方法来寻找显著性区域,其主要分为基于全卷积神经网络的算法和基于区域提取的算法。全卷积神经网络能够对任意大小的输入图像进行端到端的学习,通过在网络中添加显著性损失函数来训练网络,以达到找出显著性目标的目的。这类算法的代表性工作包括DeepGaze[1]、DeepFix[2]和Deep Contrast Network[3]等,其采用了类似于分类网络的结构,将图像分为显著区域和非显著区域。另一类基于区域提取的显著性目标检测算法则是通过从图像中提取一系列候选区域,再对这些区域进行显著性评估,最终选出显著性最高的区域作为显著性目标。这类算法的代表性工作包括Selective Search[4]、MCG[5]和RPN[6]等,其通过设计不同的区域选择策略和显著性评估方法,在保证检测准确率的前提下,大大提高了检测速度。

在深度学习技术的帮助下,显著性目标检测算法已经取得了很大的进展。但是,在检测中仍然存在一些问题,如在复杂背景下的检测效果不佳、对小目标的检测能力较弱以及无法准确预测目标边界等,这些问题仍需要进一步研究和改进。本文针对这些问题做出以下改进:

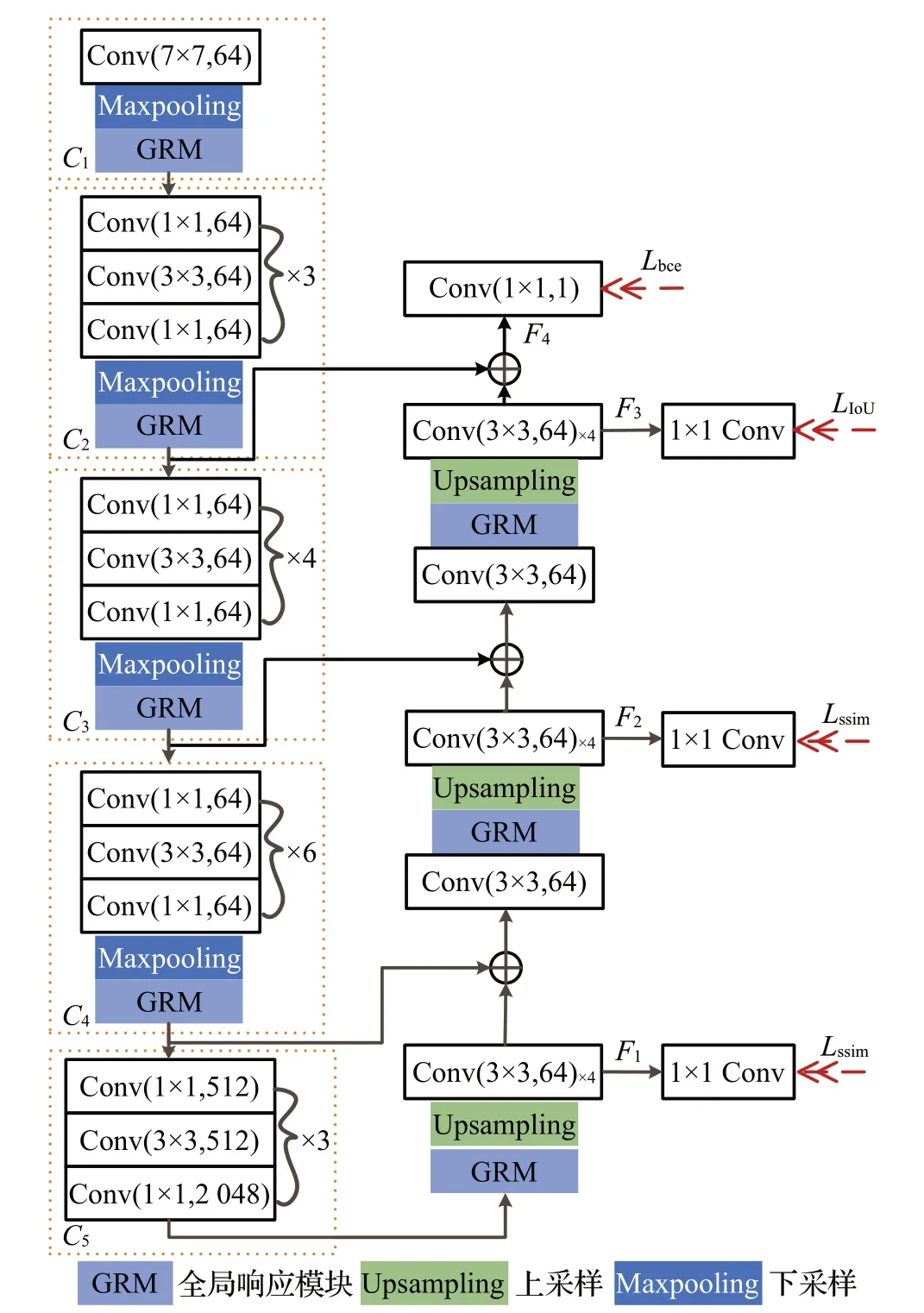

(1)提出基于全局响应的多级融合显著性目标检测算法,该算法采用了沙漏型的特征编解码结构,使网络拥有了更广泛的学习视野,短连接的引入则充分融合了不同尺度下的显著目标,提高模型对物体尺度变化的适应性。

(2)设计了全局响应模块(global response module,GRM),在特征提取初期从整体和局部两个角度来学习目标的结构信息,并从空间和通道两个维度来增强了特征的高响应区域,不仅能强调图片的整体特征,还能显著提高模型的表征能力和网络的学习效率。

(3)在后期对三个尺度下的特征图进行了分层多级优化(layered and multi-level optimization,LMO)。对不同尺度和阶段下的显著图进行了监督,通过减小其与真实值之间的距离来校正预测结果,达到突出前景和抑制背景误判的作用。

相比于简单的融合策略,本文方法有效地利用不同阶段所学的特征特点,反复关注了目标的结构信息和空间分布,更好地定位了显著图像。多个数据集上的实验证明了本文方法的有效性和合理性。

1 相关工作

显著性目标检测主要的难点在于适应不同目标的尺度变化以及准确预测目标边界。

为了更好地适应目标的尺度多样性,一些研究引入多尺度特征融合、深度监督、短连接等来提高显著性目标检测性能。其中,DeepLab[7]引入空洞卷积和空洞空间金字塔池化模块来增加感受野。U-Net[8-10]系列则采用了编解码结构,通过跳跃连接对高级语义信息和低级特征进行融合以捕获多尺度特征。PoolNet[11]在最高层特征图后以及编解码途径上添加了特征增强模块,以更好地融合自上而下、自下而上及全局局部的输出特征,含有四个不同尺度的空间金字塔分支,该设计在一定程度上降低了重叠效应,提高了整个网络的感受野。GCPA[12]通过一些渐进的上下文感知特征交织聚合模块,有效地集成了低层外观特征、高层语义特征和全局上下文特征,并以有监督的方式生成显著图。同时利用空间和通道注意来减少信息冗余,并进一步细化和增强顶层特征输入特性,缓解高层次特征的稀释效应。AGR[13]采用了渐进式注意力机制,对深度卷积网络的感知特征做自顶而下的反馈操作,通过多次迭代来逐渐提高对不同尺度目标的检测能力。

为了获得更清晰、准确的边界,一些方法通过增强深度特征中的低层特征来学习更多的目标轮廓。ELD算法[14]和KSR 算法[15]通过编码低层特征距离来检测边界信息,但是轮廓有时会模糊,边界细节不足。相较于直接编码,DCL算法[16]增强了低层特征以获得更加清晰的边界。但是,此举容易导致显著性目标检测主体不准确,比如误检。AFNet[17]捕获了全局及边界特征,创新性地提出了边界增强损失,显著地加强了模型对边界的学习能力,提高了边界分类准确率;BASNet[18]提出hybrid loss。通过将交叉熵损失,结构相似性和交并比三种损失进行结合,让模型能够关注到图像的像素,区域和图片三个不同层级的显著性信息,从而获得更加精确的显著性结果。这类方法能够提取清晰的显著性目标边界,无关的显著性目标少了许多,显著性目标的检测准确度也更高。

2 本文方法

有别于计算回归框的目标检测,显著性目标检测的结果要更精细,要求网络准确定位到图片中的显著区域,并对目标进行像素级的分割。对此,本文采用强调早期特征空间结构、浅层特征深层特征交融的机制进行学习,提高网络不同尺度目标的检测性能。同时,还对每一层融合特征进行了监督,提高模型的学习能力,使其能够更好地聚焦前景。本文所提的基于全局响应的多级融合显著性目标检测算法采用了沙漏型的特征编解码结构充分学习不同尺度的特征,同时对其进行融合以提高模型对物体尺度变化的适应性。在编码阶段引入了全局响应模块从整体和局部两个角度来学习目标的结构信息,强调了高响应区域。解码阶段对三个尺度下的特征图进行了分层多级监督来校正预测结果,达到突出前景和抑制背景误判的作用。

2.1 网络结构

浅层网络提取的主要是细粒度特征,诸如颜色、纹理、轮廓等,但是此时网络感受野较小,特征图中存在大量噪声。随着感受野的扩大以及重叠区域增加,高级特征具有更深刻的语义信息,能够体现图片的整体性,但是分辨率很低,对细节的感知能力也较差。增强低层特征可以获得更清晰的边界预测,但容易造成显著性目标检测主体不准确的问题。过分关注高层语义特征能有效区分显著区域和非显著区域,但是会导致显著性目标边界模糊或多个显著性目标重合,为了获得更好的检测性能,各个阶段的特征都应该获得充分的利用和关注。

模型结构如图1所示,所提网络采用了对尺度变化包容性更强的沙漏结构,采用四个卷积块进行基础的特征学习,学习了每个位置局部的显著性,还搜索比较了全局颜色对比度、几何信息和局部显著性度量。此外,每个卷积块后都引入全局响应模块来从整体角度对每个对象候选区域的显著性进行了判断。在解码过程中,对应层之间引入短连接来在不同尺度上融合显著性线索互补学习不同视觉特征,同时对不同阶段下不同尺度的预测图f1,2,3,4进行监督,并在无损特征反射的指导下预测精确显著图。最后在浅层网络中搭建了全局响应模块来学习空间特征,全局响应模块不仅在感受野受限的阶段强调特征的整体结构,提高网络的学习效率,还能更快地锁定显著区域,减小无效目标的干扰,减少背景误判。

图1 网络结构Fig.1 Structure of network

2.2 全局响应模块

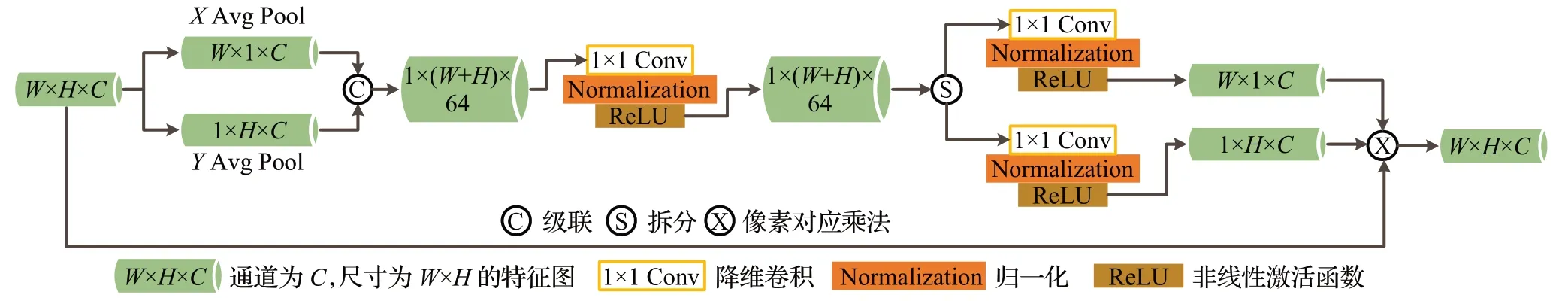

全局响应模块强调了该阶段特征在空间上的结构信息,该模块的引入主要是为了在感受野受限的特征学习初期考虑图片的全局信息,有助于网络更好的适应特征空间的复杂分布,其结构如图2所示。

图2 全局响应模块结构Fig.2 Structure of global response module

全局响应模块同时考虑了通道和平面内水平和垂直两个方向的信息,首先计算空间维度上横纵两个方向的特征响应,将其应用于对不同位置特征权重的调整,寻找该方向上的高响应区域。不同位置的显著性响应计算方式由公式(1)和(2)所示:

ℎ 和w分别为特征图的高和长,f为输入特征,mean()为不同方向上的取平均操作,计算了特征图每行每列的平均值作为空间响应向量来寻找特征图在水平方向和垂直的高响应位置。全局响应模块并对两个方向的响应特征进行了融合计算,保留了图片的全局特征,更强调整体性,实现了全局感知。之后采用通道注意力机制来计算通道间的响应值,使用该响应图对原特征通道进行加权调整,获得同时具备空间和通道维度重要特征探索能力的双向通道注意力图。最后切分双向通道注意力图,此时的响应图计算了特征图平面以及通道上的显著值,将其与初始输入特征图相乘,用不同位置的响应值来校准其重要性,以增强显著区域的表征能力。

全局响应模块通过寻找特征在空间和通道上的高响应区域来强调显著目标的全局结构特征。其在网络早期的频繁叠加使用可以提高网络的学习效率,通过强调三个方向的显著区域来滤除浅层背景区域噪声,使得网络能够更快更准确地锁定显著目标。

2.3 分层多级优化

在对图片进行学习的过程中,会在不同层级产生许多中间输出,为了监督不同层的学习结果同时提高提取效率,对后期阶段的四层输出显著图进行了监督。并针对不同层的特征,设计了不同的损失函数,最后对其进行整合,并通过网络后向传播对优化模型参数。

网络首先使用交叉熵损失函数对最终预测F4进行了评估,其计算方式如式(3)所示:

其中,x为真实标签,y为预测显著图,K为像素点总数。该公式计算了预测显著图与真实标签上每个位置上的平均误差,缺乏对整体图像预测的评估。

层数浅的特征F1和F2输出大多为充满背景噪声的低级特征,为了感知到像素点周围环境信息,使层数浅的特征F1和F2输出大多为充满背景噪声的低级特征,为了感知到像素点周围环境信息,使用对图片整体结构具有判断能力的结构相似性损失来计算显著图和真实图之间的距离。结构相似性损失函数定义如公式(4)所示:

其中,μx为x的均值,μy为y的均值,为x的方差,为y的方差,σxy为x和y的协方差,c1=(k1L)2,c2=(k2L)2为两个常数,L为像素值的范围,k1=0.01,k2=0.03。

为了进一步强调目标的整体特征,对深层高级语义信息使用IoU损失监督整体的分割图像,其定义见公式(5):

最终本文方法用来优化模型参数、监督网络学习的损失函数如公式(6)所示:

其中,α和β为各损失函数对应的比重。本文网络采用U型结构来充分学习不同尺度下的显著目标,提高模型对物体尺度变化的适应性。在浅层网络搭建了全局响应模块,从空间和通道三个方向寻找并强调了高响应区域,提高网络的表征能力。此外,还引入跳跃连接来融合多层特征,用低级特征显著性图不断更新模糊显著图中的清晰详细的边界,此举可以细化物体的轮廓特征,获得更准确的边界预测。最后设计了分层多级优化来监督监督标签和显著图之间的残差,更好地定位显著性目标,同时抑制背景误判,显著提升了模型的综合性能。将对多层深度特征聚合到每个层的特征,在增强显著性细节的同时抑制中间显著图的非显著区域,从而减少了低级非显著区域,增强高级显著性细节。

相比于简单的继承多级特征,这一方法能够更有效地利用在不同层中生产的特征中编码的补充信息。此外,该模型还反复关注场景的空间分布,更好地定位显著图像,通过每个像素在图片上与其垂直和水平方向上“邻居”的关系细化显著性图。

3 实验

本章首先介绍实验所需的数据集和评价指标,然后介绍具体实现细节,最后对结果和消融实验结果进行定性和定量的分析。

3.1 相关数据集

相较于目标检测、语义分割等视觉任务,显著性目标检测数据集十分稀少。当前常用的14个目标级显著性检测数据集与语义级显著性检测数据集仅为COCO[19]数据集的数分之一大小。这主要受限于该类数据集制作方法的精细和复杂。本文主要在ECSSD[20]、DUTS[21]、PASCAL-S[22]、HKU-IS[23]、DUT-OMRON[24]五个数据集上进行研究。

ECSSD数据集由复杂场景显著性数据集(CSSD[25])扩展,在2013被香港中文大学的Yan公布,其包含1 000张具有复杂的显著物体结构和背景的图片,这些图像对于评估显著性目标检测模型在复杂场景下的性能非常有用。DUTS 数据集为目前数据量最大的显著性目标检测数据集,包含10 553 个训练图像和5 019 个测试图像,其训练图像来源于ImageNet DET[26]训练/验证集,测试图像来源于ImageNet DET 测试集和SUN[27]数据集,都包含非常重要的场景用于显著性检测。PASCAL-S数据集来自于PASCAL VOC 2010[28]分割比赛,为乔治亚理工学院的Li等人建立并在2014年公布。该数据集的特色在于图像中没有非常醒目的显著物体,主要由人类的眼动数据集标注,具有非常大的检测难度。HKU-IS数据集由香港大学的Li等人于2015年公布,包含4 447张高质量的显著图像和对应的像素级显著目标标签。该数据集的每张图像或许含有多个分散的显著物体,或许至少有1个显著物体在图像边界,或许显著物体与背景表观相似,这些图像可以用于评估显著性目标检测模型在复杂场景和多目标检测任务中的性能。DUTOMRON数据集包含了5 172张图像,由大连理工的Yang等人于2013年建立。该数据集的主要任务是显著物体检测,但也提供了眼动数据集,同时也包括了物体的标定框。因其涉及各类复杂背景,相比于其他显著性目标检测数据集,DUT-OMRON 具有更强的挑战性,并有着更大的研究空间。

这些数据集具有丰富的场景和目标,可用于训练和评估显著性目标检测模型,促进显著性目标检测技术的发展。本文将采用DUTS-TR作为训练集,ECSSD、DUTS-TE、PASCAL-S、HKU-IS和DUT-OMRON作为测试集。为节约篇幅,消融实验将采用最具代表性的DUTS 和DUTOMRON进行对比分析。

3.2 评价指标

显著性目标检测的评价指标主要包括平均绝对误差(mean absolute error,MAE)、PR曲线、F值和S值。

平均绝对误差用来衡量预测结果与真实值之间的差异。由预测值与实际值之间绝对误差的平均值来定义。计算公式如下:

其中,N为图片中的像素点总和,x(i)为每个位置上的预测值,y(i)为每个位置上的真实标签值,为1 说明该位置为显著区域,为0则说明该点为背景。MAE越小说明预测结果越接近实际值。

PR 曲线是一种用于评估分类模型性能的图形工具,它显示了精确率和召回率之间的关系。精确率是被正确预测的显著区域占所有被预测为正样本的数量的比例,召回率是正确预测的显著区域占所有实际显著区域的比例。PR曲线下的面积(AUC-PR)越大,说明分类模型的性能越好。因为精确率综合考虑了TP 和FP 的值,因此在极度不平衡的数据下,PR曲线可能更实用。

F值是精确率和召回率的调和平均值,用于综合评价模型性能。其计算公式如下:

其中,β设置为0.3,F 值的取值范围为0 到1,越接近1说明模型的性能越好。

S值是一种衡量预测显著图与显著图标签相似性的指标,它考虑了图像的亮度、对比度和结构信息。与传统的均方误差(MSE)等指标相比,S值更符合人类视觉系统的特性。S值的计算公式如下:

其中,Sr为基于区域的结构相似性,So为基于目标的结构相似性。根据经验被设置为0.5。S值的取值范围为-1 到1,越接近1说明两幅图像越相似。

3.3 实现细节

实验使用DUTS-TR作为训练集,ECSSD、PASCAL-S、DUTS-TE、HKU-IS、DUT-OMRON作为测试集。为快速高效训练,模型使用ImageNet 预训练模型初始化网络参数。设置训练时每次将48张图像送入训练64轮。

3.4 实验结果对比分析

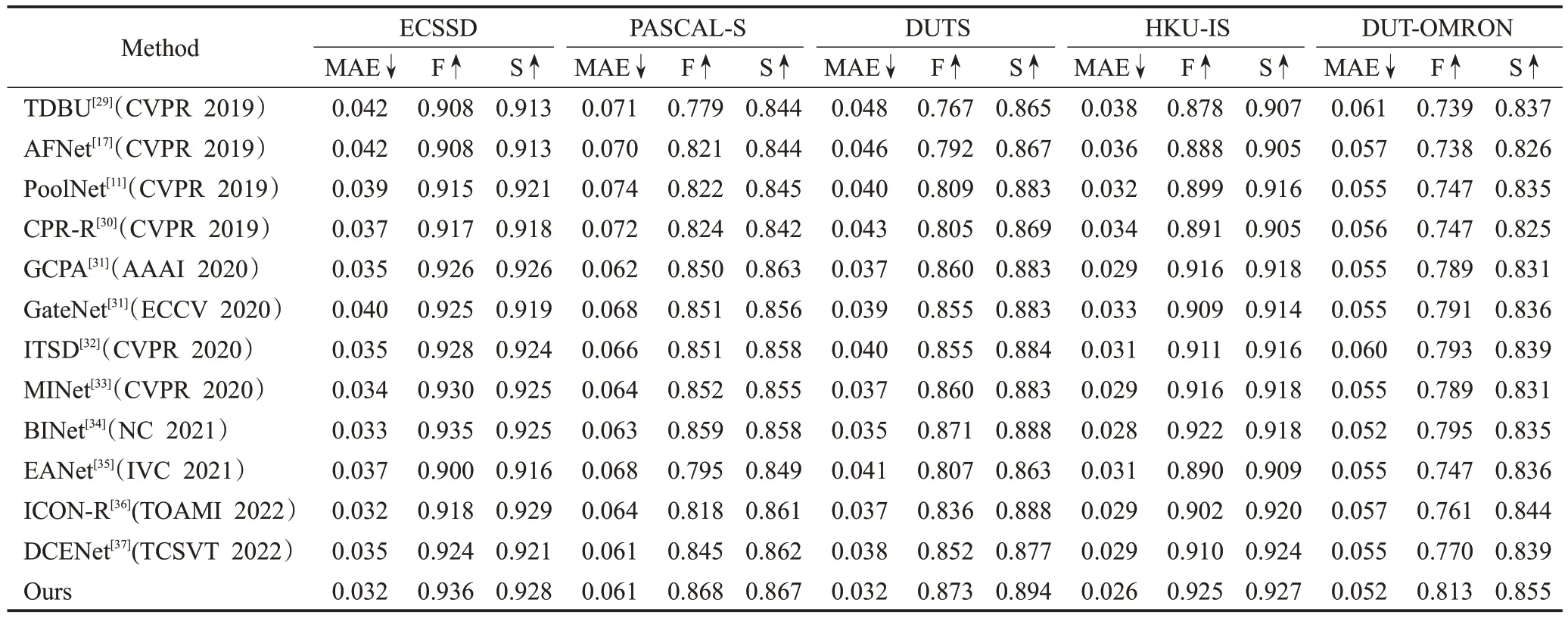

本节将所提模型同当前流行的其他卷积神经网络的显著性目标监测方法进行对比。对比方法包括TDBU[29]、AFNet[17]、PoolNet[11]、CPR-R[30]、GCPA[12]、GateNet[31]、ITSD[32]、MINet[33]、BINet[34]、EANet[35]、ICON-R[36]、DCENet[37]共 计12种方法。

3.4.1 定量分析

表1展示了本文方法和其他12种方法在5个数据集ECSSD、PASCAL-S、DUTS、HKU-IS以及DUT-OMRON上在各评价指标上的对比结果。可以看出,在数据集ECSSD 上,本文方法在MAE 和F 指标上均取得了最好的结果,而在S 指标上则是比表现最好的ICON-R 低了0.001。在数据集PASCAL-S 上,本文方法在MAE 指标上和最新的DCENet 持平,均为0.061,而在F 和S 指标上均取得了最好的结果。在数据集DUTS上,本文方法在各项指标上均取得了最好的结果。在数据集HKU-S上,本文方法在三项指标上均取得了最好的结果,而在数据集DUT-OMRON 上,本文方法在MAE指标取得的0.052 和BINet 持平,而在F 指标和S 指标上均为最高。经过和近几年先进算法的结果对比,本文方法在MAR、F、S指标上均表现出强大的性能。

表1 本文方法同其他先进方法的性能比较Table 1 Performance comparison of proposed method with other advanced methods

图3展示了本文方法和其他几种先进方法的PR曲线图,可以看出本文方法能够表现出更好的性能。

图3 本文方法和其他方法的PR曲线图Fig.3 PR curves of our model and other methods

3.4.2 定性分析

为进一步验证本文方法的性能,图4展示了本文方法和其他方法的可视化对比结果。得益于对不同尺度包容性更强的U型结构,本文方法能够有效地检测到不同尺度的显著目标。由图4 一、二行可以看出,对不同场景下的多尺度目标,本文方法均能够有效检测,并生产高质量显著图。得益于全局响应模块对深层次空间和通道信息的挖掘能力,本文方法能够有效区分显著目标和背景噪声。由图4 三、四行可以看出,对于背景中容易被误判的人拿的箱子、动物影子等噪声,本文方法能够较好地区分前背景,避免产生背景误判。得益于分层多级优化,本文方法能够深度分析高级特征,更准确地定位显著目标,得到清晰的边界。由图4 五、六行可以看出,对于结构复杂的厨具和椅子,本文方法均能对其准确定位,并生成边界清晰的显著图。

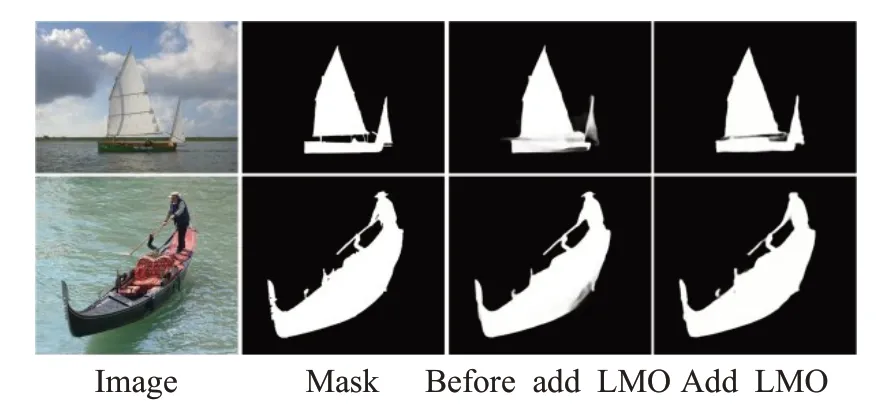

3.5 消融实验

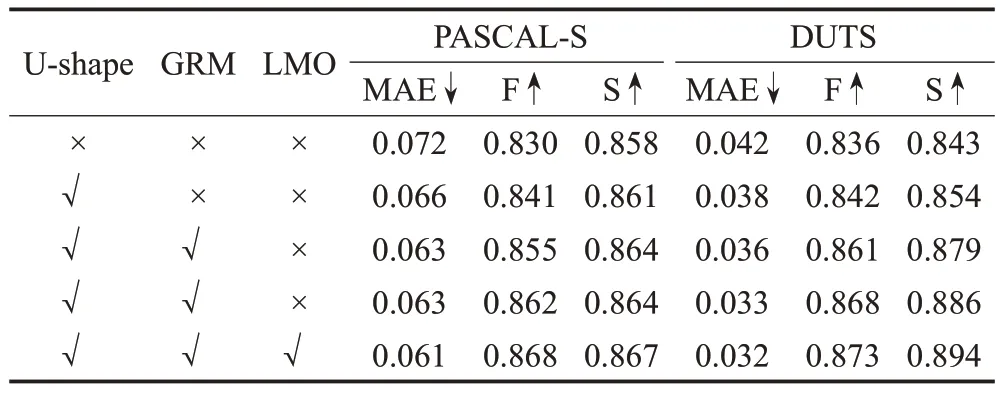

为验证所提内容有效性,本文在数据集PASCAL-S和DUTS 上进行了消融实验。采用ResNet-50[38]作为基础网络结构,之后将结构调整为U 型结构,并依次加入全局响应模块、分层多级优化。实验结果如表2 所示,使用U 型结构能够保证模型基本的准确性。在浅层堆叠全局响应模块强调特征地空间性后,模型的准确性得到了进一步的提高。最后使用分层多级优化,模型具备了目标定位与边界细化的能力,同时能够有效地区分显著图像中的前景和背景。每次加入所提模块后,各项指标均有所提升。

表2 消融实验Table 2 Ablation experiment

为了进一步验证提出各模块的有效性,图5展示了使用U 型结构前后的显著图。所选择的第一张图的化石体积大且具有复杂的结构,而第二张图的建筑物体积小且处在图像的边角位置,这两张图都要求模型在各种复杂场景均能够准确检测目标。可以看出,得益于U型结构对多尺度显著图的感知能力,模型能够比主干网络更加有效的检测出复杂场景下不同尺度的显著图像。

图5 主干网络和U型网络消融实验可视化Fig.5 Visualization of backbone network and U-shaped network ablation experiments

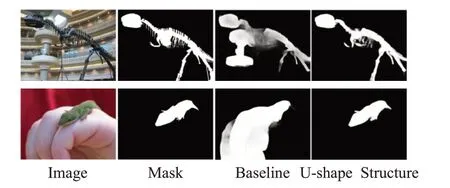

全局响应模块对图片各个方向的高响应区域都进行了增强,从噪声较多的特征提取初期开始重视网络的学习效率,显著提升了对前背景的区分能力。图6展示了加入全局响应模块前后的可视化对比结果,第一张图中的座位和第二张图中的标示牌都是易被误判为显著目标的背景噪声,要求模型能够对背景噪声和显著目标具有足够强大的区别能力。可以看出,加入全局响应模块后模型能够显著抑制背景误判。

图6 全局响应模块可视化消融实验Fig.6 Ablation of GRM

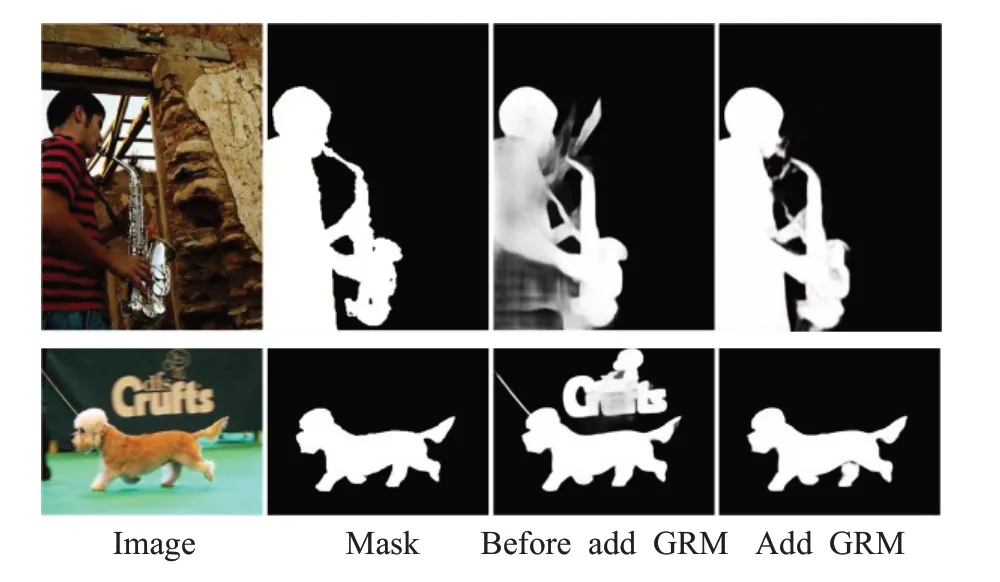

分层多级优化对不同阶段的高级特征进行了监督,通过像素级的校正更加准确地对目标进行定位并划分轮廓。图7 展示了加入分层多级优化前后的可视化结果,第一张图帆船和第二张图的小船,两者都具有复杂的边界,这要求模型具备充足的边界感值能力以适应不同目标的边界学习。相比于加入分层多级优化生成的显著图,加入后的模型生成的显著图像更清晰准确地展示了图像中作为显著目标的帆船的位置和轮廓。

图7 分层多级优化可视化消融实验Fig.7 Ablation of LMO

3.6 时间复杂度分析

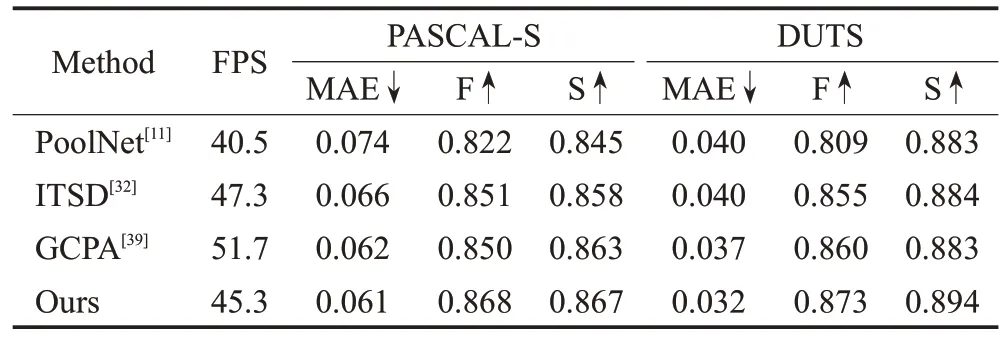

表3 展示了本文方法与现阶段其他先进方法在PASCAL-S和DUTS两个数据集上FPS的对比结果。由表3 可见,本文方法在每秒传输的帧数上相比ITSD 和GCPA相对较低,但是本文方法在MAE、F和S指标是表现出更好的结果。这说明本文方法更加注重显著性检测的准确性。

表3 时间复杂度对比Table 3 Comparison of time complexity

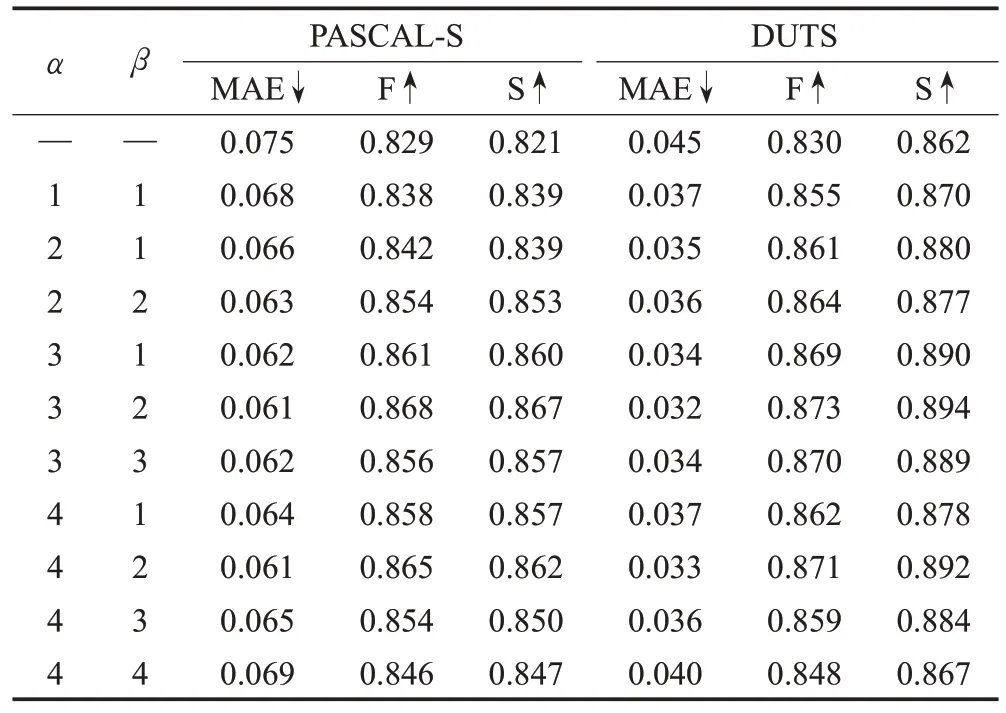

3.7 参数调优

为了取得最好的模型性能,表4 展示了在数据集PASCAL-S和DUTS两个数据集上损失函数中α和β的参数调优实验,其中第一行表示仅使用Lbce()F4作为总损失函数的结果。可以看出,在使用分层多级优化后,模型性能显著提升。同时,经过α和β不同取值下的结果对比,当α=3 且β=2 时,模型性能最佳。

表4 参数调优实验Table 4 Parameter tuning experiment

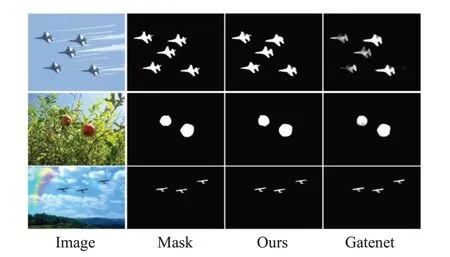

3.8 小目标检测

小目标检测作为显著性目标检测中特殊场景,具有数量多、分布广的特点。图8展示了本文方法在小目标检测中的可视化对比实验,选择的场景为天空中的飞机以及树丛中的果子,可以看到,得益于模型多尺度感知能力,本文方法检测到的小目标更加清晰准确。

图8 小目标检测实验Fig.8 Experiment on small object detection

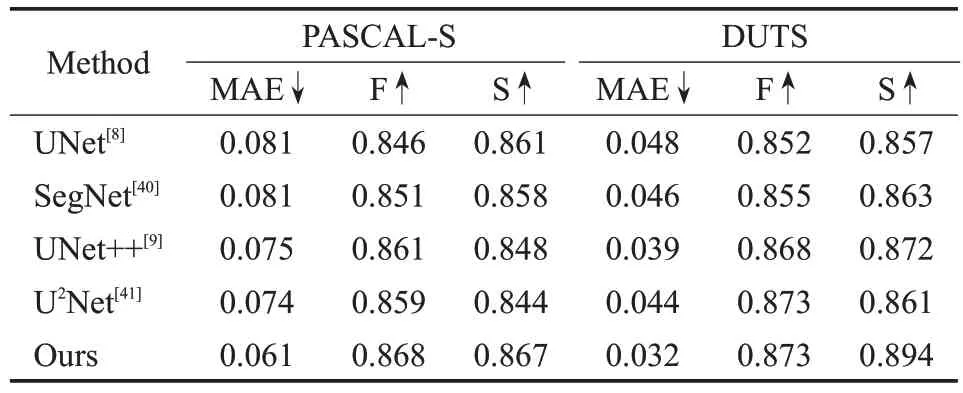

3.9 与图像分割算法对比

为展示本文方法在显著性目标检测针对性,表5展示了本文方法与典型的图像分割领域方法在PASCAL-S和DUTS两个数据集的对比结果。可以看到,相比于采用同样U型结构的图像分割算法UNet、UNet++,本文算法表现出更好的性能,而相比于显著性目标检测的U2Net,本文方法在各项指标上同样优秀。相比于采用基于编解码结构的图像分割算法SegNet,本文算法同样在MAE、F和S指标上表现更好。这说明相比于经典的图像分割算法,本文方法更适用于显著性目标检测。

表5 与图像分割算法对比Table 5 Comparison with image segmentation algorithms

4 结论

本文所提的基于全局响应的多级融合监督显著性目标检测算法主要通过扩大感受野、多层特征交融学习、强调多维高响应区域以及分层多级监督来寻找图片中的显著性目标,强调了目标结构及全局视野的重要性,充分利用了不同阶段特征的特性,提高了网络对目标尺度变化的感知能力以及对显著目标的敏感度。引入层间连接的U 型金字塔结构能够充分融合高级低级特征,在保留清晰目标边界的同时结合高级语义信息,在锁定显著区域的同时能够更好的分割前背景。浅层引入的全局响应模块计算了空间和通道维度上的显著值,在局部计算之外补充了图像的全局信息,强调了目标的整体性。最后在不同阶段对显著图进行了监督。实验结果均体现了所提方法的有效性。未来将进一步考虑设计合理的损失函数来提升网络的表征能力,更高效地利用不同阶段特征融合学习,更多地考虑将算法应用于实际的工程项目中。