多分支修复网络的沙尘降质图像增强算法

丁 元,邬开俊

兰州交通大学 电子与信息工程学院,兰州 730070

沙尘现象是由于大气中大量的悬浮沙尘颗粒对光线产生散射而造成的,由于沙尘颗粒对蓝紫光的吸收速度远快于对红橘光的吸收速度,因此沙尘图像不同于雾霾图像只有不同浓度的白色噪音,沙尘图像不仅浓度不同而且噪音颜色也是多种多样,这样的降质图像会对计算机视觉工作造成较大的影响。在沙尘天气中所拍摄到的图片,会因为大气中的沙尘影响导致成像效果产生模糊、颜色失真以及对比度降低的问题,如果在计算机视觉任务中采用这样的数据进行实验,会使得最终结果产生偏差。

相比较于R、G、B 值相同的雾霾图像成像条件,沙尘天气所得到的图像往往由于R、G、B值的衰减程度不同,而具有明显的偏置、浓度和先验特征。所以消除沙尘不仅仅要提高可视性,还要恢复色差,正是由于沙尘图像这样的性质,导致这是一项极具挑战的任务。也正是因为沙尘图像的色彩色差问题,所以不能直接采用去雾算法对沙尘图像进行处理,去雾算法往往可以恢复图像的清晰度但往往也会忽略对图像色彩的恢复。

为了解决沙尘图像清晰化以及色彩恢复问题,本文提出了一种融合色彩恢复子网的多分支沙尘降质图像增强算法,通过不同分支子网络的不同作用,对沙尘图像的细节、清晰度以及色彩进行恢复。本文的网络模型中第一个网络分支为预训练好的特征提取网络,即迁移学习子网(transfer learning subnet,TLSN),由于并没有大规模沙尘数据集,所以预训练模型有助于避免网络训练过程中产生过拟合现象,增强对当前数据特征提取的有效性。第二个网络分支的作用是对图像的色彩进行恢复,即色彩恢复子网(color recovery subnet,CRSN),由金字塔网络、灰色世界算法、带有颜色修复功能的归一化模块以及注意力机制构成,充分利用位置注意力特征图对所有像素之间的相似性的计算,获得特征图中任意两个位置之间的空间依赖。在该子网中保持图像增强之后原有分辨率,避免丢失图像的色彩特征信息。第三个网络分支为数据拟合子网(current data fitting subnet,DFSN),该子网针对当前数据进行网络更新,提高对当前输入数据的拟合能力。

本文的主要贡献:(1)提出一种端到端的沙尘图像增强模型;(2)提出一种新的图像色彩恢复子网络;(3)通过大气散射模型构建了一套不同浓度不同色彩的沙尘图像数据集;(4)证明了迁移学习在沙尘图像增强中的有效性;(5)展示了大量的实验结果,证明了网络在小数量、大尺度合成沙尘图像及真实沙尘图像增强上的有效性。

1 相关工作

由于数据集的缺乏以及任务的挑战性,沙尘图像增强任务近年来的发展并没有去雾领域发展的迅速,许多基于深度学习的去雾方法取得了很好的性能表现;而且去雾领域相关的竞赛也在一定程度上推动了这方面的发展。而沙尘图像增强增强的任务除了要消除沙尘对于图像清晰度得到影响,还要尽可能恢复图像的色彩,所以本章内容主要围绕这两个任务进行展开。

1.1 沙尘图像清晰化

朦胧图像清晰化方法分为两类:基于先验知识的方法和基于学习的方法。基于先验知识的方法通过估计透射图和大气光值,然后利用大气散射模型(atmospheric scattering model,ASM)[1]反演退化过程来实现清晰化朦胧图像。许多基于先验知识的方法在清晰化图像中表现出良好的性能,但是由于先验知识在实际应用中不容易获得,所以这类方法并不鲁棒。He等[2]提出通过暗通道先验(dark channel prior,DCP)的方法实现图像去雾,该方法对于大面积天空图像的清晰化效果并不好;Gao等[3]提出一种基于反转蓝色通道先验的沙尘图像恢复算法,通过DCP理论提高了沙尘退化图像的可见性。

近年来基于深度学习的图像清晰化方法发展越加迅速,其中DehazeNet[4]是第一个使用深度学习进行去雾工作的模型,其采用卷积神经网络(convolutional neural network,CNN)进行特征提取,然后采用ASM得到清晰化图像。AOD-Net[5]基于重新设计的大气散射模型,AOD-Net 不是像大多数先前模型那样分别估算透射图和大气光值,而是一次性估算透射图以及大气光值。这些依据于ASM的模型在进行沙尘图像训练测试之后会出现颜色失真的问题,因此出现了许多方法可以舍弃ASM 恢复图像,实现端到端的恢复过程。Qin 等[6]提出了带有注意力模块的FFA-Net,取得了很好的效果。Dudhane等[7]提出了一种去除浓雾的端到端可训练残差生成对抗网络模型,对于浓雾的清晰化效果得到了提升。Singh等[8]提出采用多UNet网络分别输出不同尺度特征再进行叠加操作的方式实现多尺度学习。Das等[9]提出了快速深度多补丁分级网络,在网络参数较少的情况下聚合来自不同空间区域的多个特征来恢复非均匀的雾霾图像。Yu 等[10]提出了双分支神经网络来处理去雾问题,在NTIRE2021去雾比赛中得到了第二的成绩[11]。

与去雾任务相比,沙尘图像清晰化算法需要考虑更多的色彩因素,尽管近几年有许多研究提出,但是结果并不尽如人意。目前的沙尘增强算法可以在一定程度上减轻沙尘对视觉的影响,但处理后的图像仍存在除尘不彻底、细节信息丢失、颜色失真等问题。刘春月等[12]提出了一种基于卷积神经网络的沙尘图像色彩恢复与增强方法,特别提到对沙尘图像的颜色进行恢复,但采用的数据集较为简单并且图像尺寸较小。其他沙尘图像清晰化算法大多是基于复原的算法和修改图像像素值以提高视觉质量,比如Gao等[13]提出将RGB沙尘图像转移到YUV空间,并首次创新性地使用颜色分量U、V来校正YUV空间中的颜色偏移,然后使用改进的Multiscale Retinex算法对Y分量进行处理,减少空气中散射光的影响,提高图像清晰度。Xu 等[14]提出了一种张量最小二乘优化模型,用于分解保留边缘的基础层和细节。该模型不仅分解了彩色图像,而且可以物理地揭示内在的颜色信息。相反基于学习的算法沙尘图像增强算法并不多,而且性能不如先进的图像去雾算法。

1.2 沙尘图像色彩恢复

1.2.1 沙尘图像的色彩分布

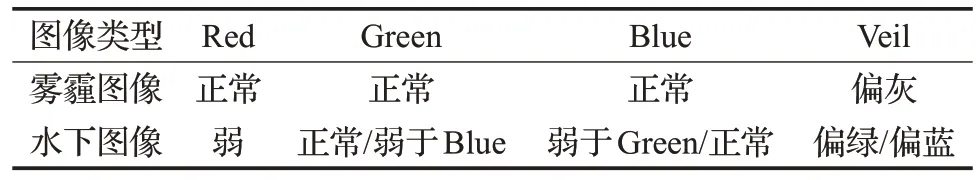

沙尘图像是一种典型的退化图像,与雾霾图像、水下图像类似,但是色彩分布各有其特点,表1 中展示了各种退化图像的色彩特点。

表1 退化图像的颜色特性Table 1 Color characteristics of degraded images

图1显示了雾霾图像、水下图像和沙尘图像及其对应的颜色直方图。图1(a)中雾霾图像其直方图显示R、G、B颜色分布类似;图1(b)中水下图像具有较强的蓝色分量;而图1(c)、(d)中沙尘图像的直方图显示图像的蓝色和绿色分量较弱,具有较强的红色分量,而沙尘图像偏红或者偏黄取决于绿色分量的强弱,绿色分量比蓝色分量强很多时图像偏黄,而绿色分量比蓝色分量略强时图像偏红。

图1 退化图像的颜色直方图Fig.1 Degraded image with its color histogram

1.2.2 沙尘图像色彩恢复方法

图像的色彩信息是图像增强和修复的重要依据,经过修复之后的图像色彩是否符合人眼的视觉体验是评判图像修复成功与否的一个关键因素。现在常见的图像颜色校正技术包括基于RGB颜色空间的灰色世界法(gray world algorithm,GWA)[15]、基于YUV颜色空间的白色补丁法(white patch algorithm,WPA)[16]。江兴方等[17]提出了用小尺度Retinex增强朦胧图像,利用图像中相应的像素替代原图像中阴影的区域,但是由于Retinex算法采用随机路径的方法估计像素颜色,因此带来了较大的计算量。Liu等[18]提出了采用颜色迁移的方法增强沙尘图像的颜色,但是该方法对于失真严重的图像处理略显乏力,依然存在一定的颜色失真问题。

虽然现在有许多较为成熟的图像色彩恢复方法,但大多数对于色彩单一且具有大块单一颜色的图像往往会失效。而沙尘图像存在单一的以黄色或红色为基调的色彩且范围较大,因此普通的图像色彩恢复算法在对沙尘图像进行恢复的过程中,效果往往不好。

2 本文方法

基于当前沙尘图像增强算法的不足,本文提出了融合色彩恢复子网的多分支沙尘降质图像增强算法。本章将详细说明TLSN、CRSN、DFSN的结构,最后给出损失函数的选择。

2.1 网络结构

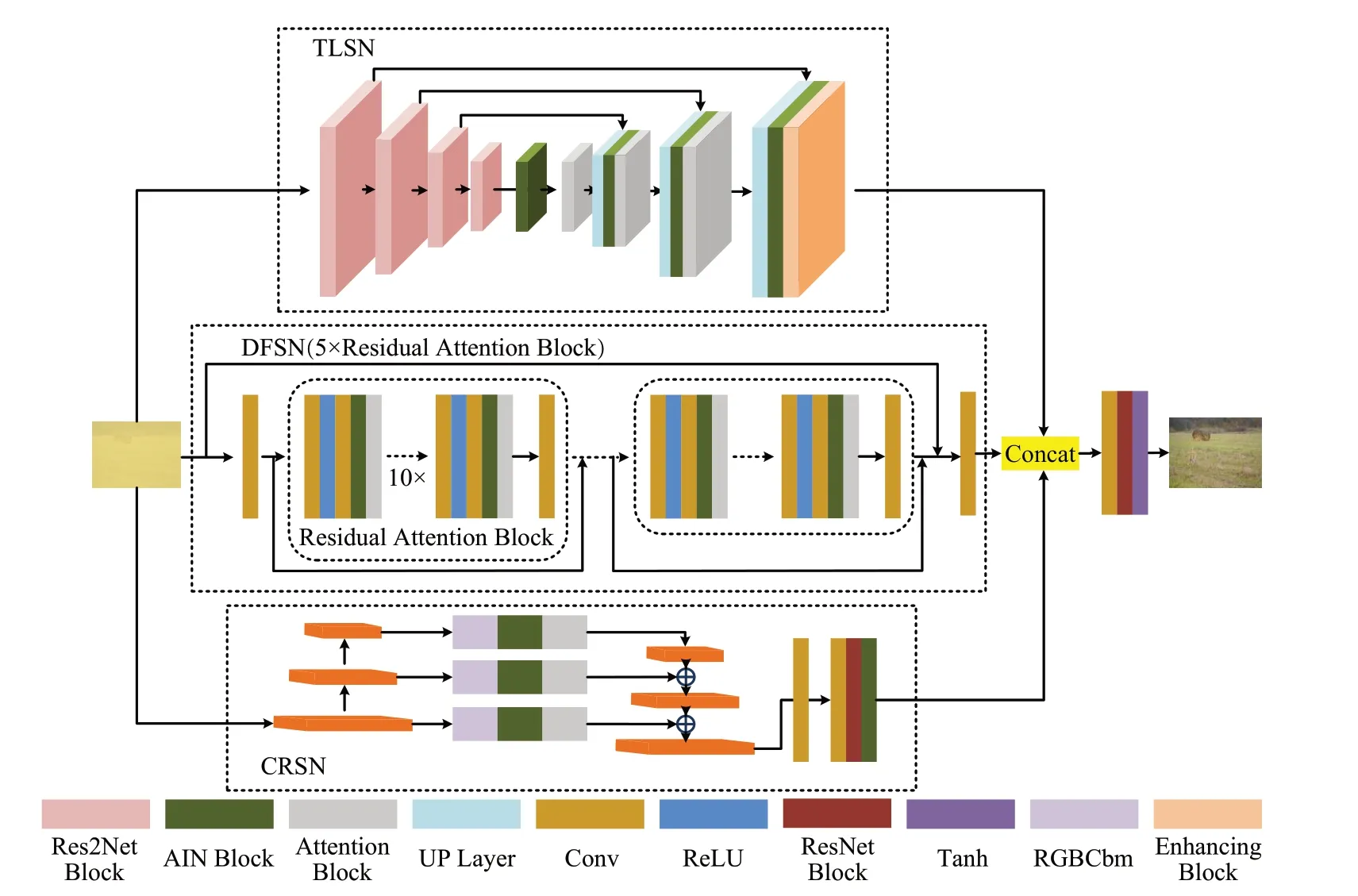

本方法网络总体结构由三个子网组成,如图2 所示。每一个子网都有其特定的作用,TLSN 由于加载了预先训练好的权重,因此用于从训练数据集中获取到更加鲁棒的特征表示;CRSN针对普通灰色世界算法的缺点,使得图像场景颜色并不丰富的时候也可以获得较好的色彩恢复;DFSN 通过对当前数据的处理,提高在所采用数据集上的表现。最后通过一个融合层将三个子网的结果叠加起来映射得到输出图像。

图2 总体模型结构Fig.2 Overall model structure

三个子网中均加入了具有色彩校正功能的自适应实例归一化模块(adaptive instance normalized blocks,AIN),如图3所示。AIN通过计算输入特征h的标准差对其进行归一化处理,然后对色彩校正的图像(y)进行卷积得到仿射变换参数γ*和β*,最后对归一化之后的特征进行仿射变换得到hout。训练过程中AIN 会对网络所产生的特征进行仿射变换以达到色彩校正的目的,自适应恢复网络中特征映射所存在的色彩失真问题,得到更好的去沙尘效果。

2.1.1 迁移学习子网

首先,由于沙尘图像没有高分辨率的大规模标准数据集,所以必须采用合成数据集并且最大限度地利用小规模数据,因此受到文献[19]启发,构建迁移学习子网并采用Res2Net 作为编码器来实现上述目的。使用Res2Net作为编码器,只采用了它的16次下采样层舍弃全连接层,并在残差块中加入特征注意力机制[20]。采用PixelShuffle[21]作上采样操作,将低分辨的特征图,通过卷积和多通道间的重组得到高分辨率的特征图。在训练阶段,迁移学习子网的训练参数通常可以采用加载在ImagesNet 数据集[22]上预训练好的参数,或者使用一个大规模相关数据集在其中直接训练参数,但是由于沙尘图像没有大规模高质量数据集,所以后一种方式被排除。而前一种方式虽然使用ImagesNet预训练参数是有效的,但是沙尘图像因为其色彩等方面的特殊性,本文也没有采用该方式。

结合上述两种方式,本文采用一个合成低分辨率大规模沙尘数据集(synthetic low resolution large scale dust images dataset,SLLD)在训练之前先预训练Res2Net网络的参数,该数据集拥有12 000对256×256×3大小的沙尘图像。在之后的小规模高质量数据集训练过程中载入在SLLD 上预训练好的Res2Net 网络参数,提高对特定图像的特征提取和表达能力。

2.1.2 色彩恢复子网

沙尘图像的恢复不仅仅包括对图像清晰度的恢复,还包括对其色彩的恢复。由于沙尘图像存在严重的色彩失真问题,整体图像表现为黄色或者红色,因此加入了色彩恢复子网,初步恢复图像色彩,提高特征提取的准确性。为此,提出了一种保持颜色分量均值的RGB色彩平衡方法(RGBCbm),采用以R、G、B 三通道分量均值为目标分别对分量进行归一化,使得颜色直方图分布更加均匀且贴近自然清晰图像,以达到颜色校正的目的。实验中RGBCbm算法处理一张图像(1 600×1 200×3)的时间仅0.086 s,远低于传统的灰色世界算法以及自动色彩均衡算法,后两者在相同图像规格的情况下处理时间分别为3.241 s和11.845 s。具体方法如公式(1)所示:

式中,Ic为输入图像的颜色通道;m(Ic)为计算颜色通道的均值;h(Ic)和l(Ic)为计算颜色通道的高像素值和低像素值,F为双边滤波处理去除噪音,c的取值为r、g、b。

具体过程为:色彩恢复子网首先通过采用一个小规模特征金字塔得到图像的多尺度结构图,然后对多尺度结构图采用RGBCbm 进行色彩校正,再结合AIN 模块和一个位置注意力模块进行归一化和特征映射,最后对处理之后的多尺度特征图进行特征融合,经过一个残差块进行特征提取,达到颜色校正的目的。

2.1.3 数据拟合子网

由于迁移学习子网采用了预训练模型参数,所以可能导致网络缺少对当前训练数据的拟合的信息,因此采用数据拟合子网来解决这一问题,采用通道注意力[23]结合残差块构造子模块。通道注意力有助于网络提高对训练数据的拟合能力,提高特征表示能力;残差块由于其跳跃连接的结构有助于减轻梯度消失问题。在该网络模块中训练数据的大小不会进行修改,避免上下采样对于数据特征的损失,全程采用全分辨率进行构建,进一步提高对数据的细节特征的提取,增强拟合能力。

2.1.4 三子网特征融合模块

本文网络采用三个子网分别对数据进行处理,因此需要一个特征融合模块对来自三个子网的不同特征进行融合得到最后的清晰化图像。具体来说,融合模块将各分支的输出结果叠加起来,然后通过卷积运算将融合特征映射为清晰图像。其结构采用双层卷积运算和一个Tanh激活函数组成。

2.2 损失函数

2.2.1 对抗损失

本文采用的数据集较小,因此单纯采用像素级损失不能很好地提高图像的全局一致性,而对抗损失(adversarial loss,ADLoss)[24]有助于解决这个问题。网络中加入使用马尔科夫判别器实现对输出图像和原清晰图像的对抗损失计算,其损失函数可以表示为公式(2):

式中,D为判别器;fθ(x)为增强后的清晰图像;D(fθ(x))为所处理图像是真实清晰图像的概率。

2.2.2 Smooth L1损失

使用L1损失可以有效改善对图像进行不精准估计时所产生的细节丢失问题,并且Smooth L1损失函数相比于L1 损失函数更加鲁棒,确保输出图像保有更多的细节信息[25],其损失函数可以表示为公式(3)、(4):

式中,yi和xi为清晰图像和预处理图像在i处的像素;fθ(xi)为以θ为参数的网络;N为总像素数。

2.2.3 感知损失

感知损失[26]可以通过对输出图像和真实图像的特征进行对比,有效减少它们之间的差异,本文采用预训练的VGG-19网络获得感知损失,其损失函数可以表示为公式(5):

式中,C、W、H分别为通道数、宽度和高度;x和y分别为预处理图像和清晰图像;fθ(x)为处理之后的预处理图像;V为非线性CNN 变换,由VGG 网络执行;N为感知损失中使用的特征个数。

2.2.4 全变分损失

全变分损失[27]可以在图像修复任务中依靠梯度下降流对图像进行平滑,去除伪影并消除噪声,其损失函数可以表示为公式(6):

式中,xi,j为预处理图像在i、j处的像素,求每一个像素和横向下一个像素差的平方,加上纵向下一个像素差的平方,然后开β/2 次根,默认β=2。

2.2.5 多尺度结构相似损失

多尺度结构相似损失(multi-scale structure similarity loss,MS-SSIM Loss)[28]的引入可以使得网络输出的图像更加符合人眼视觉体验,相比于结构相似损失(structure similarity loss,SSIM Loss)相当于基于多层的SSIM 损失函数,考虑了分辨率的影响,增加鲁棒性,其损失函数可以表示为公式(7)、(8):

式中,O、G分别为预处理图像和清晰图像中以像素i为中心的两个大小相同的窗口,对O、G进行高斯滤波并计算结果的均值μO、μG,标准差σO、σG以及协方差σOG。C为两个常量用来避免分母为零,l为亮度,cs为对比度和结构度量。α和β为默认参数。

最后将总的损失定义公式(9)为:

式中,A为平衡损失比例的超参数,其大小从1~5 分别为0.000 5、1、0.01、0.05、0.5。

3 实验与结果

对数据集的使用、训练细节、评估标准进行详细的阐述。然后将本文方法与其他先进的沙尘图像修复算法进行比较,但由于沙尘图像修复算法并不多且性能并不优越,因此加入了一些先进的去雾算法作为对比算法,最后加入消融实验阐明不同模块对网络整体性能的影响。

3.1 数据集

3.1.1 图像选择

在深度学习领域,所采用数据的质量关乎最终结果的好坏,而当前很多先进的沙尘图像清晰化算法采用的均是小分辨率图像,比如256×256×3,但是这样规模图像数据的特征以及提取特征的复杂性较为简单,与真实沙尘图像差距过大,会使得所训练的神经网络在处理真实沙尘图像的过程中不具有较强的鲁棒性和泛化性。因此本文采用NTIRE-(2020)数据集[29]、NTIRE-(2021)数据集[30]、Dense-Haze[31]和O-HAZE[32]数据集中的清晰图像进行合成沙尘图像的操作得到标准沙尘数据集,该数据集中图像大小为1 600×1 200×3,具有较高的分辨率以及更为复杂的图像特征,使得网络更具有鲁棒性和泛化性。对VOC数据集中的12 000张256×256×3的图像进行合成沙尘图像操作得到预训练数据集,保存网络在预训练数据集上训练的参数,之后对标准数据集进行训练的时候首先在TLSN上加载预训练参数,提高对图像特征提取的有效性。

NTIRE-(2020)包含45 张图像,NTIRE-(2021)数据集包含25张图像,Dense-Haze包含45张图像,O-HAZE数据集包含35 张图像,共150 张图像,根据需要删除其中的重复以及室内环境图像最终选择了112 张图像合成了沙尘图像标准数据集。真实沙尘图像数据集通过网络采集,共50 张图像进行测试。合成数据集和真实沙尘图像数据集定量比较结果均采用统一尺度的图像。

3.1.2 沙尘图像合成

由于缺乏配对的标准真实沙尘图像数据集,因此采用人工合成的方法构造配对的数据集。上一小节介绍了数据集图像的选择,这一小节着重介绍数据合成过程。合成沙尘图像数据类似于合成雾霾图像,同样利用大气散射模型[1]的公式(10)进行操作,如下所示:

式中,J(x)为清晰图像,I(x)为沙尘图像,x为像素位置,t(x)为图像场景透射率,A为大气光值。其中t(x)=e-βd(x),β为衰减系数,d(x)为场景深度图。

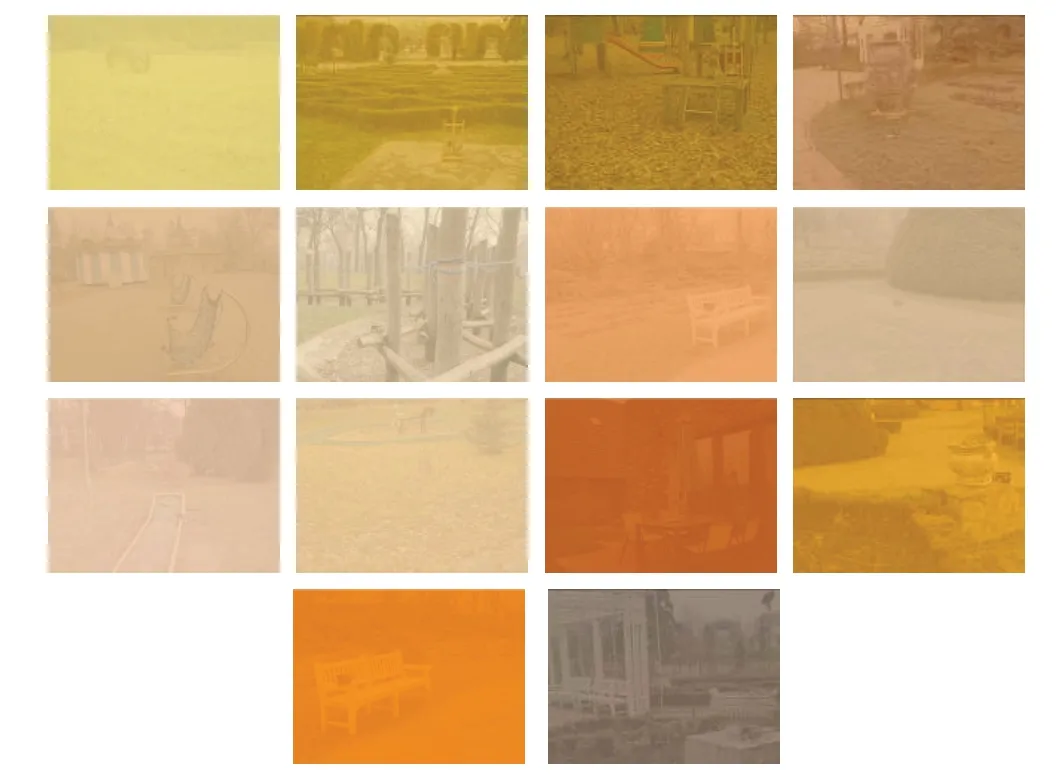

沙尘图像与雾霾图像合成的区别在于,雾霾图像合成过程中R、G、B 三通道所采用的大气光值相同,可以得到白色色调的雾霾图像。而沙尘图像由于其整体偏向黄色或者红色,因此在合成过程中R、G、B 三通道所采用的大气光值不同,通过实验不同的三通道大气光值组合,得到14种不同风格和色彩的沙尘图像,并通过调整衰减系数和中心位置尺寸得到不同浓度的沙尘图像,不同的风格颜色以及沙尘浓度的图像可以提高网络应对不同真实沙尘图像的鲁棒性并提高性能。利用文献[33]中的方法对图像场景深度进行估计,代入公式中。图4展示本次实验所合成的14种不同颜色风格的沙尘图像。

图4 多风格合成沙尘图像Fig.4 Multi-style synthetic sand dust images

3.2 训练细节

本文所采用的数据集包含112 张1 600×1 200×3 规格的图像,由于数据量不大,因此使用了随机角度翻转、水平翻转、垂直翻转和随机裁剪对数据集进行数据增强操作。优化器采用Adam优化器[34],β值采用默认0.9和0.999。训练1 000轮,初始学习率为0.000 1,600轮之后每200 轮学习率下降一半,有助于网络的收敛,算法采用Pytorch库实现。定量评价采用峰值信噪比(PSNR)和结构相似性(SSIM)。

预训练网络参数过程只采用迁移学习子网,在SLLD上进行参数预训练,网络训练50次迭代,初始学习率为0.000 2并且每隔10个迭代将学习率缩小为原来的一半。

3.3 实验结果及对比

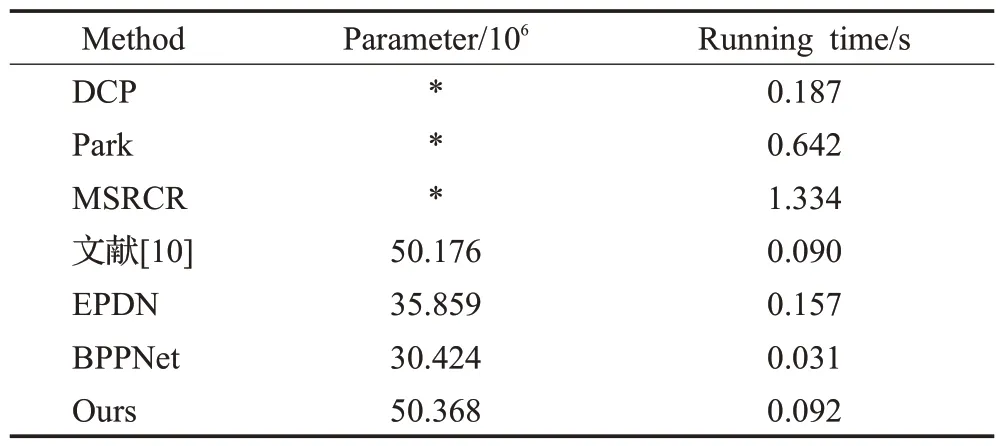

本节将展示本文算法在数据集上的表现,并选择了8种算法进行定性和定量的比较。8种对比算法中分别为4种典型的传统朦胧图像增强算法:包括DCP算法[2],该方法是2009年CVPR最佳论文,开启了图像去雾的一个新方法领域,根据暗通道先验得到大气散射模型中的参数,反推出清晰图像;Shi等[35],该算法包括三个组件:灰色世界理论的LAB 颜色空间中的颜色校正、使用减少光晕的DCP去雾方法的除尘以及改进的对比度限制自适应直方图均衡化;Park[36],该算法以获得一个一致的彩色直方图为目的,减少增强图像的偏蓝或偏红伪影;MSRCR[37],该算法利用彩色恢复因子,调节原始图像中3个颜色通道之间的比例关系,达到了消除图像色彩失真的目的。4种先进的基于深度学习的算法:包括BPPNet[8]、FSAD-NET[9]、文献[10]以及EPDN[38]。EPDN将有雾图像通过生成网络得到由透射图和大气光值联合估计的图像,通过改进的大气散射模型输出去雾图像。表2 给出了所选择的对比算法和本文算法处理每张图片(1 600×1 200×3)的网络参数总数和运行时间,本文算法中大部分参数来源于迁移学习子网,但由于下采样操作缩小了中间层的特征大小,从而加快了计算速度,所以尽管本文算法具有最多的参数,但运行时间仍然很快。实验数据集包括了合成数据集以及搜集得到的真实沙尘图像数据集,在两个数据集上分别进行定性和定量的比较。

表2 不同方法的参数总数和运行时间比较Table 2 Comparison of total number of parameters and running time for different methods

3.3.1 合成数据集实验结果

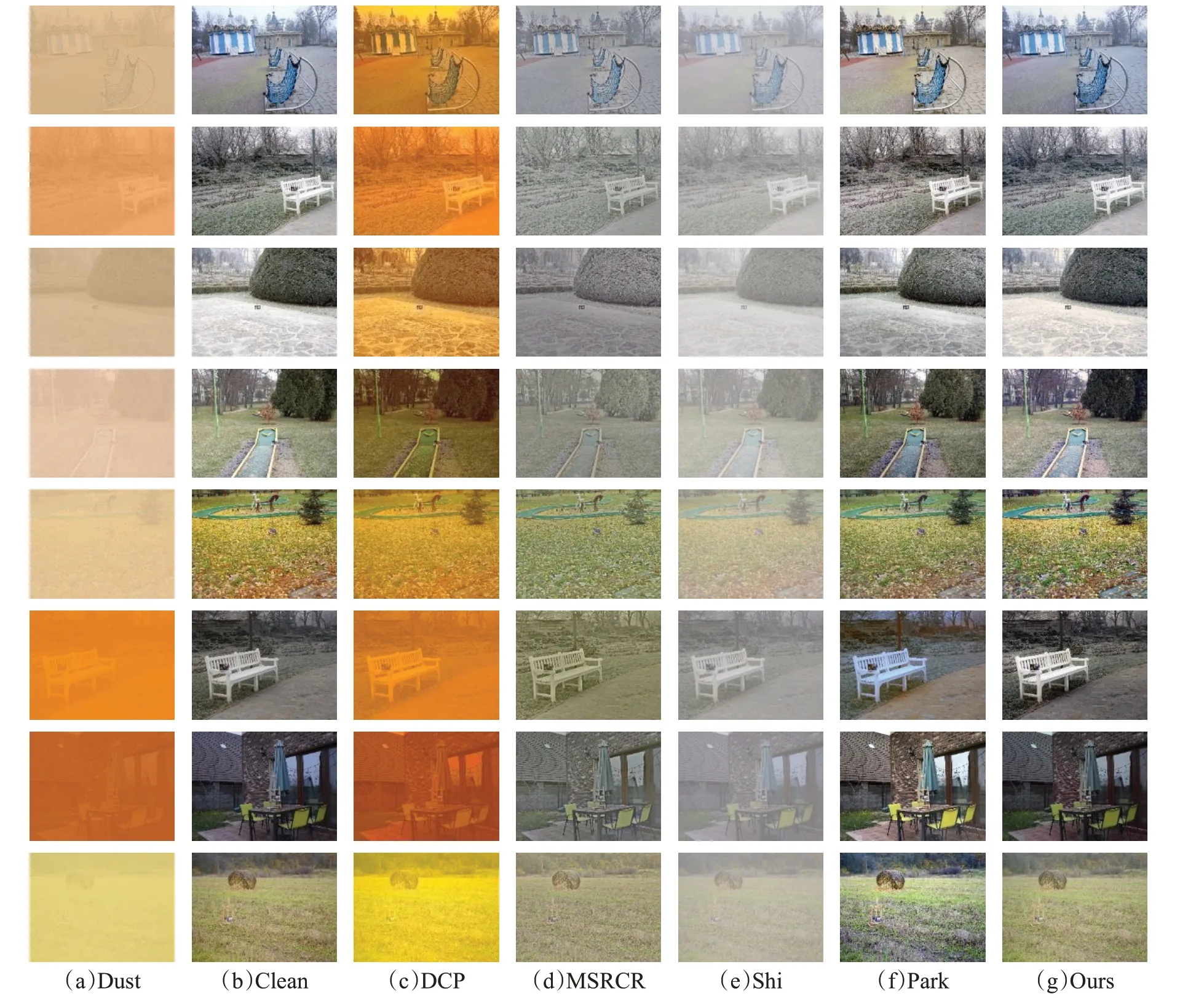

图5展示了本文算法与传统算法的定性比较结果,可以看出,DCP方法并不能去除图像的沙尘并且图像处理之后整体还是偏黄,但是可以在一定程度上显示图像内容;MSRCR方法可以去除图像的沙尘,但是在偏红图像上还是存在图像色彩失真的问题,并且在大规模绿色背景下会使得处理之后的图像偏白;Shi 方法可以去除图像整体偏黄或者偏红的色彩,但是又会出现类似雾霾图像的白色噪音;Park方法相较于其他传统方法取得了最好的结果,但是所恢复图像相比于原有图像的色彩较深,可能产生色差,但图像视觉较好。而本文算法在与这些传统算法的比较中产生了最符合原图色彩以及细节的清晰图像。表3 展示了本文算法与传统算法的定量比较结果,本文方法在平均PSNR 和平均SSIM 的比较中均取得了最好的结果。

图5 本文方法与传统方法在合成数据集上的比较Fig.5 Comparison of our method with traditional methods on synthesized test images

表3 不同方法在合成数据集上的定量比较结果Table 3 Quantitative comparison results of different methods on synthetic test images

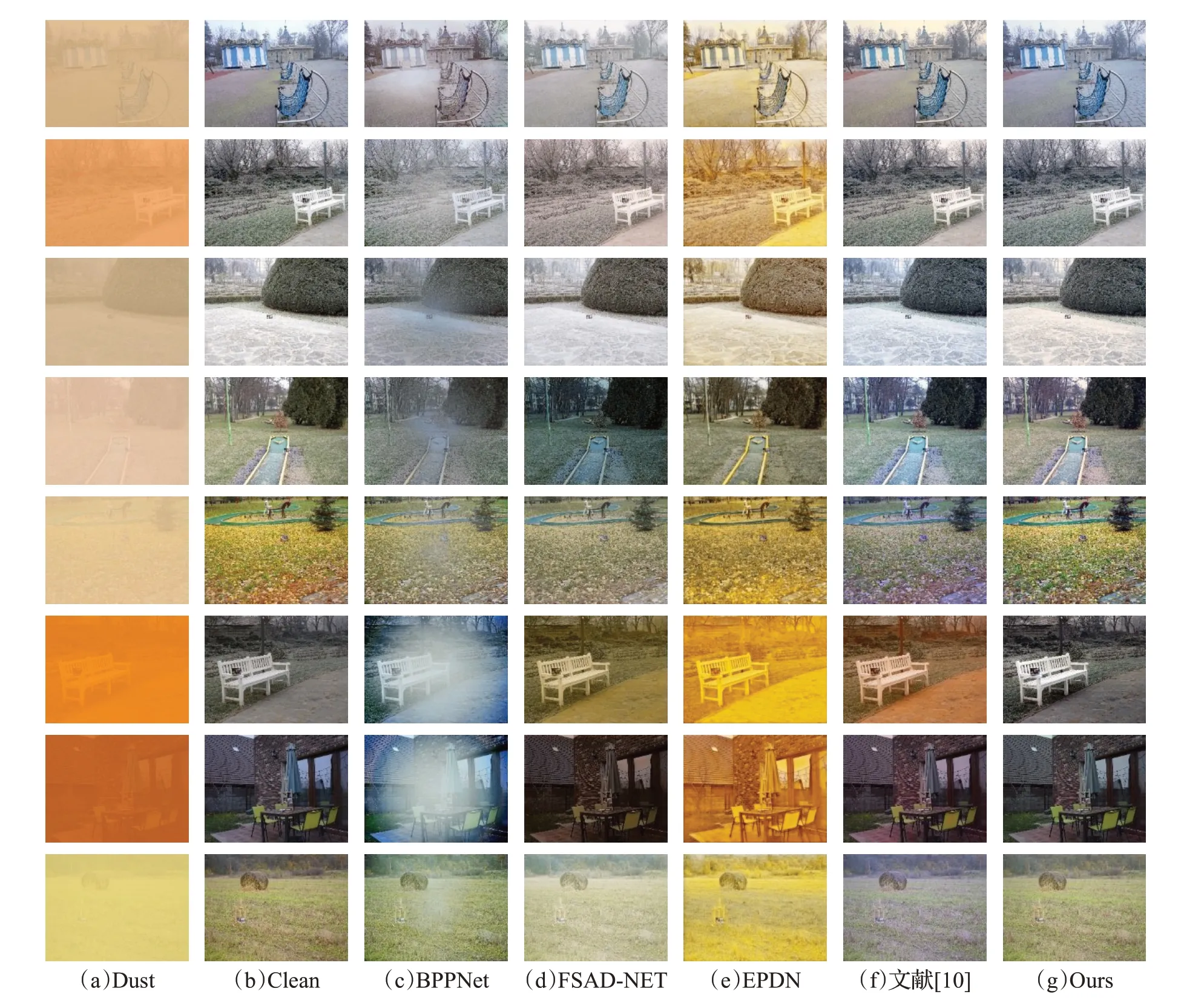

图6 展示了本文算法与基于深度学习算法在合成数据集上的定性比较结果,可以看出,BPPNet所产生的结果可以在一定程度上去除图像整体偏黄的色彩,但是图像无论时色彩还是细节恢复都不够完美,图像中心产生了明显的光晕,并且在沙尘颜色较深时尤为明显;FSAD-Net 较好地去除了图像中的沙尘,但是整体图像细节有白色噪音,而且在沙尘颜色较深时存在沙尘去除不彻底的问题;EPDN所产生的结果并没有去除图像中的沙尘,只是在一定程度上恢复了图像的细节;文献[10]取得了在所对比的基于深度学习的算法中最好的结果,有效去除了沙尘并恢复了图像细节,但是色彩恢复上存在色差问题。而本文算法在与这些基于深度学习的算法比较中产生了最符合实际色彩以及细节的清晰图像。表3 展示了本文算法与基于深度学习的算法的定量比较结果,本文方法在平均PSNR 和平均SSIM 的比较中均取得了最好的结果。

图6 与基于深度学习的方法在合成数据集上的比较Fig.6 Comparison with deep learning-based methods on synthetic datasets

3.3.2 真实数据集实验结果

为了验证训练模型可以对真实沙尘图像进行清晰化处理,本文采用在网络上搜集到的50 张真实沙尘天气图像对模型进行测试,图像大小采用双线性插值或裁剪调整为1 600×1 200×3。对比算法选择在合成数据集上表现最佳的两种传统方法和两种基于学习的方法,分别是:MSRCR、Park、FSAD-NET以及文献[10]。

图7 展示了本文方法与MSRCR、Park、FSAD-NET以及文献[10]在真实沙尘图像上的定性比较的结果。可以看出,MSRCR算法在应对真实沙尘图像时,可以大致将沙尘图像整体的黄色去除,但是图像的清晰度并没有得到较好的提升,整体图像颜色偏暗,视觉观感较差;Park的方法可以较好地恢复图像的颜色和清晰度,但对于黑夜中灯光的处理会出现色彩偏差;FSAD-NET得到的结果图像颜色过深,整体偏暗,有些图像并不能很好地去除沙尘;文献[10]得到的结果较好,可以有效去除沙尘,但是对于偏红的图像依然存在色彩失真的问题。而本文算法可以更好地去除图像的沙尘并恢复图像的色彩,但是在大面积天空区域存在一定的光环伪影。

对于真实沙尘图像,由于没有可对比的清晰图像,而且现在也没有对沙尘图像进行质量定量评价的方法,所以采用自然图像质量评价(natural images quality evaluator,NIQE)[39],基于无参考图像质量评价(no-reference perception-based images quality evaluator,PIQE)[40],无参考图像空间质量评价(blind/referenceless images spatial quality evaluator,BRISQUE)[41]以及无参考对比度失真图像质量评价(no-reference images quality metric for contrast distortion,NIQMC)[42]四种无参考图像质量评价指标,对于NIQE、PIQE 和BRISQUE,其数值越小,图像质量越好;对于NIQMC,数值越大,图像质量越好。

表4 总结了50 张测试图像的四个平均定量评价指标的比较。本文算法具有最好的平均NIQM、PIQE 指数。对于BRISQUE 指数,本文的方法获得了第二的平均值,仅次于是文献[10]。本文算法和Park得到的NIQMC分数相近,NIQMC 通过测量给定图像的局部细节和全局直方图来评价图像质量,特别适用于对比度较高的图像。综上所述,本文算法在综合考虑四个定量评价的得分时具有最好的性能。因此,本文提出的算法能够在对比NIQE 评分的基础上生成更自然的增强图像。另外,从NIQMC 值的比较结果可以判断,本文算法相比于其他方法对比度失真也较小。

表4 不同方法在真实沙尘数据集上的定量比较结果Table 4 Quantitative comparison results of different methods on real-world images

3.4 消融实验

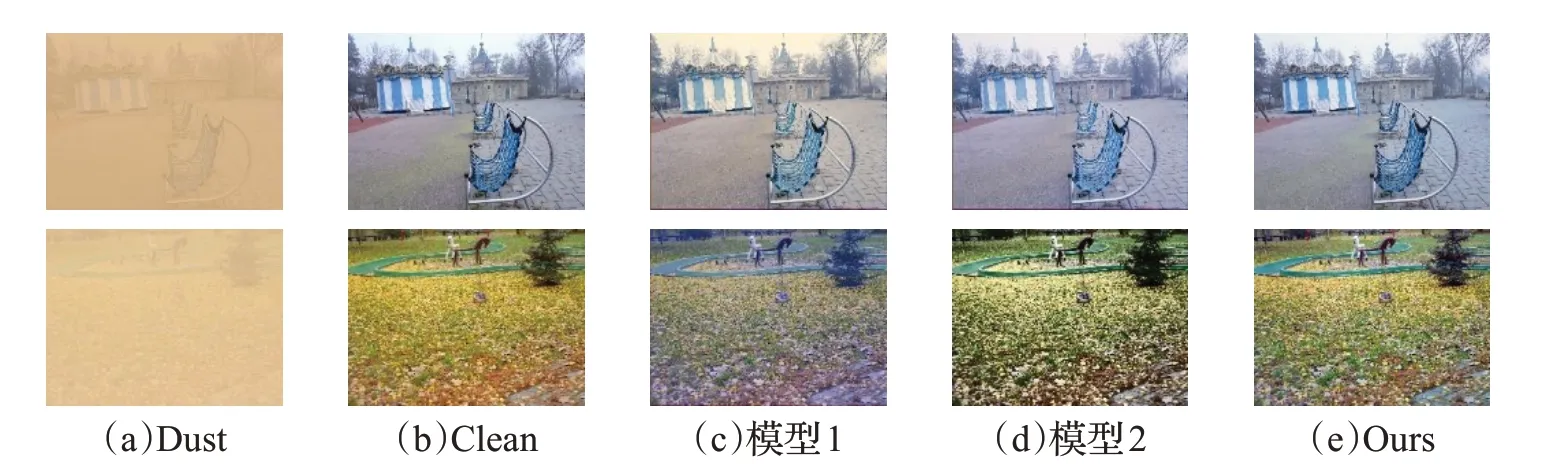

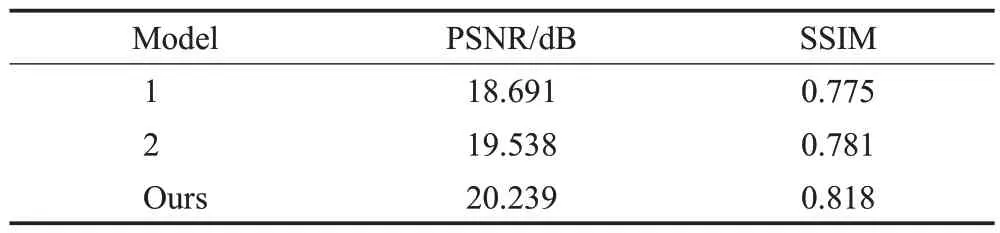

本文的消融实验主要考虑的是色彩恢复子网以及迁移学习子网对于网络性能的影响。模型1,舍去色彩恢复子网,并采用Batch normalization[43]代替AIN 做归一化处理,具有其他设置不变,测试网络性能;模型2迁移学习子网加载在ImagesNet 数据集上预训练的参数,其他设置不变,测试网络性能。

表5的定量比较可以看出,色彩恢复子网和预训练参数的选择对结果评价指数的变化都有一定影响,而本文模型获得了最好的评价指数,证明了模型所选择的各个模块的重要性。从图8的定性比较中可以看出,舍去色彩恢复子网和AIN 后,网络依然可以去除沙尘,但对于色彩的恢复与原网络存在差距,定性比较中特别采用了色彩艳丽的图像增加对比的明显度;而迁移学习子网在加载ImagesNet数据集上预训练的参数后所得到的结果也是较好的,图像细节处理与原网络十分接近,但是也存在颜色的差异,很明显可以看出原网络所得到的图像在色彩表现上更加符合人眼视觉体验。

图8 消融实验定性比较结果Fig.8 Qualitative comparison results of ablation experiments

表5 消融实验定量比较结果Table 5 Quantitative comparison results of ablation experiments

4 结论

本文所提出的基于多分支修复网络的沙尘降质图像增强算法,通过实验证明了它在沙尘图像增强任务中的能力。将迁移学习子网、色彩恢复子网和数据拟合子网所得到的特征进行叠加,通过融合层映射出清晰图像。实验中采用的数据集不大,但取得了良好的效果,证明方法在小数量数据集上有显著的优势,通过测试可以看出算法在所测试的数据集中的表现都超过了所对比的先进方法。并且通过迁移学习子网证明了迁移学习在沙尘图像增强中的有效性。

基于深度学习的沙尘图像增强方法发展的局限性主要是由于获取训练样本较为困难,所以本文采用了大规模低分辨率合成数据集进行参数预训练,然后在小规模高分辨合成数据集上进行训练和测试,这样会导致网络在处理真实沙尘图像过程中存在性能下降的问题,因此如何构造高质量的真实沙尘图像和相应的清晰图像数据集是突破该方向发展瓶颈的难题,也为未来的研究指出了一个明确的方向。