基于人工智能的无人机测绘遥感图像信息提取方法

陈立娜,李 真,宋 辉

(国网河南省电力公司内乡县供电公司,河南内乡 474350)

无人机测绘遥感是当前遥感技术发展的一个重要方向,它在实时性、针对性和灵活性等方面具有很大的优势,是获取遥感资料的一个重要方法。但是在实际应用中,不能很好地提取出一些细节特征。因此,对无人机测绘遥感图像信息进行提取具有重要意义。

刘强[1]等提出卷积神经网络模型方法,采用基于分类的方法对各个像素进行分类,在像素水平上的提取精确度可能会很高,但是也很容易忽视像素与像素之间的相互关系。由于实际场景的复杂性和多样性,使用该方法常常会受到目标对象大量变化、目标遮挡和重叠、目标缺乏高识别特性以及光照变化等原因,使得提取模型缺乏泛化能力。郑蓉珍[2]等提出将无人机影像与数字地表模型相融合,利用最大似然法提高图像识别准确率。然而该方法已经无法适应高分辨率图像的要求。为此,提出了基于人工智能的无人机测绘遥感图像信息提取方法。

1 图像信息提取模型构建

利用无人机测绘与遥感技术对多幅无人机测绘遥感图像进行了采集,将所获得的图像信息分成若干个图像信息,这些图像信息均为同一像素。利用聚类方法,将小图像信息中的背景信息划分为亮色裸地、暗色裸地、绿色植被和枯萎植被四种类型。指数NDVI 的表达公式为:

式中,I表示图像红外波段反射值;R表示标准红光波段反射值。当利用该指数计算获取植被面积[3]占小幅图像总面积之比大于5%时,认为该图像背景信息是植被,否则是裸地。

选择有目标的小幅图像数据与无目标的小图像数据相结合,构成一个图像数据对,从而构成多个图像数据对。在此基础上,将图像数据集分为四个集合:亮色裸地影像数据集、暗色裸地影像数据集、绿色植被影像数据集和枯萎植被影像数据集[4]。

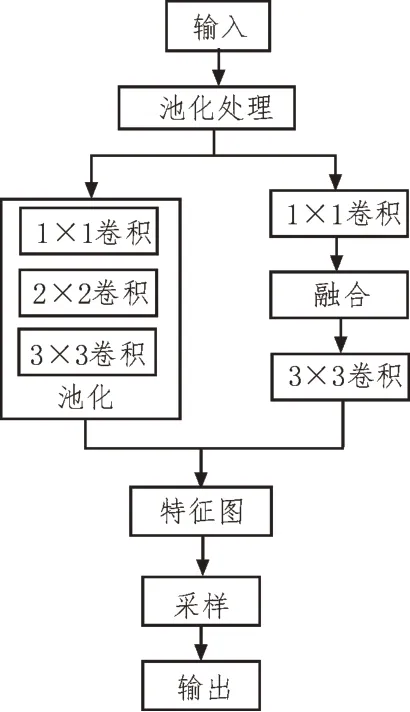

在四组图像数据集合中,分别对各小图像数据建立学习样点,由此构成学习样本对。根据学习样本对训练结果构建基于机器学习算法的目标提取模型,如图1 所示。

图1 基于机器学习算法的目标提取模型

由图1 可知,将原无人机遥感影像分割为一组n×n尺寸的遥感图像,在此基础上绘制一幅标签图像,并将每幅图像与其相应的标签图像作为训练数据。在上述构建的模型中,需要使用2×2 的最大池化函数max pooling[5]。基于机器学习的方法,在无人机测绘遥感影像的数据抽取中采用了以下卷积过程:

过程1:对64 个卷积核进行两次卷积,并执行一次池化层处理;

过程2:对128 个卷积核进行两次卷积,并执行一次池化层处理;

过程3:对256 个卷积核进行三次卷积,并执行一次池化层处理;

过程4:对512 卷积核进行三次卷积,并执行一次池化层处理;

过程5:采用三阶全连接层Fc-layer,并由softmax分类器进行处理。

经过卷积处理后,判断模型输出的提取准确度是否达到阈值,如果没有达到,则需对图像数据进行降维处理,并继续更新图像信息集[6-8];如果达到,则训练完成,得到图像信息提取结果。

2 遥感图像信息提取过程

基于人工智能的无人机测绘遥感图像信息提取方法包括以下步骤。

步骤1:图像特征融合

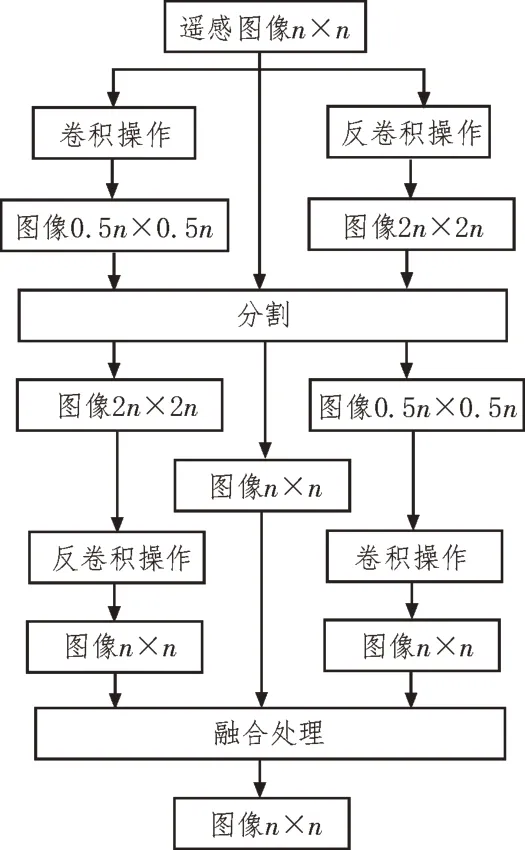

1)利用RGB 三通道图像进行卷积操作,获得了尺寸为0.5n×0.5n、2n×2n的RGB 三通道图像[9];

2)将2n×2n的RGB三通道图像进行端对端训练,并经过图像分割处理后,获得2n×2n的分类概率特征图,并进行卷积运算,获得尺寸为n×n的概率特征图[10];

3)将0.5n×0.5n的RGB 三通道图像进行端对端训练,并经过图像分割处理后,获得0.5n×0.5n的分类概率特征图,并进行卷积运算,获得尺寸为n×n的概率特征图[11];

4)将n×n的遥感图像RGB 经端到端训练后,可获得具有n×n遥感图像的分类概率特征图[12]。

结合上述内容,设计详细图像特征融合过程,如图2 所示。

图2 图像特征融合过程

由图2 可知,将以上所得的三个大小均为n×n的概率特征图进行统计学尺度的图像特征融合[13],从而得到了目标提取模型输出特征图。

步骤2:卷积过程中的权值共享

为了实时更新机器学习的判别参数,需要对卷积过程进行权值共享。在共享时,需要测试各个性能指标的取值,形成目标相对优属度矩阵[14]。

在共享过程中,需要测试各个性能目标的取值,基于此构成目标特征值矩阵,如式(2)所示:

式(2)中,zij表示第j个参数被采集时第i个性能目标的取值。

为了准确分析,应采用适当的优属度计算方法对目标值进行标准化处理,将式(2)转化为无量纲的目标相对优属度矩阵,标准化处理公式为:

经过标准化处理后,得到目标相对优属度矩阵为:

式(4)在客观层面上体现出了各个参数对目标的影响,根据获取的目标相对优属度矩阵,安全共享卷积过程中的权值。

步骤3:模型训练

在获取共享权值情况下,采用人工智能的机器学习算法进行模型训练。通过训练得到遥感影像和相应的标记图像[15],通过机器学习模型的训练,使得机器学习和识别过程之间的关系趋于均衡。

步骤4:信息提取

首先,在n×n幅遥感图像上添加训练数据,将其输入到所构造的图像特征融合处理[16]过程中;然后,将输出与n×n大小的遥感图像进行卷积运算,并将其作为判别目标的输入内容;最后,在确定判别目标后,得到一个介于0 和1 之间的输出值。如果期望输出为0,则判别该信息下所对应的图像是假图像;如果期望输出为1,则判别该信息下所对应的图像是真图像。

在机器学习模型中,通常采用模型复杂度惩罚项η来衡量其空间容量,η数值的大小与泛化性能通常是成比例的,它被定义为:

式中,k表示样本总数量;c表示机器学习模型的维数;c值越大,η值也就越大,反之,则越小。因此,在机器学习模型维数一定的情况下,增加训练样本数量,能够避免提取模型在提取信息过程中出现过拟合现象。

3 实 验

3.1 实验区域与数据

为了验证基于人工智能的无人机测绘遥感图像信息提取方法的有效性,实验区域为某城市某地区的焦化工厂,位于矿区详查区的西南部,面积约1.60平方公里,高程在1 150~1 210 m 之间,该地区的地形中西部较高,西北部较低。

无人机测绘遥感图像是在2021 年5 月6 日9:00时拍摄的,天气晴但有雾,使用某公司制造的eBee Ag 固定翼无人机。无人机能够迅速、高效地产生地形图、正射影像图、地面数字模型等数据。机身搭载索尼DSC-WX220 相机,该相机的镜头是索尼的G 镜头,它的焦距是4.50~43.5 mm。选取的地物目标图像如图3 所示。

图3 地物目标标注结果

以图3 所示的目标标注结果为研究对象进行实验验证分析。

3.2 实验指标

使用整体像素精度评估不同信息提取方法下遥感图像目标识别精度,公式为:

式中,a、b表示目标类别;n表示被预测成不同类的像元数量;m表示目标类型数量。

3.3 实验结果与分析

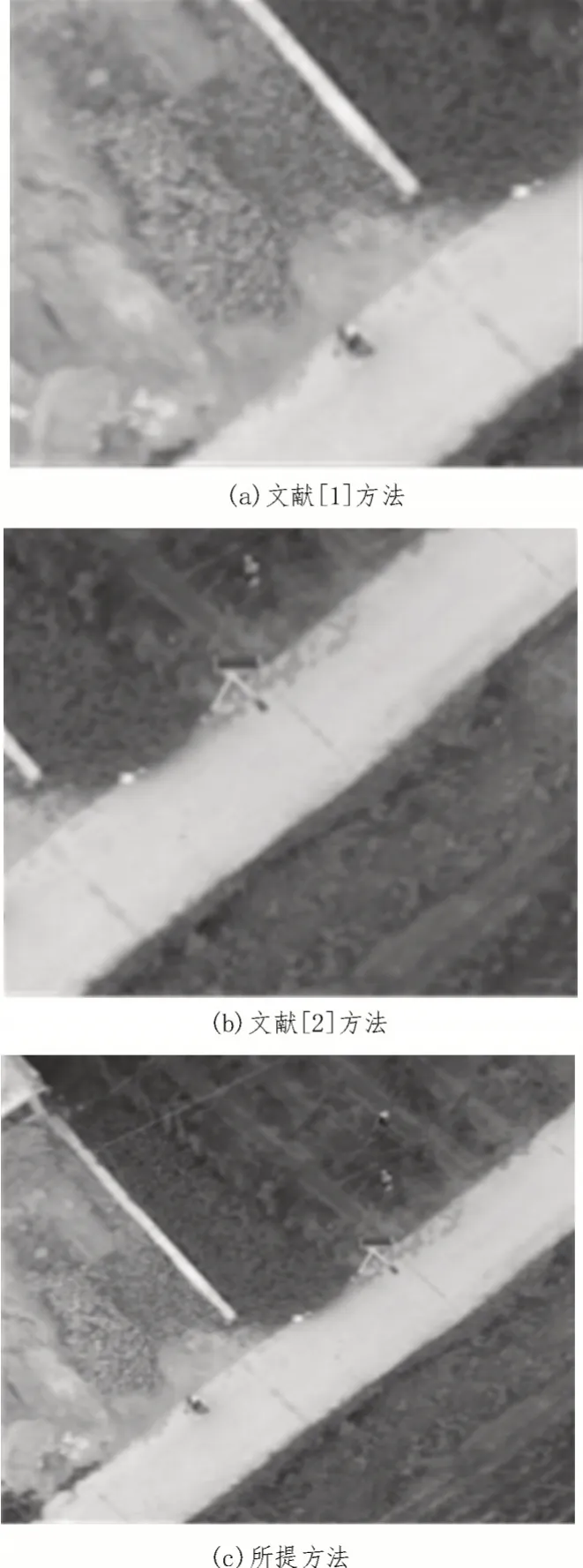

在提取遥感图像信息过程中,不仅要考虑所收集的图像数据,而且需将图像失真问题纳入其中。因此,分别使用文献[1]方法、文献[2]方法和所提方法,对比分析无人机测绘遥感图像提取结果,如图4所示。

图4 三种方法的图像提取结果对比分析

由图4 可知,文献[1]方法和文献[2]方法提取的图像并不全面,导致部分信息丢失,而所提方法提取的图像全面,且与图3 所示选取区域一致,能够获取全部图像信息。

基于此,分别使用这三种方法对比分析图像信息提取的精度和提取过程的损失情况,如表1 所示。

表1 三种方法的信息提取精度和损失情况对比分析

由表1 可知,文献[1]方法和文献[2]方法图像信息提取精度最高分别为0.70 和0.56,损失程度最高分别为0.52 和0.39。而所提方法提取精度最高为0.93,损失程度最高为0.22。由此可知,所提方法信息提取精度高的同时损失程度低。

4 结束语

该文提出了一种基于人工智能的无人机测绘遥感图像信息提取方法,该方法相比于现有的提取方法,提取精度高且损失程度低,可以满足当前实际需要,通过使用人工智能方法识别的图像和人类视觉效果更接近。在今后的遥感图像质量评估中,可以从以下方面进行:同一区域内不同时期的遥感图像,其数据自身具有一定的时间序列性。因此,可以将时间信息引入到图像质量评估模式中,以实现将不同时期所收集到的数据进行整合,进而优化提取方法。