结合天空分割和金字塔融合的多尺度图像去雾

肖新杰,李志伟,,张楠楠,孙雨晴,周武能

(1.上海工程技术大学 电子电气工程学院,上海 201620;2.东华大学 信息科学与技术学院,上海 201620)

0 概述

雾霾是光在空气中传播产生散射的主要因素之一,雾霾场景所获得的图像存在对比度下降、细节丢失和色彩失真等视觉退化现象,不利于目标检测和目标追踪等高水平的计算机视觉任务[1-3]。因此,实现图像的有效去雾,复原出高质量的清晰图像对开展高水平计算机任务具有重要的理论意义和应用价值。

目前的主流图像去雾方法包括使用先验知识的方法[4-6]和基于深度学习的方法[7-9]。使用先验知识的方法采用大量清晰图像所遵循的客观规律估计介质透射率和大气光值,进而采用大气散射模型[10-12]复原无雾图像。文献[13-14]根据清晰图像中至少有一个通道的强度值接近于零的假设提出了暗通道先验(DCP)方法,该方法首先通过暗通道先验理论估计透射率值,然后使用引导滤波细化透射率图。暗通道先验方法具有去雾能力强、运行速度快等优点,但对于具有大面积天空区域的图像,暗通道先验理论失效,复原的无雾图像亮度偏低且出现色彩扭曲现象。在上述暗通道先验理论中,大气光值和介质透射率共同决定了复原无雾图像的亮度、对比度和色彩准确性。为了精确求取透射率值,文献[15]提出散射立方法估计暗通道图像,但复原的无雾图像天空区域仍然会存在光晕和亮度偏低的现象。为了克服天空区域存在的光晕现象,文献[16]提出四阶偏微分方程模型优化介质透射率,该方法去雾能力强、稳定性好,但对于雾霾分布不均匀的图像,会出现雾霾残留和亮度偏低的现象。上述基于先验知识的方法,仅能在特定场景下取得较好的去雾效果,且复原的无雾图像存在亮度低和色彩扭曲等问题。

基于深度学习的方法又可细分为2 类:第1 类是应用深度学习估计复原无雾图像所需的参数,进而得到无雾图像[7-8],如文献[8]将透射率值和大气光值用一个等价变量表示,并在图像像素域中通过最小化重建误差估计等价变量,该方法具有去雾效果好、运行速度快等优点,但复原的无雾图像亮度偏低;第2 类是不借鉴物理模型和先验知识,直接学习雾霾图像与清晰图像之间的转换关系[17-18],如文献[9]提出一个包含多分辨率生成器和多尺度判别器的增强去雾网络,此网络不依赖物理模型和先验知识便可输出无雾图像,但所复原无雾图像存在色彩扭曲和亮度偏低的现象。为解决基于先验和深度学习的去雾方法所复原无雾图像普遍存在色调偏暗和亮度偏低的问题,文献[19]提出一种具有曝光特性的图像去雾方法(IDE),该方法对大气散射模型增加一个光吸收系数,从而产生曝光效果,提高了所复原无雾图像的亮度。该方法不依赖于先验知识和数据训练,运行速度快且具有较高的鲁棒性。尽管该方法在解决复原图像偏暗问题上取得了较好的效果,但存在过度曝光的问题。

为解决传统去雾方法所复原图像存在的对比度下降、色调偏暗和过度曝光的问题,本文提出一种结合天空分割和金字塔融合的多尺度去雾方法。首先介绍暗通道先验和增强型大气散射模型(IDE 去雾理论);然后利用含有梯度的分水岭算法与均值滤波处理天空区域,生成天空区域得分图,使用最高得分所对应最亮天空区域的平均灰度值获取更准确的大气光值;最后融合DCP 去雾能力强和IDE 提升复原无雾图像亮度的优点,设计一种基于图像金字塔的多尺度透射率融合方法,根据所求大气光值和透射率融合还原出清晰图像。

1 暗通道先验和增强型大气散射模型

1.1 大气散射模型

针对雾天能见度低、图像模糊不清的问题,研究人员通过构建大气散射模型(ASM)来解释雾天图像成像的过程[10-12],其表达式为:

其中:x是图像中的像素点位置;i为通道索引且i∊{r,g,b};Hi(x)为雾霾图像;Ci(x)为清晰图像;Ai为大气光值;t(x)为透射率。从大气散射模型表达式可以看出,想复原出高质量无雾清晰图像的关键是精确求取大气光值Ai和透射率t(x),大气散射模型的提出为图像去雾奠定了理论基础。

1.2 暗通道先验

文献[13]根据无雾图像的暗通道图数据观察发现,无雾图像中至少有一个颜色通道的像素点非常低,进而提出暗通道先验(DCP)理论,且将暗通道图像Cdark表示为:

其中:Ω(x)为局部图像块;Ci(y)是清晰图像中的一个颜色通道图像。根据DCP 理论可知:

对式(1)两端同时进行最小值处理,并进行数学变换,可以得到透射率图t(x):

其中:λ通常取0.95,目的是为了使图像保持一定的雾感,看起来更自然。

根据大气散射模型可知,所复原的无雾图像为:

其中:t0通常取0.1。

由于天空区域灰度值偏高,不存在至少有一个颜色通道的像素点非常低的情况,且在颜色较深的场景下,暗通道先验估计的介质透射率强度值较低,导致所复原的无雾图像中存在对比度下降、色调偏暗和过度曝光的问题。

1.3 增强型大气散射模型

由于光可以在纹理中被吸收,且光吸收率与纹理密度成正相关,即纹理密度越高,光吸收率越大,因此大气散射模型(ASM)中的大气光对不同的场景具有不同的照明效果。无雾图像中景深较小的目标比景深大的目标具有更丰富的纹理,因此景深较小的目标具有更大的光吸收率。而大气散射模型(ASM)忽略了光吸收率与景深的关系,致使基于大气散射模型的去雾方法所复原的无雾图像中存在偏暗的问题。为消除此问题,文献[19]提出在大气散射模型中增加一个光吸收系数构成增强的大气散射模型,称为IDE 模型,即:

其中:α(x)是光吸收系数,且α∊(0,1];ρ(x)是场景反照率。

因为α(x)随着场景深度d的增加而衰减,且其最大值为1,被定义为:

场景深度d(x)与t(x)相关且遵循:

其中:β是大气衰减系数。联立式(6)~式(8),可得具有曝光能力的增强大气散射模型为:

其中:tmin是t(x)中的最小值。

根据灰 度世界假设[20],ρ(x)取0.5,线性拟 合ln(t(x))和使用全局搜索策略求解ln(tmin),求得t(x),进而结合ASM 复原具有曝光特性的无雾图像。IDE 去雾方法不依赖于任何训练过程,也不需要与场景深度相关的额外信息,不仅运算速度快,而且具有较高的鲁棒性。然而在IDE 求解透射率的过程中,假定ρ(x)常数为0.5,而实际场景的ρ(x)是与图像大小相同的矩阵,且相应数值不全是0.5,导致所复原无雾图像中存在过度曝光和雾霾残留的现象。

2 多尺度图像去雾方法

2.1 本文方法的去雾原理

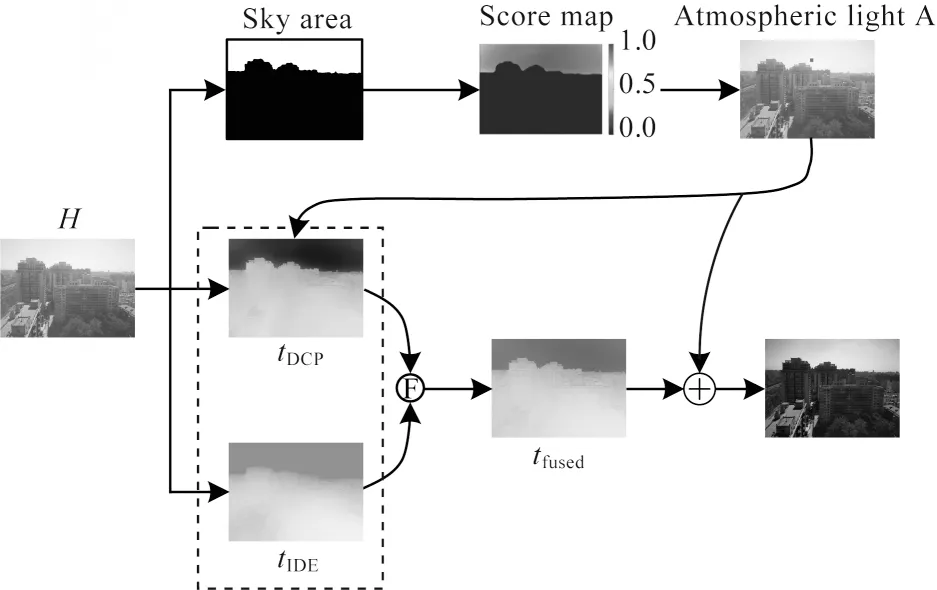

在先前的去雾方法中,暗通道先验(DCP)具有较强的去雾能力,但所复原的无雾图像的色调偏暗;IDE 通过引入一个光补偿系数提高了所复原的无雾图像的亮度和对比度,然而所复原的无雾图像出现了过度曝光和雾霾残留的问题。为了规避图像中存在对比度下降、色调偏暗和过度曝光的问题,本文提出结合天空分割和金字塔融合的多尺度图像去雾方法,该方法结合了DCP 去雾能力强和IDE 提高去雾图像亮度的优点,生成高质量的去雾图像,原理如图1 所示。首先利用与梯度结合的分水岭算法粗略分割天空区域图像,使用均值卷积核对分割得到的天空区域图像进行卷积,得到大气光值得分图,选取最高得分对应的最亮天空区域获得大气光值。然后使用基于图像金字塔的多尺度感知融合方法,融合DCP 和IDE 估计的透射率。最后结合大气光值和大气散射模型复原无雾图像。

图1 结合天空区域分割和透射率的图像去雾方法原理Fig.1 Principle of image dehazing method combining sky region segmentation and transmittance

2.2 基于天空区域得分图求取大气光值

文献[13]使用暗通道图像中最亮的前0.1%的像素点的平均值作为大气光值。然而对于含有大面积白色物体的图像,暗通道先验的方法往往会选取错误的像素点求取大气光值,导致所复原的无雾图像出现颜色扭曲等现象。

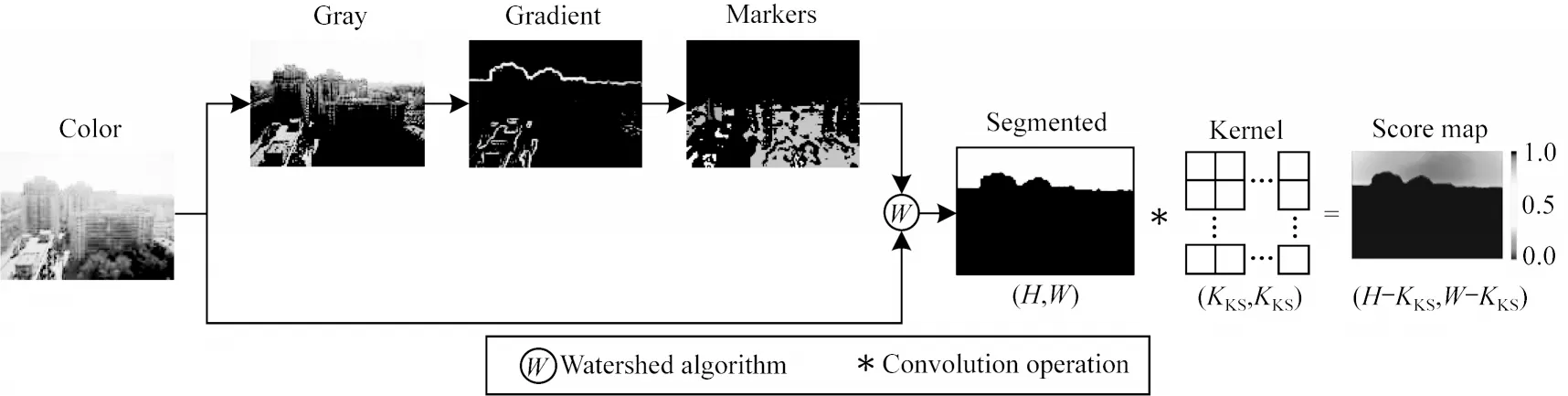

为了提高估计大气光值A的准确性,本文提出一种估计天空区域得分图的大气光值求取方法。首先采用与梯度结合的分水岭算法,粗略地分割天空区域,再使用均值卷积核求取天空区域得分图,选取最高得分对应的最亮天空区域的均值作为大气光值。如图2 所示,首先把彩色图像转成灰度图,再使用具有半径为5 个像素的圆形滤波器的梯度算子计算梯度图像,并将梯度值小于10 的点作为开始标记点。其次使用分水岭算法即可得到粗略分割的天空区域图像。根据文献[1]可知,灰度值阈值大于204并且连通区域的像素数量大于整幅图像像素数量的5%的连通区域可认为是天空区域。

图2 天空区域得分图计算流程Fig.2 Calculation procedure of sky area score map

值得注意的是,这里将天空区域图像分割分为多个固定大小的图像块,并计算其得分,可以准确地找到最亮的天空区域。本文采用均值卷积核与天空区域图像进行卷积,计算天空区域的得分图,且卷积核的大小为输入雾霾图像的0.1%。

其中:天空区域图像Segmented 的形状为(H,W);(KKS,KKS)和(H-KKS,W-KKS)分别表示均值卷积核KKernel和天空区域得分图SScoremap的形状。再找到得分图中得分最高点的位置坐标ppos,进而获取最亮的天空区域bbrightsky,其表达形式为:

其中:argmax(·)和findpos(·)分别表示寻求最大值和寻找坐标操作,使用得分最高点的位置坐标截取最亮的天空区域。大气光值可以被表示为:

其中:Ai表示一个通道的大气光值,且i∊{r,g,b};mean(·)表示均值操作。

2.3 基于图像金字塔的多尺度感知融合方法

针对所复原的无雾图像中存在对比度下降、色调偏暗和过度曝光的问题,提出一种基于图像金字塔的多尺度感知融合方法,通过融合DCP 和IDE 所获取的透射率,估计出更精确的透射率。图像金字塔的每个尺度都具有丰富的语义信息,对于融合后的图像在纹理特征方面具有合理的过渡性,融合后的透射率图更平滑,该透射率结合了DCP 和IDE 的优点,最大程度地还原了图像场景的风格特点。

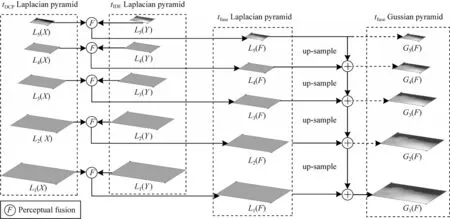

基于图像金字塔的多尺度感知融合方法原理图如图3 所示。

图3 基于图像金字塔的多尺度感知融合方法Fig.3 Multi-scale perceptual fusion method based on image pyramid

首先,分别估计暗通道先验和IDE 的透射率图,使用Laplacian 图像金字塔将tDCP和tIDE分解为多个尺度。使用感知融合方法[21]分别融合tDCP和tIDE图像金字塔的每一层,构建tfusedLaplacian 图像金字塔。最后,重建tfusedGaussian 金字塔,Gaussian 金字塔的最底层G1(F)就是融合后的透射率图tfused。

tDCP和tIDELaplacian 图像金字塔的构建过程为:

其中:Ln(X)和Ln(Y)分别表示tDCP和tIDELaplacian 图像金字塔,且n∊{1,2,3,4,5};Gn(X)和Gn(Y)分别表 示tDCP和tIDEGaussian 图像金字塔;Ln(F) 表 示tfusedLaplacian 图像金字塔。

感知融合方法[21]被用来融合tDCP和tIDELaplacian图像金字塔。首先分别使用暗通道先验(DCP)和IDE 复原的无雾图像计算与输入雾霾图像的相似度,再使用Softmax 计算融合权重,最后融合暗通道先验和IDE 的透射率图Laplacian 金字塔的每一层Ln(X)和Ln(Y)。

暗通道先验和IDE 复原的无雾图像与输入雾霾图像的相似度计算主要依靠YIQ 和LMN 颜色空间提取特征[22-23],其计算公式如下:

其中:Y是YIQ 颜色空间中的一个颜色通道;x是图像中的像素;Gx(x)和Gy(x)是Y通道中在x处的偏导数;M和N分别是LMN 颜色空间中的颜色通道。根据文献[21]中的相似度计算方法分别计算HCDCP和HCIDE,其计算公式如下:

其中:GH(x)、GDCP(x)和GIDE(x)分别表示雾霾图像、DCP 和IDE 复原的无雾图像的G(x)值。再通过相似度图像和Softmax 计算FDCP和FIDE融合权重,融合权重可以被表示为:

使用FDCP和FIDE融合权重融合透射率图Ln(X)和Ln(Y),Ln(F)可以被定义为:

其中:⊙为逐像素点乘操作。最后,重建Gaussian 金字塔Gn(F) 复原融合后的透射率图tfused,重建Gaussian 金字塔的每一层可以被表示为:

其 中:n∊{1,2,3,4};up-sample(·)为上采 样操作[24],采用反卷积的方法使Gn+1(F)的大小在行和列方向分别增大一倍。

高斯金字塔Gn(F)的最底层就是复原的融合透射率tfused,即:

受文献[25-26]启发,本文采用导向滤波得到精细的融合透射率trefined:

其中:GGF(·)表示导向滤波操作。

2.4 无雾图像复原

从大气散射模型可知,使用大气光值A和融合透射率trefined可以复原无雾图像,联立式(1)、式(15)和式(29)可以得到复原的无雾图像Ci(x):

其中:t1取0.1,为了防止透射率趋近于0,导致复原的无雾图像过度曝光。所提出的结合天空分割和金字塔融合的多尺度图像去雾方法成功去除了雾霾,并规避了传统方法复原的无雾图像色调偏暗和过度曝光的问题。

3 实验结果与分析

实验是在一台具有处理器Intel®CoreTMi5-11400HQ CPU@2.70 GHz 和16 GB RAM 的惠普 电脑上使用MATLAB 2022a 和Python 3.9 开展的。所使用测试数据集分别是合成目标测试集SOTS 和混合主观测试集HSTS[27]。本文实验使用图像去雾任务中常用的峰值信噪比(PSNR)和结构相似性(SSIM)[28]作为性能指标,其值越高表示复原无雾图像的质量越高。为验证所提去雾方法的有效性,分别从合成雾霾图像和真实雾霾图像两方面与已报道的典型方法开展对比实验,对比方法包括传统方法DCP[13]、CAP[5]和IDE[19]和基于 深度学 习的方 法AOD-Net[8]、TCN[17]。

3.1 主观评价

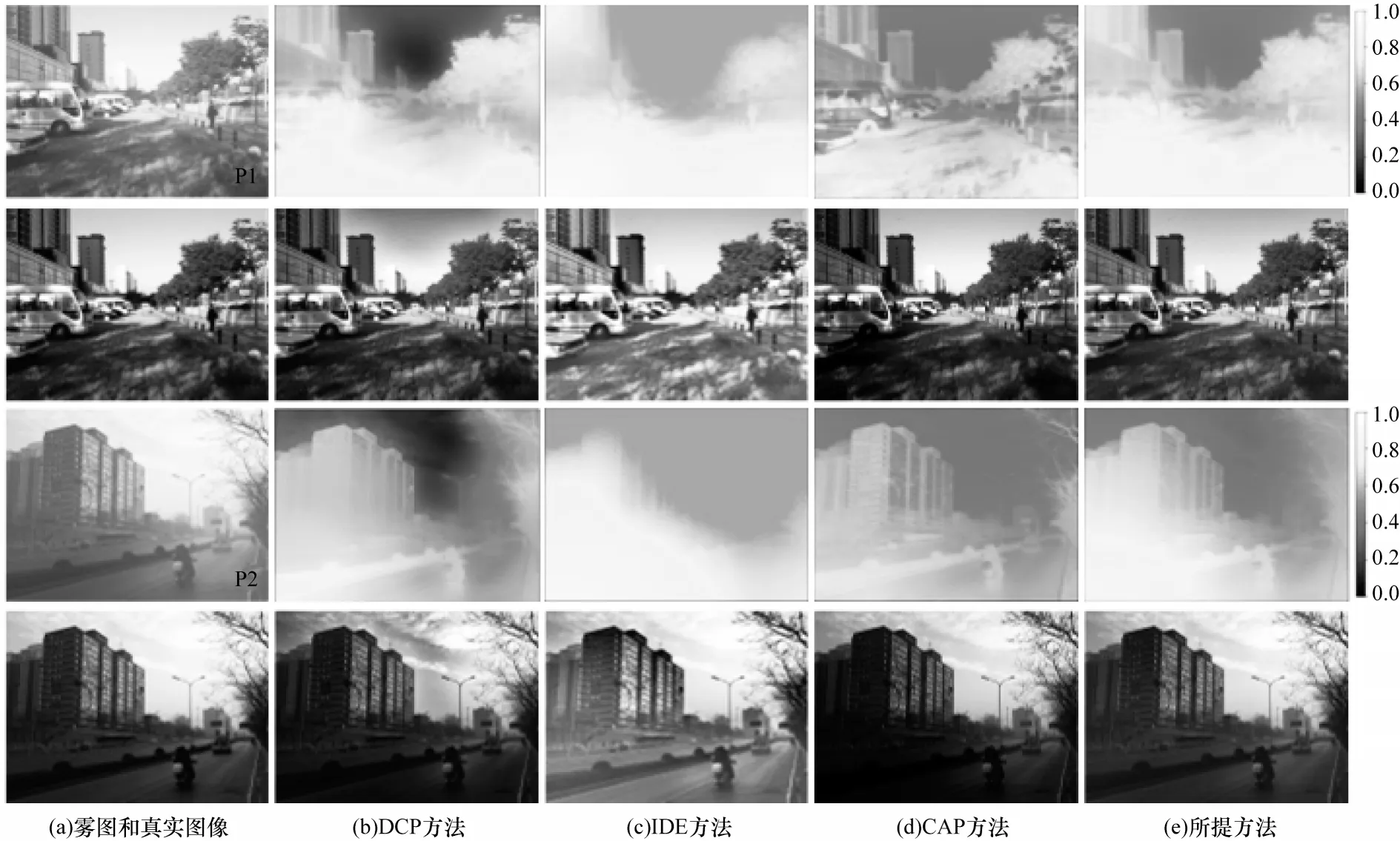

3.1.1 主观分析透射率图

对于基于大气散射模型的去雾方法,生成高质量的透射率图是复原无雾图像的关键。为证明所提基于图像金字塔的多尺度感知融合方法估计透射率的有效 性,将本文 方法与 典型的DCP[13]、IDE[19]和CAP[5]方法做比较,实验结果如图4 所示。图4(a)分别是雾霾图像和其相应的真实图像,图4(b)~图4(e)分别是相应雾霾图像使用不同方法估计的透射率图和相应复原的无雾图像。DCP 得到的透射率结果天空区域强度较低,并且在图像分界处具有不连续性,导致复原的无雾图像的天空区域出现伪边缘和颜色失真,在DCP 复原的无雾图像中,雾霾图像P1 复原的天空区域出现了严重的颜色扭曲和伪边缘,P2 复原的无雾图像的左下角明显偏暗[见图4(b)]。IDE得到的透射率图整体强度值偏高,导致复原的无雾图像亮度过高且有雾霾残留,复原P1 和P2 的无雾图像的左下角与真实图像相比亮度过高,且复原P2 的无雾图像的左下角疑似有雾霾残留[见图4(c)]。由文献[29]可知,在景深一致时,透射率图中的同一场景目标的强度值应基本一致,然而CAP 估计的透射率图违反了这一规律,其估计的透射率图强度值偏低,且透射率图的场景目标有过多的纹理细节,导致复原的无雾图像产生色偏[见图4(d)]。而本文所提方法估计的透射率图避免了天空区域强度值偏低的情况,也避免了透射率图整体强度值偏高,所复原的无雾图像既不偏暗也不过亮,最接近于真实图像[见图4(e)],这归因于所提的基于图像金字塔的多尺度感知融合方法在不同尺度融合了DCP 和IDE 的透射率图,即结合了DCP 和IDE 算法的优点。

图4 不同方法生成的透射率图及复原结果比较Fig.4 Comparison of the transmittance maps and recovery results generated by different methods

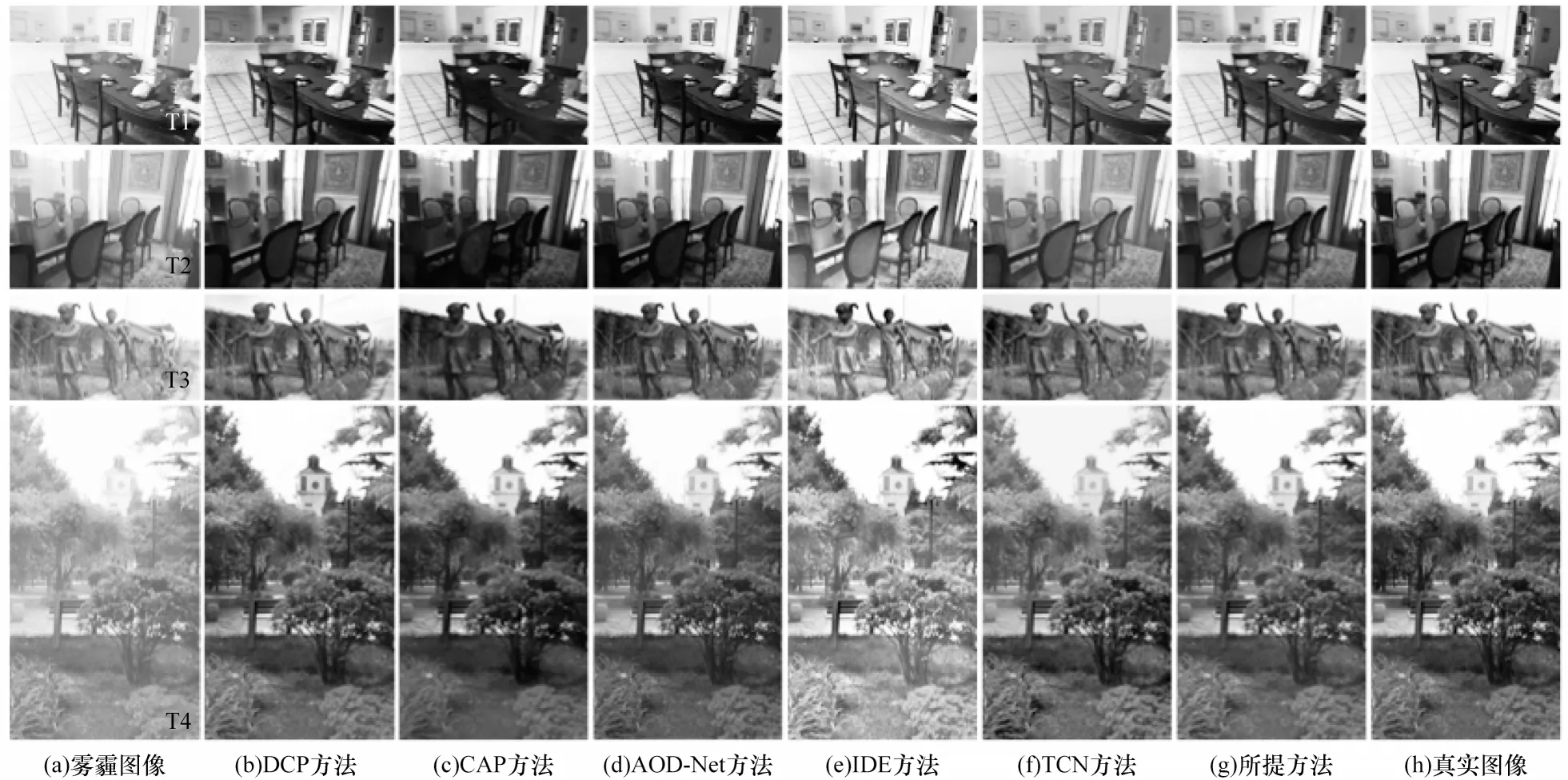

3.1.2 主观分析图像的去雾结果

为了验证所提方法的有效性,分别在SOTS 数据集和HSTS 数据集上开展了主观评价对比实验。所提方法与典型的5 种方法在SOTS 数据集上的主观评价对比如图5 所示。实验从SOTS 的室内和室外图像中分别选取两张图像。DCP、CAP和AOD-Net对于去雾的效果具有极好的表现,但是复原的无雾图像部分区域存在色调偏暗、对比度低的现象,图5中的T1和T2,桌椅处相比于真实图像较暗[见图5(b)~图5(d)]。IDE 和TCN 是为了解决基于大气散射模型的方法复原的无雾图像亮度偏低而提出的,IDE 复原的无雾图像达到了很好的视觉效果,但由于其估计的透射率图的强度整体偏高,出现了过度曝光的现象[见图5(e)],TCN 也提高了所复原无雾图像的亮度,但却出现了色彩扭曲的现象。与前5 种典型的方法相比,所提方法更接近于真实图像,既没有色调偏低和对比度低的现象,也没有过度曝光和颜色扭曲的现象。综合主观评价对比实验,证明所提方法对于图像去雾的有效性,得益于基于图像金字塔的多尺度感知融合方法估计的融合透射率图,融合了DCP 去雾能力强和IDE 提高复原无雾图像亮度的优点,克服了色调偏暗、对比度低和过度曝光的问题。

图5 在SOTS 数据集上的主观评价对比实验Fig.5 Subjective evaluation comparison experiments on the SOTS dataset

图6 是不同方法在HSTS 测试集真实图像上的主观评价对比结果。DCP 对于含有天空区域和大块白色物体图像的处理结果,依旧出现了天空区域颜色失真和色调偏暗的现象[见图6(b)]。CAP 由于估计的透射率图的强度整体偏低,因此其所复原无雾图像整体亮度偏低[见图6(c)]。AOD-Net 展现出了良好的去雾能力,但其所复原无雾图像也存在色调偏暗的现象[见图6(d)]。为了提升所复原无雾图像亮度而提出的IDE 与TCN 确实提升了图像的亮度和对比度,但IDE 却因为估计的透射率图的强度整体偏高而有雾霾残留,TCN 则是出现了颜色扭曲现象。所提方法展现出了较强的去雾能力,所复原无雾图像既没有出现颜色失真的现象,也没有出现对比度低和过度曝光的情况[见图6(g)],得益于本方法所估计的透射率更接近真实值,避免了融合透射率图的天空区域强度过低和整体强度偏高的极端情况。

图6 在HSTS 数据集上真实世界图像上的主观评价对比实验Fig.6 Subjective evaluation comparison experiments on real-world images on the HSTS dataset

图7 是在HSTS 数据集中合成图像上的主观评价对比实验。图7 展现了所提方法与典型的5 种方法的主观评价比较,DCP、CAP 和AOD-Net 的方法都取得了较为理想的无雾图像,但其复原无雾图像中植物的对比度偏低[见图7(b)~图7(d)]。IDE 对比度过高且植物的颜色略有失真,TCN 复原的无雾图像的天空区域出现失真现象[见图7(e)和图7(f)]。所提方法所复原无雾图像的天空区域没有出现颜色失真的现象,植物等颜色较深物体的对比度适中,没有出现偏暗和过度曝光的问题,所提方法复原的无雾图像在风格特点上最接近于真实图像[见图7(g)]。

图7 在HSTS 数据集上合成图像上的主观评价对比实验Fig.7 Subjective evaluation comparison experiments on synthetic images on the HSTS dataset

3.2 客观评价

为了客观地验证所提方法的普适性,分别在SOTS 数据集和HSTS 数据集上开展了客观评价对比实验,由于真实世界的雾霾图像没有真实图像,因此实验只对合成雾霾图像进行了客观评价对比。在SOTS 数据集上与当前国内外主要方法的客观评价对比结果见表1,分别在室内和室外测试图像上与5 种最先进的方法对比PSNR 和SSIM 指标。可以看出所提方法分别在500 张室内测试图像和500 张室外测试图像上的PSNR 和SSIM 指标的平均值都得到了最好的结果,且分别比第2 好的结果高出1.545 dB、0.005 和0.349 dB、0.014,体现出所提方法具有一定的泛化性,对于室内和室外的图像,都有较理想的去雾效果。

表1 在SOTS 数据集上的客观评价对比Table 1 Objective evaluation comparison on the SOTS dataset

表2 是在HSTS 数据集中合成图像上的客观评价对比实验,其对应的视觉效果见图7。由表2 可知,所提方法对于图7所示图像I1、I2、I3 和I4 在PSNR 和SSIM 性能指标上得到了较好的结果,对于图像I1 的PSNR 与最优值CAP 非常接近,但SSIM 优于CAP;图像I2 和I4 所对应的PSNR 和SSIM 优于所有的对比方法;对于图像I3,所提方法的SSIM 非常接近表现最好的DCP,并且PSNR 超过了DCP。

表2 在HSTS 数据集上合成图像上的客观评价对比Table 2 Objective evaluation comparison on synthetic images on the HSTS dataset

综上所述,在真实世界测试图像和合成图像上的主观评价和客观评价对比实验中,所提方法不仅展现出了优秀的去雾能力,也复原出了高质量的无雾图像,究其原因是所提方法综合了DCP 和IDE 方法的优点,估计出了更合理的透射率图,遗弃了DCP透射率图强度值过低的缺点,也改善了IDE 透射率图整体强度值过高的劣势,使复原的无雾图像具有较高的质量。

4 结束语

针对传统图像去雾方法所复原的无雾图像对比度过低、色调偏暗和过度曝光的问题,提出一种结合天空分割和金字塔融合的多尺度图像去雾方法,结合天空分割和计算天空区域得分图,可以精确地估计出大气光值。通过基于图像金字塔的多尺度感知融合方法估计合理的透射率图,避免透射率图强度值过低和整体强度值偏高的问题,改善无雾图像中出现的颜色失真和过度曝光现象。实验结果表明,所提方法具有较强的去雾能力,且能够复原出高质量的无雾图像,在主观评价和客观评价对比实验中取得了优异的表现。下一步将结合基于深度学习的图像生成方法与去雾能力较强的传统方法进行研究,以生成高质量和高可见度的无雾图像。