基于深度学习的地震随机噪声衰减方法研究进展

崔扬,王燕楠,陈万利,张虹,朱丹丹,白敏*

(1. 长江大学油气资源与勘探技术教育部重点实验室,湖北武汉 430100;2. 长江大学地球物理与石油资源学院,湖北武汉 430100)

0 引言

伴随着石油勘探、开发技术的快速发展,高精度地震勘探要求地震资料的信噪比、分辨率和保真度更高,而高信噪比是高分辨率和高保真度的前提,也是地震资料精细处理和解释的必然要求。在野外地震数据采集过程中,由于地质条件复杂多变、环境噪声多样、设备损耗以及人为因素的干扰,检波器接收到的地震信号往往含有声波、面波、多次波等规则噪声和随机噪声,通过常规组合和叠加方法难以完全去除,导致地震资料信噪比达不到准确刻画地下地质构造的要求,对地震数据的偏移成像和反演等造成了消极影响,因此去除地震资料中的噪声至关重要。

人们提出了一系列传统的地震资料去噪方法:以数学变换为基础的方法,包括傅里叶变换[1]、小波变换[2-3]、Curvelet变换[4]和Seislet变换[5-6]等;基于滤波的方法[7];经验模态分解(Empirical Mode Decomposition,EMD)的方法[8];降秩方法[9-10];压缩感知和字典学习方法等[11-20]。

在基于数学变换的方法中,傅里叶变换具有非常重要的地位,是地震资料处理的基础,但傅里叶变换不能同时兼顾时间域和频率域分辨率。小波变换的提出进一步优化了时间域和频率域窗函数调节问题,具有时域和频域局部化性质,可较好地分析丰富的频率成分和非平稳信号。与小波变换相比,Curvelet变换在去除不规则噪声的同时有效信号的损失较小。Seislet 变换可有效压缩含有空间假频的不完整地震数据,首次在地震数据分解和重构过程中预测并更新算子,可节省内存空间、提高运算速度[6]。耿瑜等[11]根据地震数据的频散关系提出了多尺度Dreamlet 变换压缩方法,压缩比较Curvelet 变换更高,并且在相同的压缩条件下,对压缩、重建后的数据成像,可更好地刻画重要构造。但是,由于地震信号的特征复杂、噪声和有效信号在变换域存在重叠,因此在变换域准确分离噪声而不损伤有效信号的难度较大。

在基于滤波的方法中,Porsani 等[12]提出了修正Spitz 方法,将全步长预测滤波器修改为半步长,大大提高了噪声压制效果。EMD 方法根据数据本身的时间尺度特征分解信号,不需要预设任何基函数。在理论上该方法适用于所有信号分解,尤其在处理非平稳及非线性数据方面优势明显。但该方法存在较严重的端点效应,因此去噪效果不好。

奇异谱分析(Singular Spectrum Analysis,SSA)是经典的降秩方法,通过对由地震数据频率切片构造的Hankel矩阵降秩进行去噪。程文婷等[13]基于自相似性和低秩先验的地震数据去噪方法,通过块匹配算法搜索地震数据的自相似块,再以“自相似块组”为单元,利用低秩约束压制随机噪声。Donoho[14]提出了压缩感知(Compressed Sensing,CS)理论,充分利用信号稀疏性或可压缩性采集、编/解码信号,在降低信号取样要求的同时减少信号处理时间和降低成本。唐刚[15]将CS 理论用于地震勘探领域,通过有机结合地震资料采集和数据重建,充分利用地震资料在字典变换域的稀疏化特征,在大幅降低采样率和节约成本的同时,获得了理想的处理效果。以上模型驱动去噪方法的优点是具有可解释性,算法过程中的每一步都具有数学或物理意义,缺点是需要根据某种数据类型设计对应的问题模型,需要更多的先验知识调整参数才能获得更好的效果,而且简单的物理模型往往不能描述高维度地震数据的复杂特征和细微差别。

模型驱动去噪方法较大地提高了地震资料信噪比,但以字典学习和深度学习为代表的数据驱动方法为压制地震数据的随机噪声提供了新思路。在CS 理论基础上,Aharon 等[16]提出了一种信号表示理论,使用字典代替传统变换域方法的基函数,通过在变换域中选择基函数的最佳组合分离噪声和有效信号。Tang 等[17]将字典学习算法引入地震数据处理,有效去除了伪Gibbs 现象。Beckouche 等[18]通过MOD(Method of Optimal Direction)算法构造学习型字典,结合随机噪声压制过程和字典的训练压制随机噪声。宋维琪等[19]基于K-SVD(K-Singular Value Decomposition)字典学习,根据地震资料本身的特点训练稀疏表示地震资料的最优字典,从而分离噪声与有效信号达到去噪的目的。Wu 等[20]利用SGK(Sequence Generalized K-means)算法代替KSVD 字典学习,提出同步随机噪声去除和重建三维地震数据的快速字典学习方法,显著提高了计算效率。

近年来,大数据、人工智能技术的飞速发展为短时间内处理海量数据提供了保障。目前,地震勘探正向超深层、复杂构造、岩性勘探和非常规方向发展,对地震资料的信噪比和保真度提出了更高要求,神经网络的出现为处理以上问题提供了新思路和途径。深度学习与传统的模型驱动方法相比,在给定先验信息的前提下,在应用过程中对参数的调节更少,对于初学者更友好。主要的神经网络结构,如卷积神经网络(Convolutional Neural Network,CNN)[21]、去噪卷积神经网络(Denoising Convolutional Neural Network,DnCNN)[22]、U-Net 深度神经网络[23]、前反馈(Back Propagation,BP)神经网络[24]、空洞卷积神经网络[25](Dilated Convolutional Neural Network,DCNN)、残差网络(ResNet)[26]等,在地震随机噪声衰减领域已经取得了较好效果。

本文介绍了传统去噪方法及字典学习、深度学习等数据驱动学习方法,通过简述前人研究成果,展望了深度学习在地震去噪领域的发展前景。

1 深度学习的发展历程

20 世纪50 年代,Turing[27]首次提出了人工智能概念(图1),机器学习是人工智能的核心,普遍用于人工智能的各个领域;深度学习是机器学习领域的重要组成部分,能够模仿人脑处理和解释数据。随着深度学习的进一步发展,神经网络作为一种机器学习算法出现在大众视野中,它是受人脑运行规律启发的一项技术,旨在从信息处理的角度抽象处理人脑神经元,通过建立模型模拟人脑神经元的运行规律。这些模型按照输入和输出的映射关系构成不同类型的神经网络,从而解决各类实际问题。神经网络建立了输入和输出的复杂映射关系,一般由输入层、输出层和众多隐藏层构成,输入特征通过隐藏层的复杂变换传递到输出层进而得到输出结果,深层节点可以会聚、合并、重组上一层的特征,从而识别复杂特征。因此各种具有独特神经处理单元和复杂层次结构的神经网络不断涌现,Lecun 等[21]提出的LeNet在当时的学术界和工业界受到广泛关注,随后不断出现许多典型的神经网络结构,如AlexNet[28]、VGGNet[29]、U-Net、ResNet、循环神经网络(RNN)、生成对抗神经网络(Generative Adversarial Network,GAN)和深度置信等网络,这些网络在图像识别、医学成像、信号处理以及人工地震等领域发挥了巨大作用。

图1 人工智能、机器学习与深度学习的关系

2 衰减地震随机噪声的神经网络

本文介绍几种典型的去噪神经网络结构,包括CNN、DnCNN、U-Net、BP、DCNN、ResNet 等,并分析网络性能和随机噪声衰减结果。

2.1 CNN

首先介绍CNN 及其优点,其次阐述CNN 的发展现状,再重点描述多粒度特征融合CNN(Multigranularity Feature Fusion CNN,MFFCNN)的网络结构与去随机噪声效果,并对比5种方法的去噪结果,最后总结了CNN 的不足。

CNN 已经成功用于地震资料随机噪声衰减领域。CNN 具有局部连接、权值共享和池化操作的独特操作,大大减小了参数使用量,提高了网络运算效率,最先用于地震随机噪声衰减。

韩卫雪等[30]构建了一种适用于地震资料去噪的CNN,并成功用于海上叠前地震数据和陆地叠后地震数据随机噪声衰减,实验数据显示该方法的随机噪声去除效果优于小波变换、曲波变换等传统方法。针对利用CNN 进行地震资料去噪的结构选择具有盲目性的问题,Zhang 等[31]利用稀疏自动编码器有效衰减了地震数据随机噪声,并保留了数据的细微特征。Dong 等[32]通过构建噪声集训练不同区域的去噪模型,有效抑制了不同地区的地震随机噪声。Yang 等[33]提出了一种智能CNN 降噪框架,可以自适应地捕捉地震资料中的有效信号,获得去噪信号。利用激活函数指数线性单元(Exponential Linear Units,ELU)和Adam 优化算法训练网络,ELU 能够缓解负区间的梯度消失,提高了网络对负尺度有效信息的提取能力,有效提升了随机噪声衰减效果。向奎[34]通过改进图像超分辨率重构领域的超分辨率CNN(Super Resolution Convolutional Neural Network,SRCNN)[35]衰减地震道集随机噪声。改进的SRCNN 直接从输入图像和输出图像学习端到端的映射,可将含噪道集视为低分辨率图像,去噪道集视为高分辨率图像。该映射以从输入图片到输出图片的CNN 的形式表示。SRCNN 兼具结构简单和参数调整方便的优点,不仅图像处理水平很高,而且实现了即时可用的高速实用性。

大多数CNN 采用监督学习方式衰减地震随机噪声,需要构建大量的无噪数据和含噪数据作为训练集,由于难以获得无噪数据,导致监督学习方法的去噪效果不佳,降低了网络的泛化性。使用合成地震数据训练网络时,由于合成地震记录与真实地震记录在结构上相差较大,大大降低了监督学习方法的实际地震数据去噪效果。

无监督学习克服了难以获得实际无噪地震数据的困难,基于概率密度和输入样本的相似性学习噪声数据和有效信号的相似性,达到压制随机噪声的目的。用于地震数据处理领域的无监督学习方法主要有三类:第一类是自动编码器(Autoencoder,AE),可以高效地处理含噪地震数据,并且非线性表示能力较好;第二类是深度图像先验(Deep Image Prior,DIP),此类方法需要满足两个前提,即噪声是独立分布的,且地震信号的自相关性更强。但是,在网络训练时必须要确定噪声衰减的最优迭代次数;第三类是自监督深度学习(Self-Supervised Learning),将含噪地震数据作为输入和标签训练神经网络,通过自监督损失函数去噪。自监督学习方法可以引入监督学习网络的训练模型权重训练初次全连接层,降低了网络模型的训练时间成本。

Fang 等[36]提出了一种新型无监督学习的地震随机噪声衰减方法,可以直接使用含噪标签训练网络,有效提高了地震资料的信噪比。但该方法对非零均值噪声的衰减效果较差,需要进行零均值校正。Chen 等[37]提出了一种新的自监督学习地震数据去噪方法,利用含噪数据训练网络,对丢弃层产生的原始噪声数据进行伯努利采样训练神经网络,在测试过程中采用蒙特卡罗(Monte Carlo)自积分法进一步提高了网络的去噪效果。Wang 等[38]提出了一种基于模型的地震数据无监督深度学习的去随机噪声方法,在物理模型部分改进了迭代软阈值算法(Iterative Soft Threshold Algorithm,ISTA),并设计了一个平滑惩罚损失函数计算可训练参数的梯度;将由f-x反褶积处理的含噪地震数据作为网络输入,经过网络的进一步处理后输出去噪地震剖面,不需要地震数据的先验信息,具有良好的泛化性,去噪效果优于传统方法以及监督学习、无监督学习去噪方法。

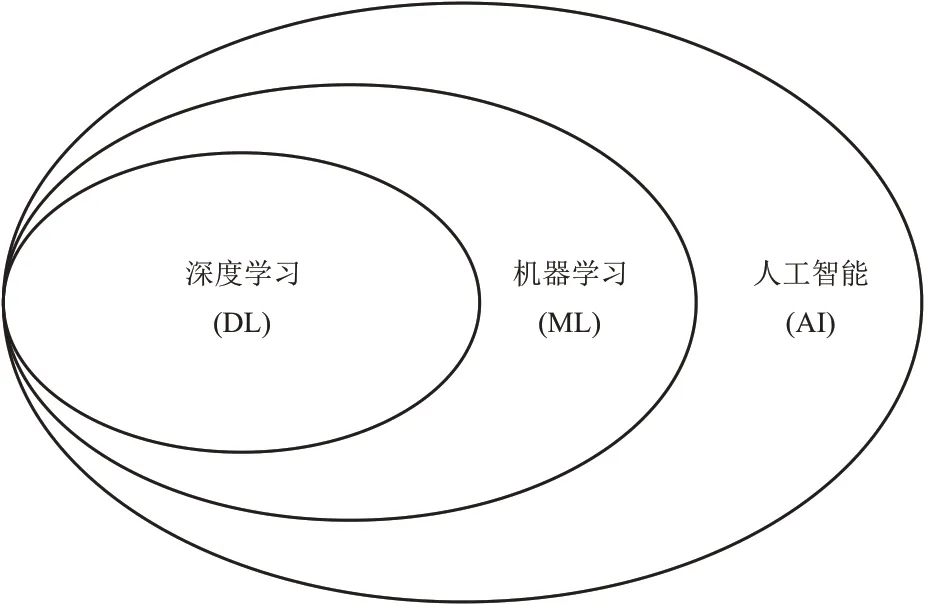

传统的基于CNN 的地震随机噪声压制方法大多使用固定大小的卷积核,不能通过可变大小的卷积核提取不同尺度的地震信号特征。为了解决这一问题,Feng 等[39]使用具有不同尺寸卷积核的多粒度特征融合模块(Multigranularity Feature Fusion,MFF)提取地震数据中不同尺度的波动特征,并利用特征融合结构的特征更好地处理地震数据的细节和纹理信息,提出了MFFCNN 地震随机噪声衰减方法,提高了地震资料去噪效果。首先,MFFCNN 的头部将输入数据经卷积层(Cov)和激活函数ReLU(Rectified Linear Unit)提取初步特征;然后,将获得的特征图送入网络结构主体,模块1、模块2、模块3分别采用3×3、5×5、7×7 的卷积核分别从不同的粒度提取潜在特征;最后,经过尾部的卷积层和激活函数还原输出(图2)。

图2 MFCNN 结构[39]

图3 为MFFCNN 主体部分的三个MFF 模块详细结构。由图可见,每个卷积层的卷积核数量为16,保证了输出图像的通道数与输入图像一致。通过不同尺寸的卷积核的模块输出16×3 的通道数连接张量,通过卷积层融合成一个16×1的张量,使MFF模块的输出图像尺寸与输入保持一致。最后,将MFF模块输入与MFF模块的输出的残差作为网络输出。

图3 MFFCNN 主体部分的三个MFF 模块详细结构[39]

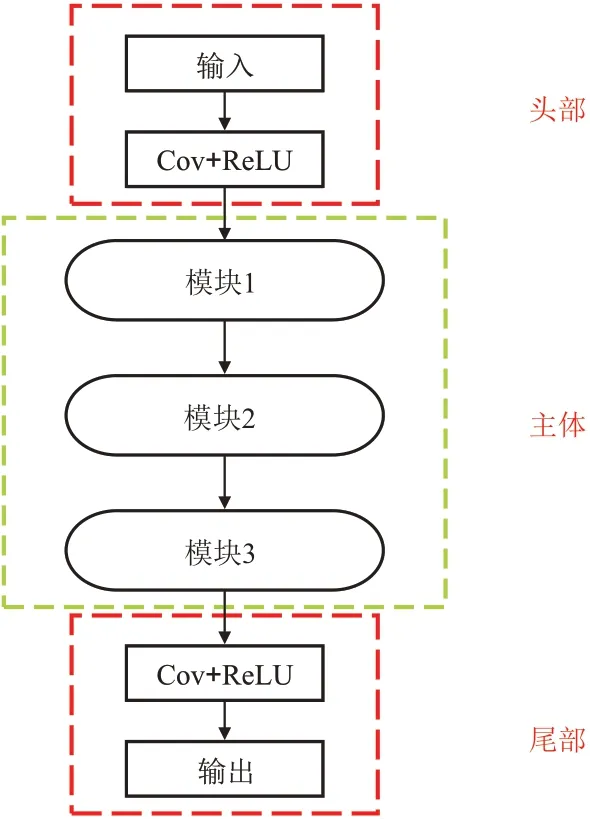

图4 为不同方法的去噪结果。由图可见:合成地震数据(图4a)添加标准差σ=1.3 的随机噪声后同相轴模糊不清(图4b),经过6 种方法压制噪声后信噪比都得到了相应提高(图4c~图4h),且都存在一定的有效信号损失和同相轴弯曲,但是MFFCNN 处理结果的同相轴最清晰,波形畸变最小,在压制随机噪声的同时,更好地保证了地震信号的保真度(图4h)。

图4 不同方法的去噪结果[39]

表1 为不同去噪方法压制噪声后的峰值信噪比(PSNR)和结构相似度指数(Structural Similarity Index,SSIM),其中SSIM 的值越接近1 代表噪声压制前、后的地震剖面越相似、效果越好。由表可见,随着输入数据加入的随机噪声越大,各种方法去噪后的PSNR 降低,但是MFFCNN 的去噪效果始终优于其他方法,其PSNR、SSIM 始终大于29.575 dB、0.9474。

表1 不同去噪方法压制噪声后的PSNR(dB)/SSIM[39]

CNN 作为一种BP 网络,自由参数的数量较少,可以提高训练效率,并且减少特征损失。但是,CNN在压制地震随机噪声时具有一定的盲目性,不同的CNN 结构对地震随机噪声的压制效果不同。

2.2 DnCNN

DnCNN 在CNN 的基础上使用了更深层次的网络结构、残差算法以及批标准化,噪声衰减效果更好。Xu 等[40]首先在图像去噪领域提出了DnCNN。为了在CNN 的基础上进一步压制地震随机噪声、提高地震数据的信噪比,Yu 等[41]将DnCNN 用于地震随机噪声衰减,分别使用不同的卷积层个数进行去噪试验,结果表明卷积层个数为17 时随机噪声衰减效果最好。但是,DnCNN 仍存在特征图利用不充分、细节特征丢失的缺点,导致去噪地震资料存在一定的波形失真。为此,张超铭等[42]进一步改进DnCNN,使网络更适用于地震数据去噪。改进模型Constrained-DnCNN 在浅层网络引入约束卷积提取低层特征并传递到深层网络,因此能够自主学习噪声残差特征,并借鉴残差网络的结构设计,通过跳连接(Skip Connection)提高网络训练效果。结果表明,Constrained-DnCNN 可以实现盲去噪,并进一步增强去噪效果,提高地震数据信噪比。针对DnCNN 对复杂地震数据的去噪效果较差、存在波动特征损失的问题,钟铁等[43]提出了多分支去噪神经网络(Diverse Branch Block Convolutional Neural Networks,DBBCNN),对沙漠地区复杂地震数据的随机噪声衰减实验结果表明,DBCNN 可以更好地压制随机噪声,去噪地震数据的信噪比较高。Zhong 等[44]利用多尺度去噪卷积神经网络(Multiscale Denoising Convolutional Neural Network,MSDCNN)压制地震随机噪声,可在不同尺度提取地震数据特征,其跨尺度交互功能提高了去噪精度,特别对低信噪比地震资料的去噪效果更好,并在更大程度上保留了有效信号的振幅特性。

DnCNN 的输入信号为含噪地震数据,网络共有17个卷积层,前16层的卷积核尺寸为3×3,步长为1,卷积核数量为64。为了使输出特征图的大小与网络输入匹配,在卷积后进行填充0操作,避免了图像的特征损失。该网络在第1 个卷积层中使用激活函数ReLU 对含噪数据归一化处理;第2~第16 卷积层添加批归一化处理,加快网络收敛速度;第17 卷积层通过卷积还原输出,网络的输出为预测的随机噪声,经过还原输出为去噪数据(图5)。

图5 DnCNN 去噪网络结构[41]

DnCNN 是一种利用残差学习和BN 进行去噪的CNN,由于DnCNN 为没有池化层的全卷积网络结构,导致内部数据结构和空间层级化信息丢失,造成去噪地震数据的少部分纹理特征丢失、卷积核感受野较小以及捕获邻域信息能力不足的问题。

2.3 U-net

U-Net是改进的全卷积网络,因其结构的形状类似于字母“U”而得名(图6)。U-Net 最早由Ronneberger 等[23]提出,目前已成为深度学习领域最重要的方法之一,同时也普遍用于地震随机噪声衰减。

图6 U-Net 结构[48]

在U-Net结构的基础上,王钰清等[45]提出了一种以数据增广和CNN 为基础的U型网络,为解决深度学习中的数据标签问题提供了新的途径和方法。罗仁泽等[46]构建了一种较U-Net 更深的残差U 型网络(RU-Net),该网络具有强大的特征捕获能力,引入残差块后,通过对提取的随机噪声进行二次消化、学习,尽量保留一次学习可能丢失的随机噪声特征,使学习到的噪声特征更接近噪声本质,因此随机噪声压制效果优于U-Net。Bai等[47]搭建了一种基于U-Net的深度学习网络压制地震随机噪声,与U-Net不同的是在编码器部分添加了Dropout 防止网络过拟合,可以提高网络的运行效率,网络输出为含噪地震数据和去噪地震数据之间的残差。将余弦相似度指数作为损失函数,可更好地保持去噪地震数据同相轴的横向连续性。Liu 等[48-49]在前人的基础上基于U-Net 提出了融入自相似性的无监督地震数据噪声压制(Noise2Sim)方法,采用相似图像采样器生成训练对,提出了相似驱动的自监督学习(Similarity-informed Self-learning,SISL)模型。在训练过程中引入正则化约束的损失函数约束有效信号损失,有效提高了地震数据信噪比。

图6 为U-Net 结构。由图可见,U-Net 网络主要分为编码和解码两个部分,其中编码部分使用卷积核尺寸为3×3 的卷积与BN 和ReLU 串联,使用最大池化(Max Pooling)压缩特征图尺寸,转置卷积(CovTranspose)的作用是重构特征图,使用Conat跳连接缓解网络训练过程的过拟合。

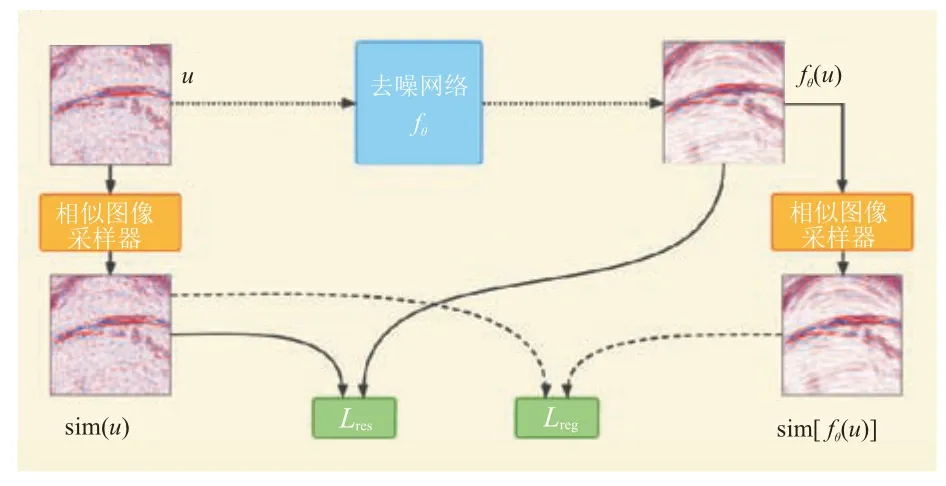

图7为SISL结构图。由图可见:将原始含噪数据u送入相似图像采样器中生成相似噪声图像sim(u)。然后,将u作为去噪网络fθ的输入得到去噪后的数据fθ(u)。再将fθ(u)送入相似图像采样器得到sim[fθ(u)]。使用的混合损失函数由两部分组成:①fθ(u)与sim(u)之间的均方误差损失函数Lres;②考虑到sim[fθ(u)]和sim(u)之间的差异,引入正则化约束的均方误差损失函数Lreg,可以有效地减少有效信号的损失。图8、图9 分别为不同算法的去噪结果、去除的噪声剖面。由图可见:①K-SVD(图8b)和非局部均值(Nonlocal Means,NLM)(图8c)方法去噪剖面信噪比较高,同相轴较清晰,但是相对于含噪地震数据(图8a),图8b、图8c损失了部分波动特征,还存在一些条带噪声和剩余随机噪声(图9a、图9b),并使部分同相轴过于平滑;②由于图8a 中存在非零均值噪声,由噪声数据的无监督去噪方法(Noise2Void)虽然更好地保留了波动特征(图8d),但噪声剖面残存有效信号(图9c);③Noise2Sim(图8e)和SISL(图8f)方法较好地保护了有效信号并压制了随机噪声,二者总体上去噪效果接近,但图8e 左上角存在部分波形错乱,噪声剖面(图9d、图9e)的颜色指示SISL(图9e)更好地保留了有效信号。因此,SISL 方法可以有效地消除随机噪声,并较好地保留有效信号。U-Net通过独特的编码和解码操作,在地震随机噪声衰减领域已取得较好效果,但仍存在模型泛化性受限和地震数据局部细节丢失等问题。

图7 SISL 结构图[48]

图8 不同算法的去噪结果[48]

图9 不同算法去除的噪声剖面[48]

2.4 BP 神经网络

按误差反向传播训练的BP 神经网络是一种多层前馈网络,最早由Rumelhart 等[24]提出。图10 为BP神经网络结构。由图可见,网络结构主要包括输入层、复杂的隐藏层和输出层,神经元的作用是连接相邻的层并进行相关计算。图11 为BP 神经网络工作流程。由图可见:噪声衰减原理是把含噪数据作为输入数据,然后通过隐藏层的处理和反向传播调整权值和参数,输入数据从输入层经过隐藏层逐层处理,然后转入输出层,每一层的神经元状态仅受上一层神经元状态的影响;如果输出结果不及预期,则转入反向传播,即将误差信号沿着连接通路原路返回,不断修改各神经元的权值,使误差信号逐渐降至最小。输出为去除的随机噪声,再用原始含噪数据减去BP 神经网络输出的噪声剖面,即可得到去噪地震数据。

图10 BP 神经网络结构[24]

图11 BP 神经网络地震数据去噪流程(据文献[24]修改)

BP 神经网络在去噪方面有独特优势,它能自动学习噪声和地震资料之间的函数关系,并且具有网络结构简单、效果好、普适性强等优点。但BP 神经网络主要用于处理非线性问题,对于线性问题,噪声衰减效果并不理想。

2.5 DCNN

DCNN 在DnCNN 的基础上扩大了卷积层的感受野,能够进一步缓解池化操作造成的特征细节丢失问题,用于地震随机噪声衰减可更有效地提取地震资料中的波动特征,保留更多细节。顾航[50]提出了一种基于DCNN 的地震数据去噪算法解决DnCNN 去噪后部分纹理信息丢失问题。将空洞卷积引入DnCNN结构,采用扩大感受野的方式获取更多的地震记录波动特征,以增强网络的特征学习能力。应用空洞卷积改进DnCNN 结构构建地震数据去噪模型,通过优化网络扩展率、训练集、网络参数提高模型去噪能力。玉琨[51]基于DnCNN 网络结构并结合空洞卷积的优势改进 DnCNN 算法:利用空洞卷积核代替传统的卷积核,并在不增加参数的情况下扩大CNN 的感受野,设计了一个用于地震资料去噪的对称式空洞卷积神经网络(Symmetric Dilated Convolutional Neural Network,SDCNN)。

SDCNN 将空洞卷积方法引入DnCNN 框架,以空洞卷积代替部分传统卷积,为网络提供了更大的感受野,使地震数据的内部数据结构保留更多的有效信息,并避免了丢失大量有效信息的情况发生。SDCNN 充分考虑了含噪地震记录与残差之间的关系,扩大了卷积视野,便于恢复地震记录的纹理信息,其结构如图12所示。含噪数据作为网络结构的输入,经过多层1D、2D、4D 卷积层、BN 和ReLU 激活函数,最终输出结果为去噪数据。

图12 SDCNN 结构[53]

DCNN 具有较大的感受野,在提取随机噪声特征时能利用更大范围的背景信息,大大增强了信息捕获能力,既能消除大量的随机噪声,又避免了有效信息的丢失。但由于空洞卷积在常规卷积核的相邻权重之间插入了“0”,因此损失了捕获信息的连续性。

2.6 ResNet

He等[26]提出的ResNet是改进的深层CNN,在图像处理领域引起了巨大反响。通过在卷积层之间添加快捷连接(Shortcut Connection)操作,解决了随着网络层数加深带来的梯度消失问题。何凯[52]提出基于双重残差结构的CNN 地震随机噪声压制方法,缓解了CNN 的梯度消失问题,可更好地提取地震数据特征。结果表明,该方法在保留有用信息的同时能够更好地压制随机噪声。在地震信号去噪问题中,ResNet通过逐层残差学习,可充分学习信号和噪声特征。在图像处理领域,研究表明重复的配对操作可以有效地提高网络性能。为了进一步提高去噪效果,方文倩等[53]将双重ResNet结构引入地震资料随机噪声衰减,该方法允许将不同层配对操作的两个算子任意组合,可提取丰富的地震数据和随机噪声特征,提高了网络的随机噪声衰减性能。武国宁等[54]结合ResNet的拓扑结构与平稳小波变换(Wavelet)压制地震随机噪声,避免了训练过程中的梯度消失问题,可获得信号低频以及不同方向的高频特征信息。

图13为小波变换与深度ResNet结构。网络输入为一级平稳Haar小波变换(SWT)得到的低频以及不同方向的高频含噪数据。ResNet 共有17 层,其中第一层为卷积和激活函数层(Cov+ReLU),其他层为卷积、批量归一化和激活函数层(Cov+BN+ReLU),最后一层为卷积层(Cov)用于重建输出。输出为一级平稳Haar小波变换的四个分量。用输入数据X与标签数据Y相减得到的信号通过逆平稳小波变换(ISWT)得到去噪数据。

图13 小波变换与深度ResNet 结构[54]

图14 为含有4个不同斜率的线性同相轴的模拟数据去噪效果对比。由图可见,文献[54]的方法对加噪地震数据的去噪效果(图14f)优于小波阈值(图14c)、f-x域反褶积(图14d)、DnCNN(图14e)、方法。

图14 含有4个不同斜率的线性同相轴的模拟数据去噪效果对比[54]

ResNet的提出解决了由于网络层数过深带来的性能退化问题,可以反向更新解决梯度消失和梯度爆炸问题,打破了网络的不对称性,增强了网络的泛化性。

2.7 迁移学习

目前,由于CNN 等监督学习方法需要大量的标签数据,但野外地震数据量大、采集成本高以及地震资料保密机制的限制,难以获得高质量的标签数据,很难继续提高去噪效果。为了解决缺乏真实地震数据的问题,人们提出了GAN[55]用于生成数据集,但是将GAN 生成的数据作为训练集处理结果可能不尽人意。

Sun 等[56]提出了基于无监督迁移学习的地震随机噪声衰减方法,该方法在Batson等[57]提出的自监督盲去噪(Noise2self)的基础上加入迁移学习策略。假设真实地震信号是相关的、噪声是相互独立的,使用一个不变的值(J-invariant)用于估计降噪器的去噪性能。利用N2STL(Noise2self Transfer Learning)方法对含有不同高斯噪声的2D 叠前和叠后合成地震记录、2D 野外共反射点道集和3D 叠后地震记录降噪,在增强地震资料信噪比的同时更好地保留了深部有效信号,取得了理想的去噪效果。另外,自注意力机制等网络结构的地震资料去噪效果较好。

2.8 不同网络模型噪声压制效果对比

目前,利用神经网络压制地震随机噪声已成为研究热点,人们不断提出了新的网络模型、优化算法、学习策略以及数据集制作方式。CNN、DnCNN和U-Net都是利用卷积操作提取特征,但是它们的网络结构不同。DnCNN 在CNN 的基础上引入BN 和残差学习策略,加快了网络的收敛速度;U-Net 在CNN 的基础上增加了编码和解码步骤,分别通过池化层或下采样和转置卷积或上采样实现,能够提取更高维度的复杂特征。文中对比、分析了不同的网络结构以及去噪效果(表2)。

2.9 CNN 噪声压制实例

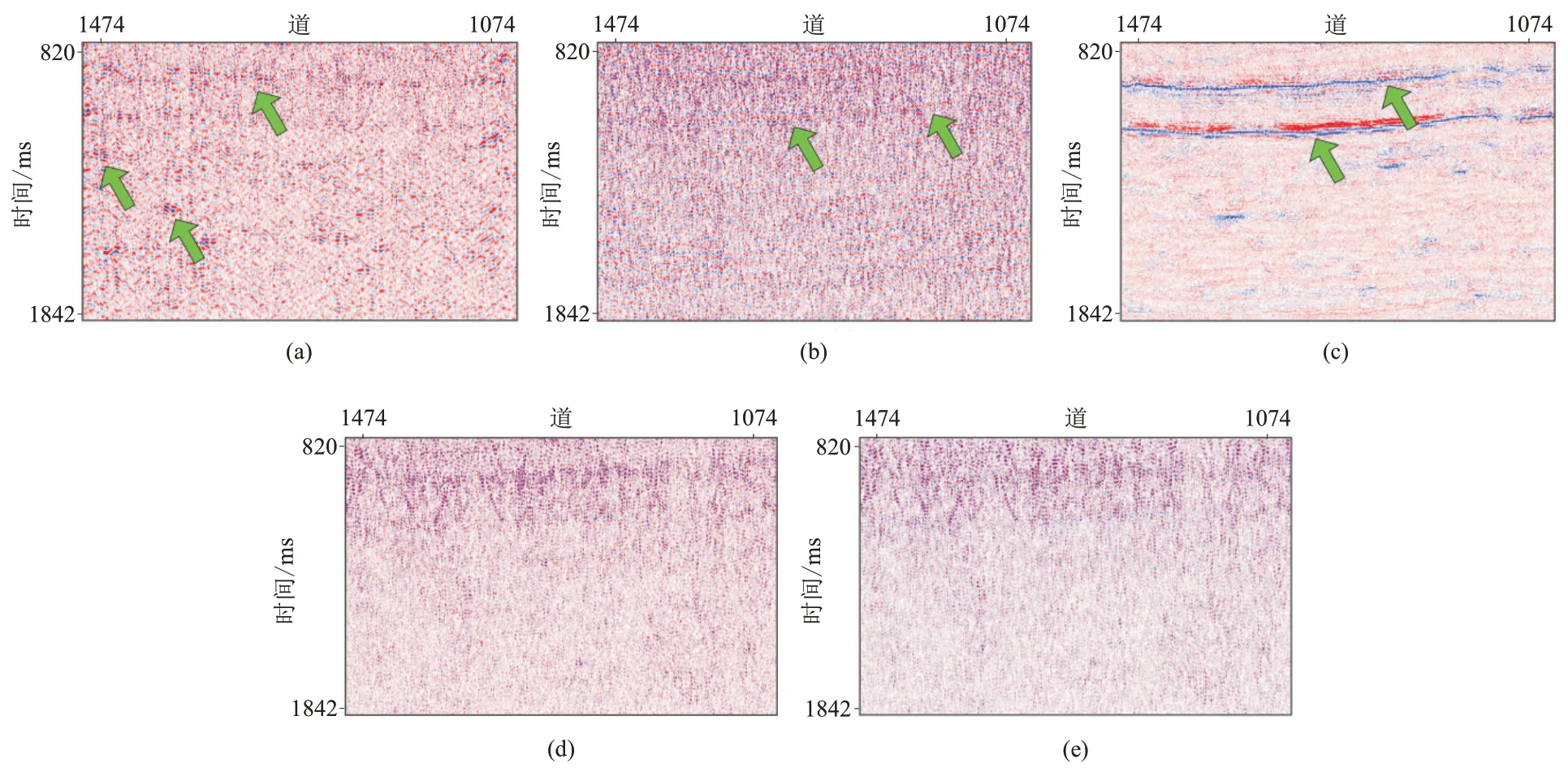

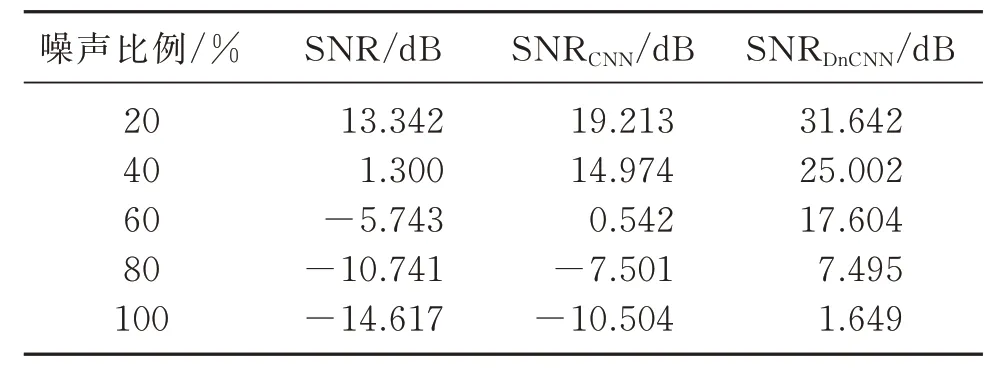

采用2D 开源数据集[41],将数据集划分为145631 个标签数据,并对每个标签数据添加40%的随机噪声作为训练集(图15)依次训练。初始学习率为0.0001,卷积核尺寸为3×3,步长为1,利用Adam优化算法自动调整学习率提高网络收敛速度。共迭代80 次,每次送入神经网络的样本数设置为64。测试在Ubuntu 操作系统下进行,内存为32 G,GPU 型号为NVIDA GeForce RTX 3090。噪声压制效果(表3)表明,随着噪声比例增加,原始地震数据的信噪比SNR 不断降低,去噪地震数据的信噪比SNRCNN、SNRDnCNN显著提高,且DnCNN 的噪声压制效果好于CNN。

表3 DnCNN 和CNN 的去噪前、后的信噪比

图15 随机抽取的训练数据和标签数据对

图16 为实际地震数据去噪结果。由图可见,对于原始地震数据(图16a)的加噪数据(图16b),DnCNN 的噪声压制效果(图16d、图16f)好于CNN(图16c、图16e),能够更好地压制随机噪声并保留弱振幅地震信号,且图16d的同相轴更清晰。

图16 实际地震数据去噪效果

3 结论和展望

3.1 结论

以CNN、DnCNN、U-Net、BP、ResNet 和迁移学习等为代表的深度学习方法的实际去噪效果优于传统方法和字典学习方法,且不需要设定结构模型,泛化性更强。利用训练好的网络结构去噪时,计算时间往往比模型驱动短且精度更高。

但是基于深度学习的地震去噪技术也存在诸多不足:实际数据的去噪效果往往差于合成数据;普适性不强;神经网络的“黑匣子”特性使其物理可解释性大大降低;网络性能与训练数据的泛化性密切相关,若训练集覆盖所有类型的解,则去噪效往往较好;用于训练网络的数据集因人而异,难以评价网络性能。

3.2 展望

深度学习技术已经成功用于地震去噪领域,但也存在诸多问题,期待深度学习在以下方面取得进展和突破:

(1)搭建适用于不同噪声的去噪神经网络结构,并将更优的网络结构引入地震随机噪声压制。目前基于深度学习的去噪方法中,大多针对去除地震随机噪声,而对于面波、声波、多次波、绕射波等相干噪声的压制方法较少,若能通过深度学习方法去除相干噪声,将会大幅提高地震资料处理效率及信噪比。将更多的神经网络模型引入地震资料去噪领域提高资料处理精度,将成为未来的研究方向。

(2)将地震信号转换到变换域构造网络的损失函数。在变换域可在一定程度上分离噪声和有效信号,将变换域的地震信号作为网络损失函数可进一步加快网络收敛速度、提高网络的预测精度,但也存在多次变换的累计误差。

(3)改进学习策略的同时制作更具代表性的数据集,尽可能地使训练数据覆盖所有类型的解,提高网络泛化性。对于基于监督学习的地震随机噪声衰减方法,训练结果与训练集的质量密切相关,因此制作更具代表性的数据集使训练集尽可能地覆盖所有解,可以提高网络的泛化性;采用基于无监督学习的方式可以摆脱对无噪数据的依赖,将含噪数据做为训练集也是发展趋势之一。

(4)自动化的参数调优。神经网络依赖于大量的训练集,而地震数据量巨大,造成模型训练时间过长。因此期待自动改进网络参数的方法,在保证地震资料信噪比的同时,提高网络的训练速度。

(5)结合模型驱动与数据驱动的方法。基于模型的方法并不依赖标记数据学习映射,但简单的模型往往不能描述高维复杂数据的细微差别和动态变化,而且每一步算法都需要对应的数学/物理模型,不具备泛化性。相比之下,基于数据驱动的方法不依赖于解析近似,从复杂数据中提取有效信息,但不具备数学可解释性。采用即插即用等方式,结合模型驱动与数据驱动的方法可以进一步探索数据驱动和模型驱动的优势。