汽车毫米波雷达信号处理技术综述

黄 岩 张 慧 兰吕鸿康 邓 坤 杨 阳 张睿哲 刘 江 张彦君 王韵旋 周 睿 徐 俊 奚新锁 张 侠 郑凯航 刘育铭 洪 伟

(东南大学毫米波国家重点实验室 南京 210096)

1 引言

随着科学技术的发展,自动驾驶技术正在逐步从理论探索转向实际工程应用。传感器作为具备测量和感知功能的器件,在这一过程中扮演着重要角色,它们就像汽车的“眼睛”和“耳朵”,能够帮助驾驶人员和高级驾驶辅助系统(Advanced Driving Assistance System,ADAS)对周围的目标进行检测、识别和跟踪,为驾驶操作提供决策依据。毫米波雷达作为ADAS中不可取代的一部分,具有许多优势。首先,毫米波雷达具备远距离探测的能力,可以在较大的范围内感知周围环境。其次,毫米波雷达体积较小且成本适中,易于集成到汽车中。此外,毫米波雷达具有全天候工作的能力,不受天气条件的限制,能够在雨、雾和烟尘等复杂环境下工作。它还具备强大的穿透能力,可以穿透雨雾等干扰物,提供可靠的检测数据。毫米波雷达与其他传感器如激光雷达、摄像头等相结合使用,能够提供更全面、准确的环境感知能力,提高自动驾驶系统对周围环境的理解和判断能力。

近年来随着多输入多输出(Multiple Input Multiple Output,MIMO)技术以及多芯片级联技术的成熟,通过优化设计汽车毫米波雷达系统,使其能够在空间上虚拟出比物理天线孔径大很多的虚拟阵列,再加上稀疏阵列合成孔径的设计思想,让毫米波雷达的角度分辨率得到了极大的提升。硬件水平的提升使得毫米波雷达得到了快速的发展,当前新一代汽车毫米波雷达已能初步实现目标距离、多普勒(速度)、方位角和俯仰角的四维高分辨能力,即获得具有空间三维坐标和速度信息的4D点云。相较于传统的毫米波雷达,新一代4D毫米波雷达能够提供更为丰富的点云信息,因此如何有效地将机器学习框架应用到4D毫米波雷达中实现特征提取和目标分类成为目前的研究热点。除了点云成像外,能够利用相对运动等效合成阵列实现距离向、方位向的二维高分辨率的合成孔径成像也在汽车毫米波雷达领域掀起了研究的热潮。此外在装载4D毫米波雷达的车辆不断增多的情况下,如何提高毫米波雷达的抗干扰能力也已然成为亟需面对的问题。

下面本文将围绕三大核心雷达信号处理应用领域来对汽车毫米波雷达信号处理技术进行总结展望。

2 汽车毫米波雷达点云处理技术

随着射频器件尤其是芯片高集成度的持续发展,在车装有限空间下(例如前向汽车雷达尺寸≤11 cm×11 cm×3 cm,角雷达的尺寸≤6 cm×7cm×2 cm[1]),汽车毫米波雷达可以实现高分辨的点云成像能力。所谓“点云”就是指通过测量仪器得到物体表面的点数据位置的集合。目前用于实现点云处理的方法主要包括阵列信号处理方法、神经网络方法以及多传感器融合方法等。这些方法各具特色,都能有效实现点云成像。其中,阵列信号处理方法主要基于数学模型和信号处理技术,它的优点在于实现简单、稳定可靠;神经网络方法因其强大的非线性建模能力和高效的并行计算在图像识别和目标检测等任务中表现出色,具有良好的应用前景;多传感器融合方法可以利用多种传感器对汽车毫米波雷达的互补性,结合毫米波雷达高精度点云成像能力,提高ADAS的鲁棒性和精确度。无论采用何种方法,汽车毫米波雷达点云处理技术的发展都为自动驾驶的实现提供了重要支持和保障。下面具体介绍各类方法的流程及特点。

2.1 阵列信号处理点云成像方法

在阵列信号处理流程中,实现汽车毫米波雷达点云成像的关键是利用方位向和俯仰向的空间分辨能力生成致密的点云。主要流程为发射调频连续波(Frequency Modulated Continuous Wave,FMCW)信号,经目标反射后在接收机与发射信号进行混频得到中频(Intermediate Frequency,IF)信号,通过对中频信号进行二维快速傅里叶变换(Two Dimensional-Fast Fourier Transform,2D-FFT)以及恒虚警率(Constant False Alarm Rate,CFAR)目标检测算法估计出目标的距离和速度信息,然后利用不同通道间接收信号的相位差,采用波达方向(Direction of Arrival,DOA)估计算法可以获得目标的方位角和俯仰角信息。完整信号分析流程如图1所示。

图1 毫米波雷达点云成像算法处理流程Fig.1 The processing flow of millimeter-wave radar point cloud imaging algorithm

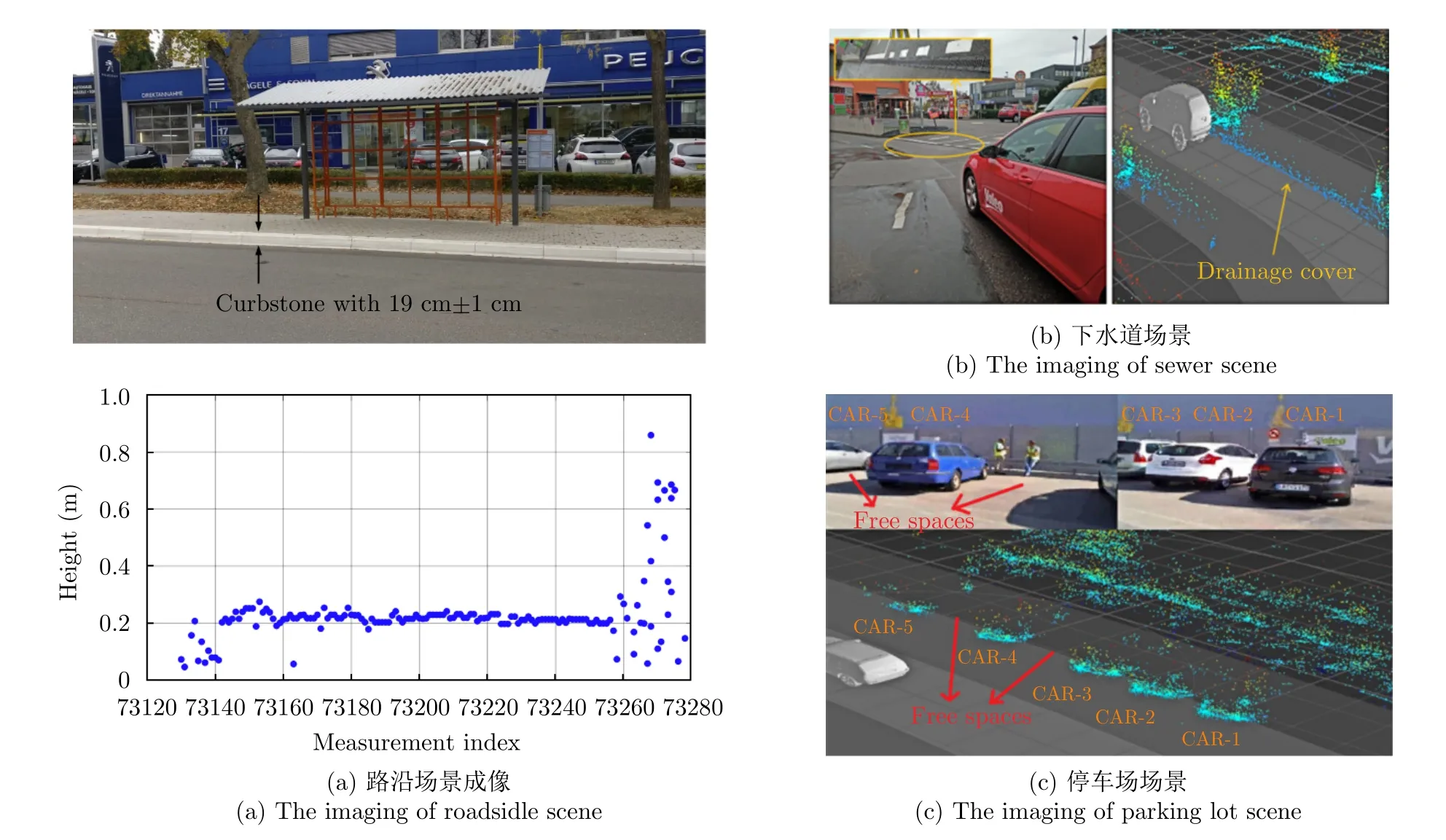

传统的毫米波雷达信号处理算法仅能通过稀疏的点云定位目标,而无法准确勾勒待测物体的轮廓,从而限制了对周围场景的还原能力。自2015年以来,越来越多的研究人员致力于开发汽车毫米波雷达系统的点云成像和处理技术。其中,Li等人[2]设计了一款基于二进制相移键控(Binary Phase Shift Keying,BPMK)正交波形的MIMO-FMCW 4D成像雷达,该雷达实现了实时信号处理和对雷达周围场景的三维映射,成像结果如图2所示。加州大学圣迭哥分校的Qian等人[3]开发了名为MilliPoint的毫米波雷达系统,该系统通过对信号变化和雷达运动之间的关系进行建模,实现了自追踪以进行相干空间采样,并通过成像后处理的方式对目标聚焦,解决了镜面反射的问题,其点云生成效果如图3所示。此外,Engels等人[4]概述了汽车毫米波雷达信号处理的研究进展,并对多目标情况下毫米波雷达的综合信号模型进行了分析和讨论。文献[5]则通过分析毫米波雷达点云图像数据特征,利用最近迭代点方法实现对两帧数据的匹配和融合,再通过自适应邻域半径的DBSCAN算法对融合后的点云进行聚类,最后通过求解凸包得到点簇的最小外接矩形,实现目标识别。

图2 基于BPSK正交波形的MIMO-FMCW 4D雷达成像[2]Fig.2 MIMO-FMCW 4D radar imaging based on BPSK orthogonal waveform[2]

图3 MilliPoint系统3D点云生成[3]Fig.3 The 3D point cloud generated by MilliPoint system[3]

在汽车毫米波雷达系统中,点云是通过使用CFAR检测器从雷达回波信号中检测出目标并以点的形式在三维坐标系上表示的。点云的数量和密度直接影响着成像质量和目标检测的准确性。传统的信号处理方法通常通过改进CFAR检测器的算法来实现更高密度、更精细的点云生成。文献[6]提出了一种名为PreCFAR网格地图的方法,通过建立一个静态环境的图像表示,克服CFAR网格图构建时存在的稀疏性和掩蔽性等缺点。而文献[7]则提出了一种基于区域的CFAR框架,利用二维RDM上基于区域的目标信息来提高检测信噪比,极大提高了CFAR检测性能,得到点云图像如图4所示。此外,文献[8]还提出了一种自适应门限设置的方法,根据雷达接收功率与距离的关系动态地分配CFAR检测的门限系数,并结合检测单元附近单元的噪声功率得到自适应检测门限,从而生成了较为致密可信的毫米波雷达三维点云图像,如图5所示。

图4 文献[7]提出的PreCFAR方法与传统SO-CFAR方法生成点云数量对比Fig.4 Comparison of the number of point clouds generated by PreCFAR method proposed in Ref.[7] and the traditional SO-CFAR method

图5 文献[8]中三维点云成像结果Fig.5 3D point cloud imaging results in Ref.[8]

基于传统信号处理的毫米波雷达点云成像技术具有高精度、高灵敏度和鲁棒性等优点,相关论文汇总如表1所示,但在实际应用中,也存在一些挑战。首先,环境噪声会干扰雷达接收到的信号,从而影响成像结果的精度。此外,多径效应也会对成像精度产生影响,因为雷达信号在传播过程中会发生多次反射、折射或散射。另外,处理大量数据也是毫米波雷达系统面临的问题之一。由于需要采集和处理大量的点云数据,处理器需要具备高速的计算和存储能力,才能实现实时处理。因此,需要使用更加高效的数据处理算法和技术来提高数据处理速度和效率。

表1 基于信号处理方法实现点云成像相关论文汇总Tab.1 Summary of relevant papers of realization of point cloud imaging based on signal processing

2.2 深度学习点云处理方法

自2015年以来,快速发展的深度学习技术在绝大部分计算机视觉任务的表现效果超越了传统方法,例如目标检测、图像识别和语义分割等。在雷达信号处理领域,使用深度学习算法进行数据分析同样成为研究热点,一些基于数据驱动的方法被广泛应用于汽车毫米波雷达信号处理技术。

2.2.1 点云分割

汽车毫米波雷达得到的点云稀疏、噪声多、信息不够直观,因此仍需通过分割等点云处理方法来提取目标物体的信息。近年来,通过深度学习方法对毫米波雷达得到的点云进行分割,提取目标物体的轮廓和特征,从而更加准确地实现目标识别和分类。Danzer等人[9]利用PointNets对二维雷达点云进行车辆边界盒估计,以区分车辆和杂波。然而,Point-Nets的设计是为了学习对象的三维空间特征,且雷达点云相对于激光雷达而言较为稀疏,因此直接借鉴不是最佳选择。为了解决这个问题,文献[10]提出了一种高斯混合模型(Gaussian Mixture Model,GMM),结合相对高分辨率的雷达数据进行点云分割;文献[11]提出了一种改进随机样本一致性(Random Sample Consensus,RANSAC)算法,通过点云分割从二维静态点云图像中估计道路边界,如图6所示;此外,文献[12]介绍了一种基于雷达点云数据的自动驾驶道路路线估计算法,包括Density-based Spatial Clustering of Applications with Noise (DBSCAN)算法去除部分错误检测、DT (Delaunay Triangulation)进行空间数据聚类、使用RANSAC拟合道路边界曲线以及通过PointNet++神经网络估计可能形成的轨迹。

图6 RANSAC算法实现道路检测[11]Fig.6 Road boundary detection based on RANSAC algorithm[11]

2.2.2 目标检测

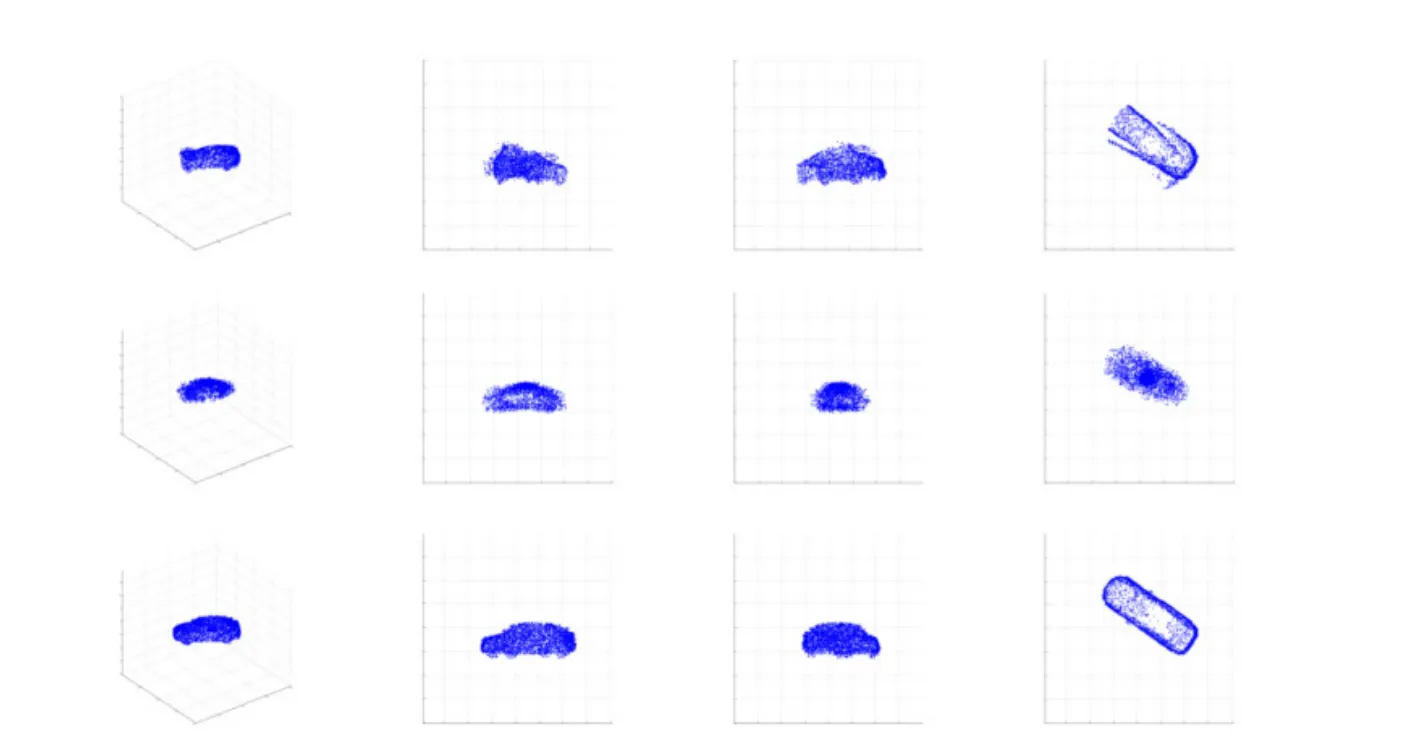

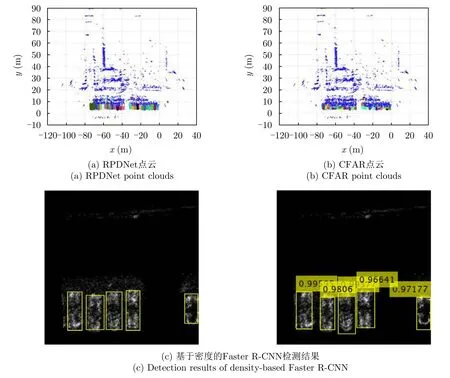

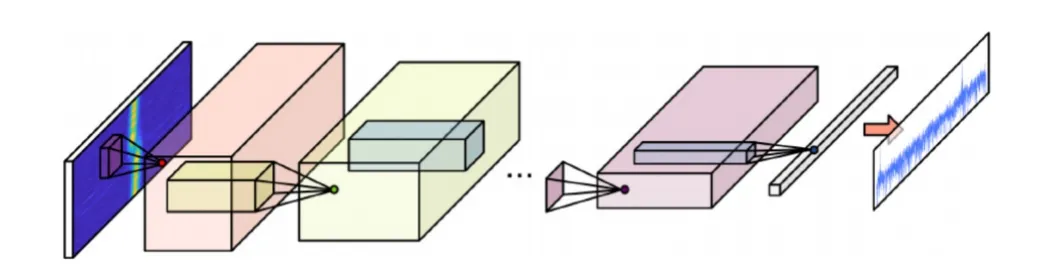

基于深度学习技术可对生成的点云图像实现目标检测和识别。Cheng等人[13,14]提出了一种基于数据驱动的轻量级神经网络RPDNet (Radar Points Detector Network),该网络将目标检测视为3D点云的语义分割任务,并通过基于激光雷达数据自动生成标签的方法来训练雷达检测器,生成点云如图7所示。Jiang等人[15]提出了一种仅使用单帧数据进行超分辨DOA估计的复值深度卷积网络(Complex Valued-Deep Convolutional Network,CV-DCN)。文献[16]提出了一种两步式雷达目标检测模型,利用Range-Doppler Network (RDNet)的卷积神经网络(Convolutional Neural Network,CNN)在距离多普勒域上进行目标区域检测,然后输入第2层网络Angle Estimation Network (AngNet)获取目标的方位、俯仰角估计。文献[17]提出了一种基于多帧4D毫米波雷达点云的三维目标检测框架,首先估计车辆的自身速度信息进行补偿,并通过雷达帧间匹配将多帧点云匹配到最后一帧,利用多帧点云检测网络对目标进行检测,得到了高分辨率的目标点云图像。在文献[18,19]中,作者提出了一种基于3D重构成像的神经网络架构3D Reconstruction and Imaging via mmWave Radar (3DRIMR),该网络从多个视角采集毫米波雷达原始数据作为输入,并以点云形式输出物体的3D形状,该方法有效结合了CNN的优点、提升了点云表示3D形状效率,如图8所示。

图7 RPDNet[13,14]生成的点云图像与CFAR,Lidar对比Fig.7 Comparison of point cloud image generated by RPDNet[13,14] with CFAR and Lidar

图8 3DRIMR [18,19]以点云形式重建汽车的三维形状Fig.8 3DRIMR[18,19] used to reconstruct the three-dimensional shape of the car in point cloud form

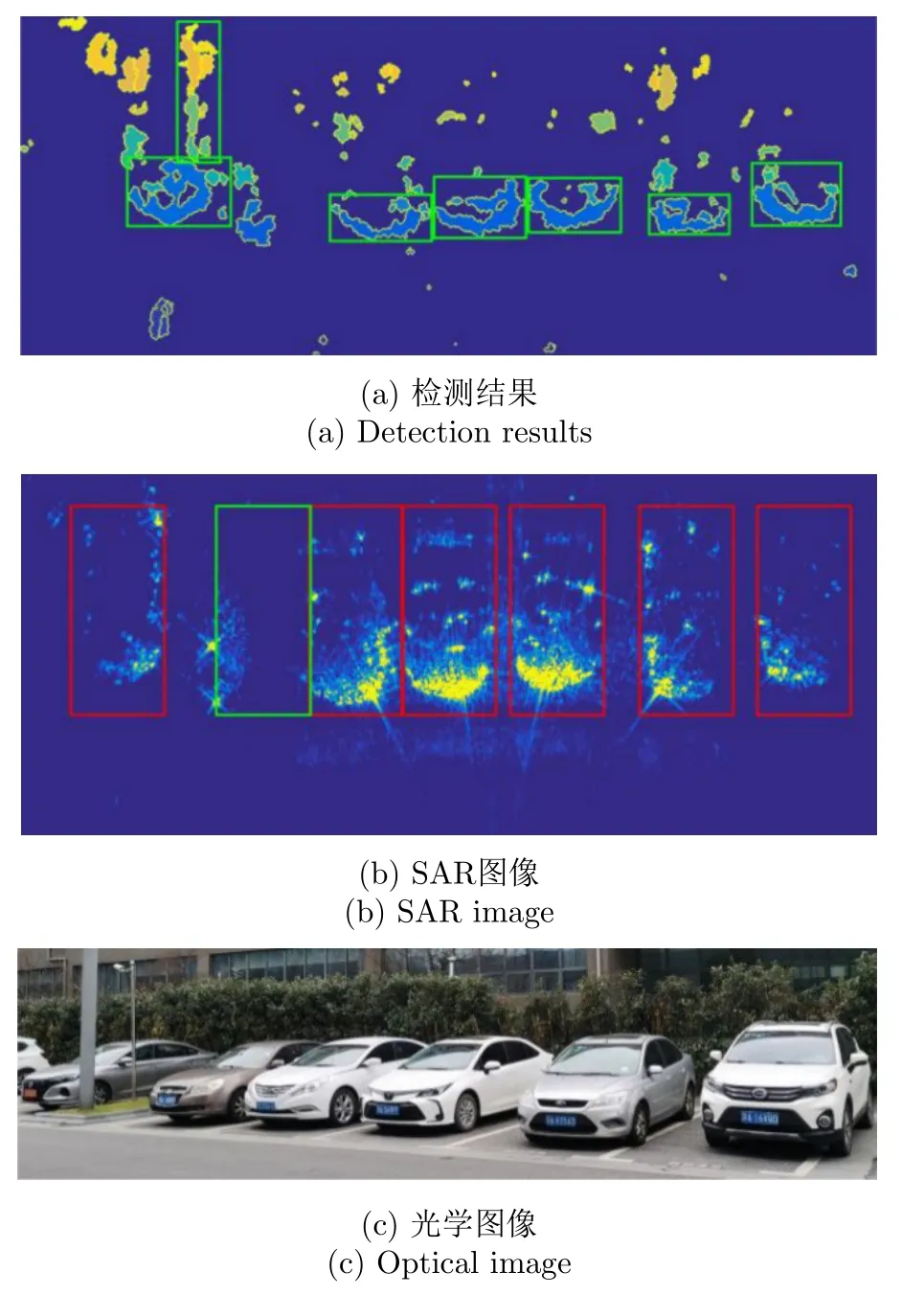

Huang等人[20]提出了一种基于机器学习方法的带噪声DBSCAN聚类算法以及基于深度卷积神经网络(Deep Convolutional Neural Network,DCNN)的实时目标检测区域提议网络(Faster R-CNN),得到检测结果如图9所示。文献[21]比较了两种基于雷达点云进行目标检测的方法。一种是基于网格的方法,将雷达点云转化为Bird’s Eye View (BEV)网格,使用3个通道表示目标信息和Radar Cross Section (RCS)信息,再通过YOLOv3网络进行目标检测。另一种是基于点云的方法,将点云数据分割为补丁,补丁内数据作为网络输入,再通过4个网络进行目标检测。结果表明,基于网格的方法的平均准确率(mean Average Precision,mAP)较低,但速度较快。针对三维物体检测方法不能通过关注稀疏点云中的局部特征来判断物体的航向的问题,Xu等人[22]提出一种仅使用4D毫米波雷达的三维目标检测网络RPFA-Net(Radar Pillar Feature Attention Network),该方法利用自注意机制而不是PointNet来提取点云的全局特征。这些包含远距离信息的全局特征可以有效地提高网络对目标航向角的回归能力,提高检测精度。图10显示了RPFA-Net[22]和PointPillars[23]在AstyxHiRes数据集中的测试结果,由于该网络相较于PointPillars估计方位角更准确,因此检测结果与地面真实情况的吻合度更高。

图9 文献[20]所提出方法检测结果Fig.9 Detection results of the method proposed in Ref.[20]

图10 RPFA-Net[22]和PointPillars[23]在AstyxHiRes数据集中的检测结果Fig.10 Test results of RPFA-Net[22] and PointPillars[23] in AstyxHiRes dataset

深度学习在毫米波雷达信号处理中应用越来越广泛,且已在实际应用中取得了很好的效果。深度学习能够通过学习复杂的信号特征来提取有效的信息,并在噪声和干扰环境下表现出很好的性能,以此提高毫米波雷达系统的鲁棒性和可靠性,在复杂环境下的目标检测、分类和跟踪中有很好的应用前景。但它也存在一定的局限性,深度学习模型的内部机制很难解释和理解,且通常需要大量的标注数据来进行训练,因此大规模、高质量的毫米波雷达数据集对于深度学习在毫米波雷达领域的应用至关重要。基于深度学习方法实现点云处理相关论文汇总如表2所示。

2.2.3 毫米波雷达数据集

在深度学习点云处理中,大样本数据的获取与标注是一个关键问题。在早期研究中,研究人员通常自己采集和标注数据,这既费时费力,也不便于算法的对比。近年来随着相关研究的深入,很多毫米波雷达数据集被逐渐公开,可简单根据数据种类的不同分为单模态数据集和多模态数据集。其中,单模态数据集仅包含雷达数据,一般来说,由于毫米波雷达解析电磁波进行参数估计,单纯毫米波雷达数据是难以进行标注的;多模态数据集除了毫米波雷达数据外,还包含同步的图像或激光雷达等其他汽车传感器数据,为毫米波雷达数据提供真值参考,实现准确的定位和标注。随着对雷达信号数据的利用越发深入,相关数据作深度学习等输入的应用逐渐增多,可服务于汽车雷达目标检测等功能。

雷达数据集的质量和规模与基于深度学习的汽车雷达性能存在紧密联系,目前开源的毫米波雷达数据集一般为带有标注的多模态数据集,主要有Astyx HiRes,CARRADA,NuScenes,SCORP,CRUW,SeeingThroughFog,VOD,ColoRadar,K-Radar,RADIal,TJ4DRadSet,Oxford Radar RobotCar Dataset等。其中,NuScenes,CRUW和Oxford Radar RobotCar Dataset这3个数据集仅含有2D雷达点信息或雷达的射频图像。

Astyx HiRes 2019[24]是首个包含4D成像毫米波雷达的公开数据集,由500个同步帧(雷达、激光雷达、相机)组成。其中包含约3000个精确注释的3D对象注释。该数据集基于自动标注的结果,并通过人工微调进行补充。Astyx数据集的规模相对较小,存在框架数目不足的问题,并且大部分数据都是关于汽车的,导致在类别上存在不平衡的情况。与此相比,文献[25]提出的CARRADA数据集提供了3种不同的注释格式,包括稀疏点、边界框和密集掩码,标注类别包括汽车、自行车以及行人。CARRADA数据集中包含了具有时间同步的摄像头和低级雷达的R-A和R-D数据,但是CARRADA的采集场景并不是真实的交通路况,因此其实用性会受到一定影响。

NuScenes[26]被认为是首个开源的多模态数据集,它开创性地提供了雷达信息、3D对象注释以及夜间和下雨天气条件下的数据,同时还包括对象属性注释。NuScenes数据集提供了6个摄像头14万帧的图像数据、1个激光雷达39万帧的点云数据以及5个毫米波雷达130万帧的点云数据。相较于之前发布的数据集,NuScenes的对象注释质量更高。然而,NuScenes数据集只提供经过预处理的无注释稀疏二维雷达点云,每帧中的点云数量较少。

SCORP数据集是首个包含了ADC数据的公开雷达数据集,其提供了3种不同的雷达数据表示形式,即Sample-Chirp-Antenna数据块(SCA数据块)、Range-Azimuth-Doppler数据块(RAD数据块)以及稀疏点云形式。但其规模较小,仅包含11个序列和3913帧数据,且只有语义分割标注,没有目标级的标注。ColoRadar[27]数据集包含来自毫米波雷达、激光雷达和惯导等大约2小时的数据。该数据集提供了3个级别的雷达数据:原始ADC数据、距离-方位-俯仰角张量数据以及雷达点云,涵盖室内与室外的多种场景。

2020年,华盛顿大学的Wang等人[28]开发了CRUW数据集,加入多种自动驾驶环境下同步的图像和雷达数据帧。CRUW数据集中包含目标级别的标注(物体框和分割mask),其数据格式为Range-Azimuth-Chirp数据块。

SeeingThroughFog[29]数据集采用相机、毫米波雷达、激光雷达、热传感等多种传感器,总共采集了超过10万个物体的数据,并且这些数据是在包括雾天、雪天和雨天等极端天气的环境下采集,其目的是评估可用于极端天气环境下多模态数据融合方法的性能。

VOD[30]数据集使用了4D毫米波成像雷达,除了提供距离、方位和多普勒速度外,还提供了高度信息。VOD数据集是在复杂的城市交通场景下采集的,包含8693帧时间同步和标定好的64线激光雷达、双目相机和4D雷达数据。包括123106个运动和静态对象的 3D 边界框,其中包括26587个行人、10800个骑自行车的人和 26949 辆汽车。

K-Radar[31]数据集是目前基于4D毫米波雷达的最大规模数据集之一。它收集了35000帧在晴天、雾天、雨天、雪地等不同天气条件下的数据。除了4D雷达数据外,K-Radar还提供高分辨率激光雷达点云、来自4个立体相机的环绕RGB图像以及来自车身的RTK-GPS和IMU数据。RadarScenes[32]是包含多场景的大规模数据集,由手动标记各类目标与环境组成,其包含了158个具有时间戳的序列,点云上7500个标注数据被分成了11个类别。TJ4DRadSet[33]数据集包含40 K的同步数据,其中7757帧,44个序列具有高质量注释的3D边界框和跟踪id。该数据集基于联合多传感器标注、多轮手动检查标注的三维标注系统进行标注。

总体来说,毫米波雷达大样本数据的获取与标注是汽车毫米波雷达信号处理流程的重要一环。数据集包括各类天气条件、道路环境、驾驶条件等,并标注目标对象的边界框、目标类别、掩码等。传感器采集、标注的数据除毫米波点云,往往还包括图像或激光点云,如何将各传感器的数据有效融合从而支撑信号处理流程是后续处理的关键。

2.3 多传感器融合成像处理方法

汽车驾驶实际场景往往很复杂,只使用汽车毫米波雷达进行感知往往会漏检和误检,导致目标检测性能下降。因此,多传感器融合处理是解决这一问题的有效途径,将毫米波雷达生成的3D点云图像与视觉传感器生成的RGB图像、激光点云数据进行融合实现三维目标检测已成为当下的一个研究热点。

根据融合的信息类型和融合方法,可以将多传感器融合分为以下几类:

(1) 数据级融合:将来自不同传感器的原始数据进行整合,形成融合后的数据。

(2) 特征级融合:将来自不同传感器的特征进行整合,形成融合后的特征,如将雷达和光学的数据特征进行融合,提高目标检测和跟踪的精度。

(3) 决策级融合:将来自不同传感器的决策信息进行整合,形成融合后的决策,如将多个传感器的目标检测结果进行融合,提高目标的识别准确率和鲁棒性。

2.3.1 数据级融合

数据级融合也称为低级别融合或早期融合,将多传感器的原始数据或预处理数据在信号处理前进行融合。数据级融合通常包括3个步骤:首先,数据级融合基于雷达点云生成感兴趣区域(Region of Interest,ROI);然后,根据ROI提取视觉图像的相应区域;最后,利用特征提取器和分类器对这些区域进行对象检测。在全部融合方法中,数据级融合方案是计算成本最高的方法,因为它需要对大量原始数据进行直接处理。

Meyer等人[34]提出了一种基于雷达和视觉信息数据级融合的三维目标检测系统,该系统利用雷达点云和RGB图像生成ROI,并采用Fast R-CNN检测器获取ROI内目标的边界框和分类得分,实现三维目标检测效果如图11所示。Nabati等人[35]提出了RRPN网络,通过将雷达点云映射到图像坐标系生成预定义锚盒,确定目标检测的候选区域,相比于Fast R-CNN中生成ROI的选择性搜索算法,RRPN算法的效率和准确性更高,其在NuScenes数据集[26]中的检测结果如图12所示。文献[36]中Jha等人提出了一种将雷达和视觉数据级联融合用于车辆导航的方法,通过将雷达信息映射到图像坐标系,基于YOLOv3架构设计融合系统。Nobis等人[37]提出了CRF-Net体系结构,融合相机数据和雷达稀疏点云投影后的数据,然后使用Visual Geometry Group(VGG)网络从组合数据中提取特征来增强目标检测效果。

图11 文献[34]中基于AstyxHiRes数据集的三维目标检测结果Fig.11 3D target detection results based on AstyxHiRes dataset in Ref.[34]

使用数据级融合方法时,输入是传感器原始数据,可利用完整的数据信息。但是这种方法往往对数据内的时间或空间错位敏感,因此需要对融合的传感器进行精确的外部校准。此外,雷达和图像数据的表示方式不同,导致很难将雷达点云数据与图像像素进行匹配。因此,在进行数据级融合时需要采用合适的方法将不同数据形式进行转换和配准,以便有效融合。基于数据级融合方法实现成像处理相关论文汇总如表3所示。

2.3.2 特征级融合

特征级融合也称为中层融合,基于深度学习的目标检测模型可以同时提取雷达和图像数据在深度网络的中间特征进行融合。Cui等人[38]提出了一种基于交叉融合策略的卷积神经网络,该网络利用每帧雷达点云生成前视(Front View,FV)图像和鸟瞰图像,使用3D区域建议网络生成候选区域,并采用交叉融合方案将特征图信息与候选区域融合。

Nabati等人[39]提出了CenterFusion,利用雷达和视觉传感器信息进行鲁棒的三维目标检测。Center-Fusion使用基于椎体的方法(Frustum-based Methods)将雷达生成的点云与图像上的对象精确匹配,并利用雷达的特征图来增强图像特征,其在NuScenes数据集上的检测结果如图13所示。John等人[40]提出了SO-Net网络,SO-Net是一个包含两个特征提取分支和两个输出分支的感知网络。这两个特征提取分支分别针对基于相机的图像和基于雷达的特征,输出分支分别对应车辆检测和自由空间语义分割分支。文献[41]提出了一种基于毫米波雷达和视觉传感器的障碍物空间注意融合(Spatial Attention Fusion,SAF)方法,该方法考虑了雷达点云的稀疏性,对雷达和图像进行特征级融合。此外,所提出的SAF方法可以通过端到端方式与最新的深度学习目标检测框架相结合进行训练。

图13 不同场景下CenterFusion[39]在NuScenes数据集上的三维检测结果Fig.13 Three-dimensional detection in different scenarios results of CenterFusion[39] on the NuScenes dataset

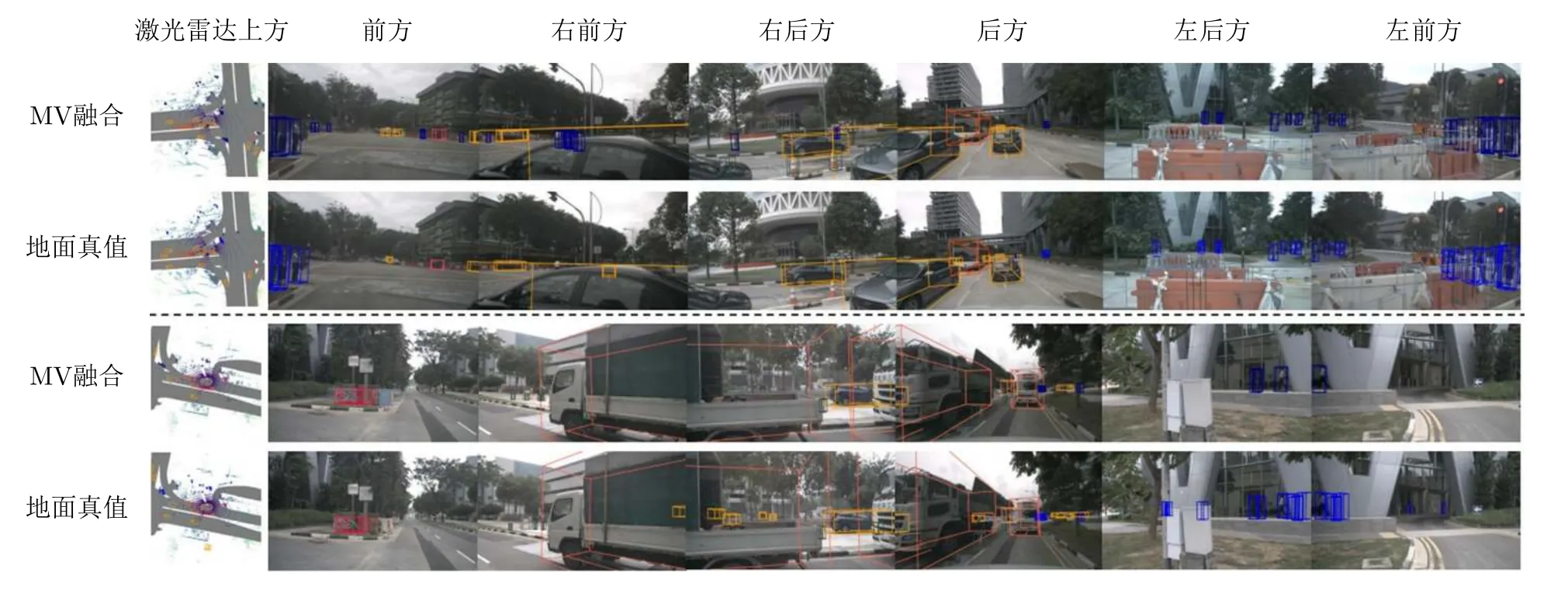

Bansal等人[42]提出了一种多模态融合目标检测方法RadSegNet,该网络是通过利用SPG (Semantic-Point-Grid)模块生成的编码进行对象检测。为了将语义与雷达点相关联,SPG为每个雷达点查找相机像素对应关系,实现了所需的独立信息提取,即使在相机输入不可靠的情况下,RadSegNet仍然可以使用雷达数据可靠地工作。文献[43]提出了基于DPT(Dense Prediction Transformer)的雷达-相机融合深度估计模型RCDPT,该模型使用变换器作为骨干网络,将从图像和雷达中提取的特征在所提出的重组层中有效地合并。文献[44]提出了一种新的多视图雷达-摄像机融合方法MVFusion,用于实现语义对齐的雷达特征并增强模态之间的交互信息。该方法通过使用SARE (Semantic Aligned Radar Encoder)将语义对齐注入雷达特征中,以产生图像引导的雷达特征。接着,该方法使用RGFT (Radar Guided Fusion Transformer) 加强雷达和图像特征之间的全局相关性。该方法在NuScenes数据集上进行了评估,其检测结果如图14所示。

图14 MVFusion[44]在NuScenes数据集上的三维检测结果Fig.14 3D detection results of MVFusion[44] on the NuScenes dataset

对于特征级融合,可以根据每个模态的具体特征为其设计适当的特征提取器,神经网络还可以跨模态联合学习特征,使它们相互补充。但是在进行特征级融合时要对不同传感器特征进行配准和对齐,这需要比较复杂的算法和计算。此外,特征级融合可能会导致信息冗余,需要进行特征选择和降维,以避免计算和存储的浪费。基于特征级融合方法实现成像处理相关论文汇总如表4所示。

表4 基于特征级融合方法实现成像处理相关论文汇总Tab.4 Summary of image processing papers based on feature-level fusion method

2.3.3 决策级融合

决策级融合也称为目标级融合或后期融合,是目前主流的融合方案,其主要融合从雷达和相机传感器获取的独立目标,以获得最终的综合结果。在决策级融合中,如何匹配来自两种不同模态的结果是值得考虑的,其中一种方法是计算目标相似性,然后使用卡尔曼滤波器、贝叶斯理论、匈牙利算法等方法来匹配输出;另一种方法涉及利用雷达和相机之间的变换矩阵来确定两种模态之间的位置关系。

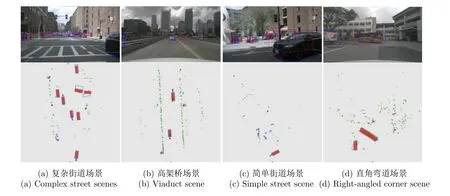

文献[45]提出一种使用单目相机和毫米波雷达传感器融合的鲁棒跟踪框架,该框架通过匈牙利算法将来自不同传感器的数据进行关联,并使用基于三卡尔曼滤波器(tri-Kalman Filter)框架作为跟踪方法。文献[46]提出了一种目标级三维跟踪方法,并设计了能够根据物体不同的空间分布和传感器特性,充分利用运动、外观和几何特征的自适应数据关联方法,图15展示了测试验证结果,结果证明该融合算法具有足够的准确性、快速性和鲁棒性,能够满足自动驾驶对动态物体的感知需求。在文献[47]提出的方法中,首先使用雷达和相机分别进行目标检测,得到两个独立的检测结果。然后,在图像平面中将这些检测结果进行关联,生成一个具有对象类型的随机有限集,通过改进的GM-PHD滤波器和信息融合,提出了一种鲁棒的DATMO算法,解决了物体遮挡、测量丢失等跟踪问题。

图15 文献[46]中测试的3个场景及3D跟踪结果Fig.15 Three scenes tested in Ref.[46] and 3D tracking results

Jha等人[36]使用变换矩阵将雷达探测投影到图像平面上,然后对准来自两个传感器的独立检测目标。在文献[48]设计的方法中,首先对视觉传感器和雷达传感器进行联合校准,获得雷达到相机的转换矩阵。接着使用基于密度的聚类方案将收集的雷达回波按不同目标进行分离,并使用变换矩阵将聚类质心投影到相机图像上。此外,在完成雷达点云与相机图像的关联后,Dong等人[49]提出了AssociationNet来学习来自两个传感器的语义表示信息。该网络通过计算和最小化来自雷达点云和图像边界框对的表示之间的欧氏距离,提高了关联的准确性。

决策级融合常用于雷达与相机传感器的融合,但是其在很大程度上依赖于单个模块输出的准确性。例如,在相机传感器被遮挡的情况下,决策级融合完全取决于雷达传感器检测到的最终目标。此外,由于传感模态的弱点或传感器中的错误,丰富的中间特征被丢弃,因此,目标级融合方法只能利用从检测结果中获得的有限信息。基于决策级融合方法实现成像处理相关论文汇总如表5所示。

表5 基于决策级融合方法实现成像处理相关论文汇总Tab.5 Summary of image processing papers based on decision level-fusion method

综上所述,使用传统信号处理方法实现汽车毫米波雷达点云成像的优点在于稳定性和可靠性,且可利用雷达系统硬件特性提高成像效果。但该方法需要较高计算资源和时间,对于复杂场景和目标的识别和分类能力有限,对噪声和干扰的抑制能力也有限,且难以处理非线性和非高斯分布的点云数据,限制了其应用范围和效果。深度学习方法实现汽车毫米波雷达成像处理的优势在于能够处理大量数据,并从中挖掘出目标物体的特征信息。深度学习方法可以自适应地学习目标物体的特征,并能够根据实际场景进行实时调整和优化,此外还可以实现基于历史数据的预测和决策,提高系统的整体性能。多传感器融合方法可以综合不同传感器的信息,提高系统的鲁棒性和准确性。多传感器融合方法需要对不同传感器的数据进行有效的协同处理,同时需要对数据的融合算法进行充分验证和优化,这对系统的设计和开发带来了一定的复杂性。

3 汽车毫米波雷达合成孔径成像技术

除了点云成像处理,近十年学术界逐渐兴起了通过汽车毫米波雷达进行合成孔径成像的热潮。传统合成孔径雷达(Synthetic Aperture Radar,SAR)成像系统通常依托于卫星、飞机、导弹等空天运动平台,通过运动形成的等效合成孔径以获取对地/海区域的高分辨成像。对于车载场景的SAR系统,由于成像目标区域距离较近且幅宽较小,因此对分辨率的要求相比传统场景更高。对比低频段,毫米波频段具有丰富的频带资源、较小的波长以及较小的天线实孔径,故而能够提供更高的距离-方位二维理论分辨率。

车载场景SAR成像属于近场模式,适用于传统SAR远场成像模式的近似条件不再成立。由于场景中心距离较短,且汽车毫米波雷达通常波束宽度较大、波长较短,场景内单个散射点的回波历程在距离向和方位向都分布较广,导致出现严重的距离徙动现象,且不同距离单元目标的距离徙动差异明显,最终影响SAR成像算法的设计。同时,汽车运动过程中易颠簸、抖动,对于波长较短的毫米波雷达而言,所造成的运动误差往往不可忽略。此外,汽车毫米波雷达通常采用MIMO体制,其拓展性质也为更加复杂与灵活的SAR系统设计提供了可能性。

3.1 汽车毫米波SAR基础成像算法

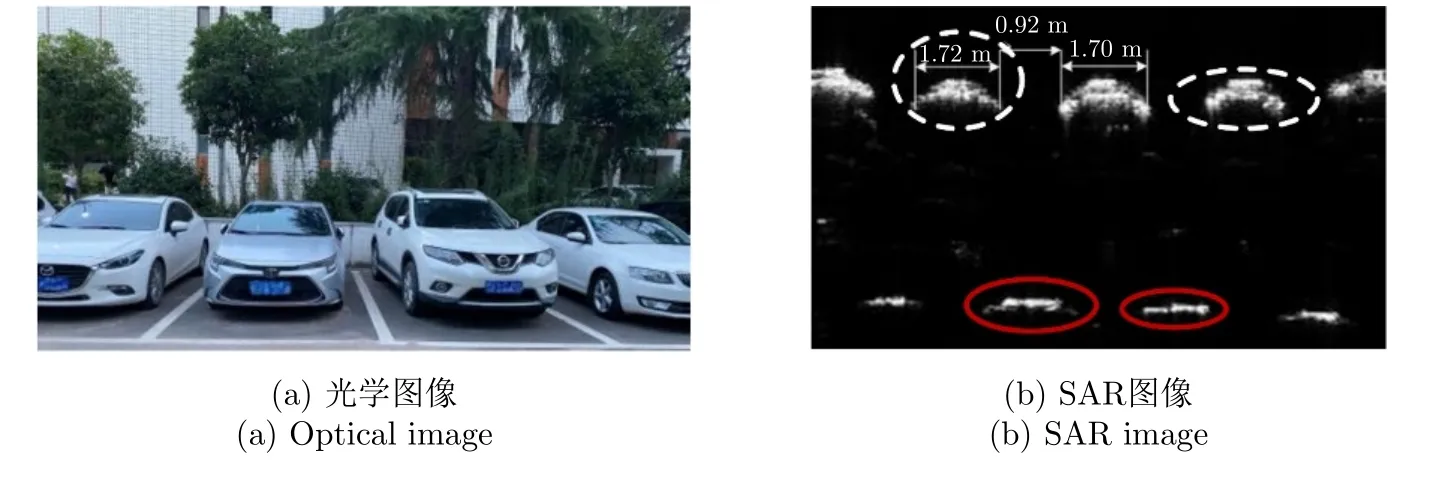

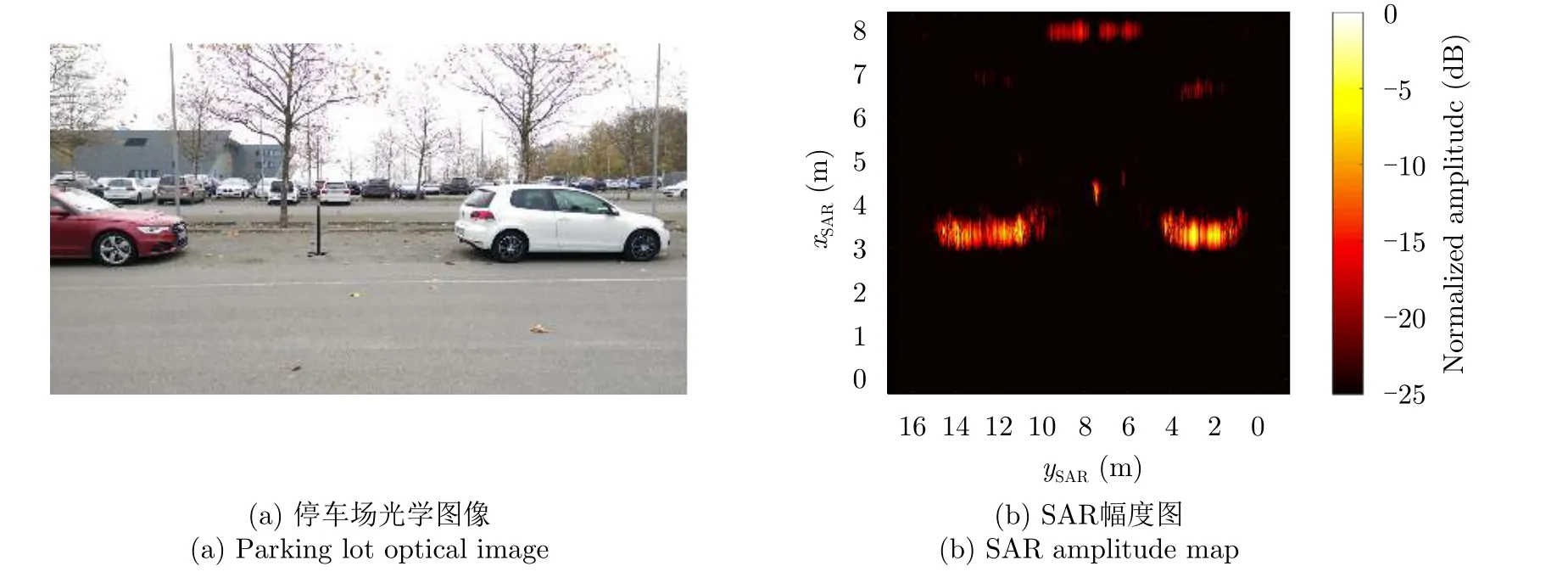

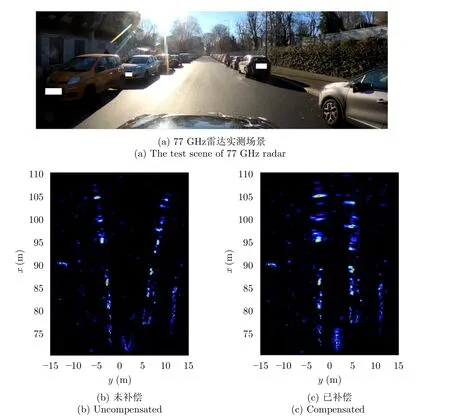

要实现车载毫米波SAR成像,需要将传统SAR基础成像算法修改以适用于新场景,其中距离多普勒等频域算法可实现条带模式成像。文献[50,51]使用距离多普勒算法(Range Doppler Algorithm,RDA)对中近场(0~100 m)毫米波SAR成像进行了充分的评估,验证了77 GHz波段下中近场各距离范围内一些常见目标的成像效果,场景光学图像与成像结果如图16所示。

图16 RDA近场场景SAR成像验证[50,51]Fig.16 The verification of RDA near-field scene SAR imaging[50,51]

上述距离多普勒算法对汽车毫米波SAR成像进行一些初步的演示与验证,但其实验条件较为苛刻,其假设车辆保持匀速直线运动,并进行正侧视成像。近年来,Jiang等人[52]阐述了一种汽车SAR系统模型,并利用改进后的RDA进行车载场景成像,结果如图17所示。二维频域算法作为一种可行的成像算法,也被应用于汽车毫米波SAR成像,Xu等人[53]通过对信号进行二维去斜和运动补偿处理,实现停车场车位检测和识别,结果如图18所示。在汽车毫米波SAR成像中,成像分辨率需至少达到厘米级,由于距离多普勒算法等频域算法的实现采用一定的近似条件,导致其在实际场景中应用受限。

图17 车载场景RDA成像[52]Fig.17 RDA imaging for automotive scenes[52]

图18 停车场车位检测和识别[53]Fig.18 Parking space detection and recognition[53]

3.1.1 距离徙动算法

相比于RDA等频域算法,很多学者在车载平台更倾向于使用距离徙动算法(Range Migration Algorithm,RMA),因为它是一种依靠波数域插值的精确算法,并未与传统频域算法一样做出大量近似,更加适合车载场景。

2005年,Wu等人[54]率先将距离徙动算法应用于24 GHz FMCW雷达,实现了室内停车场场景的正侧视条带模式SAR成像,并建议将汽车毫米波FMCW雷达系统用于辅助泊车。2006年,Gumbmann等人[55]将距离徙动算法应用于毫米波雷达系统,并检验了近距离(小于1 m)小物体(厘米级)的成像与区分能力,实测证明了距离徙动算法对近距离SAR成像的精确性,实物光学图像与成像结果如图19所示。Sriharsha等人[56]通过比较SISO体制与MIMO体制下距离徙动算法的成像结果,验证了在高速行驶状态下汽车毫米波MIMO-SAR成像的可行性,具体成像结果如图20所示。

图19 不同倾斜程度铝楔块的94 GHz毫米波SAR成像结果[55]Fig.19 94 GHz millimeter-wave SAR imaging results of polyethylene cylinders with different tilting degrees[55]

图20 停车场SISO-RMA SAR图像[56]Fig.20 Parking lots SISO-RMA SAR image[56]

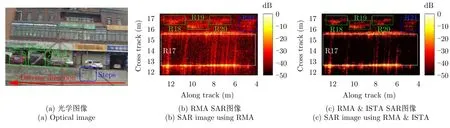

针对汽车毫米波SAR成像的场景特性,可以对距离徙动算法进行加速与优化。Zhang等人[57]基于RMA,利用迭代软阈值算法(Iterative Soft Thresholding Algorithm,ISTA)实现SAR稀疏成像,结果如图21所示。Lee等人[58]将RMA与压缩感知(Compressed Sensing,CS)技术结合,仅提取部分原始数据即可实现与原先成像结果大致相同的效果。Iqbal等人[59]通过子孔径数据划分的方法实现了对RMA的加速,场景光学图像、后向投影算法和所提出的子孔径成像算法结果对比如图22所示。

图21 RMA与CS结合后的SAR图像[57]Fig.21 SAR images using RMA &CS[57]

3.1.2 后向投影算法

为了应对复杂的车辆运动情况,成像算法选取需要进一步考虑。通常SAR成像算法要求雷达平台运动轨迹是规则的,即运动轨迹须是已知且固定的多项式曲线,如直线、圆周、抛物线等,由此方便对斜距进行多项式展开,并进行频域分析和匹配滤波。而汽车SAR平台的运动轨迹通常是不规则、非多项式的,很难通过频域分析,此问题可通过时域的非参数化方法完成,如后向投影算法(Back Projection Algorithm,BPA)。该算法的优势在于,只要能精确得到雷达平台的运动轨迹,就可以进行成像。同时其和距离徙动算法一样,都是未经近似处理的精确算法,也适合于车载近场场景。此外,后向投影算法原理简单、可扩展性强,可以较为方便地应用于多种信号体制的成像系统,同时也便于从二维成像扩展为三维成像。然而,该算法需要进行网格的预设,并对网格点逐一进行相干积累以获得高分辨图像,相比于频域和波数域算法,运算量较大,实际处理中可在网格逐点相干积累时采用并行处理,例如快速分解后向投影算法[60](Fast Factorized Back Projection,FFBP)等,再结合FPGA,GPU并行处理等硬件加速手段,可以进一步提高成像效率。综合各种因素,后向投影算法在车载毫米波SAR成像中有广泛的应用前景。

针对汽车运算平台,可以通过一些数据预处理手段和特殊处理流程来提高成像运算效率。Gisder等人[61]提出了基于GPU平台的BP算法流式处理方案,该方案实现了回波数据的预处理和高效的GPU资源分配,场景光学图像与成像结果如图23所示。Farhadi等人[62]利用Digital Spotlighting (DS)方法提取原始数据,在避免剔除有效数据的前提下大大降低了原始数据的距离向和方位向维数,实现了FFBP算法的进一步优化。

图23 BP算法流式处理方案试验场景[61]Fig.23 The test scene of BP algorithm flow processing scheme[61]

近年来,考虑更为复杂的车载场景应用,BP算法在汽车毫米波SAR成像中发挥了重要作用。Farhadi等人[63]提出一种基于子孔径的BP算法,实现车载场景的动目标成像(Moving Target Imaging,MTI),结果如图24所示;针对车载场景的多径干扰问题,Manzoni等人[64]通过理论分析,并利用BP算法验证了MIMO-SAR成像抑制多径干扰的可行性,对比结果如图25所示。

图24 基于BP算法的动目标成像[63]Fig.24 Moving Target Imaging (MTI) base on BP algorithm[63]

图25 多径干扰抑制对比图[64]Fig.25 Multipath interference suppression comparison chart[64]

目前对于车载毫米波SAR成像基础算法的研究已经相当成熟,未来的研究更需要注重算法对于车载硬件的适应性,如成像算法的简化、加速以及实时性等。此外,除了前文所述基本成像算法,也可以继续引入新的适应车载平台的基础成像算法。表6总结了车载毫米波SAR发展过程中的基础成像算法分类。

表6 车载毫米波SAR基础成像算法总结Tab.6 Summary of imaging algorithms for automotive millimeter wave SAR

3.2 汽车毫米波SAR成像新应用

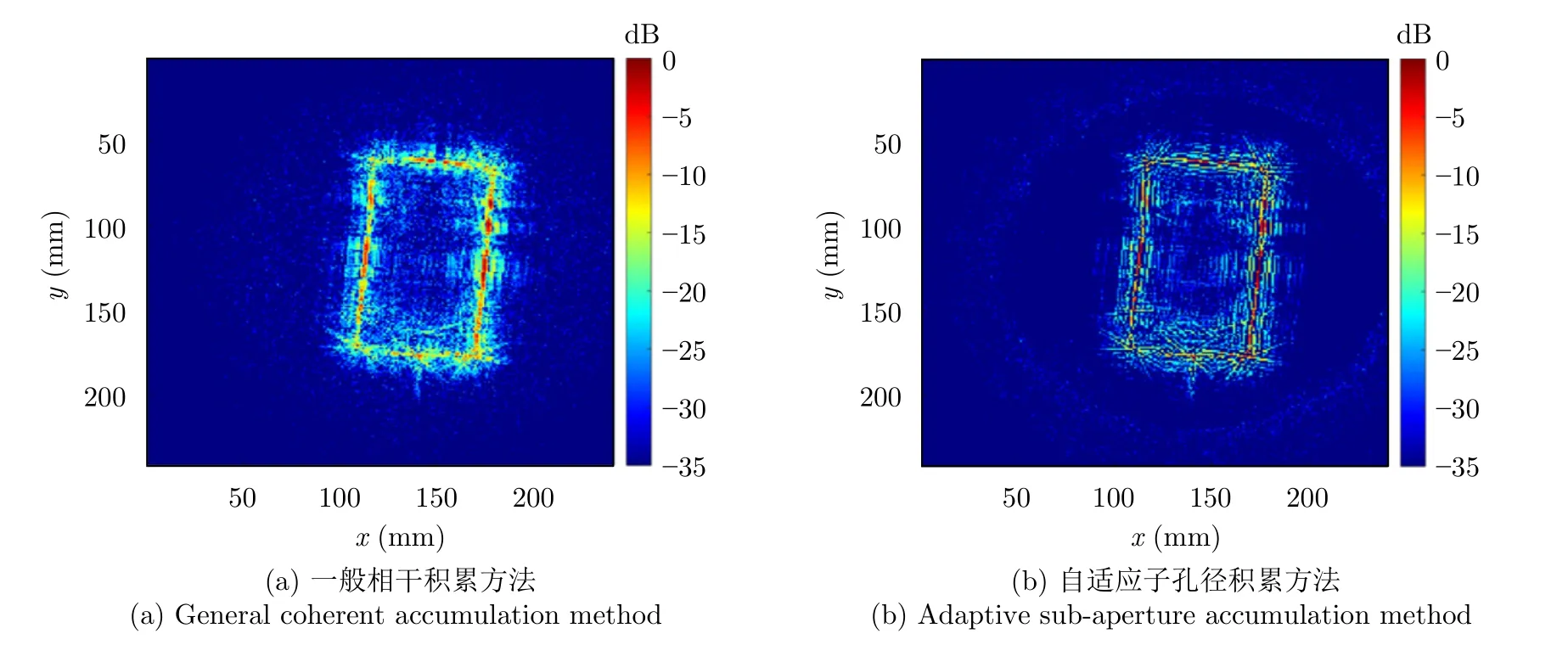

3.2.1 毫米波宽波束子孔径处理

区别于传统SAR成像平台,汽车毫米波雷达的天线波束宽度通常较大,SAR成像子孔径长度相对于整个场景画幅来说占比较大,这使得各种基于子孔径处理的算法优化方案逐渐流行;同时,这种宽波束特性引发不同于传统窄波束SAR成像的特殊性质:同一点目标在合成孔径时间内是从较大视角范围接收并反射电磁波能量的,即某一个物体的宽波束SAR成像结果是该物体在大角度范围散射的叠加,这使得车载毫米波SAR成像有了全新研究方向。Rizzi等人[65]通过选取不同波束角度范围内的数据,对不同波束角下的成像效果进行了对比,如图26所示。Wright等人[66]则提出了一种基于目标RCS检测的自适应子孔径优化方法,提高了宽波束下的图像相干积累增益,优化前后对比效果如图27所示。此外,在宽波束的条件下,Tagliaferri等人[67]将多个不同位置车辆的子孔径SAR图像进行相干处理,在调频信号带宽受限的条件下提高了距离向分辨率性,多车协作成像与单车成像结果对比如图28所示。

图26 不同波束角度下车载SAR的成像结果[65]Fig.26 Imaging results of automotive SAR at different beam angles[65]

图27 自适应子孔径积累图像增强[66]Fig.27 Image enhancement by adaptive sub-aperture accumulation[66]

图28 多车协作下提高距离向分辨率的效果比较[67]Fig.28 Comparison of improving range-direction resolution in multi-vehicle collaboration[67]

总体来看,汽车毫米波SAR成像中,毫米波雷达宽波束的特性对基础成像算法的影响存在差异。BP算法的成像质量仅与雷达轨迹的准确性有关,雷达轨迹误差越小,BP算法的成像质量越好,因此,BP算法能够较好地适用于雷达宽波束的情况,这是它被广泛应用于车载SAR成像的主要原因;RMA则在相位补偿时没有做任何近似,但雷达宽波束的特性使得波数域的支撑域展宽,支撑域过宽将导致Stolt插值处理的误差过大,无法忽略,因此,传统RMA适用于雷达波束较小的情况,雷达波束过大时,RMA需要考虑宽波束带来的插值误差,提高Stolt的插值精度;而对于RDA等频域算法来说,雷达宽波束特性导致近似条件不再成立,且车载SAR成像的分辨率较高,使其无法忽略方位空变误差,导致传统频域算法无法直接应用于复杂的车载场景。但是,相较于BPA和RMA,RDA等频域算法的计算复杂度较低,且车载SAR成像对实时性要求非常高,因此,在雷达宽波束的条件下推导各类频域成像算法,使其适应于车载雷达宽波束的情况,具有很高的研究价值。

3.2.2 汽车毫米波SAR成像运动补偿

实际处理中,各类SAR精细化高分辨成像方法均要求对平台运动轨迹有一定的先验信息。若获得的先验信息与雷达平台实际运动情况不符,则无法对回波数据相位进行精确匹配滤波或相干积累,导致最终成像有明显的剩余相位,从而影响图像聚焦效果和准确度。我们可将此问题等效理解为SAR回波数据存在由未知运动引起的相位误差,而称解决此问题的过程为运动补偿。实际场景中,车载平台的运动是复杂的,具有较大不确定性,车辆颠簸或行驶轨迹偏移会带来较大的斜距误差,而我们获取的车辆运动先验信息很容易与实际情况有较大出入,导致车载平台SAR成像极易出现严重的相位误差。

车载毫米波SAR成像的运动补偿主要有两种思路:一是通过外部设备尝试获取满足精准度要求的运动参数(轨迹、速度等),根据这些运动参数进行补偿和高分辨成像;二是直接通过雷达回波数据本身进行自聚焦处理。下面将从这两种思路具体介绍。

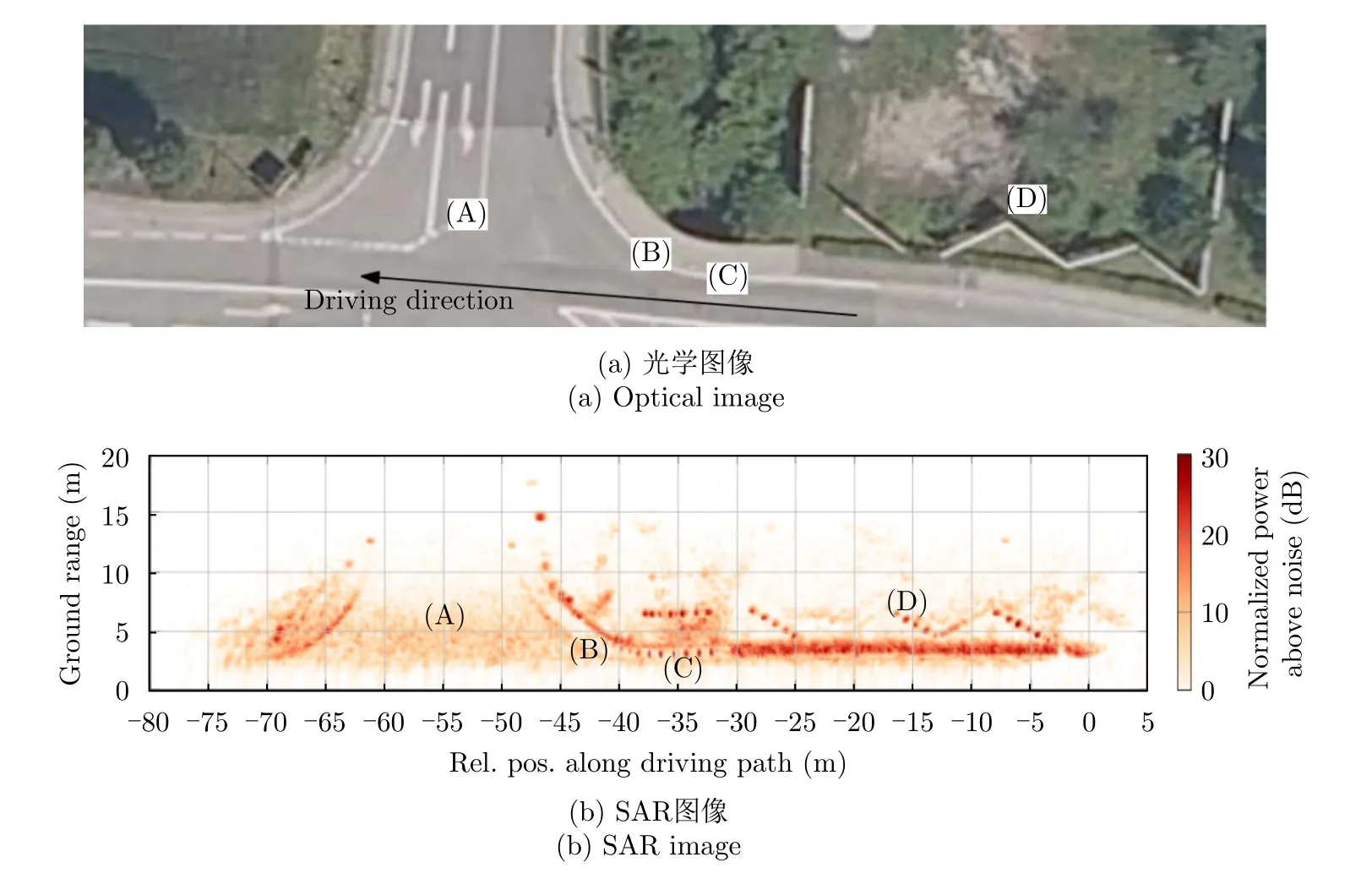

3.2.2.1 外部设备补偿

从算法实现原理来讲,后向投影算法作为时域成像算法的代表,只需要获取精准的运动轨迹,计算每个脉冲对应的真实斜距,再逐脉冲相干积累即可实现精确聚焦;而对于其他非时域算法,则需要获取更多的运动参数,如实时速度、加速度等,来进行参数化的运动补偿。惯导系统是SAR成像运动补偿最常使用的外部设备,Feger等人[68]提出了一个通过惯性测量单元(Inertial Measurement Unit,IMU)和全球导航卫星系统(Global Navigation Satellite System,GNSS)获取精准轨迹并实现距离-多普勒算法成像的77 GHz车载SAR系统,场景光学图像与SAR成像结果如图29所示。Tagliaferri等人[69]在一套低成本IMU和GNSS设备的基础上,结合后向投影算法,实现了车辆复杂轨迹下的自适应运动补偿,补偿前后的图像对比如图30所示。文献[70,71]则利用陀螺仪和加速度计对SAR回波斜距误差进行直接的建模和估计。除了以上辅助测量设备,也可通过其他雷达设备获取车辆的运动参数,文献[72,73]使用多部雷达设备进行测量,其中一部雷达用于录取SAR数据,其他雷达设备进行车辆轨迹、速度等运动参数的测定以实现运动补偿,场景光学图像与SAR成像结果如图31所示。

图29 77 GHz车载SAR系统[68]Fig.29 77 GHz automotive SAR system[68]

图30 综合运动补偿方法[69]Fig.30 Comprehensive motion compensation method[69]

图31 多雷达协同运动补偿[72,73]Fig.31 Motion compensation by multi-radar system [72,73]

3.2.2.2 自聚焦补偿

不依赖额外的测量设备、直接通过雷达回波数据本身进行自聚焦是当下运动补偿处理方法的热门。实际场景中,车辆行驶发生颠簸或其他复杂路况导致的车辆路线随机偏移,由此产生的相位误差虽然可通过测量设备来直接补偿,但依然会有剩余相位误差的残留,很难完全补偿。因而在基于参数测量的运动补偿完成后,很多学者进一步采用自聚焦方法来提高最终的运动补偿性能。

自聚焦方法在传统SAR体制下已经非常成熟,有很多高效的自聚焦方法可以运用到车载场景。自聚焦方法主要分为两类:参数化方法与非参数化方法。作为传统SAR成像中最为经典的非参数化自聚焦方法,相位梯度自聚焦(Phase Gradient Autofocus,PGA)比较灵活,不受具体成像算法的限制。经调整后PGA被率先运用于汽车SAR场景[74,75],场景光学图像以及非空变、空变处理下的成像结果如图32所示。Farhadi等人[63]还将PGA应用于汽车SAR场景的动目标成像中,如图24所示。对于参数化方法,则通常对误差模型做出假设,Manzoni等人[76]认为PGA处理后残留的相位误差来源于多普勒频率的残余,基于此提出了剩余多普勒频率提取方法,并根据文献[68]中剩余多普勒频率估计车辆的实时运动参数,以补偿剩余相位误差,补偿前后的成像结果对比如图33所示。Manzoni等人[77]进一步分析因导航引起的轨迹误差对SAR成像质量的影响,并利用文献[76]的自聚焦方法实现汽车MIMO-SAR成像,成像结果如图34所示。Xu等人[53]将稀疏贝叶斯学习(Sparse Bayesian Learning,SBL)应用于雷达参数估计中,结合基于流域的SAR图像分割方法实现停车场目标识别和检测。需要注意的是,上述自聚焦运动补偿方法需要对回波数据进行预先成像,对未聚焦的SAR图像进行后处理以提取剩余相位信息;这会造成相当大的额外计算资源开销,且依赖于实际回波数据的统计特性,可能存在算法稳健性方面的问题。

图32 PGA运动补偿[74,75]Fig.32 PGA motion compensation[74,75]

图33 剩余多普勒方法[76]Fig.33 Residual Doppler method[76]

图34 MIMO-SAR运动补偿[77]Fig.34 MIMO-SAR motion compensation[77]

总体来说,车载毫米波SAR系统处理中运动补偿是必不可少的,现有的运动补偿方法已经可以较好地校准一般车况下的SAR成像结果,且方法较为灵活。传统机载SAR成像常使用惯导粗补偿与自聚焦细补偿相结合的方案来获取高精度图像,同样地,车载毫米波SAR也可以借鉴类似的复合运动补偿系统结构,根据车载硬件平台条件、实际任务精度要求等因素来设计一套完整的运动补偿流程。表7按类别总结了目前的车载毫米波SAR运动补偿方法。

表7 车载毫米波SAR运动补偿方法总结Tab.7 Summary of motion compensation methods for automotive millimeter wave SAR

3.2.3 斜前视与MIMO-SAR成像

3.2.1 节和3.2.2节的研究内容都是基于正侧视或小斜视成像模式,且未利用毫米波MIMO雷达的多通道性能进行分辨率的增强。本节将结合车载毫米波雷达系统体制介绍斜前视成像与MIMO-SAR成像的新模式与新体制。

3.2.3.1 斜前视SAR分辨率分析

在真实场景中,汽车毫米波雷达(尤其是前向雷达和前角雷达)更多关注于车辆前方的事件预警,因此,结合SAR成像的基本原理,将雷达视线置于大斜视条件下并对斜前方的目标成像具有重要的研究意义。在此条件下,显然斜视角越大,可成像范围越往前方延伸,越有利于提前预警,但由于SAR成像的方位向分辨率取决于多普勒带宽,而大斜视角下的多普勒带宽相对较小,因此难以实现大斜视下目标的高分辨率成像。所以实际应用中,通常在成像范围和分辨率之间做出合理折衷,确定合适的斜视角,从而既能覆盖较远的成像预警区域,又能满足一定的分辨率需求。

不同雷达斜视角造成的方位向分辨率变化是复杂的,所以对成像分辨率的评估也较为困难。Hu等人[78]利用向量场分析方法给出了条带式斜前视车载SAR场景下二维综合成像分辨率与目标位置的定量数学关系,针对具体的行车速度情况与合成孔径长度精确得到前方区域的二维分辨率分布图,如图35所示。由此可根据分辨率需求划定有效的SAR可预警区域,也证实了车载毫米波条带式斜前视SAR目标预警的可实现性。Wang等人[79]推导沿航迹方向等效虚拟阵列模型,提出一种通过波束设计和虚拟孔径处理的前视雷达成像方法,计算复杂度低,提供了一种SAR前视成像思路。

尽管基于条带式斜前视SAR目标预警是可行的,但为了进一步提高斜前方甚至近前方目标的分辨率,需要更为复杂的成像体制。Gishkori等人[80]将前视扫描SAR (Forward Scanning-SAR,FS-SAR)引入汽车毫米波雷达平台,在车辆向前行驶中,采用数字波束形成的方法让雷达天线波束在前半平面内来回扫描以形成合成孔径,用以解决正前视目标分辨率恶化的问题,同时结合压缩感知的后向投影算法来实现成像,结果如图36所示。当前绝大多数汽车毫米波雷达系统暂未实现数字波束扫描能力,而FSSAR的本质是获取车辆前方的角度维高分辨,这也可以通过MIMO阵列来实现,通过在车头增加一维MIMO阵列孔径可获取对正前方目标的分辨率,这恰好是车载毫米波MIMO雷达硬件有机会实现的。

3.2.3.2 MIMO-SAR成像体制

车辆运动获取的合成孔径和MIMO阵列等效形成的阵列孔径本质上均可看作虚拟阵列孔径,而车载斜前视或前视高分辨成像则依赖于这种虚拟孔径的综合设计。因此,合适的虚拟孔径设计方法有助于实现前方目标的有效预警,车载斜前视或前视高分辨成像技术需与MIMO阵列设计方法相结合,以满足各方向和位置的分辨率需求。得益于MIMO雷达系统提供的可用自由度,车载MIMO-SAR系统及其对应算法设计具有很大的发展空间,可以进一步优化车载SAR系统的性能,如提高分辨率、降低旁瓣、节省计算资源等。

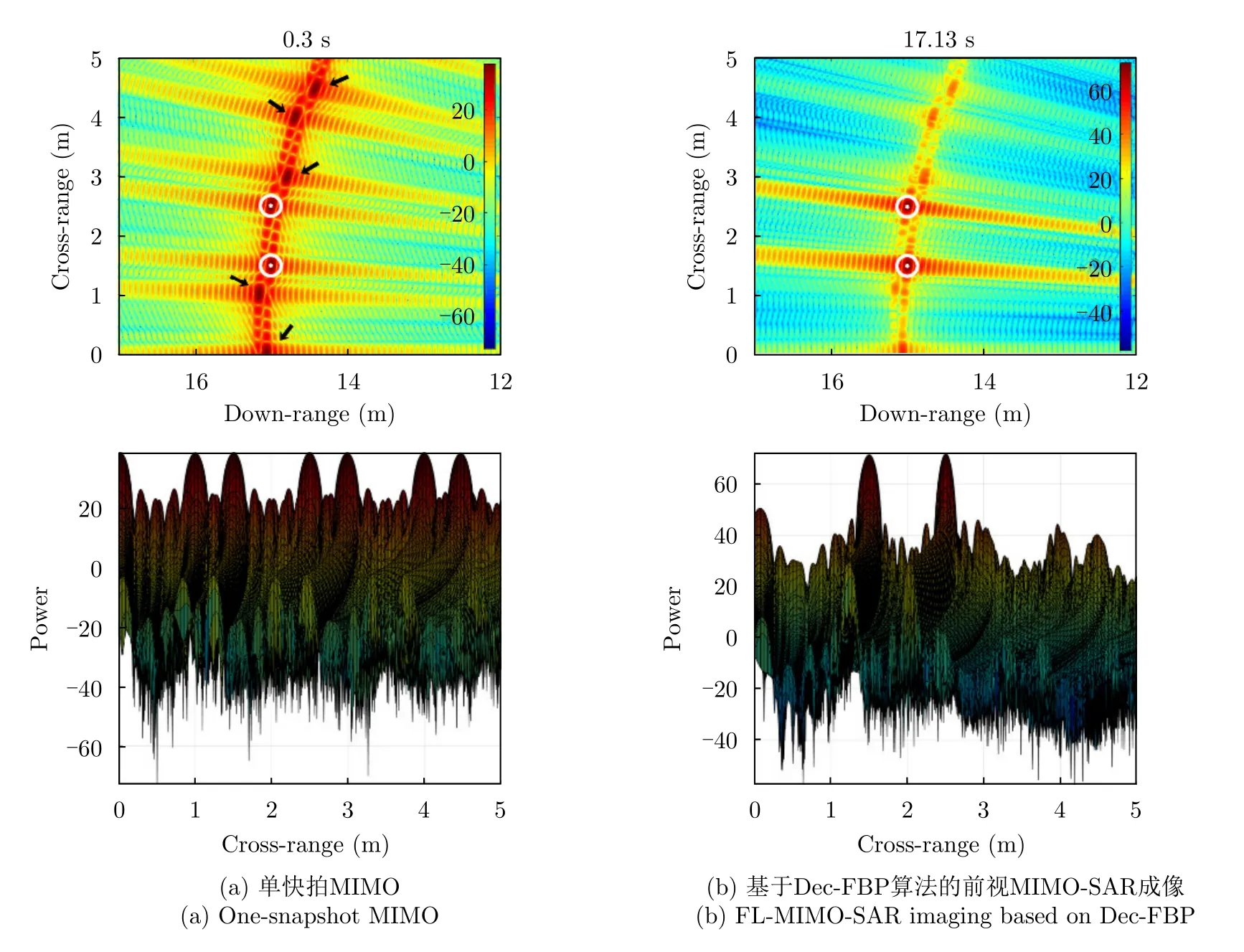

针对MIMO-SAR系统对方位向分辨率的增强,Gao等人[81]提出了一种分层MIMO-SAR成像结构,通过MIMO多通道数据估计车辆运动轨迹,并在有效提升方位向分辨率的同时节省了大量运算资源,其场景光学图像与SAR成像结果如图37所示。Zhang等人[82]则提出了一种基于多普勒复用(Doppler-division Multiplexing)的多通道后向投影算法,结合不同多普勒通道有效提高了车载环境下的SAR成像性能,场景光学图像与SAR成像结果如图38所示。Farhadi等人[83]提出了一种基于后向投影算法的TDMMIMO-SAR成像算法,结合随机激活函数(Random Activation Function),有效克服了在SAR图像中引起强旁瓣的耦合问题,并且适合应用于运动情况复杂的车载环境。

图37 分层MIMO-SAR成像[81]Fig.37 Hierarchical MIMO-SAR imaging[81]

图38 多普勒复用MIMO-SAR成像[82]Fig.38 Doppler multiplexing MIMO-SAR imaging[82]

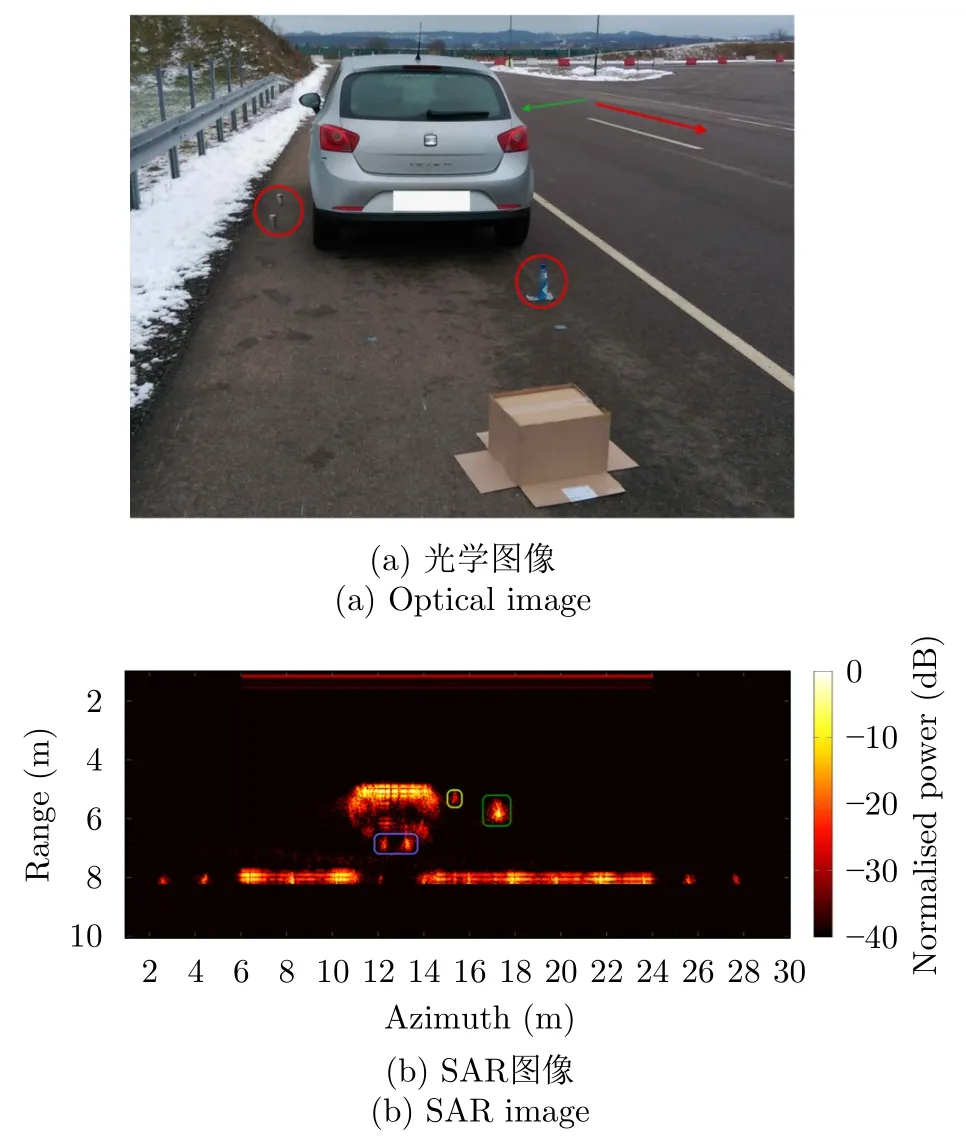

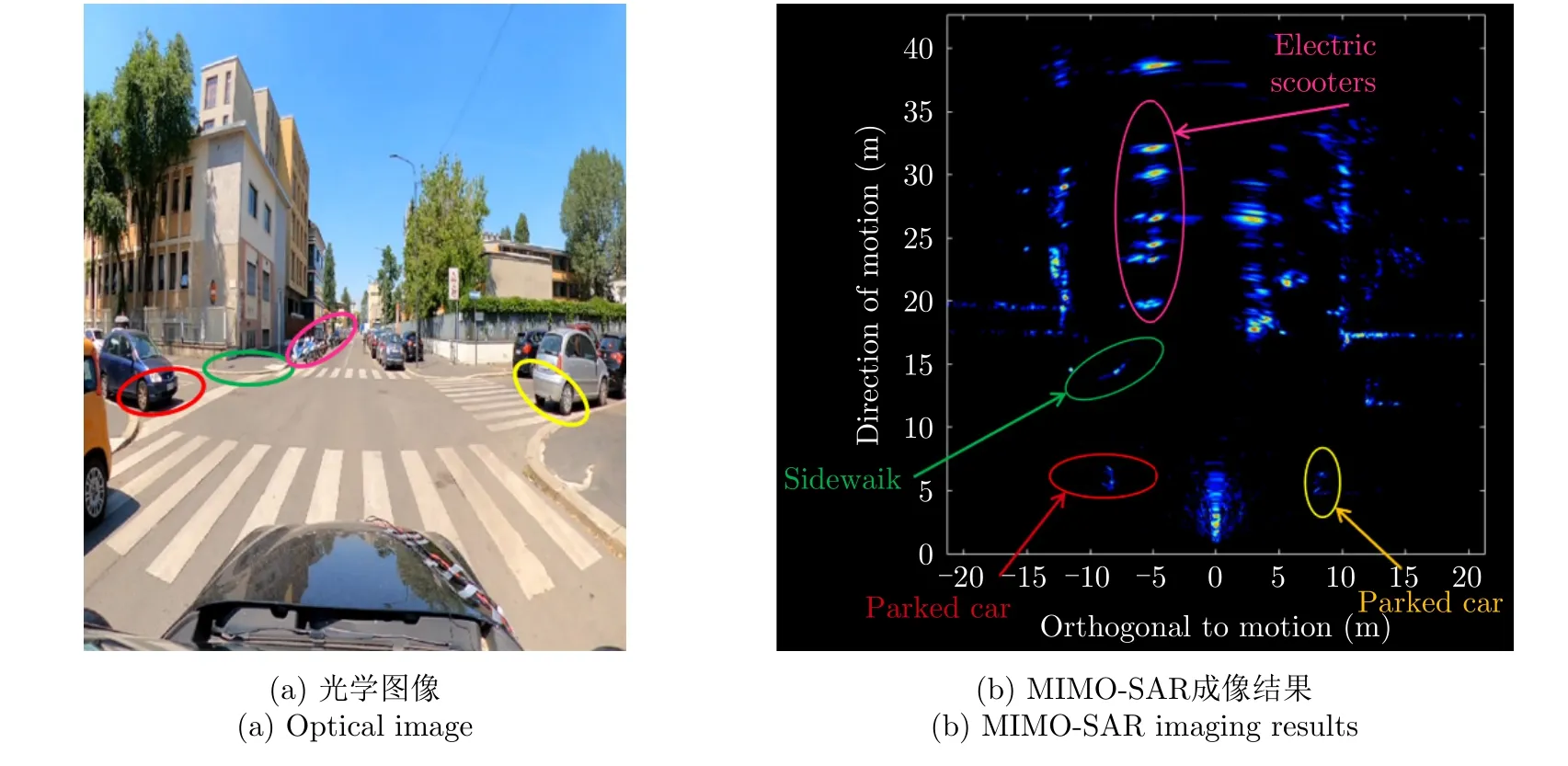

对于前文所述的大斜视或前视SAR成像问题,MIMO-SAR是一种更为方便的解决方案。MIMO雷达形成的多个虚拟通道可用于解决大斜视或前视SAR中接近车辆正前方区域内目标分辨率的问题。当雷达波束指向车辆行驶正前方,且MIMO阵列雷达也垂直于车辆前进方向形成虚拟孔径,则可以获取对车辆前方区域的空间角度分辨率。当前汽车毫米波雷达通常都是基于MIMO阵列来提供额外的虚拟孔径,所以此类方案在现有平台硬件上是较容易实现的。Sommer等人[84]使用MISO雷达形成虚拟阵列,对车载前视SAR的分辨率性能进行了评估。Tebaldini等人[85–87]实现了一个成熟且实用的车载77 GHz前视MIMO-SAR成像系统,该系统搭载于一个常用且低成本的8通道77 GHz汽车雷达硬件平台,利用快速分解后向投影算法(FFBP)达成了对前方50 m范围内的目标成像,且可以灵活地与自聚焦算法相结合,提高成像精度,其光学场景和MIMO-SAR成像结果如图39所示。Albaba等人[88]通过多普勒波束锐化(Doppler Beam Sharpening,DBS)技术提取沿航迹空变的多普勒信息,进一步分析SISO-SAR和MIMO-SAR在前视成像中角分辨率的差异,论证了DBS技术在SAR前视成像中存在局限性,提出一种改进的FBP算法实现SAR前视成像,成像结果如图40所示,并在此基础上提出一种三维引导和衰减BP (3D Guided-and-Decimated Back-Projection,3D GDBP)算法[89]实现前视三维成像。

图39 77 GHz前视MIMO-SAR系统[85–87]Fig.39 77 GHz forward-looking MIMO-SAR system[85–87]

图40 前视SAR成像结果[88]Fig.40 Forward-looking SAR imaging[88]

总的来说,对于特殊车载毫米波SAR成像场景(如在斜视角极大或合成孔径长度不足的场景),SAR成像的分辨率性能会急剧恶化,而单通道SAR系统从物理本质上无法突破这种分辨率限制,可通过上述MIMO阵列来弥补分辨率的不足,所以MIMO阵列对于车载SAR系统是相当重要且有意义的。此外,MIMO雷达在波形设计方面的多样性与可扩展性也为车载毫米波SAR系统提供了更多的可能,信号复用和波形正交的方案一定程度上也影响最终SAR成像的效果。根据具体的车载毫米波SAR成像任务,可以设计更为复杂的MIMO雷达正交波形,以实现更好的成像性能。

4 汽车毫米波雷达抗互扰技术

随着汽车行业日常井喷式发展,尤其是电动汽车、辅助(自动)驾驶等新车型、新技术的推广,汽车毫米波雷达的普及率也越来越高(高等级辅助驾驶汽车需至少5颗毫米波雷达);而得益于点云信号处理技术与合成孔径成像技术的快速发展,汽车毫米波雷达探测性能不断提升。由此会导致汽车毫米波雷达相互干扰的可能性大幅增加,已经成为亟需解决的实际问题[90]。多个汽车毫米波雷达系统间的互相干扰会极大降低雷达灵敏度和分辨率,严重危害交通安全[91]。因此,抗互扰成为汽车毫米波雷达信号处理技术中至关重要的一环,也是当下汽车行业与自动驾驶方向研究的热点。本节将从汽车毫米波雷达互扰模型展开,分别介绍波形设计、系统策略的抗互扰思路,最后着重介绍信号处理抗互扰技术。

4.1 互扰信号模型

如1.1节所述,当前汽车毫米波雷达最常使用的波形是调频连续波(FMCW)信号,其基本工作原理是将回波信号与发射信号混频,去斜处理为中频(拍频)信号后从中提取目标距离与速度信息。调频连续波发射信号模型可写为

其中,fc为发射信号载频,γ为调频率,t,和tm分别为全时间、快时间和慢时间(三者之间关系t=tm+)。假设目标相对于雷达的速度为v,那么目标与雷达的瞬时距离可以表示为

其中,R(tm)=R0-vtm为在tm时刻目标与雷达的距离。接收信号与发射信号的时延为τ=c为电磁波的传播速度,则回波信号为

利用发射信号为基准进行混频,混频结果为

对拍频信号的快时间维做快速傅里叶变换(FFT),则可得

对上述信号的慢时间维做FFT可得

由式(9)与式(10)可见,干扰信号会在距离多普勒谱上产生错误峰值,导致提取的目标距离与速度信息被破坏。无干扰的距离多普勒图像与被干扰的距离多普勒图像如图41所示[92]。

图41 无干扰与有强干扰的距离多普勒图像[92]Fig.41 Range Doppler images without interference and with strong interference[92]

目前,国内外专家学者已经提出许多方法来抑制汽车毫米波雷达之间的干扰。通常,这些方法主要可分为3类:(1)雷达系统和波形设计;(2)系统协调和策略方法;(3)信号处理方法。这3类方法实际上是分别从雷达发射端、发射端与接收端之间、接收端采取相应措施以抑制互扰。

4.2 系统和波形设计抗互扰方法

系统和波形设计方法一般要求雷达系统具有波形调制能力、新的结构或者协调单元等,甚至需要修改或重新设计雷达系统。该方法可避免雷达间互扰产生,但失去FMCW信号处理的简单性,需系统级全面考虑,设计复杂度高、难度大。

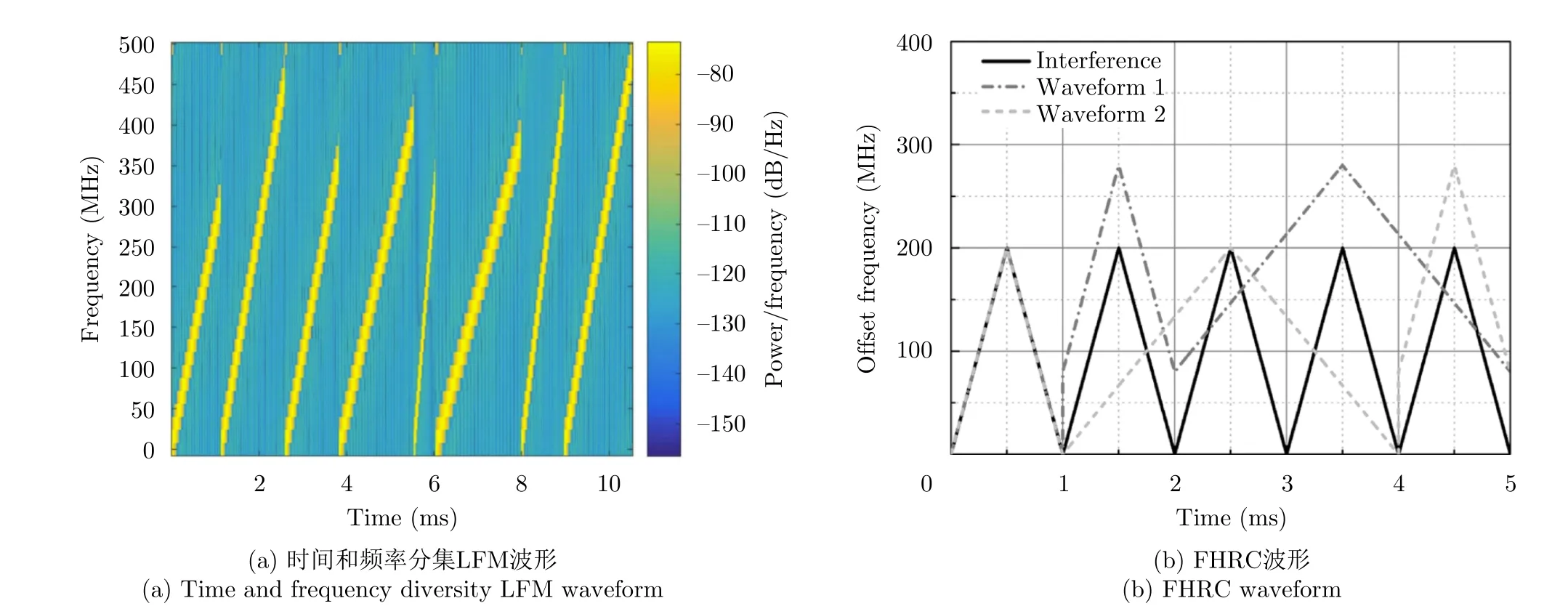

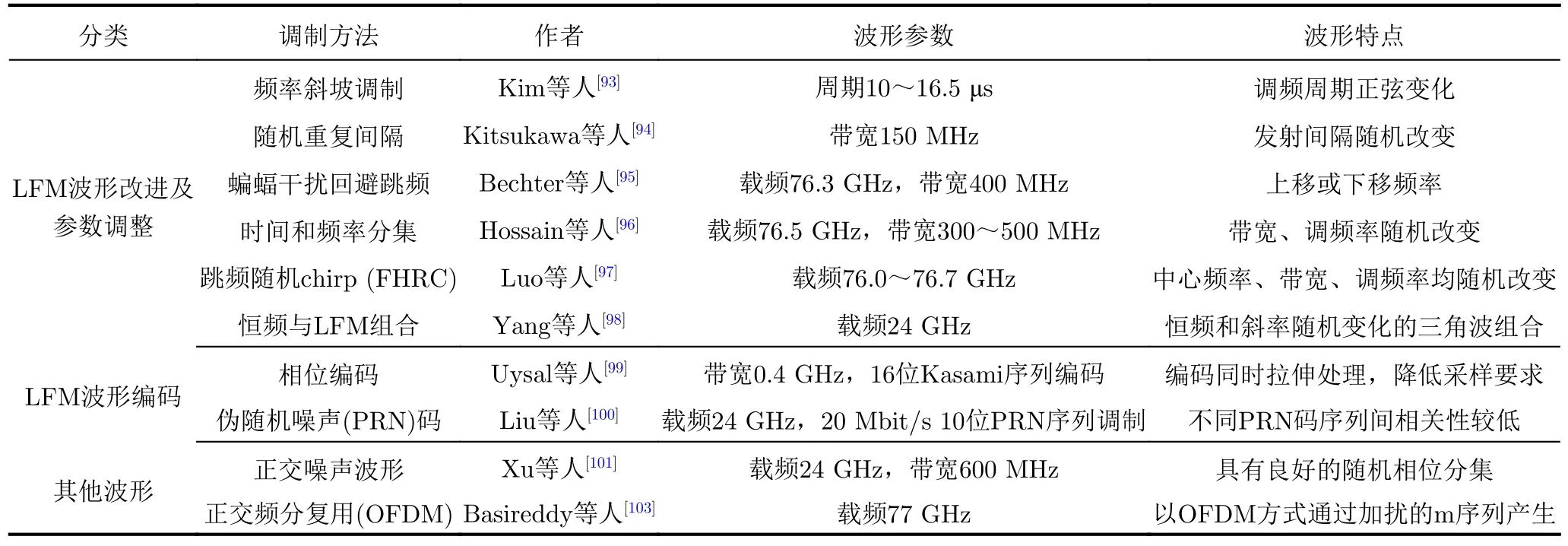

系统和波形设计抗互扰的基本思路是改进常见FMCW波形,降低互扰可能性。简单方法如文献[93]中的频率斜率正交调制、文献[94]中的随机重复间隔调制和文献[95]中基于蝙蝠干扰回避反应(Jamming Avoidance Responses,JAR)的跳频技术,如图42所示。在此基础上,文献[96]和文献[97]分别提出时间和频率分集LFM波形和跳频随机Chirp (FHRC)波形,同时调整多个LFM波形参数以避免互扰,如图43所示,抗互扰性能优于只调整单一波形参数的简单方法,但信号处理复杂度增加。此外,文献[98]提出恒频信号与LFM信号的随机组合波形,在有效降低互扰概率的同时也能实现多目标检测。另一种基于LFM波形的抗互扰思路是波形编码,例如文献[99]提出的相位编码(Phase Coded,PC)系统和文献[100]提出的伪随机噪声(Pseudo-Random Noise,PRN)码,对不同编码的干扰具有良好抑制效果,但对雷达硬件及解码要求较高。

图42 简单的抗互扰改进FMCW波形[93–95]Fig.42 Simple anti-interference improved FMCW waveform[93–95]

图43 调整多个参数的抗互扰改进FMCW波形[96,97]Fig.43 FMCW waveform improved by anti-interference adjustment of multiple parameters[96,97]

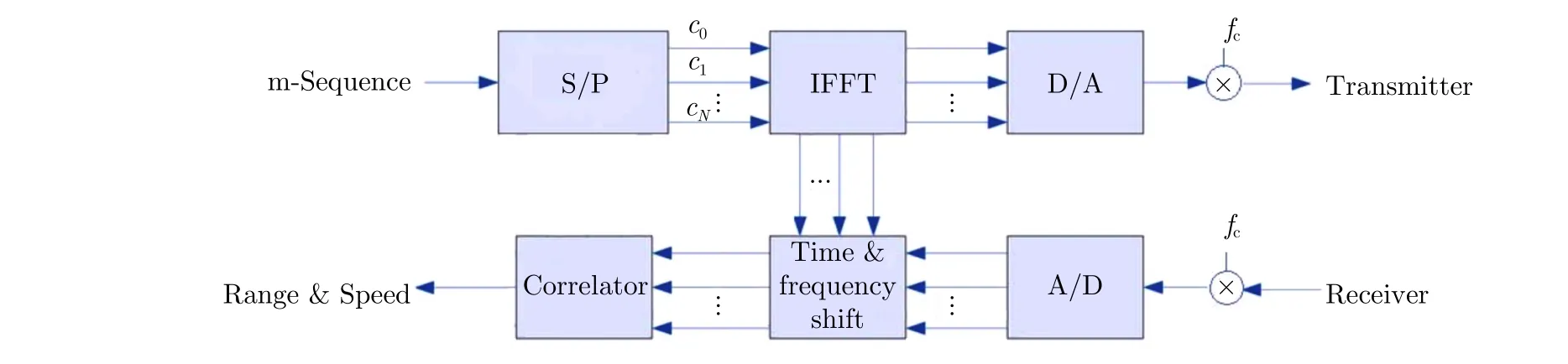

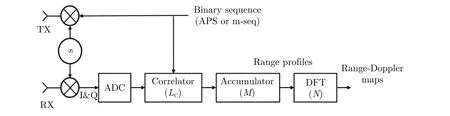

除LFM相关波形外,文献中也已将其他波形应用于汽车雷达抗互扰。文献[101]提出正交噪声波形,能够产生具有随机相位分集的正交信号,相较于PRN编码具有更低旁瓣,但相位估计问题较为复杂。文献[102,103]分别针对正交频分复用(Orthogonal Frequency Division Multiplexing,OFDM)波形进行互扰抑制,文献[102]利用chirp波形自适应方法实现干扰动态避免,从整体而非局部减轻互扰,文献[103]则利用最大长度序列(Maximum Length Sequence,MLS)低互相关特性来产生OFDM信号(如图44所示),并将加扰序列结合到波形中以抑制互扰。文献[104]针对相位调制连续波(Phase Modulated Continuous Wave,PMCW)雷达(如图45所示)间的互扰,通过序列分集、循环移位、反转来抑制PMCW雷达间互扰及其对其他雷达的干扰,可应用于包括OFDM雷达在内的所有数字调制雷达。表8总结了汽车毫米波雷达抗互扰的常用波形。

表8 汽车毫米波雷达波形及其特点Tab.8 Summary of common automotive millimeter-wave radar waveform and its characteristics

图44 基于m-序列的OFDM雷达[103]Fig.44 OFDM radar based on m-sequence[103]

图45 PMCW雷达框图[104]Fig.45 PMCW radar block diagram[104]

4.3 系统协调和策略抗互扰方法

系统协调和策略方法通常将感知与通信相结合,针对雷达间缺乏协调的现象提供中心控制和资源分配策略,减小雷达互扰的可能性,是可以联合雷达收发两端的抗干扰技术。在复杂车路场景下,这类方法需要花费昂贵的代价以实现最优的资源分配策略。

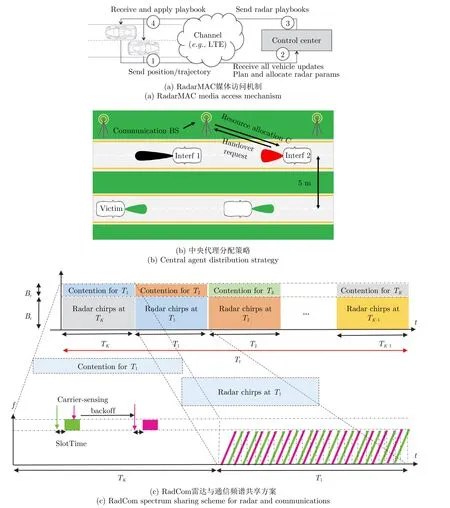

对于整个交通系统而言,系统协调和策略抗互扰的基本思路是基于基础通信设施和架构调度雷达资源。例如,文献[105]提出RadarMAC媒体访问机制,如图46(a)所示,通过专用LTE链路将每辆车当前位置信息发送到调度中心,调度中心动态分配雷达参数以避免雷达互扰。类似地,文献[106]提出中央代理分配策略,通过通信基础设施将雷达参数联合分配给附近的汽车雷达,如图46(b)所示。文献[107]提出RadCom架构,利用部分雷达带宽创建车对车(Vehicle-to-Vehicle,V2V)连接,使得雷达和通信信号以频分复用方式共享频谱,如图46(c)所示。

图46 系统协调和策略抗互扰架构[105–107]Fig.46 System coordination and policy anti-interference architecture[105–107]

对于每辆汽车而言,系统协调和策略方法通常需要其具备无线通信模块。例如,文献[108]提出分布式网络协议RadChat以控制和协调汽车雷达,RadChat是具有雷达和通信功能的集成模块,如图47所示。利用雷达的低时间和频率利用率,RadChat能有效抑制雷达互扰。文献[109]进一步研究Rad-Chat在多跳网络环境中协调雷达和通信的干扰抑制性能,高速公路场景的仿真结果表明RadChat以相当低的延迟运行,且有效减轻了干扰。表9总结了几种汽车雷达抗互扰协调系统及策略。

表9 汽车毫米波雷达抗互扰协调系统及策略总结Tab.9 Automotive millimeter-wave radar anti-interference coordination system and strategy summary

图47 RadChat的系统组成[108]Fig.47 The system composition of RadChat[108]

4.4 信号处理抗互扰方法

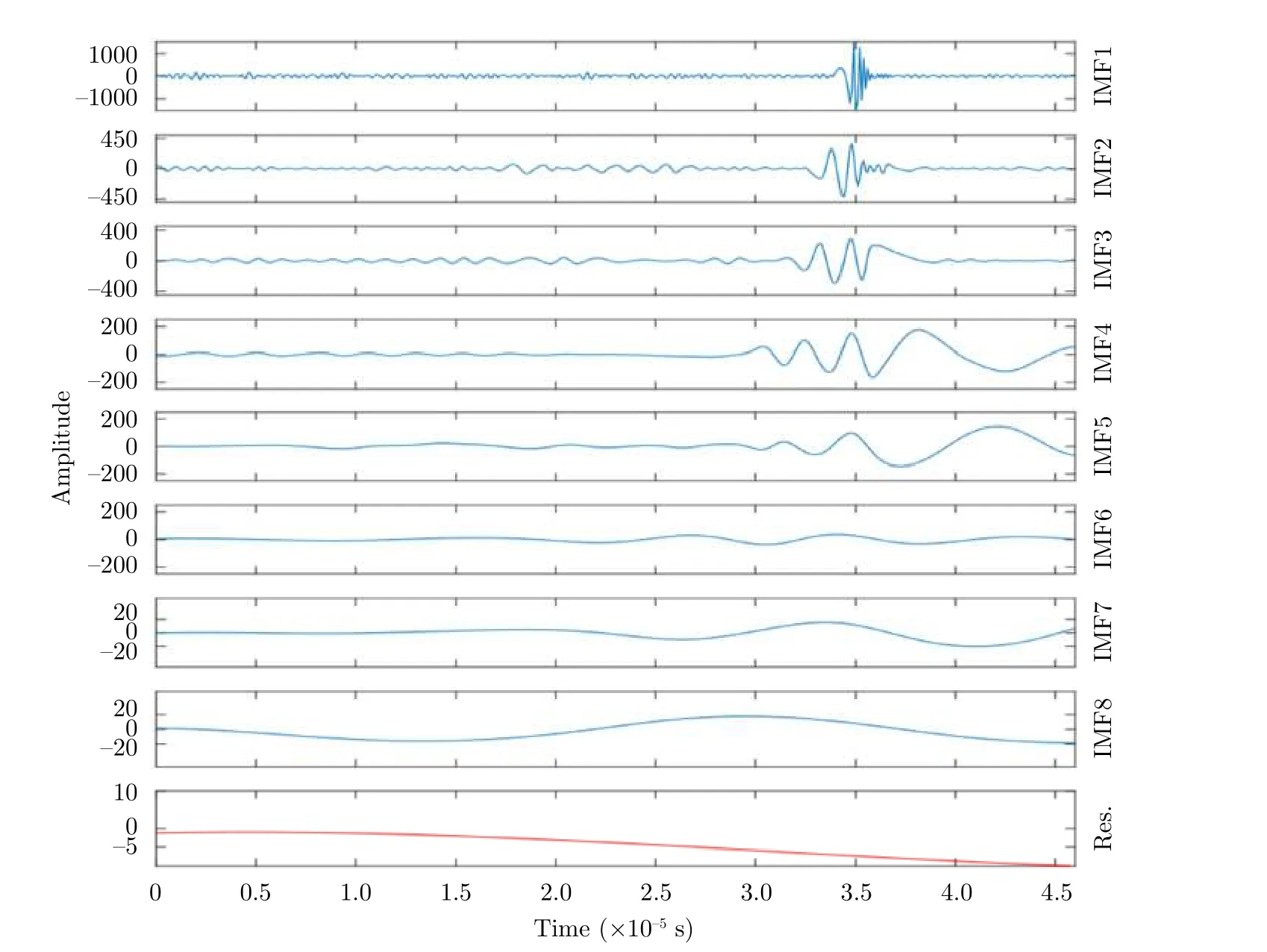

信号处理方法可以在不改变系统硬件架构基础上,通过接收信号后处理抑制互扰,是当前研究热点之一。这类方法大致可分为4类:(1)滤波;(2)干扰消除与重构;(3)信号分离;(4)基于数据驱动的方法。表10首先简要总结了各类信号处理方法的适用场景与优缺点。

表10 汽车雷达干扰抑制的信号处理方法对比Tab.10 Comparison of signal processing methods for automotive radar interference suppression

4.4.1 滤波

滤波方法主要根据干扰的不同分布,利用不同变换域(时域、频域、空域等)设计适当的滤波器以滤除干扰,对于平稳干扰有较好的干扰抑制效果。复杂场景中干扰非平稳或急剧变化时,导致滤波方法性能降低,此时可通过自适应滤波来缓解,但其所需的参考信号在实际处理中很难精确获得,仍会导致抗互扰性能不够稳定。

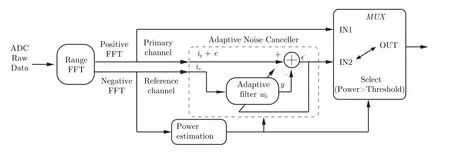

时域滤波方面,文献[110]提出自适应噪声抵消法,将时域信号FFT后频谱正半部分和负半部分分别馈入自适应噪声抵消器的主通道和参考通道,寻找滤波器的最优解以抑制互扰,如图48所示。该方法对中远距离干扰抑制效果较好,但在近距离性能受限。

图48 采用自适应噪声抵消器的干扰抑制方案[110]Fig.48 Adaptive noise canceller used to suppress interference[110]

频域滤波方面,文献[111]通过在多个脉冲间执行FFT单元的幅度非线性滤波,实现噪声抑制和干扰消除。该方法无需预先确定干扰阈值,同时也可有效保留相位信息,满足后续信号处理算法需求。

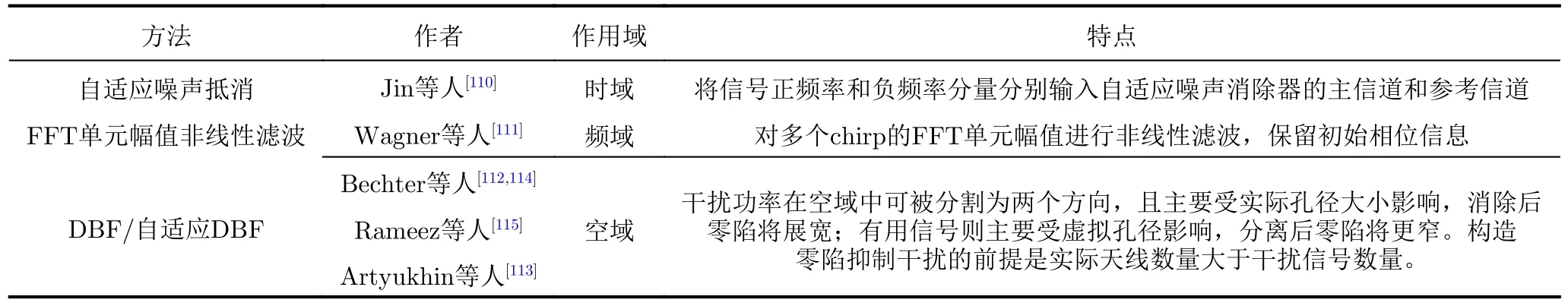

空域滤波方面,干扰抑制通常利用数字波束形成(Digital Beam Forming,DBF)实现。文献[112]证明用DBF进行干扰抑制时干扰功率在空域中可被分割为两个方向,如图49(a)所示。文献[113]提出基于干扰相关矩阵估计的样本矩阵求逆(Sample Matrix Inversion,SMI)算法,在干扰方向上构造零陷,该方法在干扰信号数量少于实际天线单元数量情况下有效。文献[114]证明干扰仅受实际孔径大小影响,导致其消除后零陷更宽;而有用信号则受虚拟孔径影响,其零陷更窄。文献[115]提出自适应DBF抗互扰方法,自适应计算DBF权重并用于主波束形成器,如图49(b)所示,可在干扰DOA未知情况下抑制干扰。表11总结了上述几种滤波方法,并给出具体应用特点。

表11 不同域中的毫米波雷达干扰抑制滤波方法Tab.11 Interference suppression filtering methods for millimeter wave radar in different domains

图49 用于干扰抑制的自适应DBF[112,115]Fig.49 Adaptive DBF for interference suppression[112,115]

4.4.2 干扰消除与重构

干扰消除与重构方法是指将接收信号受干扰部分消除、再对该部分进行重构的研究思路,关键问题是对干扰区域的精确检测和对信号的准确恢复。由于汽车雷达在实际中所受干扰的波形参数未知,且雷达系统发射信号和静默处理周期未知,干扰检测存在一定难度。而干扰检测不准确会导致无法完全消除干扰或有用信号被过度消除,影响后续目标检测性能;但即使干扰被精确检测并消除,部分有用信号也无法避免被消除,导致目标功率损失。因此,此类方法只适用于干扰部分占比不太高的信号,随着干扰数量增加,信号重构精度会显著下降。

文献[116]在消除相位噪声的影响后,用基于简单阈值的方法检测干扰并通过升余弦窗方法进行抑制。文献[117]提出最大稳定极值区域(Maximally Stable Extremal Region,MSER)算法以消除图像干扰区域,并通过反升余弦窗恢复,保证恢复信号平滑过渡,消除恢复信号不连续性。文献[118]提出改进的加权包络归一化(Advanced Weighted Envelope Normalization,AWEN)算法来检测干扰并抑制,可分离出间隔较短的脉冲干扰。文献[119]在压缩感知的稀疏采样基础上通过自适应阈值迭代(Iterative Method with Adaptive Thresholding,IMAT)恢复缺失信号,直到阈值低于噪底,可有效抑制近距小目标所受干扰。文献[120]提出基于迭代阈值的时域干扰检测方法,迭代计算干扰的检测阈值,而不使用被干扰拍频信号,可检测到弱干扰,如图50所示。

文献[121]提出短时傅里叶变换(Short Time Fourier Transform,STFT)域拍频插值方法,检测并消除时频域干扰,通过自回归(AutoRegression,AR)模型恢复无干扰信号,如图51所示。文献[122]提出修剪精确线性时间(Pruned Exact Linear Time,PELT)算法PELT-KCN,通过文献[118]中WEN算法获得拍频信号包络,计算最优惩罚因子,精确检测干扰时间位置,通过AR模型来恢复受干扰部分。

图51 STFT域中拍频插值[121]Fig.51 Beat interpolation in STFT domain[121]

文献[123]提出基于卡尔曼滤波器的干扰恢复算法,通过峰值检测识别干扰时段,将未失真信号输入卡尔曼滤波器来预测干扰区域。文献[124]提出在频域恢复失真信号的方法,分别在快时间和慢时间内检测时域干扰,再迭代地自适应选择频谱主峰,对其傅里叶逆变换后以近似缺失信号。文献[125]提出基于CFAR检测器的方法,在时频域中用一维CFAR检测器来检测干扰,并利用图像扩张掩模方法扩张检测区域,分别用幅值校正法和Burg算法外推信号,如图52所示。

图52 时频域拍频信号[125]Fig.52 Beat signal in the time-frequency domain[125]

文献[126]提出基于矩阵束(Matrix Pencil,MP)的干扰抑制方法,将拍频信号建模为复指数之和。拍频信号受干扰部分被截断后,MP方法可估计截断部分参数并对其重构,可直接在高维数据空间减轻干扰。文献[127]提出AR模型慢时间重构方法,并证明了对于静态雷达,慢时间重构比快时间重构干扰抑制效果更好,但在信号处理之前需要接收整个信号帧,处理时间更长。文献[128]提出块克罗内克压缩感知(Block Kronecker Compressed Sensing,BKCS)算法,将2D距离多普勒谱数据分成几个块并分别恢复其无干扰数据,干扰抑制性能优于1D信号恢复算法。文献[129]提出迭代干扰抑制(Interference Mitigation via Iterative Approaches,IMIA)算法,引入二维CA-CFAR来检测并消除强干扰,从而检测出强目标。在去除强目标后,重复上述步骤来检测弱干扰和弱目标,直到不再检测到目标或干扰,如图53所示。IMIA算法可同时消除弱干扰和强干扰,从而检测到弱目标和强目标。表12总结了文献中已有的干扰消除与重构方法。

表12 毫米波雷达干扰消除与重构方法总结Tab.12 Summary of interference elimination and reconstruction methods for millimeter wave radar

4.4.3 信号分离

信号分离方法利用干扰与有用信号在某些基下或某些域(时域、频域等)中的不同特性将干扰分离,在一定程度上避免干扰的逐脉冲显式检测。通常情况下,有用信号在时域表现出稀疏特征,而干扰在时频域是稀疏的,用不同的基来分别表示干扰与有用信号或者将其变换到不同域中是分离干扰的可行办法。然而,这类方法计算量通常很大,且存在离网问题,即真实频率或时频分量与基之间失配,造成信号分离不够准确,干扰抑制性能下降。

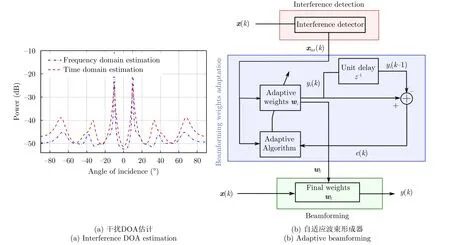

文献[130]提出形态成分分析(Morphological Component Analysis,MCA)算法,由于干扰在时频域的稀疏特性更明显,而拍频信号在频域更稀疏,MCA可以将STFT后的干扰与DFT后的拍频分离。文献[131]提出基于经验模态分解(Empirical Mode Decomposition,EMD)的迭代修正阈值(Iterative Modified Threshold,IMT)算法,根据连续均方误差确定干扰主导分量,如图54所示,通过迭代修正阈值来对干扰主导分量进行调整,最后将所有分量组合得到干扰信号。

图54 时域信号EMD[131]Fig.54 Time domain signal EMD[131]

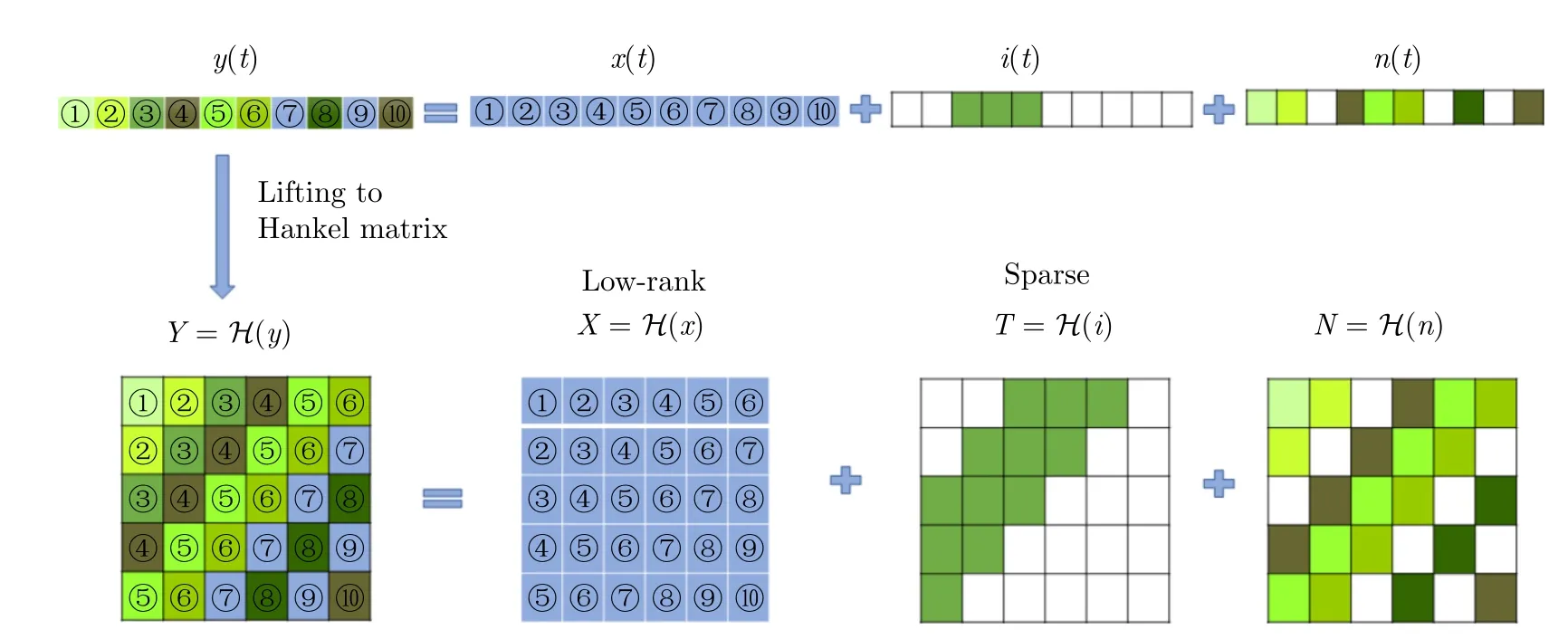

文献[132]提出利用小波去噪分离信号与干扰的方法,反转小波去噪过程,提取高强度脉冲干扰并去除低强度正弦信号,但需要通过大量实测数据搜索小波去噪的合适参数。文献[133]使用正交匹配追踪(Orthogonal Matching Pursuit,OMP)算法在简化的线性调频小波变换基础上进行信号重构,减少需要估计的参数数目,同时也可以通过硬件加速。文献[134]提出稀疏低秩汉克尔矩阵(Hankel Matrix)分解方法,将信号矢量提升为Hankel矩阵,如图55所示。有用信号Hankel矩阵是低秩的,而干扰信号Hankel矩阵是稀疏的,可通过RPCA分解信号与干扰矩阵。

图55 Hankel矩阵的稀疏低秩分解[134]Fig.55 Sparse low-rank decomposition of Hankel matrix[134]

文献[135]提出基于EMD和MUSIC的DOA估计方法,使用EMD分解受干扰影响的天线单元的接收信号,根据阈值抑制干扰分量。文献[136]提出可调Q因子小波变换(Tunable Q-factor Wavelet Transform,TQWT)域干扰抑制技术。目标信号在高Q因子小波变换后表现出稀疏性,而干扰信号在低Q因子小波变换后稀疏性更明显,可通过MCA和L1范数惩罚最小二乘法,建立基于稀疏性的非线性信号分离模型来分离干扰。文献[137]提出基于几何序列分解的干扰抵消(Geometric Sequence Decomposition based Interference Cancellation,GSD-IC)算法,将单个采样信号看作一个几何序列,将接收信号分解成不同的非正交叠加信号,从而分离干扰与目标信号。文献[138]基于有用回波信号在频域的行稀疏性与干扰信号在时域的稀疏性之间的差异,提出一种具有行稀疏约束的目标回波抑制优化算法,通过对回波信号进行时频分解,可有效分离目标信号与干扰。表13总结了文献中已有的用于毫米波雷达干扰抑制的信号分离方法。

表13 用于毫米波雷达干扰抑制的信号分离方法总结Tab.13 Summary of signal separation methods for millimeter-wave radar interference suppression

4.4.4 基于数据驱动方法

近年来,随着人工智能技术的发展,基于数据驱动的方法也越来越多地应用于汽车雷达抗互扰。深度学习是基于数据驱动的典型方法,具有出色的端到端数据处理性能,但在一定程度上缺乏坚实的物理基础。

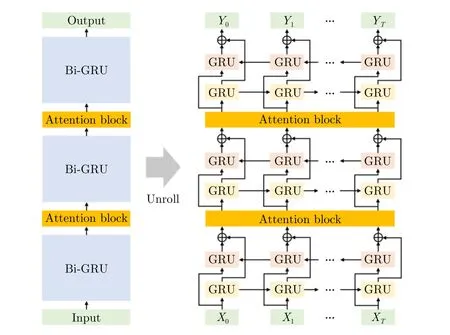

文献[139]提出具有门控递归单元(Gated Recurrent Unit,GRU)的递归神经网络(Recurrent Neural Network,RNN)模型,如图56所示。RNN已知适用于处理序列数据,能同时去除干扰和重构发射信号,信号处理可以只用矩阵计算来完成,而不用任何迭代结构或自适应阈值。

图56 具有GRU的RNN模型[139]Fig.56 RNN model with GRUs[139]

文献[140]使用CNN来减轻干扰。CNN能通过考虑附近的输入来学习局部模式并在整个数据信号中识别,需要的参数相对较少,更有利于集成到芯片中。文献[141]引入深度学习自我注意机制与RNN结合,如图57所示,相较于具有GRU的RNN模型对干扰的抑制性能更好,且同样适用于OFDM雷达。

图57 具有自我注意机制的RNN模型[141]Fig.57 RNN models with self-attention mechanisms[141]

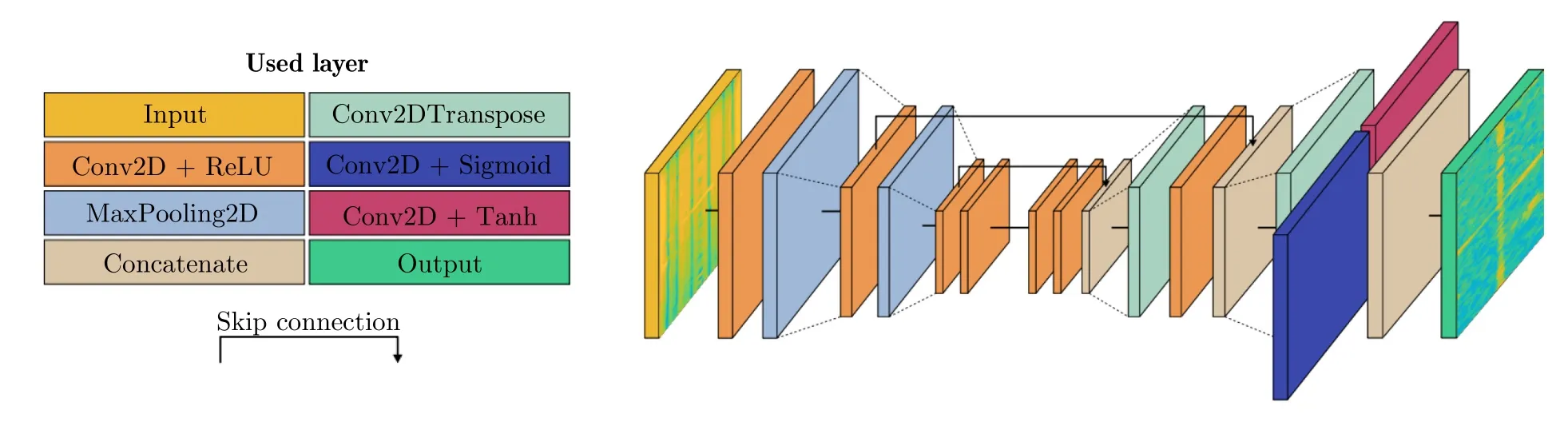

文献[142]提出基于全卷积神经网络(Fully Convolutional Neural Networks,FCNN)的干扰抑制方法,将拍频信号的频谱作为输入,输出干扰消除后的距离剖面,如图58所示。

图58 FCN模型的一般架构[142]Fig.58 General architecture of the FCN model[142]

文献[143]提出基于自动编码器(AutoEncoder,AE)的CNN模型以执行图像去噪,如图59所示,将干扰抑制问题转化为距离多普勒图像去噪问题。该网络可以很好地适用于不同类型的干扰,但对信号的相位信息不能完全保留。文献[144]针对CNN模型超出硬件存储容量的问题,分析比较不同网络的量化能力和内存需求,找到具有适当资源需求的小型模型,以保证干扰缓解性能。

图59 基于AE的CNN模型架构[143]Fig.59 CNN model architecture based on AE[143]

综上所述,尽管信号处理类的干扰抑制方法可能在计算上比较复杂,在不同场景中抗干扰性能会有一定差异,但在毫米波雷达互扰问题日益严重场景需求下,无需改变硬件结构的处理方式具有极大的发展潜能及重要的现实意义。极为有限拥挤的频谱资源决定了系统和波形设计方法的局限性,在复杂环境下干扰几乎无可避免,而系统协调和策略类的方法需要对整个环境中的通信设施、雷达等资源进行调配,在实施上具有巨大难度,需要花费高昂成本。因此,信号处理类抗干扰方法既有其存在的必要性,也有其无可替代的优点。随着汽车毫米波雷达芯片算力不断提升与各种信号后处理算法不断优化,此类方法实时性和稳健性势必能得到不断提高,最终满足智能驾驶汽车雷达抗干扰的实际需求。

5 总结与展望

5.1 汽车毫米波雷达点云成像处理

汽车毫米波雷达是自动驾驶的主要传感器,它全天时全天候的工作特性势必在自动驾驶领域扮演重要角色。毫米波雷达的主要弱点在于有限的角分辨率性能,这对未来自动驾驶、车路协同的需求提出了挑战,因此如何提升汽车毫米波雷达的角分辨率是当前研究的关键核心之一,也是点云成像的关键技术之一。展望未来的发展趋势,基于车载场景的特定需求,汽车毫米波雷达主要朝着小型化、集成化以及低功耗化方向发展;同时,随着硬件技术的进步,雷达的探测性能也在逐步提升,更大的带宽将带来更高的距离分辨性能,MIMO技术以及超分辨算法的应用也使毫米波雷达在角度维的分辨性进一步提高。除了提高角度分辨率外,在实际应用中毫米波雷达点云成像处理技术未来仍需解决以下问题:

(1) 通道一致性问题。目前各大公司的汽车毫米波雷达均采用MIMO技术,结合天线阵列布局实现大于实际阵列尺寸的虚拟孔径,提高阵元利用率。但在MIMO雷达系统设计中,如果无法保证通道间的一致性,就无法保证目标定位一致性,从而严重影响点云生成。目前有源校正思路在小孔径少通道的单芯片系统较为常用,但为了提高空间角度分辨率,汽车毫米波雷达正逐渐向多芯片级联方案拓展,对于较大规模阵列通道而言,其校正的准确度和实时性将是未来汽车毫米波雷达的难点。

(2) 检测器性能问题。汽车毫米波雷达目标检测仍然继承了雷达统计信号处理的分析流程,在面对少量强目标和均匀杂波背景下具有较好的效果。但汽车高速行驶中面临的电磁环境非常复杂,尤其是城市道路及路口,杂波非均匀且目标相互遮掩,尤其是存在强散射目标(如大卡车、广告牌等)下很难通过统一的检测器来有效检测弱散射目标(如行人等)。而当前点云成像的准确度和密度都依赖于良好的目标检测性能,具有自适应滤波且面向复杂场景的目标检测器将是未来点云成像质量的关键。

(3) 算法运行效率问题。除了高精度需求外,实时性也是汽车毫米波雷达应用的重要指标。目前汽车毫米波雷达的刷新周期大概在50 ms左右(对应于1.67 m@120 km/h),因而在实现理论高精度、高密度点云外,若在点云生成采用较为复杂的算法导致整体耗时明显增加,ADAS功能响应被拖慢,很可能会造成严重的交通事故。尤其对于汽车毫米波雷达而言,其相对于激光雷达的一大优势在于低廉的成本,以上算法实现需在低成本条件下完成,算法运算效率是未来必须要考虑的因素。

5.2 车载毫米波合成孔径雷达

随着车载毫米波SAR成像技术在现实场景的应用越来越广泛,很多学者和各大厂商也逐渐重视这种高分辨成像体制的研究,也逐渐产生了更加复杂困难的任务需求(如高精度运动补偿、高分辨率、大斜视角成像等)。相较于传统汽车毫米波雷达阵列处理方案,汽车毫米波SAR系统结构更加复杂,提升和扩展的空间也更大,因此,若要设计一个实用且高效的车载毫米波SAR系统,未来系统结构、信号处理等环节都面临不小的难题,具体如下:

(1) 车载毫米波SAR的运动补偿。对于车载毫米波SAR系统而言,目前77 GHz频段对应较小的波长,其相较于低频段对运动补偿的精度要求更高,尤其对于复杂路况,实现准确的运动补偿十分困难。目前,可以借鉴其他平台SAR系统采用“粗补偿+细聚焦”的方案,先利用低成本的导航或定位设备实现粗成像,再利用运动补偿算法进行精细成像。而其他平台的惯导系统对于低频段、大型目标的场景是足够的,对于汽车上装配的导航设备受限于成本、重量等限制,通常精度有限,未来车载毫米波SAR系统仍需在低成本、低载荷平台上实现高精度的运动补偿。

(2) 车载毫米波MIMO-SAR和大斜视角成像。当前汽车毫米波SAR系统主要关注于车侧方的目标场景,主要用于自动泊车、搜寻停车位等,而未来车载毫米波SAR系统仍需考虑实际驾驶中对于前视或斜前方目标场景的高分辨成像。如3.2.3节所述,当前汽车毫米波雷达系统全部采用MIMO阵列设计,从而获取更大的虚拟孔径以提高分辨率。因而如何将MIMO体制应用于汽车毫米波SAR系统,应用于解决汽车驾驶前向分辨率不足的难题将是未来的重要研究方向之一。

(3) 多部车载毫米波SAR协同处理。结合3.2.1节所述,开展多平台协同车载毫米波SAR系统设计的研究,结合多平台同步技术、时域和频域成像算法以及运动补偿技术等,可以获取多位置、多角度的SAR图像,从而提高SAR成像性能。在自动驾驶和车联网领域,已有大量关于多雷达和多平台协同系统的研究成果,前期开展可在这些基础上借鉴适用于SAR成像任务的结构。但考虑到自动驾驶或辅助驾驶平台除了执行SAR成像任务外还有其他功能,未来如何将SAR成像任务嵌入通用的汽车雷达协同网络中仍是很大挑战。

5.3 汽车毫米波雷达互扰抑制

纵观汽车毫米波雷达抗互扰技术的3种不同路线,结合目前常用的已经成熟的主流互扰抑制方法,汽车毫米波雷达的抗互扰任重道远,但发展意义重大,前景广阔。在实际复杂道路交通环境中,目前3类主要的毫米波雷达干扰抑制方法各有其适用场景与固有缺陷,需要结合具体场景分析其适用性。总体来说,汽车毫米波雷达抗互扰的思路正在由被动抗互扰向主动抗互扰转变,即由后处理被干扰的雷达信号向主动避免或识别、抑制干扰转变,该趋势在汽车毫米波雷达波形设计、系统协调策略与信号后处理上均有不同体现,具体表现为:

(1) 雷达波形复合化。当前汽车毫米波雷达的主流波形为FMCW波形,该波形虽具有回波信号处理简单、目标信息易于提取的优点,但在有限的频带范围内极易相互干扰,因而未来汽车毫米波雷达波形正在向更为复杂的多种波形组合发展,以具有更强的抗干扰能力。

(2) 雷达通信一体化。当前汽车毫米波雷达抗互扰的主要策略即为在同一区域内利用通信设施协调各汽车毫米波雷达系统,使之降低互扰的可能。当前以及未来汽车毫米波雷达正越来越紧密地与车联网通信相互联系,车路协同、雷达通信一体化的趋势日益加强。

(3) 干扰类型主动识别与抑制。当前部分汽车毫米波雷达信号后处理方法虽然有干扰检测与抑制步骤,但仍然缺乏对干扰类型及干扰雷达参数的有效识别手段。未来在信号后处理环节中雷达应能主动对所受干扰类型作出主动识别与判断甚至直接采取相应手段抑制,从而更有效地抑制互扰。

(4) 信号处理与数据处理相结合。如4.4.4节所述,得益于深度学习领域的高速发展,深度学习的互扰抑制方法正在被应用于汽车毫米波雷达的抗互扰。深度学习方法注重数据处理,与基于信号模型的处理方法相结合,实现数据模型双驱动的应对思路,正在成为应对复杂场景下互扰抑制问题的新趋势。