基于U-Net改进的肺结节3D分割网络

夏家权

(福州大学 先进制造学院,福建 福州 350108)

0 引 言

肺癌是最具侵袭性的癌症之一,其5年生存率仅为19%[1]。肺癌也是发达国家和发展中国家男性残疾调整生命年的主要原因[2]。由于空气污染和高吸烟率,巴西、俄罗斯、印度、中国和南非的肺癌发病率和死亡率正在上升[3]。肺结节的早期发现和诊断可以大大降低肺癌的死亡率。虽然晚期肺癌患者的生存率较低,但Ⅰ期肺癌的10年生存率高达75%。因此,肺癌的检测、诊断和早期治疗对患者的生存至关重要。胸部螺旋计算机断层成像(Computer Tomography,CT)筛查作为一种无创方法,是肺癌检测的有效手段[4]。结节的CT图像特征可以帮助放射科医师评估恶性结节的风险。由于形态学、纹理或灰度特征的定量测量容易受到周围环境的干扰,因此有必要进行精确的结节边缘分割。一种具有健壮性且准确的自动肺结节分割方法在避免烦琐的人工处理和减少观察者之间的差异方面具有临床意义。

肺结节分割方法大体上可分为传统方法和深度学习方法。传统方法中,有REN H[5]等人提出改进的区域生长方法,只需给定一个坐标点,通过评估周围像素与该点的相似性判断生长条件,当连续切片中目标区域的平均CT值满足一定条件时,自动分割后一张切片内的结节。但在多条血管贯穿结节等复杂情况下,该方法会造成欠分割。FARHANGI M M[6]等将结节的先验形状表示为训练形状的稀疏线性组合,集成到level set[7]目标函数中实现了结节3D分割。该方法普适性较好,但函数的非自动初始化差强人意。肺结节内部密度不均匀,外部形态多样化为其分割带来了困难,且部分结节与血管、胸膜等结构粘连,更增加了其分割难度,以致目前仍缺乏能适用于所有类型结节分割的传统方法。

相较于传统的图像分割算法,基于深度学习的图像分割方法可以适应复杂多变的环境,在各种场景的图像分割任务中表现出了更高的精度和健壮性。深度学习方法中,SONG J[8]等提出了一种基于WGAN-GP[9]的肺结节分割模型,使用修改后的WGAN-GP作为生成网络,结合Faster-RCNN[10]剔除假阳性,在LIDC数据集中取得82.05%的肺实质尺度结节分割精度,但该方法对GGN分割效果仍然欠佳。NI Y[11]等提出两阶段分割方法,第一阶段使用3D分割网络进行结节定位,第二阶段基于多视图的2.5D网络进行精分割,在公共数据集LIDCIDRI上的肺实质尺度结节分割Dice相似系数(Dice Similarity Cofficient,DSC)为83.1%。WANG S[12]等提出了一种基于边缘增强的双路径肺结节分割模型。该模型由全局路径、边缘路径和特征聚合模块组成。其中,边缘路径引入边缘检测算子构建肺结节边缘增强数据集,提高了数据集利用率,同时提供了更多目标病灶边界的先验知识;最后设计特征聚合模块,融合两条路径的输出,得到最终的分割结果。该模型在公共数据集LIDC-IDRI上的结节尺度分割平均DSC为89.86%。对于使用深度学习进行肺结节分割,一方面,所使用的网络模型对肺结节进行分割的过程中网络模型中超参数的设置方式有待改进;另一方面,对于结节的分割效果,尤其是基于CT的端到端全自动分割效果仍有很大提升空间。此外,结节异质性强导致不同类型的结节分割效果差距大,如空洞型结节、磨玻璃结节及与其他组织有粘连的结节分割效果普遍不佳[13]。

尽管以上这些工作通过引入先进的模块和复杂的结构来提高对新冠病灶的分割精度,并且在各自的数据集上表现优于传统模型,但是,由于肺结节的大小、分布和结节内部的异质性,很容易导致边界过度分割或欠分割。本文提出的方法可以有效地解决肺结节边界分割不清的问题。本文的主要工作如下。

(1)在3D U-Net[14]的基础上提出全局注意力上采样模块(Global Attention Upsample,GAU)。GAU是一种基于注意力的高效解码器,用于融合低分辨率和高分辨率的信息,通过global average pooling操作,GAU可以提取深层全局信息,对浅层特征进行加权处理。GAU模块不仅能高效地适应不同尺度的特征映射,而且能以简单的方式为浅层特征的映射提供指导信息。

(2)添加了门单元注意力(Gateunit)。门单元集成了多尺度特征和编解码特征,但空间信息在编码器自上而下的结构中会逐步丢失。为了防止信息丢失,本文采用一种空间注意力机制来逐步抑制不同特征尺度的不相关背景信息,并能将注意力集中在前景中。

(3)通过结合U-Net结构、多尺度特征提取、GAU以及Gateunit,本文构建的网络的整体结构仍然保持着U型的形状。

1 方 法

因计算机图形处理器(Graphics Processing Unit,GPU)显存限制,本方法需要对输入网络的CT图像进行裁剪,裁剪后为32×32×32的立方体,最后输出时,再进行拼接,形成完整模型结果。

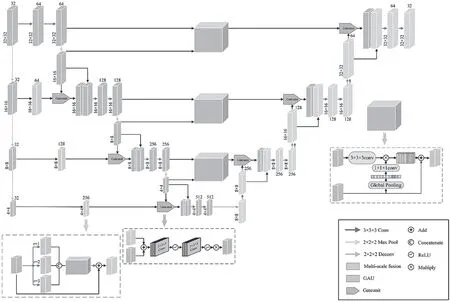

本文提出的模型结构由编码器和解码器构成,如图1所示,分别使用了不同模块来构建网络。通过结合U-Net结构、多尺度特征提取、GAU及Gateunit,构建网络的整体结构,仍然保持着U形结构。编码器模块逐渐降低特征图的分辨率,捕捉深层次的语义信息,同时对输入进行三维池化和多尺度特征提取,并与编码中自上而下的特征输入Gateunit中,作为编码器中新的输入特征,可以提高分割性能,也不会增加太多的计算成本。新的输入特征输入GAU中,融合了浅层特征与深层特征的GAU与解码器模块则一步步地恢复空间信息。

图1 模型结构图

1.1 多尺度特征提取

为了综合考虑局部信息与全局信息,本文使用膨胀卷积来捕捉输入图像的多尺度特征。在该模块中,分别使用膨胀率为1、2、3的卷积来捕捉多尺度信息,输出特征图数量为n,膨胀率为2和3的卷积用于扩大感受野。在批量归一化和ReLU激活操作后,将它们的输出连接起来,用3n个大小为3×3×3的卷积核来融合多尺度信息,输出特征图数量为n,将融合后的多尺度特征与浅层特征相加。

1.2 全局注意力上采样模块

GAU是一种基于注意力的高效解码器,用于融合低分辨率和高分辨率的信息。通过global average pooling操作,GAU可以提取深层全局信息对浅层特征进行加权处理。因为相比于浅层特征,深层特征具有更加丰富的语义信息,可以为浅层特征提供指导。在所示模块中,对浅层特征进行3×3×3卷积运算,以减少特征图中的通道数量。由深层特征产生的全局信息依次经过1×1×1卷积、批量归一化和非线性处理,然后与浅层特征相乘。最后,深层特征被添加到加权的浅层特征中,并进行逐步的上采样过程。GAU模块不仅能高效地适应不同尺度的特征映射,而且能以简单的方式为浅层特征的映射提供指导信息。

1.3 门单元注意力

门单元集成了多尺度特征和编解码特征,但空间信息在编码器自上而下的结构中会逐步丢失。为了防止信息丢失,本文采用一种空间注意力机制来逐步抑制不同特征尺度的不相关背景信息,并能将注意力集中在前景中。

1.4 损失函数

Dice系数是一种集合相似度度量函数,通常用于计算两个样本的相似度,取值为[0,1],在图像处理过程中一般用在评估区域重叠状况,可用于评价模型分割性能。Dice系数越靠近1,代表分割结果与金标准越接近,说明分割效果越好。Dice Loss为1减去Dice系数。作为损失函数,Dice Loss越靠近0,代表模型的分割性能越好。经过smoothing系数加权的Dice Loss,以下简称Ld,可避免计算过程中分母为0的情况,并可以减少训练过程中的过拟合。Ld的计算公式为

式中:A代表分割结果为阳性的区域,B代表分割金标准中为阳性的区域,S为平滑系数。

使用Ld作为模型损失函数,当出现分割的前景区域过小时,过小的分割误差会导致Ld出现巨大幅度改变,给训练过程带来极大的不稳定性。常用的交叉熵损失函数LCE的计算公式为

在肺结节分割任务中,交叉熵损失会使模型对背景部分产生更多的关注,因为相较于前景,背景区域大许多,对学习效率十分不利,将导致模型不收敛。本文使用Ld和LCE的联合函数L作为模型的总损失函数。

式中:λ代表Ld和LCE的占比,本文取λ=0.5。

1.5 评价指标

为了评价模型预测结果的好坏,本文采用Dice系数D作为训练的评价指标,其计算公式为

此外,为了更好地对预测结果进行评价,本文还引入了参数Precision(P),表示在模型预测是Positive的所有结果中,预测正确的比重;Recall(R),表示所有样本的正例中,模型被预测正确的比重。

2 实 验

2.1 实验环境与数据集

本文的实验使用Tesla V100服务器显卡进行训练,所使用的深度学习框架为Pytorch 3.6。所有的实验都在此环境下进行训练。

本文选用公开的LIDC-IDRI(The Lung Image Database Consortium)数据集。该数据集有1 018例CT,排除了截面厚度为3 mm以上的病例以及其他质量较差的病例,最后筛选出888例可供使用的病例。

实验的对比网络模型采用了U-Net、SegNet和Attention U-Net的3D结构模型。本文使用相同的裁剪与缝合方法,将888例数据中的700例作为训练集,88例作为验证集,100例作为测试集,初试学习率均为0.001,训练轮数为200 epoch。

2.2 肺实质尺度下的结节分割实验

表1为肺结节分割实验的相关数据。其中,DICE、P、R指标均为各模型下进行5次实验后所取的平均值。

表1 肺实质尺度上的对比模型分割数据

实验中,模型输入均为32×32×32的结节立方体,由一副完整的CT裁剪而来。其中所有结节立方体均含有结节体素。

2.3 实验结果分析

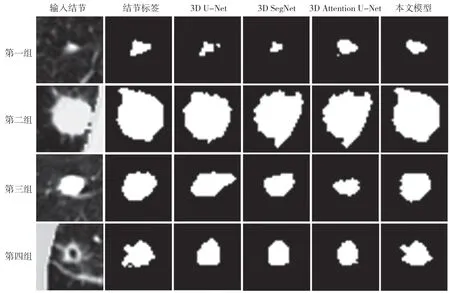

图2为肺结节分割实验中,模型输入、结节标签、对比模型分割结果和本文所提出GMUNet的分割结果图。因为肺结节占整副CT的比例很小,故放大结节区域作为对比显示,均取缝合后的结节中心Z轴切片展示。从第一组图可以看到,对于直径较小的结节,由于前背景不平衡过大,U-Net、SegNet、Attention U-Net模型均对结节有欠分割或过分割现象,本文模型所预测的轮廓模型最接近真实标签。第二组图,结节直径较大,此种情况对分割模型的边缘计算性能有很高要求。可以看到,U-Net对于结节左上方的细长突出部分分割不准确,欠分割;SegNet、Attention U-Net则在结节下方过分割,且结节边缘有明显的畸变;本文提出的模型不仅准确分割出了结节左上细长部分,且对结节轮廓保持了较好的分割性能。第三、四组图分别是血管粘连型结节与空洞型结节,本文模型以及所对比模型均未对血管以及空洞部分进行过分割,可以看出,3D模型有效地利用了结节的空间信息,做出了准确分割,并且可以很明显看出,本文提出的模型最接近于结节标签。

图2 肺结节轮廓分割结果图

通过实验可以看出,本文结合U-Net结构、多尺度特征提取、GAU及Gateunit,捕捉深层次的语义信息,同时对输入进行三维池化和多尺度特征提取,结合3D模型结构,对结节的空间信息进行了充分利用,显著提高分割了性能。

3 结 语

本文基于改进的3D U-Net提出了肺结节分割的3D网络模型,采用了多尺度的特征方法以综合考虑局部信息和全局信息,所添加的全局注意力上采样模块能够最大限度地适应不同尺寸的特征映射;解决了空间信息在编码器自上而下的结构中会逐步丢失的问题,采用一种空间注意力机制来逐步抑制不同特征尺度的不相关背景信息,将注意力集中在前景之中。通过实验数据与对比图可以发现,所提出的模型对小尺寸结节、大尺寸结节、血管粘连型结节、空洞型结节的分割表现都优于其他对比模型,取得了更好的精度,证明了所提方法的有效性。