基于深度学习网络TAST用于CT图像上身体成分的分割分析

殷露宴,陈海军

1.齐齐哈尔医学院医学技术学院,黑龙江齐齐哈尔,161006;2.黑龙江省医院CT室,黑龙江哈尔滨,150036

0 引言

近年来,随着计算机技术的飞速发展以及医疗设备和成像技术的不断进步,人们对人体内部结构的了解越来越深入。计算机断层扫描(CT)检查能够精确地测量身体成分[1],并且医生在进行临床诊断时可以借助Sliceomatic[2]等分割软件。然而受到各种复杂因素的影响导致分割效果不尽如人意,如手术后器械伪影[3]、皮下软组织肿胀[4]和外伤积气[5]等。传统的基于人工特征的方法存在一定局限性[6],比如手工分割费时费力,并且很难保证有效性。此外,这些方法通常只适用于特定场景,例如患有肌少症的受检者[7-8]。因此,如何从复杂情况下的医学影像中提取出有用的信息是目前研究人员面临的一个重要问题。

我们开发出一种基于三注意力Swin Transformer(Triple Attention Swin Transformer,简称为TAST)的自注意力神经网络,实现在复杂情况下胸腹部的皮下脂肪层、肌肉及肌内脂肪组织的自动分割。TAST是一种基于深度学习架构、利用三注意力机制来捕捉图像中的先局部后全局特征的算法。Swin-Unet[9]网络模型架构是基于Transformer的U-Net形的医学图像分割网络,因此本文会将其与我们所开发的深度学习网络进行对比实验。

1 资料与方法

1.1 一般资料

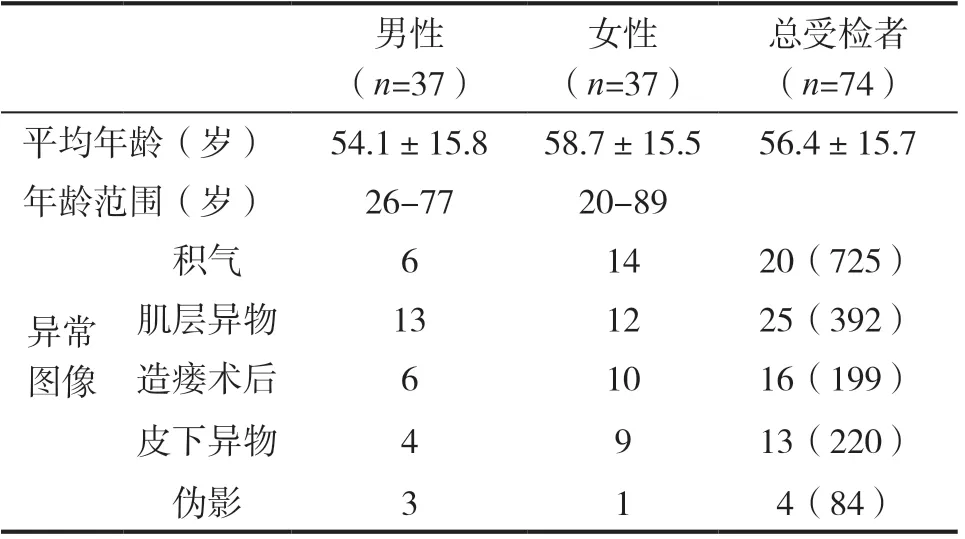

回顾性研究数据来自黑龙江省医院,检索2021年3月至2022年3月期间进行的所有胸腹部非增强CT扫描。纳入标准:扫描层厚和间距为5mm,图像包含伪影、软组织肿胀、造瘘和积气等异常情况。排除标准:非64排联影CT仪器。随机选择了74位受检者(37名女性和37名男性),获得1620张CT图像,如表1所示。考虑临床上复查意义,我们不拒绝同一患者在不同时间段进行CT扫描检查的数据纳入,其中有4位患者在不同时间段的检查被纳入。为了评估我们的自动化方法的泛化能力,在CHAOS多脏器增强CT分割数据集[10]上进行分割。

表1 数据集的患者特征

1.2 数据集准备

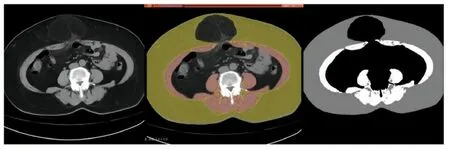

五折交叉验证法将数据划分为训练集(1296张)和测试集(324张)。注意皮下脂肪的分割需要将皮肤层排除,确保皮下脂肪分割的准确性,如图1所示。使用翻转和剪裁的方式进行数据增强,有助于防止记忆训练数据。使用PyTorch 1.9.0、Python 3.8、Cuda 11.1进行算法训练。

图1 腹部造瘘分割效果图

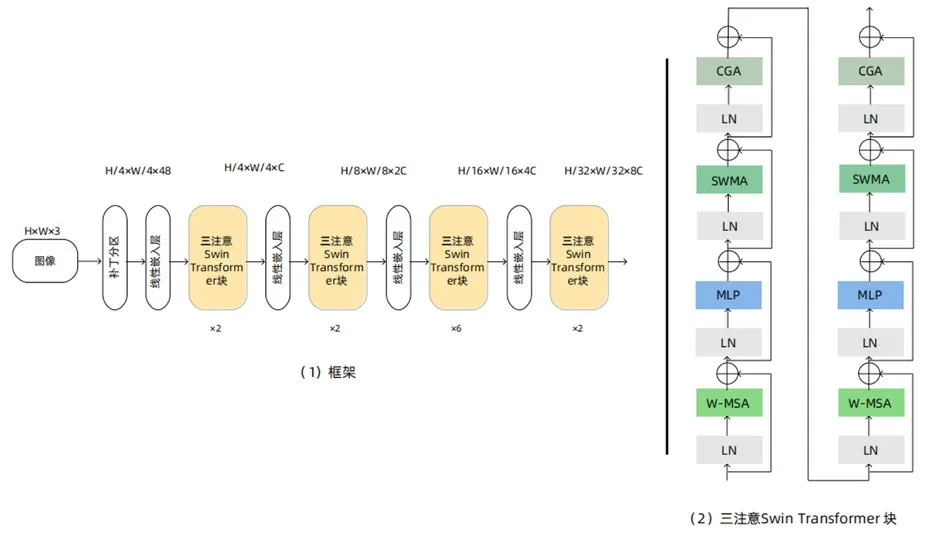

1.2.1 模型

模型分五个阶段,先通过尺寸为4的卷积层将输入图像切割成不重复的块,并到嵌入层将尺寸转变为48。再通过线性嵌入调整通道数,之后阶段均由补丁合并层和多个三注意力Swin Transformer块组成。其中补丁合并层进行下采样,三注意力Swin Transformer块具体结构如图2右边所示,主要组成是层归一化、空间窗口注意力、通道注意力、窗口注意力、翻转窗口注意力和多层感知机。

图2 TAST 的总体结构图

窗口注意力将计算限制在每个窗口内,计算中加入相对位置编码。对于翻转窗口注意力,设置合理的矩阵将翻转窗口注意力与窗口注意力具有相同的窗口个数以达到等价的计算结果。空间窗口注意力和通道注意力从两个正交的角度进行自注意力:一是对空间的块进行自注意力,此时空间维度定义了块的数量,而通道维度定义块的特征大小;二是对通道的块进行自注意力,通道维度定义块的数量,而空间维度定义块的特征大小。该两种注意力能够实现互补:空间窗口注意力能够提取窗口内的局部特征,而通道组注意力能学习到全局特征,这是因为每个通道的块在图像空间上都是全局的。

1.2.2 分割性能评价指标

对TAST生成的分割结果与Swin-Unet进行了比较。使用Dice评分和Jaccard评分,公式如下:,,其中x、y分别表示标签和预测结果。

2 结果

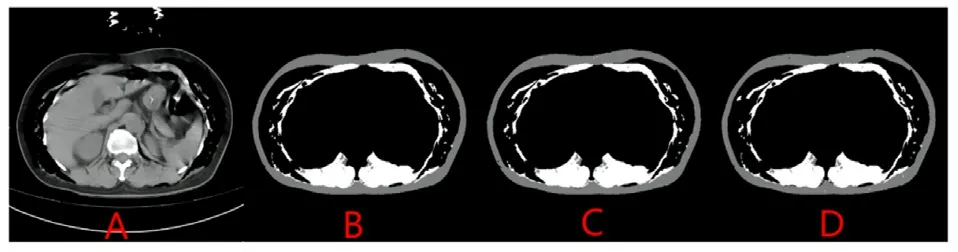

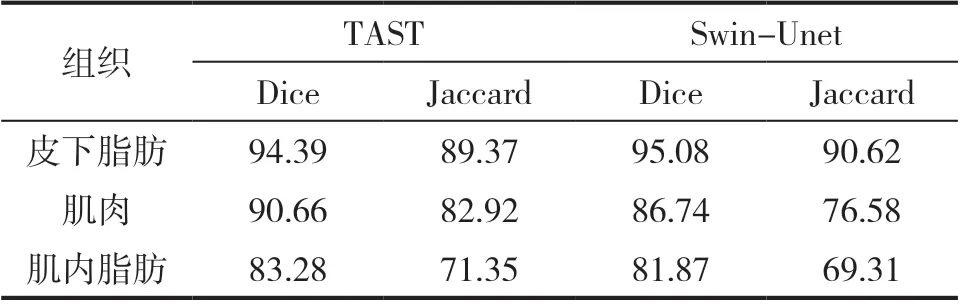

图3所示TAST算法提高了在复杂情况下对身体成分的精确分割。表2所示Dice和Jaccard在皮下脂肪组织评分最高,分别为94.39和89.37,而肌内脂肪组织评分最低,分别为83.28和71.35。

图3 分割效果示意图

表2 TAST 与Swin-Unet 分割效果

3 结论

针对当前由于造瘘术、伪影和积气等原因导致分割软件对于胸腹部身体成分的分割并不理想的情况下,我们提出三注意力Swin Trans former。将翻转窗口注意力、空间窗口注意力以及通道组注意力融合形成新的模块。先进行局部学习,再进行全局特征学习去捕捉图像中的高级特征,能够最大限度地挖掘数据信息。

本文所提出的TAST网络结构目的在于学习更多的数据信息,在Swin Transformer网络架构的基础上增加了注意力,导致算法的复杂度增加。本实验仅纳入了CT的研究数据,MRI能够更好地展现身体的成分,我们仍然需要开展更为深入的工作,并开发出更多高效的算法模型去解决临床问题。