冷连轧轧制力深度神经网络模型泛化能力并行优化

吴 爽,闫 奕,李 爽,李 峰

(1.南阳职业学院计算机与信息工程学院,河南南阳 474550;2.南阳职业学院,机械与汽车工程学院,河南南阳 474550;3.河南理工大学机械与动力工程学院,河南焦作 450000)

1 引言

冷连轧处理时构建的轧制力模型是冷连轧系统实现轧制控制功能的基础,对于保证轧制控制精度以及减少生产成本存在积极作用,并对轧制状态具有显著影响[1−3]。目前,针对冷连轧生产过程构建的轧制力模型主要包括Siemens、Stone 与Hill 等类型,以上模型通常都是根据冷轧带钢塑性变形机制进行解析的结果[4−6]。进行建模与求解的时候需要设置多种假设条件,实际得到的模型结构也较简单,并且随着连续轧制时间的增加,各项工艺参数也会逐渐改变,受以上不确定因素的影响会引起传统轧制力模型精度发生下降的现象,从而引起误差的增加,在实际生产阶段造成波动变化的板形厚度,并且需要经过更长时间完成自适应过程,不能同时适应高效率、多品种与高精度的轧制要求[7−10]。

相关方面的研究吸引了很多研究学者。文献[11]在半监督深度网络基础上构建了轧制力预测模型,通过测试发现该模型可以获得3%以内的预测精度,由此达到准确预测轧制力的功能。文献[12]则利用极限学习机(ELM)方法建立了轧制力仿真模型,之后利用从现场采集获得的数据完成上述网络的训练,可以达到不超过10%的轧制力预报误差,并使钢板头部区域的厚度命中率增大了近2%。文献[13]通过激活函数构建神经网络模型并完成了平整机轧制力预测功能,采用上述模型可以使预测误差达到10%以内,可以满足各输入参数下进行平整机轧制力预测的要求。

进行冷连轧处理时,为调控板厚参数,需对轧制力进行预测并调整冷连轧负荷分布状态,可以通过构建神经网络轧制力分析模型来获得更高预测精度,增强了冷连轧模型的控制效果。这里选择2030冷连轧结构进行研究,对多输入多输出(MIMO)深度神经网络进行预处理,同时针对多线程CPU与GPU实施了优化,同时对比了神经网络模型和冷连轧系统Siemens模型误差。

2 数据预处理

这里构建的神经网络轧制力模型是利用5机架2030冷连轧系统变量对轧制力进行预测,之后跟机架实际测试得到的轧制力实施了对比,由此实现将神经网络应用于函数逼近的过程,可将其看成是输入与输出变量间的非线性映射形式。神经网络模型从生产现场采集原始数据作为样本,由于现场数据采集过程受到工况、人为因素、测试仪器运行状态的综合影响,从而引起噪声、测试误差以及收集结果偏差的情况,形成离群参数与线性相关变化规律,并且现场输入输出参数都存在实际物理意义,各数据间存在很大的绝对值差异,此时应采用归一化方法完成数据处理后,使输入输出结果介于[−1,1]区间内。

3 深度神经网络模型

以归一化方法处理得到2030冷连轧1−4机架中的22个输入变量,同时输出1−4机架轧制力预测结果,以1−4机架运行过程测试得到的轧制力作为目标值,总共包含三层隐含层,各隐含层将节点数设定在(16~64)范围内并对其进行循环处理,将输入层直接转移至隐含层,后续隐含层之间通过ReLU()函数进行激活。利用BP算法完成深度神经网络的前期训练过程[14−15],该算法从收敛效果、泛化性能以及CPU与GPU优化计算方面分析都比缩放共轭梯度法与L−M数值优化算法更强。以下为SCG与L−M算法的具体原理。

在SCG算法中,以w表示BP神经网络连接权值与阈值组成的空间集,BP算法搜索计算式为,n表示迭代的次数,相邻搜索方向呈现共轭的特征。选择第一步搜索方向作为负梯度方向,将其表示成d(1),对应的学习速率存在以下关系:

在第一步迭代基础上,建立第二步迭代方向:

以下为网络权值的修正参数:

式中:(1)—共轭因子,计算流程如下:

进一步推断出第n+1步迭代方向:

修正后的网络权参数如下:

L−M算法属于一类“信赖域法”,其具备梯度法与牛顿法的共同优势。本实验选择MATLAB2018b系统平台并通过DeepLearn⁃ing 训练神经网络模型,该系统中存在两个Intel(R)XEON(R)CPU2.60Ghz处理器以及能够实现GPU运算功能的NVIDIAK620图形工作站,通过并行计算以及GPU优化的方法使运算速度获得显著提升,使训练、验证以及测试时间都大幅缩短。

4 结果分析

4.1 泛化能力

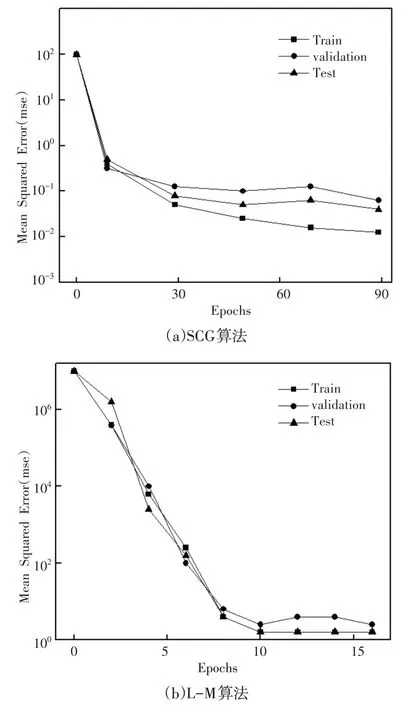

利用多CPU 线程优化方式时,采用包含二个隐含层的神经网络结构,当隐含层节点数介于(22~36)之间时,得到泛化测试收敛过程结果,如图1所示。

图1 泛化测试收敛过程Fig.1 Generalizes the Test Convergence Process

由图1可知:以二种算法对神经网络模型进行训练时表现出了相近的验证性能。以L−M算法得到的结果为0.217,以SCG算法得到的结果为0.246。分析SCG与L−M算法训练结果可知,L−M算法表现出了更优的收敛稳定性、测试和验证性能、梯度下降趋势,并且收敛速度也更快。

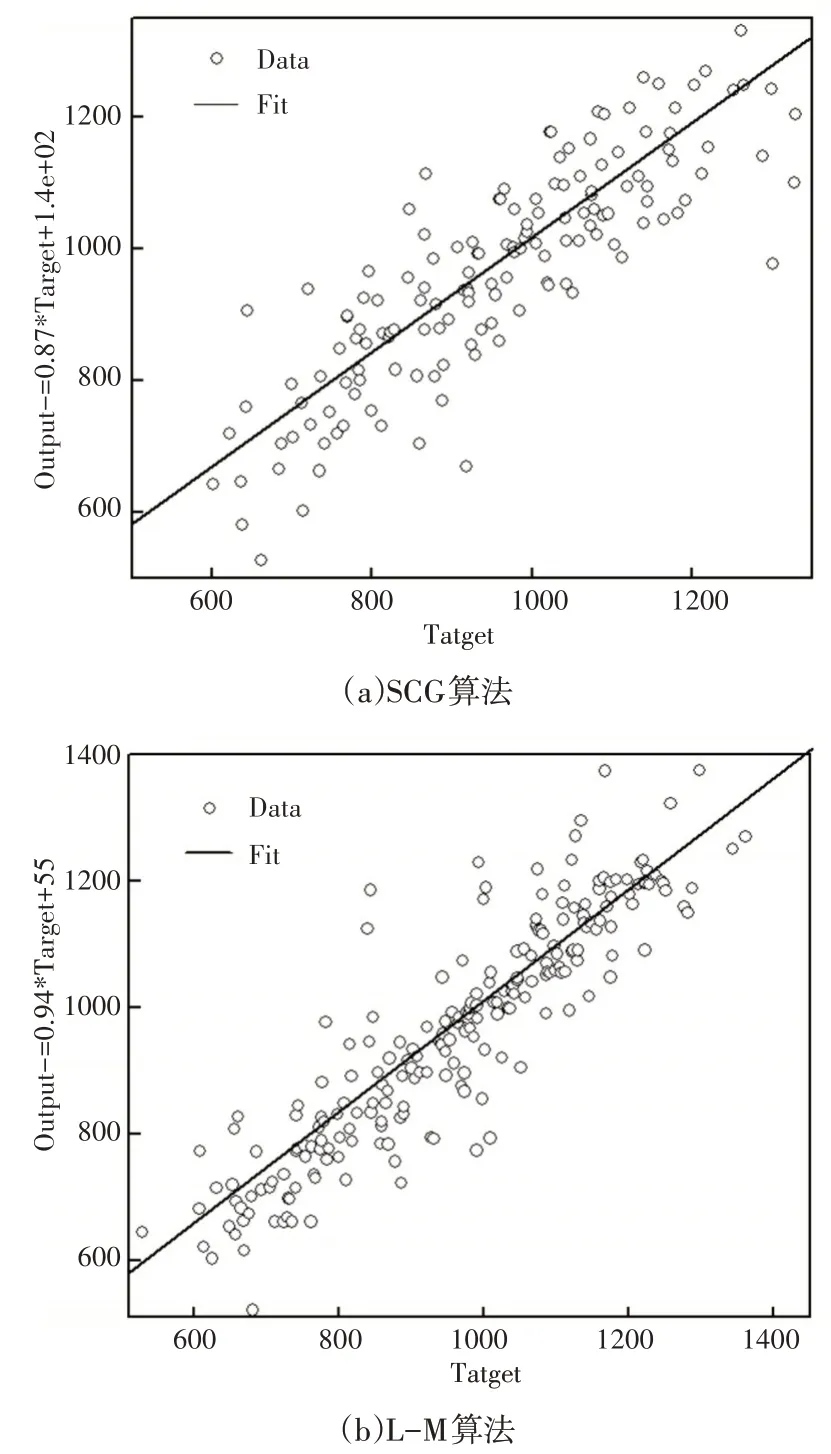

以随机方式选择180个数据并测定泛化性能,得到的结果,如图2所示。由图2可以看到,L−M算法获得了比SCG算法更大的相关系数。在多CPU 线程优化训练网络模型时,L−M 算法具备更强的并行处理能力,这加强了其搜索异常数据的能力,更易得到最优解集的范围。

图2 泛化测试线性相关系数分布Fig.2 Distribution of Linear Correlation Coefficient of Generalization Test

4.2 隐含层数分析

以SCG算法进行训练的时候,当神经网络模型中包含二个隐含层时,相对包含一个隐含层的神经网络模型获得了更小的均方差,当包含三个隐含层时均方差发生了进一步降低。其中,隐含层节点数介于(16~64)之间时,隐含层数量为3的神经网络模型达到了(0.839~0.942)的相关系数,相对一个与二个隐含层条件下的相关系数更小。以L−M 算法进行训练时,表现出了与SCG算法基本一致的隐含层数影响性能。不管是SCG算法还是L−M算法,都是随着隐含层数的增加,获得了性能更优的神经网络模型,并且都会增加训练时间。从各项模型指标分析,L−M算法都比SCG算法的性能更优。

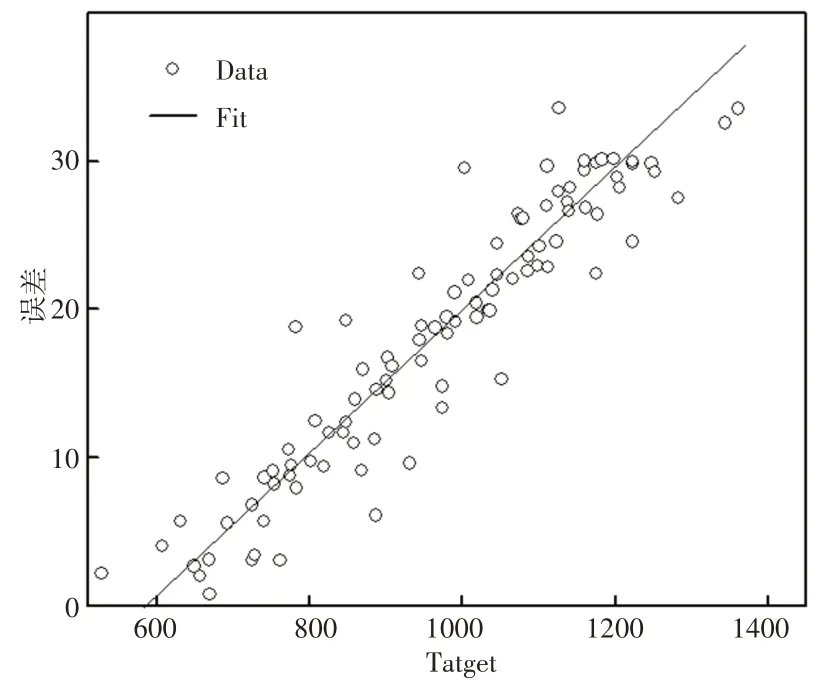

4.3 实用性分析

为了对这里模型进行实用性验证,把选择得到的测试集代入轧制力机理模型中测试计算结果,再跟现场实际测试得到的轧制力进行对比,计算得到图3中的误差数据,这里构建的神经网络轧制力模型总共包含二个隐含层、节点数介于(17~30)、通过L−M算法进行训练;以Siemens模型作为轧制力机理模型,按照随机方式选出115个测试数据。

图3 误差结果统计Fig.3 Statistics of Error Results

由图3可以发现,采用神经网络轧制力模型得到的结果与实测值之间的误差比Siemens机理模型和测试值的误差更低。神经网络模型训练过程的数值类型默认为双精度,相比较传统单精度,可大幅度缩短训练耗时和计算耗时,训练耗时是秒级,计算耗时是毫秒级,表明神经网络模型可用于在线使用,具有在线自调整和自学习功能。

5 结论

(1)L−M算法表现出了更优的收敛稳定性、测试和验证性能、梯度下降趋势,并且收敛速度也更快。以随机方式选择200个数据并测定泛化性能测试得到,L−M算法获得了比SCG算法更大的相关系数。

(2)都是随着隐含层数的增加,获得了性能更优的神经网络模型,并且都会增加训练时间。从各项模型指标分析,L−M算法都比SCG算法的性能更优。

(3)这里构建的神经网络轧制力模型总共包含二个隐含层、节点数介于(17~30)、通过L−M算法进行训练。采用神经网络轧制力模型得到的结果与实测值之间的误差比Siemens机理模型和测试值的误差更低。