基于注意力机制和多尺度特征的伪装目标检测

蔡俊敏,孙 涵

(南京航空航天大学 计算机科学与技术学院/人工智能学院,江苏 南京 211106)

0 引 言

在计算机视觉领域,目标检测一直是一个非常热门的课题,各种各样的目标检测模型层出不穷,并不断刷新各个性能榜单。在Zhao等人的研究[1]之后,可以将目标检测大致分为三类,分别是:显著性目标检测、通用目标检测和伪装目标检测。显著性目标检测旨在识别图像中最引人注目的目标,并对它们的轮廓进行分割。通用目标检测往往伴随着语义分割或者全景分割等任务,需要在识别图像中目标对应的区域,并且为之分配可能的标签和相应的分数。而伪装目标检测则要求识别图像中被隐藏的目标。伪装目标是指目标自身的形状、纹理或者颜色特征等特性导致其与周围的背景相近的物体。其中伪装目标检测由于目标和其背景具有高度相似性,所以检测起来更加困难。

伪装图像大致可分为两类,天然伪装和人为伪装的图像。昆虫、头足类等动物的天然伪装是一种可以避免被天敌察觉的生存技巧。而人为伪装通常被应用于视频检测过程;还会出现在产品制造的时候(即产品瑕疵检测);也可以用于游戏或艺术中帮助隐藏信息。

与类别相关的语义分割任务不同,伪装目标检测任务与类别无关。伪装目标检测的任务简单且易于定义。给定一张图像,该任务需要一个伪装目标检测算法来为每个像素i分配一个置信度Labeli∈{0,1},其中Labeli表示像素i的概率值。0表示该像素不属于伪装目标,而1表示该像素完全属于伪装目标。

在伪装目标检测领域,如何利用提取到的特征来区分伪装目标和背景是一个至关重要的问题。为此,文中提出了基于注意力机制和多尺度特征的伪装目标检测算法,该算法主要由两部分组成:混合尺度解码器(MSD)和注意力引导模块(AG)。混合尺度解码器对多尺度特征进行解码得到伪装目标的初步检测结果,之后引入反向注意力机制得到最终的伪装目标检测结果。

该文的主要贡献如下:

(1)提出了基于多尺度特征的伪装目标检测算法,通过提取到的多尺度特征有效区分伪装目标和背景。

(2)设计了混合尺度解码器和注意力引导模块,通过级联的特征融合单元对多尺度特征进行解码,之后引入反向注意力机制得到最终的伪装目标检测结果。

(3)在COD10K这一数据集上与十三个经典的深度学习方法进行比较,证明了该方法的有效性。

1 相关工作

1.1 传统的伪装目标检测算法

在传统的伪装目标检测算法中,大部分方法都是基于图像的低级特征以及一些人为设计的特征(例如图像的纹理、色彩、亮度、强度)。Galun等人[2]以纹理分割技术为基础来检测伪装物体。鲜晓东等人[3]借助图像的颜色和纹理信息实现伪装目标检测。周静等人[4]提出基于光流场分割的伪装运动目标检测方法,面对更加复杂的场景,这些方法在性能和泛化性上还有待提高。

1.2 基于神经网络的伪装目标检测算法

近年来,卷积神经网络的发展给目标检测带来了很大的提升。基于神经网络的深度学习方法主要分为三类:结合上下文信息的伪装目标检测模型、结合注意力机制的伪装目标检测模型和结合边缘信息的伪装目标检测模型。

大多数模型致力于挖掘图像特征的上下文信息以提升模型的性能。Le等人[5]提出了一个端到端的神经网络——Anabranch Network。该网络结合了多任务的学习框架,将图片分类和图像分割整合到一个模型中。Zheng等人[6]提出了一个密集的反卷积网络。为了能够有效地提取高级特征中包含的丰富的语义信息,该网络采用短连接的方式融合多尺度的高级特征。Fan等人[7]受动物的捕食过程(先发现猎物,再确定猎物的具体位置)所启发,提出了SINet。SINet由搜索模块(SM)和识别模块(IM)组成,搜索模块通过多个感受野(RF)组件来模仿人眼感知系统的感受野。

近些年来,引入注意力机制来提升伪装目标检测性能的方法也有很多。在显著性目标检测方面,Zhao等人[8]提出的PFAN模型认为分辨率较大通道数较少的低级特征图保有丰富的细节和结构信息,适合采用空间注意力加以过滤不需要的空间信息,而分辨率较小通道数较多的高级特征图具有丰富的语义特征,适合采用通道注意力来选取有效的语义信息。Chen等人[9]提出的 RANet则设计了反注意力模块,通过擦除每个侧输出特征中的当前预测区域来引导整个网络顺序发现互补对象区域及细节。

将这些方法迁移到伪装目标检测方向,Sun等人[10]的C2F-Net借助注意力引导的跨级融合模块,将多级特征与信息注意系数相结合。

对于边缘信息,许多研究证明了边缘检测在一定程度上可以促进伪装目标检测性能的进步。在显著性目标检测方面,Zhao等人[11]提出的EGNet将提取的显著目标结构特征和显著目标边缘特征两个部分相结合,来提升显著目标的检测效果。伪装目标检测作为与显著性目标检测相似的任务,同样可以借鉴。Ji等人[12]提出的ERRNet利用了边缘信息,旨在对生物的视觉感知系统进行建模并实现有效的边缘先验和潜在伪装区域与背景之间的交叉比较。

2 网络结构

2.1 模型网络结构

网络的整体结构如图1所示。主要由两部分组成:混合尺度解码器和注意力引导模块。

图1 网络结构

2.2 混合尺度解码器

(1)

通过四个级联的特征融合单元和几个卷积层,组成基于多尺度特征的混合尺度解码器,得到一个单通道的映射图。最后通过sigmoid函数得到初步的检测结果M6并输出。

2.3 注意力引导模块

在得到伪装目标的粗略位置之后,设计了基于反向注意力机制的引导模块,通过擦除前景目标的方式逐步挖掘伪装区域。为了节省计算资源,该文选择对三个高层特征的输出分支进行引导。如图1所示,从解码器得到的粗略伪装图M6开始,通过从旁路输出特征中擦除当前预测的伪装区域,引导整个网络逐步地发掘补充的目标区域和相关细节。首先对得到的初步伪装图像M6做计算得到反向注意力权重Ak,然后借助该权重引导网络挖掘有效的伪装区域。受文献[13]启发,文中对特征进行切片化处理,能够更加高效地利用之前得到的反向注意力权重。如图3所示,切片化处理的具体过程可以通过以下的式子表示:

图3 切片化处理

stepII:FC({p(k,1),Ak},…,{p(k,gk),Ak})→qk

(2)

式中,FS、FC分别表示通道分割和通道连接函数,qk表示加入反向注意力引导之后的特征。

3 实验结果与分析

3.1 实验数据集

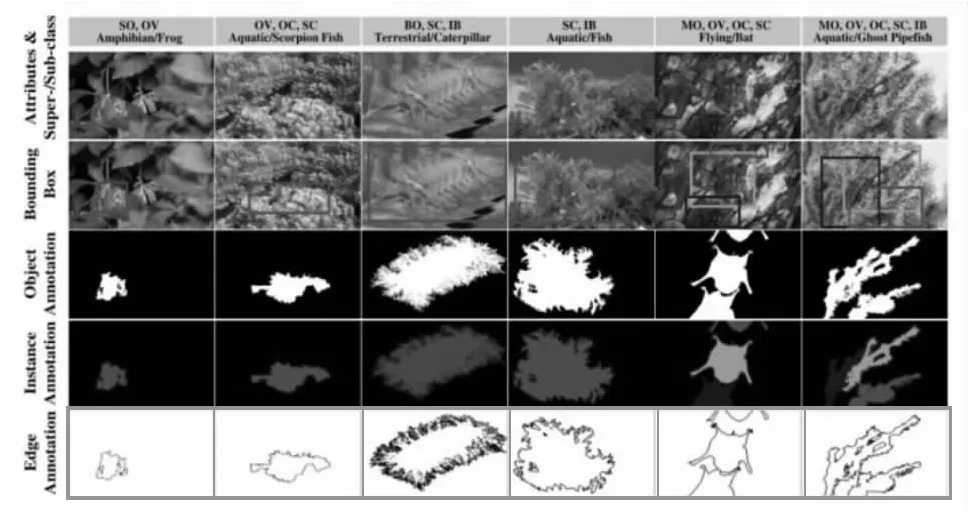

该文提出的算法所采用的训练集为COD10K+CAMO,训练完成之后在COD10K的测试集上做测试。CAMO数据集是Le等人[5]提出的伪装目标数据集,一共包含2 500张图像,其中2 000张图作为训练集,500张图像作为测试集,涵盖了八个类别。COD10K是Fan等人[7]提出的一个大型伪装目标数据集,一共包含10 000张图像,其中6 000张图像作为训练集,4 000张作为测试集。这10 000张图像划分为10个超类和78个子类,包括水生、飞行、两栖和陆地等等。此外,该数据集还对伪装图像提供了丰富的标签,包括目标类别、边界框、对象级标注、实例级标注和具有挑战性的属性,如图4所示。

图4 COD10K数据集示例

3.2 实验细节及超参数设置

文中提出的算法以Res2Net50[16]为骨干网络,并使用在ImageNet训练好的权重进行初始化。模型的训练集采用CAMO+COD10K,一共是4 040张图像。在模型输入端,统一将输入图像调整为352×352。在模型训练过程中,使用Adam优化器进行训练。批处理大小设置为32,学习率从1e-4开始,每50个epoch除以10。整个训练过程共有100个epoch。GPU为Tesla V100。

3.3 性能比较

本节将所提算法与13个经典的深度学习模型进行性能比较,包括FPN[17]、MaskRCNN[18]、PSPNet[19]、Unet++[20]、PiCANet[21]、MSRCNN[22]、PFANet[8]、CPD[23]、HTC[24]、EGNet[11]、PraNet[25]、SINet[7]和SINet-V2[13]。由于伪装目标检测是一个新兴的领域,因此部分深度学习模型的原本目的是应用于显著性目标检测,其中PraNet、SINet和SINet-V2是直接针对伪装目标检测的模型。关于这些对比模型的性能指标,主要来自文献[13]。

3.3.1 定量分析

表1 在COD10K测试集上的性能比较

尤其是与SINet-V2(目前最好的伪装目标检测模型)相比,E-measure、F-measure分别增长了0.010(1.1%)、0.024(3.5%)。MAE下降了0.005(13.5%)。

3.3.2 定性分析

为了更直观地比较所提模型和其他经典的深度学习方法,文中还进行了一系列和其他经典深度学习方法的视觉对比实验,并提供可视化展示。由于篇幅有限,本节只列举了在COD10K测试集上同SINet、SINet-V2(分别是2020年的SOTA方法和2021年的SOTA方法)两个经典模型的比较,这两个模型的预测图是根据开源的代码重新训练和测试生成的,如图5所示。

图5 与两个经典模型的可视化比较

从整体来看,文中所提出的伪装目标检测算法相比这两个经典方法识别效果更佳,识别出的伪装目标更加准确,更加完整,更符合对应的真值图像。具体地说,从前三列图像中可以看出文中提出的模型输出的检测结果几乎与对应的真值图像完全一致,而另外两个模型对于伪装目标的检测效果都有一定的缺失,对伪装区域均存在误判的情况。对于第四、五、六列的输入图像,尽管SINet和SINet-V2也能识别到大致的伪装区域,但伪装目标的完整性以及边界细节均不如文中所提出的算法。总的来说,无论是在整体的目标区域还是边界细节方面,文中所提出的算法相比较其他的模型均能更准确地识别到伪装目标。

另外,针对Flying子集和Amphibian子集中普遍存在的小目标场景(第七、八、九、十列),文中提出的算法能够精确地识别出伪装目标,而另外两个模型都存在被图像中的其他目标所干扰的情况,说明文中提出的混合尺度编码器能够有效地组合多尺度特征,提升模型对较小伪装目标的识别效果。

3.4 消融实验

本节进行消融实验,通过分离各个子模块,分别验证文中所提模型中各个模块的有效性。具体结果如表2所示。其中Baseline表示使用相邻连接解码器对特征编码器进行解码,+MSD表示仅加入混合尺度解码器,+AG表示仅加入注意力引导模块,MSD+AG表示既加入混合尺度解码器,也加入注意力引导模块。实验结果表明,文中提出的混合尺度解码器和注意力引导模块可以有效提高模型的检测精度。尤其是注意力引导模块,通过引入反向注意力机制,可以引导网络有效地挖掘潜在的伪装区域,从而提升模型对伪装目标的检测效果。

表2 在COD10K测试集上的消融实验

另外,还探究了注意力引导模块中多阶段细化中不同阶段切片化大小对模型效果的影响,主要探究不同阶段基于统一策略和基于渐进式策略的方法。{*,*,*}表示从第一个切片化处理到最后一个切片化处理时的不同切片大小,如{32,8,1}表示三个阶段的切片化处理分别将候选特征pi沿通道维度分成32片、8片和1片。如表3所示,相比较其他方案,基于渐进式策略的方法性能更优。因此,在文中的其他对比实验中,均采用渐进式策略的方法。

表3 注意力引导模块中不同切片化策略的影响

4 结束语

针对伪装目标结构多样、尺度不一和目标边界与其背景具有高度相似性的情况,提出了一种基于注意力机制和多尺度特征的伪装目标检测算法,通过混合尺度解码器和反向注意力模块,提升了模型的检测性能。借助四个评估指标将文中算法与现有的十三种算法在COD10K数据集上进行测试,结果表明文中算法具有更好的性能,可获得识别位置更准确、边界细节更完善的伪装目标检测结果。