知识图谱补全技术研究综述

吴国栋,刘涵伟,何章伟,李景霞,王雪妮

(安徽农业大学 信息与计算机学院,合肥 230036)

1 引 言

自Google于2012年5月首先提出了知识图谱(knowledge graph)[1]概念以来,知识图谱在搜索引擎[2]、问答系统[3,4]、对话系统[5]、推荐系统[6,7]、知识推理[8,9]、实体对齐[10]、事件预测[11,12]等方面都有着良好的表现.知识图谱是一种有向异构信息网络,含有丰富的实体、概念及其之间的各种语义关系[13].知识图谱(KG)正成为实现人工智能(AI)的首要驱动力.与人脑一样,KG将成为机器的大脑,这些机器可以相互连接,执行认知推理,最重要的是,可以从大量异构数据中获取见解.许多KG构建于AI相关应用中,例如,推荐系统、问答、语义搜索和排名和阅读理解[14].从广义上来说,知识图谱是将现实世界中的概念,实体和相互关系用结构化形式表述出来,通过学习人类认识世界的方式,增强互联网对海量信息的管理、组织和理解能力.知识图是事实的结构化表示,由实体、关系和语义描述组成.实体可以是现实世界中的对象和抽象概念,关系表示实体之间的关系和实体的语义描述,它们的关系包含定义明确的类型和属性[15].知识图谱主要由实体节点和实体间关系组成,由实体-关系-实体来构成最基本的三元组结构,通过目标函数将实体和关系分别以低维的向量来表示.Trans系列的知识图谱表示方法均采用同样的函数思想,Trans方法主要有TransE、TransH、TransR、CtransR、TransD、TransA以及TransG等.

随着网络容量的爆炸式增长,传统知识图谱的缺点也逐渐暴露出来,首先是计算效率的问题.在使用知识图谱计算实体之间的语义关系时,通常需要设计一种特殊的图算法来实现.然而,该图算法计算复杂度高,可扩展性差.当知识图达到较大规模时,很难满足实时计算的需要.其次是数据稀疏性问题.与其他大规模数据一样,大规模知识图也面临着严重的数据稀疏问题,这使得实体的语义或推理关系的计算极不准确.为了应对这些挑战,知识图嵌入技术被提出并引起了人们的广泛关注,因为它能够将知识图嵌入到稠密的低维特征空间,并且能够有效地计算低维空间中实体之间的语义关系,有效地解决计算复杂性和数据稀疏性问题[15].

知识图嵌入的关键思想是在连续向量空间中嵌入包含实体和关系的知识图谱组件,以简化操作,同时保留知识图谱的固有结构.这些实体和关系嵌入可以进一步用于各种任务[16].

知识图谱虽在现代科学中起着越来越重要的作用,但一个数据丰富且准确的知识图谱其建立过程需要大量的技术甚至人力,多数知识图谱在建立后仍然存在着内容不够完善的问题,知识图谱补全技术就是为了通过算法来对图谱补充新的知识,从而减少构建知识图谱所需的人工成本.

知图图谱(KG)包含大量的事实三元组(头实体、关系、尾实体),广泛应用于许多领域,如电子商务、金融和社交网络.由于知识图通常是不完整的,手动查找所有事实三元组的成本很高,因此如何自动执行知识图补全(KGC)备受关注[17].

知识图谱补全技术(knowledge graph completion)是知识获取中的一个重要的应用,现阶段知识图谱的补全方式主要依靠通过实体和关系的低维嵌入,对知识图谱中的实体与关系进行预测.知识图谱往往被定义成(头实体h,关系r,尾实体t)所构成的三元组,知识图谱补全技术就是对这三元组的缺失部分进行补全[18],它能够让知识图谱变得更加完整,虽然人工干预构建出的特征会具有较好的可解释性,但耗费资源太多.与之相比,通过表示学习技术可以自动地根据任务构建特征,但其往往又缺乏可解释性.如何找到更有效的知识图谱补全技术,是一个非常值得研究的课题.

2 知识图谱补全技术相关研究

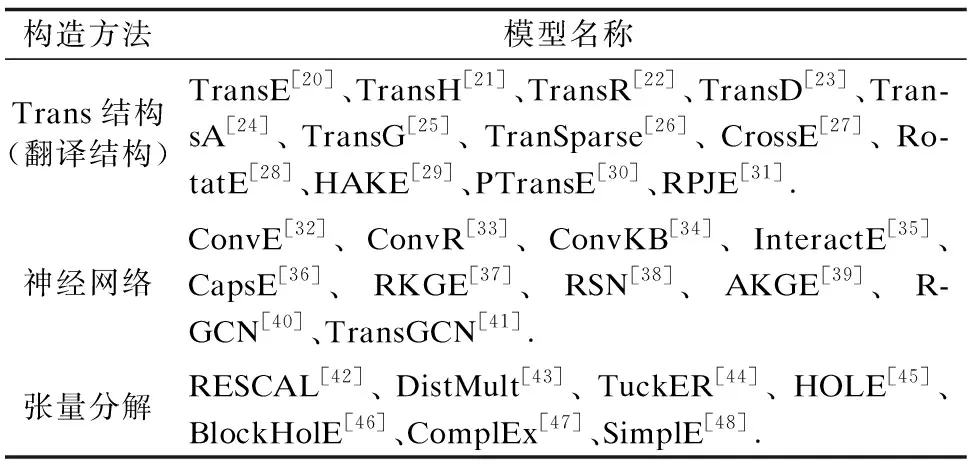

知识图谱补全(KGC)可以解决知识图中数据稀疏的问题.近年来,针对KGC任务提出了大量模型[19],本文从模型构造方法的视角,将已有知识图谱补全技术的相关研究分为Trans结构、神经网络和张量分解3种构造方法.其中TransE模型在链接预测方面表现很好,并且参数少、操作简单;但TransE 方法在处理复杂关系方面,准确度较低,如在处理一对多、多对一、多对多和自反等复杂关系时,TransE模型难以精准推算出具有相同关系的实体.神经网络模型其结构复杂多样,不同的模型具有不同的特性,但主体上都是通过聚合的方式,来捕捉邻域节点信息.这类模型常会用到多层信息传递,大量的参数加重了模型的训练负担,但模型因加入了非线性计算,能取得较好的预测效果.张量分解模型是通过多维矩阵的组合和计算,来表示三元组内部关系,模型结构简单,计算效率高,在大规模数据计算上也有不错的效果,与Trans模型一样使用线性计算的方式,可以作为解码器来使用,但对复杂的数据关系难以处理,使用时有一定的局限性.

已有知识图谱补全技术的主要研究如表1所示.

表1 知识图谱补全相关模型Table 1 Model about knowledge graph completion

2.1 Trans结构模型的知识图谱补全

2.1.1 多语义环境中Trans结构模型的改进

Trans结构也被人称为翻译结构,最早的Trans结构的模型是TransE[20],模型将知识图谱中的三元组定义为(头实体head,关系标签label,尾实体tail),并简写为(h,r,t).通过三元组向量化,头实体h加上关系r便可得到尾实体t,即h+r=t,这样可以通过一个实体和关系来预测另一个实体,即h+r≈t.

因为TransE模型较为简单,只是三元组内的向量叠加,所以难以处理一对多或多对多的复杂关系.TransH[21]相对于TransE在这一方面做出了改进,TransH同样假设了三元组(头节点h,关系r,尾节点t)其中关系r会对应一个矩阵Wr(可以理解为一种超平面),以矩阵相乘的方式进行投影.但TransH依旧只关注了同一个语义环境下的三元组(投影在同一平面),而TransR[22]则在此基础上将三元组分在不同的实体空间(entity space)和关系空间(relation space)中,并对关系空间中的头尾实体映射一一建立不同的关系向量,从而达到相同的头尾实体在不同的语义环境下会有不同的关系表示.

由于实体在不同语义环境中会有不同的关系,因此在通过头实体和关系预测尾实体时,会产生多种可能结果.CrossE[26]提出了使用交互矩阵,来提取头实体和关系向量对应的语义向量,进而得到相应的尾实体.

2.1.2 复数域上Trans结构模型的扩展

eiθ=cosθ+isinθ

(1)

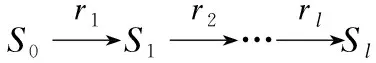

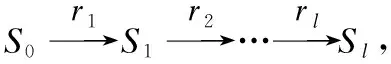

2.1.3 多步路径中Trans结构模型的扩展

ci=f(W[ci-1;ri]),ri∈p

(2)

其中c1=r1,P=cn为最终的关系嵌入.模型使用向量距离差作为评分函数(能量函数),评分函数如公式(3)所示:

E(h,p,t)=‖P-(t-h)‖=‖P-r‖=E(p,r)

(3)

(4)

同样的,利用公式(4)也可以计算出从头实体h到尾实体t的路径可靠度,如公式(5)所示:

(5)

图1 路径可靠性的传播图Fig.1 Propagation diagram of path reliability

2.2 神经网络模型的知识图谱补全

2.2.1 基于卷积神经网络的知识图谱补全

(6)

p=σ(ψr(es,eo))

(7)

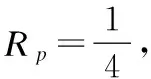

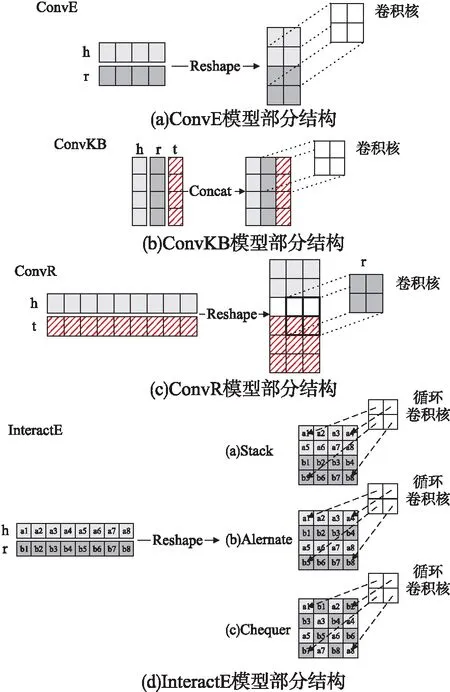

ConvKB[33]则在ConvE的基础上进行了改进,不再是对单个实体和关系的拼接计算,而是将一个三元组看作为整体,拼接为一个三列矩阵作为卷积输入,最后计算评分.将不同的嵌入向量进行拼接(Conact)并重塑(Reshape),虽然让实体关系间产生了交互性,但拼接和重塑都无法保证向量的整体都参与到了交互中,ConvR[32]则是将关系r的嵌入作为卷积核,保证关系和实体之间的交互最大化.

InteractE[34]结合了之前模型的卷积处理方式,通过排列、重塑特征和循环卷积进一步改善卷积神经网络在知识图谱补全上的应用.InteractE提出了3种重塑函数(Reshaping Function):Stack、Alternate以及Chequer.设实体嵌入h和关系嵌入r分别为es=(a1,…,ad)和er=(b1,…,bd),通过重塑函数φ改变张量维度,如公式(8)所示:

φ(es,er):Rd×Rd→Rm×n

(8)

Stack将实体嵌入和关系嵌入重塑并拼接为(m/2)×n的矩阵,单个嵌入重塑为2d=m×n的矩阵,最后拼接重塑后的矩阵.

Alternate采用交替堆叠的方式拼接重塑的矩阵,先将实体嵌入和关系嵌入任重塑为m×n的矩阵,在每行依次交替拼接,可以看作是两种嵌入频率为1的条件下交替出现.

Chequer对实体嵌入和关系嵌入直接拆分为单个单元,再交替堆叠,从而保证重塑的矩阵中不会有相邻的两个相同的嵌入单元.

图2(a)~图2(d)分别为ConvE、ConvKB、ConvR和InteractE 4种模型的卷积操作以及交互方式,三元组(h,r,t)在不同模型下采取了不同的拼接和重塑(Conact & Reshape)策略,其中ConvR模型直接将关系向量作为卷积核,InteractE则采用3种重塑方式进行特征获取.

图2 4种模型的卷积操作以及交互方式Fig.2 Convolution operation and interaction mode of four models

传统的卷积神经网络更多的是应用在图像处理上,原因是卷积核为不可拆分的固定维度张量,但应用于知识图谱上时,输入张量的边角和输入中心区域与卷积核的交互程度产生的差异,会导致卷积神经网络没有均匀地捕捉实体和关系的嵌入特征.InteractE采用了循环卷积运算,卷积核不受边界限制,从而捕捉三元组中更多的特征信息.图3展示了标准卷积和循环卷积的区别.

2.2.2 基于循环神经网络的知识图谱补全

多数知识图谱补全往往针对的是单个三元组的补全,即预测实体间的直接关系,而对实体间的长期关系没有过多的关注.在知识图谱中,实体间存在类似序列的关系,也就是语义信息会沿路径传播,而单个三元组难以包含在路径中传播的语义信息.对于路径关系处理,常用的是循环神经网络(RNN),而RSN[37]将循环神经网络与残差学习相结合,通过随机游走的方式来捕获实体间的长期依赖关系.

常见的RNN循环神经网络[49]分为输入层、隐藏层和输出层3大部分,通常上一次的输出只作为下一次输入的一部分,来确保节点间的语义信息可以有效保存.RNN原理如公式(9)所示:

ht=tanh(Whht-1+Wxxt+b)

(9)

其中ht为当前层的输出,ht-1为上一层的输出,Wh为ht-1的权重矩阵,用来调整上一层信息的占比.xt为当前层的输入,Wx为输入的权重矩阵.

显然,传统的RNN每次都会迭代上一层的信息,但随着层数的堆叠,最早的信息会多次与权重矩阵进行运算,导致信息占比不断减少,对路径语义信息的捕捉效率也不断降低.而且RNN忽略了知识图谱中的三元组结构,只是对路径节点的信息进行捕捉记录.

对于关系路径,往往是一条实体与关系相互间隔排列的路径,也就是说关系路径中的排列元素可能是实体,也可能是关系.RSN结合残差学习的方式提出了跳跃机制,对节点和关系进行区分.对于实体节点的嵌入,RSN不仅将其作为当前层的输出,而且在下一层的关系嵌入中加入实体信息,让实体信息有效参与到神经网络运算中,而这种实体跳跃关系链接的方式就是RSN的跳跃机制.RSN的递归公式如公式(10)所示:

(10)

RSN通过随机游走来对知识图谱进行补全,常见的无偏置的随机游走通过均匀的概率分布选择下一个实体,RSN采用偏置随机游走,利用二阶随机游走的想法,并引入深度偏置来控制采样的路径深度.二阶随机游走与一阶不同的是,一阶随机游走只依赖当前节点,而二阶随机游走会捕捉到当前节点与上一个节点,相对一阶随机游走提高了精度.常规的随机游走[50](Conventional random walks)如公式(11)所示:

(11)

其中ei为随机游走的第i层实体,r为关系,Γ为知识图谱中的三元组集合,πei→ei+1表示对ei到ei+1之间的非归一化转移概率.对所有的三元组随机进行概率抽样.

RSN中提到的偏置随机游走(Biased random walks)通过二阶随机游走来提高精度,并采用偏置来控制采样的路径大小,二阶随机游走如公式(12)所示:

(12)

其中d(a,b)表示实体a和b之间的最短路径距离,值的范围为{0,1,2},且控制随机游走路径方向的超参数α∈(0,1),μd(ei-1,ei+1)中较大的值代表随机游走的方向.

2.2.3 基于图神经网络的知识图谱补全

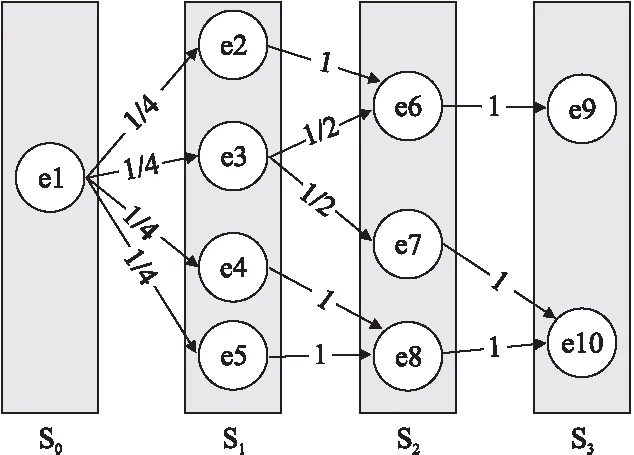

深度学习的研究领域不断扩大,图神经网络[51](GNN,Graph Neural Network)突破了卷积神经网络[52](CNN,Convolutional Neural Network)的局限性,不再像卷积神经网络那样只能应用于欧几里得数据上,而是通过聚合图结构的数据来捕捉信息,其中图卷积网络[53](GCN,Graph Convolution Network)是将图中的数据通过映射函数来聚合自身和邻域的特征信息.GCN的消息传递如公式(13)所示:

(13)

gm(hi,hj)=Whj

(14)

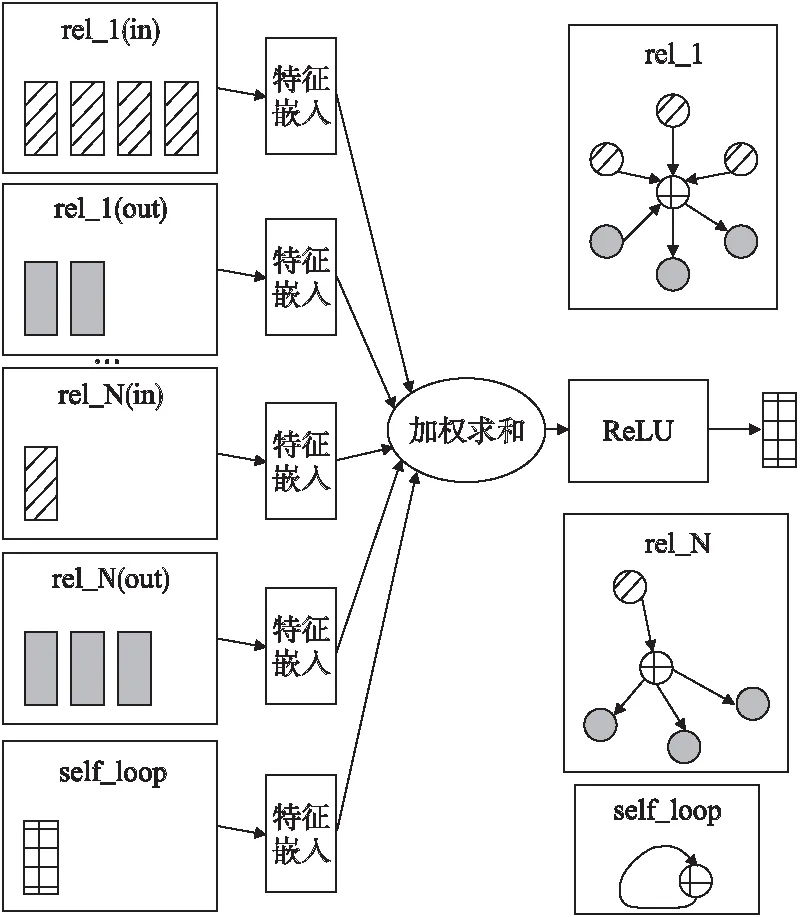

从上述公式可以看出,GCN对邻域聚合的方式是通过统一的函数来处理,对于邻域中不同的节点以及关系并没有进行有效的区分.R-GCN[39](Relational Graph Convolutional Network)改进了传统GCN的信息聚合方式,对节点间的不同关系进行分类,每种关系中的节点都有对应的信息聚合方法.R-GCN将不同类型的边设定一个独立的权重矩阵,使得聚合邻域节点时权重矩阵会记录相种关系相关的节点信息,R-GCN的信息传递如公式(15)所示:

(15)

图4中网格节点表示聚合的当前节点,深色节点和斜线填充的节点为当前节点的邻域,对不同关系构成的邻域(从rel_1到rel_N组关系邻域,且根据方向再划分为in和out两种)进行特征提取,并按照分配的权重矩阵加权求和,最后通过激活函数获得最终特征.

图4 R-GCN的节点特征信息聚合过程Fig.4 Aggregation process of node characteristic information in R-GCN

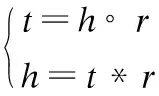

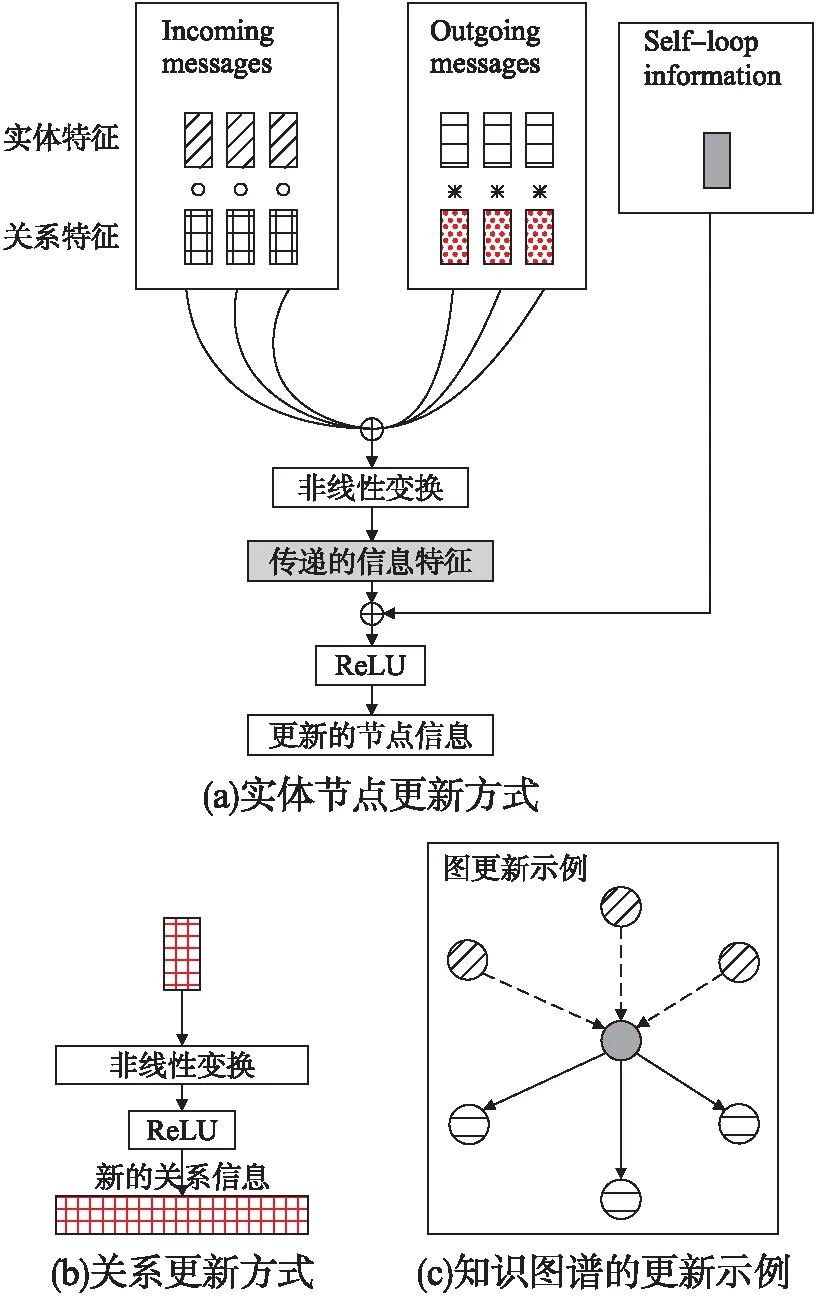

R-GCN的作用更多的是作为一种编码器,通过多个矩阵来聚合不同关系的信息.但由于每种关系需要一个权重矩阵,导致R-GCNs训练时所需要的参数过多,而且R-GCN聚合的目标是实体节点,对关系本身的信息没有进行捕捉.在知识图谱中,因为不同实体之间的关系会因为实体语义环境而变化,所以关系本身是具有方向的.TransGCN[40]在R-GCN的基础上提出实体更新和关系更新,而且定义了相对于实体的关系方向,对于实体节点vi,从其他节点指向vi的关系为incoming关系,而从vi指向其他节点的称为outgoing关系.而且TransGCN更加重视知识图谱中的三元组结构,TransGCN将GCN与Trans模型相结合,并定义Trans模型的三元组转换方式,如公式(16)所示:

(16)

其中∘ 和*代表头实体h向尾实体t和尾实体t向头实体h转换的操作符号,会与不同Trans模型结合时赋予不同的操作方法.

TransGCN在更新实体和关系节点时采用了消息传递神经网络框架[54](MPNN,Message Passing Neural Networks).MPNN是一个用于深度学习的算法框架,主要作用类似神经网络中的前馈网络,将三元组的嵌入作为消息传递内容,再与相应的实体或边结合,从而达到实体与边的更新.消息更新公式如公式(17)所示:

(17)

公式中m为消息嵌入,M为消息更新矩阵,l为隐藏层层数,vj为头实体特征,vi为尾实体特征,rk为关系特征,Γ(vi)为与节点vi相关联的三元组集合.

有了传递的消息嵌入,就可以将消息与实体特征结合,获得新的实体特征.实体更新公式如(18)所示,其中U为实体更新的权重矩阵.

(18)

对于关系更新,TransGCN直接采用一个变换矩阵W1来做为更新权重矩阵,关系更新公式如(19)所示:

(19)

TransGCN的更新方式如图5所示,图5(c)节点和边对应图5(a)和图5(b)的嵌入对象,虚线表示Incoming关系,实线表示Outgoing关系.图5(a)中的深色实体为要更新的节点特征,∘ 和*为Trans模型的转换公式换算符.

图5 TransGCN的更新方式Fig.5 Update mode of TransGCN

TransGCN不仅仅改进了R-GCN在知识图谱的嵌入方式,而且还作为编码器与Trans模型相结合,将公式(16)中的操作符∘ 和*进行替换,就可以将Trans模型公式代入消息传递公式中.作者选取了TransE和RotatE两种模型,其头实体和尾实体的转换公式分别如如公式(20)和公式(21)所示:

(20)

(21)

2.3 张量分解模型的知识图谱补全

2.3.1 张量分解模型对潜在因子的获取

张量分解模型则是将整个知识图谱张量化,通过张量的形式来表示三元组以及内部的关系,整个知识图谱可以被看做是一个三阶二元张量,每个元素代表一个三元组.经典的张量模型RESCAL[41]将两个实体(头实体和尾实体)向量化,从而构成一个含有关系的域.假设有E1…En这 n个实体,R1…Rm为实体E所构成的m个域中的关系,通过张量模型分解潜在因子来获取新的关系嵌入.张量分解如公式(22)所示:

χk≈ARkAT,fork=1,…,m

(22)

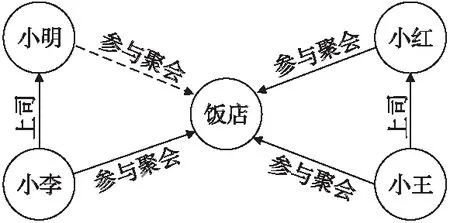

其中χk为待分解矩阵,A为分解的中的潜在实体特征,Rk则是一个非对称矩阵.通过分解矩阵,RESCAL可以从两个对照的三元组(其中一个为残缺三元组,缺少关系)中预测新的关系.如图6所示,小明、小红都有上司在同一饭店聚餐,而小红也参与了饭店聚餐,通过RESCAL将小红和饭店构成一个待分解的矩阵,再利用小明和饭店作为分解的部分矩阵,来推测小明和饭店之间的关系(虚线为推测的关系).

图6 RESCAL应用示例Fig.6 Application example of RESCAL

2.3.2 张量分解模型在复数域上的扩展

为了解决DisMult中的这一问题,ComplEx[46]引入了复数域,将实体用复数向量表示,这样非对称关系也可以通过共轭向量来解决.在关系为r,实体为s和o的三元组(s,r,o)中,ComplEx将张量分解中的适用关系扩展到了多类型,对于关系则有嵌入向量ωr∈CK,其中CK表示K维度的复向量空间,实体嵌入则用es和eo表示,模型的评分函数如公式(23)所示:

(23)

2.3.3 张量分解模型的一般性扩展

TuckER模型在张量分解中表现更具有一般性,RESCAL、DisMult和ComplEx都是在三阶二元张量中进行三元组补全,TuckER也不例外,模型利用塔克分解(Tucker Decomposition)来处理张量分解问题.塔克分解在三阶的情况下会将张量拆分为一个核心张量和3个分部矩阵,如公式(24)所示:

(24)

其中,待分解的原始张量χ∈RI×J×K,核心张量Z∈RP×Q×R,分部矩阵分别为A∈RI×P,B∈RJ×Q,C∈RK×R.符号×n为第n个情况下的乘法,⊗为向量内积运算符.

模型将塔克分解中的3个分部矩阵作为三元组对应的3个嵌入矩阵,即实体嵌入矩阵E=A=C,关系嵌入矩阵R=B,核心张量Z=W.而对于三元组(s,r,o)就有对应的向量表示es,wr.eo.es,wr和eo分别为3个嵌入矩阵的向量表示,由此也可定义TuckER的评分函数如公式(25)所示:

φ(es,r,eo)=W×1es×2wr×3eo

(25)

最后通过激活函数获得概率p=σ(φ(es,r,eo))作为三元组预测的真实性概率.

3 已有知识图谱补全技术比较

3.1 知识图谱补全性能的常用指标

1)Mean Rank:通过评分函数f()来计算三元组的得分(比如真实性),从实体集合中取出部分实体代替原有的三元组中的尾实体(或头实体),并对替换后的三元组计算得分,分越底排名越靠前,再对所有与测试集相符的排名次数求和取均值就为Mean Rank,值越低表示模型性能越好.

2)Hits:与Mean Rank类似,通过相同的评分函数来计算排名,排在测试集中前k名的三元组个数之和在所有三元组中的比例则为Hits@k.Hits的值越高说明符合排名内的三元组可能越多,模型效果越好.

3.2 知识图谱补全常用数据集

1)WordNet:WordNet是以英文为主的一种数据集,早在1995年就被提出并建立,该数据集将英文中的各种词汇作为实体对象,通过不同词汇之间的关系来构建知识图谱.作为一个由词汇构成的语义网络,WordNet在构建处就明确了6种语义关系信息,分别为同义关系(synonymy)、反义关系(antonymy)、上下关系(hyponymy & hypernymy)、部分与整体关系(meronymy & holonymy)、方式关系(troponymy)和蕴含关系(entailment).论文中使用的往往是WordNet的子集,例如WN11、WN18、WN18RR等.

2)Freebase:Freebase是一个超大规模的知识图谱数据集,含有超过1.25亿个三元组,关系种类超过4000,而实体属性超过7000.Freebase属于百科类型的知识图谱,建立的初衷就是为了记录地球上所有的知识,里面涉及了多种学科知识,比如人文、地理.由于Freebase本身数据量较为庞大,实验往往会采用Freebase的子集,例如FB15K、FB15K-237、FB1M等.常用公共数据集信息如表2所示.

表2 常用公共数据集Table 2 Common public datasets

对于数据集的选择,各个模型往往选取特定的关系种类来体现模型的优势,所以使用的数据集以子集为主.本文从各个模型实验中选取了4个常用的数据集作为实验对比,分别为WordNet的子集WN18、WN18RR和Freebase的子集FB15K、FB15K-237.WN18包含了18种词语关系,WN18RR对WN18的关系进行了删选,因为WN18包含了许多互为逆的三元组,比如(合肥,属于,中国)和(中国,包含,合肥)就是一对互逆的三元组,这种三元组在数据处理的过程中对关系取逆就可以得到,因此WN18RR删除了可以通过关系取逆的三元组.类似的FB15K也删除了类似可以关系取逆的三元组,但Freebase本身内容较多,FB15K依旧保留了1345中关系.FB15K-237则是在原有基础上进一步删减数据,保留了237种关系.

3.3 不同知识图谱补全技术实验分析

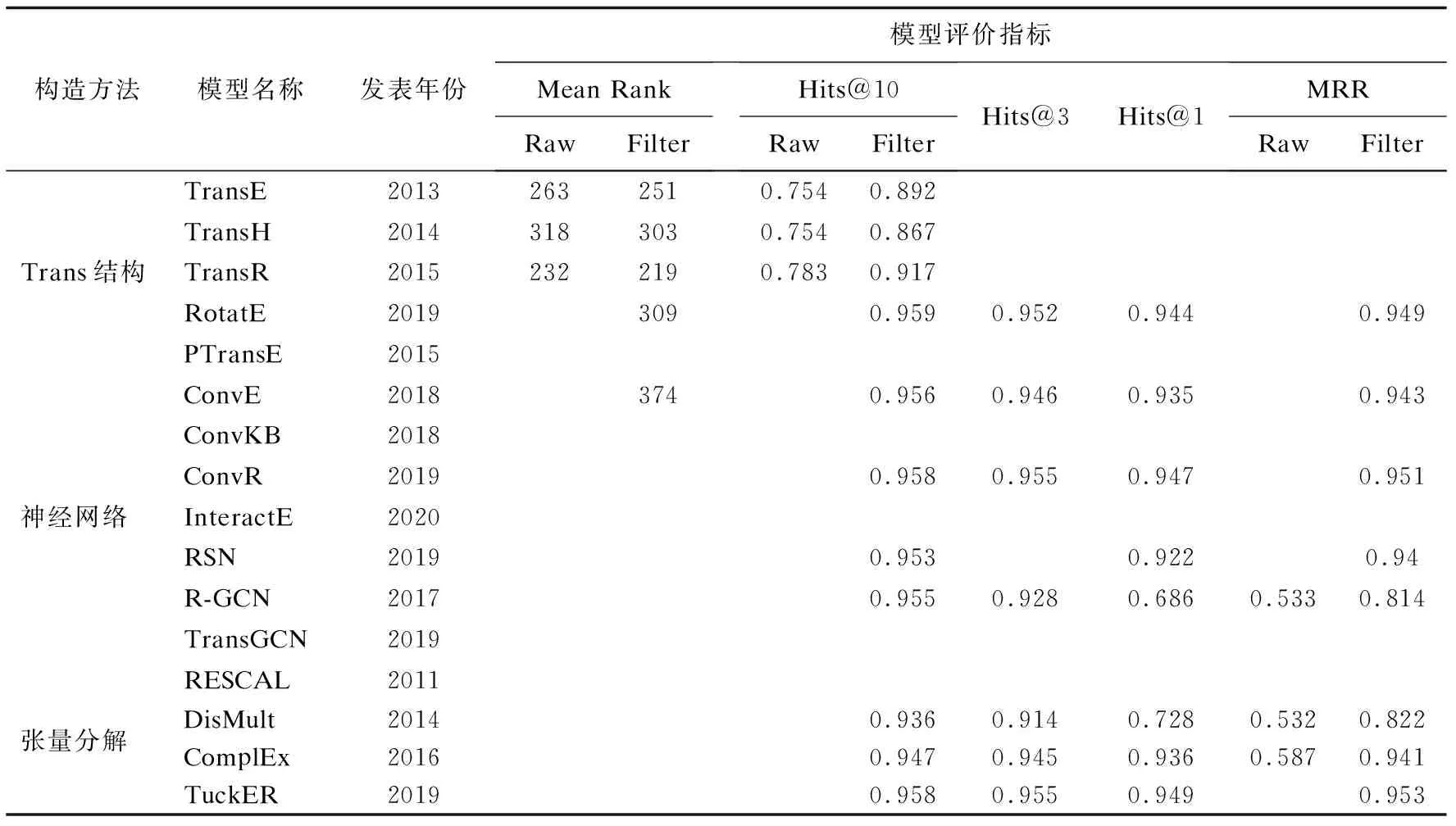

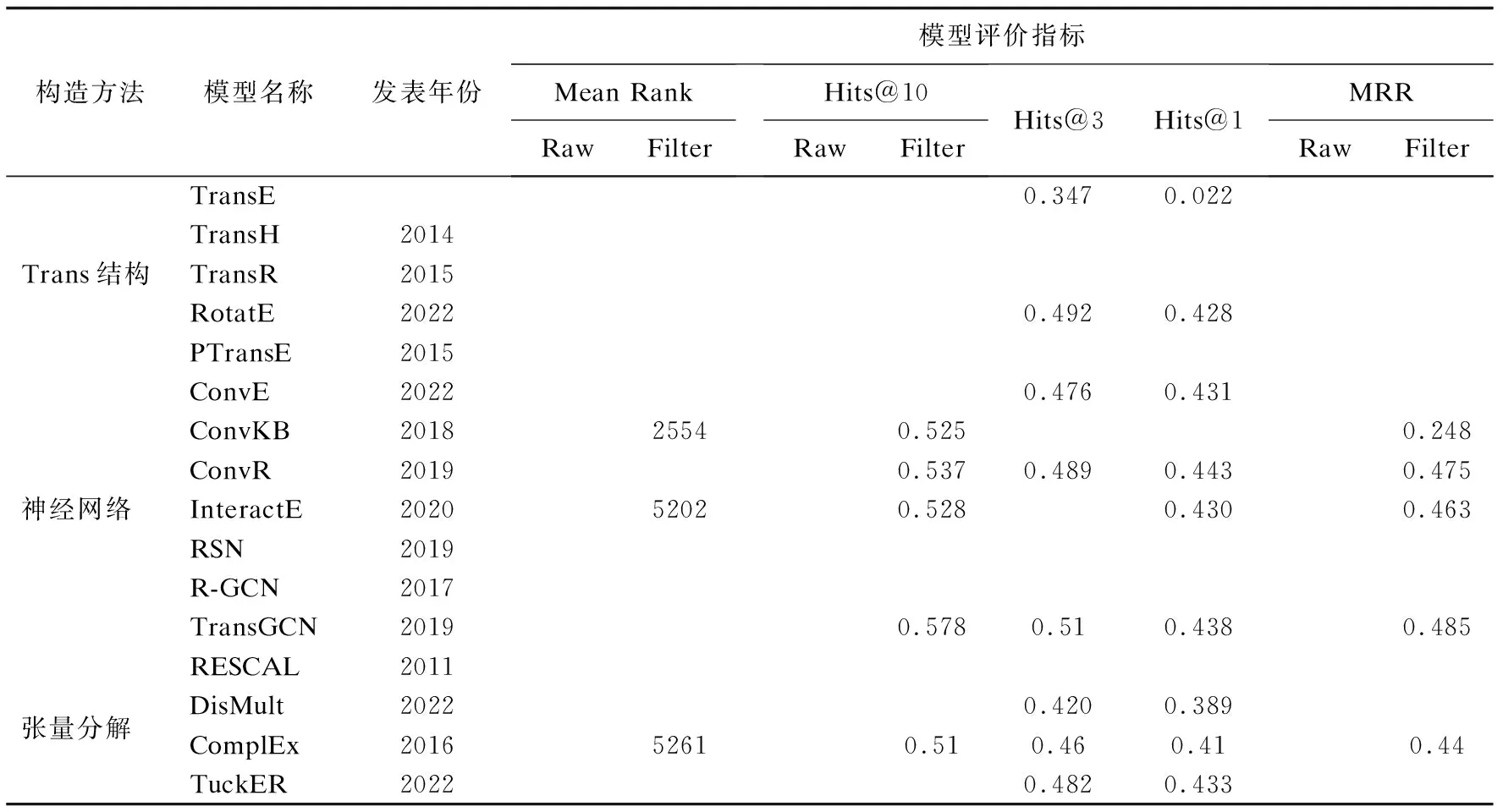

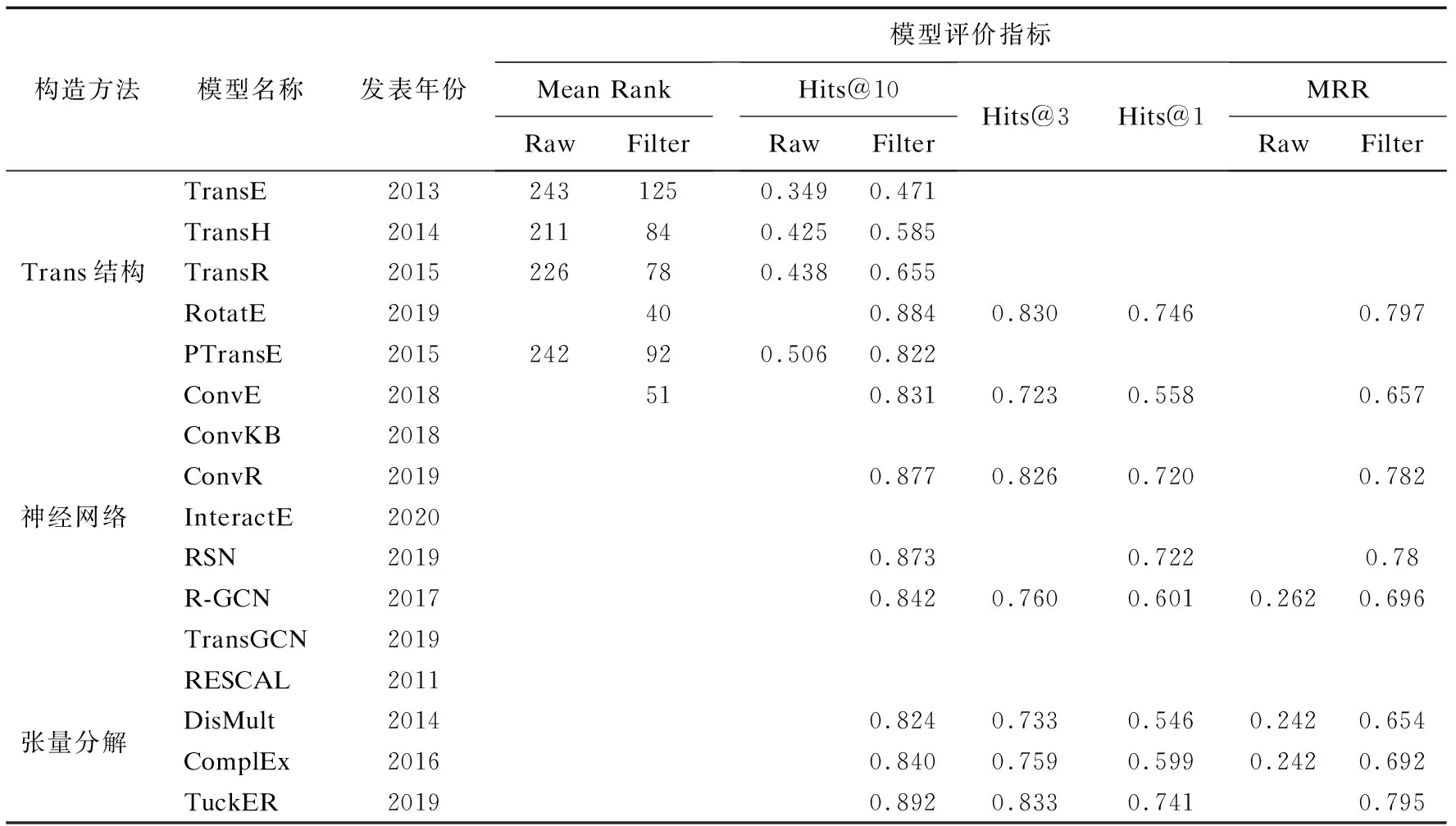

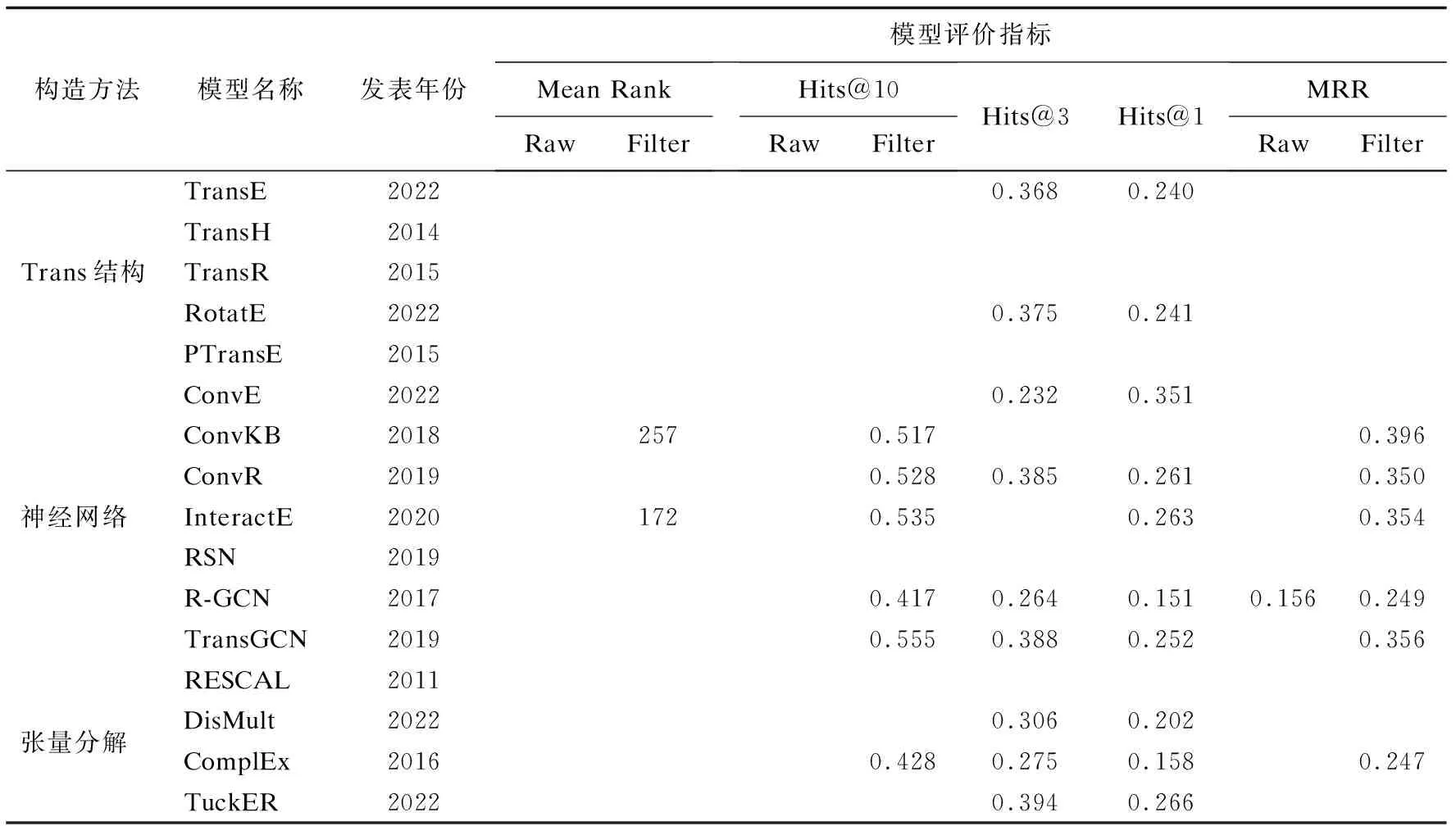

文章中的实验结果是作者在公开数据集上进行实验得出的,将知识图谱补全常用的3种指标Mean Rank、Hits和MRR作为评测标准,总结各个模型的在WN18、WN18RR、FB15K和FB15K-237 4个数据集上的实验数据,对比模型的训练效果.其中Raw表示包含负样本的初始的三元组数据,因为人为构造的三元组不一定不存在,也有可能是真实数据,所以也可以作为训练数据.Filter则表示的是删除过负样本的真实数据.具体的实验结果如表3~表6所示.

表3 数据集下不同模型实验结果Table 3 Experimental results of each model in WN18 dataset

表4 WN18RR数据集下不同模型实验结果Table 4 Experimental results of each model in WN18RR dataset

表5 FB15K数据集下不同模型实验结果Table 5 Experimental results of each model in FB15K dataset

表6 FB15K-237数据集下不同模型实验结果Table 6 Experimental results of each model in FB15K-237 dataset

表3所用的数据集为WN18,其中DisMult数据来源于ComplEx,WN18作为WordNet的一个子集,所构成的关系种类并不多,因此复杂的模型并不一定可以在WordNet上取得很好的效果,从Hits@10的数据中可以看出,神经网络模型和张量分解模型的表现较好,如ConvR模型、R-GCN模型、TuckER模型及ComplEx模型等,但在MRR上神经网络模型的得分较低,如R-GCN模型及DisMult模型.

Trans结构模型中的RotatE在Hits@10上排到了第1名,它在Hits@1和Hits@3以及MRR 3种评价指标中也均表现很好,张量分解模型在Hits@10和MRR两种评价指标上均表现良好,其中TuckER的MRR评分最高,在Hits@1和Hits@3上也排到了第1名.这也在一定程度上说明了张量分解模型比较适用关系较少的知识图谱.

表4中TransE的数据来源于ConvKB的实验数据,表中数据集WN18RR是在WN18的基础上去除了可逆关系的三元组,进一步简化了关系的复杂度,Trans模型在Mean Rank指标上表现较好,而在另两个指标中TransE的分值较低,RotatE则在Hit@3及Hit@1中表现较好,神经网络模型中的TransGCN在Hits@10以及Hits@3评价指标中均排到了第1名,而ConvKB在MRR评价指标中分值较低,神经网络模型中的ConvKB在MRR中表现较差,而Trans结构中的TransE在Hits@1中表现则最差,其他的神经网络模型和张量分解模型没有太大的区别.同时,可以看出,张量分解模型的改进有一定的成效,DisMult、ComplEx和TuckER的评价分数稳步上升.

如表5所示,FB15K中所含的实体个数为14951个,数量上要少于WN18和WN18RR,但关系种类远大于WordNet的这两个子集,共有1345种,而且训练所需的三元组也较多.可以看出,神经网络模型中实验数据整体较为稳定,张量分解模型中的DisMult在MRR中,及Trans模型中的TransE在Hit@10中都表现较差;而张量分解模型中的TuckER则在Hit@10中表现良好.从整体上看,神经网络模型更适合于关系复杂的知识图谱,主要因为神经网络模型对关系语义的捕捉更加精确.

表6中的FB15K-237对FB15K的关系种类进行了较大的缩减,训练规模也有所减小,大多数模型都有较好的训练效果,尤其近几年出现的模型评分较高,这也在一定程度上反应了知识图谱补全技术的最新发展.其中TransE实验数据来源于ConvKB,DisMult、ComplEx实验数据来源于TuckER.

4 已有知识图谱补全技术存在的主要问题

4.1 模型关系复杂性高

知识图谱是通过关系来连接数据,而知识图谱中的关系种类较为复杂,单一结构的模型在处理多种关系时,往往会出现很多问题,如TransE模型难以处理一对多的关系,DisMult虽然使用了对角矩阵,也难以处理非对称关系.模型的结构在一定程度上会对关系的处理产生影响,单一结构的模型在数据处理上更有效率,而往往会受限于对关系种类的处理.如何改进现有知识图谱补全模型,使得模型可以学习更大规模的关系种类,成为知识图谱补全技术的一个主要研究方向.

4.2 语义信息难以获取

知识图谱本质上也是图,作为一种非欧数据结构,采用传统的欧式几何处理方法会产生维度过高,计算复杂等问题.在知识图谱补全技术中,一些模型采用分割处理的方式,只对图谱中的一部分几何结构进行处理,例如Trans模型多是是通过一组或多组类似的假三元组,来拟合真实三元组.但这种方式往往割裂了不同三元组之间的关系,难以拟合图谱中语义信息的获取.

4.3 训练代价高

大规模知识图谱结构复杂,数据庞大,从数据收集、数据清洗、对比分析到图谱的构建,整个流程自动化程度不高,知识图谱补全技术往往将知识图谱拆分为多组三元组,因其结构及数据本身的复杂性,导致补全模型的训练效率低.这在神经网络结构模型上表现较为明显,神经网络对一个三元组往往会有多层的信息传递和计算,这虽然增强了对关键信息捕捉的能力,但一定程度上加重了模型训练负担,使得模型训练代价高.

4.4 模型可扩展性、通用性差

大多数知识图谱补全模型(例如Trans模型和张量分解模型)都是对同一时间点的图谱内容进行补全,模型在训练时也只是针对训练集中已有的三元组,无法推测出数据中未知的三元组数据,这种静态的补全方式难以适应外界环境的变化,模型的可扩展性差.现实世界中,环境复杂多变,要求知识图谱的补全技术,能够适应外部环境的变化而动态变化.同时,当前知识图谱的构建仍然高度依赖领域专家知识,模型通常具有较强的行业属性,其通用性较差.

4.5 路径数量增长过快

在知识图谱中进行路径查找,可以进行更加复杂的知识推理,但在大规模的图谱中存在路径数量增长过快及冗余信息过多等问题.传统的路径查找方法主要是PRA方法(Path Ranking Algorithm),但对于规模较大的知识图谱,这种路径查找方法会带来路径数量的过快增长与冗余信息过多,进而会导致特征空间急剧膨胀.

5 知识图谱补全技术未来主要研究方向

5.1 复杂关系处理研究

TransE和RESCAL中对实体和关系的处理都是进行单一的向量化,通过向量的简单计算来表示三元组中各元素之间的关系,这种处理虽然极大的减轻了数据训练时的复杂度,但缺乏对复杂关系的有效处理,TransH、TransR、DisMult等模型都做出了一定的改进,而在一些较为特殊的关系中(例如对称关系),RotatE、ComplEx等一些模型引入了复数域的概念,通过共轭向量的特殊性质来表示更多实体间关系.

5.2 上下文语义信息获取研究

传统的张量分解模型主要以线性变换为主,这种方式往往会导致模型处理后的结果缺乏表现力,而且张量之间的相乘难以保证每个张量的元素之间都会产生交互,因而需要非线性的处理方式,神经网络模型就可以有效的弥补这一缺憾.ConvE最早提出了将卷积神经网络用于知识图谱补全技术中,而ConvE使用的是较为传统的卷积模型,对三元组的处理仅仅是向量化拼接成新的张量,这种做法对知识图谱中的丰富语义信息捕捉不够连贯,元素之间的信息聚合更多的是割裂的.ConvKB、ConvR以及InteractE进一步改进了三元组的处理方式和卷积神经网络,弥补了之前的不足.

同样的,图神经网络也开始应用于这一领域中,较为经典的模型R-GCN,通过对关系分类来聚合实体节点.由于知识图谱中的关系种类繁多,这导致R-GCN需要大量的参数(R-GCN中每个关系都有对应的权重矩阵)来参与数据训练,增加了模型的训练的时间复杂度.TransGCN虽然减少了R-GCN的参数使用,但本身对图神经网络的更新方式没有做出更多的改变,而是与其他模型更好的结合起来,将图神经网络实现知识图谱补全中的编码功能.

5.3 节点间长期的依赖关系捕获方式研究

上述的模型中多数都是将目光集中在单个三元组上,而多个关系密切的三元组所形成的链路路径也应当被视为一个研究的重点.PTransE和RSN将多步路径引入到了知识图谱补全技术中,知识图谱的构成本身就具备较强的逻辑性,实体间的逻辑关系也可以被看作是一种序列关系,PTransE和RSN这两个模型都提到了循环神经网络的使用,不同的是RSN对循环神经网络做出了改进,而PTransE更多的是结合多个模型.在路径的信息聚合中难免会遇到一个问题——如何选取有效的路径作为信息聚合对象?两种模型也给出了不同的方式,PTransE通过路径资源算法来评估路径的“价值”,以此来作为是否作为有效信息的衡量标准,而RSN则是通过随机游走和噪声估计的方式聚合路径信息.

5.4 多模型融合研究

经典的知识图谱补全模型往往都存在着一定的局限性,如R-GCN是通过聚合周围节点信息得到节点嵌入,适用于编码器,而RESCAL、DisMult等模型则是通过映射的方式将三元组转换为低维向量组合,可以作为解码器使用,类似的TransGCN将GCN和Trans模型在信息传递的过程中结合,通过Trans模型解开GCN编码.将多种较为基础的模型进行有效的融合可以弥补原有模型的不足,进一步拓展模型的功能.

5.5 模型的可扩展性、通用性研究

现实世界往往是动态变化的,要求所构建的知识图谱能够适应这种动态变化的特征.传统用于静态知识图谱补全的方法,在捕获动态信息方面有着较大的局限性,不能直接运用于这种动态的、甚至是多模态的知识图谱补全方面.近年来,出现了一些新的知识图谱补全技术[58,59],采用类似迁移学习的思想,借助神经网络模型,以获取不同动态场景中特征信息,对数据集中未知的关系和实体进行补全预测,以提高模型的可扩展性,然而,实际效果都不是非常理想,模型的通用性也较差.如何将知识图谱补全技术运用于动态、多模态环境,以提高知识图谱补全模型的可扩展性,及如何将知识图谱技术运用于现实世界中的不同领域,以提高知识图谱补全模型的通用性,都是未来值得研究的重要方向.

6 结束语

本文对已有知识图谱补全技术相关的主要研究进行了分析与讨论,指出了已有知识图谱补全技术不同模型各自的优点与不足.从知识图谱补全模型复杂关系处理、上下文语义信息获取、节点间长期依赖关系的捕获、模型的可扩展性与通用性等方面,展望了未来知识图谱补全技术主要研究方向,以期对知识图谱补全技术研究提供一点借鉴与帮助.