基于BERT-BiLSTM-CRF的中医医案命名实体识别方法*

胡 为,刘 伟,石玉敬

(湖南中医药大学信息科学与工程学院,湖南 长沙 410012)

0 引言

中医医案记录了古今众多从医者的诊断经验和诊疗规律,是中医从医者辨证论治的重要基础。目前的中医医案信息化程度较低,因此研究如何从海量的中医医案数据中挖掘症状描述或症状术语信息具有重要意义。早期对中医医案的命名实体识别研究,主要使用基于统计学的方法,文献[2]在2009 年利用CRF 方法对明清古医案进行了病症、方剂、药材等中医术语抽取,F值均达到了80%以上。文献[3]等用条件随机场对中医病历进行命名实体识别研究,并通过和传统的HMM 模型对比,验证了该方法是一种较为适用的中医临床病历命名实体抽取方法。近年来由于深度学习在自然语言中的良好表现,大量研究者采用深度学习方法对中医医案进行命名实体识别研究。文献[4]针对于中医医案临床症状术语提出了一种基于长短期记忆(LSTM)网络和条件随机场(CRF)的深度学习症状术语识别方法,该方法在中医典籍《全国名医验案类方》数据集上F值最好达到了78%。文献[5]利用BiLSTM 能够更有效的获取输入语句前后特征的特点,用BiLSTM-CRF 模型对中医医案进行命名实体识别,在曹沧洲医案数据集上F值达89.8%。文献[6]基于word2vec 的向量构建,通过BiLSTM-CRF 方法对中医医案文本进行命名实体识别,在人工标注的老中医医案数据集上F值达到了88.34%。上述的中医医案的命名实体识别方法中,传统的机器学习命名实体识别方法由于无法捕获长距离上下文的信息,而深度学习方法如BiLSTM 算法可以从双向来捕获上下文的信息,还能从文本中挖掘隐藏特征,故深度学习方法和机器学习方法相比,优势比较明显。

本文在现有中医医案命名实体识别研究基础上,提出在BiLSTM-CRF 算法上加入BERT 语言模型(Bidirectional Encoder Representationfrom Transformers,BERT)来提高中医医案命名实体识别效果。BERT 语言模型是一个强大的预训练模型,通过采用Transformer训练出一个强大的预训练模型,并可以将预训练的模型进行迁移学习,只需在小规模的中医医案训练集上进行微调,即可提升命名实体识别任务的效果,同时还能解决文本特征表示时一词多义的问题。

1 研究方法

1.1 构建BERT-BiLSTM-CRF模型

BERT-BiLSTM-CRF模型核心由BERT语言模型、BiLSTM 模型、CRF 模型三个大的模块组成,其整体结构如图1所示。

图1 BERT-BiLSTM-CRF模型图

BERT-BiLSTM-CRF 模型首先利用预训练的BERT语言模型的Transformer机制对输入的数据进行编码,输出文本的字向量序列表示即={,,…,x},然后将结果输入到BiLSTM 层进一步获取数据隐藏层的高层特征,最后通过CRF 对BiLSTM 的输出结果进行状态转移约束,并最终输出命名实体结果。

1.2 BERT预训练模型

自然语言处理任务的第一步是如何将文本信息转化为计算机能识别的数据形式,早期的主流做法是采用词向量模型,比较经典的词向量模型有Google 在2012 年提出的Word2Vec。该方法生成的词向量虽然考虑了上下文信息,但该方法本身属于一种浅层结构的词向量,所学到的上下文语义信息受限于窗口大小导致无法获取长距离的上下文依赖关系,并且该方法也无法解决一词多义的问题。文献[7]提出的BERT预训练语言模型可有效解决上述问题。该模型的结构如图2 所示,该模型采用双向Transformer 编码器,生成的字向量可以充分融合字词左右的上下文信息,与传统语言模型相比,该模型可以更充分地表征字的多义性。

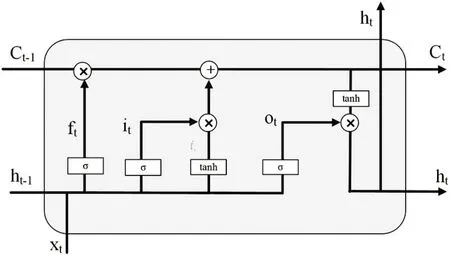

1.3 BiLSTM模型

LSTM(Long Short-Term Memory)是一种特殊的RNN(Recurrent Neural Network),每个LSTM 单元由输入门、遗忘门和输出门组成。其单元结构如图2所示。

图2 LSTM单元结构图

LSTM 存储单元不仅能够存储短期输入信息,还能保存长期的输入状态。LSTM 核心的3 个门中,输入门控制输入的新存储内容的大小,遗忘门确定需要忘记的存储量,输出门调制输出存储器内容的数量。通过三个门还能克服传统RNN 模型在面向长序列特征提取过程中存在的梯度消失等问题。

由于LSTM 模型都是从前向后编码,使得句子只能掌握从前到后的上下文信息,而很多句子后面的词语跟前面的词语也是有很强的关联性,因此BiLSTM模型组合了前向LSTM 模型与后向LSTM 模型,通过前向LSTM 模型和后向LSTM 模型组成BiLSTM 模型来学习双向上下文信息。

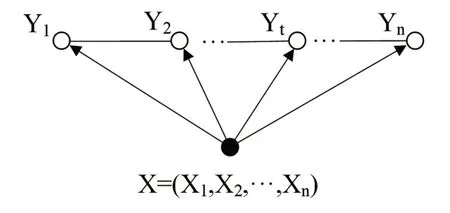

1.4 CRF模型

CRF 是Lafferty 等在2001 年提出的一种遵循马尔可夫性的概率图模型,通过随机变量作为输入来输出随机变量的条件概率分布的一种算法。对于标签分类问题,由于CRF 能够充分考虑标签与标签之间的依赖关系,相比于Softmax 分类器,CRF 更适合用于分词任务,CRF结构如图3所示。

图3 CRF模型结构图

图3中{,,…,x}为需要预测的文本序列,={,,…,y}为输出结果的预测序列。

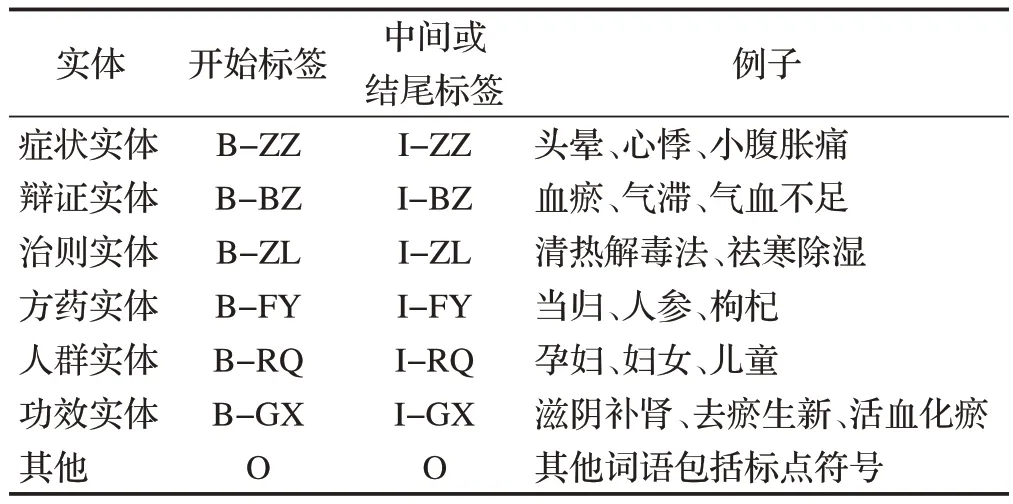

2 实验数据

本文使用的数据集来源于《中国现代名中医医案精粹》,从数据集中甄选出1000 条高质量医案后由多位经验丰富的中医学者共同对数据集进行人工标注。数据集共设计了六个实体类别,即症状实体、辩证实体、治则实体、方药实体、人群实体、功效实体。数据集采用BIO 标注法,其中属于六个类别的实体元素标注为B-X 或I-X,B-X 为此实体元素的开头,I-X 表示次实体元素的中间或结尾,不属于六类实体中的其他实体用元素O 来表示。具体的标注表1 所示,最后从标注后的数据集中选取70%作为训练数据,20%作为测试数据,10%为验证数据来进行实验。

表1 待预测的标签

3 实验过程

3.1 评价指标

本文采用命名实体识别的常用的三个评价指标即精确率(P)、召回率(R)和F值。具体公式如下:

其中T为模型正确识别的实体数,F为模型识别错误实体数,F为模型没有检测到的实体数。

3.2 实验环境及参数

本文实验采用一台操作系统为Ubuntu、CPU 型号为2.2 GHz八核Intel Core i7、显卡型号为GTX2080i、显存11G 的机器。在机器上搭建了Tensorflow1.15 框架、Python3.7 版本的环境,BERT 预训练模型采用Google 官方的Bert_Base_Chinese 版本,该版本模型设置了12 层的Transformer,12 个Attention-head,768 个隐藏层单元,整个模型有110m 个参数。在实验的过程中,将BERT 模型的参数最大句子长度设置成256,batchsize设置成8,学习率为1e-5,dropout 为0.5,BiLSTM中隐藏层的维度为128,训练的轮数设置为20。

3.3 实验结果

本文利用BERT-BiLSTM-CRF 得到的各个实体预测结果如表2所示。

表2 各类实体标签的识别结果

从表2 的结果看出,BERT-BiLSTM-CRF 模型在各个实体上得分有一定的差异,比如“辩证实体”的F得分只有0.814,分析其原因是由于“辩证实体”、“治则实体”、“功效实体”在概念上存在一定的相似性,人工标注时,对部分实体比较难界定其边界,导致标注时比较容易受到主观因素和习惯的影响,另外,部分实体的数量较低也会影响其识别效果。

为了验证本模型BERT-BiLSTM-CRF 的效果,我们选取了如下几种方法进行对比:①传统的HMM模型;②机器学习CRF 模型;③深度学习BiLSTM模型;④深度学习BiLSTM-CRF模型。上述四种命名实体算法在本文的数据集上进行了实验,将实验结果和本文的BERT-BiLSTM-CRF模型进行对比,各模型性能指标如表3所示。

从表3 可以看出,传统的机器学习模型HMM 和CRF 深度学习模型相比,深度学习模型各方面的性能都优于传统的机器学习模型。在深度学习模型中加入序列标注CRF的BiLSTM-CRF模型,在各方面都优于BiLSTM 模型,说明CRF 在考虑了序列的全局标签信息后对模型的性能有一定的提升。在深度学习BiLSTM-CRF模型上加入BERT模型后,F值提升3.3%,由此可以说明,BERT 模型对于文本数据字符间的关系特征提取及其性能提升有明显效果,同时也说明本文BERT-BiLSTM-CRF 模型在中医医案的命名实体识别相比于其他模型优势较明显。

表3 各种模型的结果对比

4 结束语

本文研究设计了一种BERT-BiLSTM-CRF 中医医案命名实体识别方法,利用BERT语言模型,能够解决在文本特征表示的一词多义问题,结合BiLSTM 算法充分学习上下文信息的特点以及CRF 算法提取全局最优标注序列,得到中医医案的实体,最后通过实验对比,P 值、R 值和F值相比以往研究者所提出的中医医案命名实体识别效果最好的方法分别提高了3.58%,1.95%,3.4%。本文提出的方法解决了中医医案实体识别效率一般的问题,将为挖掘中医医案的有用信息提供了技术支撑。