智能家居中的触觉交互体验

王韫,何丽雯,王党校

智能家居中的触觉交互体验

王韫1a,2,何丽雯1a,王党校1

(1.北京航空航天大学 a.机械工程及自动化学院 b.虚拟现实技术与系统国家重点实验室,北京 100191;2.清华大学 a.美术学院 b.未来实验室,北京 100084)

触觉是人类主动感知和响应外部世界及其他个体最直接、关键的感官渠道,近年已成为交互设计和用户体验设计的热点主题。由于触觉感知维度多、传感和驱动技术多样化,以及家居环境中已存在诸多天然触觉反馈等原因,触觉交互在智能家居场景中仍没有得到充分利用。在智能家居系统逐步普及的今天,触觉交互有助于智能设备更自然地融入用户熟悉的日常生活场景中,优化用户体验。基于智能家居自然交互的内涵和发展趋势,论述了触觉的自然性优势和触觉交互技术的现状,确定了家居情境下的触觉交互界面的应用基础和设计框架。通过大量案例调研发现,以辨别功能为主的触觉交互可以在智能家居的控制、监测、安全和提示场景中降低成本、提高操作效率、交互自然性和用户舒适度,保留用户熟悉的家居样式和与之相关的生活方式,优化用户的智能生活体验;同时,触觉交互还可以在感官增强、情感沟通、多模态媒体等方面提出新方案和新设备,发挥触觉独特的情感承载能力,为用户拓展智能家居的沉浸体验。此外,列举了一系列助力设计师搭建触觉交互体验的设计工具。

智能家居;触觉交互;触觉体验;触觉界面;可触家居表面

随着传感技术和通信网络的不断发展,如今智能家居逐步演变为被大众广泛认知的多种技术、设备和服务等子系统的有机组合[1]。从技术性角度而言,智能家居系统的两大主要目标是提供生活方式的支持和优化能源管理,强调其功能性和工具性。系统中互联的设备可被监测、访问或远程控制,以针对不同的用户需求提供支持、协助、预测及响应[2]。而从社会性视角来看,技术不一定以预想的方式被实际使用,因为真正的家庭生活是“有机、取巧和即兴的[3]”。智能家居系统当前所面临的核心挑战,除了在系统的效率、稳定性和安全性等指标上的优化,还需要使技术融入“充满情感和动态”的真实家庭环境中[4],与用户日常生活的不确定性和差异性相结合[5]。这意味着以用户为中心、更加自然的感知和反馈方式,以及更加丰富的情感互动,是设计师需要着重关注的研究方向。

触觉是人与外部世界交流的重要感官媒介,用户的触觉体验对于人机交互系统中“自然性”的营造和增强有着不可替代的作用[6]。触觉技术是一种利用人体触觉的交互界面技术,主要包括触觉传感器和驱动器。随着自然人机交互理念和虚实融合环境的普及,触觉交互近年已成为人机交互的热点领域。本文首先确立了触觉界面在智能家居场景中的应用基础和设计框架,并通过案例调研,探讨了用户通过触觉与智能家居设备进行交互时的体验优化和拓展。

1 智能家居自然化

1.1 智能家居的研究趋势

房屋和房屋内的物品构成了家的物质环境,但并不是家的本质。家的核心概念不是场所,而是与环境建立意义关系的原则,是随着时间变化的一种空间组织形式,囊括了人、物、活动和意义[7-8]。智能家居通常被理解为居家环境中互联的自动化、智能化设备的集合,其重要目标之一是帮助用户获得有关其家庭环境的重要信息,为他们提供决策支持和知情选择[9]。然而,如果不能与家的概念内涵深度融合,智能家居从技术意义上讲可能只是提供便利或提升效率,并不一定舒适、安全和令人愉快[10]。用户(特别是老年人用户)对技术的接受度[11]也逐渐成为研究焦点之一。用户无法接受智能家居产品的因素有很多,比如技术不适应现有环境并强制用户改变生活方式和行为[12]、系统的低反馈导致用户失去对技术的掌控感等[3]。智能家居应作为一个情境感知学习系统,通过与日常生活中物品和环境的自然结合,提供新的机会和体验,而不是限制人们如何安排家庭生活[13]。

因此,为了更好地解决日常生活中的不确定性问题,越来越多研究者的关注点从对设备的控制,逐步转向为理解用户的意图和情绪、优化系统的上下文感知[14],为用户提供定制化服务[3],使智能家居成为普适计算的重要应用。这便要求系统使用多样化的自然交互界面,基于用户的日常行为来感知其生理和心理状态,并给予用户舒适的多模态反馈。

1.2 皮肤触觉与动觉

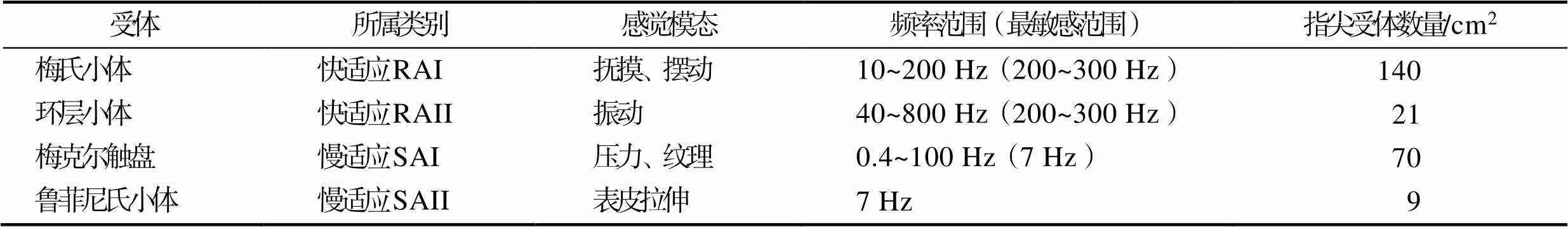

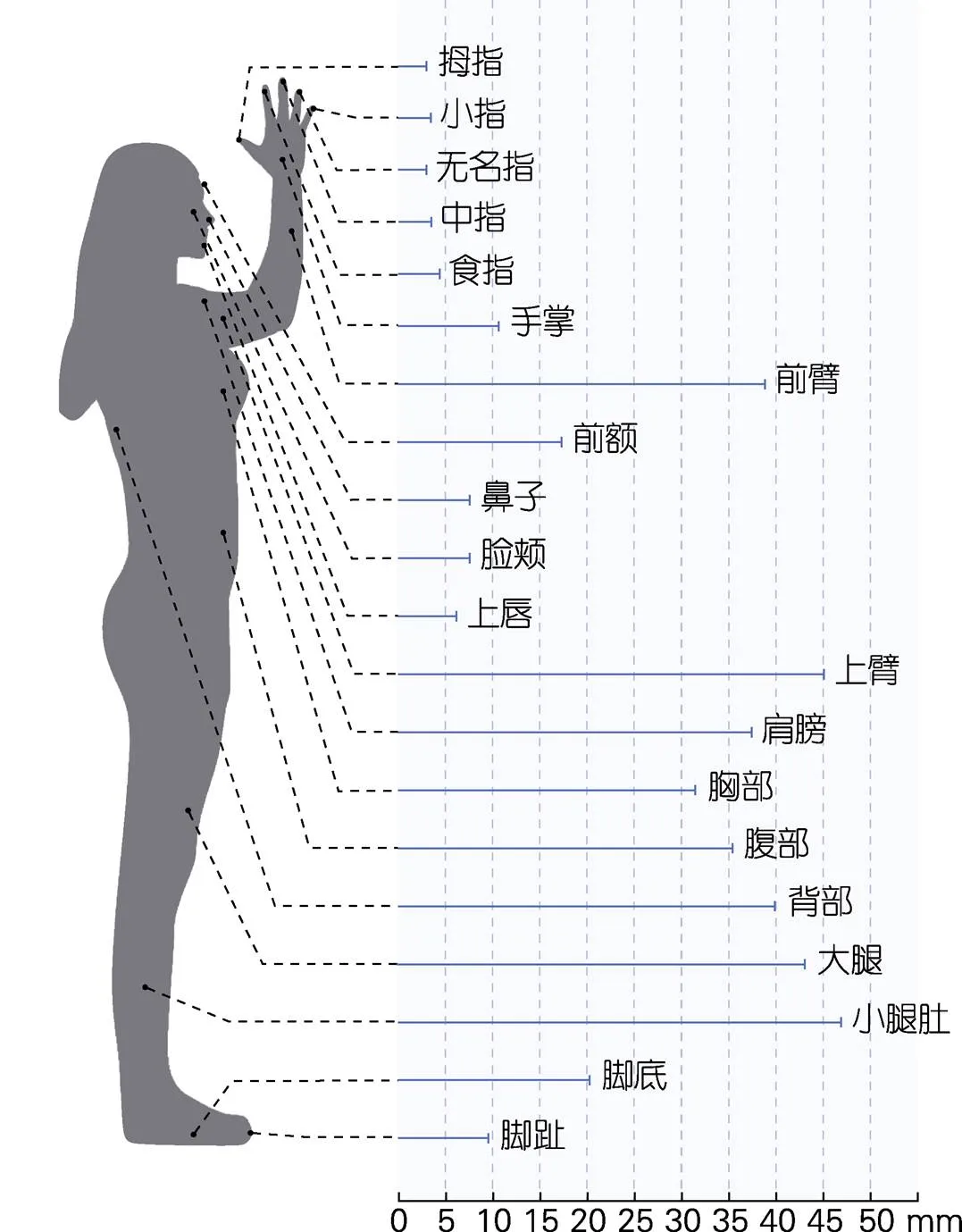

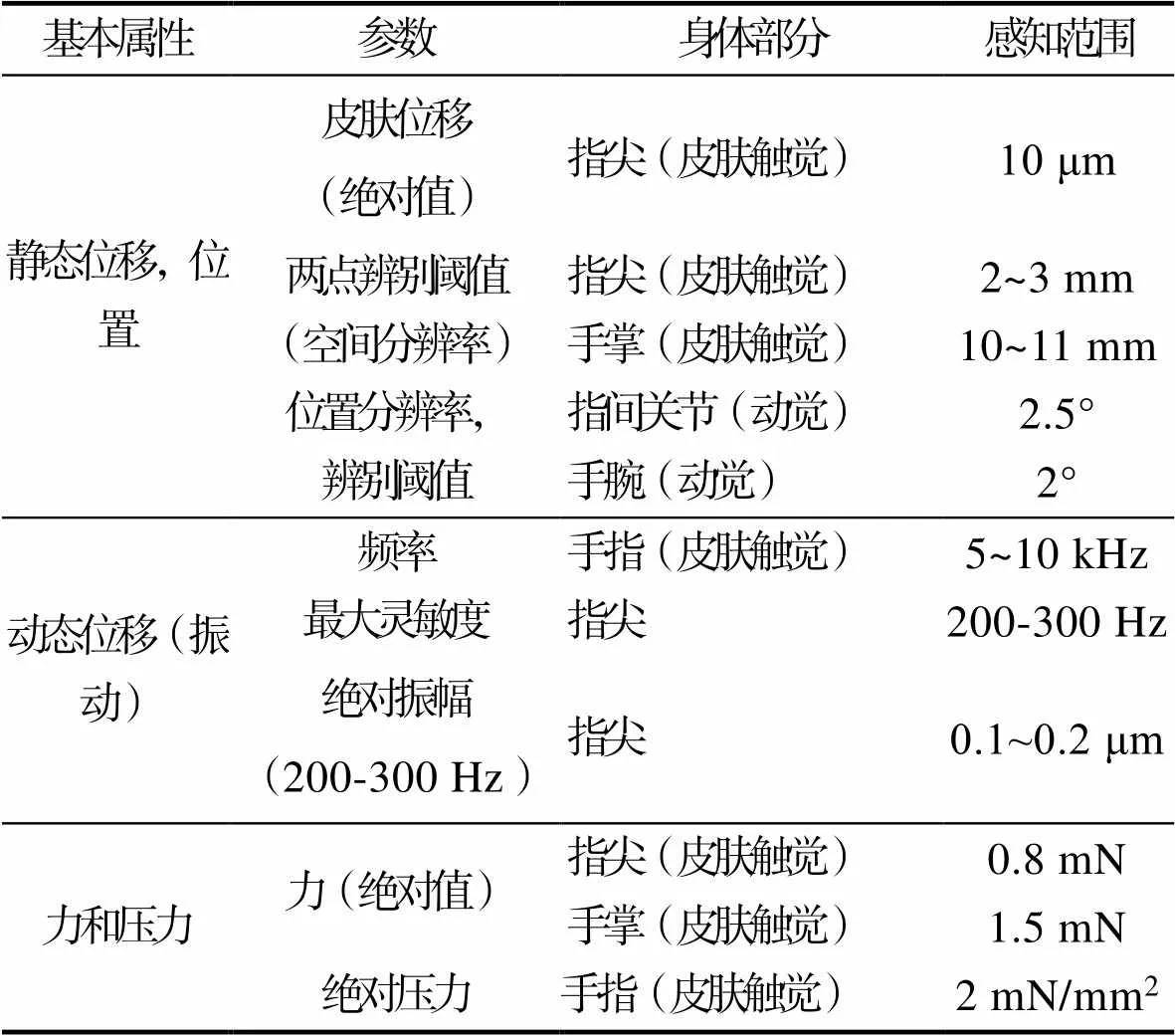

相对于以接收信息为主的视听觉,触觉是人最重要的主动感觉。人类通过动态地接触或操纵对象来获得其物理特征信息[15]。人类皮肤包含了机械感受器、热感受器、本体感受器等多种触觉受体,见表1。根据受体的不同,触觉主要可被分为以下2种。第1种是皮肤触觉(Cutaneous Haptics)[16],指人体通过皮肤所感知的信息,主要由振动、压力、横向拉伸,以及相对切向运动这4种基础的机械刺激要素组合而成。对温度等其他非机械信息的感知则可以参与材料识别等更复杂的任务。皮肤传感器的性能与它们所覆盖的身体部位息息相关,通过两点辨别阈限测试可以测量出皮肤触觉的空间分辨率,见图1。人类随时随地都使用手部对日常物品进行操作,表2显示了手部主要的基础触觉能力数据,其中指尖的灵敏度和分辨率最高。第2种触觉被称为动觉或本体觉(Kinesthetic Haptics)[16],它与对身体部位的位置和运动,以及施加在身体的力和力矩的感知有关,比如感知手指、关节和四肢的运动和位置。这类触觉还可以被分为手部动觉和全身动觉。

表1 人体触觉的常见机械感受器及其感觉模态[20]

Tab.1 Common human mechanoreceptors and their corresponding sensory modes[20]

图1 身体主要部位的触觉两点辨别阈值

表2 手部主要触觉能力[15]

Tab.2 Main parameters of perception at the human hand [15]

触觉不同于其他感觉通道的独特性在于其同时存在输入(感知)和输出(操作)的双重作用[17],因而具有强烈的即时感[18]。身体既是触觉感觉器官的支架,也是介导感知和动作耦合的媒介,主动触摸(Active Touch)、触觉探索(Haptic Exploration)都依赖于人体感官和运动能力的整合[19]。

1.3 触觉的自然性

人类几乎所有的活动都涉及手与工具、物体或环境的精细触觉交互。触摸可以被视为一种从近端、即时性的信息中获取环境物理特征的机制[21],这些信息会直接影响人类接近和处理对象的方式。同时,触觉不仅是辨别性的,还具备承载情感的能力[22]。人们触摸的目的有很多,比如探究一个物体的状态或材质,传达一条非语言类的信息等;也可以是享受审美上的愉悦或舒适,缓解紧张,或通过身体上的连接与其他个体建立情感联系[23]。触觉在人与物之间是私人化的,而在人与人之间则是社交化的。触觉的多样性使其适用于低注意力的多任务环境[24-25],有助于人们在日常生活中轻松地处理很多复杂信息。

在与智能产品互动的过程中,用户操作物品及物品给予反馈的方式越接近真实生活中的情况,且对用户原本生活干扰得越少,交互便越自然。触觉在人类日常环境感知、互动意图表达和情感传递中起到关键性的作用,在感官营销和产品设计领域已有丰富的研究应用[26],但在人机交互界面中却没有得到充分利用[16,18]。随着交互界面对于信息传递的要求越来越高,原先以视听觉交互为主的人机交互方式的局限性越来越突出,比如显示设备空间有限、容易信息过载、缺乏具身互动等[27-28],因而触觉交互具有较高的研究和应用潜力[29]。触觉设备可以无缝集成到用户的日常环境中[30],使用户能够以一种自然而私密的方式感知周围环境并与之互动[31];在消耗较少认知资源的前提下接受多种类型的信息[27],提高对环境认知和操作的效率[32];也可以为交流带来更多的丰富性和沉浸感,提升用户的参与体验[33]。特别是可穿戴触觉和柔性触觉设备,能够以一种干扰小、非侵入性的、容易为用户所接受的方式获取用户的身体数据[34]。

2 触觉交互技术

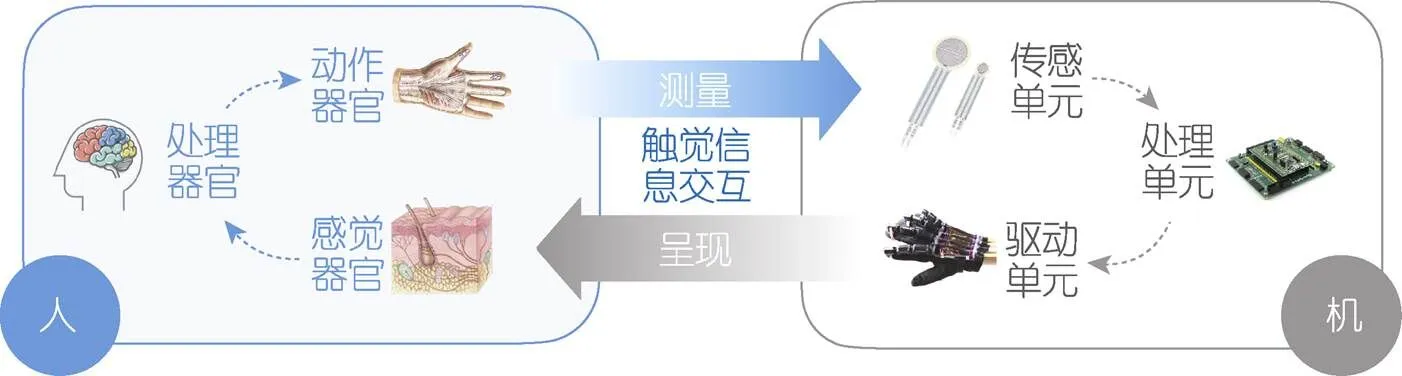

触觉交互技术主要分为以测量人体触觉信息为主的传感技术和以向人体呈现触觉信息的显示和反馈技术,见图2。

图2 触觉人机交互模型

2.1 触觉传感

常见的触觉输入设备主要用于测量用户在触摸敏感表面上施加的力,以便让系统得知用户的操作意图,比如物理按钮、电容触摸屏或触控板[16]。这些设备依赖于用户指尖的主动按压或者滑动来进行类似鼠标的操作,所能收集的用户触觉信息比较单一、简单。当前的触觉输入技术正逐渐向全身化、多维度发展,旨在针对居家环境内日常监测的需求提供低成本、低耗能、更精准稳定的解决方案。基于触觉的生物识别系统可以测量身体不同部位的位置、速度和力,从而开发出用于识别的独特物理模式[35],私密性和安全性都较高。其中,薄膜皮肤形态的触觉传感器可分为刚性薄膜皮肤和柔性薄膜皮肤(又称电子皮肤),前者主要贴附于各类刚性平面,后者主要贴附在曲面,以获取人手作用时的刺激信号或者机器设备的触觉激励[36]。

2.2 触觉显示和反馈

当用户在与交互对象进行互动时,需要触觉显示器和驱动技术给予触觉反馈,以帮助用户确认操作状态,建立控制反馈回路[37]。与显示器和音响设备等传统视听反馈界面不同,触觉设备通过施加力、振动和运动这些机械信号,或者主动驱动的温度刺激、形状模拟和纹理模拟来刺激人的触觉通道。

不同领域在触觉输出的研究上有不同的侧重点。计算机触觉专注于开发算法和软件来模拟和渲染触觉刺激,触觉生成(Tactile Rendering)和力觉生成(Force Rendering)与皮肤触觉和动觉相对应[38]。机器触觉由机械装置组成,可以对用户施以振动、力反馈等机械刺激,主要维度包括自由度和刷新率[39]。手和手指上的触觉反馈通常采用皮肤触觉和动觉结合的指套或手套形式。全身触觉则通过使用外骨骼或者接地动觉反馈装置控制身体运动或增强其力量和速度,主要提供动觉反馈和协助,而不是细微的皮肤触觉反馈[16]。软物质设备则可以利用可变刚度材料和柔性、轻质致动器、应变传感及热反馈等与人体生理学更紧密联系的驱动模式来产生触觉反馈[16]。目前常见的驱动技术包括电磁、静电、介电弹性体(DEA)、压电、气动、流变液和形状记忆合金等,不同的技术在触觉显示的精度、功率、驱动和响应速度、便携性上都各自具有优缺点[40-41]。此外,多媒体触觉,也称为“触觉视听环境(Haptic Audio Visual Environment,简称HAVE)”,则主要处理触觉数据和其他类型的媒体的感知协调性能[35],多感官的跨模态感知可以用来增强或改善触觉反馈效果[42]。

3 智能家居中的触觉界面

3.1 适用于家居环境的触觉技术辨析

由于触觉本身的多维特征,广义的触觉交互范畴较大,触觉技术手段众多。由于稳定性、小型化、自供电等问题尚待优化,诸多技术仍处在实验室研发阶段,产品化的案例较少。如何快速定位适宜的技术并将之自然地嵌入到用户的日常生活中,是家居环境中触觉界面设计的最大挑战之一。基于用户居家活动中的触觉感知部位和交互模式,通过辨析广义触觉交互中不同技术的居家适用性,可以确定一些基本筛选原则。具体包括以下3个方面。

1)可穿戴皮肤触觉交互。可穿戴生理监测设备一直是个性化和居家健康应用的热门领域,非侵入性皮肤生物化学传感器利用人体皮肤作为交互表面[39],通过测量皮肤表面的生物标记物,来洞察用户的健康状况或进行慢性病管理[16]。这类设备虽然直接与皮肤接触,但通常并不属于触觉交互设备的范畴,因为其传感的信息往往不是基于机械刺激的。而通过皮肤触觉进行信息传感的柔性可穿戴触觉设备(比如功能织物),可以应用于可穿戴智能服装或者柔性家居表面,给予用户新的触觉界面来控制其他智能设备或者采集与身体相关的各类数据,还可以对特定皮肤区域提供有针对性、独立的触觉提示和反馈[40]。

2)接触式动觉传感。除皮肤触觉交互外,广义的触觉交互也囊括了以非接触式的动觉输入为主的手势或体感交互和以动觉协助为主的外骨骼或接地设备。其中,大型触觉反馈设备在功能、体量、操作难度上都不适合于家庭场景。在实际的家居场景中,手部操作以精细动作为主,且居家生活空间有限,较大幅度的手势或体感控制并不是自然、便捷的交互方式,不容易被用户接受[43]。而基于家居物品和环境表面的接触式动觉传感,比如步态监测,可以构建一种压力敏感型的智能交互环境[44],避免对用户的日常生活造成干扰。因此,通过与身体直接接触来进行自然化交互的触觉设备更加适用于家居环境。

3)动态触觉反馈。实体用户界面(Tangible User Interface,简称TUI)[45]也通常被认为是广义的触觉交互界面。TUI基于Gibson对于“主动接触(Active Touch)[46]”的表述,关注用户通过手部与各类实物对象表面的直接接触和操作中的自然行为来实现信息与物理实体的耦合。虽然TUI采用了接触式的动觉输入,但通常提供非触觉的动态反馈(比如投影屏幕),适用于办公、教育、创作等需要较高的注意力水平的任务情境,并不属于典型的家居环境触觉交互方式。在智能家居环境中的触觉输出设备需要充分利用用户触觉通道的优势,制定连续、动态、响应式的触觉反馈策略,更好地满足用户非任务式的需求,比如情感交流、娱乐等。

3.2 可触家居表面作为交互载体

触觉交互体验的营造需要与家居环境特点紧密结合。除了触觉感官本身的自然性优势以外,皮肤触觉、尤其是指尖触觉对材料属性(纹理、柔度、热和重量)相关的感知和区分上也格外敏感[47]。居家场景中天然存在大量不同材质的可触表面,涵盖丰富的触觉信息和语义,作用于人们的无意识过程,比如墙体、地板、家具、纺织品、纸制品等。表面界定了触觉有效访问的区域,对感知效果起关键作用[48]。触觉交互技术的应用可以将各类表面转化为一种“主动材料(Active Material)[49]”,有效拓展可交互表面的面积及分布(见图3)。MacLean提出了“泛在触觉(Ambient Haptic)[27]”的概念,使通常不在用户注意力中心的物品成为一种温和又丰富的环境交互界面。

图3 智能家居中的可触表面示意

多场景、多材质的可触表面为交互模式的丰富提供了新的可能性。Taylor等[50]认为家中的各类表面是将居住者的生活智慧进行编组、展示和利用的地方,通过调查某些表面如何适合某些形式的显示和交互,可以制定“家庭表面混合体”的信息任务策略。Tigwell等[51]将用户与不同的家居表面材料的触觉信息互动称为“家居表面交互(Household Surface Interaction,简称HSI)”,并初步探索了一些HSI的设计要点,比如坚硬的表面更适合短时间的操作、柔性表面会让用户对重置产生困惑,以及材料的情感语义会影响应用体验等。而Philipose等[52]通过监测用户与日常用品表面接触的频次和时段来获取用户日常生活行为(Activities of Daily Living)的关键数据,并以此推断用户的自主生活能力和健康状态。Degraen等[53]创新性地提出,家中的一些有机表面,比如家养植物,也可以被用作触摸式通知界面。

3.3 触觉界面设计框架

综上所述,智能家居中触觉界面的设计框架归纳见图4。

4 基于触觉交互的用户体验优化

触觉交互技术能够自然地与各类可触家居表面融合,在用户熟悉的家居样式和与之相关的生活方式保持不变的情况下,优化用户的智能生活体验。其中,触觉传感器对于现有智能家居设备的部署和配置在降低成本、提高操作效率、自然性和用户舒适度等方面都具有较好的应用潜力。

图4 智能家居中触觉界面的设计框架

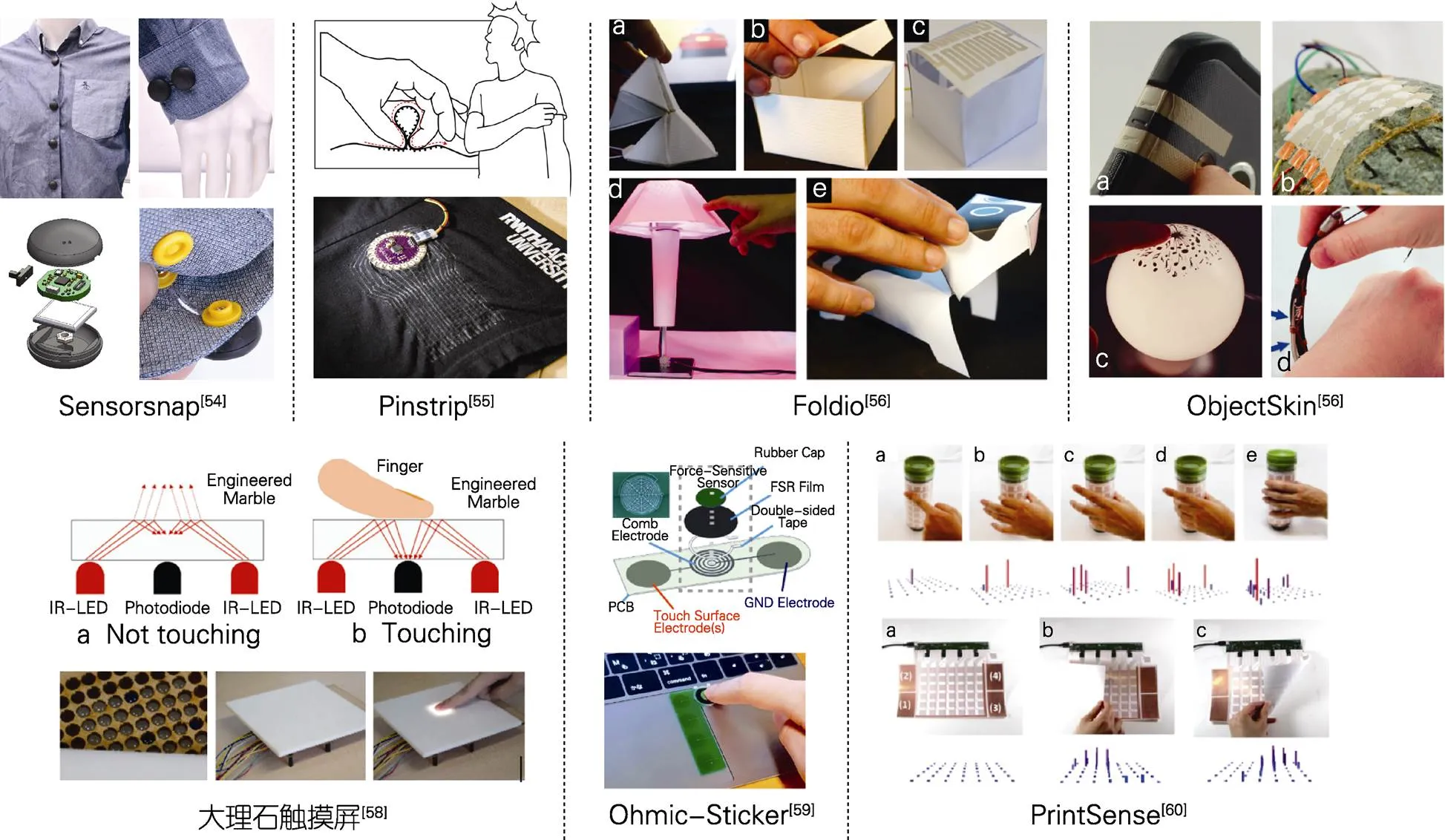

4.1 控制

利用手部皮肤触觉的电子织物能够以低成本、低能耗的方式简化日常物品智能化的流程。如图5所示,Sensorsnap[54]是一种集成小型运动传感器和电容触摸屏的智能扣子,可以检测用户的轻拍、旋转和触摸等动作,用于控制设备。Pinstripe[55]是一种可以用于智能服装上的连续触觉输入元件,由缝在织物上的平行导电线组成,用户使用手指捏和滚动布料来控制输入力度。除了柔性材料外,有一定变形能力的支撑型材料也可以智能化。Foldio[56]是一种由塑料、纸或纸板薄片折叠而成的交互式3D对象,它具有触摸和变形传感,并通过嵌入可折叠结构中的定制印刷电子元件提供系统输出,可应用于触摸感应式包装或灯罩等日常生活物品。

柔性触觉设备也可以拓展已有家居或者电子设备表面的触控区域。ObjectSkin[57]基于柔性电路定制传感器和显示器,无缝贴合各种日常物体的弯曲几何形状和详细表面结构,实现曲面触控。Tada等[58]研发了一种薄显示面板系统,可以将现有的厨房或梳妆台的大理石台面转换为智能触摸屏,用户可以用湿手或脏手触摸,实现拨打电话或者设置计时器等功能。Ohmic–Sticker[59]是一种新型的触觉传感贴纸,可以附着在电子设备表面来拓展触摸交互面积,实现各种类型的力敏输入。PrintSense[60]是一种在平面、曲面或柔性表面上进行多模式传感的技术,可以覆盖在家居物品表面,支持触摸和接近输入的感应,而且能够捕获多个级别的压力和弯曲。

4.2 监测

利用皮肤触觉和接触式动觉进行非侵入式的身体数据监测,是一种有效应用可穿戴功能织物和智能化可触表面的方式。Seo等[61]在一个生活实验室(Living Lab)研究项目中邀请了青年到老年3个年龄段用户生活在部署各类智能家居设备的公寓中,3个群体在身体成分检测、步态探测和智能床的服务项目上都提出增加触觉输入的需求。

图5 触觉控制设备

在穿戴式的设备中,触觉传感器通常与日常衣物相结合。Sazonov等[62]开发了一种鞋内压力和加速度传感器系统,用于识别用户的坐姿、站立、行走、伸展等活动,有助于进行肥胖管理、疾病预防和运动康复。SmartSox[63]是一种可以测量温度、压力和拇趾运动范围的舒适袜子,以进行足部情况监控。Textronics[64]是一种测量人体呼吸频率的原型纺织传感器,可将其嵌入服装结构中。Furlanetto等[65]和Patel等[66]的研究表明,可以利用可穿戴的温度传感器测量热流和皮肤温度,准确估计用户在运动中的能量消耗。

接触式的设备还可以部署到与检测活动高度相关的居家物体表面,比如地板、椅子和浴室设备。压感座椅[67-68]可以监控坐姿、姿势和日常行为模式异常等特征。压感床或压敏床单可以用于独居老年人夜间呼吸频率的连续监测[69];监测睡眠阶段,通过微型振动旋转致动器阵列在最佳时间唤醒用户[70];分析不同人群的睡眠模式等[71-72]。浴室设备[44]可以监控各种使用情况,如浴室占用情况和跌倒检测等。

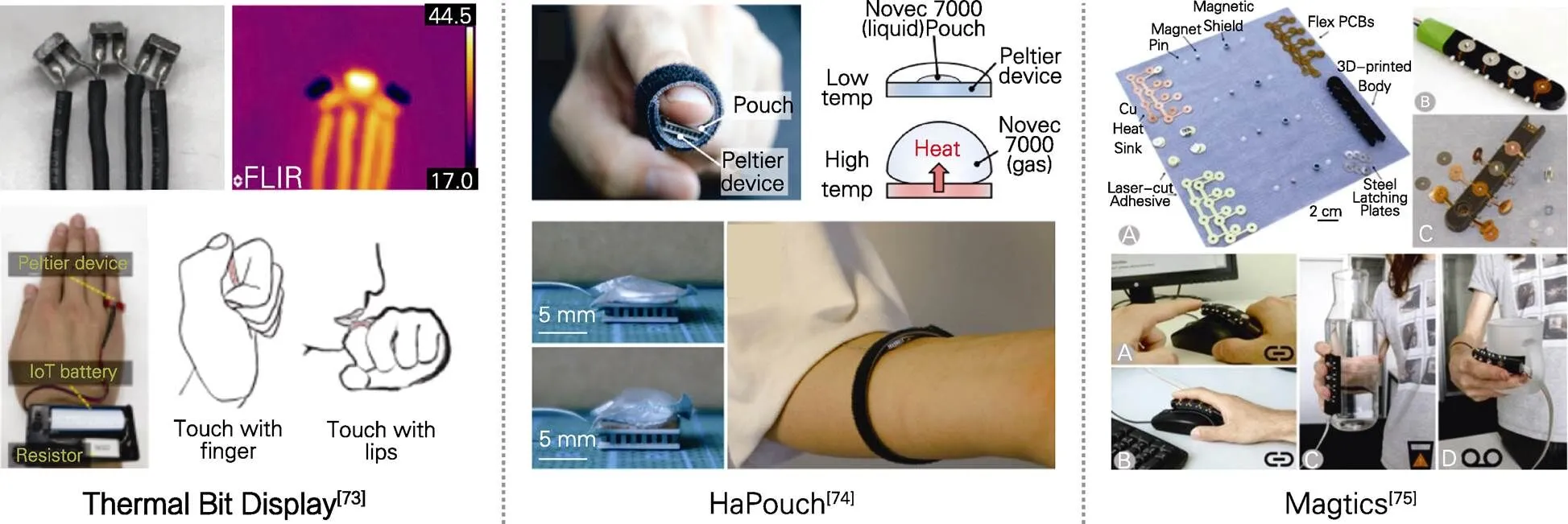

4.3 提示

由于人类触觉的感知即时性和低认知消耗等特征,触觉提示在导航、驾驶、运动训练等诸多要求人们快速反应的场景中得到了有效应用。同时,触觉传感的近身性还可以较好地保护用户隐私。在家居环境中,触觉提示可以作为贴身式、轻量化的无声私人通知,用于提醒用户居家活动时间计划,比如闹钟、吃药等。如图6所示,Thermal Bit Display[73]是一种热触觉显示器,带有微小的设备,在特定身体范围内提供热反馈。HaPouch[74]依靠加热使液体汽化膨胀来实现小而轻的气动触觉显示。Magtics[75]是一种基于电磁锁存的柔性薄型触觉反馈装置,可被独立佩戴,或者集成到腕带、服装和日常用品表面,用于提供各类通知提示。

图6 触觉提示设备

4.4 安全

为了避免摄像头带来的隐私问题,通过部署传感阵列、采用功能织物等方法,可以在家门口使用智能地板[76-78]或者智能地毯[79-80],感知人的室内定位并基于步态识别个人身份。通过支持深度学习的数据分析,Shi等[80]研发的智能地垫可以根据10个人的特定步态实现96%的高识别准确率。利用传感地板或地砖监测是一种非侵入性的监测方法,它可以收集环境机械能并转换为电能[81-82]。智能地板还可以充分利用足部的触觉感知特点,通过振动反馈等方式来发送警告信号[83]。

5 基于触觉交互的用户体验拓展

居住在生活实验室(Living Lab)[61]的用户在评估智能家居系统时,可能因为在日常生活中已经从各类可触表面中获得了丰富的真实触觉反馈信息,所以提出了多个触觉输入的应用场景,却没有针对触觉输出提出具体要求。触觉显示和反馈通常被认为是增加虚拟现实系统沉浸感的重要元素,用来弥补物理触觉反馈的缺失。从这一角度看,如果触觉交互要在现实的家居情景中发挥其独特的作用,除了优化用户在一些典型场景的体验外,还需要从触觉的非辨别性功能入手,拓展用户与“家”相关的感性认知和情感交流的新体验。

5.1 增强触觉

通过各类视觉显示设备,人们可以突破自身的局限,看到视野外、微观或宏观的物体。同样,触觉设备可以作为感官系统的增强和身体工具的延伸,扩展个人在日常居家活动中的触觉感知能力和范围,也可以为感官障碍人士提供感知替代方案[84]。

随着多功能柔性和可拉伸电子器件的快速发展,电子纹身等技术使皮肤具备了成为增强的私人化、个性化触觉通信界面的可能。如图7所示,Tacttoo[85]可以在确保与裸皮肤类似的自然触觉灵敏度的同时,在用户皮肤上进行高密度的电触觉输出。Multi-Touch Skin[86]给交互设计师提供了一种高分辨率的多点触摸传感功能皮肤。Springlets[87]则使用模块化弹簧实现了一种新的机械驱动接口,用于在皮肤上产生富有表现力、非振动、无声的输出。

在触觉的延伸性上,KnitUI[88]是一种基于电阻压力传感的可访问的机器编织用户界面,可定制、便携、变形和清洗,使用户可以将自己身体的任意部位变成触觉传感接口。HAPTIC PLASTeR[89]使用基于介电弹性体致动器(DEA)组成滑环聚合物材料(SRM),可以将其与用户身体紧密贴合,集成为各类可穿戴的触觉感知设备,用户可以体验远程用户的心跳、材料的纹理、风吹过皮肤的感受等。

图7 增强触觉设备

5.2 情感触觉

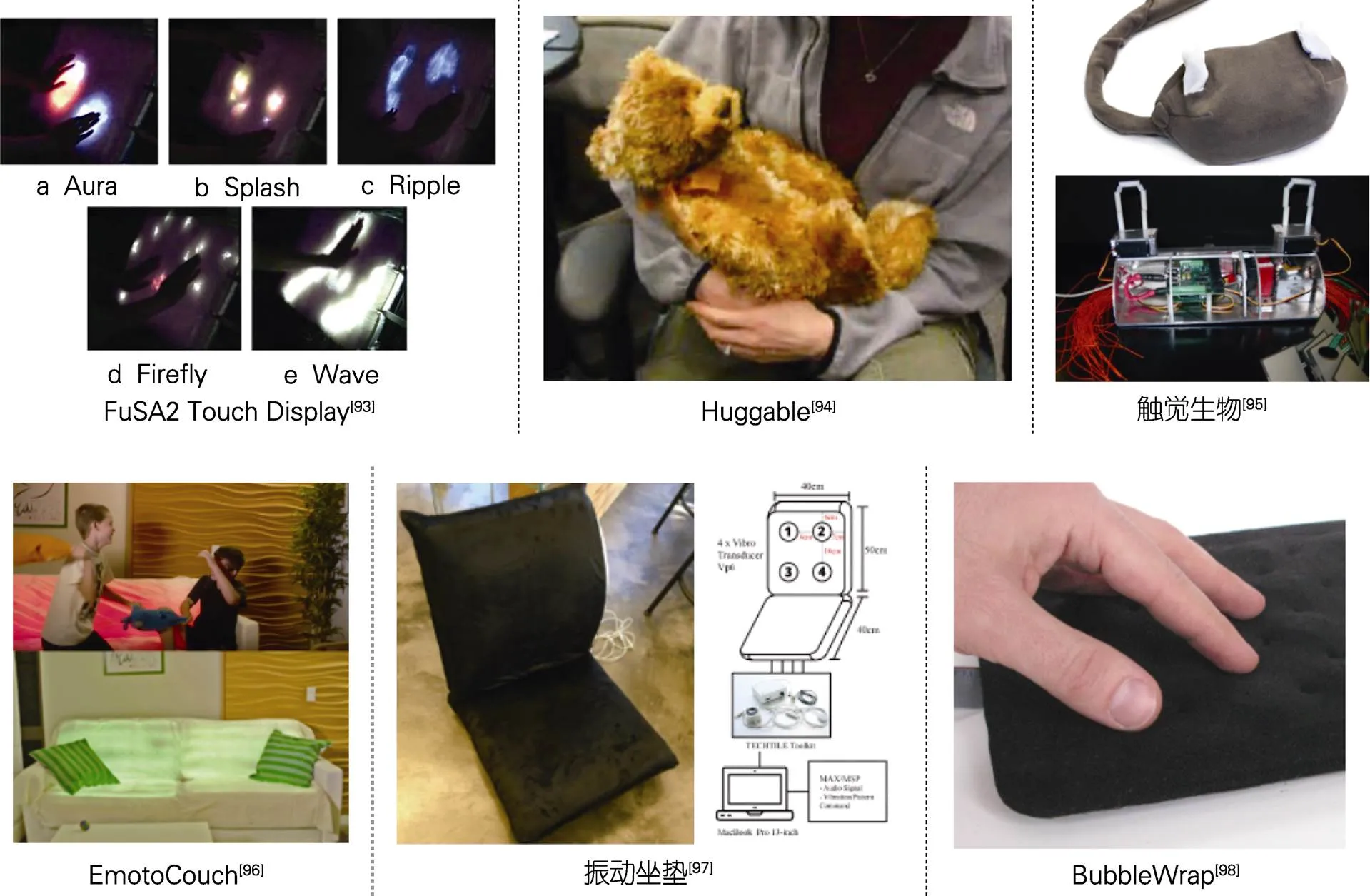

触觉的情感语义十分丰富,既可以传达情绪的高低,又可以传达情绪的类型[90]。情感计算技术使研究者可以通过用户触觉行为推测其情绪状态,以及应用不同的触觉技术唤起用户不同的情感。通过触觉行为进行检测是一种侵入性较小的情感感知技术[22],比如压力特征可能有助于区别沮丧和兴奋两种情绪[91]。在智能家居环境中的可触表面上集成触摸感受器,可以隐式地捕捉用户的情绪状态并予以响应。比如,通过愉悦的触觉增强亲密关系的沟通相处;使用表面摩擦可表示信息的关键情感元素;支持与儿童、残障人士的艺术感知和表达等[92]。

触摸和身体动作,比如拥抱或抚摸手臂,也可被编码为表征情感语义的触觉信号[49]。如图8所示,FuSA2 Touch Display[93]是一种毛茸茸的可伸缩多点触摸显示屏,根据用户抚摸和挠抓其表面纤维,视觉图像会发生移动而变形。这类情感触觉也可以应用于具备情感治疗功能的可触机器人。Huggable[94]是一款陪伴玩具泰迪熊,可以识别用户与其触摸互动中的各类手势。Yohanan和MacLean有意避免对特定动物的再现,开发了一只“触觉生物[95]”,它可以基于不同的抚摸手势做出不同的触觉反馈,如规律的柔和振动(打呼噜或呼吸)和软化耳朵等,以协调情感上的耦合互动。

嵌入了定向振动触觉反馈的家具也可以具备隐形调节用户日常生活中情绪的潜力。比如振动沙发[96]、振动坐垫[97]、可膨胀的振动键盘BubbleWrap[98]等。

5.3 触觉媒体

嵌入家居产品(尤其是能够保持身体接触的家具)中的触觉反馈不仅可以传递情感,还可以辅助实现居家式的沉浸式媒体体验,对视听数字媒体信息进行“再物质化”[99],增强媒体内容的交互性和理解度[40]。

Cha等[100]把触觉媒体分为2类:传递预先记录信息流的被动触觉“回放”和给予用户自由意愿探索的主动触觉交互。被动触觉回放一般与影音媒体相结合,用户使用嵌入家具的触觉刺激器或者独立的动觉触觉设备(如触觉手套、臂套等),来感受时序性的线性触觉介质,如同个人4D影院。而家庭线上购物场景中,主动触觉设备可以捕获目标物品的2.5维深度场景或完整三维图景,并通过给用户指尖提供力反馈和纹理等触觉特征,邀请用户发挥主观能动性来感受物体。目前已有多种轻便式的触觉反馈设备,包含指尖佩戴式的[101-102]和固定式的[103]。

游戏类娱乐体验也是触觉媒体的主要应用场景之一。TouchTV[104]是一种触觉遥控器,通过在圆形操纵杆上添加力反馈,能够很好地增强电子游戏的体验感和参与感。将触觉遥控器与沙发摇床进行结合,可以分层次显示触觉反馈。比如体育观赛场景中,遥控器上可以显示较弱的冲击,而在沙发摇床上可以显示较强的冲击来突出表达射门。Stevenson等[105]提出了一种充气式的可变形触觉显示器,胶乳表面的曲率和硬度随容器中空气密度而变化,可以模拟鼓等乐器,也可以用于显示二/三维图像的Z轴变形。

图8 情感触觉设备

未来的多模态触觉设备能够通过整合的刺激来同时激活人类触觉通道的多个受体[106],更好地保证用户与虚拟对象的高保真触觉交互。比如,Guo等[107]开发了一种磁响应软触觉装置进行精细纹理的显示。

6 触觉体验设计工具

Schneider等[42]将“触觉体验设计(Haptic Experience Design,简称HaXD)”定义为通过将交互技术与一种或多种感知触觉进行有意图地结合来进行用户体验的设计。然而,将触觉交互技术实际应用到智能家居场景中,对于不熟悉触觉领域的用户体验设计师是一个巨大的挑战,原因包括触觉硬件的庞大多样性,缺乏描述、绘制、共享和测试想法的手段,以及缺乏过程示例或指导方针[108]。因此有必要使用一些设计工具来进行概念的开发和测试。

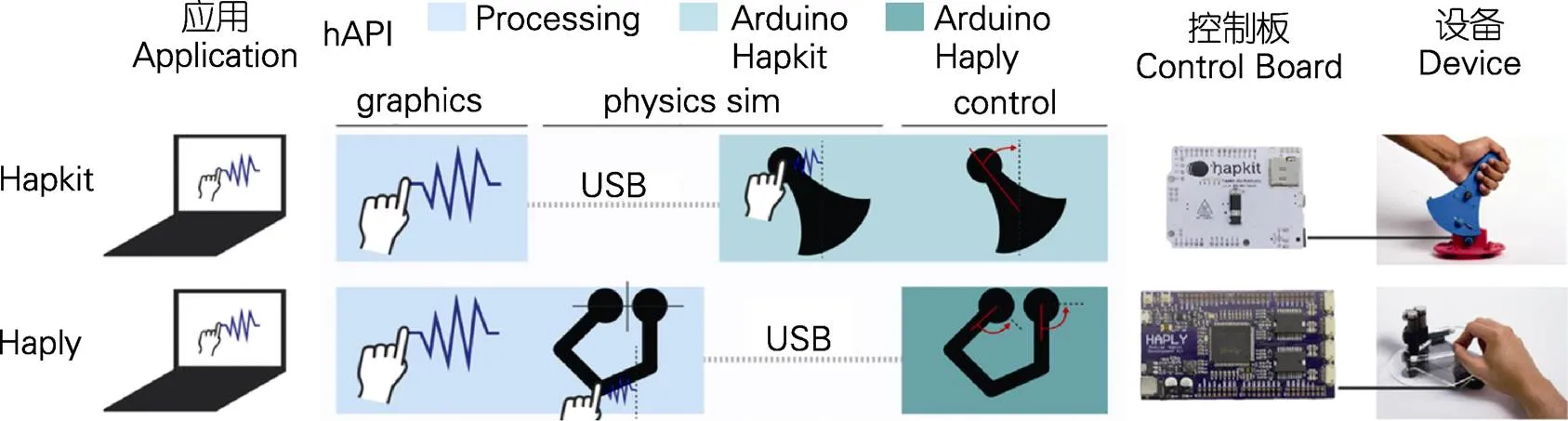

为了降低非专家的应用壁垒,Hayward和MacLean在2篇鼓励DIY搭建触觉交互原型的论文中详细介绍了触觉接口、操作原理和如何调试相对简单的设备进行实验[109],以及触觉交互的表达能力与情感设计,并强调了设计从以技术为中心转向以用户为中心的必要性[110]。Moussette等[111]开发了一种简单触觉的简单驱动机制,可以作为平台和构建块,用于快速绘制、理解、探索、实验、构建变体和开发主题的触觉设备设计。Seifi等[108]开发了一套触觉设计工具包,包含了Hapkit[112]和Haply[113]开源定制触觉控制板,和hAPI应用程序编程接口,来协助新手进行低成本的触觉设备原型设计,见图9。Seifi等还创建了Haptipedia[114],一个将零散的触觉反馈形式及设备的语料库进行汇总分类的平台,交互设计师可以搜索和浏览105个触觉设备的数据库,权衡设计策略。

图9 触觉交互原型设计工具[108]

7 结语

本文论述了触觉交互在智能家居场景中的优势、适用技术和物理载体,提出了居家触觉界面的设计框架,并梳理了具体的触觉交互体验类型与原型设计工具。“家”是人类寻找安全感、归属感、控制感和私密感的最重要场所。触觉界面有助于让智能的家与人的生活智慧相结合,平静地适应以用户为中心的最自然的居家方式,优化系统的上下文感知,降低交互成本、提升交互效率。同时,触觉界面也提供一个具身的信息交互环境,为用户营造更加私人化、情感化、沉浸式的体验。

触觉在提升用户与智能家居系统的自然化交互体验上有诸多优势和潜力,但也具有一定的局限性,比如指尖以外的触觉感知分辨率较低、对刺激的适应导致感知敏感度降低、容易受其他模态影响等。交互设计师和用户体验设计师可以密切关注国内外触觉交互理论和技术领域的快速发展,结合对智能家居概念内涵的剖析和对用户需求的深入洞察,进行触觉交互体验的设计创新。

[1] LI Min, GU Wen-bin, CHEN Wei, et al. Smart Home: Architecture, Technologies and Systems[J]. Procedia Computer Science, 2018, 131(1): 393-400.

[2] MARIKYAN D, PAPAGIANNIDIS S, ALAMANOS E. A Systematic Review of the Smart Home Literature: A User Perspective[J]. Technological Forecasting and Social Change, 2019, 138(1): 139-154.

[3] DAVIDOFF S, LEE M K, YIU C, ZIMMERMAN J, DEY A K. Principles of Smart Home Control[C]// UbiComp 2006: Ubiquitous Computing. Berlin: Springer Berlin Heidelberg, 2006.

[4] WILSON C, HARGREAVES T, HAUXWELL- BALDWIN R. Smart Homes and Their Users: A Systematic Analysis and Key Challenges[J]. Personal and Ubiquitous Computing, 2015, 19(2): 463-476.

[5] HERCZEG M. The Smart, the Intelligent and the Wise: Roles and Values of Interactive Technologies[J]. ACM International Conference Proceeding Series, 2010(1): 17-26.

[6] 路璐, 田丰, 戴国忠, 等. 融合触、听、视觉的多通道认知和交互模型[J]. 计算机辅助设计与图形学学报, 2014, 26(4): 654-661.

LU Lu, TIAN Feng, DAI Guo-zhong, et al. A Study of the Multimodal Cognition and Interaction Based on Touch, Audition and Vision[J]. Journal of Computer- Aided Design & Computer Graphics, 2014, 26(4): 654-661.

[7] GRAM-HANSSEN K, DARBY S J. "Home is where the Smart is"? Evaluating Smart Home Research and Approaches Against the Concept of Home[J]. Energy Research & Social Science, 2018, 37(1): 94-101.

[8] DOUGLAS M. The Idea of a Home: A Kind of Space[J]. Social Research, 1991, 58(1): 287-307.

[9] YANG H, LEE H, ZO H. User Acceptance of Smart Home Services: An Extension of the Theory of Planned Behavior[J]. Industrial Management & Data Systems, 2017, 117(1): 68-89.

[10] SAIZMAA T, KIM H C. Smart home design: Home or house? [C]// 2008 Third International Conference on Convergence and Hybrid Information Technology. Busan: IEEE, 2008.

[11] SHUHAIBER A, MASHAL I. Understanding Users' Acceptance of Smart Homes[J]. Technology in Society, 2019, 58(1): 101110.

[12] ALAM M R, REAZ M B I, ALI M A M. Statistical Modeling of the Resident's Activity Interval in Smart Homes[J]. Journal of Applied Sciences, 2011, 11(16): 3058-3061.

[13] TAYLOR A S, SWAN L. Artful Systems in the Home[C]// Proceedings of the SIGCHI Conference on Human Factors in Computing Systems. Portland: ACM, 2005.

[14] ALAM M R, REAZ M B I, ALI M A M. A Review of Smart Homes: Past, Present, and Future[J]. IEEE Transactions on Systems, Man, and Cybernetics, Part C (Applications and Reviews), 2012, 42(6): 1190-1203.

[15] POTT P P. Haptic Interfaces[M]. Amsterdam: Elsevier, 2022: 257-274.

[16] YIN J, HINCHET R, SHEA H, et al. Wearable Soft Technologies for Haptic Sensing and Feedback[J]. Advanced Functional Materials, 2021, 31(39): 2007428.

[17] DAN J. Haptic or Touch-Based Knowledge[M]. Amsterdam: Elsevier, 2020: 291-296.

[18] HAYWARD V, ASTLEY O R, CRUZ-HERNANDEZ M, et al. Haptic Interfaces and Devices[J]. Sensor Review, 2004, 24(1): 16-29.

[19] GILLESPIE R B, O'MODHRAIN S. Embodied cognition as a motivating perspective for haptic interaction design: A position paper[C]// 2011 IEEE World Haptics Conference. Istanbul: IEEE, 2011.

[20] CHOUVARDAS V G, MILIOU A N, HATALIS M K. Tactile Displays: Overview and Recent Advances[J]. Displays, 2008, 29(3): 185-194.

[21] GALLACE A, SPENCE C. The Cognitive and Neural Correlates of "Tactile Consciousness": A Multisensory Perspective[J]. Consciousness and Cognition, 2008, 17(1): 370-407.

[22] GAO Yuan, BIANCHI-BERTHOUZE N, MENG Hong- ying. What does Touch Tell us about Emotions in Touchscreen-Based Gameplay? [J]. ACM Transactions on Computer-Human Interaction, 2012, 19(4): 31.

[23] MACLEAN K E. Designing with Haptic Feedback[C]// IEEE International Conference on Robotics and Automation, Symposia Proceedings (Cat. No.00CH37065), San Francisco: IEEE, 2000.

[24] POUPYREV I, MARUYAMA S, REKIMOTO J. Ambient Touch: Designing Tactile Interfaces for Handheld Devices[C]// Proceedings of the 15th Annual Acm Symposium on User Interface Software and Technology (UIST '02). New York: ACM, 2002.

[25] MACLEAN K E. Haptic Interaction Design for Everyday Interfaces[J]. Reviews of Human Factors and Ergonomics, 2008, 4(1): 149-194.

[26] 曾栋, 周砖, 程海峰, 等. 产品设计中的触觉体验研究[J]. 包装工程, 2020, 41(2): 134-141.

ZENG Dong, ZHOU Zhuan, CHENG Hai-feng, et al. Tactile Experience in Product Design[J]. Packaging Engineering, 2020, 41(2): 134-141.

[27] MACLEAN K E. Putting Haptics into the Ambience[J]. IEEE Transactions on Haptics, 2009, 2(3): 123-135.

[28] ENRIQUEZ M, MACLEAN K, CHITA C. Haptic Phonemes: Basic Building Blocks of Haptic Communication[C]// Proceedings of the 8th international conference on Multimodal interfaces. New York: ACM, 2006: 302-309.

[29] 李宏汀, 陈柏鸿, 葛列众. 触觉交互研究的回顾与展望[J]. 人类工效学, 2008, 14(3): 51-53, 17.

LI Hong-ting, CHEN Bai-Hong, GE Lie-zhong. Review and Prospect of Tactile Interaction Research[J]. Chinese Journal of Ergonomics, 2008, 14(3): 51-53, 17.

[30] WEISER M. The Computer for the 21st Century[J]. Scientific American, 1991, 265(3): 94-104.

[31] PACCHIEROTTI C, SINCLAIR S, SOLAZZI M, et al. Wearable Haptic Systems for the Fingertip and the Hand: Taxonomy, Review, and Perspectives[J]. IEEE Transactions on Haptics, 2017, 10(4): 580-600.

[32] KIM S W, KIM S H, KIM C S, et al. Thermal Display Glove for Interacting with Virtual Reality[J]. Scientific Reports, 2020, 10(1): 1-12.

[33] HEIKKINEN J, OLSSON T, VÄÄNÄNEN-VAINIO- MATTILA K. Expectations for User Experience in Haptic Communication with Mobile Devices[C]//Proceedings of the 11th International Conference on Human- Computer Interaction with Mobile Devices and Services. New York: ACM, 2009.

[34] JONES L A, SARTER N B. Tactile Displays: Guidance for Their Design and Application[J]. Human Factors, 2008, 50(1): 90-111.

[35] SREELAKSHMI M, SUBASH T D. Haptic Technology: A Comprehensive Review on Its Applications and Future Prospects[J]. Materials Today: Proceedings, 2017, 4(2): 4182-4187.

[36] 曹建国, 周建辉, 缪存孝, 等. 电子皮肤触觉传感器研究进展与发展趋势[J]. 哈尔滨工业大学学报, 2017, 49(1): 1-13.

CAO Jian-guo, ZHOU Jian-hui, MIAO Cun-xiao, et al. Research Progress and Development Strategy on Tactile Sensors for E-Skin[J]. Journal of Harbin Institute of Technology, 2017, 49(1): 1-13.

[37] BISWAS S, VISELL Y. Emerging Material Technologies for Haptics[J]. Advanced Materials Technologies, 2019, 4(4): 1900042.

[38] WANG D, XIAO J, ZHANG Y. Haptic Rendering for Simulation of Fine Manipulation[M]. Berlin: Springer, 2014.

[39] BERMEJO C, HUI Pan. A Survey on Haptic Technologies for Mobile Augmented Reality[J]. ACM Computing Surveys, 2022, 54(9): 184.

[40] 赵璐, 刘越, 祃卓荦. 触觉再现技术研究进展[J]. 计算机辅助设计与图形学学报, 2018, 30(11): 1979-2000.

ZHAO Lu, LIU Yue, MA Zhuo-luo. Research Progress of Tactile Representation Technology[J]. Journal of Computer-Aided Design & Computer Graphics, 2018, 30(11): 1979-2000.

[41] OZIOKO O, NAVARAJ W, HERSH M, et al. Tacsac: A Wearable Haptic Device with Capacitive Touch- Sensing Capability for Tactile Display[J]. Sensors (Basel, Switzerland), 2020, 20(17): 4780.

[42] SCHNEIDER O, MACLEAN K, SWINDELLS C, et al. Haptic Experience Design: What Hapticians do and where they Need Help[J]. International Journal of Human-Computer Studies, 2017, 107: 5-21.

[43] Hoffmann F, TYROLLER M I, WENDE F, HENZE N. User-defined Interaction for Smart Homes: Voice, Touch, or Mid-air Gestures?[C]// Proceedings of the 18th International Conference on Mobile and Ubiquitous Multimedia (MUM '19). New York: ACM, 2019.

[44] JONES M H, ARCELUS A, GOUBRAN R, et al. A Pressure Sensitive Home Environment[J]. 2006 IEEE International Workshop on Haptic Audio Visual Environments and Their Applications, 2006: 10-14.

[45] 米海鹏, 王濛, 卢秋宇, 等. 实物用户界面: 起源、发展与研究趋势[J]. 中国科学: 信息科学, 2018, 48(4): 390-405.

MI Hai-peng, WANG Meng, LU Qiu-yu, et al. Tangible User Interface: Origins, Development, and Future Trends[J]. Scientia Sinica (Informationis), 2018, 48(4): 390-405.

[46] GIBSON J J. Observations on Active Touch[J]. Psychological Review, 1962, 69: 477-491.

[47] LEDERMAN S J, KLATZKY R L. Haptic Perception: A Tutorial[J]. Attention, Perception, & Psychophysics, 2009, 71(7): 1439-1459.

[48] HERSSENS J, HEYLIGHEN A. Haptic Design Research: A Blind Sense of Space[C]//Proceedings of the 7th ARCC/EAAE 2010 International Conference on Architectural Research, Washington, DC: ARCC, 2011.

[49] BAURLEY S. Interactive and Experiential Design in Smart Textile Products and Applications[J]. Personal and Ubiquitous Computing, 2004, 8(3): 274-281.

[50] 50. TAYLOR A S, HARPER R, SWAN L, et al. Homes that Make us Smart[J]. Personal and Ubiquitous Computing, 2007, 11(5): 383-393.

[51] TIGWELL G W, CRABB M. Household Surface Interactions: Understanding User Input Preferences and Perceived Home Experiences[C] //Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2020.

[52] PHILIPOSE M, FISHKIN K P, PERKOWITZ M, et al. Inferring Activities from Interactions with Objects[J]. IEEE Pervasive Computing, 2004, 3(4): 50-57.

[53] DEGRAEN D, SCHUBHAN M, KOSMALLA F, ZENNER A, DAIBER F. Ambient Living Media as Haptic Proxy Interfaces for Virtual Reality[C]// Workshop on Everyday Proxy Objects for Virtual Reality at CHI'21. Yokohama: ACM, 2021.

[54] DEMENTYEV A, GÁLVEZ T V, OLWAL A. SensorSnaps: Integrating Wireless Sensor Nodes into Fabric Snap Fasteners for Textile Interfaces[C]// Proceedings of the 32nd Annual ACM Symposium on User Interface Software and Technology. New York: ACM, 2019.

[55] KARRER T, WITTENHAGEN M, LICHTSCHLAG L, et al. Pinstripe: Eyes-Free Continuous Input on Interactive Clothing[C]// Proceedings of the SIGCHI Conference on Human Factors in Computing Systems. New York: ACM, 2011.

[56] OLBERDING S, ORTEGA S S, HILDEBRANDT K, et al. Foldio: Digital Fabrication of Interactive and Shape- Changing Objects with Foldable Printed Electronics[C]// Proceedings of the 28th Annual ACM Symposium on User Interface Software & Technology. New York: ACM, 2015.

[57] GROEGER D, STEIMLE J. ObjectSkin: Augmenting Everyday Objects with Hydroprinted Touch Sensors and Displays[J]. Proceedings of the ACM on Interactive, Mobile, Wearable and Ubiquitous Technologies, 2017, 1(4): 134.

[58] TADA T, HIRAI S. Transmissive LED Touch Display for Engineered Marble[C]// UIST '20 Adjunct: Adjunct Publication of the 33rd Annual ACM Symposium on User Interface Software and Technology. New York: ACM, 2020: 145-147.

[59] IKEMATSU K, FUKUMOTO M, SIIO I. Ohmic- Sticker: Force-to-Motion Type Input Device for Capacitive Touch Surface[C]// CHI EA '19: Extended Abstracts of the 2019 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2019.

[60] GONG Nan-wei, STEIMLE J, OLBERDING S, et al. PrintSense: A Versatile Sensing Technique to Support Multimodal Flexible Surface Interaction[C]// Proceedings of the SIGCHI Conference on Human Factors in Computing Systems. New York: ACM, 2014.

[61] SEO E, BAE S, CHOI H, et al. Preference and Usability of Smart-Home Services and Items-a Focus on the Smart-Home Living-Lab[J]. Journal of Asian Architecture and Building Engineering, 2021, 20(6): 650-662.

[62] GIANSANTI D, MACCIONI G, MORELLI S. An Experience of Health Technology Assessment in New Models of Care for Subjects with Parkinson's Disease by Means of a New Wearable Device[J]. Telemedicine Journal and e-Health: the Official Journal of the American Telemedicine Association, 2008, 14(5): 467-472.

[63] NAJAFI B. SmartSox: A smart textile to prevent diabetic foot amputation[C]// Qatar Foundation Annual Research Forum Proceedings. Doha: Hamad bin Khalifa University Press (HBKU Press), 2013.

[64] ZIEBA J, FRYDRYSIAK M. Textronics-Electrical and Electronic Textiles. Sensors for Breathing Frequency Measurement[J]. Fibres and Textiles in Eastern Europe, 2006, 14(5): 43-48.

[65] FURLANETTO K C, BISCA G W, OLDEMBERG N, et al. Step Counting and Energy Expenditure Estimation in Patients with Chronic Obstructive Pulmonary Disease and Healthy Elderly: Accuracy of 2 Motion Sensors[J]. Archives of Physical Medicine and Rehabilitation, 2010, 91(2): 261-267.

[66] PATEL S A, BENZO R P, SLIVKA W A, et al. Activity Monitoring and Energy Expenditure in COPD Patients: A Validation Study[J]. COPD, 2007, 4(2): 107-112.

[67] TAN H Z, SLIVOVSKY L A, PENTLAND A. A Sensing Chair Using Pressure Distribution Sensors[J]. IEEE/ASME Transactions on Mechatronics, 2001, 6(3): 261-268.

[68] KUMAR R, BAYLIFF A, DE D, et al. Care-chair: Sedentary activities and behavior assessment with smart sensing on chair backrest[C]// 2016 IEEE International Conference on Smart Computing. St. Louis: IEEE, 2016.

[69] JONES M H, GOUBRAN R, KNOEFEL F. Reliable Respiratory Rate Estimation from a Bed Pressure Array[J]. 2006 International Conference of the IEEE Engineering in Medicine and Biology Society, 2006: 6410-6413.

[70] DANESH A, LAAMARTI F, EL SADDIK A. HAVAS: The Haptic Audio Visual Sleep Alarm System[M]. Cham: Springer International Publishing, 2015: 247-256.

[71] WANG Hai-ying, ZHENG Hui-ru, AUGUSTO J C, et al. Monitoring and analysis of sleep pattern for people with early dementia[C]// 2010 IEEE International Conference on Bioinformatics and Biomedicine Workshops. Hong Kong, China: IEEE.

[72] SAMY L, HUANG Ming-chun, LIU J J, et al. Unobtrusive Sleep Stage Identification Using a Pressure- Sensitive Bed Sheet[J]. IEEE Sensors Journal, 2014, 14(7): 2092-2101.

[73] NIIJIMA A, TAKEDA T, MUKOUCHI T, et al. ThermalBitDisplay: Haptic Display Providing Thermal Feedback Perceived Differently Depending on Body Parts[C]// CHI EA '20: Extended Abstracts of the 2020 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2020.

[74] URAMUNE R, ISHIZUKA H, HIRAKI T, et al. HaPouch: Soft and Wearable Haptic Display Devices Using Liquid-to-Gas Phase Change Actuator[C]// UIST '20 Adjunct: Adjunct Publication of the 33rd Annual ACM Symposium on User Interface Software and Technology. New York: ACM, 2020.

[75] PECE F, ZARATE J J, VECHEV V, et al. MagTics: Flexible and Thin Form Factor Magnetic Actuators for Dynamic and Wearable Haptic Feedback[C]// Proceedings of the 30th Annual ACM Symposium on User Interface Software and Technology. New York: ACM, 2017.

[76] BENBASAT A Y, MORRIS S J, PARADISO J A. A Wireless Modular Sensor Architecture and Its Application in On-Shoe Gait Analysis[J]. Sensors, 2003 IEEE, 2003, 2: 1086-1091Vol.2.

[77] MIDDLETON L, BUSS A A, BAZIN A, et al. A floor sensor system for gait recognition[C]// Fourth IEEE Workshop on Automatic Identification Advanced Technologies (AutoID'05). Buffalo: IEEE, 171-176.

[78] LI You, GAO Zhou-zheng, HE Zhe, et al. Multi-Sensor Multi-Floor 3D Localization with Robust Floor Detection[J]. IEEE Access, 6: 76689-76699.

[79] DONG Kai, PENG Xiao, AN Jie, et al. Shape Adaptable and Highly Resilient 3D Braided Triboelectric Nanogenerators as E-Textiles for Power and Sensing[J]. Nature Communications, 2020, 11(1): 1-11.

[80] SHI Qiong-feng, ZHANG Zi-xuan, HE T, et al. Deep Learning Enabled Smart Mats as a Scalable Floor Monitoring System[J]. Nature Communications, 2020, 11(1): 4609.

[81] MA Jin-ming, JIE Yang, BIAN Jie, et al. From Triboelectric Nanogenerator to Self-Powered Smart Floor: A Minimalist Design[J]. Nano Energy, 2017, 39(1): 192-199.

[82] KIM K B, CHO J Y, JABBAR H, et al. Optimized Composite Piezoelectric Energy Harvesting Floor Tile for Smart Home Energy Management[J]. Energy Conversion and Management, 2018, 171(1): 31-37.

[83] VISELL Y, LAW A, COOPERSTOCK J R. Touch is Everywhere: Floor Surfaces as Ambient Haptic Interfaces[J]. IEEE Transactions on Haptics, 2009, 2(3): 148-159.

[84] WALL S A, BREWSTER S. Sensory Substitution Using Tactile Pin Arrays: Human Factors, Technology and Applications[J]. Signal Processing, 2006, 86(12): 3674-3695.

[85] WITHANA A, GROEGER D, STEIMLE J. Tacttoo: A Thin and Feel-through Tattoo for On-Skin Tactile Output[C]// Proceedings of the 31st Annual ACM Symposium on User Interface Software and Technology. New York: ACM, 2018.

[86] NITTALA A S, WITHANA A, POURJAFARIAN N, et al. Multi-Touch Skin: A Thin and Flexible Multi-Touch Sensor for On-Skin Input[C]// Proceedings of the 2018 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2018.

[87] HAMDAN N A H, WAGNER A, VOELKER S, et al. Springlets: Expressive, Flexible and Silent On-Skin Tactile Interfaces[C]// Proceedings of the 2019 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2019.

[88] LUO Yi-yue, WU Kui, PALACIOS T, et al. KnitUI: Fabricating Interactive and Sensing Textiles with Machine Knitting[C]// Proceedings of the 2021 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2021.

[89] KUROGI T, YONEHARA Y, PEIRIS R L, et al. HAPTIC PLASTeR: Soft, Thin, Light and Flexible Haptic Display Using DEA Composed of Slide-Ring Material for Daily Life[C]// SIGGRAPH '19: ACM SIGGRAPH 2019 Emerging Technologies. New York: ACM, 2019.

[90] JONES S E, YARBROUGH A E. A Naturalistic Study of the Meanings of Touch[J]. Communication Monographs, 1985, 52(1): 19-56.

[91] LV Hai-rong, LIN Zhong-lin, YIN Wen-jun, et al. Emotion recognition based on pressure sensor keyboards[C]// 2008 IEEE International Conference on Multimedia and Expo. Hannover: IEEE, 2008.

[92] MULLENBACH J, SHULTZ C, COLGATE J E, et al. Exploring Affective Communication through Variable- Friction Surface Haptics[C]// Proceedings of the SIGCHI Conference on Human Factors in Computing Systems. New York: ACM, 2014.

[93] NAKAJIMA K, ITOH Y, TSUKITANI T, et al. FuSA2 Touch Display: A furry and scalable multi-touch display[C]// 2012 IEEE Virtual Reality Workshops. Costa Mesa : IEEE, 2012.

[94] STIEHL W D, LIEBERMAN J, BREAZEAL C, et al. Design of a Therapeutic Robotic Companion for Relational, Affective Touch[J]. ROMAN 2005 IEEE International Workshop on Robot and Human Interactive Communication, 2005, 2005: 408-415.

[95] YOHANAN S, MACLEAN K E. The Haptic Creature Project: Social HumanRobot Interaction through Affective Touch[C], Proc. of The Reign of Katz and Dogz, 2nd AISB Symp on the Role of Virtual Creatures in a Computerised Society (AISB '08), Aberdeen: AISB, 2008.

[96] MENNICKEN S, BRUSH A J B, ROSEWAY A, et al. Exploring Interactive Furniture with EmotoCouch[C]// Proceedings of the 2014 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct Publication. New York: ACM, 2014.

[97] CHANDRA Y, PEIRIS R, MINAMIZAWA K. Affective Haptic Furniture: Directional Vibration Pattern to Regulate Emotion[C]// Proceedings of the 2018 ACM International Joint Conference and 2018 International Symposium on Pervasive and Ubiquitous Computing and Wearable Computers. New York: ACM, 2018.

[98] BAU O, PETREVSKI U, MACKAY W. BubbleWrap: A Textile-Based Electromagnetic Haptic Display[C]// CHI EA '09: CHI '09 Extended Abstracts on Human Factors in Computing Systems. New York: ACM, 2009.

[99] 梁德阔. 无中介性:触觉媒体的功能、研究及实践[J]. 现代传播(中国传媒大学学报), 2022, 44(1): 136-145.

LIANG De-kuo. Non-Intermediary: Function, Research and Practice of Tactile Media[J]. Modern Communication (Journal of Communication University of China), 2022, 44(1): 136-145.

[100] CHA J, HO Y S, KIM Y, et al. A Framework for Haptic Broadcasting[J]. IEEE MultiMedia, 2009, 16(3): 16-27.

[101] MURAKAMI T, PERSON T, FERNANDO C L, et al. Altered Touch: Miniature Haptic Display with Force, Thermal and Tactile Feedback for Augmented Haptics[C]// SIGGRAPH '17: ACM SIGGRAPH 2017 Emerging Technologies. New York: ACM, 2017.

[102] TALHAN A, KIM H, JEON S. Wearable Soft Pneumatic Ring with Multi-Mode Controlling for Rich Haptic Effects[C]// SIGGRAPH '19: ACM SIGGRAPH 2019 Posters. New York: ACM, 2019: 1-2.

[103] FEDOSEEV A, TLEUGAZY A, LABAZANOVA L, et al. TeslaMirror: Multistimulus Encounter-Type Haptic Display for Shape and Texture Rendering in VR[C]// SIGGRAPH '20: ACM SIGGRAPH 2020 Emerging Technologies. New York: ACM, 2020.

[104] O'MODHRAIN S, OAKLEY I. Touch TV: Adding Feeling to Broadcast Media[C]// Proceedings of the European Conference on Interactive Television: from Viewers to Actors. Brighton: University of Brighton, 2003

[105] STEVENSON A, PEREZ C, VERTEGAAL R. An Inflatable Hemispherical Multi-Touch Display[C]// Proceedings of the Fifth International Conference on Tangible, Embedded, and Embodied Interaction. New York: ACM, 2011.

[106] WANG Dang-xiao, OHNISHI K, XU Wei-liang. Multimodal Haptic Display for Virtual Reality: A Survey[J]. IEEE Transactions on Industrial Electronics, 2020, 67(1): 610-623.

[107] GUO Yuan, TONG Qian-qian, LIU Xian-zhong, et al. MRS-Tex: A Magnetically Responsive Soft Tactile Device for Texture Display[J]. IEEE Transactions on Industrial Electronics, 2022, 69(11): 11531-11540.

[108] SEIFI H, CHUN M, GALLACHER C, et al. How do Novice Hapticians Design? a Case Study in Creating Haptic Learning Environments[J]. IEEE Transactions on Haptics, 2020, 13(4): 791-805.

[109] HAYWARD V, MACLEAN K E. Do It Yourself Haptics: Part I[J]. IEEE Robotics & Automation Magazine, 2007, 14(4): 88-104.

[110] MACLEAN K E, HAYWARD V. Do it yourself Haptics: Part II [Tutorial[J]. IEEE Robotics & Automation Magazine, 2008, 15(1): 104-119.

[111] MOUSSETTE C, BANKS R. Designing through Making: Exploring the Simple Haptic Design Space[C]// Proceedings of the Fifth International Conference on Tangi-ble, Embedded, and Embodied Interaction. New York: ACM, 2011.

[112] MARTINEZ M O, MORIMOTO T K, TAYLOR A T, et al. 3-DPrinted Haptic Devices for Educational Applications[C]// 2016 IEEE Haptics Symposium. Philadelphia: IEEE, 2016.

[113] GALLACHER C, MOHTAT A, DING S, et al. Toward open-source Portable Haptic Displays with Visual-force- Tactile Feedback Colocation[C]// 2016 IEEE Haptics Symposium. Philadelphia: IEEE, 2016.

[114] SEIFI H, FAZLOLLAHI F, OPPERMANN M, et al. Haptipedia: Accelerating Haptic Device Discovery to Support Interaction & Engineering Design[C]// Proceedings of the 2019 CHI Conference on Human Factors in Computing Systems. New York: ACM, 2019.

Haptic Interaction Experience in Smart Homes

WANG Yun1a,2, HE LI-wen1a, WANG Dang-xiao1

(1.a.School of Mechanical Engineering and Automation, b.State Key Laboratory of Virtual Reality Technology and System, Beihang University, Beijing 100191, China; 2.a.Academy of Arts&Design. b.The Future Laboratory, Tsinghua University, Beijing 100084, China)

Touch, as the most direct and essential sensory channel for human beings to actively perceive and respond to the external world and other individuals, has become a research focus of interaction design and user experience design in recent years. Due to the multiple dimensions of human haptic perception, the diversity of sensing and driving technologies, and the existence of various natural tactile feedback inside the home, haptic interaction has not been fully utilized in smart home scenarios. Today, with the gradual popularization of smart home systems, haptic interaction helps smart devices to more naturally integrate into the daily life scenes familiar with users, and optimize the user experience. Based on the connotation and development trend of natural human-computer interaction in smart home, this paper discusses the natural advantages of touch the current haptic technologies, as well as determines the adequate technologies and design framework of haptic interfaces in the home context. Through a large number of case studies, it can be found that discriminating haptic interaction can reduce the cost, improve the operation efficiency, interaction naturalness and user comfort in the control, monitoring, display and security scenes of smart home, while retaining the familiar household objects and related lifestyle of users, optimize their smart living experience; at the same time, haptic interaction can also put forward new solutions and new devices in sensory enhancement, emotional communication, multimodal media and other aspects, bringing into play the unique emotion-carrying ability of touch, while expanding the immersion experience of smart home for users. In addition, a series of design tools are listed to help designers build haptic interaction experience.

smart home, haptic interaction, haptic experience, haptic interface, touchable home surface

TB472

A

1001-3563(2022)16-0037-13

10.19554/j.cnki.1001-3563.2022.16.004

2022–04–06

自然科学基金面上项目(62172252)

王韫(1985—),女,清华大学博士生,北京航空航天大学讲师,主要研究方向为感知觉体验设计和跨学科设计思维教育。

王党校(1976—),男,北京航空航天大学教授,虚拟现实技术与系统国家重点实验室副主任,主要研究方向为机器触觉、人体触觉、医疗机器人和脑机交互。

责任编辑:陈作