基于无人机多源图谱融合的水稻稻穗表型监测

万 亮,杜晓月,陈硕博,于丰华,朱姜蓬, 许童羽,何 勇,3,岑海燕,3※

(1.浙江大学华南工业技术研究院,浙江大学生物系统工程与食品科学学院,杭州310058; 2.农业农村部光谱检测重点实验室,杭州310058;3.浙江大学现代光学仪器国家重点实验室,杭州 310027; 4.沈阳农业大学信息与电气工程学院,沈阳110866; 5.辽宁省农业信息化工程技术研究中心,沈阳 110866)

0 引 言

水稻是世界上最重要的粮食作物之一,其生长发育状态与产量品质密切相关,准确且有效地监测水稻生长对于提升产量和保障粮食安全至关重要。已有大量研究通过测量叶面积指数、生物量、含水率和叶绿素含量等表型参数去监测水稻生长。其中,稻穗表型是表征水稻生长状况和产量品质最关键的表型参数之一,因此,准确监测稻穗表型对于大田精准管理和水稻智慧育种具有重要意义。

传统的稻穗表型监测主要采用田间调查、采样以及考种等方法,但是这些方法耗时耗力,无法及时获取大面积田间稻穗表型数据。随着传感器技术的发展,近地面表型平台在稻穗表型获取中展现出极大的潜力,如车载平台、导轨式平台以及观测塔等,然而其难以用于跨区域作业,并且工作效率和时空分辨率仍然有限。相比于这些技术,无人机遥感平台具有更高的灵活性和可操作性,且能够准确地监测田间作物的生长变化。研究已经证明了无人机遥感用于监测水稻表型的潜力,包括生物量、冠层覆盖度、株高、叶面积指数和氮含量等,这些表型参数的获取有助于了解水稻生长变化,但其通常用于表征水稻的早期生长变化,无法表征水稻生长后期的稻穗变化以及最终的产量品质。

近年来,一些国内外研究试图利用无人机遥感平台监测水稻生长后期的稻穗表型,比如产量,穗倒伏和穗数。目前,针对稻穗表型监测的无人机机载传感器主要包括高清数码相机、多光谱相机、高光谱相机以及激光雷达,产生了诸如图像颜色、光谱反射率、植被指数以及纹理等多种无人机图谱特征。传统的研究主要侧重于利用机载图像的光谱反射率去监测作物生长,并未充分利用图像纹理和结构等特征,多源图谱特征融合可以减小冠层结构影响和光谱指数饱和问题,从而保留图像更多的细节信息,提升图谱数据用于监测作物生长变化的能力。Zhou等通过融合无人机可见光和多光谱的多种植被指数,利用多元线性回归算法实现了水稻产量的准确预测,决定系数(coefficient of determination,)可达0.75。Wan等进一步引入株高和覆盖度等结构参数,结合无人机可见光和多光谱植被指数,建立了基于随机森林(Random Forest,RF)回归的水稻产量预测模型,显著地改善了不同年间水稻产量的预测精度,为0.83~0.85。Maimaitijiang等利用深度学习融合无人机图像光谱、纹理、结构和温度信息准确地评估了大豆产量,可达0.72。上述研究结果表明无人机多源图谱融合用于水稻稻穗表型监测的可行性,但是上述研究主要针对水稻产量。无人机多源图谱融合用于其他稻穗表型(比如稻穗覆盖度和生物量)的监测效果未知,并且普遍存在试验数据比较单一的问题,不利于鲁棒的稻穗监测模型的开发。

综上可知,基于无人机多源图谱融合的稻穗覆盖度、生物量以及倒伏监测的研究较少。因此,本研究以诸暨籼稻和沈阳粳稻为研究对象,通过无人机平台获取作物冠层可见光和多光谱图像,探究无人机多源图谱数据用于监测水稻抽穗期、灌浆期以及成熟期生长的潜力,然后分析无人机多源图谱融合用于监测稻穗覆盖度、生物量以及倒伏的潜力,最后确定用于水稻稻穗表型评估的最佳模型,以期为高效监测水稻稻穗表型提供一种有效的方法。

1 材料与方法

1.1 试验设计

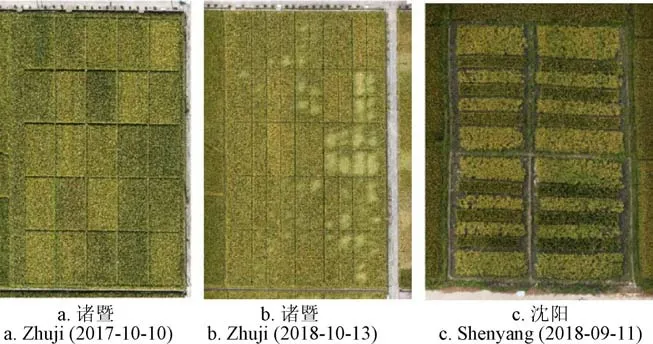

水稻田间试验于2017—2018年在浙江省诸暨市(29°31′5.35″N,120°6′6.12″E)和 辽 宁 省 沈 阳 市(42°0′53.02″N,123°38′16.04″E)进行,试验田概况如图1所示。

图1 试验田布局和空间分布图 Fig.1 The layout and spatial distribution of experimental fields

诸暨试验包括5个氮素梯度(N0~N4),2017年和2018年的氮肥施用量分别为0、72、120、240、360 kg/hm和0、120、240、360、480 kg/hm,试验对象为籼稻品种甬优1540。2017年的诸暨水稻试验包括25个小区,每个小区面积180 m(18 m×10 m)。2018年的试验将2017年的试验田拆分成100个小区,并进一步扩大了氮肥处理差异,每个氮肥梯度设置3次重复。沈阳试验包括24个小区,并根据当地常用施肥量设置了4个氮素梯度(N0~N3),分别为0、50、100、150 kg/hm,每0.033 hm设置一个氮肥处理,每个氮肥梯度设置3次重复,试验对象包含2个粳稻品种(秋光和沈农9816)。试验集中于水稻抽穗期、灌浆初期和灌浆后期,如表1所示。基于这些田间试验设计,本研究收集了不同时间、地点和水稻品种的稻穗表型和无人机图谱数据,从而构建鲁棒的水稻稻穗表型监测模型。

1.2 数据采集

研究采用浙江大学数字农业与农业物联网创新团队独立研发的八旋翼电动无人机作为遥感平台,同时搭载高清数码相机(NEX-7 camera,Sony,Tokyo,Japan)和多光谱相机(MQ022MG-CM,XIMEA,Munster,Germany),相关参数已在先前的研究中公布。获取的可见光(Red-Green-Blue,RGB)和多光谱图像的分辨率分别是6 000×4 000(像素)和409×216(像素),其通过云台与无人机平台稳定连接。多光谱图像包含25个波段,波长范围是604~872 nm。无人机平台的工作时间为当地的10:00—16:00,飞行高度和速度分别为25 m和2.5 m/s,可见光和多光谱图像的地面分辨率分别为6 mm/pixel和4.3 cm/pixel。由于多光谱的图像分辨率低于可见光图像,飞行中根据多光谱图像分别设置前向和旁向重叠率为60%和75%。在无人机飞行试验前,利用照度计(MQ-200,Apogee Instruments,Logan,UT,USA)测量光照强度去调节相机的曝光时间,从而保证获取的图像质量。飞行试验时间如表1所示。

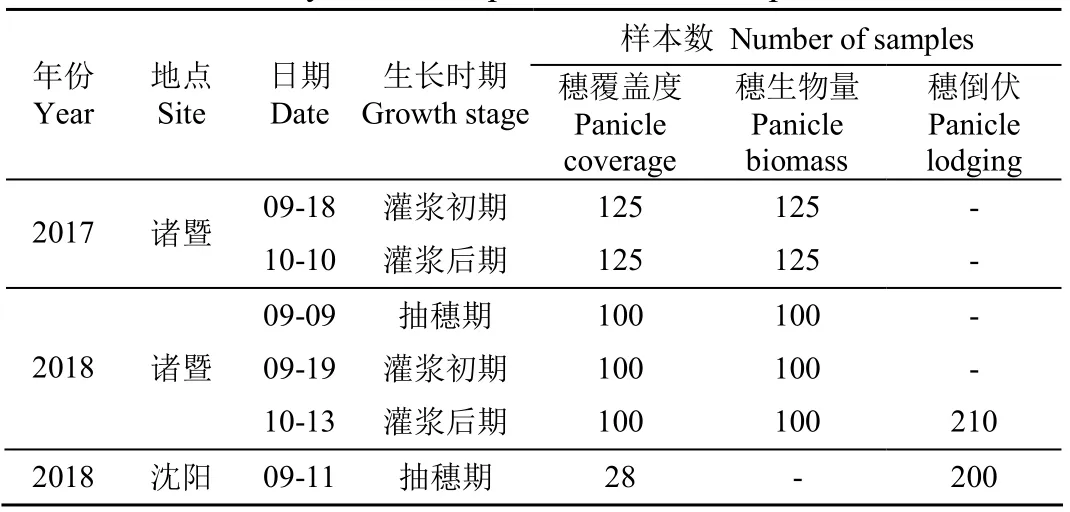

表1 田间试验和样本测量总结 Table 1 Summary of field experiments and sample measurements

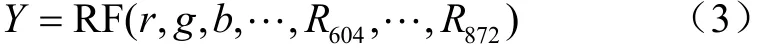

于无人机飞行试验后采集地面数据,详情如表1所示。穗覆盖度是表征水稻抽穗情况的重要参数之一,其代表特定区域中稻穗面积占总面积的比值,本研究从田间获取的高分辨可见光图像中采用人工标记的方法获取真实的穗覆盖度。进一步,利用破坏性采样的方式从每个小区随机收集稻穗样本,并运回实验室,依次进行清理-烘干-称质量等过程,最后将烘干质量除以采样面积得到稻穗生物量(kg/m)。对于2017年的诸暨试验,由于每个小区面积较大,分别在25个小区的中心和4个角度随机取样,共计125个样本。对于2018年的诸暨试验,分别在100个小区随机取样,共计100个样本。对于2018年的沈阳试验,分别在28个小区随机取样,共计28个样本。最后,基于获取的无人机可见光图像,在出现稻穗倒伏现象的小区内分别标记稻穗倒伏和非倒伏区域,2018年诸暨和沈阳试验的倒伏样本分别为210和200,与此同时也获得同样数量的非倒伏样本。由于正常生长的水稻并不会出现倒伏现象,因此在表1中一些试验日期没有获得稻穗倒伏样本。

1.3 无人机图像处理

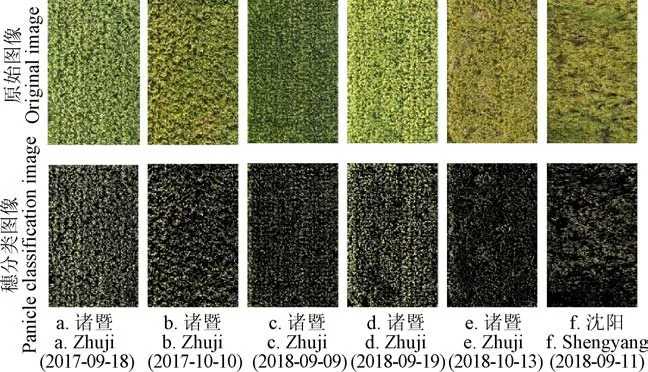

在提取无人机图谱数据前,先利用PhotoScan软件(Agisoft LLC,ST,Petersburg,Russia)进行可见光和多光谱图像拼接,操作流程包括图像对齐、特征点提取和匹配、点云生成以及正射投影图像生成,最后将全景可见光和多光谱图像以TIFF的格式导出。拼接得到的多光谱图像以灰度值(Digital Number,DN)的形式存储,需要将其转换为反射率用于进一步数据分析,本研究使用5块标准的参考板将DN值转换为反射率(Reflectance,)。在飞行试验前,利用便携式地物光谱仪(Analytical Spectral Devices,Boulder,Colorado,USA)测量了5块参考板的全波段反射率(400~2 500 nm),其在872 nm处的反射率分别为7%、17%、33%、36%和58%。然后,利用感兴趣区域(Regions of Interest,ROI)提取图像中每块参考板的DN值,并利用经典的反射校正算法,将原始图像转换成反射图像,计算公式如式(1)所示:

式中和DN分别为第个参考板在第个波段的反射率和DN值,a和b分别为第个波段的回归系数和截距。将a和b用于原始的多光谱图像计算得到多光谱反射图像,并利用光谱校正去除多光谱传感器的二阶谐波和滤波器串扰的响应。基于校正后的反射图像,将每个小区的图像分割出来,利用阈值分割算法去除土壤背景,得到每个小区的冠层光谱反射率。

1.4 稻穗表型监测模型

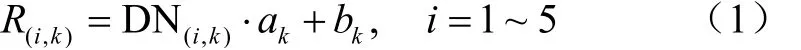

为了实现基于可见光图像的稻穗覆盖识别计算,首先将拼接的可见光图像进行几何变换得到每个小区的冠层可见光图像,并提取红(Red,),绿(Green,)和蓝(Blue,)原始颜色特征,然后选用支持向量机(Support Vector Machine,SVM)去训练穗分类模型。为了获得最佳的SVM分类模型,选用粒子群优化算法(Particle Swarm Optimization,PSO)去训练SVM模型参数:惩罚系数、不敏感损失系数以及核函数功能。训练得到最佳SVM模型用于识别每张图像的稻穗像素,最后计算每张图的稻穗像素占比作为小区的穗覆盖度。详细的图像分类流程如图2所示,穗分类结果示例如图3所示。对于多光谱图像,将25个波段的光谱反射率作为特征输入到随机森林(Random Forest,RF)回归模型,建立穗覆盖度的评估模型。相比于其他的机器学习算法,RF能够有效地避免相邻波段反射率间的多重共线性问题。最终,本文利用RF回归模型融合可见光图像的穗覆盖识别结果和多光谱图像的光谱反射率建立穗覆盖度的评估模型。

图2 基于可见光图像的穗覆盖计算流程 Fig.2 The workflow of panicle coverage calculation from RGB images

图3 原始图像和穗分类图像示例 Fig.3 Examples of the original and panicle classification images

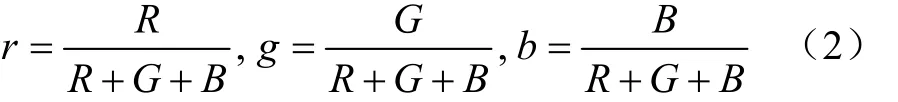

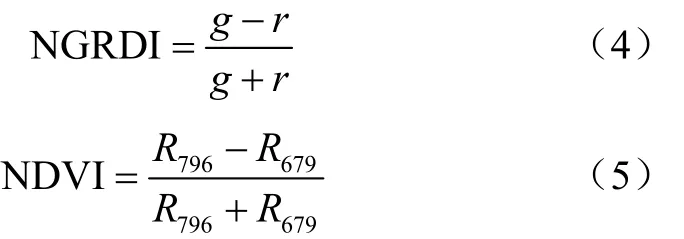

本研究利用RF回归模型去实现穗生物量的评估,并测试了可见光图像的颜色和纹理、多光谱图像的光谱反射率以及两者融合用于穗生物量评估的能力。可见光图像的颜色和纹理包括3种归一化颜色特征(、、)和4个纹理特征(对比度(Contrast,Con)、相关性(Correlation,Cor)、能量(Energy,Ene)、同质性(Homogeneity, Hom)),其中纹理特征是通过灰度共生矩阵(Gray-Level Co-occurrence Matrix,GLCM)得到的。多光谱数据分辨率较低,其纹理特征不如可见光图像清晰,因此本研究仅用到可见光图像的纹理特征。可见光图像的3种归一化颜色特征(、、)的计算公式如下所示:

式中、、分别代表可见光图像的3个颜色通道。基于提取的图谱特征,分别将可见光图像颜色和纹理、多光谱图像的光谱反射率以及所有特征融合输入RF回归模型中,从而实现穗生物量的评估,模型公式如下所示:

式中和分别代表多光谱图像在604和872 nm处的反射率,其他波段以此类推。

与稻穗分类模型相似,本文采用PSO-SVM分类器来检验多源图谱数据对稻穗倒伏监测的能力,其中穗倒伏区域和非倒伏区域如图4所示,可以看到倒伏和非倒伏区域存在明显颜色和纹理差异。为了建立可靠的倒伏识别模型,所用到的可见光图谱数据包括3种颜色特征(、、)和4个GLCM纹理特征(Con、Cor、Ene、Hom),多光谱图像包含25个波段的光谱反射率。在穗倒伏识别过程中,把“倒伏”和“非倒伏”区域像素的标签分别设置成“1”和“0”。先基于单个特征利用Otsu阈值分割方法识别倒伏和非倒伏区域,确定特征的最佳阈值,并比较不同图像特征的结果,最后利用PSO-SVM分类器联合多源图谱数据建立最佳的穗倒伏识别模型。

图4 水稻倒伏和非倒伏区域的示例 Fig.4 Examples of the lodging and non-lodging areas

1.5 动态监测与模型评估

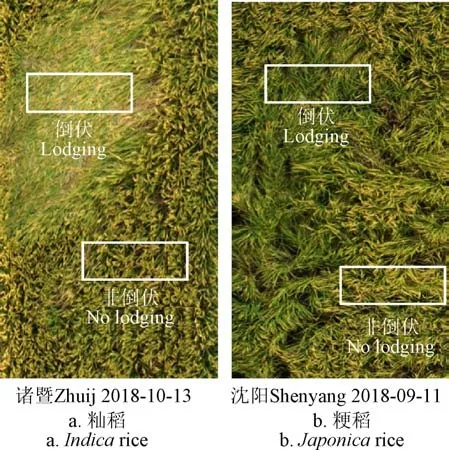

在建立模型前分析无人机多源图谱数据随作物生长的变化,有助于了解无人机图谱数据对稻穗表型的响应。本研究使用来源于可见光图像的归一化绿红差异指数(Normalized Green-Red Difference Index,NGRDI)和穗覆盖度以及来自于多光谱图像的归一化植被指数(Normalized Difference Vegetation Index,NDVI)去监测水稻抽穗后的生长变化,为稻穗表型监测模型的建立提供光谱响应理论基础。NGRDI和NDVI是两个常用植被指数,能够反映植被绿度、生物量以及覆盖度的变化,并且与作物产量紧密相关,计算公式如下:

式中和分别代表多光谱图像在679和796 nm处的反射率。

在建立模型的过程中,将所有数据的2/3随机划分为训练集去训练模型,剩下的1/3数据当作测试集,并计算、预测均方根误差(Root Mean Square Error of Prediction,RMSEP)以及相对均方根误差(relative Root Mean Square Error,rRMSE),采用10折交叉验证取最终的平均结果作为穗覆盖度和生物量的评估精度,计算公式参考文献[3]。采用准确率(Accuracy,%)评判穗倒伏的识别效果,其代表正确识别的倒伏和非倒伏像素占所有像素的比例。本次数据分析的软件平台为MATLAB R2019b。

2 结果与分析

2.1 水稻生长监测

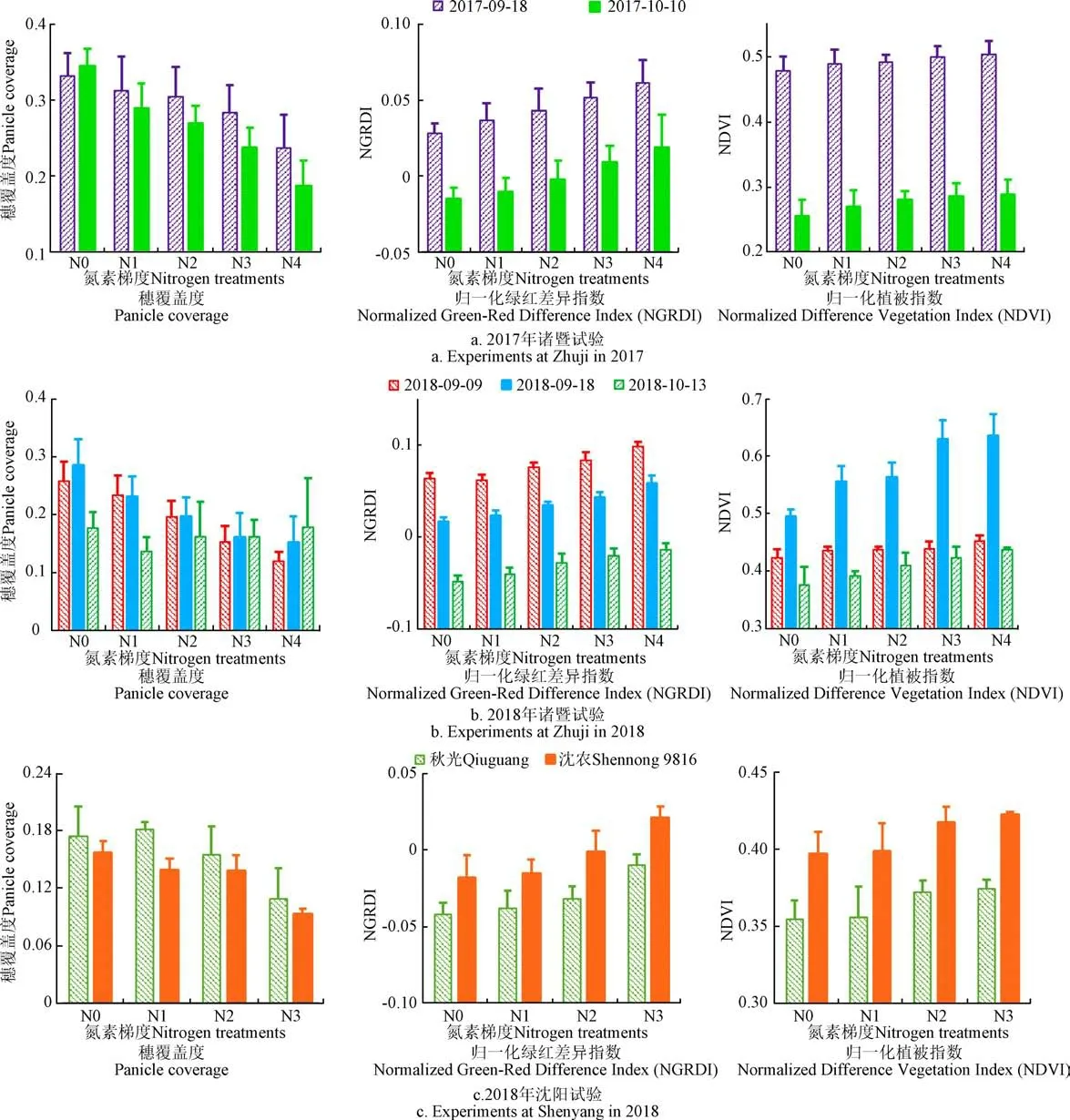

在水稻开始抽穗到成熟期间,稻穗表型会发生显著性变化,从而引起水稻冠层反射图谱的变化。因此,研究稻穗表型的时空变化有助于了解无人机多源图谱数据对稻穗表型的生理响应。如图3所示,随着水稻逐渐成熟,其冠层颜色逐渐变黄,但是诸暨籼稻和沈阳粳稻的冠层结构和颜色是不一致的。图5进一步展示了2017和2018年诸暨试验以及2018年沈阳试验的无人机多源图谱数据的变化统计。随着施氮量的增加,穗覆盖逐渐较小,秋光的穗覆盖度明显高于沈农9816。从9月9日到9月18日,穗覆盖度并没有明显变化,但是后续呈现出下降的趋势,对于2017年诸暨试验的不施氮N0和2018年诸暨试验的过度施氮N4可能会出现上升的趋势。与穗覆盖度的变化相反,NGRDI和NDVI随施氮量增加而减小,然而从2018年9月9日到9月18日,这两种指数的变化是相反的。进一步分析可知,沈农9816的NGRDI和NDVI高于秋光,其差异比穗覆盖度更加显著。因此,无人机多源图谱数据可用于监测水稻稻穗表型。

图5 不同氮素梯度和生长时期的穗覆盖度和植被指数统计 Fig.5 Statistics of panicle coverage and vegetation indices with different nitrogen treatments and growth stages

2.2 稻穗覆盖度评估

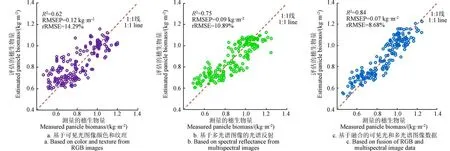

图6a显示了基于可见光图像的穗覆盖度识别计算结果,本研究通过从所有试验中提取穗的图像特征,利用PSO-SVM计算得到的穗覆盖度与实际标记值高度相关,RMSEP和rRMSE依次为0.87、0.03和12.39%。此结果表明构建的穗分类模型能够用于不同生长时期和水稻品种,对不同的数据集具有很好的泛化性。如图6b所示,当多光谱图像的光谱反射率输入RF模型中构建穗覆盖度评估模型时,其表现不如可见光图像的评估结果(=0.83、RMSEP=0.03、rRMSE=13.18%),这说明无人机可见光图像更适合用于穗覆盖度的评估。进一步融合穗覆盖度识别结果与多光谱图像光谱反射率,基于RF的穗覆盖度评估结果得到显著改善,为0.93、RMSEP为0.02以及rRMSE为9.47%(图6c),说明无人机多源图谱数据融合可以被认为是一种能够有效改善穗覆盖度监测精度的方法。

图6 基于无人机多源图谱数据的穗覆盖度评估结果 Fig.6 The estimation results of panicle coverage using UAV-based multi-source image data

2.3 稻穗生物量评估

图7显示了基于无人机多源图谱数据和RF回归模型的穗生物量评估结果。多光谱图像的光谱反射率准确地实现穗生物量评估(=0.75、RMSEP=0.09 kg/m、rRMSE=10.89%)。与多光谱图像的光谱反射率相比,融合可见光图像颜色和纹理并没有更好地实现穗生物量评估,、RMSEP和rRMSE依次为0.62、0.12 kg/m和14.29%。进一步融合可见光图像颜色和纹理以及多光谱图像的光谱反射率建立的穗生物量RF评估模型效果最好,高达0.84、RMSEP为0.07 kg/m和rRMSE为8.68%。因此,可推测多光谱图像反射率比可见光图谱数据更适合用于评估穗生物量,融合无人机可见光和多光谱多源图谱数据具有改善穗生物量评估的能力。

图7 基于无人机多源图谱数据的穗生物量评估结果 Fig.7 The estimation results of panicle biomass using UAV-based multi-source image data

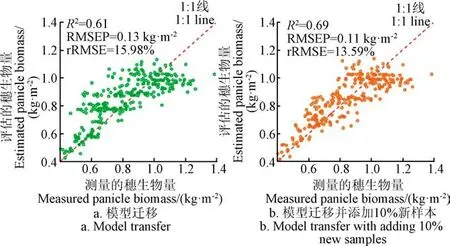

考虑到两年试验数据的差异,进一步利用2017年数据构建的模型去评估2018年的穗生物量,如图8所示。当直接将模型从2017年迁移到2018年时,基于无人机多源数据构建的RF模型较好地评估了穗生物量,、RMSEP和rRMSE依次为0.61、0.13 kg/m和15.98%,但仍存一些偏差较大的数据点。当向2017年构建的模型中增加10%的2018年的新样本,模型性能得到较大改善,、RMSEP和rRMSE依次为0.69、0.11 kg/m和13.59%。这表明构建的穗生物量评估模型能够适用于不同年间的数据,利用模型更新添加新样本可以进一步改善模型精度。

图8 基于2017年的多源无人机数据构建的随机森林回归模型对2018年的穗生物量的评估结果 Fig.8 The estimation results of panicle biomass in 2018 using random forest regression models constructed from UAV-based multi-source image data in 2017

2.4 稻穗倒伏识别

图9显示了稻穗倒伏和非倒伏的样本点分布,他们间存在明显的分界线。因此,利用Otsu阈值分割方法可以识别出NGRDI和NDVI的最佳阈值,结果表明NGRDI可用于诸暨籼稻的倒伏识别,准确率为90.24%(NGRDI阈值为-0.032),与NGRDI相比,NDVI用于倒伏识别的准确率稍低,达81.67%。 与诸暨籼稻相比,NGRDI和NDVI更难识别沈阳粳稻的倒伏,准确率分别为78.33%和75.95%。

图9 基于NGRDI和NDVI的诸暨籼稻和沈阳粳稻倒伏分类结果 Fig.9 Lodging classification results of Zhuji Indica rice and Shenyang Japonica rice based on NGRDI and NDVI

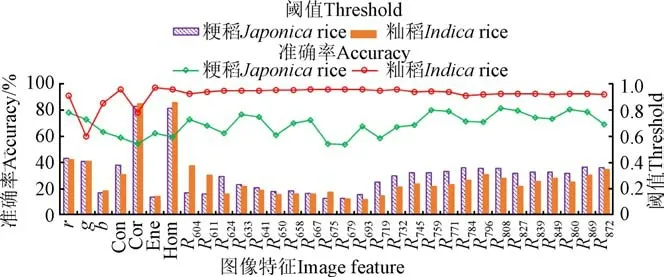

进一步统计其他无人机图谱数据用于稻穗倒伏识别的阈值和准确率,如图10所示。相比于可见光图像的颜色特征,多光谱图像反射率更适合倒伏识别,部分可见光图像纹理(比如Con)也准确地识别稻穗倒伏。对于不同水稻品种,籼稻的倒伏识别准确率显著高于粳稻,籼稻和粳稻的倒伏识别阈值也不一样。可以看出,基于可见光图像颜色和纹理的籼稻和粳稻倒伏识别阈值基本一致,基于多光谱图像反射率的籼稻和粳稻倒伏识别阈值呈现交替变化,先是籼稻的倒伏识别阈值高,然后基本一致,最后是粳稻的倒伏阈值更高。这些结果说明了无人机多源图谱数据能用于稻穗倒伏识别,多光谱图像的光谱反射率能更准确地识别稻穗倒伏。通过对比诸暨和沈阳的倒伏数据可以发现,不同水稻品种的倒伏识别精度和阈值存在差异,但他们的趋势基本一致。因此,可以推断基于无人机多源图谱数据的稻穗倒伏监测模型可以用于不同种植区域和水稻品种。

图10 基于无人机多源图谱数据的诸暨籼稻和沈阳粳稻倒伏分类准确率和阈值 Fig.10 Lodging classification accuracy and threshold of Zhuji Indica and Shenyang Japonica rice using UAV-based multi-source image data

当利用PSO-SVM分类器融合多源图谱数据用于诸暨籼稻(甬优1540)和沈阳粳稻(秋光和沈农9816)的稻穗倒伏识别时,结果显示可见光图像的颜色和纹理融合能够很好地识别倒伏,准确率为91.97%,融合多光谱图像的全波段光谱反射率更好地实现了稻穗倒伏识别,准确率为92.70%。进一步结果显示无人机可见光和多光谱多源图谱数据融合能够极大地改善稻穗倒伏的识别,准确率高达99.87%。

3 讨 论

无人机遥感平台在作物生长监测中的广泛使用已产生了丰富的图谱数据,主要包括光谱、纹理和结构特征。光谱数据可以由无人机可见光、多光谱和高光谱图像产生,其中可见光光谱主要用于反映作物的颜色变化,其与作物的生理参数有关,比如叶绿素含量。当水稻逐渐成熟和叶片颜色逐渐变黄时,NGRDI和NDVI呈现减小的趋势,然而NDVI容易受到冠层光谱饱和的影响,因此在水稻成熟期不能很好地反映其生理变化(图5)。相比于可见光光谱,近红外光谱与作物的结构、水分以及干物质含量变化有关,其能够识别结构差异大的倒伏和非倒伏的稻穗(图9)。与光谱特征相比,相对少的研究利用纹理特征去监测水稻生长,然而纹理特征能够很好地反映地物波谱差异,比如生物量变化引起的冠层致密程度以及倒伏引起的冠层结构变化等,并且已有研究表明融合光谱和纹理特征能够改善作物生物量的预测精度。最后,无人机遥感图像也能提取作物的结构特征,比如株高、覆盖度和三维结构等,其主要反映作物生长的结构差异,有助于了解光谱和结构混合效应对于作物生长监测的影响。因此,结构和光谱数据结合在一定程度上削弱了冠层结构对于作物表型监测的影响。

本研究利用RF回归模型,将可见光图像的穗覆盖度识别结果和多光谱图像光谱反射率结合起来建立了稻穗覆盖度评估模型,相比于单一的图谱数据,穗覆盖度的评估精度提升了33.33%,并且可见光图像的评估结果优于多光谱图像的评估结果。这主要是因为穗覆盖度主要体现在水稻冠层结构和纹理的变化,可见光图像对这些变化非常敏感,其能够更好地识别稻穗。相比于可见光图像颜色和纹理,多光谱图像的光谱反射率能够更好地评估稻穗生物量,这是由于光谱反射率包含作物的生理和结构信息,能够准确地表征作物生物量。当融合可见光图像颜色和纹理以及多光谱图像的光谱反射率后,穗生物量的评估误差得到改善,RMSEP减小了22.22%,这证明了图像纹理能够进一步改善基于光谱反射率的穗生物量评估结果。研究也发现无人机多源图谱数据能够用于稻穗倒伏识别,即使是单一图像特征,识别准确率也可达到80%~90%,然而其容易受到水稻品种差异的影响,比如籼稻和粳稻。利用PSO-SVM分类器融合多源图谱数据,显著地提高倒伏识别准确率,可达99.87%,其中多光谱图像的光谱反射率展现出更高的潜力。这些结果证明了无人机多源图谱数据融合对于水稻稻穗表型监测的可行性,其中无人机可见光图像适用于水稻冠层结构的监测,多光谱图像可用于表征水稻的生理变化。

虽然近几年已有大量研究探索了无人机在水稻稻穗表型监测中的应用,但是其研究的试验数据比较单一,导致模型缺乏泛化性。本研究利用多年多区域的无人机数据构建了可靠的稻穗覆盖度、生物量以及倒伏监测模型。通过对比不同试验数据发现,构建的稻穗覆盖度和倒伏监测模型具有较高的鲁棒性,在不同数据集中具有很好的泛化性。此外,本研究也探索了穗生物量模型在不同种植年间的可迁移性(图8)。结果表明,构建的穗生物量评估模型可以直接从2017年迁移到2018年,尽管由于不同数据集的差异导致模型精度降低,但是仍取得可接受的评估结果。进一步利用模型更新添加10%的新样本可以帮助原模型学习到新数据的特征,从而改善穗生物量的评估结果,这与报道研究中产量和氮素评估结果是一致的。虽然本文已经成功建立稻穗覆盖度、生物量以及倒伏等监测模型,但是尚存在部分局限性。本研究仅考虑几种水稻品种数据,进一步的研究需要在不同的水稻品种中测试这些模型的鲁棒性以及可迁移性。此外,本研究没有深入探究土壤背景、传感器观测角度以及太阳高度角等因素的变化对于稻穗监测模型的影响,未来的研究应将这些因素纳入到稻穗表型监测模型,提高模型的机理性以及可解释性,从而为农田精准管理和智慧种植提供技术支撑。

4 结 论

本研究结果表明,无人机多源图谱数据能够用于监测水稻生长变化以及稻穗覆盖度、生物量和倒伏。基于PSO-SVM分类模型和可见光图像实现了穗覆盖度的准确评估,将可见光图像的穗覆盖度识别分类结果和多光谱图像的光谱反射率结合提高了稻穗覆盖度的评估精度,为0.93,rRMSE为9.47%。基于RF回归模型,将可见光图像颜色、纹理与多光谱图像的光谱反射率融合实现了穗生物量的评估,达0.84,rRMSE为8.68%。基于PSO-SVM分类器,融合可见光图像颜色、纹理和多光谱图像的光谱反射率准确地识别稻穗倒伏,准确率高达99.87%。这些结果证明了无人机多源图谱数据融合可用于改善稻穗表型监测的准确率,为快速获取水稻稻穗表型提供了一种有效的方法。