改进的Faster R-CNN用于苹果叶部病害检测

王远志,施子珍,张艳红

(安庆师范大学 计算机与信息学院,安徽 安庆 246133)

植物叶部病害一直制约着农作物产量和质量的提升,是限制农业生产和发展的主要因素之一[1]。对植物病害进行有效识别和防治能够最大程度上减小病害对农作物造成的经济损失,具有重要的理论和实际意义。目前,植物病害识别是模式识别和现代化农业发展的重要研究领域[2]。早期的植物病害识别是通过人工从采集的病害图片中提取病变区域,根据分割出的植物病斑,采用K均值聚类并结合人工神经网络(ANN)以及支持向量机(SVM)的方法进行病害检测[3-5],但是植物病斑特征提取效果并不明显。文献[6-7]采用传统的机器学习方法识别各种类型的苹果叶片病害,由于病害区域的颜色、形状、纹理等特征信息繁杂,所以很难将特征区域成功分割,从而导致特征提取的效率及识别的准确率低。2012年,AlexNet提出深度卷积神经网络(CNN),被广泛应用到图像识别领域,且在其基础上又提出VGG-16、GooLeNet、ResNet等[8-9]优秀的特征网络模型。魏宏彬等[10]以一些常见的蔬果为研究对象,提出一种改进型YOLOV3算法,其目标检测平均精度达93.2%;闫建伟等[11]对刺梨的11类果实进行目标检测,提出将Faster R-CNN网络模型中的感兴趣区域池化进行改进,检测精度达83.74%;杨晋丹等[12]在卷积神经网络的基础上构建了一种病害识别模型,对草莓的白粉病进行目标检测,检测率达98.61%,但该实验仅针对单一病害进行识别,且实验环境不是自然环境。Geetharamani等[13]定义了大小为3×3的3层卷积的卷积核,将每层卷积后连接一个最大池化层,再通过两个全连接层进行特征融合,最后采用Softmax进行特征分类,其分类精度达96.46%。Ferentinos等[14]以不同背景下的病害叶片作为实验对象,对比VGG16、GoogLeNet、AlexNet等网络模型,实验结果表明VGG16网络模型训练的效果最好。卷积神经网络具有优秀的表征学习能力,被应用于植物病害识别领域且取得了较好的效果,但对于复杂背景环境和病斑相似性引起的类内、类间差距仍有进一步研究的空间。本文基于Faster R-CNN模型实现对苹果叶部病害区域的检测识别,提出在HSV色彩空间下,利用Retinex理论算法对病害图像进行处理,采用具有快速有效识别效果的Faster R-CNN网络模型对苹果叶部病害数据集进行训练,实现对病斑的识别检测。

1 相关工作

1.1 数据增强处理

实验采用公用数据集plantvillage中苹果叶部的病害图像,以发病概率较高的3种病害(雪松锈病、灰斑病、黑星病)苹果叶片图像为研究对象,建立图像数据集。训练Faster-RCNN模型需要较多的训练样本,样本不足时模型容易发生过拟合,目标检测精度低。因此,本文采用Augmentor数据增强方法对730张苹果叶部图像的训练样本数据集进行扩充,采用旋转、裁剪、弹性形变等处理方式,得到3 879张病害图像数据集。将扩充后的病害图像数据集进行分类,如表1所示。数据扩充后,标注病害图像数据集,进行病害数据模型的训练。采用Labelme图像标注工具对病害图像的病斑区域用矩形框进行目标标注,标注时使矩形框尽量只包含一个病斑,且每张病害图像至少包含一个标注对象。

表1 图像数据集种类和数量

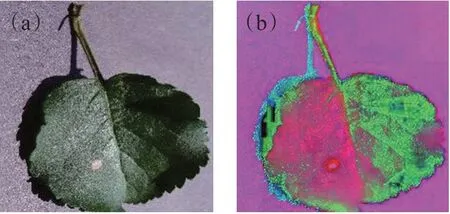

1.2 HSV颜色空间

HSV颜色空间[15]的色度H包含图像的颜色信息,饱和度S表示颜色接近光谱色的程度,明度V包含图像的光照信息。图像的彩色信息与亮度分量不相关,HSV颜色空间消除了H、S、V三个分量之间的相关性,使图像亮度信息和彩色信息处理得更加简单方便。在HSV颜色空间中,由于图像的亮度分量及明度分量相对独立,所以能更好地保持图像色彩。将RGB图像转入HSV颜色空间后的效果如下页图1所示。

图1 转入HSV空间效果。

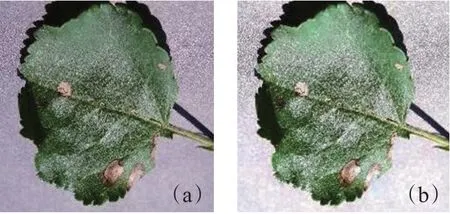

1.3 Retinex理论

Retinex算法[16]通过估算图像中入射光强度、降低入射光对反射光的影响来达到图像增强的目的。用Retinex算法对图像进行处理,能在动态范围压缩、边缘增强和颜色恒常等方面达到平衡,且对不同类型图像进行自适应增强,从而更容易识别图像特征。图像经过Retinex算法处理后的效果如下页图2所示。

图2 Retinex算法增强后效果。

2 Faster R-CNN深度学习模型

传统的机器学习方法使用滑动窗口进行检测,Faster R-CNN使用区域建议网络(RPN)替代SS(Selective Search)方法[17]生成检测框,极大地提升了检测框的生成速度[18]。Faster R-CNN利用卷积神经网络提取输入图像的特征后,使用RPN产生建议框,使得建议框数目从原有的2 000个减少为300个,并通过分配置信水平识别图像中的感兴趣区域和输出对应的建议框,判断该区域内的目标属于物体或背景。RPN区域网络结构框架如图3所示。

VGG16特征提取网络由13个卷积层、13个激励层、4个池化层组成,是一种适用于数据类别较多、数据集较大的网络模型,在植物叶部病害领域得到了较好的识别效果[19-20]。R-CNN在提取特征网络后,选取图像中感兴趣区域,并对目标物体进行坐标信息的回归修正,最终实现病害检测。Faster R-CNN网络结构如图4所示。

3 实验验证与结果分析

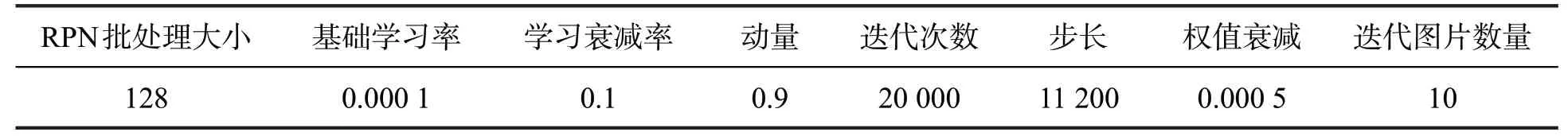

实验的硬件为笔记本电脑,操作系统为MACOS 10.15.7,硬盘为256 GB,内存为16 GB,CPU为1.4 GHz四核Intel Core i5。在Python语言下搭建TensorFlow深度学习框架。实验初始化参数如表2所示。

表2 Faster R-CNN训练参数值设置

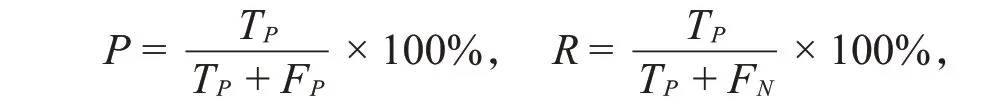

实验采用平均精度(AP)及平均精度均值(MAP)作为各类病害检测效果的评价指标。平均检测时间能有效评价训练模型的识别速度,可以作为训练模型实时性的评价标准。平均精度与精确度、召回率有关,精确度P和召回率R的计算公式分别为

其中,TP为被正确检测为正样本的数量,FP为被错误检测为正样本的数量,FN为被错误检测为负样本的数量。平均精度体现训练模型检测目标病害的检测效果,其值越大,表明检测效果越好,反之越差。

在HSV色彩空间下,采用Retinex理论和Faster R-CNN算法的苹果叶部病害检测算法步骤如下:(1)选取训练图像作为训练样本;(2)利用Augmentor扩充训练图像;(3)将训练的RGB图像转换成HSV图像;(4)对处理后的图像采用Retinex算法;(5)将病害的训练样本输入到Faster R-CNN网络中来训练该网络,将测试图片输入到训练好的Faster R-CNN模型中作检测。

本实验将苹果叶部病害图像经过HSV颜色空间转换并进行Retinex算法处理,处理后的图像采用Faster R-CNN训练模型对苹果叶部病害进行目标检测,并与传统的Faster R-CNN网络模型进行对比。利用平均精度作为实验中各类病害目标检测的评价指标,并将平均精度均值作为整个训练模型性能的评价指标,实验结果如表3所示,本文方法相比于传统的Faster R-CNN模型对苹果叶部病害识别能力更优秀,雪松锈病、灰斑病、黑星病的平均精度分别提高了4.03%、7.14%和13.77%,整体平均精度提升了8.32%。在检测时间上,本文方法的检测时间为0.201 s,保证了检测的实时性。苹果叶部的3种病害识别结果对比如图5所示。对比传统的Faster R-CNN模型,改进的模型检测病害区域的置信度、检测精度更高,提高了目标检测的可信程度,能较好地进行自动检测。对于自然条件下,该识别模型对病害区域能够有效检测,且满足苹果叶部病害自动化识别检测的要求。在检测过程中,仍有少数病斑由于过小或状态模糊不清而检测不到,所以本文实验方法的检测性能还有提升的空间。

表3 实验结果对比

图5 识别结果对比。(a),(b),(c)分别为传统Faster R-CNN模型对苹果叶部雪松锈病、灰斑病、黑星病的识别效果;(d),(e),(f)分别为本文方法对苹果叶部雪松锈病、灰斑病、黑星病的识别效果

4 结论

本文以苹果叶部病害图像为研究对象,针对自然环境条件下病害图像存在的光照分布不均匀、对比度低、过亮及过暗区域细节丢失等问题,通过对病害图像进行HSV颜色空间转换及Retinex算法处理,使之更适合自然环境下的自动检测,再将处理后的图像输入Faster R-CNN网络进行训练,提升病害的检测精度及置信度。相比于传统的Faster R-CNN模型,本文方法对苹果叶部的雪松锈病、灰斑病和黑星病的平均检测精度均有提升,分别提高了4.03%、7.14%和13.77%,整体平均精度提升了8.32%;每幅图像的平均检测时间减少了42 ms,保证了实时性。该实验方法能够适应复杂的自然环境,为植物类病害目标检测提供了研究基础,提高了植物叶部病害的识别防治,降低了植物叶部病害对农作物造成的经济损失,具有重要的理论和实际意义。在下一步研究过程中,需要采集更多种类的植物叶部病害图像,扩大模型可检测植物病害的范围。