红外热成像技术在ADAS系统中的应用

钟明霞,姜柏军

(浙江商业职业技术学院,浙江 杭州 310053)

1 引 言

目标检测是高级驾驶辅助系统(ADAS)[1]的关键技术,主要通过传感器、处理单元以及控制单元以帮助驾驶者察觉可能发生的危险,消除人为错误和分心驾驶来降低事故率,是提高驾驶安全的主动安全技术。目标检测其关键核心技术主要包含两个步骤:一是感知检测对象;二是将对象进行分类以确定行动方案。步骤一需要借助传感技术,主要用来增强或逐步取代驾驶中所需的感知能力,优化驾驶性能。步骤二需要借助人工智能深度学习算法,对传感器传送的道路交通图像或视频进行分类识别,以区分是机动车、行人、自行车等交通对象。

汽车驾驶场景中的目标检测是富有挑战性的问题,目前ADAS系统中应用的主要传感部件包括可见光摄像机、雷达传感器和激光测距仪等,可见光摄像机能够获取环境景象信息,在光线和照明充足前提下,在交通标注识别、车道偏离警告、紧急制动辅助、行人/动物检测分类等方面性能优越。缺点是夜视功能较弱且在雨雾天气情况下视距缩短。而激光雷达传感器可获取环境空间的三维尺寸信息,缺点是激光雷达会受粉尘、雨雾天气影响,一般在汽车上激光雷达需要结合其他传感器来实现避障,对细小物体识别差。而红外热成像仪因为对温度敏感,夜视能力强,作用距离远,可排除眩光和天气干扰,甚至在黑暗中或大雾条件下检测和分类目标,提供改进的态势感知。因此在行驶汽车的传感器套件中有必要添加红外热像仪,应用红外热成像技术的价值在于可增加ADAS系统传感器套件的可靠性并提高系统感知性能。如图1所示为用可见光RGB相机和LWIR(长波红外)热成像相机在雾隧道中记录的示例图像,很明显的LWIR拍摄的图像更利于目标识别。

图1 可见光RGB相机与LWIR热成像相机拍摄图像效果对比Fig.1 Comparison of image effects between visible light RGB camera and LWIR thermal imaging camera

近年来基于深度学习算法的ADAS系统目标检测技术得到了巨大的发展[2],比如一些著名的检测算法(Faster R-CNN、YOLO和SSD)在机动车或行人检测方面以及交通标志的识别任务中表现优越[3],但是由于交通目标一旦处于复杂环境,或光照不足,或处于恶劣天气时段,深度学习算法的目标检测结果经常出现误检或漏检,同时检测速度达不到系统要求的实时性需求。为了解决上述问题,本文提出了红外热像技术结合深度学习下的最新的目标检测YOLOv5算法来帮助ADAS系统实现兼顾精度与实时性的目标检测,主要特点有:①改变传统目标检测算法采用RGB可见光图像作为算法的输入,采用红外热成像仪采集的图像进行目标检测。②为了更好的进行特征提取便于后续的检测分类,本文研究了红外热图像的预处理方法,包括图像增强以及ROI目标提取。③选择了最新的YOLOv5模型作为目标检测的基本模型,并采用迁移学习提高了模型的训练速度和检测效率。

2 红外热图像预处理

前面提到了尽管红外热成像技术采集的图像(以下简称为红外热图像)在交通目标检测方面具有优于RGB可见光图像的优点,但是它也同样存在缺点。相比于可见光图像,红外热图像具有信噪比低、目标纹理特征少、分辨率低等特点,导致图像信息量太少,难以区分目标与背景等[4]。这些问题会影响目标检测的准确性,故需要针对红外热图像的特性进行图像预处理,主要包括2个方面。

(1)图像增强

图像增强目标是增加红外热图像的目标与背景的对比度,本文采用文献[5]提出的基于通道扩展的红外图像数据增强算法。因为红外图像为单通道图像导致图像信息量不够难以实现目标识别,所以对红外图像分别执行CLAHE图像增强算法和inversion图像增强算法,然后进行三通道合成,再输入到后续操作中,这样图像数据量可以进一步增加,后续网络模型训练更利于特征提取。图2所示为原图与图像增强效果对比。

(a)原图 (b)增强效果图图2 图像增强效果对比Fig.2 Comparison of image enhancement effects

(3)目标ROI提取

经研究发现视觉将显著性算法在移动目标跟踪、目标识别领域有着很好的识别效果,因此本文打算采用视觉显著性原理对目标 ROI 进行快速定位。但是行人或远处的汽车等在红外热成像相机获得的交通路况图像或视频通常都以红外弱小目标对象的形式存在,因为图像噪声或对比度低等影响目标检测误检率较高。为解决误检问题,本文采用文献[6]基于空间距离改进的视觉显著性算法,通过减少噪声、背景的干扰,同时该方法可以减少对图像的计算量,提高红外弱小目标的检测结果。以本文图1中雾隧道红外热成像图为例,对应的目标ROI的提取效果如图3所示。

图3 目标ROI提取Fig.3 Extraction of target ROI

3 YOLOv5训练目标检测网络

ADAS系统的交通目标检测是根据传感器传送的图像或视频来检测是否存在给定类型的交通目标实例(比如行人、机动车、自行车、动物等),若检测为真值确定其存在则同步返回一个边界框,用于标注每个交通目标实例的空间位置和覆盖范围。在汽车驾驶场景目标检测任务中,一般需要同时检测多类目标,但是因为汽车驾驶场景下存在不同类型目标尺度差异、姿态多样以及背景复杂且存在遮挡等不利因素导致目标检测面临诸多挑战。其中最大的困难是网络模型训练后的模板匹配过程很耗时,以至于难以实现兼顾精度与实时性的目标检测系统。

计算视觉新创公司Roboflow通过实验证明YOLO系列最新的YOLOv5算法在目标检测方面性能优越,不仅在硬件环境上易于配置,而且模型训练速度远超YOLOv4,可实时产生系统批处理结果。因此,本文采用YOLOv5算法,在图像预处理基础上对实验数据集进行迁移学习,训练并优化模型用于检测和分类各种交通环境或天气条件下的交通目标对象。迁移学习通过把当前YOLOv5模型框架下已学习训练好的针对COCO数据集预训练的相关性模型参数迁移到新的模型来帮助新模型加快并优化模型的学习效率。这样可以降低训练对于样本数量的依赖从而提高模型的精度,主要包含以下步骤:

(1)训练数据集采集与标注

为了验证实验效果,本文测试数据库采用2019年8月FLIR公司推出的免费用于算法训练的FLIR Thermal Starter 数据集V1.3。数据是由安装在车上的RGB相机和热成像相机获取的。数据集总共包含14452张红外图像,其中10228张来自多个短视频;4224张来自一个长为144 s的视频;数据集图像包括5种目标分类:行人、狗、机动车、自行车及其他车辆。该数据集使用MSCOCO labelvector进行标注,提供了带注释的热成像数据集和对应的无注释RGB图像(如图4所示),数据集文件格式包括五种:①14位TIFF热图像(无AGC);② 8位JPEG热图像(应用AGC),图像中未嵌入边界框;③ 8位JPEG热图像(应用AGC),图像中嵌入边界框便于查看;④RGB-8位JPEG图像;⑤注释:JSON(MSCOCO格式)。

图4 FLIR Thermal Starter 数据集图像示例Fig.4 Example of FLIR Thermal Starter data set image

(2)数据集预处理及配置文件准备

为了完成模型的训练,FLIR Thermal Starter 数据集必须进行预处理后才能使用,将JSON标签转换为YOLO格式,并按照YOLOv5的训练文件结构要求布置。同时加载预训练模型,准备YOLOv5代码库,在yolov5目录下的model文件夹下是模型的配置文件,提供s、m、l、x版本,版本越高,架构也越大,训练时间也会逐渐增大。为了保证系统的实时性,本文采用s版本,即采用yolov5s.yaml,修改参数后的模型文件命名custom_yolov5s.yaml,以及uc_data.yaml文件,模型的输出是FLIR Thermal Starter 数据集中的5类交通目标,因此修改模型的对象预测层输出类别数量为5。

(3)参数设置及模型训练,模型训练参数设置如表1所示。

表1 训练参数设置Tab.1 Training parameter settings

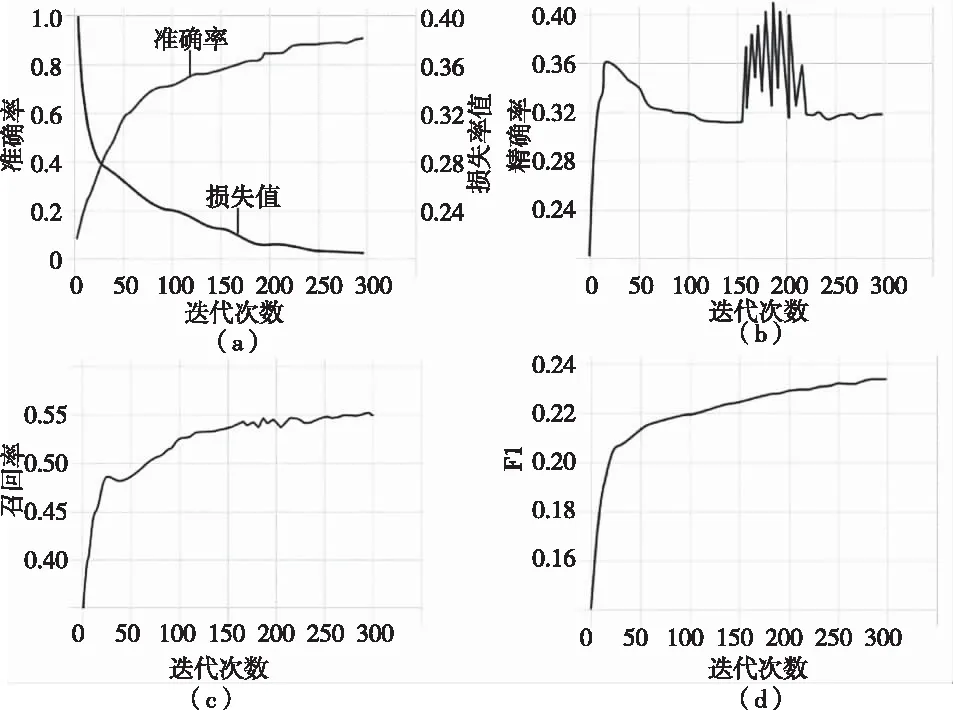

分类和目标检测的性能评价通常采用准确率、精确率与召回率、综合评价指标(F1)来进行衡量。图5展示了模型训练结果,从图中可以看出,随着模型训练迭代次数的增加整个模型趋于收敛,损失值不断降低,模型精确率和召回率也满足要求。当迭代次数到达250次之后,模型趋于稳定,准确率最高超过90 %。

图5 模型训练结果Fig.5 Model training results

4 实验结果及分析

为了测试和验证系统的目标检测性能,在数据集中选取了白天、夜晚光照不足、路口眩光、雾霾隧道等不同环境或天气条件下的图像进行性能测试,图像实验结果如图6~9所示,进行了四种情况下RGB可见光图像与红外热成像仪拍摄图像目标检测后的效果对比。很明显,相比较RGB可见光相机,红外热图像在夜视不足、眩光、恶劣环境或天气条件下具有更准确的检测效果。

(a)可见光 (b)红外热图图6 白天可见光相机图像和红外热图像检测效果Fig.6 The detection results of visible light camera images and infrared thermal images during the day

(a)可见光 (b)红外热图图7 夜晚光照不足情况下可见光相机图像和红外热图像检测效果Fig.7 The detection effect of visible light camera image and infrared thermal image under the condition of insufficient night light

(a)可见光 (b)红外热图图8 路口眩光可见光相机图像和红外热图像检测效果Fig.8 The detection effect of the junction glare visible light camera image and infrared thermal image

本文从FLIR Thermal Starter数据集中选择用于测试的实验红外热图像600张,其中包含行人、机动车、自行车等交通目标2101个,随着模型训练迭代次数到达300次,检测准确率为90.58 %,即有效检测目标1903个;误检测目标123个,误检率为5.85 %;漏检目标75,漏检率为3.57 %,目标检测速度为140FPS。通过实验也证明,经过图像预处理步骤(增强、ROI提取)后的模型分类精度更高,检测速度更快。不同图像预处理方法的模型检测精度和速度对比见表2所示。

5 结 语

本文提出了现在主流的汽车传感器技术在目标检测方面存在的缺陷,分析了红外热成像技术在ADAS系统应用的优点,提出了在传感器套件中添加红外热像仪的必要性及其技术价值,然后在图像预处理基础上结合YOLOv5算法研究了复杂交通环境中的移动目标检测问题,为汽车辅助驾驶系统的实际应用提供了新思路。后续工作考虑采用RGB可见光图像和红外热图像的彩色图像融合技术进行交通检测和目标识别,进一步增强目标检测系统的目标识别速度和准确度,以保证系统对各类场景的适应性。