快速鲁棒高光谱目标跟踪算法

徐清宇 李冬冬 蒯杨柳 盛卫东 邓新蒲

摘 要: 针对传统目标跟踪的难点如目标与背景混淆及目标外观急剧变化等问题,利用高光谱视频包含的二维空域信息和丰富的一维频谱信息,提出一种快速鲁棒目标跟踪算法FRHT。首先,在传统的空域注意力机制上基于高光谱数据的特点引入频谱注意力机制,设计了相关滤波框架下自适应更新学习的跟踪器; 其次,手工设计高光谱运动目标特征以加快跟踪器运算速度; 最后,提出一种运动目标异常检测机制,以增强跟踪器对各种干扰的鲁棒性。仿真结果表明,在高光谱数据集上,跟踪器FRHT的速度和精度显著优于KCF,SAMF和CSR-DCF等传统跟踪算法,精度提升2%以上; 引入运动目标检测机制后,算法鲁棒性得到改善。

关键词: 目标跟踪; 目标特征; 高光谱; 相关滤波; 注意力机制; 鲁棒性

中图分类号: TJ760; TN911.73

文献标识码: A

文章编号: 1673-5048(2022)02-0039-06

DOI: 10.12132/ISSN.1673-5048.2021.0131

0 引 言

随着人类航天活动的增加,空间运动目标检测跟踪在军事领域、航天测控等方面发挥着越来越重要的作用[1]。目前,对空间物体的全链路监视跟踪是天基光学监视系统急需解决的问题[2-3]。空间目标体积小,速度快,导致远距离观测条件下目标能量极为微弱,没有与背景进行区分的显著特征。因此,基于对目标分辨率和检测灵敏度的要求,高光谱目标检测跟踪受到人们的关注[4]。

由于传统视觉目标跟踪不能满足某些极端条件下的跟踪要求,在目标与背景相似或者跟踪目标快速变化时,跟踪器难以快速更新跟踪器。准确获取目标信息,及时更新跟踪器对于快速准确跟踪目标至关重要。一般而言,当下目标跟踪主要有两种框架: (1)深度学习框架; (2)相关滤波框架。本研究重点关注后者,即在相关滤波框架下,将空域目标傅里叶变换到频域后进行跟踪的方法。

基于高光谱数据的目标跟踪是目标跟踪领域中一个新兴的研究方向,其包含多谱段的丰富信息,对于实现精确目标跟踪具有特殊的优势。与可见光图像数据(RGB)或者单通道图像不同,高光谱数据(HSI)包含空间二维信息和丰富的一维频域信息,可以在可见光或是红外光难以辨识目标的情况下,将不同的物体区分开,比如白色的卡片和白色的纸。特斯拉汽车由于使用RGB视觉目标跟踪系统,将白色的卡车误认为白色的天空,致使发生车祸[5]。从另一方面,可以看出高光谱目标跟踪在现实世界中颇具应用前景,如瓦斯检测[6]等。

目前,针对高光谱目标跟踪的研究仍十分有限。Xiong等[7]提出的目标跟踪器 MHT(Material-Based Hyperspectral Tracker)利用基于空間频谱直方图统计的手工特征(Spectral-Spatial Histogram of Multidimensional Gradients, SSHMG),模拟目标物质信息,实现目标跟踪。为了促进这个新兴领域的发展,熊凤超等人在2020年组织了高光谱数据目标跟踪竞赛,并提供了一个精心制作的高光谱数据集 Whisper[7],供学者进行研究对比。该数据集共有40段训练视频和35段测试视频,平均每个视频序列的长度达 425帧。每个视频序列都标记了面临的挑战因素,所有的标记因素共11类, 分别为尺度变化(Scale Variation, SV)、运动模糊(Motion Blur, MB)、遮挡(Occlusion, OCC)、快速移动(Fast Motion, FM)、低分辨率(Low Resolution, LR)、面内运动(In-Plane Rotation, IPR)、面外运动(Out-of-Plane Rotation, OPR)、形变(Deformation, DEF)、背景模糊(Background Clutters, BC)、 光照变化(Illumination Variation, IV)和目标丢失

(Out-of-View, OV)。与其他传统的基于相关滤波的跟踪器[8-12]相比,MHT在高光谱数据集Whisper上的表现更为优异。但是SSHMG 特征通过3D直方梯度图提取,需要在高维度空间进行大量计算,降低了目标跟踪的速度。

针对高光谱图像数据维度高、处理耗时的特点,本文提出了一个新颖的高光谱图像快速跟踪算法FRHT(Fast and Robust Hyperspectral Tracker),在相关滤波跟踪的框架下,融合空间注意力和频域注意力机制,实现快速鲁棒目标跟踪。

与MHT使用的3D梯度特征不一样,本文使用的特征是压缩后的灰度图像特征,可以在速度和精度两者间取得平衡。在跟踪过程中,利用空间注意力机制,二值分割出一个自适应调整的目标分割模板,使跟踪器可以用目标图像块进行更新。对高维图像特征,频谱注意力机制可以通过学习权重,不同频域通道加权后进行定位跟踪。不仅如此,本文还设计了运动目标异常检测算法,用于对异常目标进行检测,及时纠正跟踪器。

本文创新点如下: (1)针对高光谱数据特点,提出了一个基于相关滤波的高光谱目标跟踪器FRHT; (2)提出了高光谱运动目标异常检测算法,用于及时纠偏高光谱跟踪器; (3)在当下最新的高光谱基准数据集 Whisper 上做了大量仿真实验,结果表明所提方法跟踪精度优于可见光跟踪算法,同时跟踪速度大幅提升。

1 相关滤波跟踪

目标跟踪是计算机视觉领域最富有挑战性的任务之一,目前主流有两个跟踪框架,一个是基于相关滤波框架,一个是基于孪生网络的深度学习框架。基于深度孪生网络的跟踪方法,需要大量样本来训练网络参数,以学习运动目标的空间特征表示,

因此,在训练和实时测试两个阶段,该方法耗时多[13-15]。相比之下,基于相关滤波的跟踪将目标信息根据傅立叶变换从空域到频域进行相关跟踪,大大提升了计算效率。

Bolme等[16]首先富有开创性地将相关滤波的原理引入了目标跟踪领域,提出最小输出平方和滤波跟踪器MOSSE(Minimum Output Sum of Squared Error Filter)。由于相关滤波跟踪器将空域计算转换到频域进行,基于相关滤波的跟踪器计算效率通常都很高。MOSSE能够以每秒数百帧的速度实现精确鲁棒地跟踪目标,将目标跟踪的研究向前推进了一大步。Henriques等[17]提出的核相关滤波器KCF(Kernel Correlation Filter),通过对提取的目标特征施加线性核的方法,提升跟踪器将目标与环境背景的区分能力。该方法在目标相邻区域采样大量图像块,由于图像块包含目标与背景,且有偏移真值,相关滤波器经过训练后可以提升识别目标能力。图像块组成的循环矩阵会带来边缘效应,为了消除这种影响,Danelljan等 [18]提出跟踪器ECO(Efficient Convolution Operators)来消除这种负面影响。Lukeic等[12]提出CSR-DCF(Channel and Spatial Reliability-Discriminative Correlation Filter)跟踪器,可以在空域和特征维度同时学习权重参数,针对性进行跟踪。2017年的视觉目标跟踪竞赛VOT2017[19]中,ECO和 CSR-DCF 表现最为出色。

本文的基本框架主要是CSR-DCF,为更好介绍FRHT,下面对CSR-DCF的具体实现细节进行回顾。

目标跟踪的主要问题是要在时间t和取样点坐标i找到合适的滤波器,在给定的输入xi∈Rdw×dh×p上得到想要的输出y i∈Rdw×dh×1,其中dw和dh分别表示搜索区域的长和宽,p代表输入数据的维度; 基于相关滤波的跟踪器根据上一帧预测结果在目标点周围密集采样。由于采样点随机,裁取的图像块随机覆蓋跟踪目标,若图像块中包含目标则此样本为正例,若不包含目标则为负例。滤波器的目的是使算法在所有采样图像块中跟踪偏差最小。对该问题的优化求解是一个岭回归问题[20],即

minhL(h; xi, yi) =yi -hTfi2 + λh2(1)

式中: 常数λ用来正则化优化过程,防止滤波器过拟合表示提取出的图像块特征。

针对经典目标跟踪器SRDCF[21]利用大量采样图像块构成循环矩阵学习目标特征时易引入环境背景噪声的问题,CSR-DCF通过学习目标与背景特征分割出模板m,将目标周围环境背景遮挡,来解决优化过程中产生的图像边缘效应。将上述问题式(1)转化为一个有约束的优化问题,即

minhL(h; xi,yi)=yi-hTmfi2 + λh2(2)

Lukeic等[12]引入变量hc≡m⊙h将这个优化问题转化为增广拉格朗日求解问题,即

minh^Hcdiag(f^)-y^2+λ2h2+μh^c-h^2+

[I^H(h^c-h^)+I^H(h^c-h^)](3)

为了简洁,令hm=m⊙h。可以通过 Boyd等[22]的方法分两步循环解决该问题,如式(4)~(5)所示。

h^i+1c=(f^⊙y^+(μh^im-I^i))⊙-1(f^⊙f^+μi) (4)

hi+1=m⊙F-1(I^i+μih^i+1c)/λ2D+μi(5)

滤波器h按式(4)和式(5)就可以分两步实现更新。这里操作符a^= vec (F[a])主要用于将矩阵变量a转化到频域一维向量,长度为图片所含像素数量a^∈RD×1,D=dw·dh,I^是为一个复数的拉格朗日乘子。

2 快速鲁棒跟踪器

高光谱(HSI)数据相对于可见光(RGB)数据维度高,相同时间长度对跟踪器的计算负担更重。CSR-DCF针对可见光图像设计了梯度特征(HOG)、颜色特征(CN)和灰度特征(grayscale),并在特征维度进行叠加作为目标特征。针对高光谱数据,在CSR-DCF跟踪器的基础上,设计了高光谱特征及高光谱运动目标异常检测机制。

2.1 假彩色图像

由于高光谱图像维度远高于RGB图像,直接对高光谱图像提取梯度特征等操作较为费时,因此,抽取高光谱数据低、中、高三个频段信息组成假彩色图像模拟RGB图像,用于提取物体的颜色和梯度信息。假设高光谱数据存在[1, 2, …, p]个频谱段,取最低、中间和最高频率[1, p/2, p]作为抽样频率,级联组成三通道假彩色图像Hs。生成假彩色图像如图1所示。

2.2 高光谱特征

高光谱图像由上百个记录物体反射的连续波段组成,每个像素都是一个频谱向量,因此,存在丰富的物质信息,可以作为判别目标的重要依据。为更好地利用高光谱数据提供的频域、空域和时域信息,抓取物体的物质信息、形状信息、纹理信息和语义信息,参考CSR-DCF的方式根据高光谱数据特点提取三种特征: 梯度特征 (HOG),颜色特征 (CN) 和灰度特征 (grayscale),将其在通道维度上进行拼接,作为跟踪器FRHT的目标特征。梯度特征fhist和颜色特征fcn直接按处理彩色图像的方式从假彩色图像Hs上提取,灰度特征fgray则是将高光谱数据整体Hi作为灰度值送入滤波器,并在通道维度上进行求和,然后正则化。最后,三者特征维度拼接得到跟踪器目标特征。

2.3 运动目标异常检测算法

由于高光谱数据集Whisper中图像序列平均长度达到425帧,跟踪过程考验跟踪器的长时跟踪能力,因此,设计了一个运动目标异常检测算法,帮助跟踪器检测异常目标,从而对跟踪器进行有效更新学习。假设跟踪器的目标响应值在目标的真实位置最大,即与服从高斯分布的真值响应图在真实坐标点处的差异最小,提出以响应峰值差异Dpeak作为高光谱异常的检验指标之一。其次,若是在真实坐标周围出现多个高峰值响应,即出现假目标干扰跟踪,提出利用峰值旁瓣比Dpsr作为当前响应图可靠性的判断依据。为使运动目标异常检测算法简洁有效,提出下式作为判断跟踪器可靠性的依据:

D(Response, yi)=w1×Dpeak+w2×1/Dpsr

Dpeak=max(Rexpect-Response)

Dpsr=max(Response)-μΨ(Response)σΨ(Response)(6)

式中: Rexpect为期望的以目标真值为中心的高斯分布响应图; Response为真实的跟踪响应图; Dpeak为响应图的期望与实际差值的最大值; Dpsr为根据响应图求得的峰值旁瓣比; w1和w2为两项差异值的权重; Ψ为目标周围的子区域。

若目标确定性越高,意味着在响应图上的响应越高,与其他预测点的差异就越大,因此,对其取倒数作为判断跟踪器异常的指标之一。只有在输出与期望差异大于设定阈值时,跟踪器才会限制更新,以免受非目标区域污染。

2.4 算法逻辑

以CSR-DCF跟踪器为基础框架,采用设计的高光谱特征,进行高光谱目标跟踪,并在目标异常的时候自适应停止更新跟踪器,步骤5,6,7与CSR-DCF采取相同原则进行,跟踪总体流程如图2所示。

3 实 验

3.1 参数设置

实验中使用了HOG[23],CN[24]和grayscale三种特征。在进行前景背景分割预测模板的时候,用于统计直方图的格数是16,每个颜色层的可靠性权重预测的最小值αmin=0.05。在具体的跟踪器参数设置上,与采用的跟踪器CSR-DCF基本保持一致。设置在第10帧以后,执行跟踪异常检测算法。设置差异阈值Threshold=0.35; 跟踪器的学习率η=0.02; 岭回归问题中的正则化参数λ=0.01; 增广拉格朗日问题中的优化参数μ0=5,β=3。所有的参数在跟踪过程中保持不变,若高光谱检测到目标异常,则所有学习率乘以权重0.85。该实验主要是基于MATLAB语言实现,在CPU为AMD3900X的工作站上进行,操作系统为 Ubuntu 20.04 OS。

3.2 對比方法

本文在 Whisper数据集上进行测试学习,该数据集是目前最权威的公开高光谱目标跟踪数据集,有50个视频序列,覆盖多种场景,总计11 种复杂场景。

选取当下性能最优的8种跟踪器作为对比跟踪的方法, 分别是 MHT[7], Staple[8], DSST[9], SAMF[11], CSR-DCF[12], KCF [17], BACF[18], fDSST[25]。除 MHT 和本文提出的快速鲁棒跟踪器 FRHT 外,其余跟踪器均是针对可见光视频序列设计,因此,在Whisper提供的 RGB 图像上测试 RGB 跟踪器的性能。采用跟踪精确度 PR (Precision Rate)和跟踪成功率 SR (Success Rate)评价跟踪器的性能。PR 是视频序列中跟踪器与真值的误差在一定范围的帧数与总帧数的比值,文中将像素距离设置为20。SR 是跟踪器的预测目标框与真值目标框重合度大于一定阈值的帧数与总帧数的比值。

3.3 有效性测试

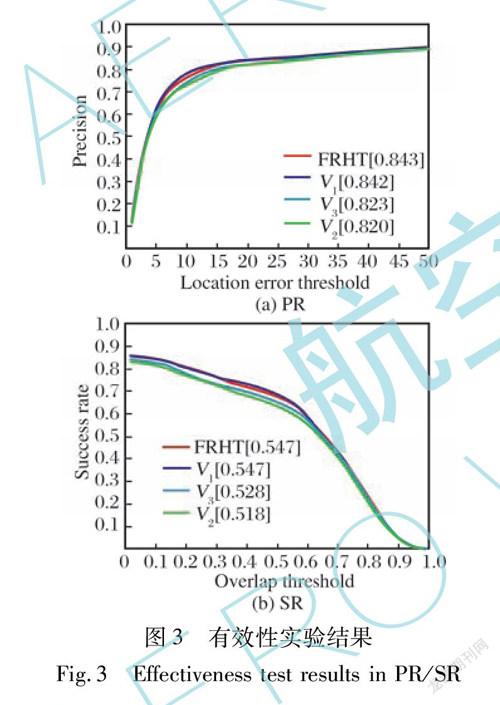

为了验证所提方法的有效性,使用三种变体V1,V2,V3。其中: 变体V1将FRHT中的高光谱异常检测机制去除; 变体V2不在通道维度压缩FRHT所使用的grayscale特征fgray,保持维度不变,仍为p; 变体V3同时采取变体V1和V2相对于FRHT所做改变。图3展示了对比结果。

可以看出,采取本文的算法取得性能最优,与之相对的变体V1和V2在PR指标上分别下降0.1%和2.3%,V2在SR指标上下降2.9%。V3在 PR和SR上分别下降 2.0%和1.9%。FRHT将高光谱灰度特征fgray压缩至1通道,相对于V2性能更优,是由于多谱段目标位置存在偏移,将其在特征提取阶段进行预融合,降低了跟踪器跟踪目标的难度。V1表现不及本文所提算法,可以看出高光谱异常检测机制的有效性。

3.4 性能分析

为了证明所提方法的性能,与当下性能最优的几种跟踪算法进行比较。KCF跟踪器对提取的图像特征施加了一个线性核,将其映射到新的维度空间,提高了跟踪器在背景中辨识目标的能力,文中设置提取的图像特征为CN,故实验中表示为KCF-CN; BACF通过将所有的背景图像块视作负例,可以针对相关滤波器裁图像块进行训练产生的边界效应进行抑制,MHT采取 BACF作为其基础跟踪器; DSST和fDSST是Danelljan等人提出的可以精确预测目标尺寸的跟踪器,在跟踪过程针对目标尺寸变化可以保持鲁棒性; Staple 通过提取目标复合信息可以使跟踪器更鲁棒。本文的跟踪器 FRHT采用CSR-DCF作为基础跟踪器。FRHT性能略低于MHT的原因在于追求跟踪器运行效率,简化特征,但损失了部分信息量。与其他7种算法相比,本文方法取得了更优的性能,如图4所示。 FRHT与 KCF和fDSST相比,在 PR 上分别提升31%和11.3%,在 SR 上分别提升29.1%和8.7%,增益效果显著。主要原因在于KCF和fDSST在目标偏移时不具有纠偏能力,对于长序列跟踪能力不足。与基础算法 CSR-DCF相比,在 PS和SR 上分别提升了2.3%和2.9%。FRHT提取的特征是高光谱灰度特征、梯度特征和颜色特征,相对于CSR-DCF特征细节更加丰富。

为了更全面地对比FRHT与其他跟踪器在各种挑战下的性能,将结果展示在表1中(略去效果较差的两种跟踪器),最好的三种跟踪器依次用红、绿、蓝三种颜色标记。可以看出,FRHT在挑战 OPR,IPR,BC,DEF下取得了性能最优的成绩。相对于MHT 跟踪器采取的复杂目标特征,FRHT的目标特征更加高效,在保持跟踪效果相近的情形下,处理速度相对于MHT大幅提升(FPS: 16.3 vs 2.6)。不仅如此,FRHT采取的运动目标异常检测机制可以及时检测当前帧的目标状态,从而抑制跟踪器的更新,使跟踪器免于污染。

同樣,为了体现跟踪效果,将FRHT与其他跟踪器在数据集上的表现体现在图5中。FRHT,SAMF,KCF-CN和目标真值框在Whisper数据集上的表现,分别用绿色、红色、黄色和蓝色进行标记。可以看出,本文的跟踪器在长时或短时序列上均可以取得精确的目标跟踪结果。

4 结 论

在复杂环境下的准确跟踪是高光谱目标跟踪区别于传统视觉目标跟踪的重要特质。本文针对当前提出的高光谱算法不能实现快速跟踪的缺点,设计了一个快速鲁棒算法FRHT。该方法通过生成假彩色图像模拟RGB图像的梯度和颜色特征,利用原始灰度图像在通道维度压缩正则化得到灰度特征,最终生成低维高光谱特征,能够压缩高光谱数据并保留充分目标信息。同时,设计了高光谱运动目标异常检测机制,针对高光谱长序列做出针对性改善,在检测到目标漂移或目标丢失等情况时,降低跟踪器学习率,减少跟踪器污染问题。采用基于相关滤波的跟踪框架,处理速度达到16.3 FPS,接近实时,满足实际应用场景。

参考文献:

[1] 高晋占. 微弱信号检测[M]. 北京: 清华大学出版社, 2004.

Gao Jinzhan. Detection of Weak Signals[M]. Beijing: Tsinghua University Press, 2004. (in Chinese)

[2] 毛银盾, 唐正宏, 于涌, 等. 地球同步轨道动态监视光学系统研制进展[J]. 天文学进展, 2018, 36(1): 57-67.

Mao Yindun, Tang Zhenghong, Yu Yong, et al. Introduction and Development of Geosynchronous Orbit Dynamic Monitoring Optical System[J]. Progress in Astronomy, 2018, 36(1): 57-67.(in Chinese)

[3] 王敏. 复杂背景下的空间目标自动识别技术[D]. 长春: 中国科学院长春光学精密机械与物理研究所, 2017.

Wang Min. Automatic Recognition of Space Targets in Complex Background[D]. Changchun: Changchun Institute of Optics, Fine Mechanics and Physics, Chinese Academy of Sciences, 2017. (in Chinese)

[4] 刘志刚, 卢云龙, 魏一苇. 有监督的高光谱图像伪装目标检测方法[J]. 红外与激光工程, 2013, 42(11): 3076-3081.

Liu Zhigang, Lu Yunlong, Wei Yiwei. Supervised Method for Hyperspectral Image Camouflage Target Detection[J]. Infrared and Laser Engineering, 2013, 42(11): 3076-3081.(in Chinese)

[5] The Tesla Team. A Tragic Loss [EB/OL]. (2016-06-30)[2021-07-16]. https:∥www.tesla.com/blog/tragic-loss.

[6] Tochon G, Chanussot J, Dalla Mura M, et al. Object Tracking by Hierarchical Decomposition of Hyperspectral Video Sequences: Application to Chemical Gas Plume Tracking[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(8): 4567-4585.

[7] Xiong F C, Zhou J, Qian Y T. Material Based Object Tracking in Hyperspectral Videos[J]. IEEE Transactions on Image Processing, 2020, 29: 3719-3733.

[8] Bertinetto L, Valmadre J, Golodetz S, et al. Staple: Complementary Learners for Real-Time Tracking[C]∥IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2016: 1401-1409.

[9] Danelljan M, Hger G, Khan F S, et al. Accurate Scale Estimation for Robust Visual Tracking[C]∥British Machine Vision Conference, 2014.

[10] Galoogahi H K, Fagg A, Lucey S. Learning Background-Aware Correlation Filters for Visual Tracking[C]∥IEEE International Conference on Computer Vision (ICCV), 2017: 1144-1152.

[11] Li Y, Zhu J K. A Scale Adaptive Kernel Correlation Filter Tracker with Feature Integration[C]∥European Conference on Computer Vision, 2014: 254-265.

[12] Lukeicˇ A, Vojír T, Cˇ ehovin L, et al. Discriminative Correlation Filter Tracker with Channel and Spatial Reliability[J]. International Journal of Computer Vision, 2018, 126(7): 671-688.

[13] Li B, Yan J J, Wu W, et al. High Performance Visual Tracking with Siamese Region Proposal Network[C]∥IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2018: 8971-8980.

[14] Li B, Wu W, Wang Q, et al. SiamRPN++: Evolution of Siamese Visual Tracking with Very Deep Networks[C]∥IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2019: 4277-4286.

[15] Voigtlaender P, Luiten J, Torr P H S, et al. Siam R-CNN: Visual Tracking by Re-Detection[C]∥IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2020: 6577-6587.

[16] Bolme D S, Beveridge J R, Draper B A, et al. Visual Object Tracking Using Adaptive Correlation Filters[C]∥IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2010: 2544-2550.

[17] Henriques J F, Caseiro R, Martins P, et al. High-Speed Tracking with Kernelized Correlation Filters[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(3): 583-596.

[18] Danelljan M, Bhat G, Khan F S, et al. ECO: Efficient Convolution Operators for Tracking[C]∥IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2017: 6931-6939.

[19] Kristan M, Leonardis A, Matas J, et al. The Visual Object Tracking VOT2017 Challenge Results[C]∥IEEE International Conference on Computer Vision Workshops (ICCVW), 2017: 1949-1972.

[20] Kart U, Kmrinen J K, Matas J, et al. Depth Masked Discriminative Correlation Filter[C]∥24th International Conference on Pattern Recognition (ICPR), 2018: 2112-2117.

[21] Danelljan M, Hger G, Khan F S, et al. Learning Spatially Regularized Correlation Filters for Visual Tracking[C]∥IEEE International Conference on Computer Vision (ICCV), 2015: 4310-4318.

[22] Boyd S, Parikh N, Chu E, et al. Distributed Optimization and Statistical Learning via the Alternating Direction Method of Multipliers[M]. Now Publishers Inc., 2011.

[23] Dalal N, Triggs B. Histograms of Oriented Gradients for Human Detection[C]∥IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR), 2005: 886-893.

[24] van de Weijer J, Schmid C, Verbeek J, et al. Learning Color Names for Real-World Applications[J]. IEEE Transactions on Image Processing, 2009, 18(7): 1512-1523.

[25] Danelljan M, Hger G, Khan F S, et al. Discriminative Scale Space Tracking[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(8): 1561-1575.

Fast and Robust Hyperspectral Object Tracking Algorithm

Xu Qingyu1,Li Dongdong1, Kuai Yangliu2*, Sheng Weidong1, Deng Xinpu1

(1. College of Electronic Science and Technology, National University of Defense Technology, Changsha 410073, China;

2. Mechanical Service Center for Vocational Education, National University of Defense Technology, Changsha 410073, China)

Abstract: Aiming at the problems encountered by traditional object tracking, such as confusion between object and background and rapid change of target appearance, a fast and robust object tracking algorithm (FRHT) is proposed based on the 2D spatial information and rich 1D spectral information included in hyperspectral video. Firstly, based on the characteristics of hyperspectral data, spectral attention mechanism is introduced into the traditional spatial attention mechanism, and an adaptive update learning tracker under the framework of correlation filtering is designed. Secondly, hyperspectral moving object features are designed manually to speed up the operation of the tracker. Finally, a moving object anomaly detection mechanism is proposed to improve the robustness of the tracker. The simulation results show that the speed and accuracy of the tracker FRHT are significantly better than the traditional tracking algorithms such as KCF, SAMF and CSR-DCF on hyperspectral data sets, and the accuracy is improved by more than 2%. After introducing the moving object detection mechanism, the robustness of the algorithm is improved.

Key words: object tracking; object feature; hyperspectral; correlation filter; attention mechanism;robustness