用于肺部肿瘤图像分割的跨模态多编码混合注意力U-Net

周涛,董雅丽,刘珊,陆惠玲,马宗军,侯森宝,邱实

(1 北方民族大学 计算机科学与工程学院,银川 750021)

(2 北方民族大学图像图形智能处理国家民委重点实验室,银川 750021)

(3 宁夏医科大学 理学院,银川 750004)

(4 宁夏医科大学总医院骨科,银川 750004)

(5 中国科学院西安光学精密机械研究所,西安 710119)

0 引言

肺癌是一种常见且恶性程度高的癌症[1],5年生存率仅为18%[2],严重威胁着人们的健康。医学影像技术[3]对肺部肿瘤的临床治疗有重要意义,其无创的成像方式被广泛应用在肿瘤诊断、分期、疗效评估等多个阶段,然而目前医学图像病灶分割仍存在一些挑战:1)病灶勾画依赖有经验的临床医生手动分割,人体复杂的解剖结构导致该工作费时费力;2)肺部肿瘤图像对比度低、病灶大小和形状不一、病灶位置多变,导致精准分割困难;3)肺部肿瘤图像数据类别分布不平衡,存在大量背景信息干扰。

医学图像分割方法分为传统方法和深度学习方法,传统分割方法[4-6]依赖参数的设定,对初始轮廓敏感,对复杂形状和对比度低的图像分割效果不理想。以卷积神经网络(Convolutional Neural Networks,CNNs)为代表的深度学习方法在计算机视觉中迅速发展。医学图像分割要求分割结果更加准确,然而数据集少、缺乏标签等特点给医学图像分割带来了困难。2015年,RONNEBERGER O[7]提出网络架构对称的U-Net,在少量医学数据的情况下仍能获得良好的分割结果,应用于多种医学图像分割场景[8-9]。黄鸿[10]提出基于U-Net++改进的肺结节分割算法,从网络不同深度提取语义信息,然后通过权重聚合模块自适应学习网络不同层的特征权重。ZHANG J[11]提出LCU-Net(Low-cost U-Net)用于环境微生物图像分割,网络使用Inception 模块增大感受野,针对改进U-Net 的分割结果使用密集条件随机场进行后处理。但是U-Net 网络存在三个问题:1)U-Net 网络对每一幅特征图使用统一的参数,对于大小不一、形状复杂的病灶,网络可能出现空间感知不高,分割性能下降;2)U-Net 未充分考虑不同通道对特征的表达能力,影响模型的鲁棒性和分割性能;3)大多数多编码器U-Net[12-13]通过提取单模态医学图像目标切片的信息,提高网络分割性能,但是未充分利用不同模态医学图像对病灶的特征表达能力。

针对以上问题,本文提出基于多编码器混合注意力机制的U-Net 网络(Multi-Encoder Attention UNet,MEAU-Net),将病灶的多个模态医学图像同时输入到网络;使用混合注意力机制,其中通道注意力机制使得网络关注重要的特征通道,空间注意力机增强网络对病灶部位的聚焦能力;最后使用多尺度特征聚合模块,对网络解码阶段得到尺度不同的特征图聚合,实现不同尺度特征的充分利用。

1 网络架构

基于U-Net 提出多编码器混合注意力机制网络MEAU-Net。网络包括提取多模态医学图像特征的编码器、还原病灶图像语义特征的解码器,在跳跃连接部分添加混合注意力机制,在解码路径使用多尺度特征聚合块。正电子发射断层扫描图像(Positron Emission Tomography,PET)图像提供病灶功能信息,计算机断层扫描成像(Computed Tomography,CT)图像提供病灶的解剖信息,正电子发射计算机断层显像(Positron Emission Tomography/Computed Tomography,PET/CT)结合两者的优点,多模态医学图像包含的病灶信息比单模态图像更丰富,因此网络同时向编码器中输入PET/CT、PET 和CT 的感兴趣区域(Region of Interest,ROI)图像提取三种模态图像病灶特征。在网络跳跃连接部分,使用混合注意力机制,包括空间注意力机制和通道注意力机制。受文献[14]启发,对PET/CT 和CT 图像特征使用空间注意力机制,强调特征图中病灶区域,抑制无关背景。使用通道注意力机制对PET/CT、CT 和PET 三个分支提取对应通道的权重值,突出网络中特征图重要通道。针对解码路径得到精细程度不同的多尺度特征图,使用多尺度特征聚合块充分利用病灶不同尺度特征图,从而实现对图像病灶的精准分割。

1.1 三编码器网络

MEAU-Net 编码路径包括PET/CT、PET 和CT 三个分支,其中CT 和PET/CT 分支由四个下采样块组成,PET 分支由三个下采样块组成。每一个下采样块包括两个卷积块和最大池化操作。卷积块包含3×3Same 卷积(指输入与输出特征图尺寸相同),批归一化(Batch Normalization,BN)和激活函数ReLU,卷积步长和填充均为1。通过上述两次卷积之后,使用2×2 最大池化进行下采样。网络最后一层将PET/CT 和CT 分支的特征进行叠加,然后使用1×1 卷积将维度降低到1 024,将降维后的特征图传输到解码路径。解码路径由四个上采样块组成,每个上采样块由与编码路径一致的两个卷积块、一个2×2 转置卷积组成。在跳跃连接部分,将经过混合注意力机制的特征图输入到解码路径。针对解码路径得到不同尺度特征,使用多尺度特征聚合块对跨尺度的特征进行聚合,最终输出分割结果。图1 为MEAU-Net 网络架构。

图1 MEAU-Net 网络架构Fig.1 MEAU-Net network architecture

MEAU-Net 网络基于编码器和解码器两个部分,编码器用于捕获PET/CT、PET 和CT 图像的低级特征,每个编码块包括两次3×3 卷积操作、BN 和ReLU。过程表示为

解码器通过上采样和跳跃连接操作逐步恢复图像的空间信息,网络拼接编码器通过混合注意力机制的特征和解码器后一层的特征进行上采样。混合注意力机制使网络关注在图像病灶部分和重要通道,将编码器对应层的PET/CT、PET、CT 三个分支的特征经过空间和通道注意力机制输入到解码器,参与网络的上采样操作。上采样操作表示为

式中,U(·)表示两次卷积操作和转置卷积操作,φl-1表示网络解码器l−1 层的特征图,+表示特征拼接,A(·)表示混合注意力机制操作。编码器分别包含PET、PET/CT 和CT 三个分支的编码卷积块。解码器共四层,每一层包括上采样块和编码器对应层特征。

1.2 混合注意力机制

网络跳跃连接引入空间注意力机制和通道注意力机制,对重要相关特征施加更多权重,允许网络专注于输入的特定部分,而不是输入每个特征。针对不同通道和空间特征对分割任务的不同贡献,对其分配不同的权重。

1.2.1 空间注意力机制

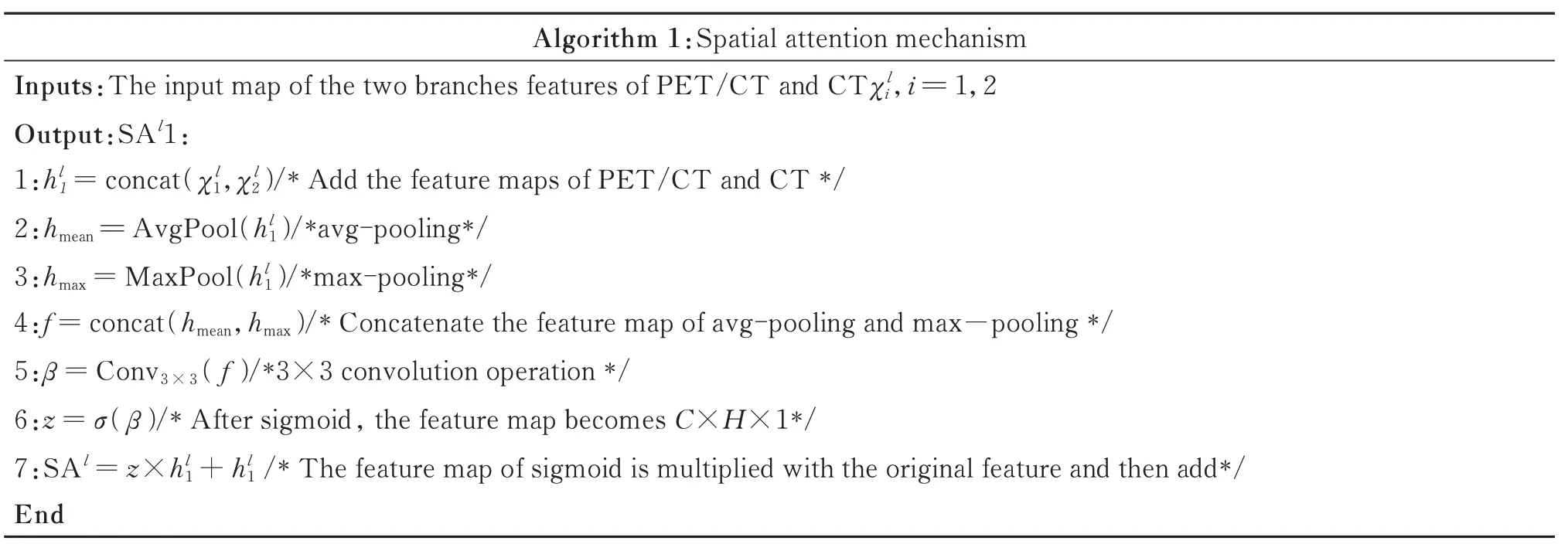

使用空间注意力机制聚焦特征图中病灶部分,抑制背景等无关信息。PET 成像技术对高代谢的组织和病灶呈现高亮信号,存在空间分辨率低的问题,不能提供准确的病灶边缘。所以空间注意力机制使用PET/CT 和CT 两种医学图像。算法伪代码(算法1)表示为

?

首先对输入的两种特征图进行叠加,分别对其平均池化和最大池化,平均池化对肺部病灶图像去噪,最大池化突出医学图像中病灶部分;然后拼接两种池化之后的特征图,对拼接后的特征图使用3×3 卷积操作,使用sigmoid 将特征值压缩到0 到1 之间,叠加的特征图与sigmoid 后的权重值相乘,最后相乘后的特征图与初始特征图叠加,图2 为空间注意力机制示意图。

图2 空间注意力机制Fig.2 Spatial attention mechanism

空间注意力机制具体表示为

式中,F表示操作的特征图,SA(·)表示空间注意力机制操作和分别为当前l层的PET/CT 和CT 特征图,AvgPool 表示平均池化,MaxPool 表示最大池化,σ表示sigmoid 操作,⊕表示特征图叠加。

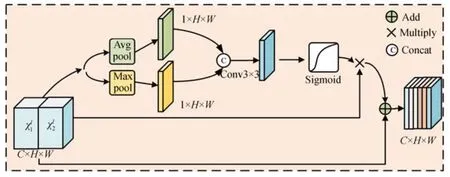

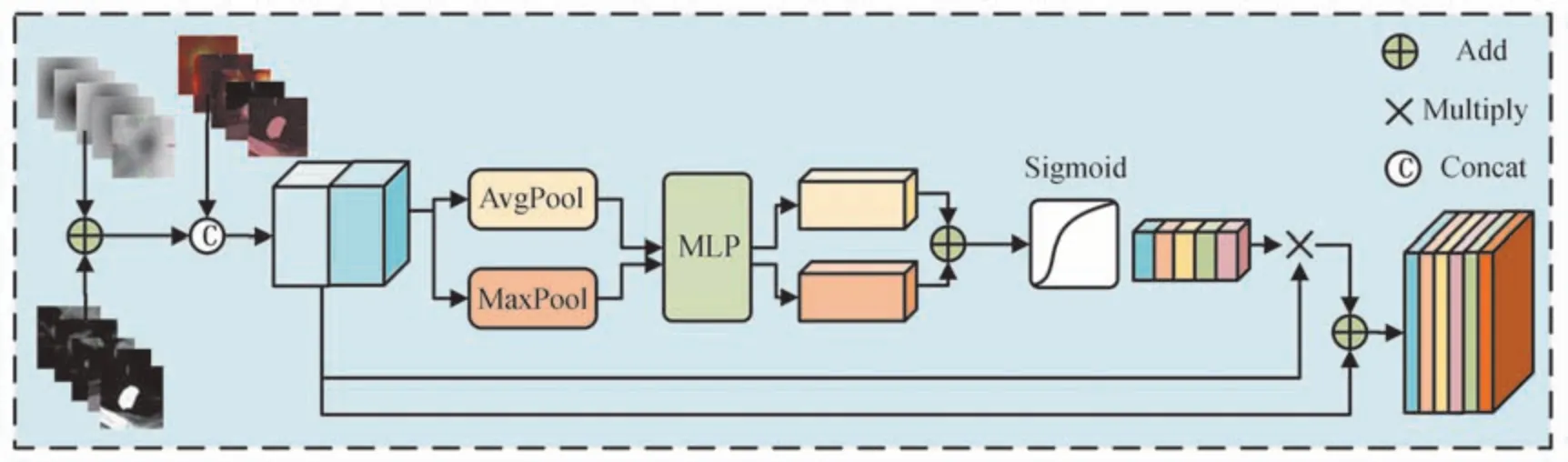

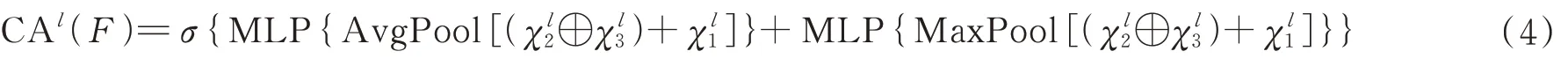

1.2.2 通道注意力机制

MEAU-Net 通过跳跃连接将编码路径特征拼接到解码路径,对编码路径三种特征进行通道注意力很有必要。使用通道注意力机制对来自编码器的三种模态特征图进行重要通道加权,对重要的通道分配更多的权重。通道注意力机制伪代码(算法2)表示为

PET/CT、CT 和PET 病灶图像提供的病灶信息不同,由于PET 图像反映病灶代谢信息,CT 图像包含丰富的病灶解剖信息,首先将来自编码路径的CT 特征图与PET 特征图叠加,将叠加之后的特征图与PET/CT 特征图拼接。为了保留特征图中更多信息,分别使用平均池化和最大池化对拼接的特征图处理得到两个1×1×C权重值。接着使用由两个全连接层和ReLU 组成多层感知机(Multi-Layer Perceptron,MLP),其中第一个全连接层有C/3 个神经元,连接ReLU,第二个全连接层有C个神经元。最后将MLP 得到的两个结果进行和操作,经过Sigmoid 得到α,将α与χl相乘之后再叠加。图3 为通道注意力机制示意图。

图3 通道注意力机制Fig.3 Channel attention mechanism

通道注意力机制可表示为

式中,CA(·)表示通道注意力机制。最后将空间注意力机制的特征图与通道注意力的特征图相叠加,即为混合注意力机制的特征图,输入到对应层的解码器中。混合注意力可表示为

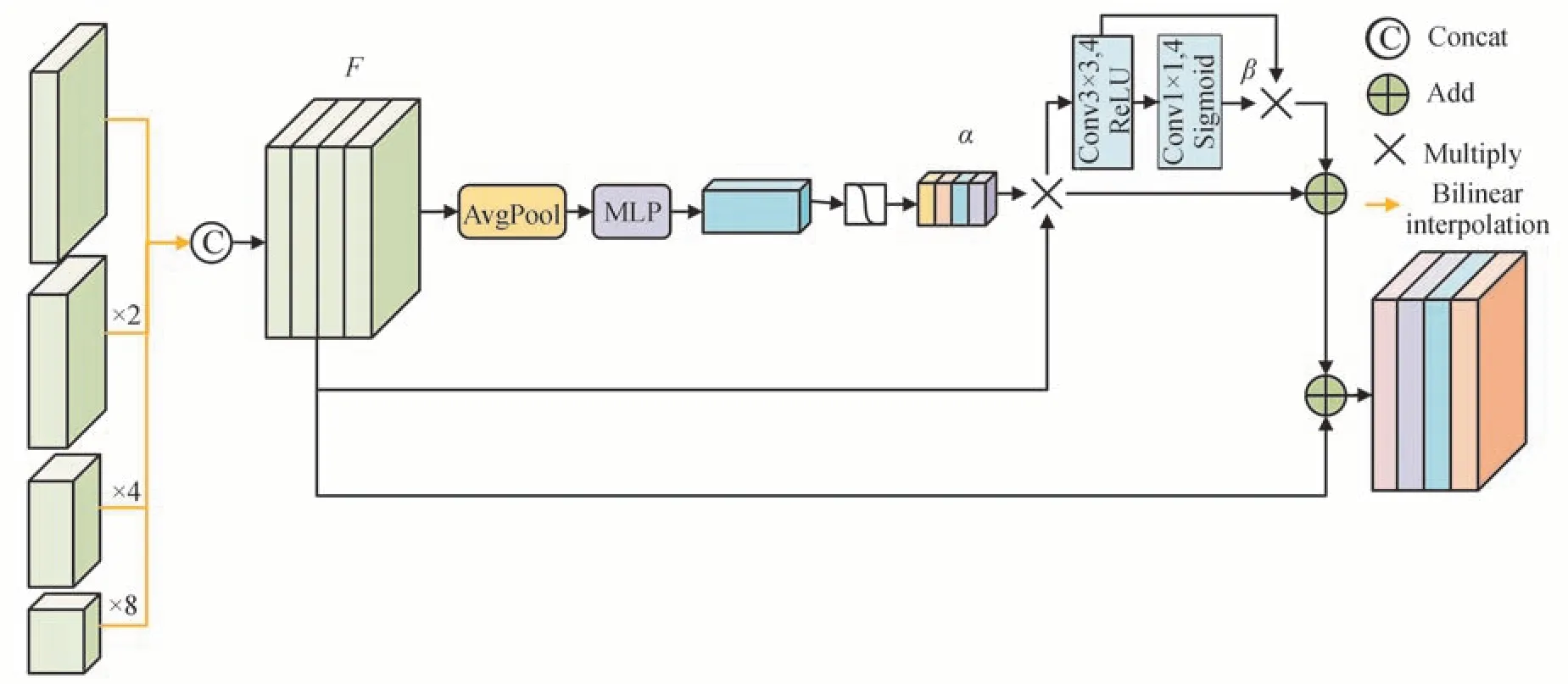

1.3 多尺度特征聚合块

网络解码阶段得到尺度不同的特征图,这些特征图包含编码路径的低级特征和解码路径的语义特征。由于不同尺度得到的特征图大小不同,通过上采样放大的特征图的像素相关性是不同的,直接对放大的特征图处理可能会丢失信息。因此,受文献[15]启发,使用多尺度特征聚合(Multi-Scale Feature Aggregation,MFA)模块,模块示意图如图4所示。首先,使用双线性插值将不同尺度特征图放大到原图像50 pixel×50 pixel大小,然后使用1×1 卷积将四个尺度特征分别压缩为16,接着将其拼接,然后进行平均池化和MLP 得到通道系数α,即

图4 多尺度特征聚合块Fig.4 Multi-scale feature aggregation block

通道系数与拼接的特征图相乘之后进行3×3 卷积、ReLU 和1×1 卷积、Sigmoid,得到系数β,即

最后使用残差连接将特征连接起来。具体过程表示为

2 实验结果与分析

2.1 数据集及数据预处理

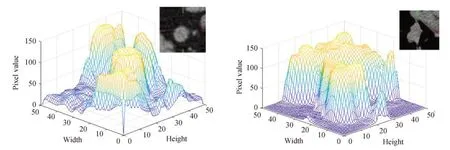

CT 是诊断肿瘤工具之一,它能够反映病灶的解剖信息。然而CT 对于肿瘤微小病灶和原发灶的检出率低,容易导致漏诊。肿瘤组织相比正常组织生长迅速、代谢旺盛,PET 利用这些特点将示踪剂注入人体内使得标记物在病灶内聚集。PET/CT 将功能成像PET 和解剖成像CT 两种成像技术相结合,综合后的图像将病灶的解剖信息和功能信息反映在同一幅影像上,得到肿瘤的位置、形态、密度、代谢信息和大小。从而达到“1+1>2”的效果,得到更为准确的病灶信息,实现对疾病的“定位”、“定性”、“定量”、“定期”。18F FDG PET/CT 对肺癌的治疗至关重要,其能无创地确定转移病灶和预测肿瘤特征[16],广泛应用于肺部肿瘤的良恶性诊断[17]、分期[18]、预后评估[19]和治疗方案制定[20]的决策等。如图5 所示CT 图像中肉眼很难分辨病灶和正常组织的密度差异,而PET/CT 图像中病灶代谢旺盛,呈高亮,因此多模态医学图像可以更好地定位病灶,识别病灶边缘。

图5 CT、PET/CT 和PET 图像Fig.5 CT,PET/CT and PET image

选用2018年1月-2019年6月在宁夏某三甲医院核医学科进行PET/CT 全身检查的90 例肺部肿瘤临床患者,包括女性32 例,男性58 例。获取患者已配准的PET/CT、PET 和CT 二维肺部肿瘤图像,患者年龄范围为26~82 岁,平均年龄为60 岁。PET/CT、PET 和CT 图像各90 张,该数据集标签均由临床医生参考肺部多模态医学图像后手动勾画。经过旋转和镜像等数据增广处理,最终三种模态图像数据集样本个数分别为1 026 张,其中909 张划分为训练集,117 张划分为测试集。肺部医学图像存在病灶和背景分布不平衡问题,网络容易学习到图像大量背景信息,导致分割结果不准确。肺部病灶由于其本身的成像特点给图像分割带来一定的困难,如人体解剖结构复杂,组织间相互重叠导致病灶边缘模糊[21]。因此对获取的医生标注CT、PET 和PET/CT 二维切片尺寸为356 pixel×356 pixel,使用Hough 变换[22]对医生标注的肺部CT 图像进行直线检测获取感兴趣区域,感兴趣区域大小为50 pixel×50 pixel。首先将彩色图像转化成灰度图像,使用5×5 高斯滤波对CT 图像进行模糊处理,然后使用Canny 边缘检测算法获得图像中每个像素的边缘梯度和梯度方向,其次进行Hough 变换,将图像从直角坐标系映射到Hough 空间,将图像中的边缘点从直角坐标系转换到极坐标的参数方程,进而找到图像中相交的两条病灶的标注直线,最后对CT、PET 和PET/CT 图像进行50 pixel×50 pixel 的裁剪,得到ROI 图像。针对医学图像中病灶与背景对比度低的问题使用基于曝光融合[23]的图像对比度增强方法来提高肺部病灶CT 图像的对比度。

2.2 评价指标

为评估MEAU-Net 性能,采用戴斯相似系数(Dice Similariy Coefficient,DSC)、召回率(Recall)、体积重叠误差(Volumetric Overlap Error,VOE)和相对体积差异(Relative Volume Difference,RVD)来评估模型分割性能。4 种评价指标的公式定义分别为

式中,病灶区域被正确分割的定义为真阳性(True Positive,TP),正常组织区域被分割为病灶区域定义为假阳性(False Positive,FP),正常区域被正确分割定义为真阴性(True Negative,TN),病灶区域分割为正常区域定义为假阳性(False Negative,FN),P表示模型预测的目标像素,G表示标签值(ground truth)中的目标像素。

2.3 实验环境与参数设置

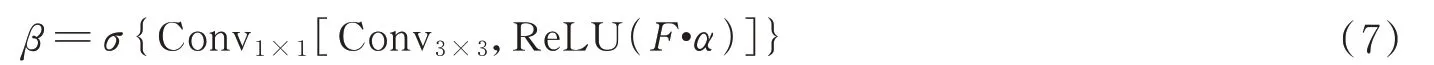

实验硬件环境:服务器IntelI XI(R)Gold 6154 CPU,内存256GB,显卡NVIDIA TITAN V,python3.7,PyTorch1.7.0,CUDA 版本为11.1.106。使用Adam 优化器,训练次数为200,学习率初始化为0.005,批处理大小为8,为了防止网络过拟合,在网络层中加入dropout,取值为0.5。损失函数是用来评估网络模型的预测值和真实值差异的函数,损失函数越小,意味着模型的预测值和真实值之间的差异越小。使用交叉熵损失函数,其中y'表示模型的输出,定义为

2.4 结果与分析

通过两组实验来说明MEAU-Net 模块的先进性,第一组实验验证多编码器对网络分割的影响;第二组实验在三编码器U-Net 基础上,探索混合注意力机制对模型性能的影响;最后,将MEAU-Net 与先进分割方法作比较。需要说明的是,采用DSC、Recall、VOE 和RVD 等4 个评价指标对算法进行评价,但是体积重叠误差VOE 和相对体积差异RVD 是越小越好,为了统一4 个评价指标,VOE 和RVD 两个评价指标的值是取1 与这两个指标的差值。

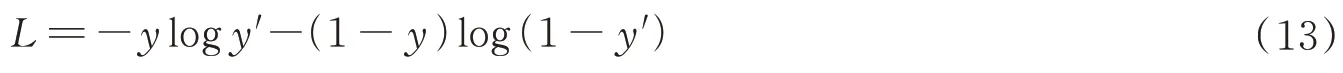

2.4.1 不同编码器分割网络

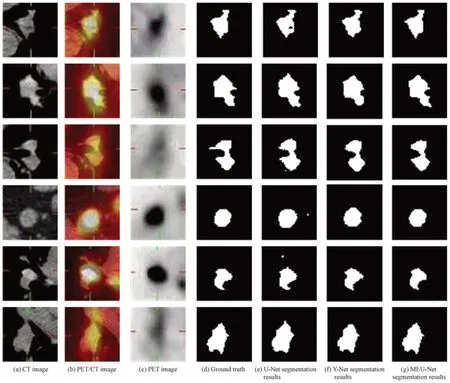

通过三个实验对比不同编码器对分割效果的影响。实验一使用原始U-Net[8]仅输入单模态CT 的图像,使用909 张CT 图像作训练集,117 张CT 图像作测试集。实验二使用两编码器的Y-Net[24],该网络包括两个编码器和一个解码器,将同层的两个编码器提取的特征与解码器下层提取的特征叠加输入到对应层的解码器中,两个解码器分别输入CT 和PET 图像,使用PET 和CT 图像各909 张作训练集,PET 和CT 图像各117张作测试集。实验三使用三编码器U-Net 模型MEU-Net(Multi Encoder U-Net),在编码器最后一层将三个编码器提取的多模态医学图像低级特征叠加,由于PET 图像的病灶轮廓模糊,将编码层PET/CT 和CT特征图拼接后经跳跃连接输入对应解码层,使用PET/CT、CT 和PET 图像各909 张作训练集,PET/CT、CT 和PET 图像各117 张作测试集。CT 图像的三维灰度图如图6 所示,不同编码器网络分割结果如表1 所示,图7 为不同编码器架构分割结果。

表1 多编码器分割结果Table 1 Segmentation results of multi-encoders

图6 CT 图像三维灰度图Fig.6 CT image three-dimensional gray value

图7 不同编码器网络分割结果Fig.7 Network segmentation results of different encoders

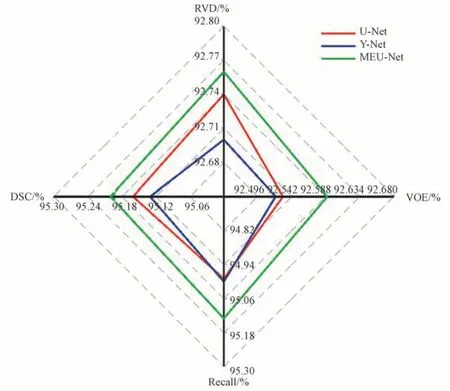

从表1 中可以看出,两编码器Y-Net 网络的DSC 和Recall 指标不如U-Net 网络,分别降低了0.03%和0.01%,而VOE 和RVD 指标比U-Net 好,分别增加了0.01%和0.04%,两编码器Y-Net 网络输入PET 和CT 图像提取特征,由于PET 图像不同于CT 图像,其提供病灶的代谢信息,帮助定位病灶,但是缺乏清晰的病灶轮廓信息,所以仅部分指标高于U-Net。三编码器MEU-Net 的DSC 和Recall 较两编码器Y-Net 分别提升了0.07%和0.13%,VOE 和RVD 分别增加了0.07%和0.06%,总的来说,三编码器MEU-Net 网络的分割指标均高于两编码器Y-Net 和U-Net,DSC、Recall、VOE 和RVD 分别为95.20%、95.13%、92.59% 和92.76%,由此可以看出模态互补的医学图像对病灶分割性能有一定提升。图7 为不同编码器网络的分割结果,从图中可以看出,肺部病灶形状复杂且与正常组织粘连,具有一定的分割难度,U-Net 分割部分病灶出现了欠分割情况,如图7(e)第一行。两编码器Y-Net[24]对于病灶形状复杂的分割效果不如其它两个网络,如图7(f)的第二行和第三行。三编码器MEU-Net 网络对于轮廓复杂与正常组织粘连的病灶分割效果优于其它两个网络,如图7(g)的第二、三行。图8 使用雷达图比较不同分割架构的性能,可以看出三编码器MEU-Net 的DSC、Recall、VOE 和RVD 均比其它网络架构高,说明其效果优于其它两个网络。

图8 不同编码器分割结果对比Fig.8 Comparison of segmentation results of different encoders

2.4.2 混合注意力机制

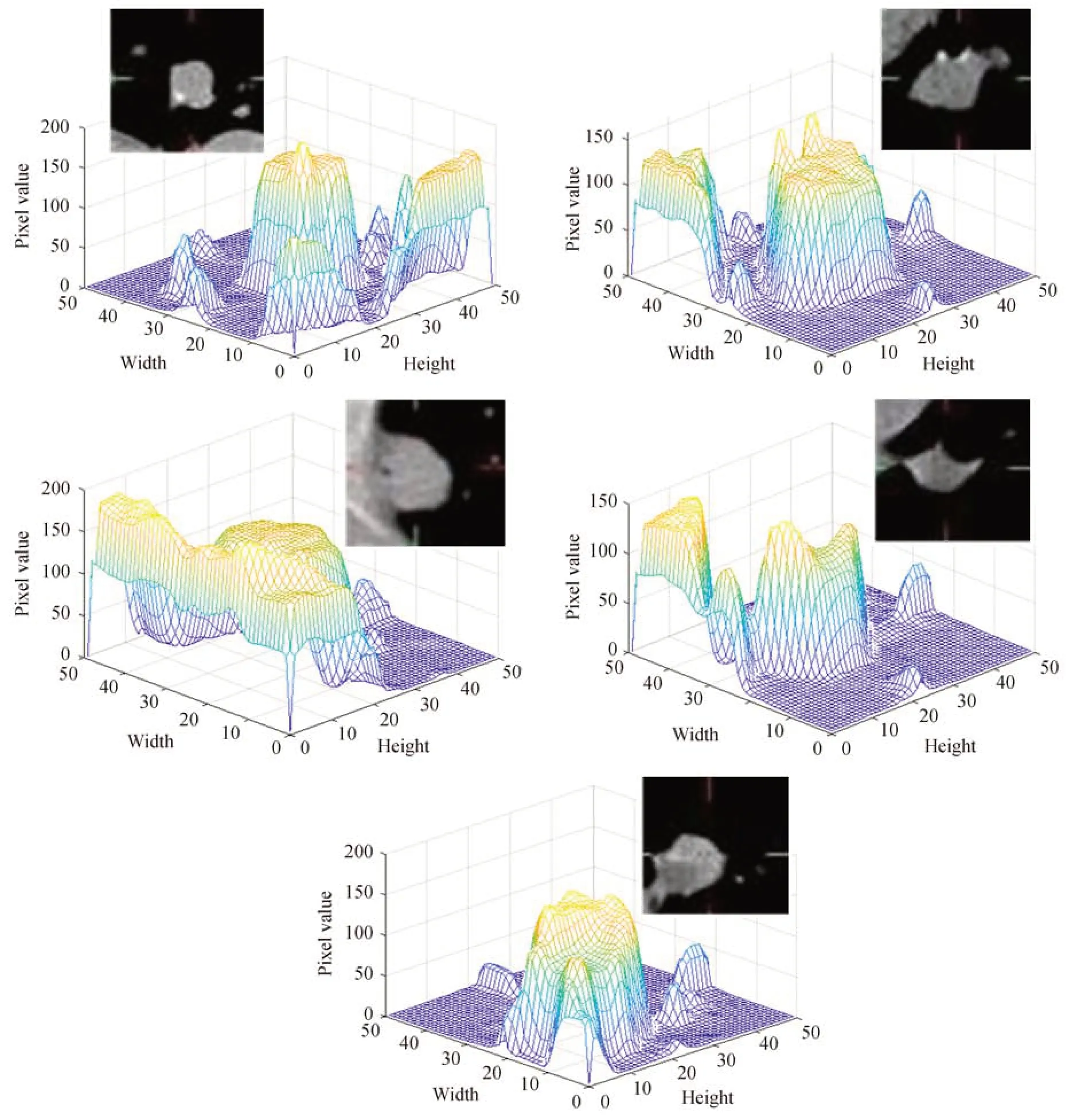

本组实验基于三编码器U-Net 评估混合注意力机制的性能,共五次实验,实验模型均使用CT、PET/CT 和PET 图像各909 张作训练集,CT、PET/CT 和PET 图像各117 张作测试集。实验一,模型跳跃连接中没有使用任何注意力机制,即为MEU-Net;实验二,MEU-Net 模型跳跃连接只引入空间注意力机制,模型为Multi Encoder Spatial Attention U-Net(MESAU-Net);实验三,模型跳跃连接只引入通道注意力机制,模型为Multi Encoder Channel Attention U-Net(MECAU-Net);实验四,模型跳跃连接引入本文空间注意力机制和文献[25]中的轻量级通道注意力机制,模型为MEAU-Net#,该通道注意力模块为无需降维的局部跨通道互动策略保留Squeeze and Excitation Networks(SENet)[26]的全局平均池化,使用自适应核的一维卷积代替SENet 的两个全连接层;实验五,模型跳跃连接引入本文的混合注意力机制,模型为MEAU-Net。图9 为CT 图像的三维灰度图,表2 为不同注意力机制的评价指标,图10 为不同注意力机制模型分割结果。

图9 CT 图像三维灰度图Fig.9 CT image three-dimensional gray value

从表2 可以看出模型MECAU-Net 和MESAU-Net 的各项指标均高于三编码器U-Net 模型MEUNet,说明网络跳跃连接引入空间注意力机制和通道注意力机制能提高网络分割性能。其中引入通道注意力机制的MECAU-Net 大多数指标优于引入空间注意力机制MESAU-Net 的指标,DSC、Recall 和VOE 分别提升了0.25%、0.07%、0.1%。MEAU-Net#的部分指标优于引入单注意力机制的网络,如DSC、Recall。混合注意力机制MEAU-Net 的DSC、Recall、VOE 和RVD 分别为96.4%、97.27%、93.0%和93.06%。从图10 可以看出,MEAU-Net#网络的分割结果整体优于前三种方法,但部分分割效果不佳,如图10(h)第一行出现了欠分割情况,第二行病灶边缘分割模糊。从图10 第四、五行可以看出,混合注意力机制网络MEAUNet 对于正常组织粘连、形状复杂的病灶分割效果优于其他方法。从图11 可以看出,MEAU-Net 的指标优于其他注意力机制方法,混合注意力机制对网络分割性能有一定提升效果,说明在跳跃连接过程中引入混合注意力机制能有效提升分割效果。

表2 不同注意力机制分割结果Table 2 Segment results of different attention mechanisms

图10 不同注意力机制网络分割结果Fig.10 Network segmentation results of different attention mechanisms

图11 不同注意力机制的分割结果对比Fig.11 Comparison of segmentation results of different attention mechanisms

2.4.3 与先进分割算法对比

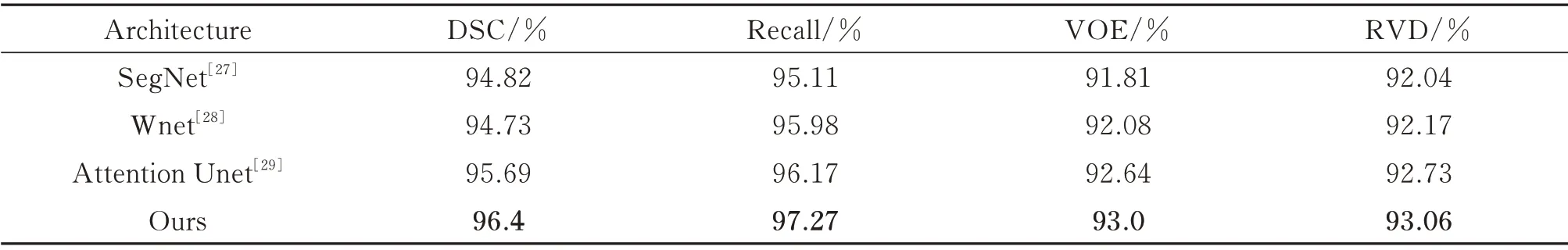

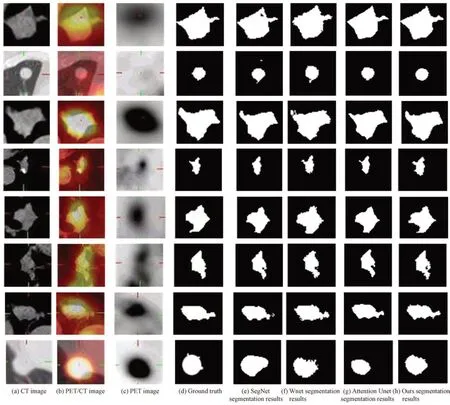

本文方法与编解码器网络、多模态医学图像分割方法和注意力机制相关方法进行对比。其中SegNet[27]的编码网络为VGG-16 的卷积层,网络跳跃连接部分使用池化位置索引存储每个池化窗口中最大特征值的位置代替U-Net 的拼接操作,提供分割效率。Wnet[28]是级连的两个U-Net 网络,用于PET/CT 图像骨髓瘤的全身骨病变分割,第一个U-Net 网络层数为5 层,输入CT 图像,第二个U-Net 网络层数为3 层,该子网络使用第一个U-Net 分割结果和PET 图像作为第二个网络的输入。Attention Unet[29]在U-Net 的基础上,在网络的跳跃连接中嵌入自注意力门,将网络上采样的特征和编码路径传输尺寸相同的特征通过自注意力门自动学习分割目标的尺寸和外形,用于胰腺CT 图像病灶分割。CT 图像的三维灰度图如图12 所示,MEAU-Net 与其他先进算法的对比结果如表3 所示,分割结果如图13 所示。

表3 MEAU-Net 与其它网络的分割结果Table 3 Segmentation results of MEAU-Net and other networks

图12 CT 图像的三维灰度图Fig.12 CT image three-dimensional gray value

图13 不同算法分割结果Fig.13 Segmentation results of different methods

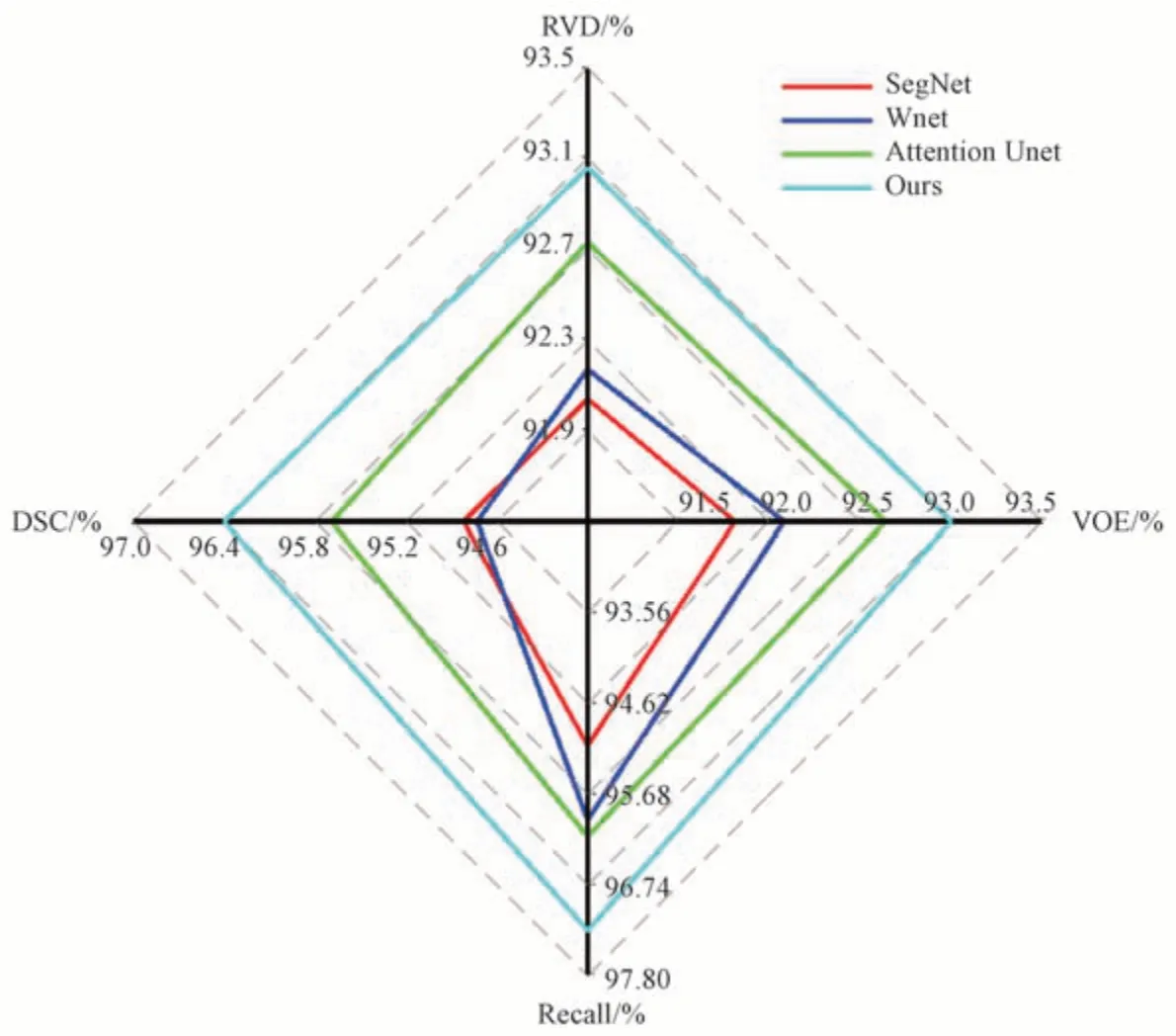

从表3 可得,SegNet 的DSC、Recall、VOE 和RVD 分别为94.82%、95.11%、91.81%和92.04%,该网络仅使用CT 单模态图像进行病灶分割,对于与正常组织粘连的病灶,分割效果不佳。从图13 可以看出,SegNet 分割结果出现了欠分割情况如图13(e)第一行,对于与正常组织粘连的病灶出现了过分割情况,如图13(e)最后一行。Wnet 的DSC、Recall、VOE、RVD 分别94.73%、95.98%、92.08%和92.17%,大部分指标高于SegNet,如Recall、VOE 和RVD,该方法将第一个网络得到的CT 特征图输入PET 图像,充分利用CT 图像的细节信息,PET 图像提供了病灶的代谢信息,有助于定位病灶,但由于第二个网络层数过浅未能充分学习特征,并且PET 图像中病灶模糊的边缘信息导致分割效果低于引入注意力机制的网络。图13(f)第二行该网络出现了欠分割的情况,对于第三、七行形状复杂的病灶,分割效果不佳。Attention Unet 的DSC、Recall、VOE、RVD 分别为95.69%、96.17%、92.64%和92.73%,相较于Wnet 分别提高了0.96%、0.19%、0.56%和0.56%。由于Attention Unet 在网络跳跃连接部分使用注意力门自动关注病灶区域,因此分割效果优于SegNet、Wnet,但是对于形状复杂的病灶如图13(a)第6 行和与正常组织粘连的病灶如图13(a)最后一行,没有PET 图像提供的代谢信息,Attention Unet 分割效果不如MEAU-Net。MEAU-Net 的DSC、Recall、VOE、RVD 分别为96.4%、97.27%、93.0%和93.06%,图13(h)中可以看出,MEAU-Net 对于不同尺度的病灶均能有效分割,对于与正常组织粘连的病灶,MEAU-Net 通过多模态图像之间的特征互补,对病灶精确定位,分割结果比其他方法好。图14 为不同分割方法的指标对比结果,从图中可以看出,MEAU-Net的各项指标优于其他网络。SegNet 和Attention Unet 方法都未使用PET、CT 和PET/CT 多模态医学图像特征,仅利用单模态医学图像,忽略了多模态医学图像之间的优势互补。由此证明MEAU-Net 使用多编码器充分提取多模态医学图像特征是可行的,混合注意力机制选取重要特征,聚焦在特征图中病灶位置,能够提高网络分割性能,为医学分割提供更准确的判断依据,分割结果更接近标签值。

图14 不同方法分割结果对比Fig.14 Comparison of segmentation results of different methods

3 结论

本文充分利用不同医学成像设备成像机理的特点,提出了多编码混合注意力的分割网络MEAU-Net。使用多编码器提取多模态医学图像肺部病灶特征,通过在网络跳跃连接引入混合注意力机制,使网络自动关注在图像病灶区域和重要特征通道。对于解码路径包含的不同尺度高级语义特征,构建了多尺度特征聚合块,实现了不同尺度的特征聚合。在临床数据集上对该算法进行验证,实验结果表明MEAU-Net 的DSC、Recall、VOE 和RVD 的平均值分别为96.4%、97.27%、93.0% 和93.06%。相较于三种对比算法,MEAU-Net 对于形状复杂、病灶与正常组织相粘连的情况均能有效分割。接下来将进一步扩充数据集,并将方法推广到3D 肺部肿瘤的分割和其它疾病的精准分割。