基于阶梯网络与交叉融合的端到端图像去雾

杨燕,张金龙,梁小珍

(兰州交通大学电子与信息工程学院,兰州730070)

0 引言

雾天场景下,光的传播极易被大气中悬浮颗粒影响,导致采集到的图像质量严重受损,表现为对比度下降、颜色偏移等。计算机视觉的高级任务对图像的清晰度具有严格的要求,例如车牌检测、人脸识别等,因此对于雾天场景下采集到的图像清晰化处理具有十分重要的研究意义。

目前主流的去雾算法主要分为两类,一类是基于大气散射模型的图像复原算法,另一类是基于卷积神经网络的训练学习去雾算法。基于复原类的去雾算法主要以HE K 等[1]提出的暗通道先验算法为代表,但由于该算法对天空等高亮区域透射率的错误估计,导致复原结果天空区域出现较为严重的偏色、失真等问题。XU Y 等[2]提出了一种较为准确的大气光估计方法,但由于其透射率估计不准确,去雾结果仍然存在一定的失真现象。YANG Y 等[3]为了消除图像去雾中的光晕和伪影等问题,提出了一种边缘保持函数估计透射率的方法,该算法的去雾结果亮度清晰,很大程度克服了光晕问题,但对于一些含有超远景的有雾图像,该算法存在去雾不彻底现象。尽管基于大气散射模型[4-9,21-22]的图像复原取得了快速发展,但由于约束条件的使用导致该类算法复杂度高,且由于先验信息的引入,导致复原结果出现了偏色和失真等问题。

近年,随着深度学习的快速发展,研究人员将卷积神经网络应用于图像去雾领域。CAI B 等[10]设计了一种去雾网络(Dehaze-Net),Dehaze-Net 利用多尺度映射和最大池化等操作得到透射率,并根据大气散射模型获得去雾图像。REN W Q 等[11]提出了一种多尺度网络结构(Multi-scale Convolutional Neural Network,MSCNN),MSCNN 以粗尺度网络进行透射率提取,并以细尺度网络完成透射率优化,取得了较好的去雾结果,但对于含有天空等区域的图像,存在明显的偏色问题。LI B 等[12]将透射率和大气光联合训练(Allin-One Dehazing Network,AOD-Net)的方式有效地解决了分别学习引入的误差叠加问题,但由于其网络太过简单,没有深入分析图像特征,导致去雾结果存在亮度偏暗和去雾不彻底现象。LIU R 等[13]提出了一种残差网络结构,并结合先验信息得到透射率训练,但由于先验信息不具有普适性,导致其网络模型的稳定性较低,对于真实环境下的有雾图像有明显的失真现象。QIAN W 等[14]设计了一种颜色提取和深度去雾网络(Color Inverse Atmospheric Scattering Modeling,CIASM-Net),尽管该网络考虑了图像颜色特征,但由于透射率的单独训练,导致其去雾结果仍具不稳定性。综上,基于卷积神经网络的去雾算法[15-17,23]近年来层出不穷,但依然存在特征提取不准确、去雾结果细节丢失、偏色等问题。

针对以上问题,本文提出了一种用以特征提取的阶梯型网络结构。首先阶梯网络的设计,有效地克服了深度网络的训练耗时问题;其次以阶梯网络中不同层次的阶梯提取有雾图像的不同特征,并在底层阶梯中引入逐层补偿的方式进行细节特征提取,得到了有雾图像较为完整的细节特征,顶层阶梯完成有雾图像轮廓特征的提取;然后结合通道注意力机制对轮廓特征和细节特征进行交叉融合,得到有雾图像的融合特征;最后结合非线性映射的方式在图像重建模块获得清晰图像。

1 本文网络模型

目前被广泛用于去雾的大气散射模型是单散射方程,而实际中许多雾图的形成与多散射有关,因此单散射模型的参数机制本身具有一定的局限。另外,大多非端到端的去雾模型仍然以大气散射模型为依据,使用卷积神经网络实现对透射率和大气光的训练学习,进而结合大气散射模型获取清晰图像,但此类方法忽视了多变量训练学习引起的误差叠加和积累问题,严重影响了模型的精度。为了不受单散射模型参数影响且消除误差累积问题,本文设计了一种只考虑输入雾图的端到端去雾网络。

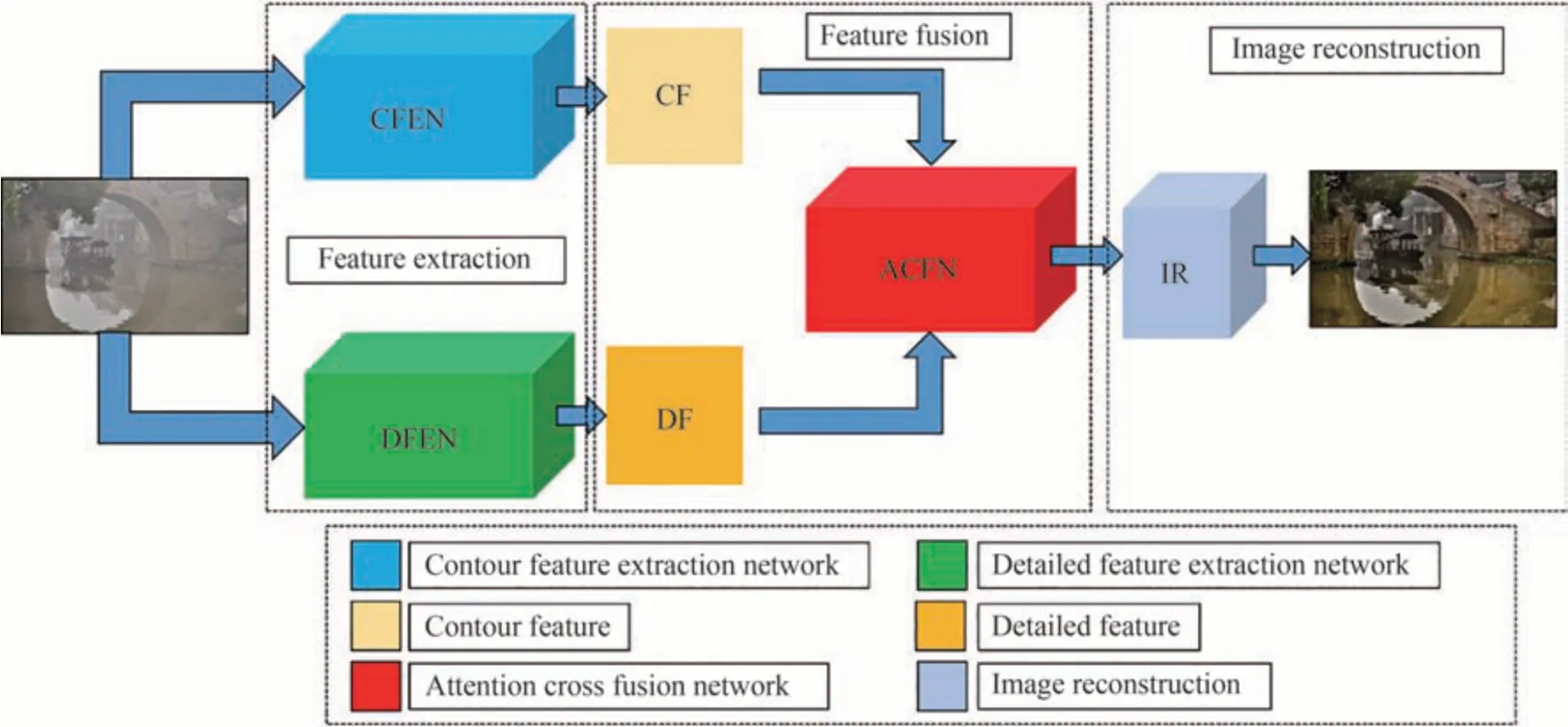

卷积神经网络凭借其独特的优势在计算机视觉问题中获得了充分的发挥。本文针对雾天图像退化问题,设计了一种基于阶梯型网络提取与注意力交叉融合的去雾网络,通过阶梯型网络提取有雾图像的轮廓特征(Contour Feature,CF)和细节特征(Detailed Feature,DF),并引入通道注意力机制分别对轮廓和细节特征进行交叉融合处理,最后将融合特征输入到重建网络模块,即可得到去雾图像。整个训练不依赖大气散射模型,消除了透射率与大气光估计导致的误差叠加问题,实现了真正意义上的图像端到端复原。本文整体网络结构如图1。

图1 本文网络结构Fig.1 The network structure of this article

1.1 特征提取

雾天图像的复原问题不仅要考虑去雾程度问题,复原图像细节和轮廓保留也同等重要。在卷积神经网络中,卷积主要是对输入数据进行处理,通过卷积核参数得到所需要的特征。为了获得更加准确的有雾图像特征,对轮廓特征和细节特征分别在不同的子网络中提取,通常网络结构越深,提取到的特征就越丰富,但深度网络在丢失信息的同时往往具有较高的复杂度,训练耗时,且稳定性较低。本文利用阶梯网络交叉融合的方式进行特征提取。卷积参数共享的优势不仅减少了各层之间的连接,同时又降低了网络过拟合的问题。采用二维卷积进行有雾图像特征的提取,整个阶梯网络分为轮廓特征提取模块和细节特征提取模块,共有5 层阶梯和15 层卷积,每一层阶梯的第一层均为1×1 卷积,其余层为3×3 卷积,3×3 卷积相比于大尺度卷积,有着更少的参数量和计算量,为了获取更加有效的特征,本文卷积均采用参数为1 的移动步长。为了保证卷积输出尺寸与输入的一致性,对不同卷积核的卷积分别进行填充处理,填充参数与输出尺寸之间的关系为

式中,O表示输出特征的尺寸,M表示输入特征的尺寸,K为卷积核尺寸,P表示填充参数,S为卷积步长,特征提取阶梯网络结构如图2。

图2 特征提取网络Fig.2 Feature extraction network

整个特征提取网络包含细节特征提取网络(Detailed Feature Extraction Network,DFEN)和轮廓特征提取网络(Contour Feature Extraction Network,CFEN)。深度卷积计算通常可以提取出图像更加丰富的特征,因此利用所提阶梯网络的下两层阶梯进行有雾图像细节特征的提取,利用阶梯网络的上三层阶梯进行图像轮廓特征的提取,从图像特征出发,浅层卷积更加注重局部特征的获取,深度卷积能捕获图像深层的特征。

在DFEN 模块中,为了进行细节特征的有效提取,对两层阶梯的分层特征进行逐步向前补偿。具体实现为将底层的各层输出特征与上层对应位置卷积的输入进行通道融合,这种处理有效地避免了深层网络出现的细节丢失和反向计算时的梯度消失问题。为了保证捕获更加丰富的细节特征,同时考虑到网络参数量问题,在DFEN 两层阶梯的最后一层卷积输出3 通道特征图,其余层均输出32 通道的分层特征图像。

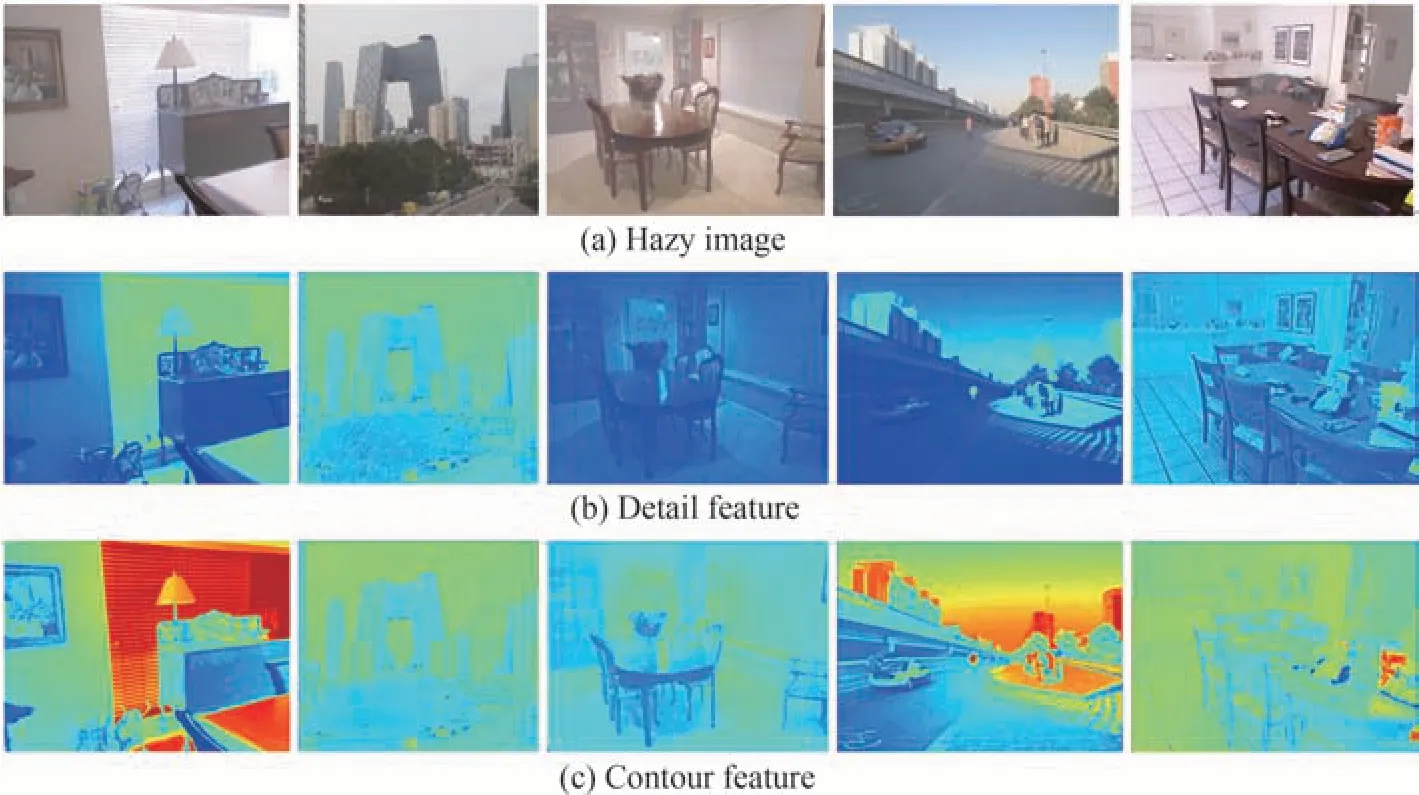

在CFEN 模块中,利用三个浅层阶梯进行轮廓特征的提取,三层阶梯后两层的第一层卷积层均采用1×1的卷积,其余均使用3×3 的卷积。轮廓特征主要是反映图像的边缘等局部特征信息,对于复原结果的视觉效果具有较大的影响,本文CFEN 三层阶梯的最后一层卷积输出3 通道的轮廓特征图,其余层输出16 通道的分层轮廓特征。整个特征提取网络避免了深度网络引入的局限性,以阶梯的形式进行特征提取网络的设计,各层特征互相补偿,获得了更加有效地有雾图像特征。随机选取RESIDE 数据集[18]中的几幅图像进行特征提取分析,有雾图像的细节特征和轮廓特征如图3,可以看出,DFEN 的输出保留了有雾图像的一些内容信息,很大程度地涵盖了有雾图像的细节特征。CFEN 的输出近似表现了有雾图像的轮廓等局部特征,而将有雾图像的具体细节进行了模糊化。为了重建出细节和轮廓更加丰富的去雾图像,在阶梯提取网络后设计了一种注意力交叉融合网络,通过将提取的特征资源进行合理地加权融合,进而得到融合特征。

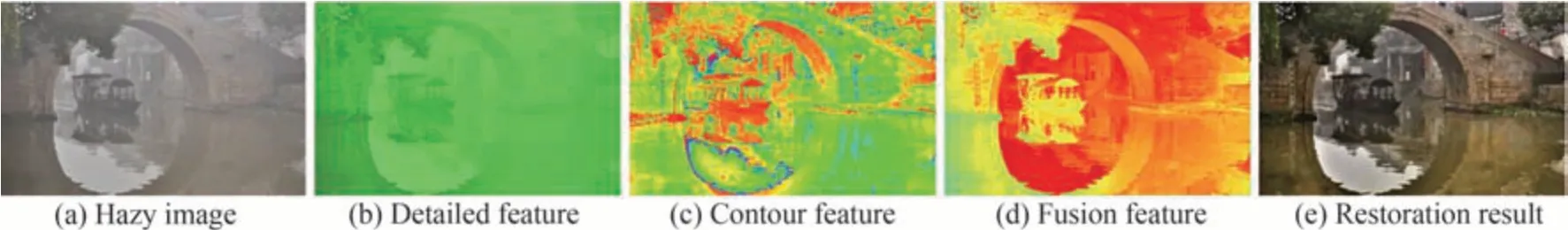

图3 有雾图像及其特征图Fig.3 Hazy image and its feature map

1.2 注意力交叉融合

与传统图像融合方式不同,本文提出了一种基于注意力的交叉特征融合策略。对于不同的有雾图像,细节特征和轮廓特征的影响往往不同。边缘等局部特征丰富的图像,轮廓特征对复原图像的影响较大;对于一些全局特征较丰富的图像,细节等全局特征对复原图像具有较大的影响。因此引入通道注意力机制,对原图直接进行注意力处理,并得到一组与特征通道数相同的自适应权重值,进而根据轮廓特征和细节特征的比重进行权值分配,注意力交叉融合模块如图4。

图4 注意力交叉融合模块Fig.4 Attention cross fusion module

在融合模块中,将经过注意力加权的轮廓和细节特征进行交叉融合。这种处理方式可以根据原图特征的分布将所提取的细节和轮廓特征进行自适应的有效融合,进而得到细节和轮廓特征丰富的清晰图像。如果将阶梯网络提取的细节和轮廓特征分别记为FD和FC,将两种特征对应的通道注意力权重记为m和n,则经过注意力加权后的细节和轮廓特征可以表示为

融合过程如式(5)~(6),首先对于细节和轮廓特征分别和其对应的特征权重进行相乘,然后将带有注意力权重的细节和轮廓特征进行融合,并将该融合特征作为融合模块的上下层输入,进而得到融合特征。

式中,F1和F2分别表示融合网络模块的两层输入,为了克服权重融合后特征会出现局部过粗糙现象,导致复原结果视觉效果下降,对输入特征分别进行一层3×3 卷积实现特征的平滑处理,并将该结果作为下一层的输入。从特征提取网络到注意力交叉融合网络,网络层次逐渐加深,本文引入残差处理的思想对图像特征进行补偿,具体实现是对原始图像经过一层1×1 卷积处理,并将1×1 卷积的输出与经过平滑处理的融合网络输入特征进行逐像素残差操作,这种处理在克服梯度消失问题的同时,对深层网络的特征减少和信息丢失起到了较大的补偿作用。最后对经过残差补偿处理的特征进行一层卷积和逐像素融合处理,进而得到细节和轮廓特征的融合特征。

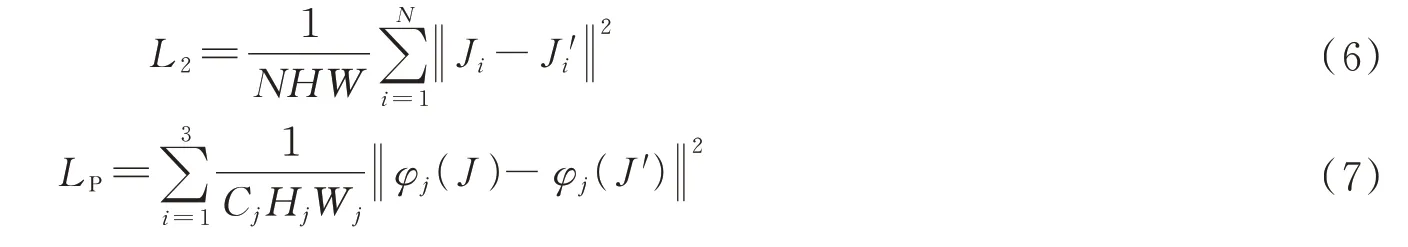

1.3 损失函数与训练细节

为了提高去雾图像的语义特征,采用均方误差(MSE)损失和感知损失的组合作为整个训练过程的损失函数。均方误差损失可以逐像素的反映出去雾图像和数据集标签的差异性,其数学表达式如式(6),感知损失预训练网络采用VGG-19[18],感知损失采用VGG-19 输出的特征图进行计算,感知损失表达式如式(7)。

式中,N表示训练集样本数目,H与W表示图像尺寸。Ji表示网络输出结果,Ji'表示对应的清晰图像。J表示去雾图像,J'表示对应的清晰图像,ϕj(J)表示去雾图像对应的语义特征图,ϕj(J')表示清晰图像对应的语义特征图。则总的损失函数表示为

式中,λ为感知损失权值,取值为0.1。整个网络模型基于Python 实现,在Torch 框架下实现,训练环境为NVIDIA GTX 1050 TI。训练集采用公开数据集RESIDE[19]中的ITS(Indoor Training Set)和OTS(Outdoor Training Set),数据集包含1 399 张标签图像和对应的13 990 张不同浓度的有雾图像。选择SOTS(Synthetic Objective Testing Set)作为网络模型的测试集,测试集包含500 张室内图和500 张室外图。当训练周期为60 左右时,整个训练过程达到收敛状态,训练过程中学习率为0.000 1。

1.4 图像重建

图像重建模块主要由输入特征,一层卷积层和输出图像组成。图像重建模块的卷积核大小为3×3,卷积步长为1,输出通道为3 通道,在卷积层后接Relu 激活函数,以非线性映射的方式得到最终的清晰图像。图像重建模块如图5,户外真实环境下雾图的复原结果及各层特征图如图6。从图6 的各层特征图和复原结果可以看出,各层特征都准确的反映了所提取的信息,复原结果具有彻底的去雾效果且颜色自然、细节丰富,具有较佳的视觉效果。

图5 图像重建Fig.5 Image reconstruction

图6 真实雾图特征及复原示意图Fig.6 Real hazy image feature and restoration schematic diagram

2 实验分析

为了验证本文算法的可行性和有效性,以主观视觉对比和客观指标分析两种评价方法进行实验分析。在主观视觉对比试验中,分别选取一些户外真实有雾图像、Reside 数据集、NYU 数据集、Middlebury 数据集中的雾图作为实验对象,对比算法选择HE K 等[1]提出的DCP 算法、WANG W 等[4]提出的线性传输算法、CAI B 等[10]提出的Dehaze-Net 算法、LI B 等[12]提出的AOD-Net 算法、REN W Q 等[15]提出的GFN 算法、QIN X 等[16]提出的FFA-Net 算法。

2.1 主观评价

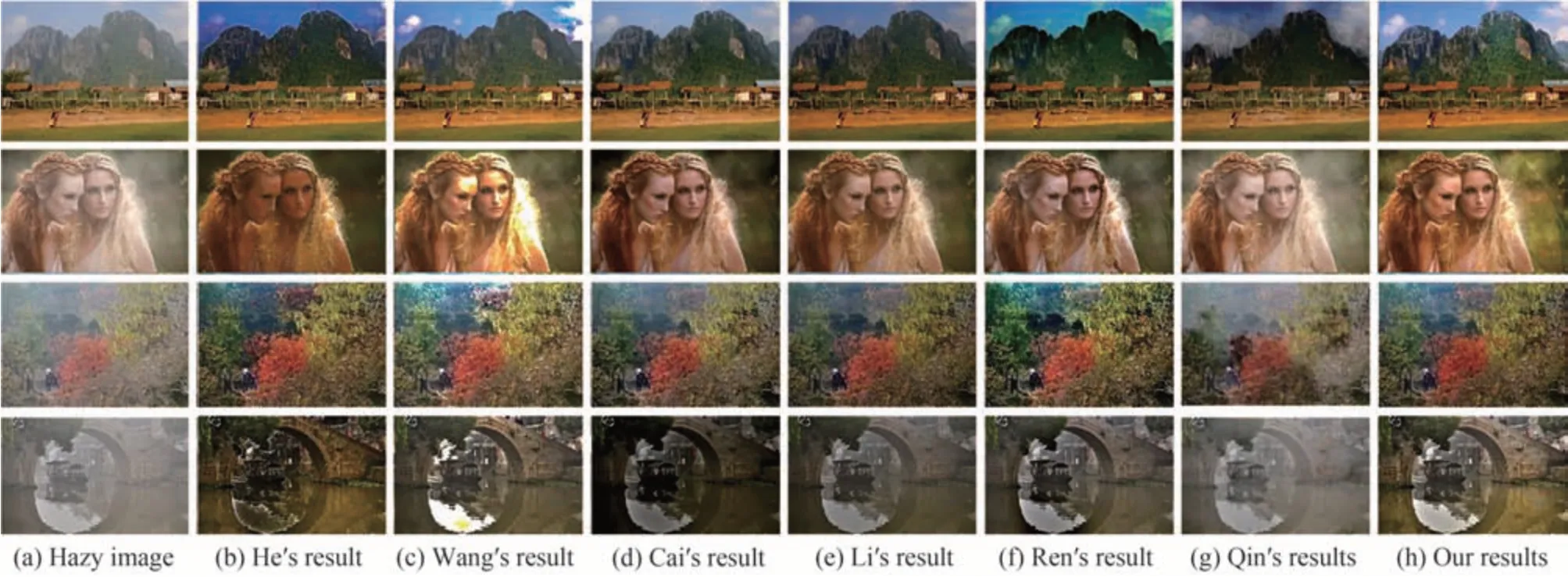

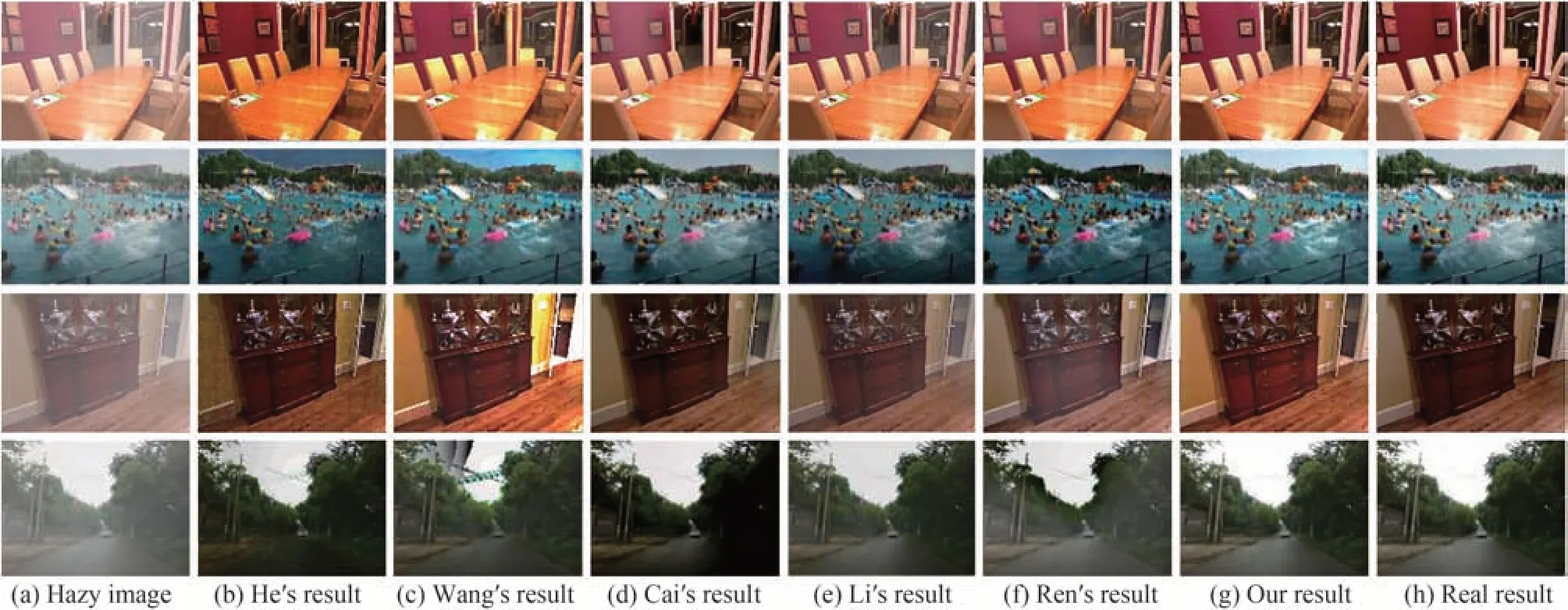

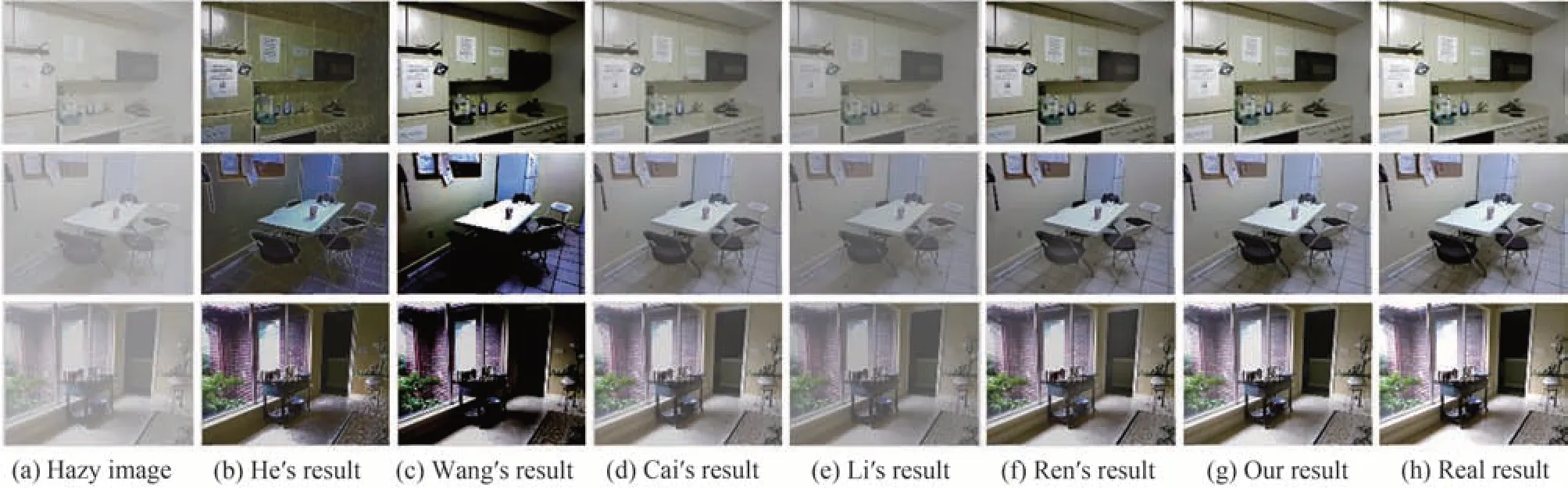

主观评价可以直接以视觉效果体现各算法的差异性,主观实验对比图如图7~10、7为真实环境有雾图像实验结果,图8为Reside数据集实验结果,图9为NYU 数据集实验结果,图10为Middlebury数据集实验结果。

图7 真实有雾图像实验结果Fig.7 Experimental results of real hazy images

图8 Reside 数据集实验结果Fig.8 Experimental results of the Reside dataset

图9 NYU 数据集实验结果Fig.9 Experimental results of the NYU dataset

图10 Middlebury 数据集实验结果Fig.10 Experimental results of the Middlebury dataset

从图7 可以看出,对于真实环境下的有雾图像,He 等算法在色彩上出现了严重的过饱和现象和明显的光晕、伪影。Wang 等算法去雾彻底,但色彩失真问题比较明显。Cai 等算法色彩保持较好,但存在去雾不彻底现象。Li 等算法颜色保持较好,但去雾图像整体偏暗。Ren 等算法去雾较为彻底,但对于天空区域发生了严重的偏色。Qin 等算法去雾不彻底,且出现了天空区域的色彩渲染和失真问题。本文算法考虑了图像的细节和边缘特征的恢复,去雾彻底,亮度适宜、颜色自然、细节丰富。

从图8~10 可以看出,对于测试集图像,He 等算法在色彩上同样出现了严重的过饱和现象。Wang 等算法局部色彩失真问题比较明显。Cai 等算法和Li 等算法颜色保持较好,但去雾图像整体偏暗且留有残雾。Ren 等算法整体去雾较为彻底,但出现了局部过饱和现象。本文算法在测试集上的表现同样理想,去雾彻底,颜色保真度较高,细节和边缘更加丰富。

为了进一步体现所提网络模型的优越性,将复原图像局部放大进行对比分析。随机选取户外真实环境下的有雾图像进行局部放大对比,放大对比图如图11。可以看出He 等和Wang 等去雾较为彻底,但由于透射率估计不准确,复原结果出现了颜色偏移和局部失真问题。Cai 等复原结果明显偏暗;Ren 等、Li 等和Qin等算法存在去雾不彻底现象,本文算法复原结果去雾彻底、亮度自然、细节清晰。

图11 局部放大示意Fig.11 Partial enlarged schematic

2.2 客观评价

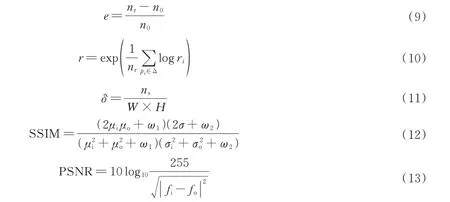

考虑到主观评价的片面性,将以客观评价的方式定量地去分析对比本文去雾网络模型的有效性和可行性。对真实环境下的有雾图像采用无参考图像质量评价方法,选择新增可见边数e,平均梯度r,饱和像素点数δ和直方图相似度HCC 作为客观指标,其中e、r和HCC 越大越好,δ越小越好[20,24]。对测试集图像采用全参考图像质量评价方法,选取峰值信噪比PSNR 和结构相似性SSIM 作为客观指标,PSNR 和SSIM 均是越大越好。上述指标的计算表达式分别为

式中,nr和n0分别表示有雾图像和无雾图像的可见边数,Δ 表示无雾图像可见边集合。ns是去雾图像比有雾图像多出像素值为0 或255 的个数。μi和μo表示输入与输出的均值,σ表示输入输出的协方差,和表示输入输出的方差,ω1和ω2是避免分母为0 的常数,fi和fo表示数据集清晰图像和本文算法去雾图像。对图7对应的各算法结果进行客观指标对比分析,各算法平均定量指标对比如表1,测试集各算法客观指标如表2~4。

由表1 可以看出,对于真实环境下的有雾图像复原,He's 算法整体取得了较好的指标;Wang's 算法在饱和像素点指标中优势较大;由于网络模型的局限性,Cai's 算法、Li's 算法和Qin's 算法对真实环境下的有雾图像处理效果一般,其各指标没有明显的优势。除饱和像素点指标稍差,Ren's 算法的其余指标同样较为理想。本文算法除饱和像素点指标略低于Wang's 算法,其余各指标均优于对比算法。从表2~4 可以看出,对于测试集图像,基于网络模型的算法整体优于传统复原算法,在对比算法中,Qin's 算法的PSNR 指标较高,He's算法在SSIM 上表现较好;本文算法在3 个测试集中整体表现优良,PSNR 和SSIM 指标均优于对比算法。结合主客观评价,本文算法具有较高的可行性和有效性。

表1 各算法真实有雾图像指标对比Table 1 Comparison of real hazy image indicators of various algorithms

表2 各算法RESIDE 测试集指标Table 2 RESIDE test set indicators of every algorithm

表3 各算法NYU 测试集指标Table 3 NYU test set indicators of every algorithm

表4 各算法Middlebury 测试集指标Table 4 Middlebury test set indicators of every algorithm

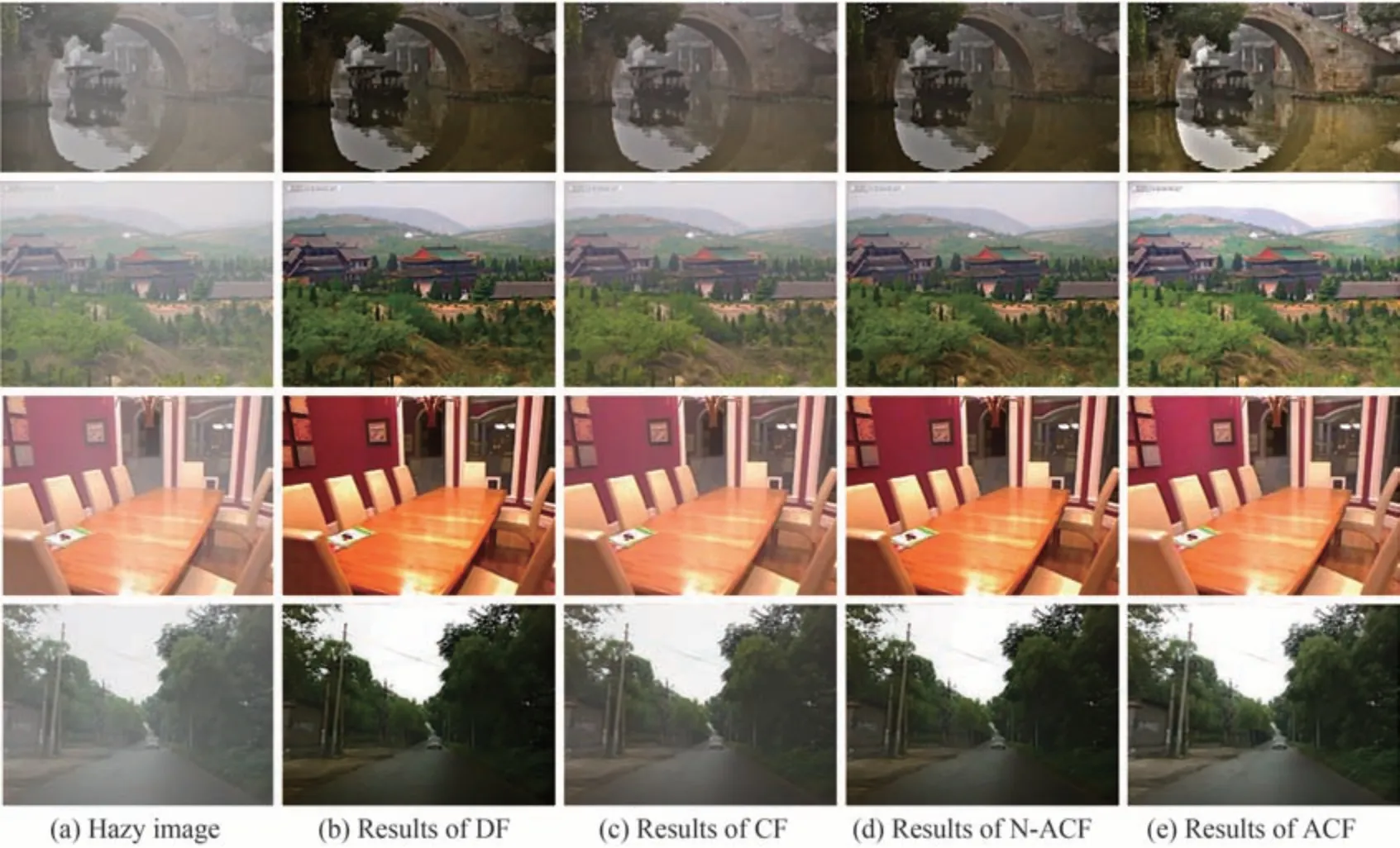

2.3 消融实验

为了说明整个网络各模块的有效性和必要性,将进行消融实验。主要包括以下实验:1)以有雾图像的轮廓特征(Contour Feature,CF)进行复原实验;2)以有雾图像的细节特征(Detailed Feature,DF)进行复原实验;3)以有雾图像的细节和轮廓特征的非注意力交叉融合(Non-Attention Cross Fusion,N-ACF)进行复原实验。随机选取真实环境下的两幅有雾图像和RESIDE 测试集的两幅图像进行消融实验主观分析,并在RESIDE 数据集中的SOTS 测试集上进行消融实验客观指标分析。消融实验对比图如图12,通过对比可以发现,仅利用细节特征DF 的复原图像去雾彻底,但颜色过饱和问题较严重,且出现了明显的发暗现象;仅利用轮廓特征CF 的复原结果颜色保持较好,但复原结果留有大量的残雾,且细节信息丢失严重;利用非注意力融合方式的复原结果同样出现了发暗和颜色过饱和现象;利用注意力机制交叉融合细节特征DF 和轮廓特征CF 的复原结果颜色自然、去雾干净、细节信息丰富。表5 是消融实验的客观指标,同样可以看出ACF的有效性,因此本文网络的各模块均具有较高的有效性和必要性。

图12 消融实验对比图Fig.12 Comparison of ablation experiments

表5 消融实验客观指标Table 5 Objective indicators of ablation experiment

3 结论

本文设计了一种阶梯型网络和注意力交叉融合的图像去雾算法,分别用阶梯网络的上下阶梯提取有雾图像细节特征和轮廓特征。该方法不仅具有较高的精度,且克服了深度网络训练耗时的问题。利用注意力机制交叉融合获得了有雾图像的有效特征,在不考虑大气散射模型的条件下,通过非线性映射输出去雾图像,克服了大气散射模型参数难以估计对复原结果产生的误差。整体网络模型具有较低的复杂度,且在主客观实验中均取得了良好结果,有效地解决了雾天图像复原过程中的偏色、失真和细节信息不丰富等问题。