人脸识别技术应用风险问题研究

◆王天伟 吴浩森 陈壮 徐培栋 陈昂鸿 万荣春

人脸识别技术应用风险问题研究

◆王天伟 吴浩森 陈壮 徐培栋 陈昂鸿 万荣春通讯作者

(江苏警官学院 江苏 211800)

当前,人脸识别技术因其独特优势被广泛应用于治安防控、智慧交通等领域。然而,人脸识别技术在提供便利的同时,也会带来许多风险。例如利用该技术侵害个人权益、泄露个人数据,通过技术手段欺骗人脸识别系统、威胁公民信息安全,此外还有法律不完善、监管不明确、行业乱象丛生等风险。本文从具体案例中分析问题,从行政监管、法制完善、技术提升等方面对我国探索该技术的规范途径提供思考与建议。

人脸识别;技术应用风险;控制策略

1 人脸识别技术概述

人脸识别技术是一项基于人脸部的特征点(如眼、口、鼻的形状,大小,倾斜角度,曲率等特征)综合运用采集设备、计算机、统计学原理、深度学习算法等科学技术的生物识别技术。通过光学采集设备,获取人像图片,结合不同的算法经过图像矫正、图像增强等手段,提取出人脸的特征信息与数据库中的人像数据进行比对检索,到达一定阈值输出最优结果。

人脸识别的优势使得该技术得以运用在生活中的众多领域。基于其识别的迅速便捷性,该技术提升了企业社区等场所入口的检验效率,降低了管理成本;基于其识别的准确性,带来商业上经济的发展,助力各种公益事业的进程,如提高公共场所身份验证的准确性,避免因工作疲惫而导致的验证误差;促进公安机关对相关人员的协查,刑侦破案,治安防控等。

2 人脸识别技术应用的隐患

2.1 人脸识别技术应用的典型风险情景

(1)个人数据泄露与技术应用边界

2019年4月,浙江理工大学副教授郭兵购买了杭州野生动物世界双人年卡,向园方提供了相关个人身份信息,并确定了指纹入园的方式。而园方之后单方面要求,将入园方式更改为人脸识别并两次向郭兵发送短信通知其激活人脸识别系统,否则将无法正常入园。郭兵因不愿使用人脸识别,与园方协商未果,遂向法院提起诉讼。该案件由于备受关注,成为“中国人脸识别第一案”。

该案件之所以能够引起社会的热议,主要还是因为公众对该项技术使用的合法性及边界性的疑惑和担忧。本案中存在的问题:

①在购买双人年卡时已经确定使用指纹入园的方式,园方再次要求人脸识别入园,显然违背了双方所签订的合同协议。故一审判决园方违约,动物世界删除郭兵办理年卡时提交的面部特征信息,赔偿郭兵合同利益损失及交通费共计1038元。

②人脸识别的必要性问题。进入动物园为什么非得采用人脸识别?不使用人脸识别就无法进入动物园内,难道人脸识别是看动物的必经环节?这样的霸王条款与手机APP里不赋予权限就无法使用的做法如出一辙。事实上,人脸识别技术已经大规模应用,在人脸识别第一案之前,利用该技术侵犯公民隐私、人格等权益的现象也屡见不鲜,只不过一方面由于公民对于这种侵害的无意识、无察觉,一方面也是公民对该技术强制使用的无奈,最后习以为常,导致技术使用越发不合理。人脸数据对于公民信息保护的重要性不言而喻。这种生物信息,与我们的指纹,DNA一样,具有惟一性,一旦被泄露,所造成的风险不可估量,并且这种损失及侵害是难以逆转弥补的。

③人脸识别的使用边界在哪?据报道,郭兵教授在八项诉讼请求中有四项要求认定园方指定的入园方式无效。但法院并未支持这些诉讼请求,认为园方没有违反法律法规。园方使用人脸识别技术的确没有违反某一具体法律条款,但审判的结果还是让人心生遗憾,对于现实生活中众多企业商铺过度使用人脸识别的现状指导意义微乎其微。法律在保障公民人格尊严权、隐私权、信息财产安全等基本权益的同时,也应该赋予公民害怕厌恶的权利。在国家对于高新技术大力支持与发展的背景下,是否也应该赋予公民对技术说“不”的权利。法律应该有其冷冰冰的铁骨,也应该有人间温情的胸怀。

随着商业化的大规模推行,在利益的考量下,人脸识别技术成为一种时髦的身份验证模式,甚至在一些生活情景里成为必经环节。商家通过利益的计算,或为了降低成本,使利润最大化,或为收集人像数据,达成用户资料的完整,更有甚者贩卖个人信息,在黑色市场上赚钱利润。时下,人脸识别技术系统可谓是无孔不入,但并非所有场景都能经受住考验,比如小区门禁仅仅通过门卡就可起到保护作用,没必要非得使用指纹、人脸等信息。遗憾的是法律或者监管部门并未明确技术应用的边界,《网络安全法》第41条规定“网络运营者收集、使用个人信息,应当遵循合法、正当、必要的原则”,那么到底什么样算是正当?企业个体及政府机构使用分别要遵循怎样的尺度?个人信息应用的场景仍然模糊不清。

从信息保护角度上说“中国人脸识别第一案”有其进步意义。该案能够唤起大家的思考,引发公众对于信息保护的关注与讨论,有助于引导规范技术的使用,促进中国信息保护法律的进一步成熟完备,使得对信息的保护真正落在实处。但该案件仍然存有遗憾,需要我国法制建设的进一步发展完善。

(2)技术安全性

2019年来自华为莫斯科研究中心的一项技术震动了人们的神经。研究者们通过打印彩色对抗样本的方式,就轻松破解了当下广泛使用的人脸识别系统。如手机上的人脸解锁,小区企业等入口的人脸识别门禁系统等。据报道,该技术已经成功破解了目前最先进的Face ID模型;无独有偶,今年一月份清华大学RealAI技术团队对19款国产智能手机的人脸开锁技术进行了检测,结果令人大跌眼镜。只要将机主的照片剪下来尤其是人眼等关键部位信息,然后套在自己的脸上,对准手机镜头,即可开启手机,如图1所示。从被破解的程度上看,攻击这些手机的难度几乎没有任何区别,不管是低端机,还是售价4000以上的高端手机,全都是秒级解锁[1],就连手机内的各种app甚至手机银行都可利用同种手段进行开锁。

图1 检测示意图

除了上述的欺骗手段以外,现实中还有通过网络黑客形式入侵数据库,窃取数据,导致用户个人信息泄露的情景。

社会上基于演示攻击(如上文的对抗样本攻击)和数据库攻击(如网络黑客形式)这两种攻击方式而引发的事件屡见不鲜。人们或因此蒙受经济损失,或因此数据泄露,导致潜在风险。虽然人脸识别已经广泛应用在治安防控、教育、金融支付等领域,但技术缺陷性使我们不得不以审慎的眼光看待人脸识别技术的使用,以此促进该技术的进一步优化。

上述典型风险情景,让我们不得不对当下技术应用的现状进行深刻反思。

2.2 人脸识别技术应用的隐患

(1)信息数据泄露问题构成严重安全风险

人脸识别的信息采集不同于其他生物数据的采集。基于人脸识别技术的非强制性、非接触性的特点,数据的采集显得十分迅速和便利,但正因为其迅速便捷性,这种技术如果不加以控制,任由市场肆意妄为,将给人们的信息安全造成巨大隐患。清华大学法学院教授劳东燕指出:“人脸识别可以发挥远距离作用,且能长时间、大规模地积累数据,具有很强的侵入性。”相关人员可能自己都没意识到自己的人脸数据已经被别人所收集。如上文说的人脸识别第一案中,当郭兵教授与园方沟通协商人脸识别的使用问题时,竟然发现园方在没有任何通知提醒的情况下已经“偷偷”地收集了自己的人脸信息。所以正是由于这种采集的“悄无声息”,技术一旦被滥用、非法使用,那么将严重侵犯公民的个人隐私,威胁着个人的人身财产安全,时刻存在着潜在风险。

生物特征具有惟一性与不变性,一旦泄露终身泄露,损害难以估量。二审法院指出:生物识别信息作为敏感的个人信息,深度体现自然人的生理和行为特征,具备较强的人格属性。获取了人脸特征数据,即可进行人像复制,如果这些数据被泄露或者被非法使用,那么我们自己的生物特征信息未来能否证明我们自己的身份?2011年12月,CSDN安全系统遭到黑客攻击,致使600万用户的登录信息泄露,结果引起大规模用户修改邮箱密码等信息的现象,如果将来,我们的人像数据大规模泄露,难道要通过整容的方式改变容貌来规避风险吗?从数据的保管来看,收集使用我们信息的主体对数据保护的能力及其保护的重视程度和数据信息泄露后的责任承担及补救赔偿等方面都没有彻底的明确认识。

(2)相关法律不完善问题导致技术使用边界模糊

由于我国相关法律制定的缺陷性,使得人脸识别的乱象始终难以得到有效管制。2021年8月《中华人民共和国个人信息保护法》出台之前,我国没有在个人信息保护领域进行专门性的立法。对于人脸识别技术的管制也仅仅在一些信息保护的法律中涉及,如《网络安全法》和《民法典》中的关于信息收集、使用、用户同意的少量规定,且没有技术规范的细化规定,缺乏具体的可操作性。上文说的“人脸识别第一案”所引发出来的一些问题:是否生活中的所有领域皆可以使用人脸识别这种技术呢?使用的具体规范性程序到底是怎样的呢?采集信息的目的、主体等内容怎样能够做到实质性的通知数据主体?这些问题都需要法律来解答,所以国家有必要制定一部专门的信息保护法。在国家层面上探讨相应的法律制定及对应的监管制度、规范人脸识别技术的信息采集与运用,如:可运用人脸识别技术的领域、技术应用的必要性限度、公众的知情权等权利与信息财产安全保障等内容;地方层面上,政府有关部门在执行法律规定的同时,结合当地具体情况在不违背法律内涵的基础上制定符合本地的行政法规,以促进法律的有效执行和行业的自律,如:政府部门如何操作以调度企业公众的积极性使其自主加入规范的阵营中等。

(3)监管的罅隙致使监管合力弱

由于我国法律规定的分散化,使得承担个人信息保护职能的机构始终未予明确。虽然我国对个人信息的保护有众多部门的管辖,例如公安部门对于贩卖个人信息的行为能够给予严厉打击,再如工信部门对各种APP违规收集个人数据及其不合理使用权限的治理,但多元化的监督力量往往形成多部门管理的情形,难以有效在一定时间内整合资源进行最大程度的监管。法律规定的不明确,致使部门监管的职责不明确,以至多部门同时“问罪”和无人管理,相互推诿,踢“皮球”的情况时有发生。此外,法律缺乏细化的制定,这就给予相关部门较大的自由裁量权:例如对于企业及个体具体行为达到怎样的程度算做违法违规;再者当出现不同情形的违规行为时,对其适用的处罚方式及程度的统一标准缺乏规定。当前,我国对人脸识别技术监管制度的不完备,严重制约着法律的执行性与监管的严肃性。

相关权威机构发布的人脸识别行业报告显示,2018年,中国人脸识别行业市场规模为131亿元,年均复合增长率为37%,在世界范围内,中国的人脸识别市场居全球前列。庞大的市场规模,逐年增长的发展现状,迫使我国急需通过法律建立一个专门的人脸识别技术监管机构或者由法律赋权给某一特定部门进行管辖,以明确管理责任,提高问题处理效率,保护人民群众的隐私信息财产安全等权益,促进人脸识别行业健康有序发展。

(4)人脸识别技术发展的缺陷与限制产生对技术安全性的担忧

上文所说的典型风险情景中,利用技术手段对人脸识别系统的攻击,让当下我们使用习以为常的识别技术变得不太安全可靠。当前人像数据的采集主要有两种,一种是2D模型,一种是3D模型。无论是从扫描的精度准度,还是识别的安全性角度来讲,3D模型相对于2D具有其独特优势。但在现实中,2D系统往往会因为其设备价格相对低而被许多厂商选择,以降低生产成本[2]。再者,虽然3D人脸模型具有更强的特征描述优势,但是目前的3D人像模型由于成本高,采光等问题存在缺陷。除此之外,人脸识别技术还有遮挡问题、年龄变化问题、双胞胎,多胞胎等特殊群体面部结构相似问题、人脸防伪、样本缺乏等难题。

据有关报道,在中国的一些重要领域,所使用的人像识别核心技术竟然掌握在国外企业手中,这不得不让我们对人像数据的跨国传输产生担忧。高质量的人脸数据和高精度的人脸模型是自主致命武器的核心。保护好一个种族的人脸数据和人脸模型,就像保护这个种族的基因库一样,是限制敌对方开发针对本种族的自主致命武器的关键任务[3]。因此技术的缺陷所带来的风险不可忽视。另外,从系统的处理芯片上看,国产芯片的市场占有量有限,高端市场均为国外企业所垄断,这无疑是行业之痛。单纯通过经济来解决供求恐怕并非长远之计,高瞻远瞩未雨绸缪,才是生存之道。

3 人脸识别技术应用风险的对策

3.1 建构人脸信息保护的法律体系

我国现行关于个人信息保护的法律整体呈现出散乱不统一、价值定位游离不定的特点。根据国外立法的实践经验,对个人信息违规非法使用的现象进行独立立法加以整治已成趋势。我国可借鉴该立法方式,制定一部个人信息保护法。该法应该在立法理念和原则方面体现出对公民权益的尊重、保护,对公共利益的强化和推进,以及对新兴产业发展的规范和引领[4]。

(1)建立更为细化统一的行业准则。从人脸识别技术的应用领域、应用门槛、应用权限,到收集的途径、收集的目的,及信息保管的责任等方面进行细化规定。

简单地说,应当包括对哪些行业可以使用人脸识别技术进行评估,可以进行民主听证,公开透明。

明确公权力与个人信息权的边界,公益使用与私益使用的边界;

对人脸识别技术的准入门槛进行限制,基于公益事项所使用的人脸识别技术,如公安防控等方面,可以规定使用时由主管领导批准,非必要不使用。基于私益的应用、企业使用可建立行使资质评测制度,例如申请报备,经政府评估颁发行使资质,并定期对其资质进行重新评测。

主体收集用户信息必须通知权利人,由权利人书面同意,保证权利人对于收集的信息内容、信息的使用目的、信息的保存时间、信息的销毁的知情权,并且在一些领域,一些情形允许权利人拒绝刷脸的权利。

对使用人脸识别技术的主体明确责任,即对收集的信息负有保管责任和赔偿责任,不得公开公民人脸信息,一旦被收集的信息出现泄露、售卖、非法使用等情况,依照法律应当进行问责赔偿等内容。

(2)明确监管责任及处罚。

使用人脸识别技术,要规定该系统定期接受第三方合法机构检测,以检验其使用技术的合法性及必要性。在“人脸识别第一案”中,诉讼人郭兵在诉讼提案中要求园方删除其个人数据时要在第三方机构监管下删除,否则仅仅依靠园方的一句回复,难以知晓数据的真实状况。尽管该提案并未被法院支持,但郭兵教授的提案对于今后法律的制定,行政管理的执行都具有一定的参考价值。

其次,使用人脸识别技术,要具有可追踪性。通过建立一个第三方平台机构,要能够查询人脸信息使用的主体、使用的时间、使用目的,以便管理和发生侵权时,监管主体对侵权人进行追责。而且要依照法律对于违反相关法规的行为进行责任问责和法律追究。目前我国对于企业违规使用数据的现象大多采用约谈及少量罚款的形式,难以有效防止进一步的侵害。欧洲国家、美国对违规收集使用用户数据,违反信息保护条约的行为处百万美元罚款,所以有必要提高侵权违规成本,以深痛的处罚警戒侵权行为及主体。

3.2 推动行政监管的专一化与规范化

2021年的两会期间,全国政协委员皮剑龙带来了一份关于加快构建人脸识别技术数据监管体系的提案,该提案有助于解决各政府部门之间对于事务管理的互相推诿,及管理的交叉空白问题,形成上下一体的监管层次。

针对当下人脸识别监管的现状提出以下建议:

(1)不同职责的政府部门之间,上下级关系的政府机构之间应加强沟通合作来管理人脸识别技术行业;

(2)在立法上要明确人脸识别行业监管的具体部门,以提高监管效率,防止出现无人管理和多部门推诿责任的情形发生;

(3)政府部门需要为整个行业发展创造良好的氛围,对于违规的边界进行充分合理的界定,并且对于惩处的力度方式都要给予统一的评判标准,让公众清晰明了,做到公正处罚;还可以建立健全企业诚信评估机制,根据企业具体行为,例如技术使用的规范性和社会反馈的影响性来评定相关资质,对于积极承担法律社会责任,有良好企业自律,社会良好信誉的企业可以根据具体情况予以减税降费等措施;

(4)监管机构应设立投诉渠道,使行政服务触及人民群众,保障群众的监督权,增加参与法制建设的信心。人民群众是社会的主体,同时也是各类侵权事件的受害者,现实中由于个体群众影响力有限,收集证据艰难等原因导致在权利伸张时存在困难,设立该渠道,不仅有助于解决个体群众无法维权的困境,也有助于教育群众,震慑不法侵权行为。监管部门必须增强公众的信心:人脸识别技术只会被用于以合法化利益为目的的情景之下。

3.3 建立健全行业自律机制

不断更新换代的人脸识别技术应用带来的是信息数据的收集、使用、保管等诸多风险,具有滞后性的法律法规和行业标准难以及时解决领域内实际应用中遇到的各种问题。所以本着科技向善理念建立健全行业自律机制十分必要。相对于国家法律的制定及执行来说,行业自律的管理成本更低,对于行业经营者而言,基于共同利益,更容易接受与认可自己行业所建立的规则,因此在具体执行过程中,更容易发挥其作用[5]。

收集主体应积极主动履行国家法律法规,进一步明确自身的告知义务,向相关权利人告知数据采集的主体、方式、处理的目的、收集做法的法律依据。企业之间应加强沟通协作,成立行业协会,商讨建立企业间互通的相关标准,制定行业公约,创造良好行业发展氛围。主动对内部行业规范进行检查,对有违规采集、使用的行为及主体进行检举处理,以表明企业勇于承担相应法律、伦理和社会责任的态度,以自我行为引导行业自律,扫除行业歪风邪气,提升公众参与信心和热情,助力构建更加纯净的行业生态,达成技术使用需求与公民伦理及信息安全的良性平衡。

3.4 克服技术缺陷的策略

(1)借助相关设备进行活体检测。检测机制大多通过检查眼球运动来实现。

(2)交互响应法。即通过要求用户执行特定动作来检验是否是人的交互方式。如检测微笑悲伤等面部表情,摇头眨眼等头部眼部动作。

(3)利用对抗训练防御对抗样本攻击。将对抗样本和正常样本一起训练是一种有效的正则化,可以提高模型的准确度,同时也能有效降低对抗样本的攻击成功率[6]。

(4)算法的改善与提升。将算法计算向量化,该方法可使得计算前后具有相关性,减少或者消除执行类似的步骤,将卷积、全连接等冗余饱和非顺序模式转化为无冗余饱和顺序的模式,从而达到提升效果;利用深度学习模型,可获取大量数据中包含的信息,并构建复杂的模型,给定时间及数据,可自动调节参数,通常优于其他机器学习算法。

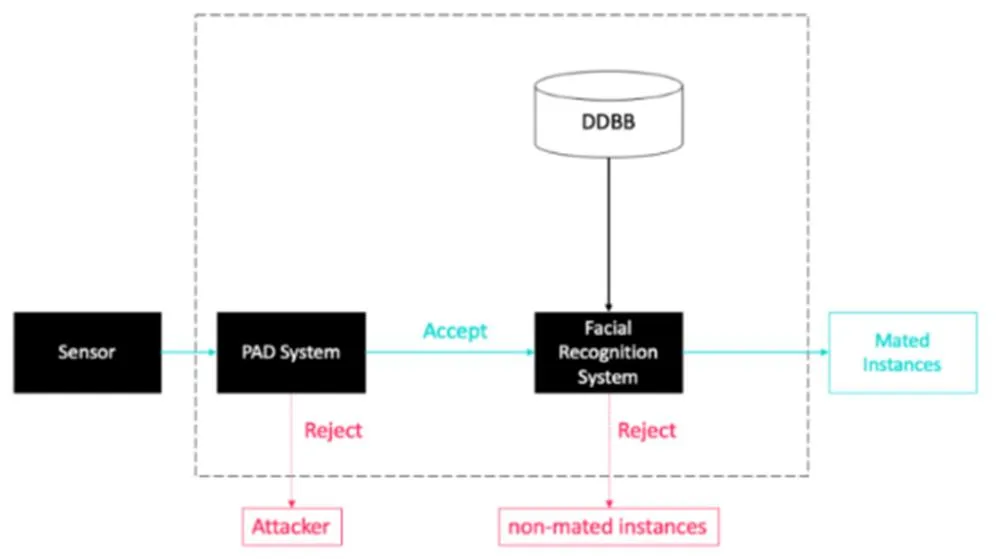

使用反欺骗技术构建演示攻击检测系统(PAD),如图2所示,并将其与面部识别系统集成。使用这种方法,防欺骗系统首先会做出决定,只有确定样本来自有生命的人之后,面部识别系统才会对其进行处理[7]。

图2 攻击检测系统(PAD)

4 结语

人脸识别技术是一把“双刃剑”,我们在享受该技术给我们带来便捷的同时,要保持理性的态度及时发现并解决风险隐患。当前人脸识别技术有被违法使用、被滥用的情况,问题的解决不能仅仅依靠某一措施或某一方面的改善,而是需要各个层面的规范进步。法律法规的制定、监管制度的完善、行业自律的建立、技术的发展优化等各个方面共同进步,才能防患于未然。

[1]大数据实验室.清华大学团队:人脸识别技术,爆出巨大丑闻[EB/OL] 2021-1-30[2020-8-14],https://www. sohu.com/a/447689279_236505.

[2]刘荣.人脸识别技术的问题及其规制研究[J].安徽警官职业学院学报,2021,20(02):11-14.

[3]安防之眼.人脸识别技术应用的价值及风险与防范[J/OL].2019-03-02[2021-8-14],https://www.sohu.com/a/298657245_100129841.

[4]郭春镇.数字人权时代人脸识别技术应用的治理[J].现代法学,2020,42(04):19-36.

[5]张继红.大数据时代个人信息保护行业自律的困境与出路[J]财经法学.2018(06):57-70.

[6]Nemoyy.对抗样本:知其然,知其所以然[J/OL].2018-7-15[2021-8-24],https://blog.csdn.net/ nemoyy/ article/details/81052301.

[7]woshicver.人脸识别:人脸识别攻击技术类型和反欺骗技术[J/OL].2020-10-23 [2021-8-19]https://blog.csdn.net/ woshicver/article/details/109252773.

江苏警官学院大学生创新创业训练计划项目(编号:XJ202110329009)