基于深度学习目标测定的大蒜收获切根装置设计与试验

杨 柯 胡志超 于昭洋 彭宝良 张延化 顾峰玮

(农业农村部南京农业机械化研究所, 南京 210014)

0 引言

我国是世界上最大的大蒜生产和出口国,产量占世界的60%以上,出口量约占世界大蒜国际贸易量的90%[1-3]。但是,我国大蒜生产机械化水平较低,尤其是收获环节,仍以人工作业为主,严重制约了大蒜产业的健康发展[4-6]。可靠的大蒜联合收获机是当前大蒜产业的迫切需要,而大蒜蒜根自动切除是关键技术之一[1]。

目前,国内高校及科研院所已研发出多款大蒜联合收获机样机,能够完成大蒜挖掘、清土、切茎和收集作业[2,7],但生产中还未见有装配切去蒜根装置的大蒜收获机。欧美发达国家的大蒜收获技术较为成熟,但由于切根难度大和消费者消费习惯的不同,收获机具很少具有切根功能[1]。日本HZ1型单行大蒜联合收获机安装有叠加的往复式锯齿刀,可进行蒜根切除,但锯齿刀高度不能根据鳞茎大小自动调节,易切伤鳞茎[8]。为了实现切根刀机械自适应式调节,现有技术多采用鳞茎接触式仿形浮动切割,即鳞茎下球面抵压切根装置,使其紧贴鳞茎下球面仿形浮动并由内置切刀完成根系切割[9-10]。但鳞茎接触式仿形浮动切割,无法分辨接触对象,由于鳞茎底部形状不规则及粘土多少、夹持形态、蒜根长短不同等,仍易造成鳞茎切伤和切根不齐。因此探索新的高质低损大蒜切根技术与方法,很有必要。

深度学习是一种高效的特征提取和目标检测网络结构[11-13]。深度学习在农业中的应用越来越多,这些研究成果为解决本文提出的问题提供了方法和思路[14-20]。

本文针对现有大蒜切根技术存在的切伤率高和切根不齐等问题,提出基于改进的YOLO v2模型的鳞茎非接触式切根方法,以深度卷积神经网络快速检测定位大蒜特征目标,切根刀高度自适应调整,设计一种大蒜切根试验台,并进行实际试验,以期为解决大蒜联合收获中高质低损切根提供参考。

1 整体结构和控制界面

1.1 整体结构

基于深度学习目标测定的大蒜收获切根装置主要由蒜秧输送装置、切根刀、控制系统组成,其中完成目标检测和控制切根刀自动调节的控制系统由硬件部分和软件部分组成,搭建的试验台如图1所示。

图1 切根试验台结构图Fig.1 Structural drawing of root cutting test bench1.蒜株夹持机构 2.X轴同步带滑台模组 3.双圆盘切根刀 4.Y轴丝杠滑台模组 5.电控箱 6.计算机 7.Z轴丝杠滑台模组 8.工业相机 9.机架 10.背景板

基于深度学习目标测定的大蒜收获切根装置是通过蒜秧输送装置、切根刀及控制系统相互配合来完成切根作业。在切根刀完成复位后,控制系统在蒜秧输送起始处采集图像并进行目标检测,按照深度卷积神经网络预测的切割线调节切根刀所在高度位置,蒜秧输送装置以设定的速度将蒜秧向前输送,输送的过程中,逆向高速旋转的切根刀刀盘切割蒜根,致使蒜根与鳞茎分离,蒜秧输送装置停止运动后返回起始处,将经过切根的蒜秧取下,最后将未切根的蒜秧固定在输送装置上,进入下一个工作循环。整个切根工作在控制系统的控制下完成,期间无人工调控。同时,无需机械结构与鳞茎接触检测位置,避免了该类损伤。

1.2 控制界面

采用Matlab中APP Designer开发平台设计了人机交互界面,主要包括试验台运动控制和目标检测结果显示两部分,如图2所示,APP最右边一栏自上至下分别用于执行电机控制系统使能、切根刀复位、选择X轴输送速度和试验台工作使能,加载深度卷积神经网络训练的检测器之后,APP将显示图像的检测结果,并显示预测的边界框左上角点像素坐标,边界框的长和宽,控制信息在APP中转换为控制命令。在界面中,还显示检测对象的类别和置信度得分(Score),并设置了紧急停止开关按钮,用以失能步进电机驱动器。

图2 人机交互界面Fig.2 Human-computer interaction interface

图2中显示的是APP加载鳞茎检测器后的检测结果,鳞茎目标像素尺寸约为276像素×231像素。为了保证向计算机提供可靠的位置信息,本文中每幅图像内只有一个大蒜,图像中的鳞茎是单个大目标[21]。

2 试验台硬件系统设计

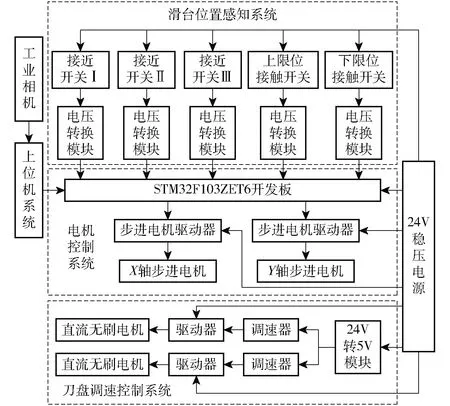

图3为控制系统硬件框图,控制系统硬件部分主要由工业相机、滑台位置感知系统、电机控制系统、刀盘调速控制系统以及安装有Matlab软件的上位机系统组成。滑台位置感知系统通过布置在X轴上的接近开关Ⅰ~Ⅲ和布置在Y轴上的接触开关感知滑台位置,各开关的信号电压由电压转换模块转为3.3 V;通过改变刀盘调速发出PWM波的频率来改变直流无刷电机的转速;上位机系统能够完成基于深度卷积神经网络的目标检测。

图3 控制系统硬件框图Fig.3 Block diagram of control system

2.1 相机标定

本文采用MS-UB500C型工业相机采集图像。工业相机采集的大蒜图像是像素信息,图像在计算机内是M×N的数组[22]。如图4所示,图像中O0为像素坐标系原点,(u,v)表示任一像素点的像素横坐标和纵坐标,相机镜头的光心投影点O1的像素坐标为(u0,v0),以点O1与x、y轴建立单位为毫米的图像坐标系((x,y)为坐标系内任意一点),图像中每个像素点的宽和高为ρw、ρh,则有

图4 图像坐标系Fig.4 Image coordinate system

(1)

(2)

在y方向上有

y=(v-v0)ρh

(3)

由式(3)得到高度方向上像素坐标与物理尺寸的对应关系,但由于镜头存在畸变,需要获取相机的畸变参数,再进行相机标定,以保证像素信息准确[23]。

2.2 微控制器

采用核心为STM32F103ZET6芯片的开发板作为下位机,控制X轴步进电机和Y轴步进电机运动。STM32F10x系列芯片属于ARM架构,基于Cortex-M3内核开发,最高工作频率为72 MHz,共有4个通用定时器,2个UART,具有高性能、低功耗、低成本的优点[24]。

2.3 通信系统设计

上位机与下位机之间采用UART通信,开发板通过板载USB转RS232转换器与上位机的USB端口相连接收TTL电平信号,程序将数据转换为数值在0~255的十进制数字命令代码,波特率设为115 200 b/s。

3 试验台软件系统设计

3.1 改进的YOLO v2模型

本文中,不同于一般分类问题中具有不同属性和类别的对象,蒜株拔出土后未做任何处理,无论是鳞茎表面还是蒜根间都随机粘附一定量的土壤,这增大了检测的难度,能否准确检测出目标的边界框是本项研究的重点,边界框的位置是影响切根质量的决定性因素。因此,需要注意每幅图像细微特征的差异。

目标的检测速度决定了试验台的性能,本文选择检测速度较快的YOLO v2模型进行研究[25-27]。为了学习更全面、更精细的图像特征,改进原始YOLO v2模型,采用ResNet50作为特征提取网络,加深了特征提取网络的深度,以提高整个神经网络提取特征的表达能力,引入残差网络,用于抑制训练误差积累,避免网络加深引起梯度消失[13,28-30]。

本文基于YOLO v2算法建立的大蒜检测模型主要由以下2个模块构成:Identity Block(IB)模块用于提取输入图像特征,包括卷积、批量归一化(BN)和ReLU激活函数处理。Conv Block(CB)模块同样是用来提取图像特征,与IB模块不同的是,该模块可以改变特征向量的维度。

改进的YOLO v2模型的特征提取网络共包括46个卷积层、1个最大池化层,模型架构如图5所示。改进的YOLO v2模型给出14×14×42张量的输出(本文对象分类为1),特征图中每个单元格预测输出7个边界框,每个边界框有6个预测值,分别为预测的边界框左上角点的像素坐标(ui,vi)、边界框的宽(wi)和高(hi)、目标性评分(pi)、置信度得分(Ci), 最终利用非极大值抑制方法只保留最佳的边界框[31]。其中,置信度得分是目标属于某个类别的置信度。

图5 改进的YOLO v2架构Fig.5 Architecture of improved YOLO v2

检测模型训练过程中的总损失用Lall表示,Lall由边界框检测损失(LIOU)、置信度检测损失(Lconfidence)和分类损失(Lclass)组成[28],即

Lall=LIOU+Lconfidence+Lclass

(4)

为了验证模型检测性能,本文采用召回率、平均精度、平均交并比和检测时间4个指标进行评价[17,32]。

在测试集上评价检测器的表现时,将统计检测率β、可用率η和置信度得分,计算公式为

(5)

(6)

式中N——测试次数

n′——检出目标的次数

N′——可以用于切根的检出次数

以可用率作为评价检测结果是否可以用于控制切根刀的指标,图像的检测结果分为可用和不可用两大类。

3.2 控制算法设计

大蒜切根时,将深度卷积神经网络预测的边界框的边线作为切割线。根据大蒜切根的需要,分别采用鳞茎检测器预测边界框的下边线、根盘检测器预测边界框的下边线、蒜根检测器预测边界框的上边线作为切割线。

检测器完成目标检测之后,上位机系统根据目标类别,计算出切割线像素纵坐标。如以鳞茎作为检测目标时,上位机系统将计算边界框下边线像素纵坐标,切割线的位置如图6中红线所示。

图6 调整方法原理图Fig.6 Schematic of adjustment method

当完成前次切根之后,上位机系统根据本次预测的切割线像素坐标,转换得到切割线图像坐标,并反馈电机控制系统调整切根刀y方向的位移。由公式(3)可知,前后两次切割,切根刀在y方向的调整位移为

(7)

式中 Δhn+1——图像坐标系中第n+1次切根与第n次切根切割线在y方向投影点的坐标差值,其值为正时切根刀向Y轴正方向移动,为负时切根刀向Y轴负方向移动,mm

kn——第n次预测的切割线像素纵坐标

kn+1——第n+1次预测的切割线像素纵坐标

此外,第1次切根时,存在关系

(8)

式中k0——完成复位后切根刀切割面的像素纵坐标,本文中为300像素

4 试验与结果分析

4.1 试验物料与设备

2021年5月在江苏省射阳县大蒜种植试验田开展了现场试验,进行目标检测和大蒜切根,试验现场如图7所示。试验田中蒜株直立性较好,随机选择蒜株,用于试验的全部蒜株经松土起秧后出土不超过1 h,蒜根长度69~151 mm,鳞茎高度38.84~49.25 mm(差值为10.41 mm)。出土后的蒜株不做任何处理,直接用于试验。

图7 系统现场试验Fig.7 Photo of system at test site

试验中使用的计算机处理器是Intel Xeon E5-1620、主频3.5 GHz,运行内存16 GB,存储内存1 TB,GPU为4 GB NVIDIA GTX1650。采用Matlab R2021a搭建神经网络。本次试验中,工业相机采集到的图像尺寸均为800像素×600像素。

4.2 多目标比较

为了研究不同目标的检测效果,本文对鳞茎、根盘和蒜根3种目标进行比较。目标比较试验的图像采集3 d,采集时间为08:00—19:00,由于天气变化和太阳移动,获得的图像亮度存在差别,将图像按照亮度分为高亮度、中亮度和低亮度3大类,保证了该目标检测方法对不同光照的适应性。

4.2.1数据处理

利用264株蒜株获得1 320幅图像(高亮度551幅、中亮度439幅、低亮度330幅)。训练集共859幅图像,测试集共461幅图像,训练集图像与测试集图像无重复。

如图8所示,利用Image Labeler对训练集图像中的3种目标进行标注,用绿色框标注鳞茎,用红色框标注根盘,用紫红色框标注蒜根。标注前将图像转换为224像素×168像素,标注时保证每个目标都被框入目标标注框之中并且在目标标注框中所占面积尽量大。训练集的70%(601幅图像)作为训练数据,其余的30%(258幅图像)作为验证数据。

图8 不同亮度的图像对比Fig.8 Image comparison charts of different brightnesses

训练集划分完成之后,在Matlab软件中采用镜像、色调、饱和度和曝光变化进行数据增强,经过数据增强的训练数据共2 404幅图像。

4.2.2参数设置

利用改进的YOLO v2模型进行训练,采用带有动量的随机梯度下降(SGDM)训练网络,动量为0.9,设置100个迭代周期。 主要训练参数包括:网络输入为224×224、最小批量为7、学习率为1×10-3、对象分类为1、锚箱数量为7。

根据鳞茎数据集的图像特征和GPU性能,当最小批量设为7,锚箱数量设为7时,取得了较好的训练效果。

4.2.3训练与结果分析

训练后期总损失稳定在0.5以下,未出现梯度消失。训练结果显示,鳞茎目标召回率为97.15%,平均精度为99.83%,平均交并比为0.957 9;根盘目标召回率为96.82%,平均精度为99.45%,平均交并比为0.894 1;蒜根目标召回率为97.26%,平均精度为99.98%,平均交并比为0.900 7,最终得到3种目标的检测器。

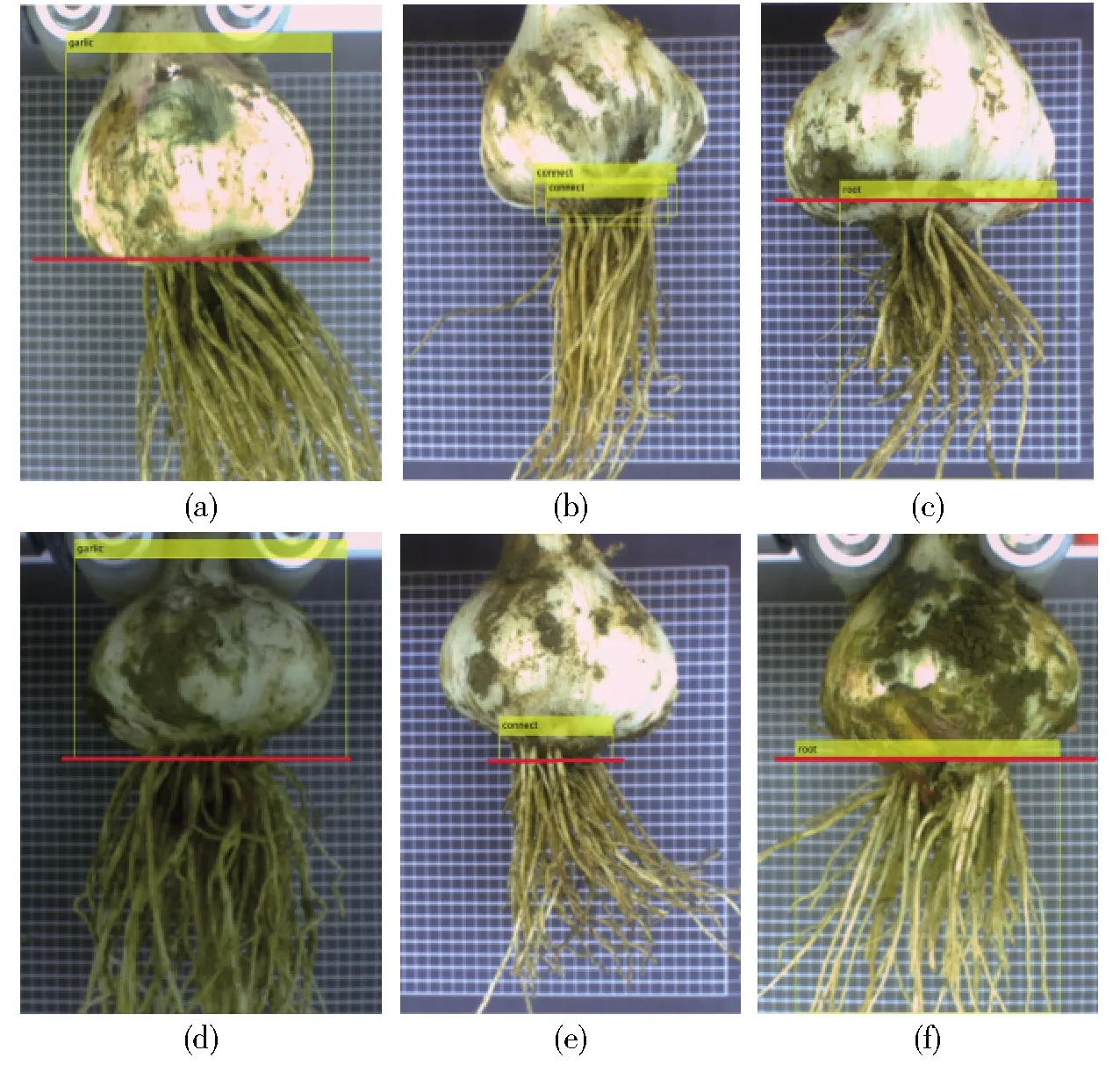

图9中所标出的红线为通过检测得到的切割线。不可用的检测结果包括:图9a、9c(预测的切割线经过鳞茎将造成大蒜切伤)、图9b(预测出多个边界框,将不能为计算机提供准确的位置信息),及未能做出检测的结果;可用的检测结果包括:图9d、9e、9f。可用的检测结果不仅做出了准确预测,而且预测得到的切割线不经过鳞茎,避免造成大蒜切伤。

图9 检测结果对比Fig.9 Comparison of recognition results

利用3种检测器,分别对测试集图像进行逐幅检测测试,结果统计情况见表1。虽然根盘检测器出现了未检测的情况,但是根盘目标检测率最低为99.17%,其余两种目标的检测率均为100%,说明3种检测器都具有较好的泛化性,模型没有过拟合。

以根盘为目标时,多次出现预测出数个边界框的情况,表明根盘作为检测目标不可靠。由表1可知,鳞茎、根盘和蒜根在APP中的检测时间平均值分别是0.088 4、0.077 4、0.083 1 s,置信度得分平均值分别是0.976 98、0.833 86、0.943 63;此外,不同亮度对同一目标的检测置信度得分影响并不大。比较在同一种亮度下不同目标检测可用率结果的差异可知,鳞茎检测可用率都最高,鳞茎、根盘和蒜根检测可用率平均值分别是94.79%、86.97%、14.23%,蒜根可用率平均值最低,低于15%,不能作为检测目标。

表1 目标比较试验结果Tab.1 Results of target comparison test

综合考虑各项试验指标和可靠性,本文选择鳞茎作为切根试验的检测目标。目标比较试验还表明,采用包含不同亮度图像的训练集,训练得到的目标检测器具有较好的检测效果。

4.3 目标检测模型比较

为了对比不同模型的检测性能,本文对基于5种算法的10种模型进行比较。5种算法分别是:Faster R-CNN、SSD、YOLO v2、YOLO v3和YOLO v4,10种模型的具体结构见表2。

4.3.1数据处理

在目标比较试验的图像采集工作基础上,继续进行图像采集,共采集到2 000幅无重复且亮度不同的图像作为训练集。采用Image Labeler对训练集图像中的鳞茎目标进行标注,处理方法见4.2.1节,标注时适当下移了标注框的下边线,以期达到提高可用率的目的。训练集的70%(1 400幅图像)作为训练数据,其余的30%(600幅图像)作为训练验证数据。经过数据增强的训练数据共5 600幅图像。

在试验中,利用1 d时间采集500幅无重复且亮度不同的图像作为测试集。

4.3.2参数设置

训练参数设置与4.2.2节基本相同,不同之处有:检测头数量为3的YOLO v3-DarkNet53(3)和YOLO v3-ResNet50(3)的锚箱数量为9,检测头数量为2的YOLO v3-ResNet50(2) 、YOLO v3-tiny-COCO 和YOLO v4-tiny-COCO的锚箱数量为6,各模型网络输入见表2。

4.3.3训练与结果分析

各模型在训练后期总损失均稳定在0.5以下,未出现梯度消失。各模型的训练指标见表2,得到10种鳞茎目标检测器。

由表2可知,YOLO v4-tiny-COCO的平均精度最高,为99.99%,改进的YOLO v2模型平均精度为97.66%,10种模型中,YOLO v3和YOLO v4模型有多个检测头,可以实现多个尺度的检测,有利于检测小目标,并且能够分辨出距离较近的多个目标,提取的特征图尺寸种类数与检测头数量相等,YOLO v3和YOLO v4算法实施了多尺度特征融合。

表2 模型结构对比Tab.2 Comparison of model structure

利用由Matlab编写的测试程序,分别统计了10种检测器在测试集上的置信度得分和检测时间,由于测试程序中的检测时间是从测试程序读入图像到检测器输出边界框的参数,无需显示图像,所以测试程序中的检测时间会略短于APP中的检测时间。试验中保证了10种模型比较环境的一致性。

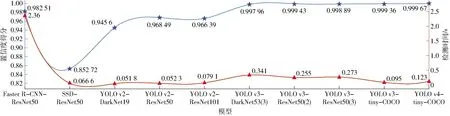

模型测试结果如图10所示, 可知YOLO v4-tiny-COCO、YOLO v3-ResNet50(2)、YOLO v3-tiny-COCO、YOLO v3-ResNet50(3)和YOLO v3-DarkNet53(3) 的置信度得分大于0.99, Faster R-CNN-ResNet50、 YOLO v2-ResNet50和YOLO v2-ResNet101的置信度得分大于0.95,YOLO v2-DarkNet19和SSD-ResNet50的置信度得分在0.95以下。

图10 模型测试结果对比Fig.10 Comparison of model test results

Faster R-CNN-ResNet50的检测时间大于1 s,YOLO v4-tiny-COCO、YOLO v3-ResNet50(3)、YOLO v3-ResNet50(2)和YOLO v3-DarkNet53(3)的检测时间在0.1~0.35 s之间,YOLO v3-tiny-COCO、YOLO v2-ResNet101和SSD-ResNet50的检测时间在0.06~0.1 s之间,只有YOLO v2-ResNet50和YOLO v2-DarkNet19的检测时间小于0.06 s。

为了提高反应速度,大蒜切根要求检测器具有较高检测置信度得分的情况下,检测时间尽可能短。对比的10种模型中,YOLO v2-DarkNet19的检测时间最短,YOLO v2-ResNet50仅比YOLO v2-DarkNet19慢0.000 5 s,几乎可以忽略,但YOLO v2-ResNet50的置信度得分较YOLO v2-DarkNet19提高0.022 89,并高于SSD-ResNet50和YOLO v2-ResNet101,说明改进的YOLO v2模型有效提高了检测精度。从快速完成检测的角度出发,改进的YOLO v2模型在10种模型中性能最优,可以实现对鳞茎快速准确的检测。YOLO v2-ResNet50训练的检测器在测试集上的检测结果如图11所示,测试集由不同亮度、鳞茎外形各异、鳞茎外表粘有不同土壤量的500幅图像构成,每幅图像中均可以准确检测出鳞茎目标位置并输出置信度得分,可以说明由改进的YOLO v2模型训练得到的鳞茎检测器具有较好的泛化性,模型未出现过拟合,可以用于切根试验。

图11 改进模型的测试结果Fig.11 Test results of improved model

4.4 切根试验

为了验证大蒜切根试验台的实际切根效果,采用改进的YOLO v2模型训练的检测器进行切根试验。设置X轴滑台输送速度为0.7 m/s,切根刀的刀盘转速为1 200 r/min。共进行3组试验,每组100个样本,采集图像的亮度由天气状况决定。

将不切伤鳞茎,且残余的蒜根长度不超过10 mm的样本认定为合格,切根之后的鳞茎底部不会发霉。切根合格率通过观察和测量统计计算得到,切根合格率计算公式为

(9)

式中N0——蒜株总株数

N1——切根合格的蒜株株数

4.5 结果与分析

切根前后对比见图12,可以看到切根刀有效切掉了蒜根。由表3可知,鳞茎目标的置信度得分为0.970 99,可用率为96.67%,切根合格率为95.33%,在APP中的检测时间为0.088 7 s。切根合格率低于可用率的原因是个别检测可用的大蒜切根后残余的蒜根长度过长,为不合格结果,降低了切根合格率。根据目标比较试验的结果对标注方法进行改善,提高了检测结果可用率。

表3 切根试验结果Tab.3 Results of root cutting test

图12 切根前后对比Fig.12 Comparison before and after root cutting

在3组试验中均出现了少数不可用的检测结果,这些检测结果中的切割线经过鳞茎,切根时将鳞茎切伤。因此,结果中切根不合格分为切伤和残余蒜根过长两种情况。在后续研究中,将采取措施进一步提高可用率和切根合格率。

5 讨论

本文切根试验结果中,鳞茎目标检测时间均值为0.088 9 s,试验记录的检测时间最大值为0.096 2 s,表明检测时间最大不超过0.1 s,取最大检测时间tmax=0.1 s。若要实现大蒜联合收获过程中的切根,可以采用双触发点控制模式将系统布置在联合收获机夹持输送通道上。具体方法如下:蒜株输送时分前后激活第一和第二触发点,第一触发点激活图像拍摄和检测功能,第一触发点与相机位置相同,第二触发点布置在第一触发点后距离L1处,切根刀的完成切割点在第二触发点后距离L2处,蒜株激活第一触发点后系统得到预测切割线的高度坐标,并将数据保存在内存中,当第二触发点激活时,系统根据数据调整切根刀的高度,完成大蒜切根。

已知现有的大蒜种植农艺中株距d为0.1~0.15 m,取d的最小值dmin=0.1 m,由4.1节统计的试验数据可知鳞茎最大高度差取整为hmax=11 mm,Z轴丝杆的螺距为mz=10 mm,丝杆驱动电机转速用ny(r/min)表示。试验测得七行大蒜联合收获机作业时输送链最大输送速度vmax为0.75 m/s;本试验台采用的双圆盘切刀有效切割行程Lx=45 mm,考虑到蒜头大小不同,根盘直径不同,同样参数配置的双圆盘切刀初始切割点与完成切割点之间的距离也会不同,为避免切伤鳞茎,设置安全切割系数φ=0.9。假设切根时以鳞茎顶面对齐,切根刀转轴的轴线与输送方向垂直,则有

vmaxtmax≤L1

(10)

(11)

将数值代入式(10),计算得到L1的最小值为0.075 m。式中L2取最大值时ny取最小值,将L2=dmin=0.1 m代入式(11)可得丝杆驱动电机转速ny最小值为1 000 r/min。通过以上计算可以看出,第一触点到第二触点距离为0.075 m,第二触点到切根完成点距离为0.1 m,丝杆驱动电机转速选取1 000 r/min即可,将基于深度卷积神经网络的大蒜切根系统布置在大蒜联合收获机上是可行的。

6 结论

(1)提出了利用机器视觉技术进行鳞茎非接触式切根方法,设计了一种基于深度卷积神经网络的大蒜切根试验台,以改进的YOLO v2模型构建深度卷积神经网络,实现鳞茎的目标检测,将预测的切割线像素纵坐标差转换为图像坐标,自动调节切根刀的高度。解决了采用纯机械机构难以检测大蒜位置的问题。

(2)采用ResNet50作为特征提取网络,比较了以鳞茎、根盘和蒜根作为目标,在高、中、低3种亮度下进行检测的结果和可靠性。以鳞茎作为目标时检测的置信度得分和可用率最高,可靠性最好。

(3)对比Faster R-CNN、SSD、YOLO v2、YOLO v3和YOLO v4算法的10种模型,改进的YOLO v2可以实现对鳞茎快速准确的检测。切根试验结果表明,鳞茎检测置信度得分为0.970 99,可用率为96.67%,切根合格率为95.33%,检测时间平均值为0.088 7 s。根据试验结果,提出了将系统布置在大蒜联合收获机上的可行方案。