乘务员值乘状态监测技术研究

李干涛,朱岸平,李火星

(1.中国铁路南昌局集团有限公司机务部,江西 南昌 330000;2.郑州畅想高科股份有限公司,河南 郑州 450000)

0 引 言

长期以来,机车乘务员因工作场所处于相对封闭的司机室内,其作业行为难于被实时监督。机务系统两违中乘务员违反作业标准的违章尤为突出,比较典型的违章有中断瞭望、玩手机、盹睡、离岗等。通过跟客户沟通,机车运行过程会出现车门未关闭的情况,这些都是行车安全的重大隐患。因此,基于机器视觉的乘务员值乘状态检测技术成为国内外研究的热点。王荣本[1]等人提出通过分析驾驶员的眼睛和嘴巴的开闭频率两种状态信息检测驾驶疲劳状态,并且结合安全车距的检测,提升了系统的安全性。疲劳程度估计法PERCLOS[2]是很多学者研究人的疲劳状态采用的方法。该方法通过分析眼睛的闭合程度估计驾驶员的疲劳程度。随着深度学习技术的崛起,其在实际应用中的准确率及泛化能力都有了质的提升。冯文文[3]等人提出以softmax损失与中心损失相结合的深度卷积神经网络算法,通过提高类间差异性、类内紧密性提升了疲劳检测的准确率。中科院计算所山世光团队开源的深度学习人脸识别[4-5]算法,包含了人脸检测、特征点对齐、头部姿态、眼睛状态检测、头部姿态、人脸识别等多个模块对人脸部特征进行了分析。姚康[6]提出了一种基于N-RANGE跟踪识别机车乘务员眼睛状态的方法输出司机值乘状态。

为了对司机值乘状态进行更全面准确的分析,本文采用多维度视频融合感知技术,对机车乘务员的值乘状态进行实时监测,提前对机车乘务员异常行为进行预警,督促其严格按标作业。

1 算法设计方案

机车运行过程图像采集设备采集图像的质量受外界光线的干扰较大,主要有以下四种情况:

(1)采集设备在光线暗时自动启用红外补光,产生脸部曝光的情况;

(2)机车快速运行时,人脸会呈现忽明忽暗、亮度不均匀的情况;

(3)机车乘务员戴眼镜,容易反光,导致看不见眼睛的情况;

(4)外界光线特别强烈、比较刺眼时,乘务员眼睛处于微睁状态,可能被误判为闭眼。

多维度视频融合感知技术即融合了图像校正、目标检测和小眼睛的Hu矩不变量特征分析技术。图像校正采用动态自适应伽马变换技术对过亮或暗的图像进行校正。目标检测技术采用轻量级网络mobilenet-yolov3[7]检测盹睡、玩手机、抽烟及吃东西等行为信息。Hu矩不变量特征通过分析前后帧小眼睛的变化状态提升盹睡检测的准确率。多维度视频融合感知技术检测的乘务员的行为特征如图1所示。

图1 多维度视频融合感知技术

2 算法技术实现

2.1 动态自适应图像校正技术

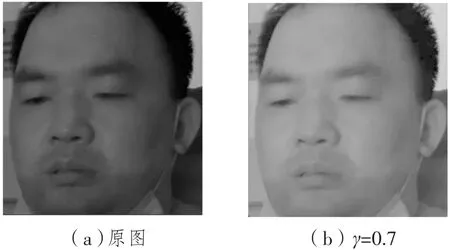

对于曝光或亮度不均匀的图像,采用动态自适应伽马变换技术进行图像校正,如式(1)所示。通过计算图像的平均灰度值动态设置阈值,对于过亮的图像,设置伽马值在1.1~1.6,对于暗的图像,设置伽马值在0.6~0.9,从而达到对曝光过暗的图像进行校正。

式中:指数γ为伽马值;a为权重参数,通常设置在0.9~1;V取值在0~1,可对图像像素进行归一化。图2为测试人员模拟测试图片校正前后对比图。

图2 图像校正效果对比

2.2 目标检测技术

2.2.1 yolov3网络

yolov3[8]是一个端到端的单阶段区域回归模型,基础网络采用darknet-53网络(不包含池化层、全连接层和softmax层)提取特征,然后通过3个不同尺度特征图预测目标对象。多个尺度特征能够提取更加细粒度的特征,适应于不同大小的目标,提升了目标检测准确率。

2.2.2 mobilenet网络

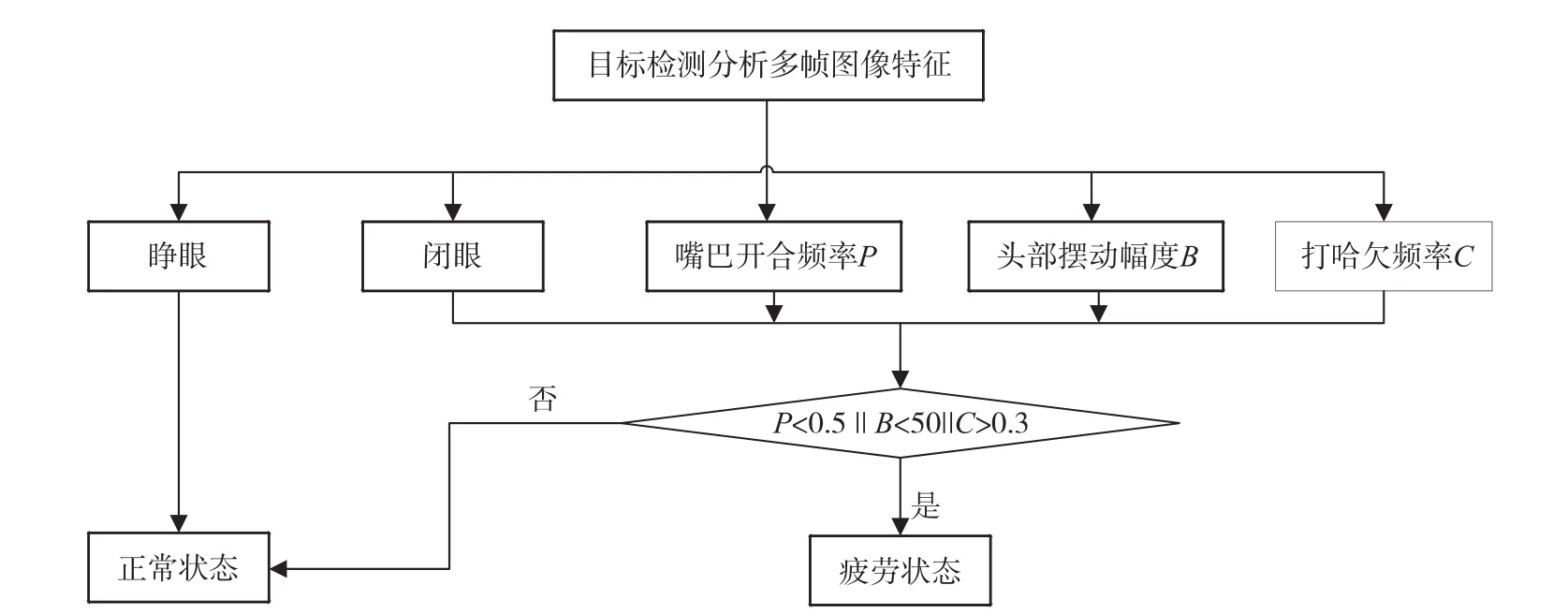

mobilenet网络是采用深度可分离卷积替代标准卷积构建的轻量级网络模型,标准卷积是用每个卷积核对所有输入通道进行卷积。深度可分离卷积由深度卷积和逐点卷积构成,其中深度卷积是每个输入通道对应一个卷积核,逐点卷积是1×1的标准卷积。

假设输入特征图大小为W×N,通道数为M,卷积核大小为DK×DK,输出特征图的通道数为N,标准卷积的计算量为O1,如式(2)所示。深度可分离卷积的计算量为O2,如式(3)所示。对比两个卷积的计算量O,如式(4)所示。此轻量级网络的卷积操作明显地减少了的计算量。

2.2.3 mobilenet-yolov3网络

目标检测技术采用轻量级网络mobilenetyolov3,其主干网络采用MobileNet网络,代替了yolov3[8]中的Darknet53网络,减少了主干网络中卷积运算的部分,极大地减少了网络的整体计算量。mobilenet-yolov3网络结构图如图3所示。

图3 mobilenet-yolov3网络结构

2.2.4 mobilenet-yolov3网络应用

在乘务员状态检测方面,mobilenet-yolov3网络具有多种应用功能。

(1)网络应用于盹睡检测。mobilenet-yolov3网络对于乘务员前方图像采集设备采集的图像进行盹睡状态检测,环境良好时,检测准确率达到98%。而机车行车过程中,外界光线会对乘务员造成干扰,乘务员会出现眯眼或戴眼镜反光状态,因此需要进行多维度特征综合分析。通过mobilenet-yolov3网络快速检测人脸的相关信息,包括人脸、戴口罩人脸、睁眼、闭眼、戴眼镜、眼镜、张嘴、闭嘴、吸烟、打哈欠等特征,综合多特征信息辅助分析,可判断人是否盹睡。图4为目标检测网络检测的人脸多特征图。

图4 mobilenet-yolov3网络检测人脸多特征

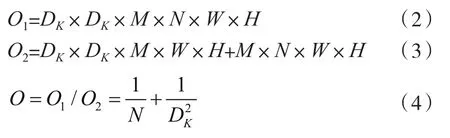

多特征信息辅助分析流程如图5所示,通过对连续时间内多帧人脸图像的多维特征进行分析,如果目标检测网络输出有闭眼特征,需增加人脸其他状态的分析。若嘴巴开合频率P<0.5,头部摆动幅度B<50,打哈欠频率C>0.1,即为疲劳状态,反之则为正常状态。

图5 多特征信息辅助分析流程

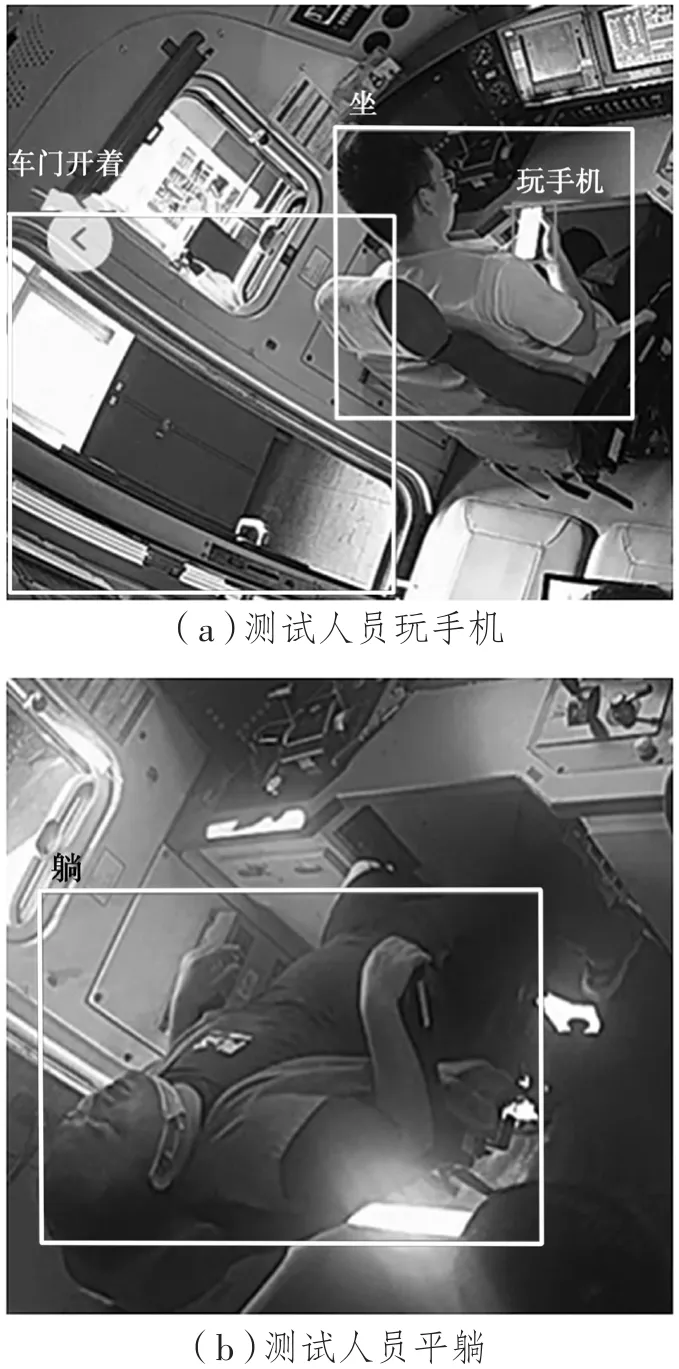

(2)网络在其他状态的应用。对于乘务员后上方图像采集设备采集的图像,利用mobilenetyolov3网络多目标分类检测特性可检测更多关键特征,如玩手机、手势、站立、坐下、平躺以及车门开闭状态。

图6 多目标特征检测效果图

2.3 小眼睛状态分析

mobilenet-yolov3对小眼睛或眯眼的情况大概率会检测为闭眼,这样会造成误判。在正常状态下人是需要眨眼的,眨眼时眼睛状态是由凸字形状变为平线或凹字形状的。为了提取眨眼特征,通过提取连续前后帧眼睛区域Hu矩不变量[2]特征,计算平均差值,根据差值统计眼睛图像的变化状态,对于平均差值小的判定为闭眼,反之则判定为眨眼。图7为实际测试过程中采集的小眼睛图像。

图7 小眼睛或微睁眼睛图像

2.3.1 Hu矩不变量

HU M K[9]提出了Hu矩不变量,通过对图像的二阶和三阶中心矩组合,构成了7个不变矩M1~M2,具有图像平移、旋转和尺度不变性。通过计算前后帧眼睛图像的7个不变矩特征,分析前后帧眼睛的变化,M3到M7不变矩特征值受眼睛状态变化影响较小,而M1和M2不变矩特征值受眼睛状态变化影响较大,因此M1和M2不变矩征值可以应用于判断眼睛是否眨眼。式(5)和式(6)分别为图像的M1和M2不变矩征值。

式中:η为归一化的中心矩,其定义如式(7)所示。

式中:x0,y0为图像的重心坐标,M,N分别为图像的高度与宽度,f(x,y)为图像像素值。

2.3.2 Hu矩不变量的应用

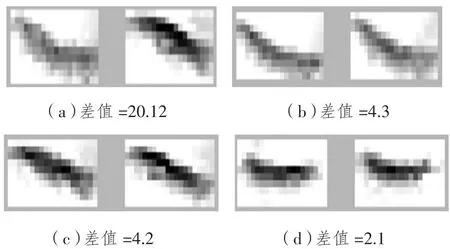

通过实验数据测试,计算连续视频帧的眼睛状态的M1和M2不变矩特征平均差值对比,如图8所示。图8(a)属于小眼睛眨眼的动态变化,形状差别还是较大的,而图8(b)、图8(c)、图8(d)图中小眼睛几乎不变的状态,平均差值较小,因此可判定为没有眨眼,即闭眼状态。

图8 前后帧眼睛状态的不变矩特征平均差值

3 实际测试结果

3.1 测试乘务员前方设备采集的人脸图像

通过多维特征信息综合判断,盹睡检测误检率对比结果如表1所示。仅判断眼睛状态时,误报率达72.42%,误报原因中眼镜反光占80%,15%是眼睛小或微睁,其他原因占5%。通过增加嘴巴开合频率、头部摆动幅度、打哈欠次数检测,误报率从72.42%降低到了7.50%;增加Hu不变量特征辅助分析小眼睛状态,误报率降到了5.00%。

表1 盹睡检测误报率统计结果

3.2 测试乘务员后上方设备采集的图像

对mobilenet-yolov3网络检测的目标,包括玩手机、手势、站立、坐下、平躺、车门开闭状态进行现场测试,准确率如表2所示。

表2 玩手机等目标检测准确率

4 结 语

本文在机车上实现了多维度视频融合感知技术检测司机室乘务员工作状态及司机室车门状态,当乘务员在行车途中发生盹睡、离岗、中断瞭望、玩手机等非正常状态时,系统发出语音提醒并生成音视频文件;当检测到司机室车门在行驶过程中未关闭时,系统发出语音提醒并生成视频文件。本系统能够及时有效地提醒乘务员进行安全操作,有利于乘务员养成规范操作的习惯,警示乘务员在行车过程中时刻提高警惕,对机车的安全运行具有重要的意义。