基于语义分割的作物垄间导航路径识别

饶秀勤,朱逸航,张延宁,杨海涛,张小敏,林洋洋,耿金凤,应义斌

基于语义分割的作物垄间导航路径识别

饶秀勤1,2,朱逸航1,2,张延宁1,2,杨海涛3,张小敏1,2,林洋洋1,2,耿金凤1,4,5,应义斌1,2

(1. 浙江大学生物系统工程与食品科学学院,杭州 310058;2. 农业农村部农产品产地处理装备重点实验室,杭州 310058;3. 浙江大学数学科学学院,杭州 310058;4. 枣庄学院机电工程学院,枣庄 277101;5. 新多集团有限公司,永康 321300)

针对目前农作物垄间导航路径识别目前存在准确性、实时性差、通用性弱及深度学习模型解释困难等问题,该研究在Unet模型的基础上进行剪枝与优化,提出了保留Unet模型特征跳跃连接优势的Fast-Unet模型,并以模型所识别的导航路径为基础,通过最小二乘法回归生成垄间导航线与偏航角。该研究首先在棉花垄间导航路径数据集上进行模型训练,随后将训练的模型迁移至玉米、甘蔗等小样本数据集进行导航路径识别,通过使用梯度加权类激活映射法对模型识别过程与迁移学习过程进行解释,对各模型识别结果进行可视化对比。Fast-Unet模型对棉花、玉米、甘蔗导航路径提取精度指标平均交并比分别为0.791、0.881和0.940。模型推理速度为Unet的6.48倍,在单核CPU上处理RGB图像的推理速度为64.67帧/s,满足农作物导航路径识别的实时性需求。研究结果可为田间智能农业装备的导航设备研制提供技术与理论基础。

图像处理;导航;路径识别;语义分割;迁移学习;深度学习

0 引 言

智能农业装备在田间作业时的导航路径控制是农业向智能化方向发展过程中至关重要的一环[1]。目前智能农机田间路径导航以卫星定位系统导航和机器视觉导航为主[2]。基于卫星定位系统的导航技术精度有限[3],多适用于大田路径规划场景。机器视觉技术可以识别田垄间导航路径,解决田间种植行间距窄、田间先遣路径难以保持稳定等情况,解决农机易产生压苗的问题[4-6],为智能农业装备提供实时导航信息[7]。但目前基于机器视觉的导航方案依旧面临田间光照环境多变和田间路况复杂的挑战[8-12]。通常情况下,传统机器视觉方法只能在特定作物、特定环境下有效,泛化能力较弱。此外,农机在行进中需要实时进行路径调整,对图像数据进行实时处理也是机器视觉导航的另一大挑战[13-15]。

近年来,深度学习在机器视觉领域发展迅速[16],其中的卷积神经网络算法更是被广泛应用于各类农业视觉任务场景[17-19],并取得较好的效果。而在结构化道路识别方面,卷积神经网络已被广泛应用于结构化道路下的汽车自动驾驶[20]。同时,使用基于深度学习的机器视觉技术可以避免因人为选择图像特征而产生的局限性[10],提高机器视觉算法的精确性与鲁棒性。

已有学者在基于深度学习算法的非结构化道路识别与导航领域开展研究,如Lin等[21]实现了一种基于深度学习的像素级道路检测和机器人导航控制方案。宋广虎等[22]使用全卷积网络(Fully Convolutional Networks,FCN)[23]在葡萄种植园中检测行间道路并实现精确导航。李云伍等[24]使用FCN实现了丘陵山区田间道路场景的语义分割,平均交并比(MIoU)达到0.732。Lin等[13]在FCN的基础上提出并利用Enet对茶叶种植场景的茶行轮廓进行语义分割,MIoU达到0.734,为骑式采茶机提供实时导航。Badrinarayanan等提出的基于FCN的SegNet[25]进一步提高了自动驾驶的图像语义分割识别精度。

但目前基于语义分割的田垄间道路识别方法依旧存在以下几个问题:一是在深度学习语义分割算法带来的高精度的同时,需要考虑与计算资源的高算力需求之间的平衡问题;二是现有研究大多关注于单一作物垄间场景的导航路径识别,缺乏一种相对通用的方法;三是基于深度学习语义分割算法在作物垄间导航路径识别过程中不能得到较好的解释。

针对上述问题,本研究基于卷积神经网络建立基于Unet[26]的实时棉花垄间图像语义分割模型,并对模型进行剪枝与优化,提出Fast-Unet模型,在棉花垄间导航路径识别的基础上进行小样本迁移学习,检验所建模型对玉米及甘蔗的垄间导航路径识别性能,并提取导航线,检验导航偏航角,以解决单一作物垄间导航路径识别泛化性差的问题。此外,本研究通过梯度加权类激活映射法[27](Gradient-weighted Class Activation Mapping,Grad-CAM)解释本文算法的末端分类规则及迁移学习优势的合理性,为模型产生的偏差与效果提供解释,以解决深度学习语义分割算法可解释性较弱的问题。

1 材料与方法

1.1 数据集构建

本研究从复杂场景出发,以作物生长高度与姿态为依据选取3种作物代表常见的大田垄间导航场景。中等高度常见作物以棉花为代表;相对高大的直立作物以玉米为代表,相对低矮的作物以幼苗期的甘蔗为代表。如图1所示,本研究所选取的作物均在导航路径上方存在交错叶片,增加了导航路径的识别场景复杂度。

本文使用Vision Datum公司的Mars2000-50gc相机,分别于2020年7月在安徽省安庆市望江县棉花试验田中采集盛蕾期棉花图像数据,棉花品种为中棉所63号;2021年5月在山东省枣庄市薛城区采集穗期玉米图像数据,玉米品种为农大108;2020年10月在广西省北海市合浦县采集青皮甘蔗幼苗期图像数据。在采集时相机安装于移动平台上,在移动平台移动时对当前的作物垄间图像进行连续采集。试验先选取800幅分辨率为1 900×1 180的棉花垄间导航路径图片并进行标注,生成棉花数据集;采集相同像素的玉米垄间图片100幅,甘蔗垄间图像100幅,分别生成玉米数据集与甘蔗数据集。图像示例如图1所示。

棉花垄间导航路径数据集按4∶1划分为训练集和验证集,训练集共640幅图像,验证集共160幅图像。

用于迁移学习的玉米垄间导航路径与甘蔗导航路径数据集按1∶1划分为训练集和验证集,训练集50幅图像,验证集50幅图像。

1.2 数据增强

为了扩增数据集,本文在模型训练过程中采用原始输入图像随机旋转90°、水平或者垂直翻转、调整图像色相饱和度明度(Hue,Saturation,Value,HSV)等方法进行随机数据增强,以提高模型的鲁棒性和准确性。在每次迭代训练读取图片数据时,原始图像按顺序执行上述步骤。每个步骤会有50%的概率触发变化。HSV随机变换限制在一定范围内,色调(H)的变换范围小于20°,饱和度(S)的变换范围小于30%,明度(V)的变换范围小于20%。

随机旋转和翻转图像为数据集中各类作物垄间导航路径的方向确认提供保障,图像HSV随机调整为模型适应不均匀的自然光照环境提供了保障。

1.3 评价指标

在语义分割任务中,一般从模型推理速度,模型参数数量和精度3个方面进行考量。推理速度代表模型的实时性水平,模型参数量代表模型对计算机的内存占用水平,精度估算选取平均交并比(Mean Intersection-over- Union,MIoU)。

推理速度本文采用每秒处理帧数(Frames Per Second,FPS)表示,为排除计算机硬盘读写速度对算法性能的干扰,本文在计算推理速度时排除所有数据集读取时间与图像加载时间,仅计算图像从输入模型到输出的时间。

模型参数数量使用算法在运行时实际占用计算机内存资源数值。

MIoU是在语义分割任务中的一种标准度量,真实值与预测值2个集合的交集和并集之比,计算公式如下:

2 基于语义分割的农作物垄间路径识别模型

基于深度学习的语义分割算法对图像进行像素级的分类。输入图片进行深度神经网络处理时被卷积层和池化层编码[28]。编码器的输出经过解码器进行解码,生成输出图像。解码器由双线性差值或反卷积进行上采样生成,增加高阶特征的分辨率,确保输出图像大小与输入图像相同,并对每个像素的类别进行预测。

FCN、SegNet和Unet作为编码-解码框架下的经典模型,具有准确度高的特点,但其运算量大,运行相对缓慢。针对该问题,本文在Unet的基础上进行剪枝与优化,提出Fast-Unet模型。

2.1 语义分割模型

传统的FCN在图像语义分割中各尺度特征间的联系有限,Unet解决了该问题,但Unet网络运行效率不高,因此本文在Unet基础上提出了Fast-Unet模型。Unet网络通过跳跃连接将网络下采样时的高分辨率信息与上采样时的低分辨率信息使用特征叠加的方式整合,以丰富采样信息,提高分割精度。

为满足智能农机导航路径识别的实时性需求,本文对Unet结构进行优化。考虑到作物垄间导航路径的分类任务与城市场景分类任务相比较为简单,缩减75%卷积核数量与前向传递推导过程中的特征图数量,Fast-Unet模型参数的减少为路径识别的实时性提供了保障。

为了进一步加快运行速度,本文将Unet及FCN中常用的反卷积上采样操作替换为双线性插值法,在保持精度水平基本不变的前提下,降低模型运算量。Fast-Unet的网络架构如图3所示。

2.2 迁移学习

迁移学习是深度学习模型运用已有知识对新知识进行学习的过程,其核心是寻找已有知识和新知识之间的相似性[29]。在迁移学习中,已有知识称为源域,本文源域是棉花垄间导航路径识别数据集的特征空间,目标域是玉米与甘蔗垄间导航路径数据集的特征空间。源域与目标域不同但是有一定的关联。

本文基于模型迁移,假设源域与目标域可以共享一些模型参数,将源域的特征空间上学习到的模型应用于目标域的特征空间上,再根据目标域学习新的模型。

2.3 模型可解释性

为了更好地理解本文所提出的Fast-Unet模型,并对其语义分割的视觉任务进行可视化解释,采用Grad-CAM方法,在没有注意力机制的基础上对图像位置进行判别,并且不需要修改网络结构与重新训练。

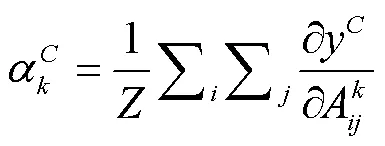

Grad-CAM使用流入最后一个卷积层的梯度信息为每个神经元分配权重,并基于特定的关注进行决策。本文只解释输出层的决策内容。

2.4 导航路径与导航线提取

对作物垄间导航路径识别后,进一步基于已有路径提取垄间道路导航线。由于玉米与甘蔗的垄间导航路径基本为直线,因此可以求取其偏航角。

首先,深度学习语义分割模型对垄间导航路径进行分割,生成由垄间导航路径与背景所构成的二值化图像,如图4b所示。选取二值化图像中的最大连通区域作为垄间导航路径,并使用Canny算子提取最大联通区域的边界,如图4c所示。随后,将边界上的点求中值,生成路径中心线散点图,如图4d所示。最后,将中心线散点图以图像长宽为坐标轴进行一元一次方程的最小二乘回归,求出导航线方程,如图4e所示。偏航角为回归函数斜率系数倒数的反正切函数值,计算公式如下:

本文将由标记数据回归生成的导航线作为真值,与预测数据回归生成的预测值进行对比,计算偏航角的平均差距与偏航线位置的平均差异。

平均偏航角的计算公式为:

3 结果与分析

3.1 试验平台

试验中模型训练的计算机处理器为Intel(R)Xeon(R)Gold 6147M,基准频率为2.50 GHz,图形处理器(GPU)为NVIDIA TITAN RTX,内存为256 GB,操作系统为Ubuntu 18.04.1。

为模拟实际场景,测试模型的计算机处理器为Intel(R)Core(R)i5-4258UM,基准频率为2.40 GHz的CPU的单一核心,无独立GPU,内存为8 GB,操作系统为macOS。

3.2 超参数设置与模型训练

本文作物垄间导航路径识别训练时所采用的超参数为:迭代次数(Epochs)为100次,最小批处理大小(MiniBatch Size)为32张图片。采用学习率衰减训练策略中的学习率调整策略,学习率分布如表1所示。

表1 学习率调整策略

田垄间导航路径识别任务明确,与常规语义分割物体识别任务差异较大,同时棉花导航路径数据充足,因此棉花数据集在训练时并没有使用迁移学习。对玉米及甘蔗数据集进行迁移学习训练时,将在棉花数据集上通过直接训练得到的最佳模型参数作为新模型的初始训练参数,其余训练参数和学习率策略与原始训练保持一致。

使用BCEDiceLoss作为训练的损失函数。该损失函数由Dice Loss和二分类交叉熵损失(Binary Cross Entropy Loss,BCELoss)按权重加权计算,具体公式如下:

DiceLoss从全局出发判断预测图的分类效果,而BCELoss从细节出发判断每个像素点分类效果。本文对作物垄间导航路径的识别需要注重全局判断的准确性,并兼顾细节,所以在BCEDiceLoss的计算中赋予DiceLoss更高的权重,本文设=0.5。

训练过程中FCN模型、SegNet模型、Unet模型以及本文Fast-Unet模型的损失函数曲线,如图5所示。

由图5可以看出,训练集的损失函数随着迭代次数的增加而下降。观察模型在验证集上的损失计算可以发现,在迭代次数达到30次左右时,3个模型的验证集损失函数值已基本保持不变,继续下调学习率也不能对模型产生明显的改善。本文Fast-Unet模型的表现介于Unet和FCN模型之间。

分别对FCN、SegNet、Unet及Fast-Unet模型的最后一层卷积层进行可视化,以棉花田垄间导航路径识别为例得到如图6所示的结果。

观察模型的CAM图发现3种模型,对于作物垄间道路的关注区域有所不同。从图6d中观察到FCN的关注区域集中于局部,各个尺度特征间的联系有限,对全图像尺度特征识别存在明显缺陷。从图6c和图6e中观察到SegNet和Unet的关注区域已将作物垄间导航路径进行覆盖,更多聚焦在导航路径周边的作物上。可以判断SegNet和Unet在识别时受较多深层尺度信息的干扰。网络结构在多次下采样后读取的信息更关注于图像的大尺寸特征,而SegNet与Unet的网络结构在下采样后保留了数倍于Fast-Unet的特征图。本研究所用的数据集较小,输入图像尺寸小,当模型存在大量深层特征图时更容易发生偏向于大尺寸特征的过拟合。从图6f中可以观察到,本文Fast-Unet模型更关注于作物垄间导航路径内的特征,该优势来源于对Unet的结构优化,去除了大量的特征图,仅保留了最重要的特征提取器,因此对特征的读取也更接近图6b的人工标签及图6a的路径弯曲特征。

为了验证模型在多种作物垄间导航路径的识别与分割,以场景最为复杂的棉花垄间导航路径数据集作为源域,向场景相对简单的玉米与甘蔗导航路径数据集的目标域上迁移。迁移学习时训练的Fast-Unet的损失数如图 7所示。

由图7中可以观察到,不论是玉米导航路径还是甘蔗导航路径,迁移学习过程的初始损失值都远低于非迁移学习过程的初始损失值,并且迁移学习中训练集与验证集的损失值差距小于非迁移数据集。此外,在使用迁移学习的过程中,模型损失函数在第30次迭代前基本收敛。

在非迁移学习情况下,验证集的损失函数值在第70次迭代后才开始快速下降,而第70次迭代时模型的训练学习率调整降至最低的0.000 1。低学习率训练的主要目的是对模型进行微调,进一步改进其性能。而在非迁移学习的环境中,最低学习率的步骤却起到了降低损失函数值的主导作用。本文迁移学习所用的目标域数据集较小,该现象很可能是源于模型对数据中非关键特征产生过拟合现象。本文对各模型识别过程使用Grad-CAM,对识别特征进行可视化,进而继续解释模型的关注重点。

从可视化结果(图8)可以发现,迁移学习模型与直接训练模型的最终关注点存在较大的差异。首先从图8f和图8h观察到,基于迁移学习的方法拥有较大的激活区域,且激活的区域基本与识别的主干道路匹配,从甘蔗导航路径Grad-CAM(图8h)中可以观察到,周边的垄间导航路径也同样被关注,代表本文模型的输出结果是先识别出所有的导航路径后再进行选择需要输出的部分。而从图8e和图8g中可以观察到,直接由小样本训练产生的模型则关注图像的中下部位,玉米垄间路径识别的强度较高,模型有过拟合可能,甘蔗导航路径识别的总体信号则偏弱,模型对关键信息提取不足。

对预测结果的二值化图进行观察发现,图8f相较于图8e与图8b的标签更接近,图8h相较于图8g与标注的道路数据真值更为相似。更适合作为导航路径。

3.3 模型性能验证

以棉花棉花垄间导航路径数据集以96×96(像素)的RGB图片作为输入,试验结果如表2所示。可以看出,Unet网络在精度、推理速度、模型参数量3个方面相较于FCN具有一定的优势。Unet网络的平均交并比、推理速度分别为0.805、9.98帧/s,相对于FCN模型分别提高4.14%和34.50%;Unet网络的模型参数量为7.85×106,相较于FCN网络减少了60.95%。

本文Fast-Unet模型在精度上高于FCN但是略低于Unet,而模型参数量仅为Unet网络的6.24%。在单个CPU核上的推理速度是Unet网络的6.48倍。

表2 模型性能对比

基于棉花垄间导航路径数据集训练的Fast-Unet模型迁移学习后在玉米和甘蔗数据集的模型精度表现如下表 3所示。

表3 Fast-Unet迁移学习MIoU结果比较

甘蔗与玉米导航路径数据集在使用迁移学习方法训练所得模型的MIoU都优于非迁移学习训练模型。在SegNet、FCN、Unet网络中,甘蔗导航路径迁移学习的MIoU相较非迁移学习分别提升214.97%、435.63%、275.38%;玉米导航路径迁移学习的MIoU相较非迁移学习分别提升56.64%、21.05%、10.16%。在迁移学习后,本文Fast-Unet模型和Unet模型的MIoU仍处于类似水平。在识别难度相对较低的甘蔗导航路径场景中,Fast-Unet在迁移学习与非迁移学习中都取得了更高MIoU,相较于Unet分别提升了0.43%、38.77%。

3.4 导航线提取结果

棉花田垄间的导航因为存在小场景内道路曲折的问题,不适宜使用最小二乘回归方法生成导航的回归线并计算偏航角,针对此类情况,直接选取生成路径的中线。甘蔗与玉米的导航线提取结果具体如表4所示。

表4 各种模型对不同作物条件下的偏航角统计

从表4可以看出,Unet与Fast-Unet的导航性能基本没有差异,导航线的精度表现与导航路径的MIoU的结果类似。Unet与Fast-Unet模型在甘蔗和玉米田的偏航角平均仅相差0.066、0.003。

此外,本文的甘蔗导航路径识别因为自身特征明显,所以相较于玉米导航路径识别精度更高。而大部分作物垄间导航路径的识别难度在甘蔗导航路径识别与玉米导航路径识别之间,因此可以推断本文提出的Fast-Unet模型在迁移学习的条件下能够准确识别其他类别作物的导航路径并计算偏航角。

4 结 论

本研究针对智能农业装备在田垄间作业的导航问题,在语义分割算法Unet的基础上通过剪枝与优化模型结构提出了Fast-Unet模型。并通过迁移学习实现在棉花、甘蔗以及玉米3种作物在田间自然光照及作物遮挡道路条件下的垄间导航路径的有效识别。主要结论如下:

1)本研究在Unet的基础上提出了Fast-Unet模型,模型对棉花、玉米、甘蔗导航路径识别精度MIoU分别为0.791、0.881和0.940,在保证精度的前提下,Fast-Unet模型的参数数量为Unet的6.24%,推理速度为Unet的6.48倍,单核CPU的处理速度为64.47 帧/s,满足嵌入式环境下的实时性需求。

2)使用迁移学习将在大样本棉花数据集上训练完成的模型迁移至甘蔗和玉米的小样本数据集。验证通过小样本迁移学习进行拓展作物适用范围的可行性,提出了垄间导航路径识别的通用方法。

3)采用Grad-CAM方法对研究过程中的模型差异及是否使用迁移学习进行可视化解释,讨论了不同模型架构在进行导航路径识别时的差异来源。从激活区域的位置与强度出发进一步解释了模型的关注点,验证了Fast-Unet设计思路的合理性。通过Grad-CAM解决了深度学习语义分割算法在作物垄间导航路径识别过程中难以得到较好解释的问题。

4)通过Canny边缘检测从模型识别的导航路径中提取出导航路径中线,作为农机导航线。对于甘蔗及玉米等导航路径以直线为主的场景,将农机导航线通过最小二乘法回归即可计算出农机在田间移动时所需的偏航角。

[1] 张漫,季宇寒,李世超,等. 农业机械导航技术研究进展[J]. 农业机械学报,2020,51(4):1-18.

Zhang Man, Ji Yuhan, Li Shichao, et al. Research progress of agricultural machinery navigation technology[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(4): 1-18. (in Chinese with English abstract)

[2] 胡静涛,高雷,白晓平,等. 农业机械自动导航技术研究进展[J]. 农业工程学报,2015,31(10):1-10.

Hu Jingtao, Gao Lei, Bai Xiaoping, et al. Review of research on automatic guidance of agricultural vehicles[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2015, 31(10): 1-10. (in Chinese with English abstract)

[3] Gao X, Li J, Fan L. Review of wheeled mobile robots' navigation problems and application prospects in agriculture[J]. IEEE Access, 2018, 6: 49248-68.

[4] 张雄楚. 棉花铺膜播种作业拖拉机视觉导航路径检测与控制算法研究[D]. 石河子;石河子大学,2019.

Zhang Xiongchu. Study on the Visual Navigation Path Detection and Control Algorithm of the Tractor in Cotton Film-Spreading Operation[D]. Shihezi: Shihezi University, 2019. (in Chinese with English abstract)

[5] 孟庆宽,张漫,仇瑞承,等. 基于改进遗传算法的农机具视觉导航线检测[J]. 农业机械学报,2014,45(10):39-46.

Meng Qingkuan, Zhang Man, Qiu Ruicheng, et al. Navigation line detection for farm machinery based on Improved genetic algorithm[J]. Transactions of the Chinese Society for Agricultural Machinery, 2014, 45(10): 39-46. (in Chinese with English abstract)

[6] 宫金良,王祥祥,张彦斐,等. 基于边缘检测和区域定位的玉米根茎导航线提取方法[J]. 农业机械学报,2020,51(10):26-33.

Gong Jinliang, Wang Xiangxiang, Zhang Yanfei, et al. Extraction method of corn rhizome navigation lines based on edge detection and area localization[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(10): 26-33. (in Chinese with English abstract)

[7] 张雄楚,陈兵旗,李景彬,等. 红枣收获机视觉导航路径检测[J]. 农业工程学报,2020,36(13):133-40.

Zhang Xiongchu, Chen Bingqi, Li Jingbin, et al. Path detection of visual navigation for jujube harvesters[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(13): 133-40. (in Chinese with English abstract)

[8] 刘路,潘艳娟,陈志健,等. 高遮挡环境下玉米植保机器人作物行间导航研究[J]. 农业机械学报,2020,51(10):18-24.

Liu Lu, Pan Yanjuan, Chen Zhijian, et al. Inter-rows navigation method for corn crop protection vehicles under high occlusion environment[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(10): 18-24. (in Chinese with English abstract)

[9] 宋怀波,何东健,辛湘俊. 基于机器视觉的非结构化道路检测与障碍物识别方法[J]. 农业工程学报,2011,27(6):225-230.

Song Huaibo, He Dongjian, Xin Xiangjun. Unstructured road detection and obstacle recognition algorithm based on machine vision[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2011, 27(6): 225-230. (in Chinese with English abstract)

[10] 赵立明,叶川,张毅,等. 非结构化环境下机器人视觉导航的路径识别方法[J]. 光学学报,2018,38(8):267-276.

Zhao Liming, Ye Chuan, Zhang Yi, et al. Path recognition method of robot vision navigation in unstructured environments[J]. Acta Optica Sinica, 2018, 38(8): 267-276. (in Chinese with English abstract)

[11] 吕艳鹏,潘玉田. 基于BP神经网络的非结构化道路识别[J]. 机械工程与自动化,2014(3):178-180.

Lv Yanpeng, Pan Yutian. Unstructured road detection based on BP neural network[J]. Mechanical Engineering & Automation, 2014(3): 178-180. (in Chinese with English abstract)

[12] 韩树丰,何勇,方慧. 农机自动导航及无人驾驶车辆的发展综述[J]. 浙江大学学报:农业与生命科学版,2018,44(4):381-391,515.

Han Shufeng, He Yong, Fang Hui. Recent development in automatic guidance and autonomous vehicle for agriculture: A review[J]. Journal of Zhejiang University: Agriculture & Life Sciences, 2018, 44(4): 381-391, 515. (in English with Chinese abstract)

[13] Lin Y, Chen S. Development of navigation system for tea field machine using semantic segmentation[J]. IFAC PapersOnLine, 2019, 52(30): 108-113.

[14] 李云伍,徐俊杰,王铭枫,等. 丘陵山区田间道路自主行驶转运车及其视觉导航系统研制[J]. 农业工程学报,2019,35(1):52-61.

Li Yunwu, Yu Junjie, Wang Mingfeng, et al. Development of autonomous driving transfer trolley on field roads and its visual navigation system for hilly areas[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(1): 52-61. (in Chinese with English abstract)

[15] 杨洋,张博立,查家翼,等. 玉米行间导航线实时提取[J]. 农业工程学报,2020,36(12):162-171.

Yang Yang, Zhang Boli, Zha Jiayi, et al. Real-time extraction of navigation line between corn rows[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(12): 162-171. (in Chinese with English abstract)

[16] Lecun Y, Bengio Y, Hinton G. Deep learning[J]. Nature, 2015, 521(7553): 436.

[17] Saleem M, Potgieter J, Arif K. Automation in agriculture by machine and deep learning techniques: a review of recent developments[J]. Precision Agriculture, 2021, 22(6), 2253-2091.

[18] Kamilaris A, Prenafeta-boldú F. A review of the use of convolutional neural networks in agriculture[J]. The Journal of Agricultural Science, 2018, 156(3): 312-322.

[19] 钟昌源,胡泽林,李淼,等. 基于分组注意力模块的实时农作物病害叶片语义分割模型[J]. 农业工程学报,2021,37(4):208-215.

Zhong Changyuan, Hu Zelin, Li Miao, et al. Real-time semantic segmentation model for crop disease leaves using group attention module[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(4): 208-215. (in Chinese with English abstract)

[20] 张新钰,高洪波,赵建辉,等. 基于深度学习的自动驾驶技术综述[J]. 清华大学学报:自然科学版,2018,58(4):438-444.

Zhang Xinyu, Gao Hongbo, Zhao Jianhui, et al. Overview of deep learning intelligent driving methods[J]. Journal of Tsinghua University: Science and Technology, 2018, 58(4): 438-444. (in Chinese with English abstract)

[21] Lin J, Wang W, HuangS, et al. Learning based semantic segmentation for robot navigation in outdoor environment[C]// Proceedings of the Joint World Congress of International Fuzzy Systems Association & International Conference on Soft Computing & Intelligent Systems, F, 2017.

[22] 宋广虎,冯全,海洋,等. 采用深度学习法优化的葡萄园行间路径检测[J]. 林业机械与木工设备,2019,47(7):24-28.

Song Guanghu, Feng Quan, Hai Yang, et al. Vineyard inter-row path detection based on deep learning[J]. Forestry Machinery & Woodworking Equipment, 2019, 47 (7): 24-28. (in Chinese with English abstract)

[23] Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 39(4): 640-651.

[24] 李云伍,徐俊杰,刘得雄,等. 基于改进空洞卷积神经网络的丘陵山区田间道路场景识别[J]. 农业工程学报,2019,35(7):150-159.

Li Yunwu, Xu Junjie, Liu Dexiong, et al. Field road scene recognition in hilly regions based on improved dilated convolutional networks[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(7): 150-159. (in Chinese with English abstract)

[25] Badrinarayanan V, Kendall A, Cipolla R. SegNet: A deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 2017, 39(12): 2481-2495.

[26] Ronneberger O, Fischer P, Brox T. U-net: convolutional networks for biomedical image segmentation[J]. Springer International Publishing, 2015, 9351: 234-241.

[27] Selvarajur R, Cogswell M, Das A, et al. Grad-CAM: Visual explanations from deep networks via gradient-based localization[J]. International Journal of Computer Vision, 2020, 128(2): 336-359.

[28] 胡涛,李卫华,秦先祥. 图像语义分割方法综述[J]. 测控技术,2019,38(7):8-12.

Hu Tao, Li Weihua, Qin Xianxiang. A review on image semantic segmentation[J]. Measurement & Control Technology, 2019, 38(7): 8-12. (in Chinese with English abstract)

[29] Bosilj P, Aptoula E, Duckett T, et al. Transfer learning between crop types for semantic segmentation of crops versus weeds in precision agriculture[J]. Journal of Field Robotics, 2020, 37(1): 7-19.

Navigation path recognition between crop ridges based on semantic segmentation

Rao Xiuqin1,2, Zhu Yihang1,2, Zhang Yanning1,2, Yang Haitao3, Zhang Xiaomin1,2, Lin Yangyang1,2, Geng Jinfeng1,4,5, Ying Yibin1,2

(1.,,310058,; 2.,,310058,; 3.,,310058,; 4.,,277101,; 5..,.,321300,)

A navigation path has been widely considered as one of the most important sub-tasks of intelligent agricultural equipment in field operations. However, there are still some challenges remaining on the recognition of current navigation paths between crop ridges, including the accuracy, real-time performance, generalization, and difficulty in the interpretation of deep learning models. In this research, a new Fast-Unet model was proposed to accurately and rapidly recognize the navigation path between crop ridges using semantic segmentation. The jump connection of the Unet model was also retained to generate the navigation line and yaw angle using the least square regression. Specifically, a cotton dataset of inter-ridge navigation path consisted of 800 images, 640 of which was set as the training set, 160 of that as the validation set. Subsequently, two datasets of 100 images each were constructed for the navigation paths of sugarcane and cotton ridges, which were divided into 50 images in the training set, and 50 images in the verification set. The training strategy was selected as the data augmentation and learning rate adjustment. The training order was ranked as the corn first, and then the sugarcane dataset. The Mean Intersection over Union (MIoU) was utilized as the accuracy indicator of the Fast-Unet model, which was 0.791 for cotton, 0.881 for maize, and 0.940 for sugarcane. Furthermore, the least-squares regression was selected to calculate the navigation path of maize and sugarcane with good linearity between the ridges. Additionally, the navigation line was selected to further calculate the yaw angle. The mean difference between the predicted yaw angle of maize and sugarcane navigation path and the labeled were 0.999° and 0.376° under the Fast-Unet model, respectively. In terms of real-time performance, the inference speed of the Fast-Unet model was 6.48 times higher than that of Unet. The inference speed was 64.67 frames per second to process the RGB image data on a single-core CPU, while the number of parameters of the Fast-Unet model was 6.24% of that of Unet model. Correspondingly, the computing devices were deployed with weak computing power, thereby performing real-time calculations. A gradient weighted class activation mapping(Grad-CAM) was also used to visually represent the final feature extraction of model recognition and transfer learning. More importantly, the special features were highlighted on the navigation path between crop ridges in the optimized Fast-Unet structure, concurrently to remove a large number of redundant feature maps, while retaining only the most crucial feature extractors. The transfer learning also presented a larger activation area than the direct training, where the activated area matched the main road to be identified. In summary, the improved model can be fully realized the real-time recognition of maize navigation path. The finding can also provide technical and theoretical support to the development of navigation equipment for intelligent agricultural machinery in the field.

image processing; navigation; path recognition; semantic segmentation; transfer learning; deep learning

饶秀勤,朱逸航,张延宁,等. 基于语义分割的作物垄间导航路径识别[J]. 农业工程学报,2021,37(20):179-186.doi:10.11975/j.issn.1002-6819.2021.20.020 http://www.tcsae.org

Rao Xiuqin, Zhu Yihang, Zhang Yanning, et al. Navigation path recognition between crop ridges based on semantic segmentation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(20): 179-186. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.20.020 http://www.tcsae.org

2021-06-10

2021-08-05

国家重点研发计划(2017YFD0700901)

饶秀勤,博士,教授,博士生导师,研究方向为智能农业装备。Email:xqrao@zju.edu.cn

10.11975/j.issn.1002-6819.2021.20.020

S24

A

1002-6819(2021)-20-0179-08