基于TMS320的无人智能车编队协同控制系统

马 浩,张耀忠,肖广兵

(1南京林业大学 汽车与交通工程学院,南京210037;2江苏第二师范学院后期服务总公司运输服务公司,南京210013)

0 引 言

无人车系统作为较早被应用的智能交通运输系统之一,已在道路运输及仓储环节中初具使用规模[1]。但现有无人车系统由于智能化程度较低、协同控制策略不够完善等原因,造成柔性编队稳定性较差、鲁棒性较低、稳态间距与速度跟踪误差较大,使车队协同控制精度较低、反应不灵敏、无法应用于较复杂的道路车辆场景。目前国内对于无人车系统的研究方向比较分散,未能形成一套全面的系统设计与配套软硬件整合,解决无人车系统协同控制实效性较低的问题[2]。

本文设计了一种基于TMS320单片机的无人智能车编队协同控制系统,系统通过硬件模块完成VANET背景下的车队自主环境感知,信息处理,决策规划与协同控制,完成编组整合。可进行协同控制的柔性车队相对于单车或者分散车队行驶具有更高的安全性,并且可减小空气阻力,节约能源,车队在协同控制的决策规划中与机器学习数据库不断交互,按场景决策准则处理解算运动参数,通过训练数据不断优化场景策略,MPC自适应控制器可以实现对指标和系统约束的双重设计、实现纵向控制与横向变道控制切换应用。同时,对不确定运行阻力通过RBF神经网络进行学习,车辆与车队的关键实时信息通过4G远程监控网同步传输至上位机管理界面,实现无人车的智能化协同控制与管理,从一定程度上提高无人车系统的实效性。

1 系统模型

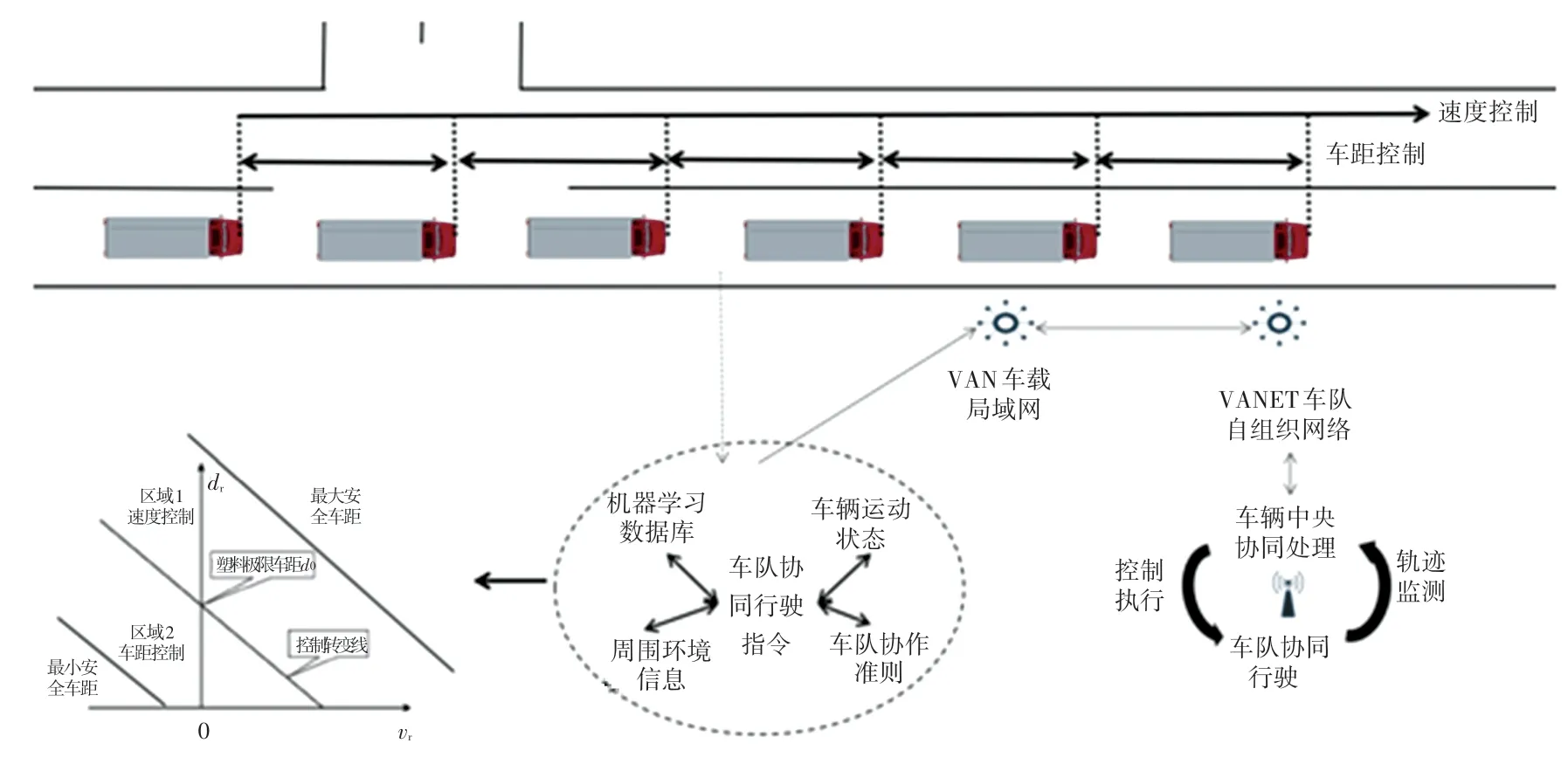

本系统以TMS320单片机为核心,由无线通信模块搭建的VANET车队自组网与远程监控网络组成,如图1所示。通过车载传感器可以融合感知车辆运动状态、位置坐标以及道路环境等信息,并进行车队广播共享;通过中央信息处理模块与DRL数据库交互,按场景决策准则处理解算运动参数;使用确定性策略梯度与DQN的深度强化学习方法,通过训练数据不断优化场景策略,进而对约束柔性车队协同行驶进行最优决策规划,实时自动匹配速度期望与车距期望;通过车辆控制模块的MPC自适应控制器完成车队最优协同控制;面将车队关键信息与道路环境信息实时传输至上位机管理界面,管理人员可实时监测车队状态,或对车队下达调整指令。

图1 系结构图Fig.1 System structure diagram

2 硬件电路设计

无人智能车协同控制系统硬件电路主要包括:供电模块,融合传感器模块,定位模块,中央信息处理模块,无线通信模块,车辆控制模块组成。

2.1 供电模块设计

考虑到系统各硬件电路模块运行需要1.8~6.0 V电压,供电模块采用车载12.0 V镍氢蓄电池组为电源,一路由TPS767电源管理芯片控制的电路完成稳压调节,电平转换[1]。将12.0V电压转化为1.8 V、3.3 V电压,为中央信息处理模块供电,一路由LT8705高性能降压-升压型开关稳压控制器为各模块提供与之需求相匹配的稳定电压输出。

2.2 融合传感器模块

本模块采用机器视觉与激光雷达融合的技术方案,通过BP神经网络模型算法完成数据转换以及融合推理,实现环境感知信息融合互补,弥补单一传感器采样精度较低,感知范围较小、稳定性较差、使用条件受限的缺陷。

融合传感器选用FQY888A型CCD摄像头与HDL32E激光雷达。FQY888A分辨率为350线,可输出制式PAL/NTSC标准视频信号至LM1881芯片进行视频同步信号分离,结合图像信号由单片机完成解析处理得到路径数据。HDL32E激光雷达共有32线激光扫描束,垂直方向可视范围41.3°,水平视野360°,角度分辨率0.09°,距离精度2 cm,如图2所示。可实现较全面的高精度实时环境感知。

图2 HDL32E激光雷达电路Fig.2 HDL32E Lidar circuit

2.3 综合定位模块

本模块采用GPS定位,SLAM并发建图与定位结合的技术方案。如图3所示,GPS接收机选用的LEA-5X模组,首次定位时间小于1 sec,最大更新速率小于4 Hz,定位精度Auto小于2.5 m,SBAX小于2 m,定时精度RMS 50 ns。对车辆位置的绝对坐标定位精度较高,稳定性强[3]。SLAM进程通过融合传感器采集的车辆运动信息和未知环境的特征信息,利用基于深度学习算法层次化图像特征提取方法完成帧间估计与闭环检测,实现对车辆以及车队位姿的精确估计以及场景的空间建模[4]。

图3 GPS定位模组电路Fig.3 GPS positioning module circuit

来自GPS的车辆位置坐标信息与来自SLAM过程的车辆以及车队位姿的精确估计,以及场景的空间建模信息在贝叶斯定位融合算法下,完成混合交互、并行滤波、概率更新、融合输出,为协同控制提供较为精准的动态车辆定位信息。

2.4 无线通信模块

本模块采用4G与DSRC结合的技术方案。利用4G传输速率高,传输距离远,网络连接稳定的特点搭建远程监控网,实现车辆车队与上位机管理界面的关键信息实时同步传输。利用DSRC延迟低、传输速率较快、在车辆网络的拓扑结构频繁变化的情况下可提供高效、稳定的资源共享和信息交互的特点[5],搭建VAN车载局域网与VANET车队自组织网络,通过自适应数据广播算法,车载终端广播数据包的频率可根据当前传输延时和数据丢包率动态调整,完成单车信息融合与车队信息广播共享[6]。

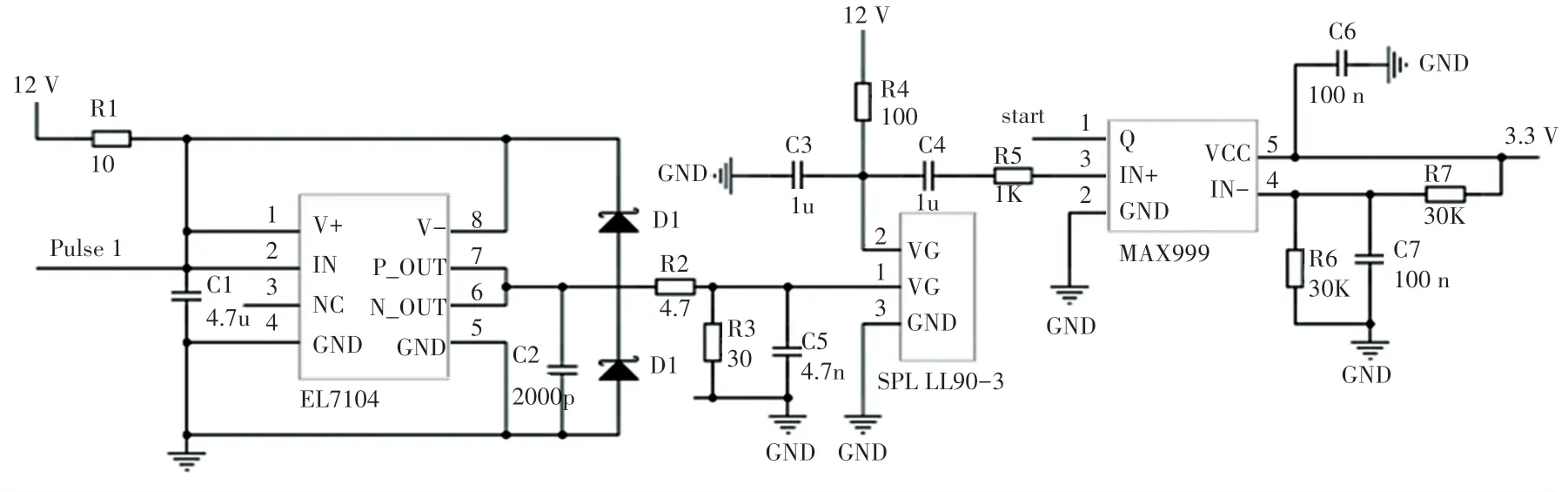

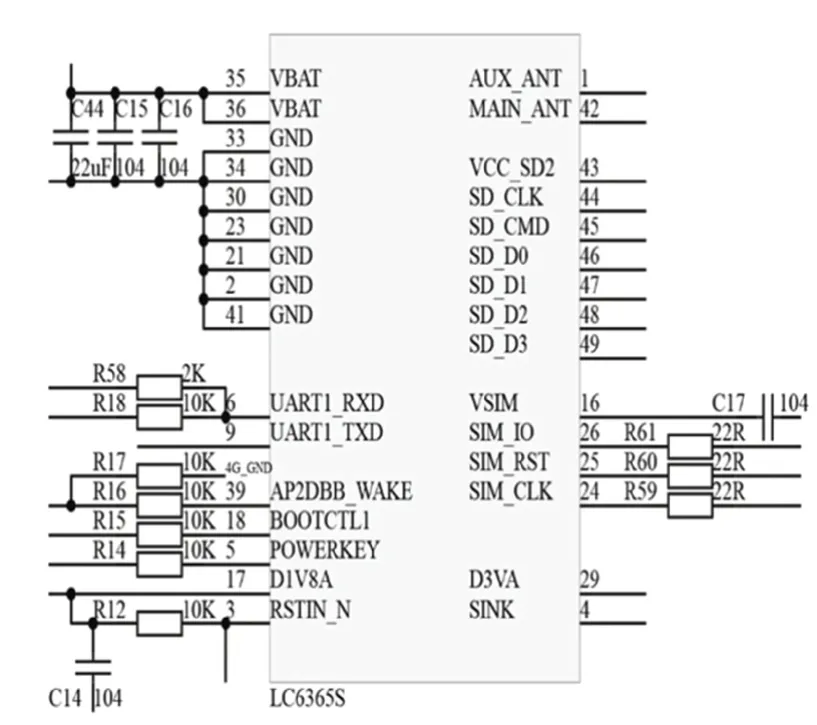

如图4所示,4G传输选用LC6365S模块,支持TD-LTE、HSPA、GGE三模通信,上行最大速率50 Mbps,下行最大速率150 Mbps,可完成指令、数据、语音信号及控制信号的双向快速传输,实现车辆车队与上位机管理界面实时数据传输与指令传达。DSRC选用的STR715FR0模块,数据传输速率6~27 Mbps,接收灵敏度-90 dBm,在自适应数据广播算法下搭建的VAN车载局域网与VANET车队自组织网络,可完成各模块与传感器采集信息的融合与车队信息广播共享。

图4 4G通信模组电路Fig.4 4G communication module circuit

2.5 中央信息处理模块

本模块采用TMS320单片机作为信息处理、决策规划的核心。TMS320多核DSP支持定点、浮点运算,内部集成8个C66x内核,每个内核频率最高可达1.4 GHz,如图5所示。在DSP芯片主频为1.4 GHz时,单 个C66x内 核 定 点 运 算 能 力 为44.8 GMAC,浮点运算能力为22.4 GFLOP,理论上可实现358.4 GMAC/s或179.2 GFLOP/s的处理能力[7](内核频率为1.4 GHz)。

图5 TMS320最小系统电路Fig.5 TMS320 minimum system circuit

通过中央信息处理模块与DRL数据库交互,执行库中当前场景下的最优决策准则,完成车辆及车队各项运动数据的处理与解算。同时在交互过程中,DRL可以利用深度和强化学习各自的优势处理决策,控制问题中的高维状态空间和离散、连续动作空间:深度学习负责复杂驾驶场景的感知和特征提取;强化学习则通过马尔可夫决策过程完成推理、判断和决策[8]。DRL可以学习如何在复杂的驾驶场景中进行自主感知和决策控制,使其成为了实现全自主智能车辆的可行方案之一,并使用确定性策略梯度与DQN的深度强化学习方法通过训练数据不断优化场景策略,进而对约束柔性车队协同行驶进行最优决策规划,实时自动匹配速度期望与车距期望。

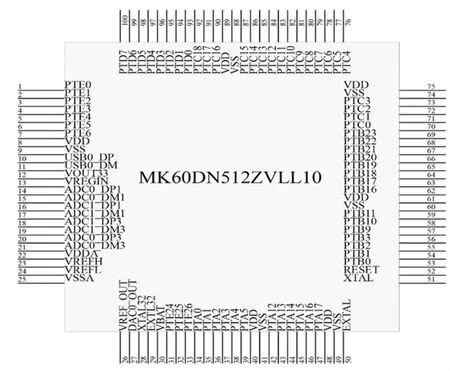

2.6 运动控制模块

如图6所示,本模块采用以K60单片机为核心的MPC模型预测自适应控制器。通过状态空间模型建立起来约束预测控制,K60单片机可实现从基本原理到算法和约束条件的分析与选择[9]。预测控制分为三部分,根据当前运动状态参量预测系统未来动态;根据确定的算法和约束条件求解优化问题、解的第一个元素重新作用于系统,如此往复进行,推导出基于状态空间模型的预测方程,依次给出优化问题描述,求解。根据MPC基本原理,在自适应式协同控制系统中,根据跟车纵向运动学模型,可以预测在未来时刻内实际的两车间距以及相对速度的大小,将该预测值与期望值进行比较便可以求得最优的控制序列[10]。

图6 K60最小系统电路Fig.6 K60 minimum system circuit

3 系统软件设计

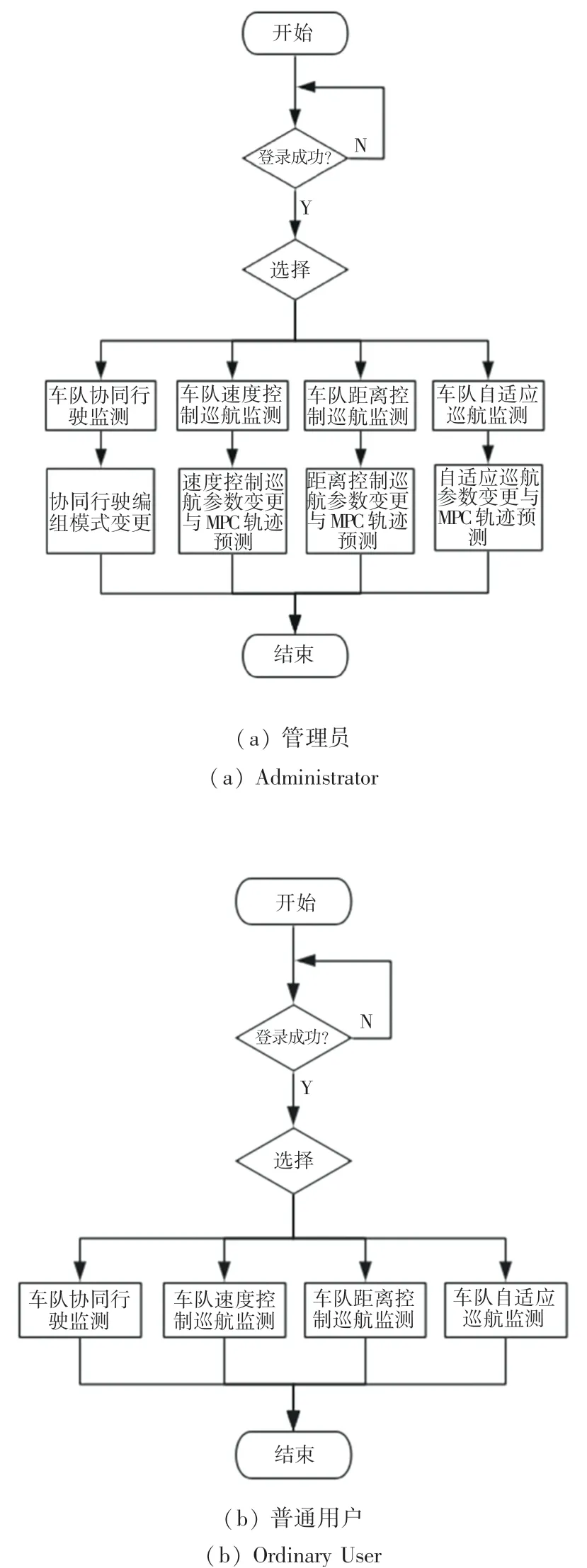

软件设计选用Visual Basic 6.0软件,搭建无人智能物流车编队汇入控制与管理系统的界面如图7所示。

图7 软件主界面Fig.7 Software main interface

软件主界面由车队协同行驶控制,车队速度控制巡航,车队车距控制巡航,车队自适应巡航,问题反馈,个性化设置6个区域组成。普通用户身份可使用车队巡航状态查询,车队运动状态监测,VANET网络运行监测,查看SLAM三维地图等功能;管理员身份在此基础上可使用车队速度控制巡航,车队车距控制巡航,车队自适应巡航等功能。图8为软件流程图,该系统软件按需求分为管理人员、普通用户两种登录身份。

图8 系统软件流程图Fig.8 System software flow char

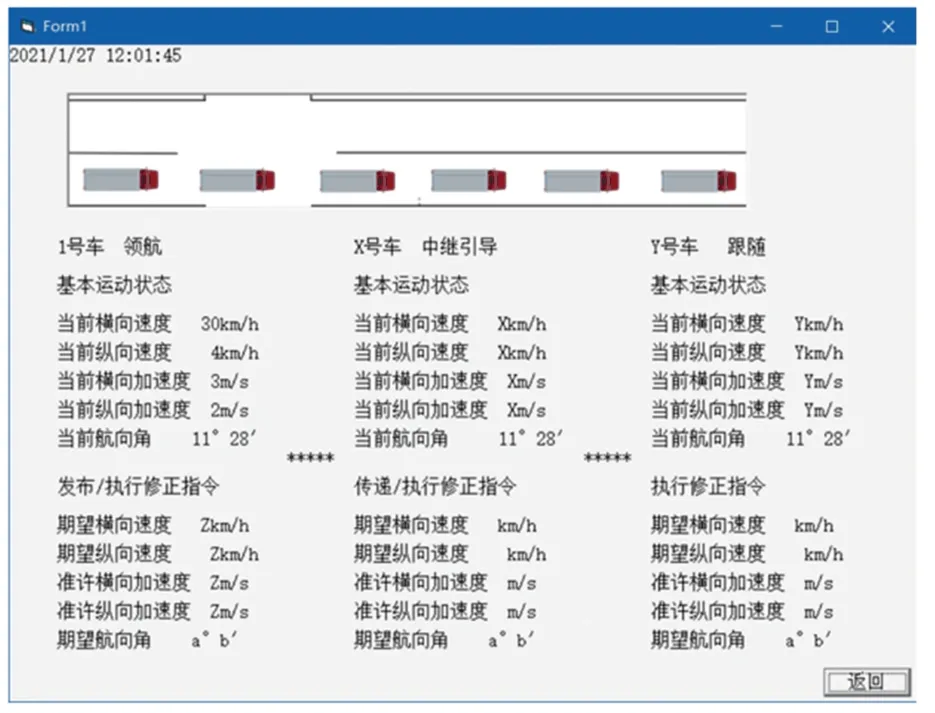

管理人员通过车队协同行驶界面主要监测由车载单元实时上传的车辆及车队横纵向速度、加速度,航向角,期望修正量等运动状态数据,并可将各个节点数字化数据按时间展开,绘制监测图像,如图9所示。同时,该界面可观测车队VANET自组织网络的运行情况,监测平均吞吐量、平均通讯延迟、丢包率等关键指标,也可查询车队车辆构建的SLAM三维地图。

图9 车队协同行驶控制Fig.9 Synergistic driving control of the fleet

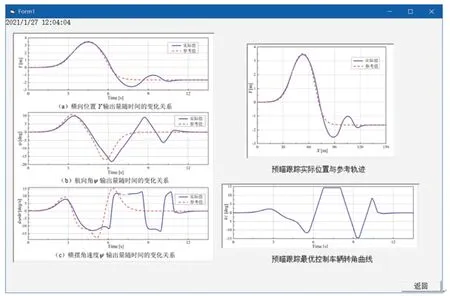

在车队速度控制界面,管理人员可对速度控制巡航车队的速度相关约束参数进行调整,在车队安全速度、加速度、车距范围内,可设置协同控制期望车速,修改车距变化范围与加速度变化范围,通过MPC轨迹预测控制界面,对车队速度相关约束参数调整后的各节点的实际运动变化量与期望运动变化量进行对比,并按时间展开为轨迹监测图像,如图10所示。对照显示偏差量,为进一步调整提供分析依据。

图10 车队速度控制Fig.10 Fleet speed control

在车队车距控制界面,管理人员可对车距控制巡航车队的距离相关约束参数进行调整,在车队安全速度、加速度、车距范围内,可设置协同控制期望车距,修改车速变化范围与加速度变化范围,通过MPC轨迹预测控制界面,对车队车距相关关键约束参数调整后的各节点的实际运动变化量与期望运动变化量进行对比,并按时间展开为轨迹监测图像,对照显示偏差量,如图11所示,为评估车队协同控制的安全性提供分析依据。

图11 车队车距控制Fig.11 Fleet distance control

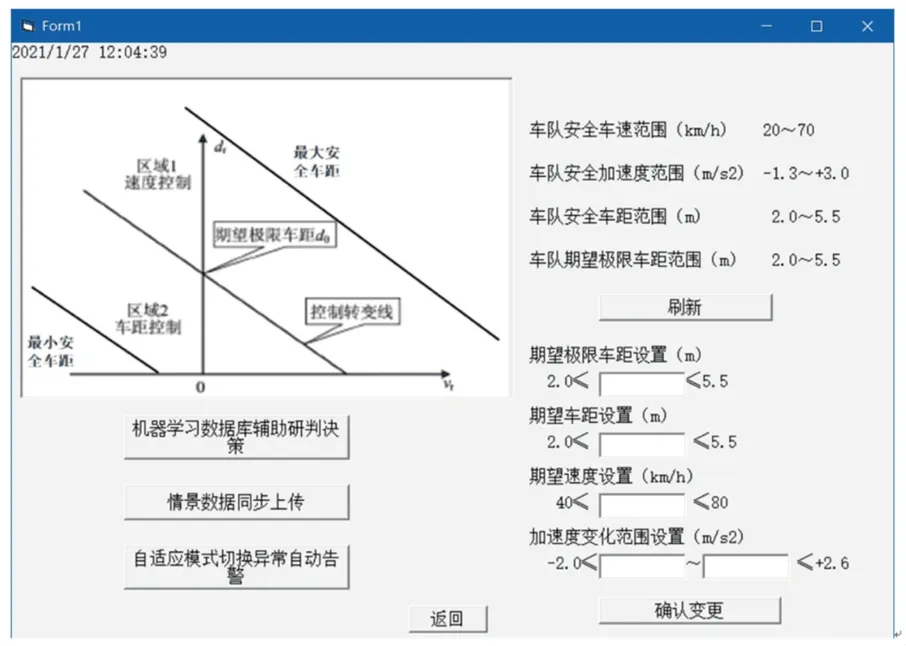

如图12所示,车队自适应转变线公式为:dr=kv+d其中,k为转变线的斜率,d为期望极限车距,即当前车和后车速度相等时的车距。可通过设定d和k来确定转变线公式[11]。在此界面,管理人员可对采用自适应控制巡航车队的距离和速度相关约束参数进行调整,在车队安全速度、加速度、车距范围内,可设置协同控制期望车距与速度,修改加速度变化范围,通过MPC轨迹预测控制界面,对约束参数调整后的各节点的实际运动变化量与期望运动变化量进行对比,并按时间展开为轨迹监测图像,对照显示偏差量,为评估车队协同控制的安全性提供分析依据。

图12 车队自适应控制Fig.12 Adaptive fleet control

4 结束语

本文设计的无人智能车编队协同控制系统以TMS320单片机为核心。系统通过硬件模块完成VANET背景下的车队自主环境感知,信息处理,决策规划与协同控制,同时车辆与车队的关键信息通过4G远程监控网实时传输至上位机管理界面,实现无人车队的智能化编队协同控制,在一定程度上解决了目前无人车系统智能化程度较低、协同控制策略不够完善造成柔性编队稳定性较差、鲁棒性较低、稳态间距与速度跟踪误差较大等问题,提高了无人车系统的实效性。