基于MATLAB图像处理的苹果大小、颜色、圆形度及缺陷度特征融合分级研究*

任龙龙 冯涛 翟传龙 宋月鹏

(1.山东农业大学机械与电子工程学院,山东泰安 271018;2.山东省园艺机械与装备重点实验室,山东泰安 271018)

0 引言

以往苹果分级多采用人工分级和机械分级,效率低、精度低。本文利用MATLAB图像处理技术设计了一个程序,能够高精度地识别苹果表面图像的大小、颜色、形状和缺陷程度数据,成功地实现了苹果的自动分级。

Bhatt等[1]建立基于机器视觉和人工神经网络的苹果分级系统,其具有较好的性能。Sofu M等[2]依据苹果的颜色,大小及重量特征将苹果分成不同的等级,设计了苹果在线分拣系统,在对183个样本进行了测试之后,得到分级的准确率在73%到96%之间。杨小青等[3]利用像素点变换法计算苹果的表面积以及着色比,依据此来判断苹果等级。黄兆良等[4]经过在苹果RGB图像上进行阙值分割,之后采用超红—超绿阙值分割来计算苹果的着色面积,最后分级准确率达到90%以上。邱光应等[5]把果梗花萼以及缺陷的颜色、纹理及形状作为特征,使用决策向量机进行三者区分,最终识别正确率达到97.7%。黄辰等[6]利用苹果的果径、色泽和缺陷面积通过判别树进行了初步的分级,又使用果形、纹理和颜色分布特征通过了粒子群优化的支持向量机进行再次分级,最后把两种模型结果进行决策融合,得到最终的分级结果。郑羽纶等[7]在对苹果的分级中,首先利用支持向量机模型区分了缺陷果和完好果,然后在对完好果分级时,分别进行了单一特征下的分级,又利用了多特征组合下利用K-最近邻、BP神经网络和支持向量机算法的分级,为提高分级准确率,提出多特征多分类器融合的分级方法,最终分级准确率达到了90.2%。

本文以红富士苹果为研究对象,设计了基于MATLAB图像处理的苹果分级检测系统。在总结国内外研究成果的基础上,选择了高速、高可靠性的方法。该系统包括图像采集、图像预处理、特征提取和苹果分级。在对苹果进行分级时,主要依据苹果的大小特征、红色着色率即颜色特性、苹果圆形度还有缺陷度进行分级。

1 苹果分级系统的框架

1.1 苹果分级系统基本框架

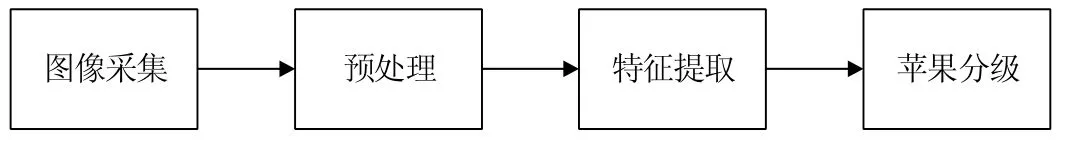

苹果分级研究具体过程框架如图1所示。

图1 苹果分级框架Fig.1 Apple grading framework

1.2 苹果分级的总体流程

(1)图像采集:苹果图像采集工作是将苹果样本放在相同的背景和光照条件下进行拍摄,拍照获得每个苹果的正视图还有俯视图图像。(2)图像预处理:灰度化处理、图像阈值分割、形态学降噪、边缘检测。(3)特征提取:大小、颜色、缺陷度以及圆形度。(4)苹果分级:综合得到的四种特征根据苹果分级标准进行苹果分级。

1.3 算法介绍

利用MATLAB进行图像处理工作,得到苹果表面四种特征数据,综合以上特征数据进行了苹果样本分级,并且设计了特别设计了用户交互界面方便操作,最终分级准确率在75%左右。

2 苹果图像预处理

2.1 灰度化处理

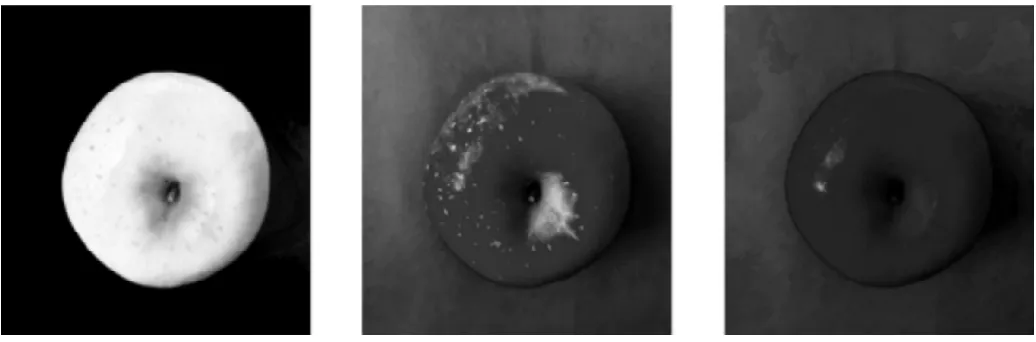

对于采集到的苹果图像,一个合适的颜色模型会使得图像的目标与背景更易分离,在RGB模型下分别提取各个分量下的苹果图像,结果如图2所示。

图2 RGB模型下各分量图Fig.2 Diagram of each component under the RGB model

在RGB模型下的各分量图中,R分量图效果较好,更适合进行图像分割。

苹果图像在HSI模型下的各分量图如图3所示。

图3 HSI模型下各分量图Fig.3 Diagram of each component under the HSI model

在I分量下的图像,苹果目标与背景区分明显,易于图像分割处理。综上所述,R分量图和I分量图均能很好的进行图像分割。

2.2 图像分割

图像分割就是对采集到的图像进行目标和背景的分割,最终得到像素值为1的目标区域和像素值为0的背景区域。对于苹果图像,目标区域是苹果样本,其余区域是背景区域。图像分割需要从整个图像中提取完整的苹果样本。

QTSU法分割效果较好,被广泛应用,因此最终使用QTSU法来进行苹果图像分割处理。

苹果R分量图和I分量图更适宜进行图像分割,在两种分量图和灰度图三种形式下使用QTSU法进行苹果目标与背景的分割,对比其分割效果,这里用三个苹果样本分别进行图像分割,结果如图4所示。

图4 R分量I分量和灰度图分割效果对比Fig.4 R component I component and gray graph segmentation effect comparison

R分量图分割效果最好,背景与目标边界区分明显,没有目标缺失的现象,I分量图和灰度图中,目标边缘缺失严重,并且有小部分像素点出现。最终选用苹果R分量图进行图像分割。

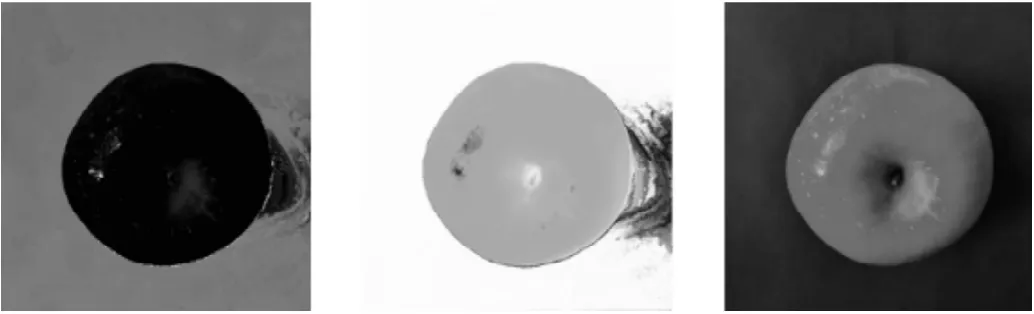

2.3 形态学降噪

图像分割后会存在孤立的像素点或出现目标边缘不平滑的现象,使得图像分割效果不完善,使特征提取结果产生误差。为了消除这一现象的影响,进行形态学操作,消除毛刺,细化边缘。将分割后的图片进行形态学处理,对比效果图如图5所示。看出先闭后开处理效果更好,并且目标边缘较为平滑。

图5 形态学降噪前后图像对比Fig.5 Comparison of image comparison before and after morphology noise reduction

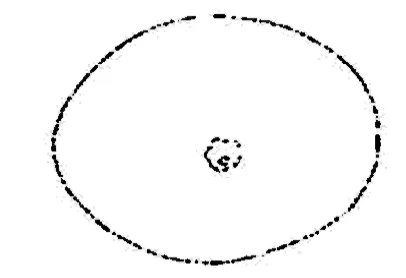

2.4 边缘检测

边缘检测是只获取苹果图像边缘部分,Canny算子边缘检测效果最好,其边缘定位准确性和抗噪声干扰性较其他算子结果更优。利用Canny算子提取到的苹果边缘轮廓如图6和图7所示。

图6 样本1Fig.6 Sample 1

图7 样本2Fig.7 Sample 2

3 特征数据提取

3.1 苹果的大小检测

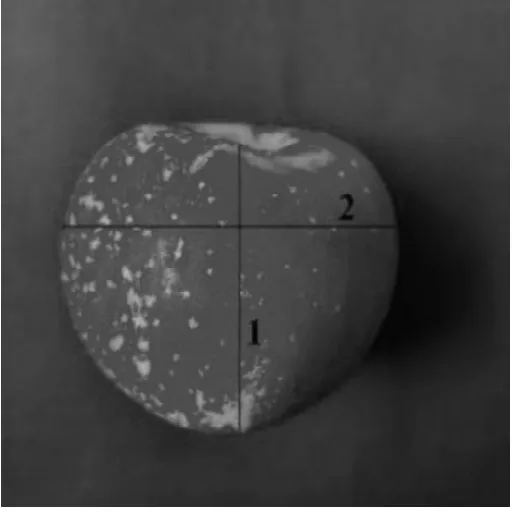

苹果最大横截面直径不是图像边缘两点距离的最大值,而是苹果正立放置时,垂直于果轴的最大直径为最大横截面直径,如图8所示。

图8 苹果最大横截面示意图Fig.8 Apple's largest crosssection schematic

其中1表示苹果果轴,2表示苹果的最大横截面直径。根据这一标准,先寻找苹果的果径面,将果径面作为最大横截面的判断依据,再将此时的最大直径作为苹果大小数据。

通过实际观察发现,通过俯视图可以直接得到苹果的最大横截面直径,将苹果的俯视面作为果径面。之后求出果径面的形心,并在图中标出中心点坐标如图9所示。

图9 苹果中心点示意图Fig.9 Apple central point schematic

3.2 苹果大小测量及结果分析

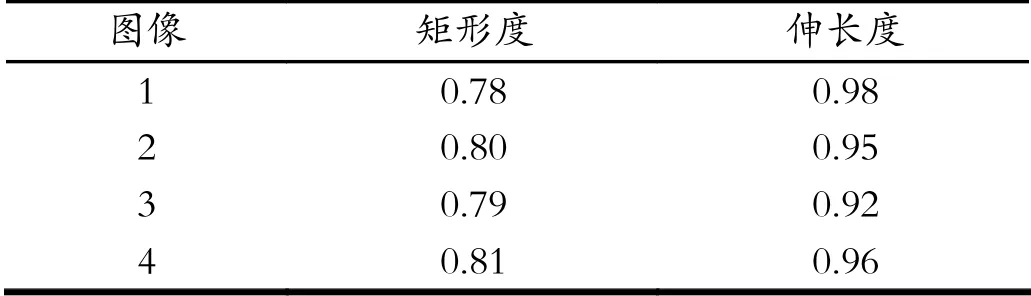

3.2.1 单一果径面的选取及测量

通过苹果表面图像的矩形度和伸长度对比,得知果径面的伸长度最大、矩形度最小,确定可以使用这一方法来进行果径面的选择。随机选取一个苹果样本,测量其四幅表面的矩形度和伸长度,结果如表1所示,由表可知矩形度最小为0.78,伸长度最大为0.98,将此表面作为果径面。

表1 苹果四幅图像矩形度和伸长度对比结果Tab.1 Rectangularity and extension of the four image of Apple

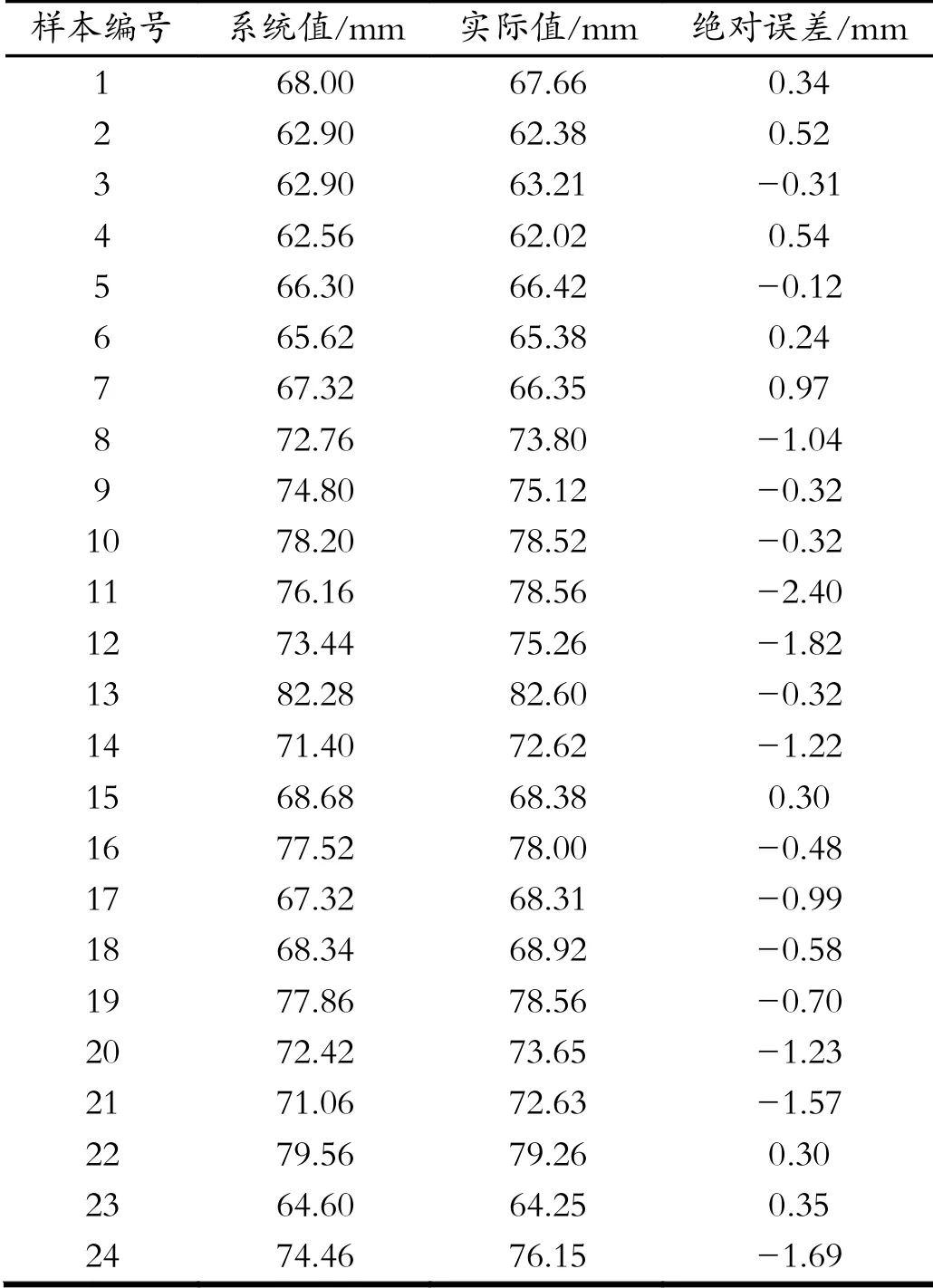

3.2.2 苹果大小测量实验

本次实验选取了24个大小不一的红富士苹果作为研究对象,分别使用游标卡尺测量这些苹果的实际果径大小,并进行编号,之后按照编号依次获得每个苹果的四幅图像并测量果径面的直径大小;最后把系统直径和实际直径进行对比,得到两者的绝对误差,结果如表2所示。结果表明,只有两个样本的绝对误差超出±2.0mm范围,其余绝对误差都在±2.0mm范围以内,符合苹果的大小分选标准。

表2 苹果大小测量结果Tab.2 Apple size measurement results

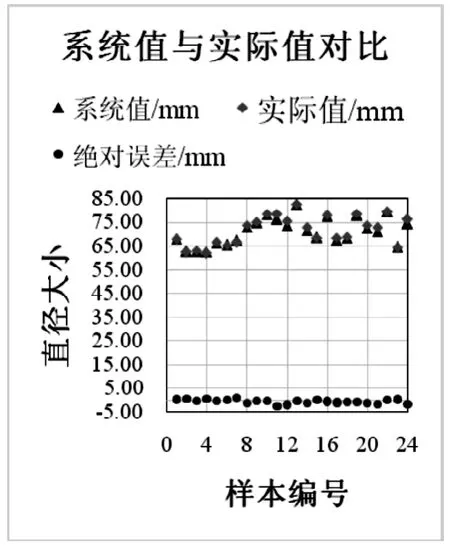

为了方便的看出实际值和系统值两者之间的关系,把数据以散点图的形式展现,如图10所示。

图10 系统值与实际值对比图Fig.10 System value and actual value comparison

3.3 苹果的颜色检测

为了方便分析苹果目标区域颜色的信息,首先需要从苹果图像中剔除背景区域,最后只留下苹果区域的彩色图。具体操作方法为:首先将图像分割后的二值图与原彩色图像的R、G、B分量进行相乘,此时就能得到去除背景区域的彩色图像,如图11所示。

图11 去除背景的彩色图像Fig.11 Remove the color image of the background

3.4 苹果红色着色率

GB/T10651-2008《鲜苹果》[8]要求以苹果表面的着色面积比作为色泽分级依据。本文通过计算苹果的红色着色率来表征颜色特性。

HSI模型比RGB模型更符合人类视觉特性,本节中只需要检测颜色分量,因此只需要分析苹果的H分量。把去除背景的彩色图像转换为HSI模型,然后提取H分量下的直方图,在得到的多个苹果样本直方图后,抽取其中两个样本进行了显示,其中苹果去背景图如图12和图14所示,样本H分量对数直方图如图13和图15所示。可以发现在苹果的颜色越红的时候,H分量越接近于0,而苹果的颜色越黄的时候,H分量越远离0,在这里将1/12和11/12作为阈值,即色度值小于1/12或者大于11/12的作为红色区域范围,之后计算它的像素面积,利用红色面积和苹果总面积的比值计算红色着色率。

图12 去背景图Fig.12 Going to the background diagram

图13 直方图Fig.13 Histogram

图14 去背景图Fig.14 Down background diagram

图15 直方图Fig.15 Histogram

如图16、图17和图18所示的红色着色率分别为98.2%、90.6%和17.2%,通过数据观察和实际图像对比,可以明显看出系统测得值和实际苹果实际颜色无比接近,验证了红色着色率描述苹果颜色特性的准确性。

图16 样本1Fig.16 Sample 1

图17 样本2Fig.17 Sample 2

图18 样本3Fig.18 Sample 3

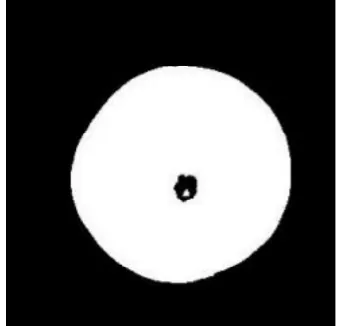

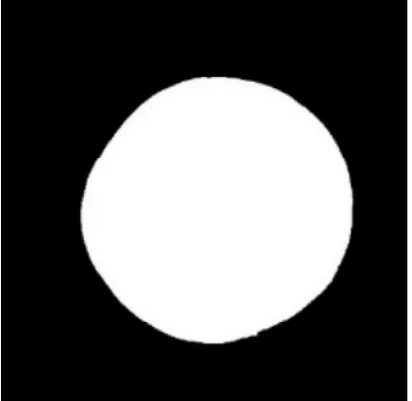

3.5 苹果的缺陷检测

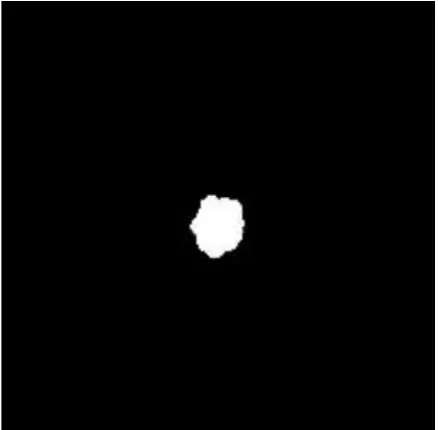

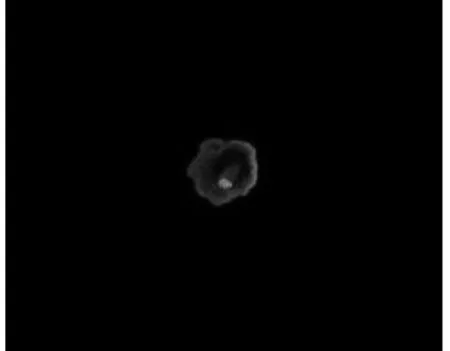

对缺陷及果梗区域进行目标提取,具体过程如下:对于苹果二值图像(如图19所示)进行Canny边缘算子提取,如图20所示,之后对二值图像进行孔洞填充,如图21所示。然后对填充的图像进行边缘提取,接着用20减图22得到只有目标区域边缘的图像,最后用孔洞填充目标区域。为了看出真实的目标情况,还应该获取目标的彩色图像,具体操作如下:将得到的目标图像(如图23所示)进行求反,得到背景区域为1,目标区域为0的二值图,如图24所示,将此二值图与原彩色图像的R,G,B分量分别进行加运算,将得到的各分量结果合成,如图25所示,得到目标区域的彩色图像,并将其进行放大处理,如图26所示。也可以直接将目标图像与原彩色图像相乘得到目标区域的彩色图像并进行放大处理。

图19 二值图Fig.19 Two value

图20 边缘提取Fig.20 Edge extraction

图21 填充图Fig.21 Plipping

图22 外边缘图Fig.22 Outside edge diagram

图23 区域边缘Fig.23 Regional edge

图24 二值图Fig.24 Binary chart

图25 白色彩图Fig.25 White color

图26 黑色彩图Fig.26 Black color map

表面缺陷率的计算方法,将上述得到苹果缺陷区域面积用SQ表示,苹果区域面积用S表示,苹果缺陷率用q表示,苹果缺陷率公式如式(1)所示。

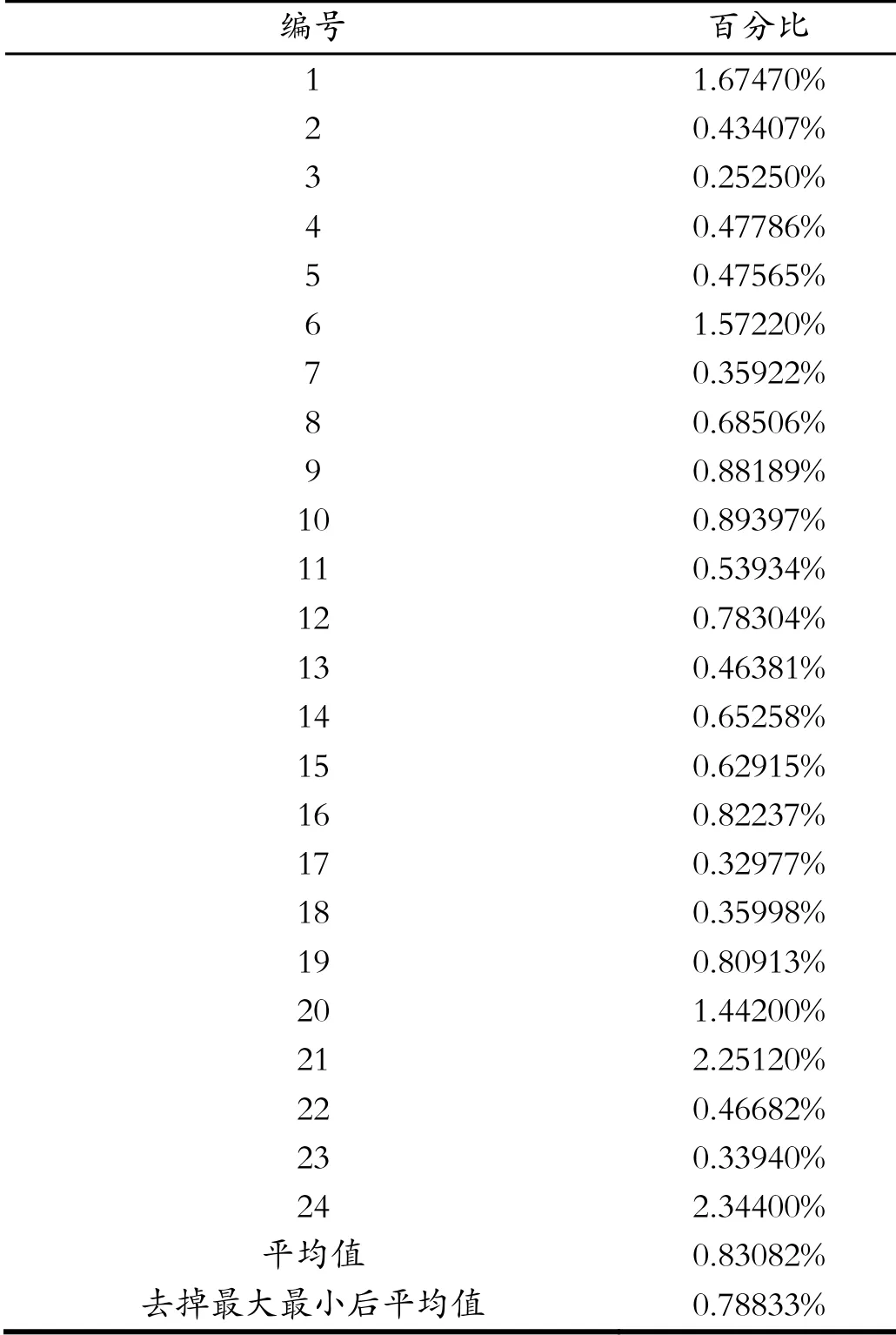

对只含有果梗区域而不含缺陷区域的苹果果径面进行了果梗区域面积与果径面面积比值的计算,结果如表3所示。

表3 苹果果径面果梗区域面积所占百分比Tab.3 Percentage of stem area on diameter surface of apple

根据表中结果显示,这里应当取果梗区域缺陷率均值为0.81%。改进后的苹果果径面缺陷率计算公式如式(2)所示。

使用改进后的果径面缺陷率计算方法对果径面进行缺陷率计算,准确率达到80%以上,结果符合预期。

3.6 苹果的圆度检测

圆形度表示目标区域图像接近圆的程度,利用区域周长C和区域面积S计算得出,根据圆的周长和面积公式,可以得出半径,如式(3)、(4)所示。

在目标区域图像中,苹果表面的周长是区域边缘像素点的个数,苹果表面面积是目标区域内总的像素点个数,圆形度的表达公式如式(5)所示。

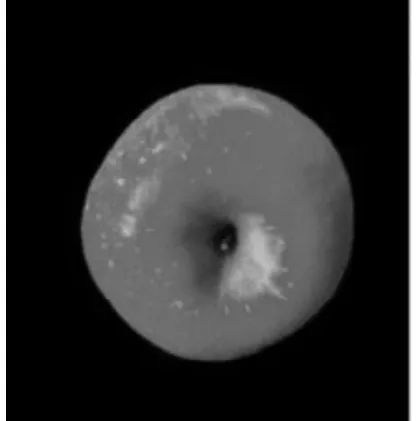

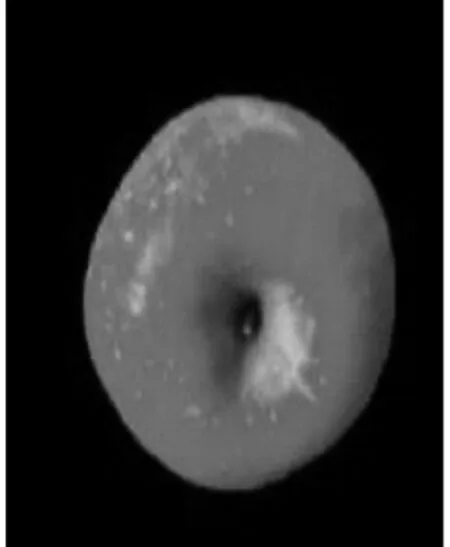

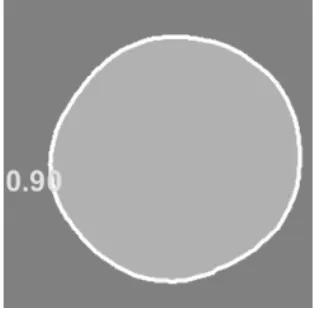

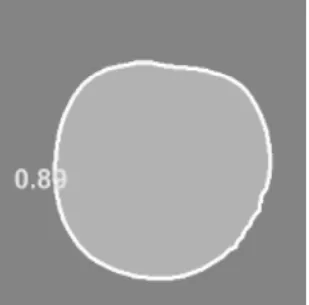

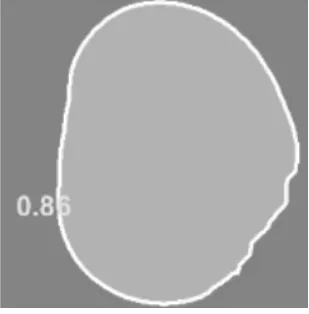

圆形度E的值越接近1时,苹果形状越接近于标准圆;当圆形度E的值越远离1时,苹果形状越不规则。根据上述研究,可以使用圆形度来表征苹果形状的优劣。这里取三个苹果样本,它们的圆形度如图27-图29所示,由以上数据可以看出苹果的圆形度结果大小与实际形状相符。

图27 样本1Fig.27 Sample 1

图28 样本2Fig.28 Sample 2

图29 样本3Fig.29 Sample 3

4 苹果分级实验

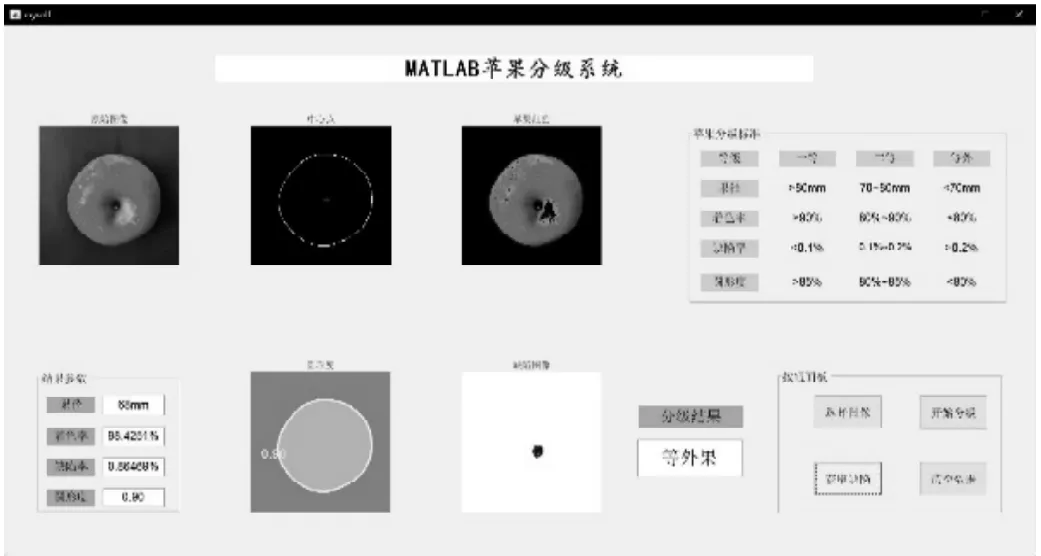

4.1 GUI系统界面

本文使用MATLAB设计了苹果分级系统的GUI交互界面,如图30所示。交互界面中结果参数区主要用来显示苹果图像的四个表面特征参数,图像显示区域主要用来显示原始图像和过程图像,分级标准区主要展示了该系统所使用的分级标准,分级结果区显示分级结果,按钮面板区放置的是控制该程序运行的按钮。

图30 GUI交互界面Fig.30 GUI interface

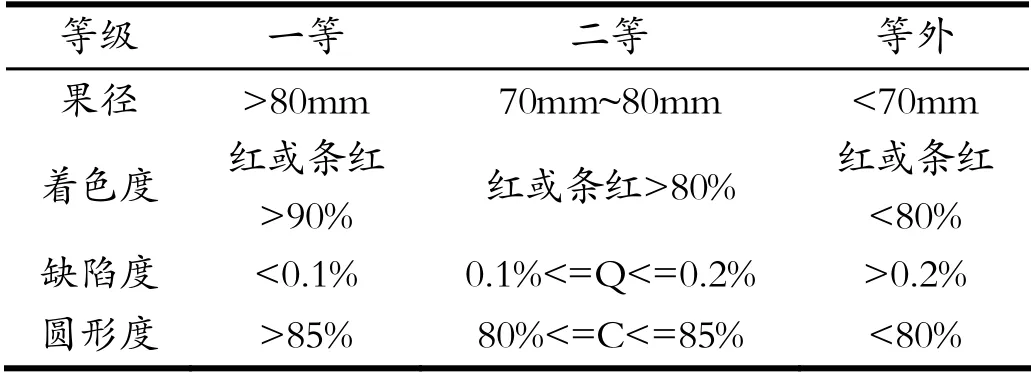

表4 本文拟定的苹果规格等级Tab.4 Apple specification grades proposed in this paper

4.2 苹果分级实验

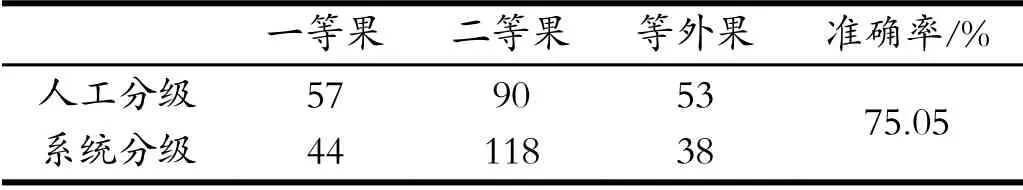

为了验证分级系统的可靠性,对样本苹果进行了分级实验。为了确保实验结果准确,本次实验选取了200个苹果样本,按照上述所规定的分级标准,将苹果分成了3等。实验以人工分级为标准,得到在该程序下的苹果分级准确率,如表5所示。由表得出该分级系统的综合分级准确率在75%左右。

表5 苹果分级准确率Tab.5 Accuracy of apple grading

5 结语

本文设计了基于MATLAB图像处理的苹果分级检测系统,以红富士苹果为研究对象。本系统主要包括了图像获取,图像预处理,特征提取以及苹果分级这四个过程。

本文的主要内容以及研究工作如下:

(1)为了确保苹果图像采集的完整性,将苹果放置在黑色背景同一光源线下进行四幅表面图像的获取。提取苹果图像的各个分量图,对灰度图还有R分量和I分量图的分割图像进行对比后,发现R分量图最适合阈值分割。之后进行形态学降噪,平滑边缘,边缘检测。(2)大小可以最直观的展现苹果品质,本文根据国标要求,将苹果正立时的俯视图作为果径面,其最大横截面直径就可以用来表征苹果大小。用苹果的红色着色率表征苹果的颜色特征,按照HSI颜色空间进行红色着色率。本文在进行缺陷提取时,首先在之前图像处理的基础上进行苹果缺陷区域和果梗区域的提取,然后在提取的苹果表面缺陷的基础上,根据苹果缺陷面积所占苹果面积计算缺陷度,又根据果梗区域面积平均占比,优化了果径面缺陷度计算公式,根据圆形度公式对苹果果径面进行了圆形度计算。(3)综合四种特征数据,完成了苹果分级系统的编写,并设计了GUI用户交互界面,使用户操作更加便捷。用上述程序进行苹果样本分级实验,与人工分级对比,准确率在75%左右。