基于U型网络复合特征的视网膜血管分割方法

孟 颖 田启川 吴施瑶

(北京建筑大学电气与信息工程学院 北京 100044)(建筑大数据智能处理方法研究北京市重点实验室 北京 100044)

0 引 言

在医学临床应用中,通过对视网膜血管的数量、宽度、长度、分支、曲度、血管走向角度等进行分析,能够帮助医生诊断患者是否患有高血压、青光眼、动脉硬化或心血管疾病。然而,目前眼底图像的血管结构主要由专家手动标记得到,整个过程耗时耗力[1]。因此,实现视网膜血管的自动检测与分割,对计算机辅助诊断各种眼底疾病具有重要的研究和应用价值。

眼底血管自动分割方法主要分为无监督方法和有监督方法两类[2]。无监督的方法依赖于人为规定的特征属性以及属性间的内在联系来区分视网膜上的血管和背景信息,主要包含匹配滤波方法、形态学处理法和血管定位跟踪方法等。如:文献[3]通过K均值聚类法构建标号场,并利用马尔可夫随机场理论计算后验概率,不断更新标号场,以获取最优的分割结果;文献[4]在不同尺度的视网膜高斯匹配滤波基础上采用双阈值的方法进行眼底图像血管分割。虽然很多无监督的方法都获得了不错的分割精度,但是这类方法往往需要与其他方法相配合,并且不能自动识别血管的变化趋势,具有一定的局限性。

在监督学习算法中,随着深度学习技术的不断发展,以FCN(Fully Connected Neural network)、U-Net(Unity Networking)、Dense-Net(Densely Connected Convolutional network)等为基础的特征提取方法已经被广泛地应用于视网膜血管分割任务中[5-7]。FCN是基于图像语义分割问题提出的经典网络结构,可以实现图像端到端、像素级的分类,但是随着网络深度增加,伴随着大量细节信息丢失的问题,不利于视网膜血管的分割。文献[8]采用Gabor滤波与FCN相结合的方法,获得了较高的分割精度,但是分割出的血管存在明显的间断现象,影响诊断。U-Net是在医学图像分割领域应用最为广泛的网络结构之一,其经典的编码器-解码器结构和跳跃连接可以解决降采样带来的信息损失问题。文献[9]基于U-Net结构提出了将编码器提取的特征与上一层级特征和解码器提取的同级特征相融合的方法,这种方法可以优化边缘的提取精度。文献[10]通过在U-Net模型上加入密集连接机制,充分利用输出层的特征信息。但是上述方法存在血管分割不全的现象。Dense-Net通过稠密连接机制提升了信息和梯度在网络中的传输效率,致力于从特征重用的角度来提升网络性能。文献[11]将空洞卷积与Dense-Net嵌入U型网络,提升了网络整体感受野和特征复用能力。文献[12]在U-Net结构与Dense-Net结构的基础上,引入可变形卷积,提高血管分割的稳健性。但上述方法过多地利用Dense Block结构和空洞卷积,存在内存占用率高、计算量较大等问题。

针对视网膜血管分割存在的问题,本文基于U-Net网络的对称结构与HRNet(High Resolution Network)[13]随时保持高分辨率表征的特点,构建复合特征提取融合模块,在整个训练的过程中保持高分辨率表示,通过并行子网反复融合特征,从而充分利用图像上下文的多重语义信息,提高分割的准确率,并通过大量的对比实验,对方法的有效性进行验证。

1 相关技术

1.1 U-Net网络模型

U-Net是由Olaf Ronneberger等构建的适用于较少的训练集进行端到端训练的网络结构。这种结构在FCN的基础上,去除了冗余的全连接层,并采用经典的“编码器-解码器”结构和跳跃连接进行特征提取和还原。具体操作如下:

(1) 编码器结构中,输入图像经过多次的卷积和池化操作进行下采样,形成从低维到高维的特征金字塔,并最终得到低分辨率的抽象特征图。

(2) 解码器结构中,特征图经过多次反卷积操作实现上采样,生成与特征金字塔对应层级的特征图。

(3) 跳跃连接将下采样得到的低分辨率抽象特征图与上采样生成的与特征金字塔对应层级的特征图相融合,融合后的特征图既包含了复杂抽象的特征,还引入了各层级中低维特征的细节信息,可以获得多尺度特征信息以提高网络性能。

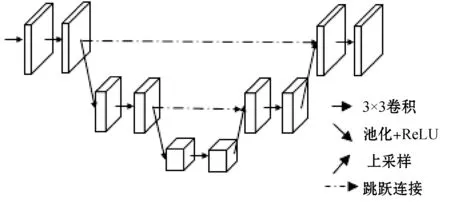

U-Net通过对称结构和跳跃连接结构,将图像的高分辨率特征与低分辨率特征相结合,有助于提高模型对每个像素点进行分类的能力,从而获得更高的分割准确率。简明的U-Net结构如图1所示。

图1 简明U-Net网络结构

1.2 HRNet网络模型

HRNet是由微软亚洲研究院视觉计算组针对视觉识别中的区域层次和像素层次问题提出的网络结构,在图像的像素级分类、区域级分类、图像级分类中都具有良好的性能。大多数现有的特征提取方式都是选择串行连接,这种方式需要上采样将特征从低分辨率恢复到高分辨率,上采样的过程中会损失很多空间和细节信息。HRNet网络通过并行连接多分辨率子网实现在整个过程中保持高分辨率表示,具体操作为:

(1) 将高分辨率子网开始作为第一阶段,逐步添加高到低的分辨率子网以形成更多阶段。

(2) 将多个子网进行并行连接,每个子网采用不同的分辨率。

(3) 在多个并行子网之间采用重复跨并行卷积,从而进行多尺度融合来增强高分辨率表示。

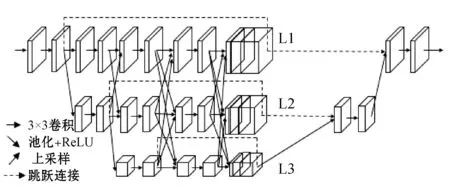

HRNet通过并行连接多分辨率子网可以使预测的热图在空间上更加精确,同时,将不同分辨率的图像采样到相同的尺度反复融合,加之网络的学习能力,会使多次融合后的结果更加趋近于正确的表示。HRNet网络结构如图2所示。

图2 HRNet网络结构

由于U-Net网络的对称结构有助于提高模型对每个像素点的分类能力,HRNet网络可以在整个过程中保持高分辨率表示,因此考虑将两种网络结构相结合,以提高视网膜血管的分割能力。

2 建模与训练

本文方法的整体流程包括搭建网络模型、构建训练集与测试集、模型训练和预测。

2.1 网络模型建立

本文提出基于“编码器-解码器”结构的复合特征语义分割模型,在U-Net结构的基础上,进一步增加了复合特征提取融合模块,能够更有效地分割视网膜血管。

2.1.1复合特征提取融合模块

传统的U-Net方法采用最大池化和ReLU线性激活来提取特征,这种方法会降低特征的空间分辨率,丢失许多细节,从而影响模型对小型目标的识别。通过搭建复合特征提取融合模块,在训练的过程中一直保持高分辨率信息,可以提高模型对细节特征的学习能力。该模块主要包含子网设计和融合策略两部分。复合特征提取模块如图3所示。

图3 复合特征提取模块

(1) 子网设计。复合特征提取融合模块包含三个并行的子网(L1,L2,L3),L1子网经过2次3×3卷积后执行步长为2的下采样操作,得到L2子网的第一个特征图,同理,L2子网经过2次3×3卷积和下采样操作后,得到L3子网的第一个特征图。每2次3×3卷积之间都会添加Dropout函数以减少过拟合。每进行一次下采样操作,特征图的分辨率变为上一层特征图的一半,通道数变为上一层的2倍。

(2) 融合策略。每个子网都由一系列3×3卷积组成,L1子网每经过2次3×3卷积后会进行步长为2和步长为4的下采样操作,并将下采样得到的特征图与L2、L3子网对应的特征图进行融合。L2子网每经过2次3×3卷积后会进行步长为2的上采样和步长为2的下采样,并将所得的特征图与L1、L3子网对应的特征图相融合。同理,L3子网每经过2次3×3卷积后会进行步长为2和步长为4的上采样,采样后的特征图与L1、L2子网的特征图进行融合。

特征融合的方法是,先采用1×1的卷积将待融合特征图的通道数调整为同一数量,再将特征图进行相加融合。在并行的3个子网之间反复交换信息,进行多尺度融合,可以使高分辨率特征与低分辨率特征相互增强,并在整个过程中保持高分辨率的特征表示,提高模型对细节特征的学习能力。

三个子网最后一次进行上采样、下采样操作时,提取出的特征图不再进行单一的融合,而是采用特征拼接的策略。每个子网都将得到的三个特征图以通道数的维度进行拼接,增加描述图像本身的特征量。

2.1.2基于U型网络的复合特征分割模型

由于U-Net网络的U型(编码器-解码器)结构在像素级的图像语义分割中性能更优越,本文将复合特征提取融合模块与U-Net网络相结合,并利用跳跃连接将二者提取的特征进行拼接。基于U型网络的复合特征分割模型如图4所示。

图4 基于U型网络的复合特征分割模型

复合特征提取融合模块中,L1、L2、L3三层子网的首次下采样构成U型网络的编码器,L3子网输出特征图的两次上采样构成U型网络的解码器。通过跳跃连接将编码器、复合特征提取融合模块和解码器输出的所有特征图进行拼接,获取图像丰富的上下文语义信息。最后通过Softmax函数得到预测的分割图像。

2.2 训练集数据和测试集数据

2.2.1原始数据库

本文使用的数据库为Niemeijer团队[14]在2004年根据荷兰糖尿病视网膜病变筛查工作建立的彩色眼底图库DRIVE。数据来自453名糖尿病受试者通过光学相机拍摄得到的视网膜图像,从中随机抽取40幅,其中7幅含有早期糖尿病视网膜病变,另外33幅不含有病变。将40幅图像分成训练集和测试集,每个子集包含20幅像素为565×584的图像,每幅图像都以专家手动分割血管的二值图像作为标签。

2.2.2数据预处理

为使构造的训练集和测试集具有更鲜明的血管结构,需要对图像进行预处理。预处理包括图像归一化、灰度处理、均衡化处理和伽马变换四个步骤。通过线性函数转换的归一化方法将所有的数据转换到-1至1之间,以抵抗仿射变换的影响;原始的数据集为彩色的RGB图像,通过灰度变换将RGB图像转换为灰度图像,以便于之后的处理;采用对比度受限的自适应直方图均衡化方法,提高图像局部的对比度,区分待分割的血管和背景信息;数据集中,某些视网膜图像存在过曝或过暗现象,通过伽马变换可以对这样的图片进行修正,同时可以提高图像的对比度。

预处理前后的图像如图5所示。可以看出,预处理后血管的形态、数量、走向都更加清晰,血管与背景的对比更加明显,更有利于视网膜血管的分割。

图5 图像预处理

2.2.3数据扩充

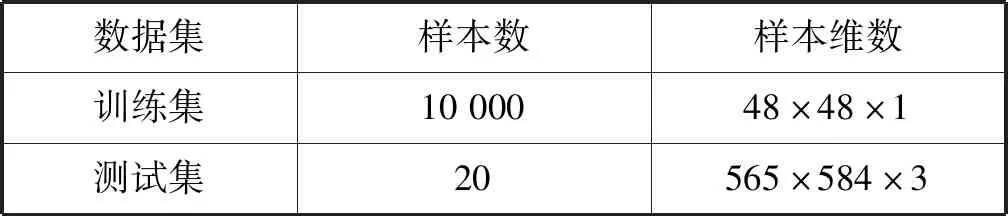

在模型的训练过程中,训练集数据量偏少是造成过拟合的重要原因之一。由于DRIVE数据集中数据量较少,为了降低过拟合的影响,本文采取分块处理的方法对输入图像进行扩充。在训练集的20幅图片上提取10 000个48×48的小块作为模型的输入图像,并相对应地在标签上也提取10 000个48×48的小块。采用分块处理的方法不仅可以进行数据扩充,还可以减少网络的计算量。

经过数据预处理和扩充后,得到的训练集数据和测试集数据如表1所示。

表1 数据集情况

2.3 模型训练和预测

本实验的仿真平台为PyCharm,使用Keras开源深度学习框架对网络进行训练和测试,计算机配置为Intel(R) Core(TM) i5-4210U CPU @2.40 GHz,4 GB内存,Windows 8.1系统。

在模型的训练阶段,训练集共10 000个图像块,每一轮训练选取90%用于训练,10%用于验证。训练过程中,将优化器设置为sgd,损失函数设置为catego-rical_crossentropy,评估模型的参数设置为accuracy。采用Keras的ModelCheckpoint函数保存最优模型。

在模型的测试阶段,首先读取保存好的模型权重,再将测试集的数据送入模型进行预测,并计算评价结果,最后将分割后的图像与原始图像拼接起来进行可视化对比。

3 实 验

3.1 实验方法

(1) 参数优化实验:在传统的U-Net网络上比较不同epoch值和batch-size值对应的训练结果,选择最优的epoch值和batch-size值作为后续实验的基准。

(2) 分割效果对比实验:综合比较传统的U-Net方法和本文方法在测试集上的准确率、特异性等评价指标,以证明改进的有效性。

(3) 多重评价指标对比分析:将本文方法与目前主流的视网膜血管分割方法进行比较。

3.2 评价指标

为了对模型进行定量分析,准确评价模型性能,本文采用准确率(accuracy)、特异性(specificity)、灵敏度(sensitivity)、AUROC和AUCPR作为模型评价指标,各评价指标定义如下:

(1)

(2)

(3)

式中:正确标注为血管的像素点数目称作真阳性TP(True Positive);错误标注为血管的像素点数目称作假阳性FP(False Positive);错误标注为背景的像素点数目称作假阴性FN(False Negative);正确标注为背景的像素点数目称作真阴性TN(True Negative)[15]。

AUROC(Area Under the Receiver Operating Characteristic curve)[16]是ROC(Receiver Operating Characteristic)曲线下方的面积,ROC曲线以特异性为横坐标、灵敏度为纵坐标绘制,其值越大说明算法的分割性能鲁棒性越优异。该曲线下方的面积越接近1,说明血管分割方法的性能越好。

AUCPR(Area under Precision-Recall curve)[16]是P-R(Precision-Recall curve)曲线下方的面积,P-R曲线以查准率为纵坐标、查全率为横坐标绘制。P-R曲线下方的面积越接近1,说明血管分割方法的性能越好。

3.3 参数优化

在深度学习网络训练的过程中,epoch值和batch-size值是影响模型训练效果的关键参数。增加epoch值有利于模型学习,但epoch值过大,会导致模型过拟合,学习效果反而不佳;batch-size过大会引发局部最优的情况,小的batch-size引入的随机性过大,使模型难以达到收敛。因此为了选择最优的参数以提高血管分割的精度,需要进行参数优化的实验。

图6为使用不同epoch值且其他参数保持不变时,验证集上准确率的变化曲线。可以看出,在训练初始阶段,网络训练收敛速度很快。当epoch=10时,准确率仍存在上升的趋势;当epoch=50时,网络在执行20轮训练后收敛速度明显变慢,训练曲线逐渐达到饱和,并且验证集的准确率与epoch=20时持平,可以说明选择epoch=20更加高效。

图6 不同epoch值验证集的准确率

表2为采用不同epoch值进行训练时测试集的预测结果。可以看出,随着epoch值增加,测试集的准确率逐渐上升,但是epoch值过高时,训练得到的模型可能存在过拟合现象,不具有泛化性。综上,将epoch值设定为20。

表2 不同epoch值的测试结果

图7为使用不同batch-size值且其他参数保持不变时,验证集上准确率的变化曲线。可以看出,随着batch-size增大,验证集的准确率逐渐下降,batch-size取值为2时准确率达到峰值。

图7 不同batch-size值测试集的准确率

表3为采用不同batch-size值训练时测试集的预测结果。可以看出,随着batch-size值增加,测试集的准确率、灵敏度等四项评价指标均呈现下降趋势。因此,将batch-size值设定为2。

表3 不同batch-size值对应的训练结果

3.4 实验结果分析

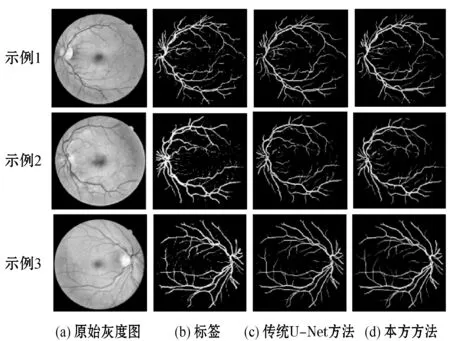

图8为传统的U-Net方法与本文方法的分割结果对比图。传统的U-Net方法在分割时存在以下3个主要问题:① 血管与视盘相混淆引起的误分割问题(如示例1所示);② 分割出的血管不具有连续性的问题(如示例2所示);③ 血管末端消失的问题(如示例3所示)。可以看出,本文方法可以避免误分割的问题,正确区分血管和视盘的位置,也解决了分割出的血管存在间断现象的问题,相较于传统的U-Net网络结构,本文方法可以学习到更多的细节信息,有助于视网膜血管分割。

图8 分割结果

将本文的测试结果与传统的U-Net方法进行对比,发现本文模型具有更高的准确率、灵敏度、AUROC和AUCPR,说明了改进的有效性。具体的性能对比情况如表4所示。

表4 本文方法与传统U-Net方法分割性能比较

将本文的测试结果与一些文献中的方法进行对比,本文方法的特异性达到0.984 6,AUROC达到0.983 0,均高于其他文献方法。采用本文方法获得的分割的准确率与最高的准确率只相差0.001 9,综合比较而言分割效果较好,说明本文方法中加入复合特征提取融合模块的必要性。具体的性能对比情况见表5。

表5 不同方法的分割性能比较

4 结 语

为了提高视网膜血管的分割结果,本文设计一种新颖的基于“编码器-解码器”结构的复合特征语义分割模型,能够有效提高分割的准确性。模型中的复合特征提取融合模块以HRNet网络结构为基础,在整个特征提取的过程中保持高分辨率的特征表示,并且在并行的多分辨率子网间反复交换信息,从而使设计的网络模型能更精确地提取目标的细节特征,很大程度上避免了分割出的血管不连续、血管末端完全消失的问题。同时,通过将编码器、复合特征提取融合模块与解码器输出的所有特征图进行跳跃连接,利用了上下文的多重语义信息,提高了分割效果。在DRIVE数据集上进行了大量的实验,验证了本文方法对视网膜血管的分割能达到较高精度。