基于双流BRC3D卷积神经网络的行为识别

臧晶 李博 李红 玉绍康

摘 要:针对C3D网络时间维上的信息抽取单一特点,模型本身存在泛化能力弱等问题,该文基于BN归一化算法改进残差网络结构,并嵌入到C3D网络中,实现了网络结构的优化,保证各个层数据的分布稳定性。引入双流思想,构建了改进的BRC3D卷积神经网络的识别方法。最终在UCF101数据集上进行训练与测试,准确率达到了91.343%。

关键词:残差网络结构 行为识别 UCF101数据集 深度学习

中图分类号:TP391.9 文献标识码:A文章编号:1672-3791(2021)04(b)-0035-03

Behavior Recognition Based on Dual-stream BRC3D Convolutional Neural Network

ZANG Jing1 LI Bo2 LI Hong 1 yu shaokang1

(1.Shenyang Ligong University, Shenyang, Liaoning Province, 110159 China; 2.Liaoyang Vocational College of Technology, Liaoyang, Liaoning Province, 111000 China)

Abstract: Aiming at the single feature of information extraction in the time dimension of C3D network and the weak generalization ability of the model itself, this paper improves the residual network structure based on BN normalization algorithm, and embeds it into C3D network to realize the optimization of network structure and ensure the distribution stability of data in each layer. An improved BRC3D convolutional neural network recognition method is constructed by introducing the idea of two streams. Finally, training and testing on UCF101 data set, the accuracy rate reached 91.343%.

Key Words: Residual network structure; Behavior recognition; UCF101 data set; Deep learning

目前,人体行为识别在监控、运动分析、智能交互、智能医疗以及故障诊断、智能小区等很多领域得到应用,相关课题有着重要的研究价值[1-3]。其中,对视频中的人体行为进行识别成为计算机视觉领域中研究的热点。

该文对C3D网络结构[4]进行改进,提出了一种基于RC3D网络的行为识别算法[5],该方法同时提取视频信息中的时间和空间特征,增加BN归一化算法的残差网络改进卷积神经网络中,引入双流思想[6],得到基于双流BRC3D卷积神经网络的识别算法。

1 双流BRC3D卷积神经网络

1.1 BN归一化算法

(1)沿着通道利用式(1)计算每个批量Bath的均值。

(1)

(2)沿着通道利用式(2)计算每个批量Bath的方差。

(2)

(3)根据(1)和(2)步骤中得到的和,利用式(3)做归一化处理。

(3)

(4)利用式(4)将归一化后的数据加入和变量。

(4)

式中:缩放参数和平移参数参数是模型学习涉及的参数。

1.2 三维残差网络

该文的残差网络[6]获得残差结果的过程具体如下。

(1)运用BN算法实现所有卷积层的输出特征图的标准化处理;(2)同时,将激励函数Relu加入在前两个BN层后面,完成非线性计算;(3)恒等变换处理;(4)再次Relu计算获得残差结果。

1.3 双流BRC3D卷积神经网络

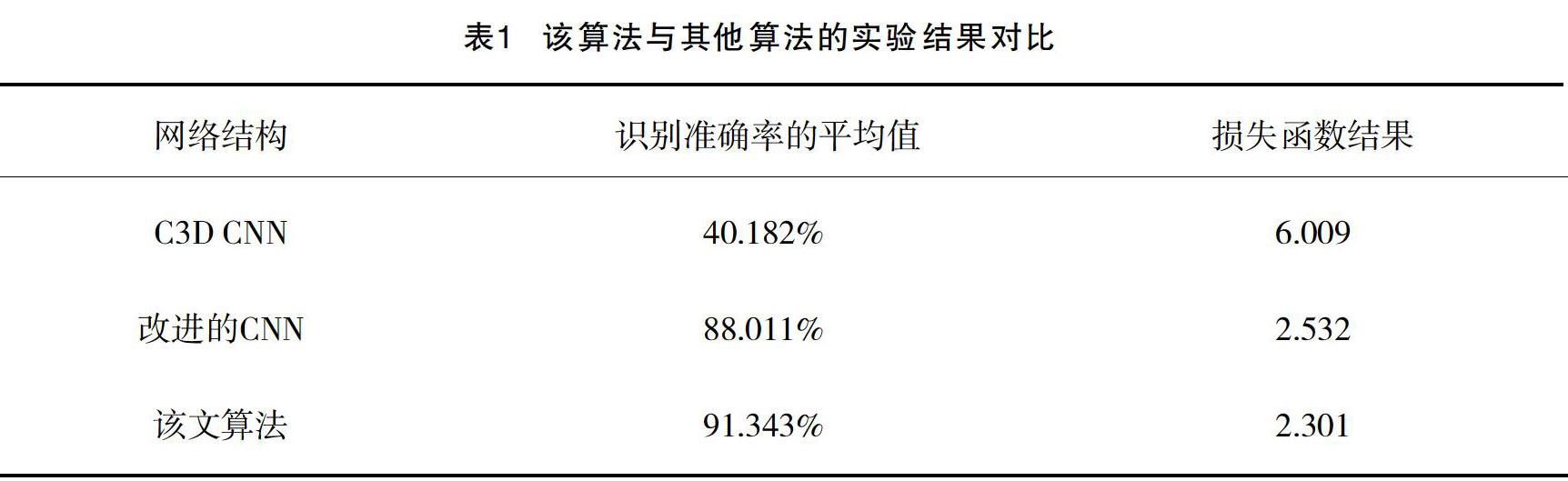

该文实现的BRC3D卷积网络结构,具体见图1。将视频中信息分为时间流、空间流两个部分,时间流描述了场景中目标对象的运动信息,空间流描述了外观场景中的大量信息和目标对象信息。

在视频分解为时间流和空间流的基础上,利用该文构建的网络实现行为识别的步骤为:(1)空间流输入:RGB彩色图像一帧,提取到视频中的外观场景信息和目标对象特征;时间流输入:多帧叠加得到的光流位移场,作用是抽取视频中的运动信息特征。(2)BN歸一化算法层,实现参数调节。(3)特征级数据加权融合:即场景信息的特征和运动信息的特征的有效结合。(4)Softmax实现动作分类,得到人体行为的动作分类结果,实验验证,准确率有提升。

2 实验过程

双流BRC3D卷积神经网络的训练实验是在UCF101数据集上进行的,该网络训练中的涉及到的主要参数有空间流net输入、时间流net输入、学习率、融合机制、轮数、迭代次数等。

双流BRC3D卷积神经网络的训练过程及其中参数设定描述如下:(1)空间流net输入的数量为T1=帧RGB图像;时间流net的输入选择连续性叠加L=10的光流。(2)训练中每轮迭代的样本容量为97;结合样本容量,确定网络的学习率的初始值为0.001,并使用MS方法来调节学习率的值。(3)动量为0.9,网络权值利用微型随机梯度下降法来调节。(4)进一步,时间流net和空间流net实现加权融合。(5)实验总共执行16轮,所有轮的训练过程中迭代量最高高达80 000次。(6)每训练过程的迭代1 000次,那么在测试数据集上将记进行600次的迭代。(7)从零开始的训练,5×104次迭代,得到学习率结果为10-3;7×104次迭代,得到学习率结果为10-4;8×104次迭代,训练结束。

3 实验结果与分析

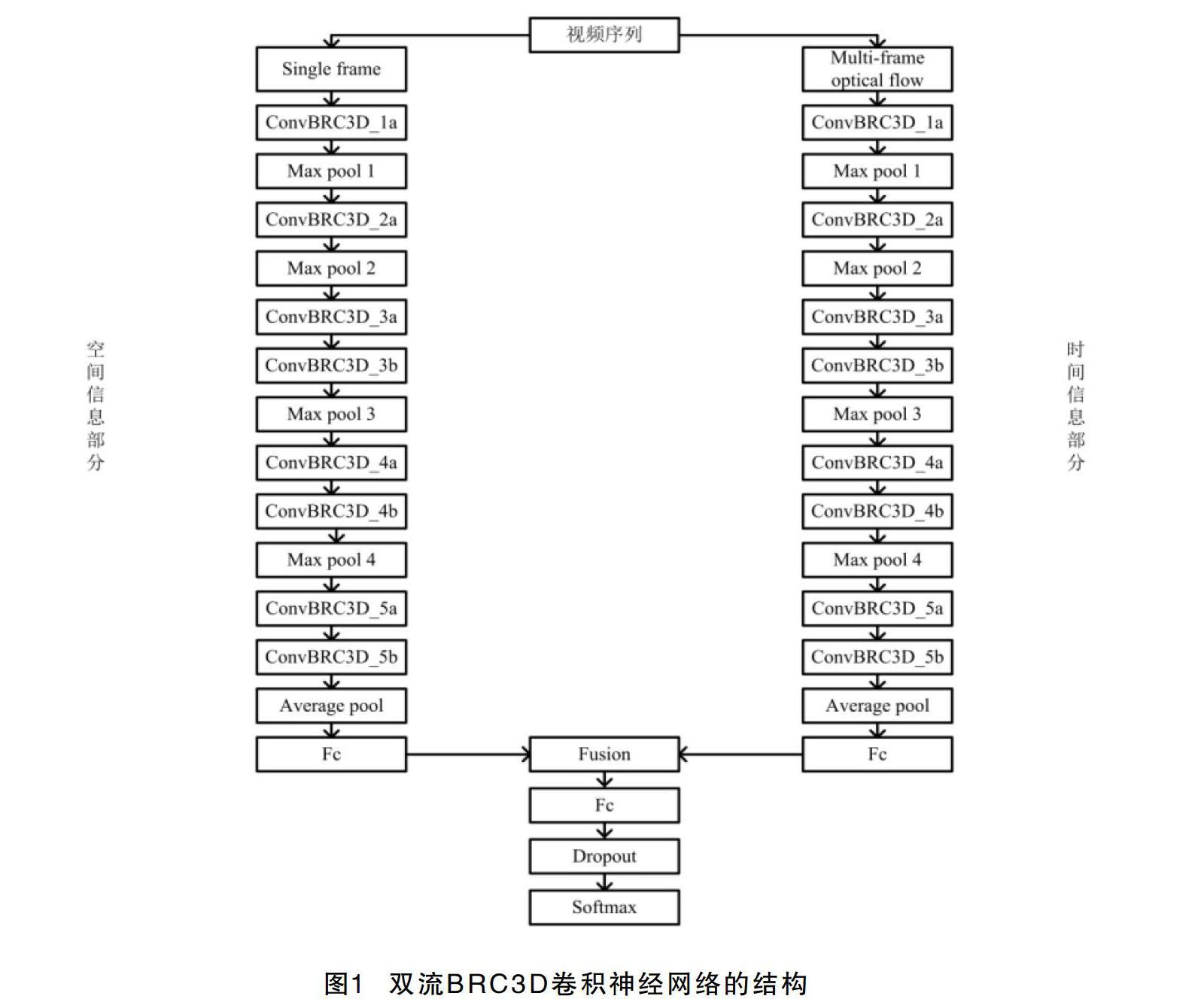

双流BRC3D网络的实验结果具体见图2、表1。

由实验结果可以看出,基于双流BRC3D CNN的平均识别准确率为91.343%,相较于C3D CNN和改进的CNN的准确率都具有很大的提升。与此同时,双流BRC3D CNN的损失函数曲线变化比较平滑,该损失函数值最终一直保持在2.301左右。

4 结语

该文构建的双流BRC3D卷积神经网络,既能提取包含场景的空间信息,又能提取包含运动信息的时间信息。最终在UCF101数据集上进行训练和测试,实验结果表明,该算法的人體行为识别准确率为91.343%,模型本身的泛化能力以及识别率都得到有效提升。

参考文献

[1] 李延林.基于深度运动图的人体行为识别研究[D].长春工业大学,2018.

[2] 刘潇.基于深度学习的人体行为识别技术的研究与应用[D].北京邮电大学,2019.

[3] 刘雪君.基于深度学习的人体行为识别算法研究[D].东北电力大学,2018.

[4] 马立军.基于3D卷积神经网络的行为识别算法研究[D].中国地质大学(北京),2018.

[5] 李红.基于深度学习的人体行为识别技术研究[D].沈阳理工大学,2020.

[6] 高阳.基于双流卷积神经网络的监控视频中打斗行为识别研究[D].西安理工大学,2018.