全局与局部注意力机制的胃部肿瘤分割算法

徐凯成,方志军,蔡清萍,卫子然,高永彬,姜晓燕

1.上海工程技术大学电子电气工程学院,上海201600;2.上海长征医院,上海200003

前言

胃癌作为全球范围内致死率最高的癌症之一[1]。胃癌的术前分期对治疗策略的制定起着至关重要的作用[2]。上消化道内视镜检查(胃镜)是胃癌检测的金标准,但由于其本身是一种侵入性检查,不仅对操作医师的技术要求较高,且患者需要承受一定的痛苦[3]。通过CT 诊断胃癌是一种高效无痛的方法,也成为未来医学工程重点发展的胃癌诊断技术手段[4]。然而由于专家资源分布不均衡,在CT 上实现精准的术前分期难度很高,事实上即使是由多位专家共同完成诊断,其结果仍然会存在很强的主观性。基于深度学习的方法由于其出色的自学习能力成为医学图像分析的主要选择之一,在减少专家重复性工作的同时也提供了更加客观的参考。

分割作为计算机视觉的基本任务之一,被广泛地应用于各种领域。在医学影像中,通过对病灶及器官组织区域的提取可以获得许多有价值的信息,如尺寸、位置等,这些信息对最后诊断提供了很大的帮助。医学影像分割在诸多医学影像应用中起着至关重要的作用,其基本原理是通过灰度、颜色、纹理、亮度和对比度来识别病变或器官区域所对应的像素或体素[5-6]。与传统自然图像相比,医学影像分割的难点主要有数据量少,图像质量低(对比度、模糊、噪音、伪影和失真),不同样本间器官组织差别较大等[7-8]。

近几年,由于U-Net网络在医学影像分割任务中的出色表现[9],被许多学者选择为基础框架,并以此展开进一步研究。对于医学影像来说,复杂的背景信息会导致提取的特征中包含多余噪声,而现有的一些分割算法并没有针对编码过程中提取的粗糙特征进行精细筛选[10-11],这增加了解码模块还原对象的难度。因此,使用合适的方法来获取上下文信息并实现特征的筛选十分关键。Fu 等[12]尝试获取全局依赖来丰富局部特征,这类方法太过于依赖全局信息而忽略了局部信息的自身价值;Gu 等[13]采用了不同感受野的尺寸来获取更多的上下文信息,该类型的方法虽然提升了感受野,但是这些信息仍然是局部的,即信息来源为一部分周围像素。

针对胃部肿瘤较难精确分割的问题,本文提出了一种基于注意力机制的2D分割网络GLat-Net来实现上腹部CT影像胃部肿瘤区域的分割。并引入一种注意力机制模块,分别从全局和局部两个角度来突出有价值信息和抑制无用信息;同时采用权值模块决定解码过程中通道上的权值,通过对通道上的特征进行筛选来提升分割的效果。相较于已有的方法,其主要优势在于同时采用了全局与局部视角,以共同监督互相约束的方式来对粗糙特征进行精细筛选,从而有效的提高了胃部肿瘤分割的准确率。本文所提出的方法应用到上海长征医院临床上腹部CT影像数据分析中,结果表明GLat-Net可以精确地提取胃部肿瘤,相较于其他前沿分割方法有着更好的表现。

1 分割方法

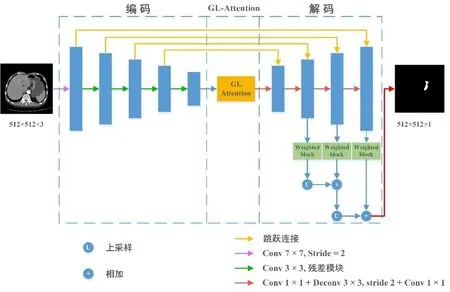

本文提出运用GLat-Net 网络结构作为分割网络,主要由编码、GL-Attention 模块和解码3 部分构成,如图1所示。本文采用ResNet-34 作为模型的backbone来对输入进行特征提取,为了获取更丰富的上下文信息,使用全局-局部注意力机制,结合全局和局部两个角度来提取更丰富的特征。在编码过程中,本文采用了加权模块来学习通道之间的相关性并给通道赋予权值,进一步提升分割表现。

图1 GLat-Net结构示意图Fig.1 GLat-Net architecture

1.1 编码

由于数据量少的限制,为了降低欠拟合和过拟合的风险,本文选择了ResNet-34 作为网络的主体。与传统的U-Net结构(每个编码模块包含两个卷积层和一个池化层)相比,ResNet-34的跳跃连接在抑制梯度消失现象上具有更好的表现,并且在训练中提升了网络的收敛能力[14]。

1.2 全局-局部注意力机制

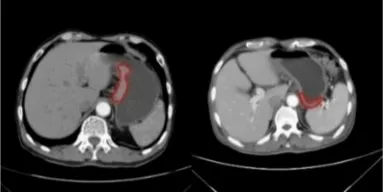

由于受到容积效应的影响,肿瘤在CT 上呈现的密度会与实际密度存在偏差。胃部肿瘤的分割主要面临以下几个困难:肿瘤形状的多样性,不同分期下肿瘤尺寸的差异性以及组织纹理的模糊性。如图2所示,红色标注区域为肿瘤位置。因此,为了能更好地提取出肿瘤,需要增加对肿瘤周围区域的关注。Li等[15]提出,全局视角虽然能提供有价值的上下文信息,但是图像中并不是所有对象都对物体定位起着积极作用,而物体周边的局部信息能对特殊区域内的推理提供线索。因此,对于医学影像这类具有复杂背景的数据而言,合理利用局部信息是十分必要的。基于此,本文提出一种全局-局部注意力机制,从全局和局部两个角度突出有效信息,抑制干扰信息,提升肿瘤提取的准确性。

图2 不同数据样本间的多样性Fig.2 Diversity of different data samples

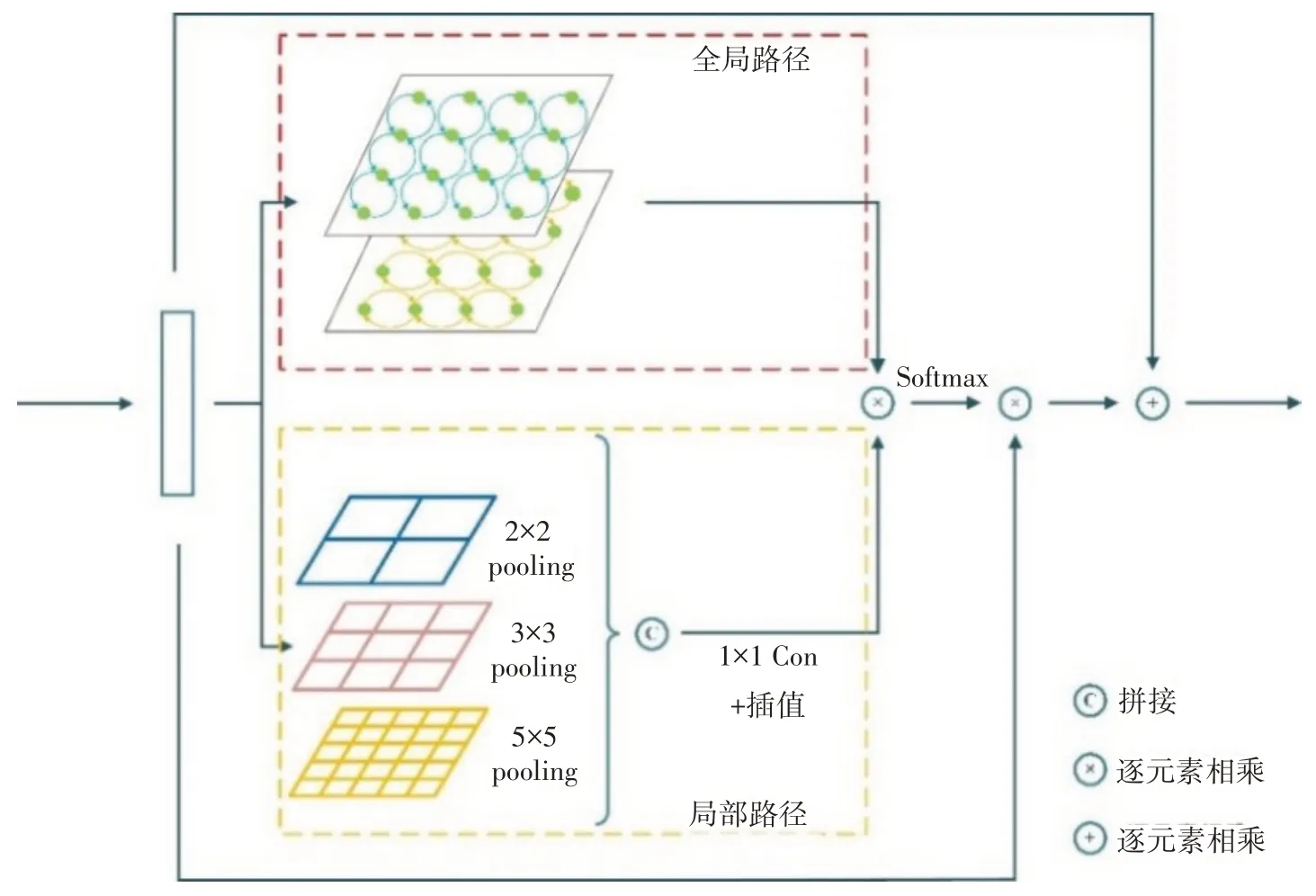

在图3所示的GL-Attention 结构中,分别设置了全局和局部双路径来实现特征的共同筛选。本文按水平与垂直两个方向来获取有价值的全局上下文信息,首先将输入张量x的行元素输入到双向长短期记忆网络(biLSTM)中,得到与x尺寸一致的张量x',随后将x'的列元素也以同样方式输入到biLSTM中并得到张量x'',通过两个双向的biLSTM 使得感受野能够覆盖整个输入图,该张量中每个元素代表全局视角下的原输入x对应位置的权值。类似地,为了获取局部上下文信息,在局部路径上采用了金字塔池化层[16],池化核尺寸分别设置为:2×2、3×3 和5×5,多尺寸的池化核提供了不同大小的感受野,这使得网络能够适应目标物体尺寸上的差异。采用双线性插值来统一经金字塔池化后得到特征图像尺寸,将不同池化层的输出张量拼接后,通过1×1卷积得到与输入张量x通道数一致的局部特征图像,该张量中每个元素分别代表局部视角下的原输入x对应位置的权值。将全局特征图像和局部特征图像进行逐元素相乘经过softmax函数后得到最终的注意力图a:

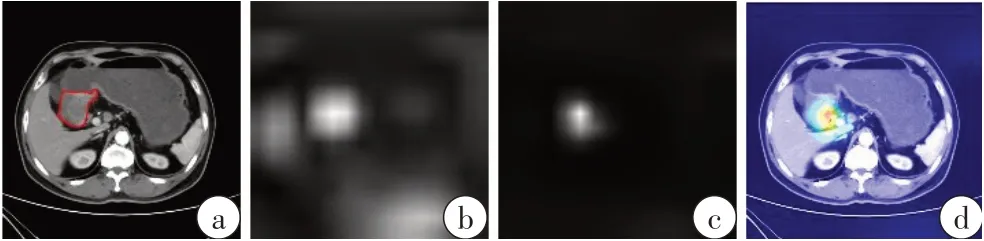

其中,R(x)和P(x)分别代表两次的biLSTM 和金字塔池化,σ为softmax函数。效果如图4所示。将注意力图a与输入特征x相乘后便得到筛选后的特征,最后,将输入张量x与筛选后的特征进行相加。

图3 GL-Attention结构图Fig.3 GL-Attention architecture

图4 GL-Attention效果的可视化Fig.4 Visualization of GL-Attention

1.3 解码权重模块

在解码过程中,网络会根据在编码中得到的高级特征进行图像还原,值得注意的是,并不是所有高级特征都有助于提升分割精度。为了能学习它们之间的相关性以及不同通道间的贡献,本文采用了一种权重模块来获取各个通道的权值,实现通道上的特征筛选[17]。

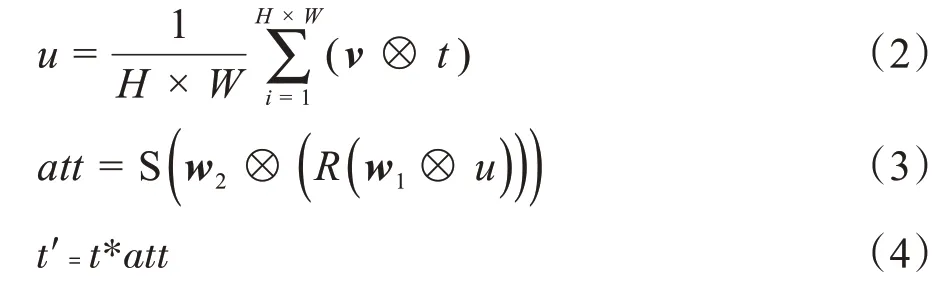

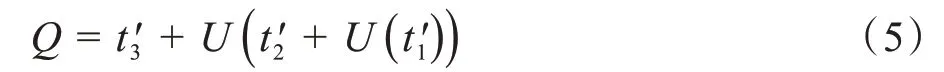

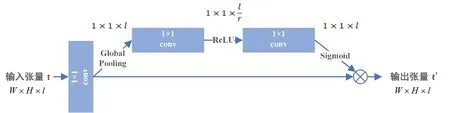

如图5所示,首先通过全局平均池化层对输入张量t∈RW×H×l做逐通道的统计,统计结果u∈R1×1×l中的每个元素um(m=1,2,…,l)可以用来描述对应通道上的整个图像。根据统计结果u,采用两个1×1 的卷积与ReLU 和Sigmoid 函数来获取通道权重A∈R1×1×l,通道权重A中每个元素am(m=1,2,…,l)代表着通道m的权值。值得注意的是,为了减少计算消耗,第一个1×1卷积层的输出张量通道数被压缩为l/r,l为原通道数,r为压缩率,第二个1×1 卷积层将压缩后的通道还原为l。将生成的权重A与原输入张量t对应相乘得到筛选后的结果t'。具体计算过程如下所示:

其中,⊗为卷积运算,v,w1和w2分别为对应特征的权重矩阵,R和S 分别代表ReLU 函数和Sigmoid 函数,通过实验证明,当解码权重块应用于d2,d3和d4的侧输出时效果最为明显,其中,dn(n=1,2,3,4)分别代表第n个解码模块。由于不同解码权重模块的输出尺寸不同,为了使输出张量间能够进行累加运算,采用了插值策略(用U表示)来统一t'的尺寸,计算过程如下所示:

图5 解码权重模块说明Fig.5 Illustration of weight module in decoder module

1.4 loss函数

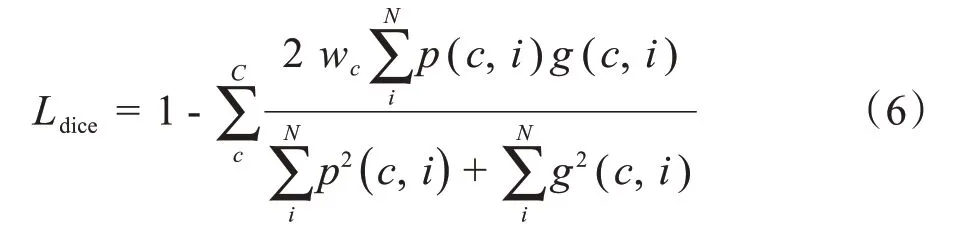

由于肿瘤的尺寸在不同分期阶段所呈现出的尺寸差异较大。当背景的像素个数远远大于肿瘤的像素个数时,正负样本之间的差距会严重失衡。标准交叉熵损失函数并不适用于这种情况。为了解决此类问题,采用了对于类别不均衡数据中表现更好的dice coefficient loss函数[18-19],定义如下:

其中,N和C分别代表像素和类别的总数,p(c,i)∈[0,1]是预测为c类的概率。相似地,g(c,i)∈{0,1}是第c类的标签代表不同类的权重。

整体loss函数定义如下:

其中,Lreg代表L2 正则化函数来防止网络在训练过程中出现过拟合,λ是正则化系数,w是权重系数向量。

2 实验与分析

2.1 实验数据

本实验为了讨论GLat-Net应用于胃部肿瘤分割在临床诊断上的有效性,采用了上海长征医院临床中440组包含不同分期的上腹部CT数据,图像尺寸为512×512,其中,390组将作为训练集,50组作为测试集。

2.2 实验设置

本次实验使用Pytorch 库来搭建网络模型,操作系统为Ubuntu 16.04,显卡为11G 的NVIDIA GeForce GTX 1080 Ti。

在训练中,总迭代次数total_iter为150,初始学习率base_lr 设置为0.000 2,采用了poly 学习率衰减策略来调整学习率,更新公式为:

其中,power 设置为0.9,实验采用Adam 算法对网络进行优化。

2.3 实验结果分析

为了验证本文所提出的GLat-Net 的有效性,通过计算交并比(IoU)和准确率(Acc),将其与当前前沿的分割算法U-Net[10]、Dense U-Net[20]、CE-Net[13]和Attention U-Net[21]进行对比,对比参数IoU 和Acc,见公式(10)和(11):

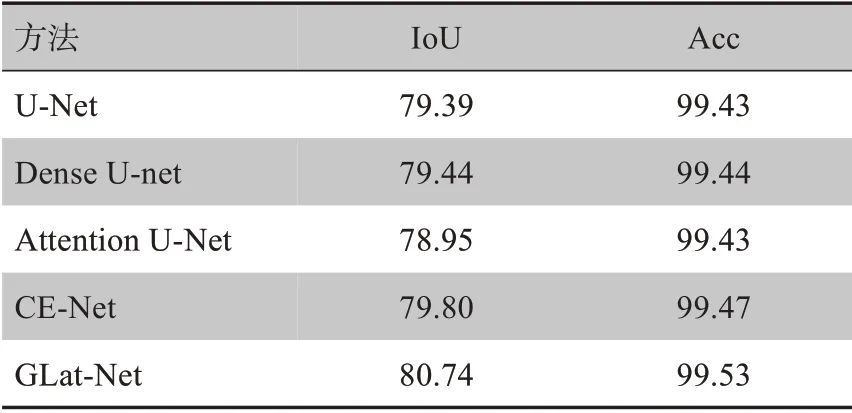

其中,TP,FN,FP,TN 分别代表真阳性,假阴性,假阳性以及真阴性像素的数量。经计算,获得胃部肿瘤分割效果对比如表1所示。

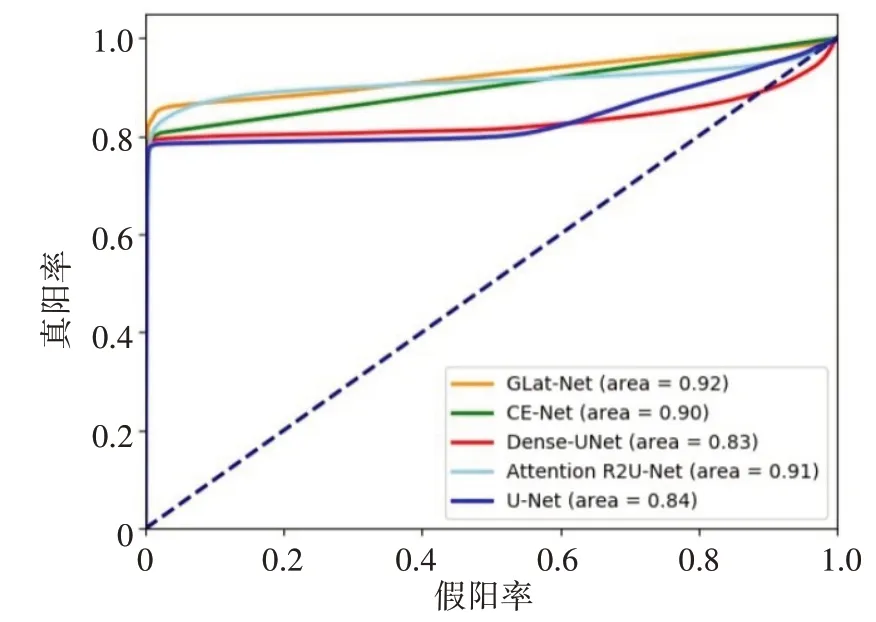

从量化结果可以看到,对于U-Net、Dense U-Net、CE-Net 和Attention U-Net,CE-Net 在肿瘤分割任务上表现更为出色,其在IoU 和Acc 两个指标上分别达到了79.80%和99.47%,而本文提出的GLat-Net 达到了80.74%和99.53%。相较于传统的U-Net,CE-Net在IoU 上提升了0.41%,而GLat-Net 提升了1.35%。由此可以得出GLat-Net 输出的分割结果与标注有更高的重合率,在原图中更多的像素被准确地分类。ROC曲线对比如图6所示。

表1 胃部肿瘤分割的量化结果(%)Tab.1 Quantitative results of gastric tumor segmentation(%)

分割的可视化结果如图7所示,胃部肿瘤的位置被用不同的颜色标出,图7a为CT 原图。作为参考标准,图7b 中,原图中肿瘤的正确位置被用红色标出。图7c~e 分别为U-Net、Attention U-Net 以及CE-Net 的分割可视化结果,分别用绿色、蓝色、青色标记,本实验分割结果图7f 由黄色标出。相较于对比的分割算法,GLat-Net 在肿瘤的提取方面取得了更好的效果。通过对比可视化结果中红色方框标出的区域,发现在U-Net、Attention U-Net 和CE-Net 的结果中存在着间断的现象,且在轮廓上存在较明显的误差,但是GLat-Net生成的结果中并不存在这类问题,肿瘤区域的像素在GL-Attention 的全局局部共同约束下增强了肿瘤区域像素间的相关性,有效地抑制了间断现象的发生,且在轮廓上也有更好的表现。

图6 ROC曲线对比Fig.6 Comparison of ROC curve

图7 胃部肿瘤分割结果Fig.7 Results of gastric tumor segmentation

2.4 消融实验

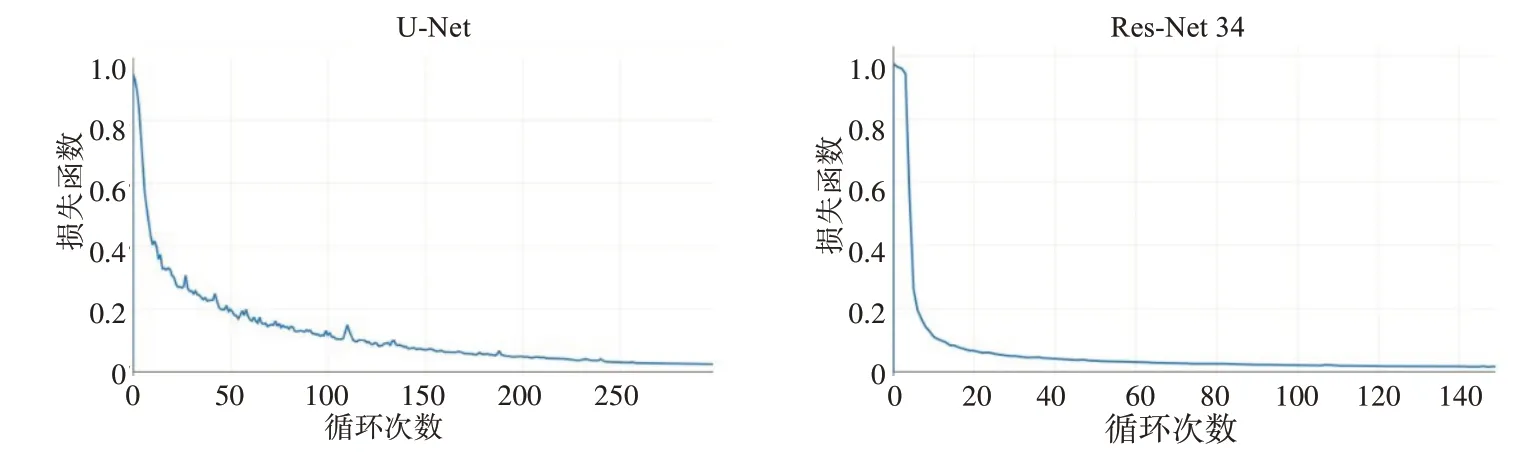

训练曲线图如图8 所指示,相较于U-Net,ResNet-34的曲线收敛地更快。

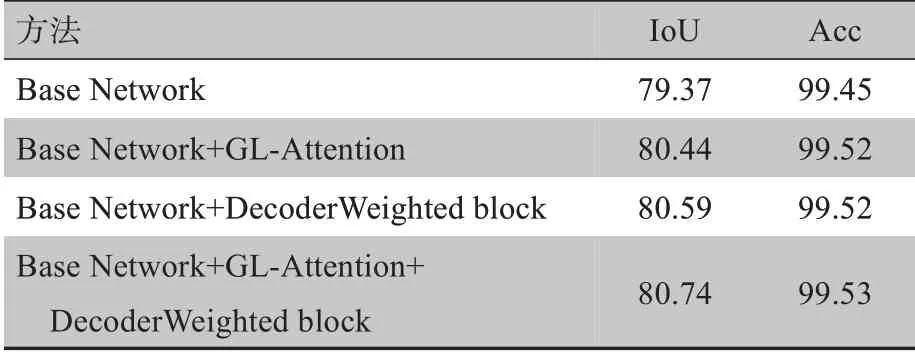

在表2中,给出了权重模块在不同解码模块上的表现,根据实验结果可以证明,当解码权重模块被应用在第2、3、4 层解码层时效果最佳。为了评估网络中各个部分的表现,每个模块都分别单独进行了实验,来验证本文所提出的GLat-Net的有效性。如表3所示,基准模型是以ResNet-34 为主体,由编码和解码两部分组成的U 型结构网络,单独进行实验后,得到IoU 和Acc 结果分别为79.37%和99.45%。添加了本文提出的GL-Attention 模块后,IoU 和Acc 的量化结果分别为80.44%和99.52%,解码权重模块单独作用时,IoU 和Acc 中的量化结果分别为80.59% 和99.52%。综上可见,本文所提出的方法有效地提升了胃肿瘤分割的准确度。

图8 U-Net和Res-Net 34训练曲线图Fig.8 Training curves of U-Net and Res-Net 34

表2 解码权重模块的表现对比(%)Tab.2 Performance comparison of decoder module with or without weight module(%)

表3 消融实验量化结果(%)Tab.3 Quantitative results of ablation experiment(%)

3 总结

通过CT实现胃部肿瘤医学影像的分割和快速诊断成为术前的重要依据。本文提出了一种基于注意力机制的分割模型GLat-Net的胃部肿瘤区域提取方法。该方法结合全局和局部两个视角来提取上下文信息,并根据这些信息来突出有效特征和抑制无用特征,降低了CT影像上肿瘤不确定性特征的干扰;同时采用了解码权重模块来学习通道间的相关性,通过对通道赋予权重提升了分割效果。实验证明该方法能够在胃部肿瘤分割任务上得到准确的分割结果,与前沿分割网络CE-Net相比,该方法在交并比上提升了0.94%。