人脸识别视频压缩感知跟踪算法

宋 强,张 颖

(辽宁科技大学 电子与信息工程学院,辽宁 鞍山 114051)

视频压缩感知的目标跟踪技术是计算机视觉领域的重要研究方向之一,广泛应用于人员定位、智能交通、智慧城市等人工智能领域[1]。将视频压缩感知的目标跟踪技术应用到动态人脸识别上,能够提高人脸识别的自动化、信息化、智能化水平,分析目标行程轨迹,确定目标信息[2]。视频监控下环境因素多变,如光照不均、人脸图像存在遮挡、目标运动速度过快等,直接应用目标跟踪方法无法捕获目标,轨迹分析效果也不够理想。

视频目标跟踪算法根据网络结构将任务分解成跟踪、检测和学习3个部分[3]。跟踪部分根据提取到的目标人脸特征,建立帧之间的数据模型,用于在视频中跟踪目标;检测部分通过训练分类器,用于检测视频中目标出现的下一帧图像位置;学习部分进行评估更新。目标跟踪算法中,特征越多准确率越高,但过多的特征提取运算会增加复杂度。视频压缩感知方法以低通带限实现数据采样,并从采样数据中精准恢复原始信号,提高运算效率。视觉目标跟踪算法主要分为生成式跟踪算法和判别式跟踪算法。生成式跟踪算法以当前帧为基础建立目标匹配模型,在下一帧图像的相关范围内寻找与目标模型匹配效果最优的区域;判别式跟踪算法提取的图像特征具有判别性,根据特征寻找目标区域的边缘,将其从背景中分离出来,反映异类数据间的差异。在监控视频环境中,判别式跟踪算法利用人脸图像信息与背景信息进行图像跟踪。Bewley等[4]提出SORT算法,利用卡尔曼滤波[5]进行目标的运动信息预测。周平平等[6]采用粒子滤波算法进行跟踪,融合人脸肤色和边缘特征,具有自适应性。已有的跟踪算法虽针对人脸识别视频跟踪具有较好的效果,但对监控视频的数据处理时间较长,分析较慢,跟踪不稳定。本文针对视频监控下的目标跟踪问题,为了加快视频数据处理的速度,提升目标图像跟踪的稳定性和精确性,提出一种人脸识别视频压缩感知跟踪算法,依据动态压缩感知(Dynamic compressive sensing,DCS)理论,采用贝叶斯压缩感知(Bayesian compressive sensing,BCS)算法,根据人脸信息的特征实现对目标图像信息的动态跟踪。

1 动态视频压缩感知算法

压缩感知理论是一种新的数据处理模式,在采样过程中实现数据压缩,并使用低秩随机测量矩阵压缩稀疏信号。传统的压缩感知理论通过分割的手段将动态信号转化为静态信号,忽略视频信号在时间维度上的特性,缺乏实时性。为此,本文选用动态压缩感知理论框架。动态压缩感知理论主要包括动态信号的稀疏表示、随机测量矩阵的选取以及信号重构。采用Ji等[7]提出的贝叶斯压缩感知(Bayesian compressive sensing,BCS)算法,利用统计学中的稀疏朴素贝叶斯分类学习方法进行信号重构,实现动态压缩感知的建模过程。

动态信号具有时变性,设Xt为经过稀疏矩阵投影的稀疏信号,则动态压缩感知模型的状态空间方程为

式中:Yt表示观测方程;ft表示状态空间方程中的状态转移函数;At为观测矩阵;vt为过程噪声;ωt为观测噪声,通常默认成均值为0的高斯白噪声。

动态视频压缩感知采用少量采样观测信号表示原始信号所包含的所有信息,实现对信号的降维处理,减少计算量。利用随机测量矩阵P对高维原始信号的特征空间向量X向低维空间进行压缩投影,获取低维压缩特征空间向量。动态压缩感知跟踪算法模型如图1所示。

图1 动态压缩感知跟踪算法模型图Fig.1 Model diagram of dynamic compressed sensing tracking algorithm

2 图像预处理

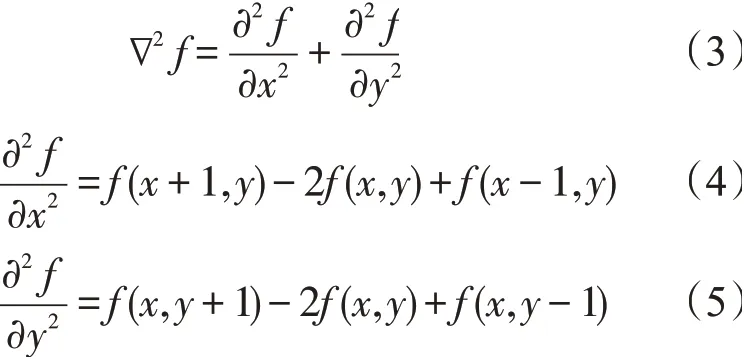

为了更易提取目标图像,采用图像尖锐化处理,提升人脸图像边缘及纹理对比度,使亮度增加,突出更多细节[8]。事实上,由于环境因素影响,图像可能不清楚,识别效果不明显,但图像细节在经过尖锐化处理后更突出,便于后续的人脸识别。图像尖锐化计算式

式中:∇2f为二元图像函数的拉普拉斯变换。

因此

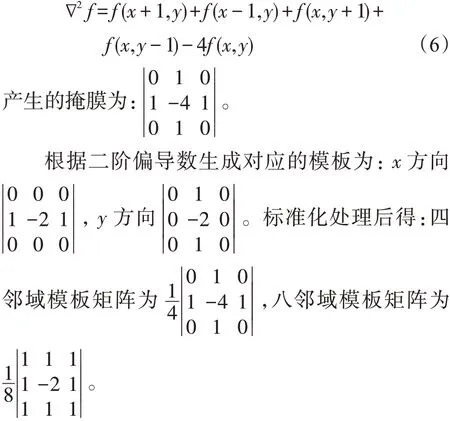

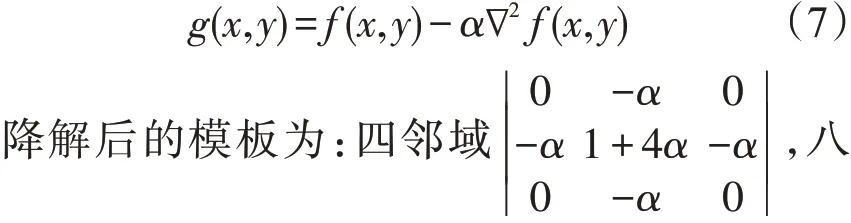

为了避免颗粒扩散导致的模糊问题,将图像降解。把图像边缘线和突出点堆叠处理,生成锐化图像。将处理前和处理后的图像叠加,突出锐化效果,同时又能恢复背景信息。降解函数为

将原图像转化成灰度二值化图像,再对四邻域和八邻域的二值图像锐化处理,使边界特征突出,效果如图2所示。

图2 四邻域与八邻域锐化效果图Fig.2 Sharpening renderings of 4 neighborhoods and 8 neighborhoods

光照强度不均匀对人脸识别准确率的影响较大,需要对锐化处理后的图像归一化处理,消除光照强度的影响,即光照修正处理方法。归一化处理修正式为

式中:(m,n)为图像像素坐标;S为原始图像;S′为归一化处理后的图像;μ为图像均值;σ为图像标准差;c为常数,一般取为1。

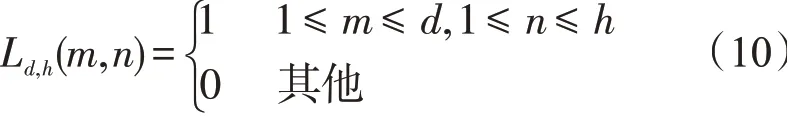

提取图像的距离不同,识别准确率也存在差异。为了减小差异,选取一组尺寸不同的矩形滤波器,对归一化后的样本图像分别进行卷积运算,提取样本特征,获取处理后的图像

式中:Ld,h(m,n)为滤波器形式;(m,n)为图像像素坐标;d,h分别为滤波器的宽度和高度。归一化矩形滤波器形式为

将通过矩形滤波器处理后的样本图像依次展开成一个M·N维的列向量X(m,n),其中X=(X1,X2,…,XM)T是样本归一化后的特征向量。

滤波器锐化归一化可以让图像更光滑,效果如图3所示。

3 Haar-like特征提取

Haar-like特征又称矩形特征,在特定范围内,利用小块区域表示图像特征。Haar-like特征根据目标区域的图像颜色深浅不同来描述人脸特征,对图像的边缘和线条比较敏感。Haar-like特征值数学表达式为

图3 图像预处理过程效果图Fig.3 Effect images of image preprocessing

式中:ωi表示权值矩阵;N表示矩形特征值的个数;RectSum(γi)表示样本图像所有矩形特征值之和。

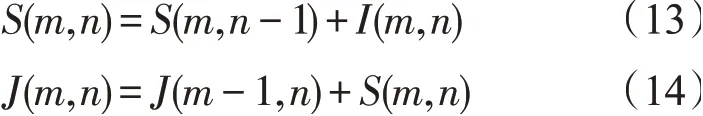

通过扫描大量的样本窗口,计算所有样本窗口的子图像特征值,其特征值为所检测图像中的矩形灰度像素差。该过程会产生大量的运算。与此同时,为了保持图像尺度不变性,会进一步增加计算量,使人脸检测速度及分类器训练效率降低。为了在压缩投影中提高特征向量值的运算效率,采用积分图算法快速计算矩形区域之和及其平方和,降低运算量,提高运算速率[9]。积分图运算式为

式中:J(m,n)表示图像在像素为(m,n)处的积分值;H(m′,n′)表示图像在像素为(m′,n′)处的灰度值。

积分图为每一幅图像建立专属查找表,在积分计算阶段可直接查找并完成卷积线性时间运算,使卷积运算的时间与矩形区域窗口大小没有关联。

计算初始图像积分,并在后续的跟踪过程中,通过行的累积求和的形式完成积分运算。积分运算公式为

其中,初始图像积分中,S(0,-1)=0,J(-1,0)=0。先计算S(m,n),再计算J(m,n)。

4 级联分类器构建及更新

在视频监控下目标跟踪过程中,动态目标跟踪具有比静态目标跟踪更稳定、更精准定位的优点。本文以正负样本的数据特征构建目标模型,通过及时更新图像识别分类器,实现动态目标跟踪过程,并对目标实现轨迹分析。

通过监控视频的帧截取,选用第i帧图像中目标人脸作为样本图像,采集目标人脸图像区域内和区域外的图像作为正负样本并进行特征提取,构建多维度图像特征向量,并通过稀疏随机矩阵降维。再利用降维后的向量构建目标模型,实现分类器的构建,并对分类器进行学习训练。在i+1帧图像中,对跟踪到的目标图像采样,并通过若干矩形窗口提取目标区域特征,将高维多尺度特征向量通过稀疏随机矩阵降维处理,最后利用训练好的分类器对特征向量分类,将最符合的矩形扫描窗口作为跟踪目标图像的具体位置,并更新分类器。重复操作,实现分类器的构建及更新。

4.1 朴素贝叶斯分类器的应用

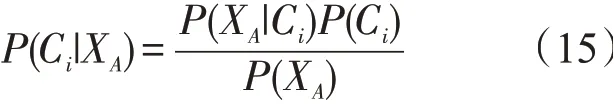

贝叶斯分类是一种归纳推理的理论,朴素贝叶斯模型是基于贝叶斯理论且应用最为广泛的分类模型之一[10]。在概率图模型中,朴素贝叶斯模型被划分为判别模型,具有坚实的数学基础和稳定的分类效率。该分类器模型的估计参数少,针对缺失数据具有良好的鲁棒性。本文采用目标样本与背景样本的特征作为分类器模型构建训练的数据向量,属性相关性小,使朴素贝叶斯模型的算法简单,降低分类误差率,提升总体性能。朴素贝叶斯分类器模型的数学表达式为

式中:Ci为数据属性类别;XA为测试样本。

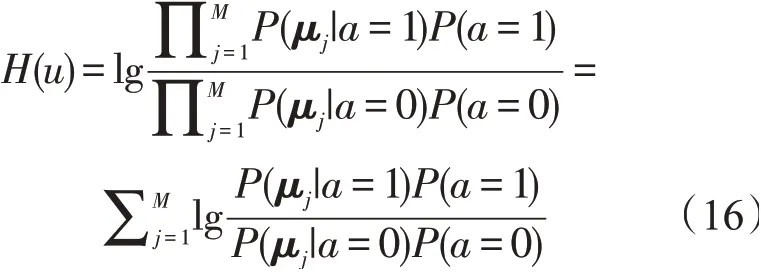

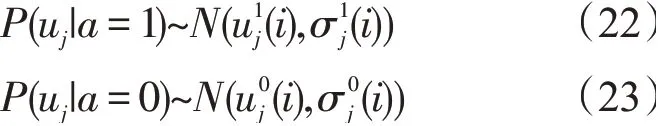

高维随机向量的投影服从高斯分布[11],设样本XA中的低维特征向量为μ,且各个元素都独立分布。假定正负样本的先验概率相等,通过朴素贝叶斯对特征向量分类。设a为样本标签,正样本用a=1表示,负样本用a=0表示。获取贝叶斯分类器响应为

式中:H(u)表示低维特征向量为μ时的贝叶斯分类器响应;a为样本标签,且a∈{0,1};P(a=1)和P(a=0)分别表示正负样本先验概率;μj为样本图像XA中的第j个特征。

4.2 Adaboost算法与分类器级联

在朴素贝叶斯分类器模型的基础上,引入Boosting技术[12]中的Adaboost算法,组合若干个朴素贝叶斯分类器模型。Adaboost算法自适应能力强,把强分类器分解成若干个弱分类器的线性组合,并通过不同的训练集样本对每个贝叶斯弱分类器学习训练,提高Adaboost算法贝叶斯级联分类器的识别精度。

Adaboost算法中,弱分类器表达式为

式中:h(x,f,p,θ)表示弱分类器;x表示为子窗口图像;f(x)为子窗口的特征函数;θ表示为f(x)函数的阙值,弱分类过程就是得出该函数阙值的过程。

由弱分类器构建强分类器的步骤如下。

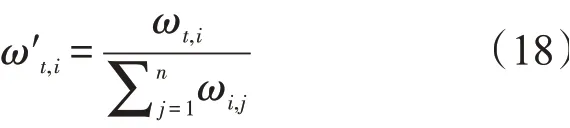

图像样本为XA,则n个训练集样本表示为,则Xi为样本图像,ai表示为正或负样本,且ai∈{0,1}。初始化操作,令t=1,对每个样本权重ωt,i初始化,再将权重归一化处理,数学表达式为

式中:ωt,i表示第t次迭代中第i个样本的权重。

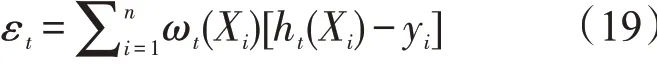

对弱分类器训练,计算弱分类器上对应特征的加权错误率,数学表达式为

式中:εt为弱分类器错误率;Xi为图像样本;yi∈(-1,1)。

经过对比,εt为错误率最小的弱分类器,即为最佳弱分类器。通过弱分类器εt更新样本的分布,数学表达式为

式中:ωt+1表示t+1时刻权重;βt是一个迭代系数。

若测试样本Xi分类正确,则有εt=0;若分类错误,则有

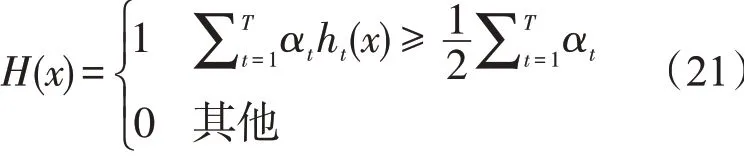

结合上述运算,得到级联强分类器数学表达式

其中α

采用级联Adaboost算法的朴素贝叶斯分类器根据各个强分类器的复杂程度由低到高进行排序。若窗口判定图像信息为非人脸图像,则将其排除,提高检测效率。运算流程如图4表示。

图4 朴素贝叶斯级联分类器结构图Fig.4 Structure diagram of Naive Bayesian cascade classifier

分类器响应H(u)中的条件概率为

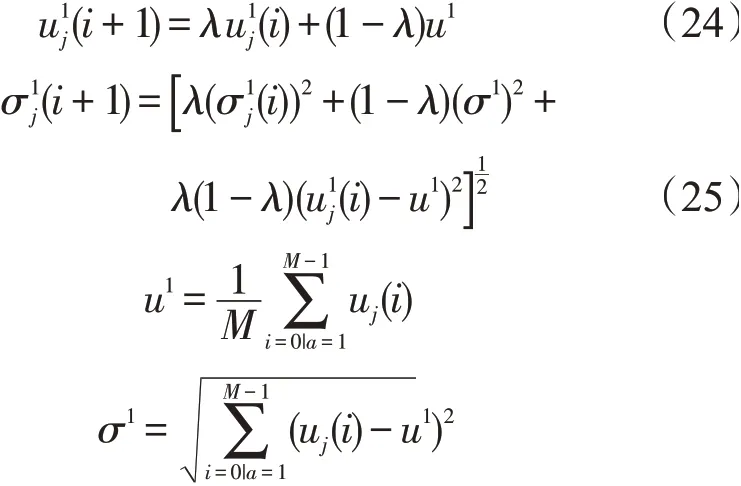

在i+1帧图像中的目标周围采样若干个正负样本,并进行特征提取,根据运算获取所有正负样本的均值u1和方差σ1。利用分类更新对目标模型更新,实现目标动态跟踪。分类更新数学表达式为

式中:λ为学习因子,λ>0;M为正负样本总数;uj(i)表示为第i帧样本图像的第j个特征。

5 仿真实验

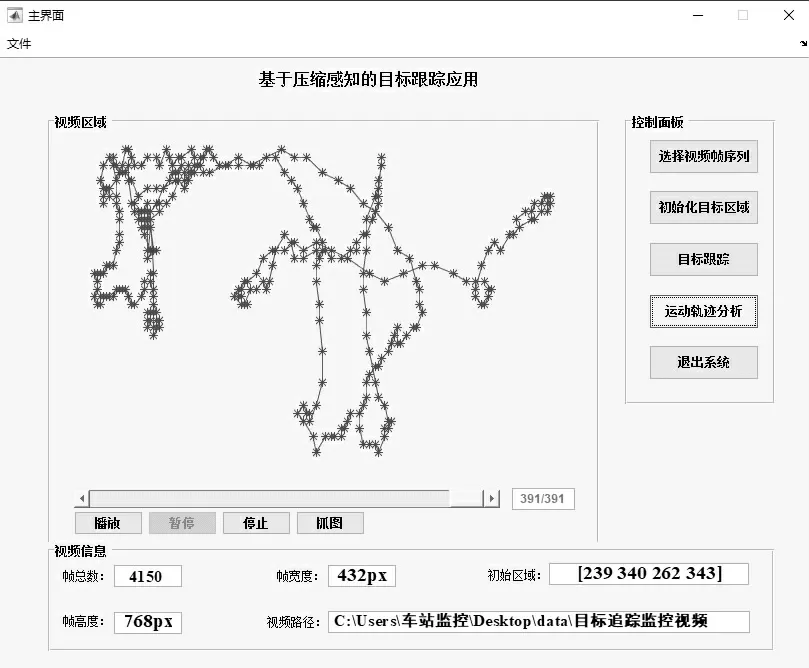

采用MATLAB调用OpenCV中的模块进行系统仿真。根据监控视频中的人物目标图像,通过图像处理模仿不同环境下的目标人物图像状态,再将若干张图片组合成监控小视频。然后采用软件中的GUI功能模块设计视频压缩感知目标跟踪系统,对视频帧截取。最后通过人脸图像识别,实现目标跟踪,并进行目标运动轨迹分析。

为了测试该算法针对视频中目标移动、遮挡、光照不均等状态下的处理效果,选用某车站视频监控下的人物目标图像的某一帧图像具体分析,如图5所示。在光照较亮、较暗、人脸有口罩遮挡和人脸图像信息移动到边界这四种条件下,本文算法都可以捕捉人脸信息,并对目标人物进行轨迹分析,如图6所示。

图5 不同环境下目标跟踪分析Fig.5 Target tracking analysis in different environments

图6 目标轨迹分析Fig.6 Target trajectory analysis

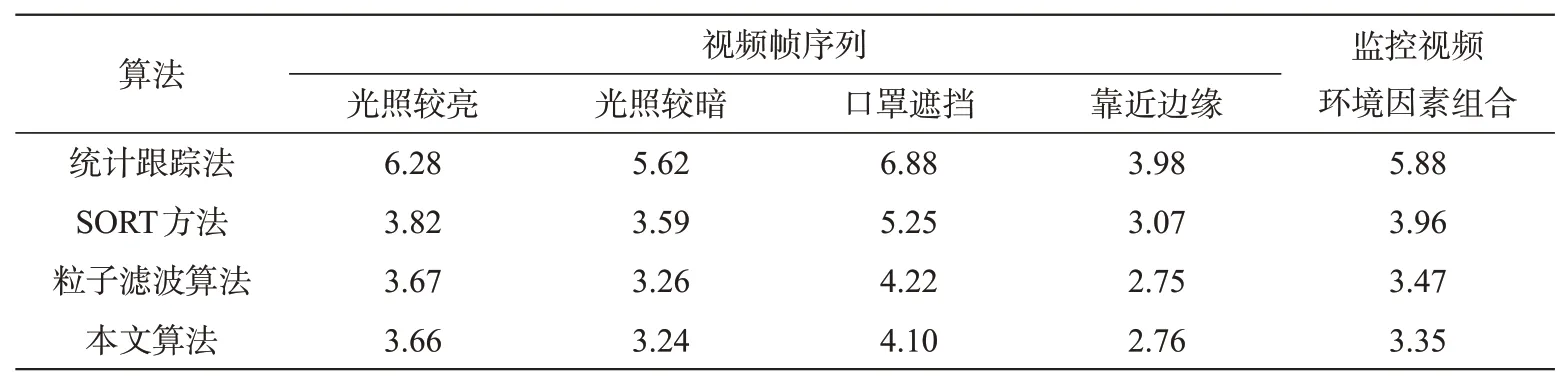

针对上述处理后的监控小视频,将本文算法与现有的人脸识别视频目标跟踪算法进行对比,跟踪漏检率如表1所示。本文算法在这四种环境下的跟踪漏检率均为最低,表明该算法的目标跟踪稳定性和准确性较好。

6 结论

本文提出人脸识别视频压缩感知跟踪算法,用以处理视频监控中光照强度不同、遮挡、快速移动的人脸图像。将动态压缩感知算法应用在人脸识别监控视频中,根据提取的人脸Haar-like特征构建级联分类器进行人脸识别,进而实现动态的目标人脸跟踪。与现有的人脸识别视频目标跟踪算法相比,本文算法跟踪漏检率较低,对视频中人脸图像移动、遮挡及光照强度度不均匀、快速变化等情况具有一定的鲁棒性,可以实现有效的目标轨迹分析。适合应用在刑侦以及疫情防控等领域。

表1 不同环境下目标人脸跟踪算法的跟踪漏检率,%Tab.1 Omission ratio of target face tracking algorithm in different environments,%