基于时间序列的团雾监测与预警系统

王 琦,冯海霞*,田 俊,张兴梓,王帅琦,赵军学,柴耀焜

(1.山东交通学院交通与物流工程学院,济南 250023;2.山东省公安厅交通管理局,济南 250000;3.北京合众伟奇科技股份有限公司,北京 100192)

团雾是我国冬春季多发的一种交通气象灾害,具有发生快、区域性强和预测预报难等特征,被称为交通安全的“流动杀手”。团雾的发生会引起能见度突然降低、路面附着系数减小以及驾驶人心理负担增加,极易发生车辆打滑、追尾等现象,对高速公路交通安全极具危害性,容易酿成重大交通事故。2019年10月3日6时30分许,G36宁洛高速下行线196 K路段,因突发团雾相继发生4起交通事故[1],共造成10人死亡,17辆车不同程度受损。高速公路“团雾”多发的路段每年都在增加,团雾的监测预警成为交通安全亟须解决的重要问题。

目前,器测法和图像检测法是团雾的主要监测方法。器测法分为透射法和散射法,利用仪器来测量一个区域范围内的气象光学数据,通过对数据进行科学分析得到较为精准的能见度,但能见度仪本身成本高、布设维修都较麻烦,且不能全方位布设,无法有效实时检测团雾的发生,虽然利用传感器检测准确性较高,但容易受外界因素(排放物、烟尘等)干扰。图像检测法则利用计算机图像处理技术有效避免了器测法的缺点,减轻了设备处理的负担[2]。HAUTIERE等[3]提出使用单个摄像头监测道路与天空,以此估算能见度距离。许志成[4]、郭尚书[5]等基于图像暗通道理论,提出一种团雾检测预报的算法。苗苗[6]提出一种基于高清视频的能见度检测算法。窦菲等[7]利用OpenCV实验提出了嵌入式硬件平台的搭建方案,着重对视频图像进行分析并对跟踪算法进行优化。许倩[8]在能见度检测相关理论基础上分析了高速公路对能见度的检测需求与检测可行性。刘建磊和刘晓亮[9]提出了一种基于视频图像对比度的团雾检测算法。此类研究方法大多基于单幅图像、算法复杂程度较高或需要提取车道标志、标线等为参照物,容易导致图像特征信息不明显、能见度测量效率不高和不够精准等问题,从而降低了实用性。同时,各类基于视频图像的团雾监测和预警系统也层出不穷,杨安博等[10]基于云计算平台设计了团雾监测与预警系统。孙良恒[11]基于Android设计了团雾预警系统并加以实现。王健等[12]针对雾气的消光性原理,提出高速公路团雾实时检测与预警系统。龚芳[13]将气象学技术、嵌入式系统技术、数字传感器技术等领域进行了系统集成,对高速公路团雾预警系统进行了设计研究。冯民学[14]基于ITS技术研究了低能见度浓雾监测与预警系统。李易润[15]基于视频分析技术,设计了高速公路团雾预警车载终端系统。徐放[16]提出了一种基于图像分析的团雾检测预警系统。以上系统利用较多技术融合,数据处理准确,但过程繁杂,容易导致漏洞的出现或运行速度较慢等问题。目前,基于视频的团雾检测系统仍是针对能见度的监测居多,经济实用的道路团雾监测系统仍然较少。针对当前问题,研建高效的团雾监测与预警模型,构建快速、准确、实时和经济的团雾监测与预警系统,已成为当前迫切需要解决的问题,本文引入时间序列的概念,固定时间间隔,将提取的背景图像做成动态的背景序列,按时间前后进行对比,分析道路背景图像特征突变情况,构建监测模型,搭建监测与预警平台,实现不同路段、道路全程的团雾监测。

1 系统构成

目前团雾检测预警系统主要依托于互联网,通过海量信息的搜集传输和归纳分析以达到团雾监测与警报的目的。本文提出的系统利用传感技术达到监测信息的传输与发布,无需过多复杂端口,有效保证了信息发布的便捷性、时效性和准确性。

1.1 系统架构

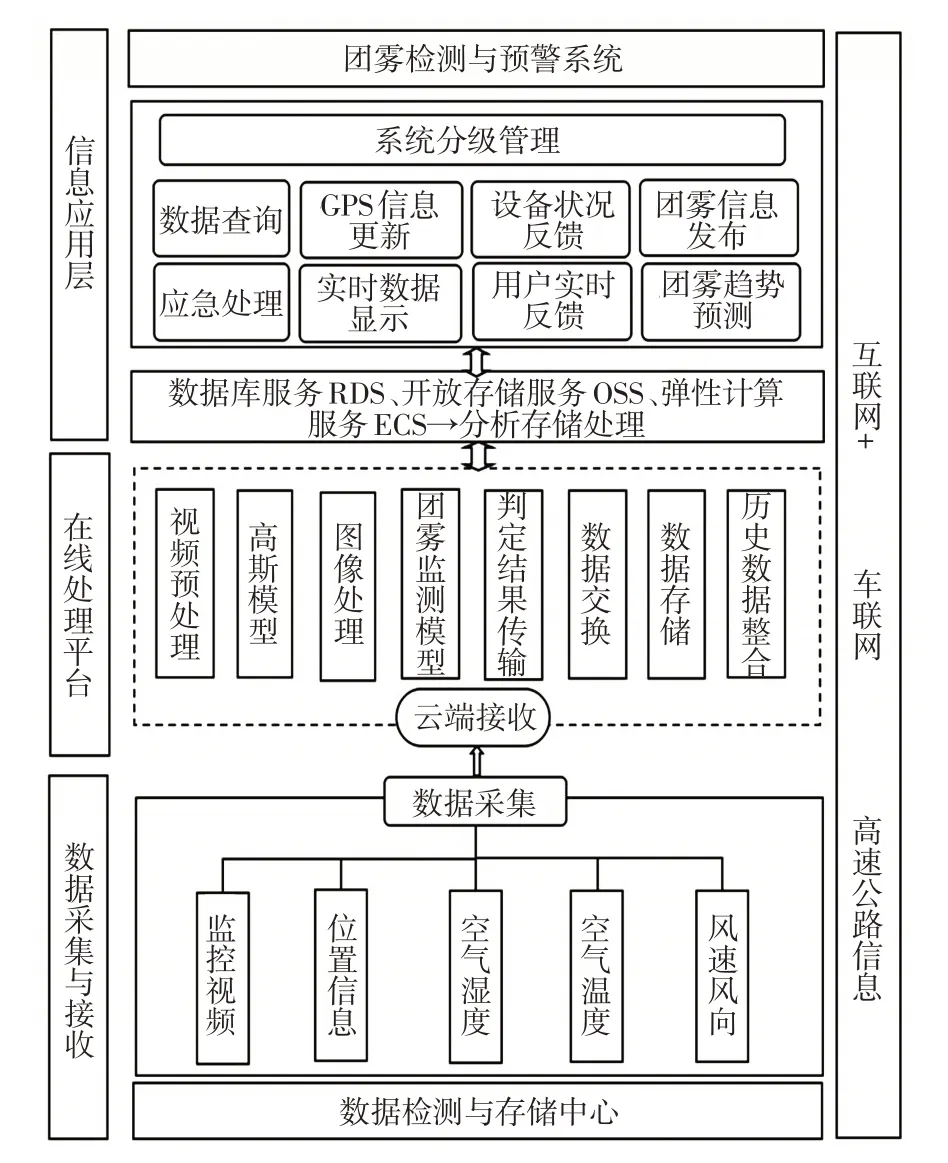

1)总体架构设计。团雾检测与预警系统由传感器技术设备,包括摄像头、全球定位系统(global positioning system,GPS);数据在线处理平台,包括数据处理、结果判定和信息留存管理等;信息应用层,包括信息发布、趋势预测等部分功能。团雾检测预警系统总体架构如图1所示。

图1 团雾监测预警系统总体架构Fig.1 Overall structure of fog monitoring and early warning system

2)功能设计。数据采集利用高速监控、气象站、高速监测站及驾驶员反馈等多方渠道获取实时准确数据,将搜集到的数据初步分类汇总上传至数据库,由专用云端接收,通过团雾监测模型分析计算,从而对道路实况和能见度变化进行实时掌握。当团雾发生时,及时通过高速灯牌、广播等途径发出警报。在实际应用中,可以通过位置信息整合出团雾多发地,对该点加大监控力度,如:路面状况、大气温度与湿度等气象数据。当临近团雾突发时,增多单位时间内图像分析的帧数,第一时间检测出团雾并发出警报。

3)管理员模块。在此系统中,视频信息的接收是整个流程的重点,当某地视频设备或文件发生损坏,需及时报备修整,避免监控力度不到位而影响监测系统的运行效率。管理员模块的实现主要在于两方面:第一系统故障的排除与系统维护,保证系统的正常运行,及时发现流程中容易报错的点并加以记录,生成系统运作日志。第二系统权限的设定,系统每个模块需要不同的专业人员操作,保证系统不被恶意篡改或非专业人员操作。

1.2 团雾系统监测步骤

1)数据采集与传输。高速实时监控视频、气象等信息进行采集,传输至云端。

2)数据预处理。对视频图像进行预处理(排除不清晰、残缺时段的视频等),将视频每间隔10 s截取为一段,利用高斯模型剔除运动目标,得到相应时段背景图像;按相应时序将背景图像排列成动态的时间序列组,计算每张背景图像的对比度、熵值、灰度值和边缘特征等图像参数。

3)监测模型构建。基于时间序列的背景图像特征,构建基于时间序列的能见度监测模型。

4)依据实验结果设置团雾判断条件。当N1摄像头数据满足对比度小于215且灰度值小于95时,将该背景直方图划分为64个区,每个区有4个灰度等级,通过线条弧度、角度及余弦值等计算该背景图与团雾状态下即能见度小于0.11 km时背景图的边缘曲线相似度,若高于95%则调取N2摄像头的视频数据,若读取结果与N1相似,则立刻发出警报并利用N3、N4等多个摄像头数据判断团雾大致范围。团雾判断流程图如图2所示。(注:Ni摄像头的i为摄像头编号,N1为路段中随机挑选的第一个摄像头,N2为顺应车流方向的第2个临近摄像头,以此类推Ni的第i个摄像头)。

图2 团雾判定流程图Fig.2 Fog determination flow chart

2 数据与方法

基于时间序列的能见度监测模型的构建是本监测系统的关键。本文以济南绕城高速路段为例,对系统的运行、监测模型的构建、结果分析等进行说明。

2.1 研究区和数据

1)研究区简介图。研究区处于京沪、胶济铁路十字交叉点,是济南绕城高速G2001线K3+0.20 km处摄像头及前后相邻摄影头覆盖区域,G2001线是国道主干线北京至上海、北京至福州和青岛银川在山东省会济南外围联网形成的绕城高速公路。

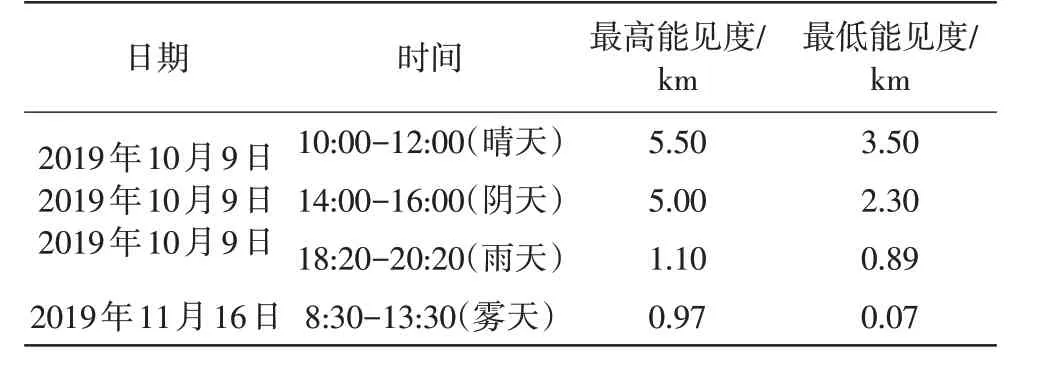

2)数据。使用的数据采集于济南市气象观测站架设的高清视频监控设备,选择雾天(包含团雾)、阴天、晴天和雨天4种常见天气,共录得4个时段实验视频,并取得该时段视频路段对应的能见度数据,实验视频数据如表1所示,其中时间为北京时间。

表1 实验视频数据Tab.1 Experimental video data

2.2 监测模型构建

高效的能见度监测模型是团雾监测系统的核心,模型构建主要利用高斯混合模型与时间序列图像特征分析拟合,本节介绍各类方法的选取及用途,并通过模型构建、输出结果比较等证明本文提出的模型的有效性和可行性。

1)高斯混合模型。利用文献[17]中高斯混合模型(gaussian mixture model,GMM)对运动目标的背景提取建模,背景图像的各个像素点分别用K个高斯成分组成的高斯模型来建模,获取当前帧图像后更新模型参数,用当前像素与混合高斯模型匹配,剔除运动目标,得到更新后的背景图像。

2)基于时间序列的图像特征提取。按时间顺序排列的图像经处理后得到各类特征值,这些特征值所构成的一组数据序列即为时间序列。本文参照图像的特征值主要包括:边缘特征、对比度和灰度值。由雾气引起的能见度变化给予人直观的感觉是视场内物体清晰与模糊的变化。场景的模糊与否体现在是否存在丰富的细节。在图像处理与理解技术中,这些细节在空域上体现为相邻像素的灰度值梯度,在能见度越低的图像中梯度越小,边缘越不明显。

(1)边缘特征。边缘是描述图像的最直观最基础的特征。本文采用了索贝尔算子(Sobel)[18]提取边缘特征,Sobel算子是计算机视觉领域的一种重要处理方法,利用梯度信息对图像进行边缘检测,通过计算每个像素的梯度,同时给出不同方向从明到暗的最大变化及其变化率,得到图像的边缘特征。不同能见度边缘图像如图3所示,其能见度依次为0.113 km、0.203 km、0.310 km、0.405 km、0.520 km、0.601 km、0.705 km、0.805 km和0.960 km。每幅图能见度相差约为0.100 km左右,边缘显示程度明显不同,纹理特征明显增强。能见度越高的背景图中,纹理延伸越远,近距离线条也更为清晰流畅。

图3 不同能见度边缘图像Fig.3 Different visibility edge image

(2)图像灰度值的提取。不同能见度图像所对应灰度值不同,各类色块的灰度均有一定程度的变化。色块颜色越接近全白或全黑,变化幅度越大。空气质量越差(即能见度越低),变化幅度越大。同一背景不同能见度的灰度直方图,如图4所示。能见度分别为0.103 km、0.520 km和0.960 km,能见度越高,灰度值在50~130左右的数量越少,降低幅度明显。说明不同能见度情况下,对灰度值影响较大。

图4 不同能见度的灰度直方图Fig.4 Gray histogram of different visibility

(3)图像对比度的提取。对比度即亮暗程度的对比,通常表现了图像画质的清晰程度。有雾视频图像和无雾视频图像最主要的区别在于对比度的不同。在雾天中悬浮颗粒对大气光散射和吸收的影响,使得有雾视频图像的对比度远远低于无雾视频图像。其计算公式为:

式中,δ(i,j)=| |i-j,即相邻像素间灰度差;Pδ(i,j)为相邻像素间的灰度差δ的像素分布概率。

团雾具有突发性,其发生会使能见度迅速下降,图中两端散点较为密集,能见度距离主要集中于0.080~0.300 km、0.900~0.980 km之间,从轻雾到团雾的变化时间较短,也验证了团雾的突发性。能见度与对比度的相关性,如图5所示,能见度与对比度相关系数为0.955 8,不同能见度下,对比度特征明显不同,对比度随能见度的升高呈增长趋势。

图5 能见度与对比度的相关性Fig.5 Correlation between visibility and contrast

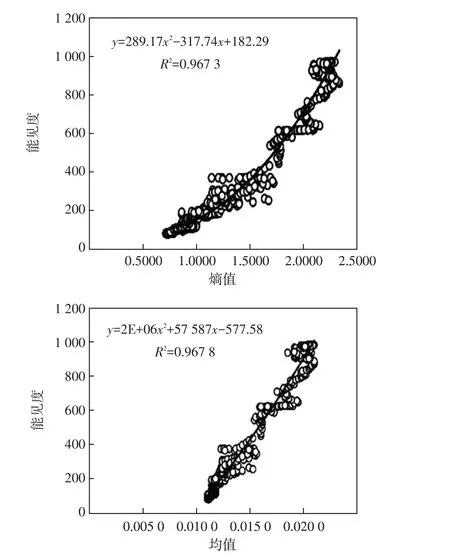

3)基于时间序列图像的能见度监测模型构建。通过上节对图像进行数据化处理,将特征值提取并进行综合分析,可知特征值与能见度具有较强相关性,其中对比度线性相关系数可达0.9558,呈正相关,熵值与均值的相关系数分别为0.967 4和0.967 8,能见度与熵值/均值的相关性,如图6所示。同样考虑计算量大等因素,拟利用收敛速度较快、鲁棒性强的差分进化算法进行线性拟合。

图6 能见度与熵值/均值的相关性Fig.6 Correlation between visibility and mean/entropy

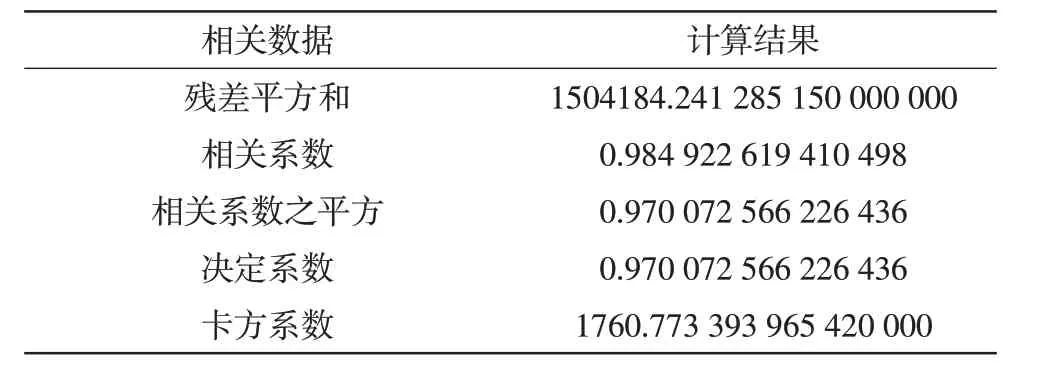

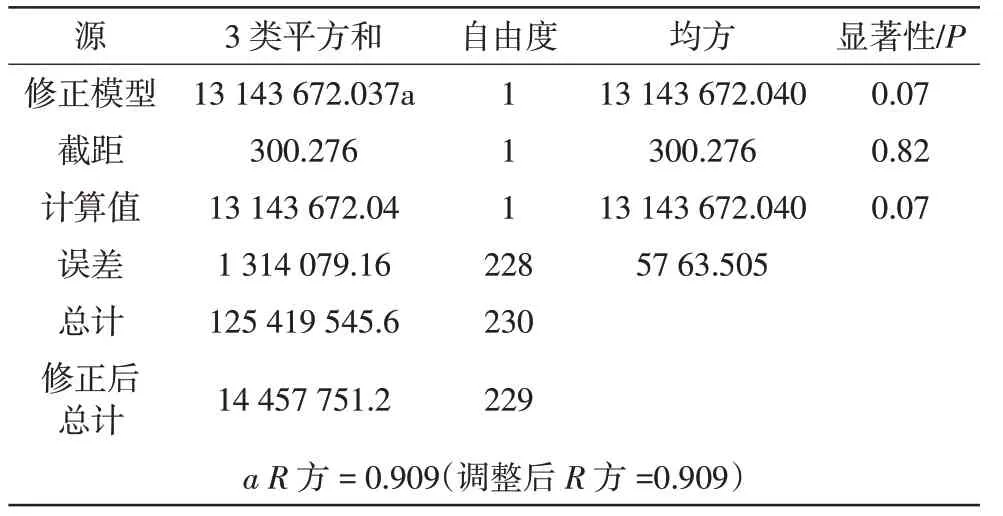

将2018年11月16日5个小时雾天数据分为两段,前3小时用于拟合公式,后两小时及10月9日数据用于验证。利用改进差分进化算法拟合出4个自变量与能见度之间的关系,拟合相关数据如表2所示,共迭代1 437次。计算达到收敛标准后停止。设能见度为Y,均值为X1,对比度为X2,熵值为X3,灰度值为X4。拟合公式模型为:

表2 拟合相关数据Tab.2 Fit the relevant data

经计算,beta0为-436.80,beta1为85 291.60,beta2为3.22,beta3为-170.67,beta4为-79.88,误差小于10 m。

由表2中相关系数值大于0.95可知,变量间关系相关性较强,该拟合公式所得结果与实际数据基本吻合,拟合计算值与实测值显著性均小于0.05,通过显著性检验。

3 结果分析

3.1 基于时间序列图像的能见度监测模型验证

将雾分为4种类型,每类样本数量为200。无雾状况下可视距离为1.000 km以上;轻雾状况下可视距离为0.300~1.000 km;中雾状况下可视距离为0.100~0.300 km;团雾状况下可视距离为0.100 km以下。其中,有雾样本为11月16日预留2 h数据,无雾样本为10月9日预留部分数据。能见度差异检验如表3所示,P值大于0.050,计算值与实测值通过显著性检验。

表3 能见度差异检验Tab.3 Visibility difference test

3.2 能见度监测检测准确率比较

针对能见度检测,定量分析本文模型准确率,根据实验结果可以看出,本文模型检测团雾效果明显优于文献[10],本文准确率平均值约为95.8%,文献[10]约为94%,多特征值分析及时间序列背景像元分析效果准确率更高。

3.3 团雾监测与预警

团雾监测。据当前数据统计显示,团雾发生范围约为1~5 km之间。利用拟合公式对预处理的图像进行初步筛选,当能见度低于0.110 km时,首先调取相邻时间背景图像,观察图像特征值数据是否发生突变,由实验数据计算可得:当背景图像对比度差值大于10,灰度值差值大于5时,能见度浮动范围约为0.150 km;对比度小于215时,95.65%的能见度是小于0.110 km的;灰度值小于95时,96.08%的能见度时小于0.110 km。其次,假设当前摄像头为N0,调用相邻10 km内摄像头N1、N2...的监控数据,观察能见度低于0.110 km的雾范围是否在6 km之内,进行辅助判读。

以此判定条件进行筛选检测,结果有效监测到了预留验证数据时间发生的团雾。

预警。通过判定条件进行监测,再通过边缘特征图像检测图像轮廓曲线,若该图像与低能见度状态下图像边缘曲线相似度高于95%,则需通过各类渠道进行团雾预警;反之,则进行雾预警。

4 结论

本文针对目前团雾监测存在的问题,构建了基于时间序列图像的能见度监测模型,搭建了基于时间序列的团雾监测与预警系统。本文利用混合高斯模型剔除运动目标,建立视频图像的背景时间序列,利用多图像特征构建了基于时间序列背景图像的能见度监测模型,极大地提高了能见度的监测精度。相邻摄影头数据的对比分析,提高了团雾监测精度。系统主要利用海量的监控视频数据,系统不需要额外增加昂贵的仪器,即可实现不同路段、道路全程的团雾监测,有效降低系统运行的成本,降低了维护难度,经济效益显著,对保障道路交通安全、减少交通事故、降低伤亡率和减少经济损失有着重要意义,应用市场广阔。