基于深度卷积神经网络的田间麦穗密度估计及计数

鲍文霞,张 鑫,胡根生,黄林生,梁 栋,林 泽

基于深度卷积神经网络的田间麦穗密度估计及计数

鲍文霞,张 鑫,胡根生,黄林生※,梁 栋,林 泽

(安徽大学农业生态大数据分析与应用技术国家地方联合工程研究中心,合肥 230601)

小麦的最终产量可由单位面积的小麦麦穗数侧面反映,为了快速准确统计小麦麦穗数,该研究给出一种在单幅图像上利用深度卷积神经网络估计田间麦穗密度图并进行麦穗计数的方法。首先对采集的田间小麦图像进行直方图均衡化及阈值分割预处理,以减少图像中光照及一些复杂背景对计数的影响;然后根据灌浆期田间小麦图像麦穗密集的特点,引入拥挤场景识别网络(Congested Scene Recognition Network,CSRNet)构建麦穗密度图估计模型,并采用迁移学习方法,利用小麦图像公开数据集对模型进行预训练,再用所采集的小麦图像数据集进行模型参数调整和优化;利用得到的模型生成单幅小麦图像的麦穗密度图,根据密度图中所有密度值的总和对图像进行麦穗计数。最后根据对单幅麦穗图像的试验数据,构建田间麦穗计数函数模型,实现田间小麦麦穗数估计。通过对所采集的安农170、苏麦188、乐麦608和宁麦24这4个品种共296幅小麦图像进行试验,平均绝对误差(Mean Absolute Error,MAE)和均方根误差(Root Mean Squared Error,RMSE)分别为16.44和17.89,4个品种小麦的麦穗计数值与真实值的决定系数R均在0.9左右,表明该方法对单幅图像小麦麦穗计数精度较高。此外,通过对田间小麦麦穗数进行估计试验,结果表明,随面积的增大麦穗估计的误差越小,研究结果可以为小麦的产量自动估计提供参考。

卷积神经网络;机器视觉;密度图估计;麦穗计数;拥挤场景识别网络;迁移学习

0 引 言

作物产量估计对农业生产起着至关重要的作用。小麦是世界三大农作物之一,也是中国主要粮食来源之一,对其进行产量估计是非常必要且有意义的。单位面积的麦穗数、每穗粒数和千粒质量是估计小麦产量的3个重要参数[1],农学专家也给出小麦理论产量用如下公式来计算:小麦亩产量=亩穗数×穗粒数×千粒质量×85%。其中单位面积的麦穗数可在小麦成长期测定,用于对小麦产量做出早期估计。目前小麦麦穗数的统计主要靠人工计算,耗时且繁琐,耗费大量的人力物力[2]。因此近年来基于图像处理技术的小麦麦穗自动计数得到了广泛研究。

基于图像的小麦麦穗自动计数方法分为传统机器学习方法和深度学习方法。基于传统机器学习方法的小麦麦穗计数[3-6]多数依赖颜色、纹理等特征,并充分利用形态学操作的特性,以达到区分背景的结果。如Zhou等[7]基于颜色、纹理、边缘直方图等特征,提出一种双支持向量分割方法,分割图像中可见的小麦麦穗,最后进行计数,计数精度为79%~82%。刘哲等[8]提出了基于改进-means的小麦麦穗计数方法,以颜色特征聚类为基础,把聚类区域内的子区域数作为麦穗数估计值,计数精度达到94.69%。虽然上述这些方法相较于传统的手工计算节省了大量人力物力,且正确性提高,但是这些方法对颜色、纹理等依赖性较强,受光照、麦叶及土壤等影响较大。

近年来,深度学习在计算机视觉的分割、识别、检测等方面取得了很大的进步,同时也逐渐开始应用到农作物的计数方面,也包括小麦麦穗计数[9-12]。Fernandez-Gallego等[13]利用热成像技术和深度学习进行图像分割,对小麦麦穗进行计数,麦穗计数值和真实值的决定系数2达到0.83;Sadeghi-Tehran等[14]利用简单线性迭代聚类(Simple Linear Iterative Clustering,SLIC)将图像分割成超像素,提取冠层相关特征,然后构造一个合理的特征模型,并将其加入到CNN分类中进行小麦穗的语义分割,最后对分割出的麦穗计数,麦穗计数值和真实值的决定系数2最高达到0.94。

虽然这些研究取得了一些研究成果,但对于灌浆期的小麦来说,基于图像的小麦麦穗计数仍面临着一些挑战。此时的田间小麦除了生长密集的特点外,小麦的叶片和茎秆与麦穗颜色相近,且茎叶繁茂,具有复杂背景。叶片对麦穗部分遮挡以及麦穗之间的相互重叠,也增加了麦穗计数的难度。

而近年来,基于密度图[15]的方法在密集对象计数的问题中颇受青睐,它通过对整个密度图求和来反映对象的总数,重叠的对象就会被算在其中。密度图估计的方法在密集人群计数[16]中应用较多,文献[17]在计算玉米须时,也借鉴了密度图估计的方法,并取得了令人满意的结果。因此密度图估计方法,对灌浆期田间麦穗计数中麦穗部分重叠提供了更多可能性。在此启发下,本文以灌浆期小麦为研究对象,提出一种基于卷积神经网络密度图估计的单幅图像麦穗计数方法。该方法通过对所采集的单幅小麦图像进行预处理,同时引入CSRNet网络构建麦穗密度图估计模型,实现对复杂拥挤场景下的麦穗计数。在训练过程中采用迁移学习的方法,利用小麦图像公开数据集对麦穗密度估计网络模型进行预训练,再用所采集的小麦图像数据集进行模型参数调整和优化。同时根据小麦麦穗数与种植面积的关系构建了田间麦穗计数函数模型,以此来实现田间小麦麦穗数估计。

1 材料与方法

1.1 数据获取及标注

1.1.1 数据采集

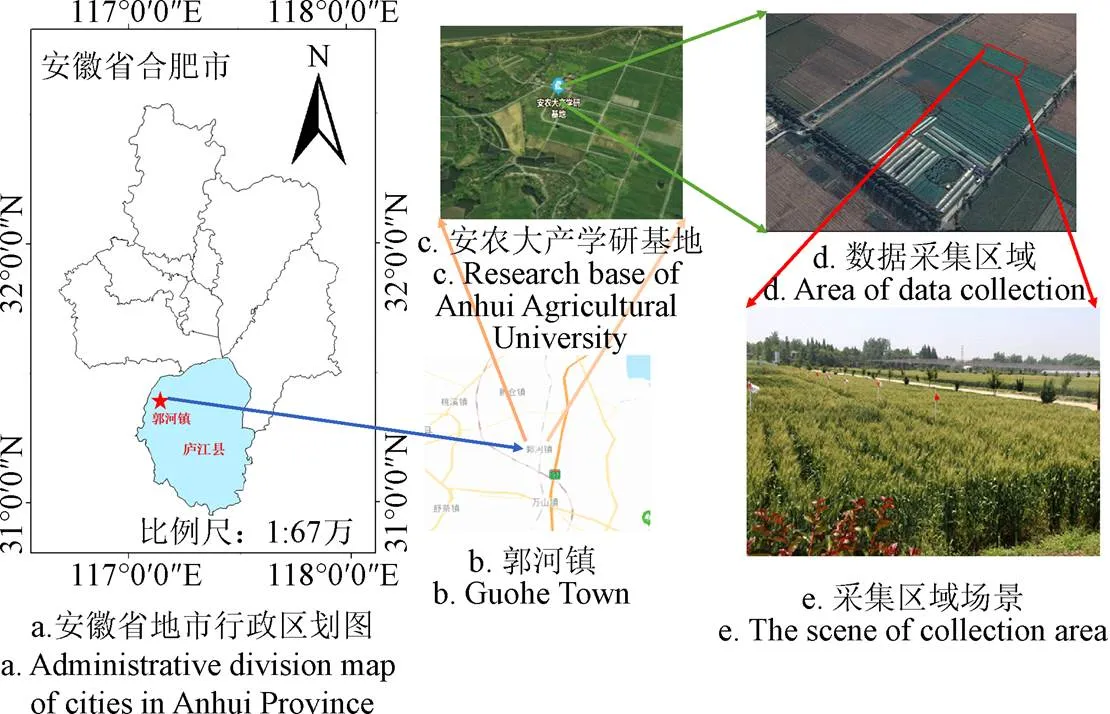

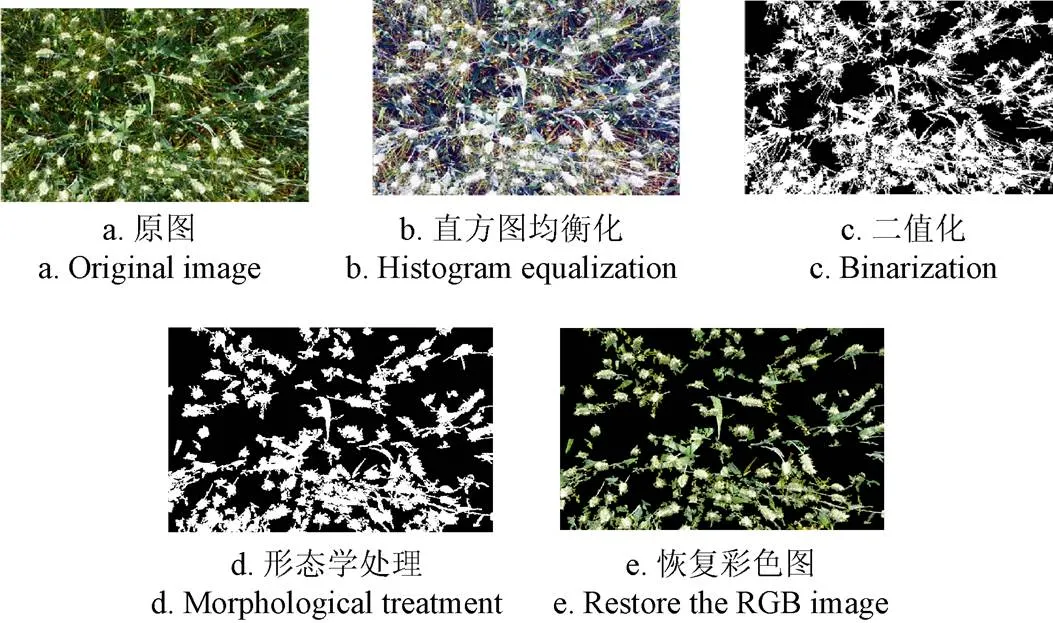

试验的研究区域是安徽省合肥市庐江县郭河镇安农大产学研基地(31°25′~31°42′N,117°09′~117°16′E)的小麦种植区域,如图1所示。该基地种植了10多个品种的小麦。对小麦种植区域中的4块种植地D1、D2、D3和D4进行了数据采集,D1~D4分别种植了安农170、苏麦188、乐麦608和宁麦24这4个品种的小麦。数据采集时间在2019年5月4日-6日,此时小麦正处于灌浆期,采集数据的具体时间是9:00-16:00,温度范围在18~25 ℃,相对湿度范围在30%~50%,且以多云和阴天为主,避免了强光照对数据采集的影响,但由于采集时拍摄角度的不同,造成图像出现光照不均匀的情况。

图1 研究区域

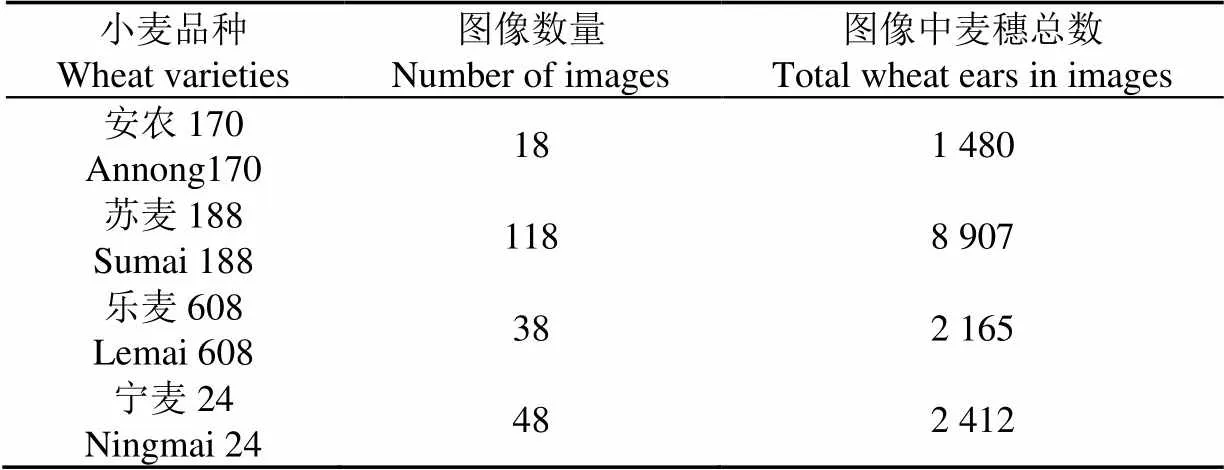

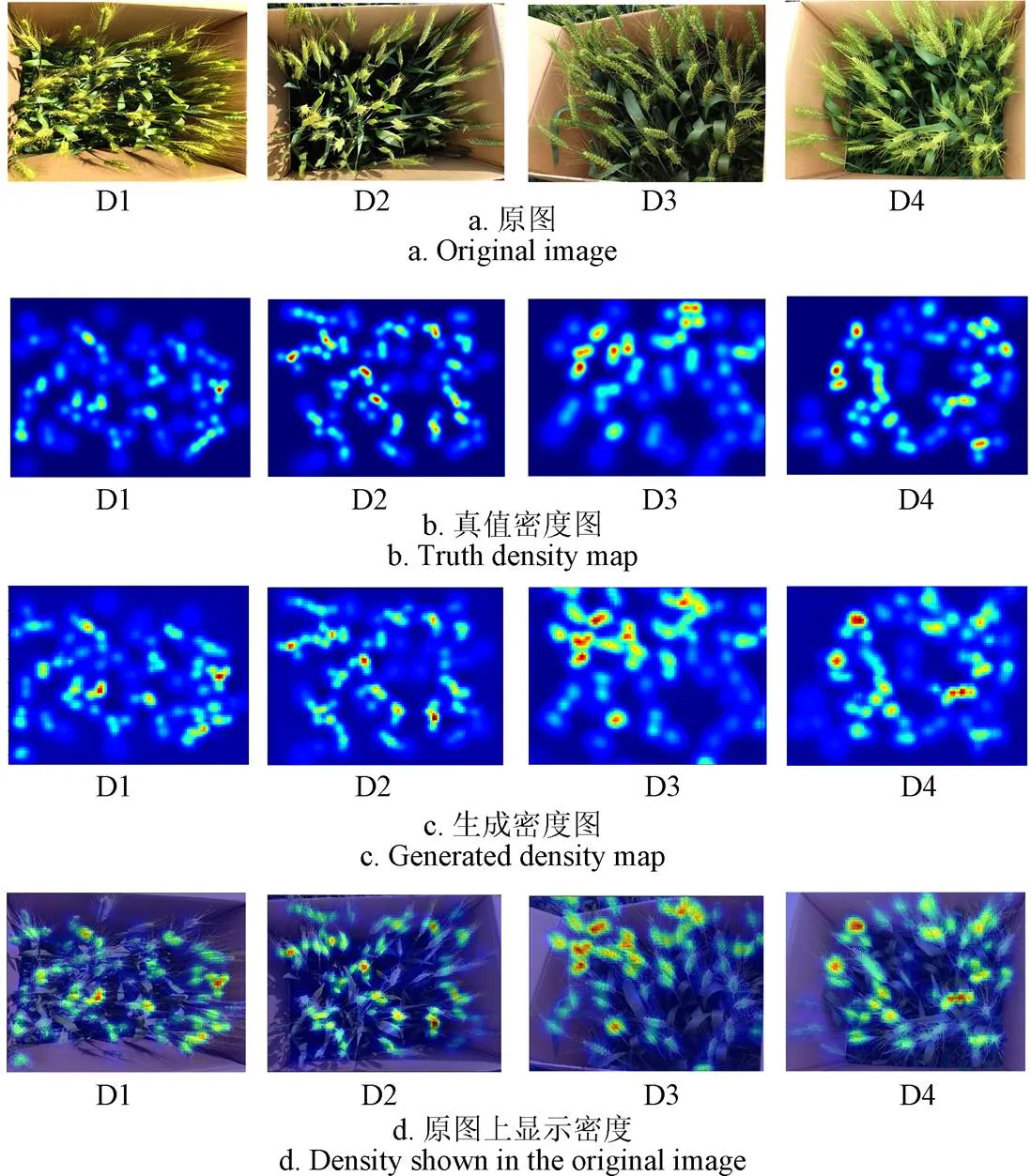

制作40 cm×50 cm的纸盒,用以固定0.2 m2范围内的小麦,并使用佳能EOS80D数码相机进行拍摄,每张图像均为5 184像素×3 456像素,拍摄4个不同品种的小麦麦穗图像,如图2所示。从采集的图像中选取了296幅图像,共14 964个麦穗,构建了WEE(Wheat Ear Estimated)数据集,数据集各品种小麦具体图像数量及麦穗个数如表1所示。

图2 WEE数据集D1-D4不同品种小麦麦穗示例

表1 WEE数据集

1.1.2 公开数据集

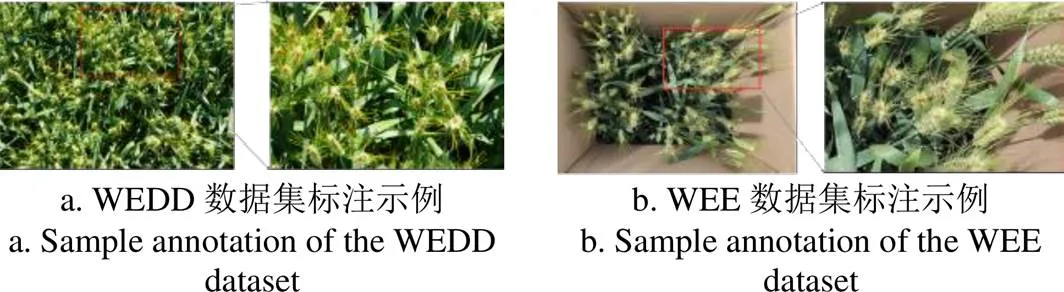

本文所用数据还包括Madec等[10]提供的公开数据集WEDD(Wheat Ears Detection Dataset),包含236幅 6 000×4 000像素的高分辨率小麦图像,共有30 729个小麦麦穗。该数据采集使用索尼ILCE-6000数码相机,并将相机固定在吊杆上距离地面2.9m进行拍摄。WEDD数据集图像示例如图3所示。

图3 WEDD数据集图像示例

1.1.3 数据标注

本文采用点标注的方式[17](即在每个小麦麦穗的位置标记一个点,标注点所占区域大小为6个像素)对小麦麦穗图像进行标注。由于这种标注方式利用的是图像中小麦麦穗的位置信息,对图像的品质没有要求,图像的分辨率对标注无影响,而在标注过程中读取高品质的图像需要更多的计算资源和时间。因此为节约计算资源和标注时间,在进行标注前,利用MATLAB中的resize函数,将2个数据集中的图像大小统一调整为800像素× 602像素的图像。图4是2个数据集(WEDD和WEE)的一个标注示例,左侧为标注样本,右侧为样本中某一标注区域的放大。

图4 WEDD数据集和WEE数据集标注示例

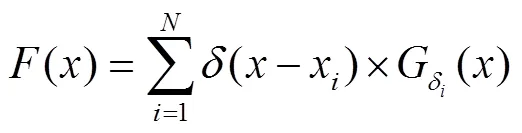

1.1.4 真值密度图

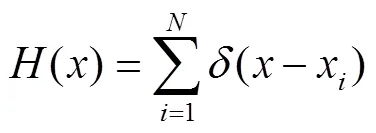

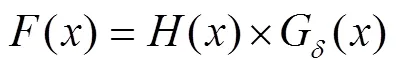

将标注好的数据用于生成真值密度图。假设某个麦穗的标注点的位置为x,脉冲函数(−x)表示此标注麦穗的信息,那么具有个麦穗标注点的图像可以被表示为

把这个函数与高斯核G[15]做卷积使其从离散函数转换成连续函数,则密度函数表示为

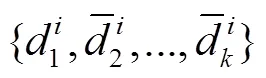

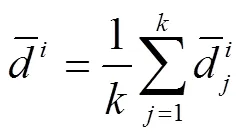

理论上,式(2)可表示一幅被标注小麦麦穗图像的密度图,然而事实上由此得到的密度图中,高斯分布是固定的,而在获取到的数据集中,每幅图像中的麦穗大小都是不同的,显然这就会使得图像中麦穗标注点x相关的像素与图像中实际麦穗所占区域有较大差异,不能准确获得麦穗大小。因此为了得到精确的估计密度,利用几何自适应核[18],根据麦穗分布情况改变高斯分布参数,使之与局部邻近的麦穗密度相关。首先计算当前麦穗标注点与一些邻近麦穗标注点之间的距离,然后由这些距离的平均距离的值构造高斯核的方差,得到几何自适应高斯核。

这样就能获得更精确的密度图,在本文的试验中,取=0.3,在此值取得的效果较好。

图5是分别在WEDD数据集和WEE数据上试验得到的热力图显示的密度图示例,其中图5a是原始图像;5b是得到的真值密度图;5c是密度图在原图上的显示结果。

注:图中的颜色是密度值大小的反映,颜色越深,密度值越大。

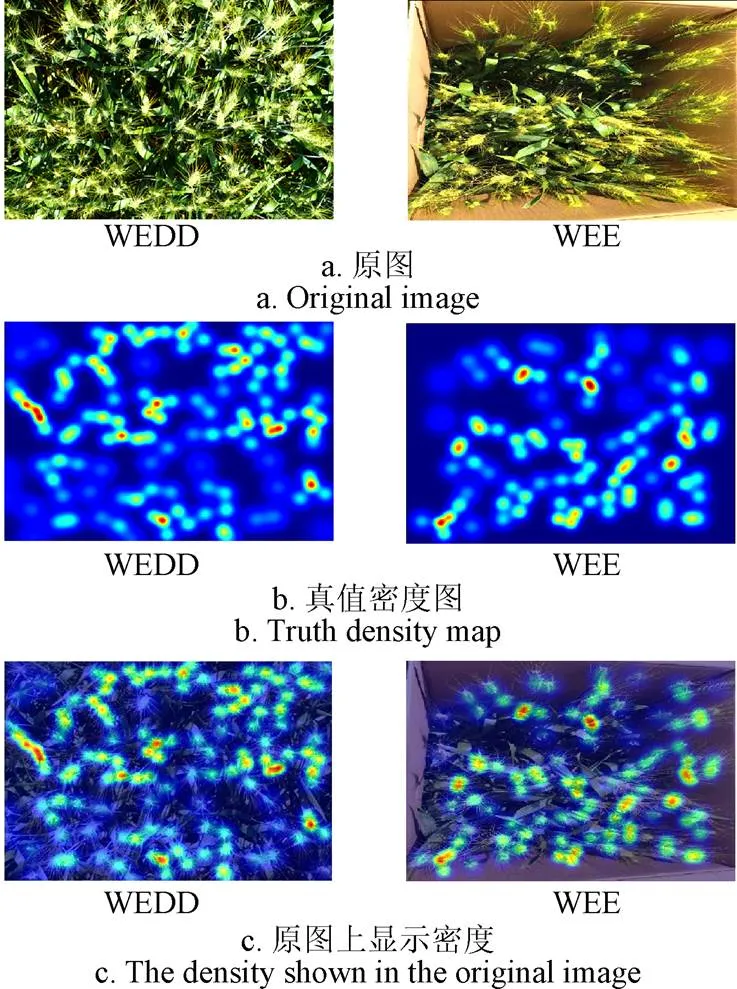

1.2 田间麦穗数密度估计及计数方法

为了减少光照、叶片等因素的对麦穗计数的影响,对小麦麦穗图像进行了直方图均衡化和预分割处理,然后构建麦穗密度估计网络模型,将训练图像和真值密度图一起用于训练该网络模型。在训练过程中采用迁移学习方法,利用小麦图像公开数据集WEDD对模型进行预训练得到预训练模型,再用所采集的小麦图像数据集WEE进行模型参数调整和优化训练。最后利用得到的模型,生成单幅测试小麦麦穗图像的密度图,密度图中所有密度值的总和即为对应图像中小麦的总数量。根据单幅测试图像中麦穗计数结果及其对应的面积,建立田间麦穗计数函数模型,算法流程如图6所示。

图6 田间麦穗数估计流程图

本文按4:1的比例将WEE数据集分为训练集和测试集,模型训练参数设置如下:学习率lr=0.000 1,迭代次数epochs=200,批次处理大小batch size=2,采用随机梯度下降优化算法(Stochastic Gradient Descent,SGD)优化训练模型。试验的硬件条件为NVIDIA GTX2070 GPU,Intel i7处理器,试验使用Pytorch的开源软件框架、Python和MATLAB编程实现。

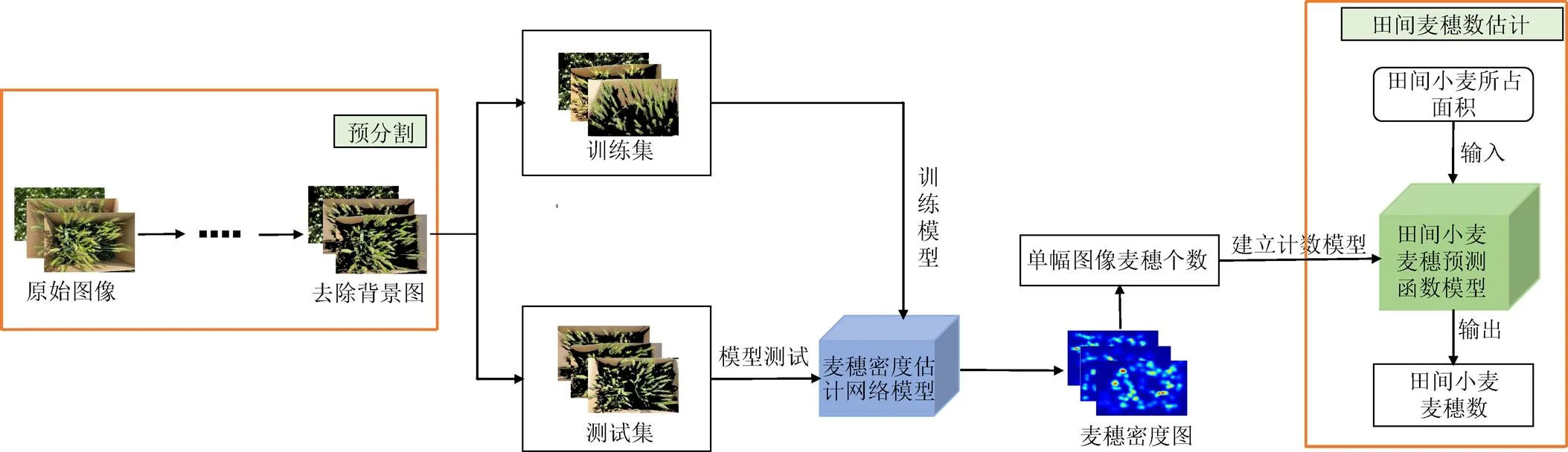

1.2.1 小麦图像预处理

灌浆期的小麦麦穗和小麦叶片、茎秆颜色相近,为减少计数的误差,对小麦麦穗图像进行了预分割处理,去除部分叶片、茎秆及光照等因素的干扰。将所有数据先经过直方图均衡化[19],然后阈值分割二值化,再做形态学处理。图7是进行数据预处理的流程示例。首先利用MATLAB中histeq函数分别对图像、、3个通道的图像进行直方图均衡化,再利用cat函数将3个通道直方图均衡化后的图像合成最终的图像,如图7b所示;再利用MATLAB中graythresh函数和im2bw函数实现对图像的阈值分割二值化;最后利用MATLAB中imerode、imdilate函数实现形态学处理过程。

图7 数据预处理流程示例

考虑到灌浆期的小麦麦穗颜色特征与小麦叶片、茎秆区别不大,以及采集数据时的环境因素(如光照不均匀等)对所采集到的数据的影响,使用增强对比度的方法来加强小麦麦穗和其他背景信息的区别,并利用了直方图均衡化对图像做了初步处理,以达到将麦穗分割出来的更好效果。经过直方图均衡化对图像的初步处理,再对图像进行分割,与没有经过处理直接对图像进行分割相比,如图8a、8c所示,分割后的图像在去除了小麦叶片、小麦茎秆等信息的同时,不会丢失小麦麦穗的信息。图8b、8d所示是经过直方图均衡化后的分割效果图,可以看到最终的分割图保留了所有的麦穗信息。

1.2.2 麦穗密度估计网络模型

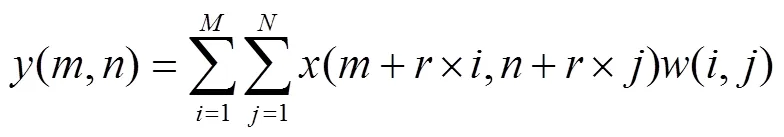

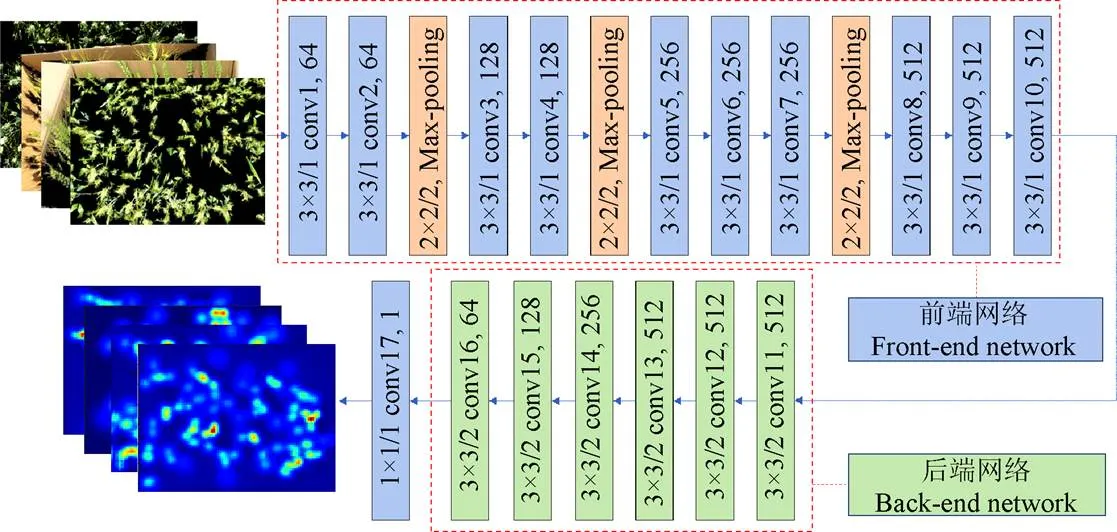

灌浆期小麦麦穗图像具有麦叶、麦秆背景复杂以及麦穗密集的特点,而拥挤场景识别网络(Congested Scene Recognition Network,CSRNet)[20]是一种为识别高密度场景而设计的网络模型,用于精确完成拥挤场景计数,因此本文利用CSRNet来构建麦穗密度估计网络模型。CSRNet网络主要分为前端和后端网络,前端使用预训练模型VGG-16进行特征提取,后端使用扩张卷积[21],在扩大感受野的同时,生成分布密度图,最后采用一层1×1的普通卷积层输出结果。研究表明[22-23],对于相同大小的感知域,卷积核越小,卷积层数越多的模型优于有着更大卷积核且卷积层数较少的模型。为了平衡准确性和减少硬件资源开销,前端网络剔除了VGG-16网络的全连接层,采用10个卷积核大小为3×3的卷积层和3个2×2的池化层的组合。后端网络采用扩张卷积,在保持分辨率的同时扩大感知域,生成高质量的分布密度图。二维扩张卷积[24]可以定义为

式中y(m,n)表示卷积输出,x(m,n)是输入,w(i,j)表示一个滤波器,m和n是卷积的长度和宽度,参数表示扩张率,当r=1时,扩张卷积即变为正常的标准卷积。扩张卷积的原理就是在kernel各个像素点之间加入0值像素点,增大核的尺寸从而增大感受野。在本文采用的CSRNet网络模型中,后端网络扩张率r=2,卷积核大小为3×3,相当于将卷积核的大小变成了7×7。

用扩张卷积来代替池化层,可以避免使用池化层造成的空间分辨率降低,进而导致的特征图空间信息丢失,生成低质量的密度图,最终影响到麦穗的计数。同时扩张卷积可以聚合多尺度的上下文信息,充分提取特征,并能保证与输入图像保持相同的分辨率,提高密度估计的准确度。本文利用CSRNet实现麦穗密度估计网络模型结构如图9所示。

在本文的模型训练过程中,还借用了迁移学习[25-26]。首先从WEDD数据集上训练麦穗密度估计网络模型的前端网络即VGG-16网络,得到预训练模型,然后将预训练模型加载到CSRNet中,再从WEE数据集上训练CSRNet,在训练过程中,冻结前端网络预训练模型参数,只对后端网络进行重新训练和更新参数。

图9 麦穗密度估计网络模型

1.2.3 田间麦穗计数函数模型

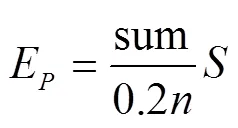

田间麦穗计数函数模型建立方法如下:首先,根据麦穗密度估计网络模型生成的密度图通过计算密度图中所有值的总和得到单幅图像的小麦麦穗个数,并计算所有图像的麦穗数总和;然后计算每幅图像小麦麦穗的估计平均个数,即得到每0.2 m2内小麦麦穗个数;最后根据推测出的每0.2 m2内小麦麦穗个数构建估计模型估计田间小麦麦穗个数。

1.2.4 评价指标

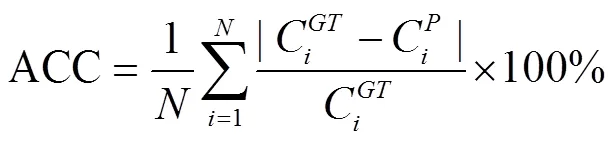

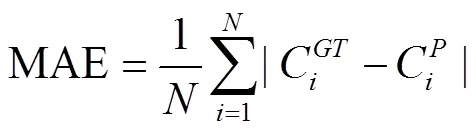

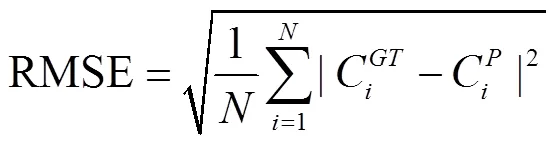

平均精确度(Accuracy,ACC)、平均绝对误差(Mean Absolute Error,MAE)能反映计数的准确性,均方根误差(Root Mean Squared Error,RMSE)可以反映计数方法的鲁棒性,常被用来量化计数性能[26],MAE和RMSE的值越低,ACC值越高表示计数性能越好。决定系数2的值可判断模型的好坏,取值范围为[0,1],2值越大越靠近1,模型拟合效果越好。本文使用这4个指标对小麦图像的麦穗计数效果做评判。假设有幅测试图像,则ACC、MAE、RMSE和2定义如下:

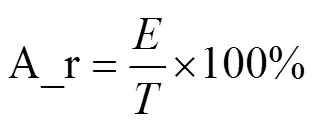

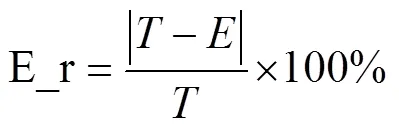

本文用准确率(Accuracy rate,A_r)和误差率(Error rate,E_r)作为对田间不同种植面积的小麦进行麦穗估计的评价指标。准确率、误差率定义如下:

式中表示田间麦穗估计数,表示田间麦穗真实值。

2 结果及分析

2.1 不同品种的麦穗计数结果

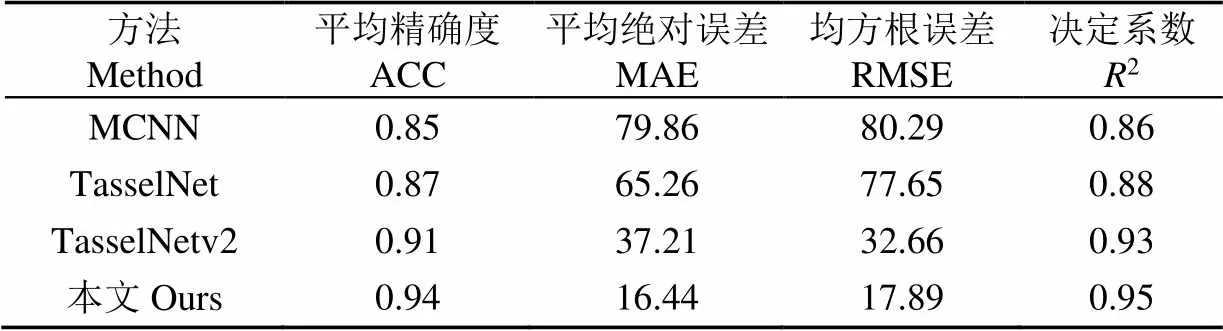

本文分别将WEE数据集中D1、D2、D3和D4 4块种植地4个不同品种的小麦麦穗图像输入训练好的麦穗密度估计网络模型中进行测试,得到麦穗估计密度图,并根据密度图,得到麦穗个数。对每个品种的小麦麦穗图像中麦穗计数值与真实值进行对比分析。图10给出了本文方法在WEE数据集中对D1~D4 4块种植地的4个不同品种小麦的麦穗生成密度图结果。图10a是麦穗原图,图10b,图10c分别是真值密度图和模型生成的密度图,图10d是将生成密度图在原小麦麦穗图像上显示的结果。从图10中可以看出,生成的密度与真值密度图比较接近,并且能够与麦穗图像很好的对应起来。

注:D1~D4为安农170、苏麦188、乐麦608、宁麦24。

根据所得密度图,对其进行积分求和得到每幅图像的麦穗个数。将WEE中4类小麦品种的单幅小麦麦穗数计数值与真实值进行对比,采用线性回归对结果进行分析。各品种单幅图像麦穗计数值与真实值的拟合结果如图11所示,从拟合结果看,决定系数2值均在0.9左右,表明本文算法对各品种小麦的麦穗数计数值与真实值具有显著的线性相关性。

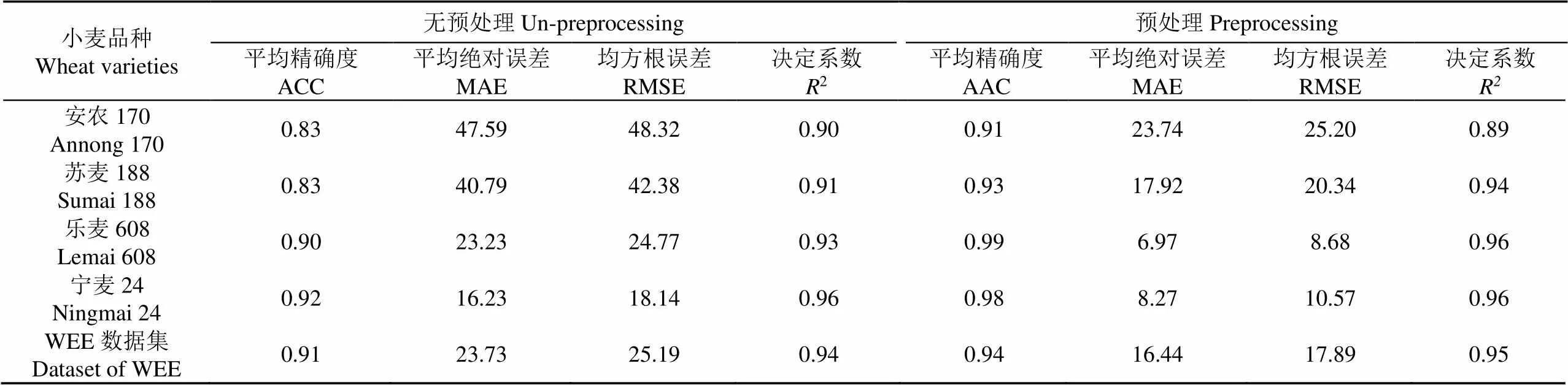

2.2 预处理对计数结果的影响分析

考虑到受光照和灌浆期小麦生理特征以及其他因素的影响,为减少计数的错误率,本文对数据集中图像做了麦穗预分割,进行直方图均衡和分割等预处理。试验分别用未分割处理的数据集与进行过预分割处理的数据集对麦穗密度估计网络模型进行训练,得到2个不同的训练模型,用以检验分割预处理对计数结果的影响。

表2给出了分割预处理和未进行分割处理的图像在模型上的MAE值和RMSE值,从结果可以看到,进行初步分割预处理的图像在4个品种小麦的测试集上的MAE值和RMSE值均比未进行分割处理的低,表现出进行分割的优异性和有效性。

2.3 不同方法的计数结果对比

选取了3种基于密度图的计数方法与本文方法进行单幅图像麦穗计数结果对比。

MCNN(Multi-column Convolutional Neural Network)是Zhang等[27]在2017年提出的一个网络,用来估计人群的密度图,Wang等[28]在2019年将MCNN应用到麦穗计数上,并与其自己提出的麦穗计数方法做对比。

TasselNet是Lu等[17]对玉米穗密度估计而设计的网络模型,作者提出了LeNet-like、AlexNet-like和VGG-VD16-Net-like 3种TasselNet模型结构,并在文中证明了AlexNet-like架构的TasselNet实现了对玉米穗计数的最佳计数性能。因此在本对比试验中,本文将AlexNet-like架构的TasselNet模型与本文方法对小麦麦穗密度估计做了对比。

TasselNetv2是Xiong 等[29]在2019年提出的融合上下文信息的局部计数模型,其用来实现对小麦麦穗的田间计数。

上述几种方法MCNN、TasselNet和TasselNetv2在GitHub上均有开源代码,表3所示是本文方法与其他方法在WEE数据集上的表现结果。

表3 不同方法在WEE数据集上的结果

从表3可以看出,MCNN、TasselNet和TasselNetv2在一定程度上对小麦麦穗计数都能有较好的结果。其中MCNN的结果相比其他2种方法要差一些,这可能与其训练方式有关,这里的训练数据是通过裁剪原图像来增加训练集数量的,这样就会导致裁剪后的图像麦穗密度减小,且会存在同个麦穗分布在不同子图像中,导致对同个麦穗重复计数,增加了计数误差。TasslNetv2的结果要优于TasselNet,这与TasselNetv2在网络中融合了上下文信息有关。本文方法的结果MAE和RMSE值比TasselNetv2更低,验证了本文模型以及引入迁移学习的有效性。

表2 有无预处理在WEE数据集上的结果

2.4 田间小麦麦穗估计结果分析

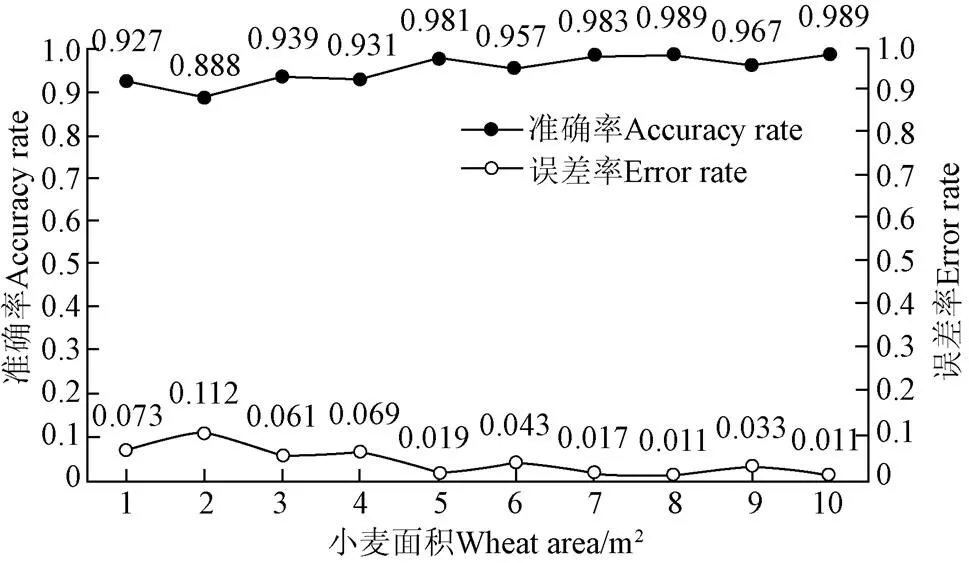

为验证田间小麦麦穗函数估计模型的精度,随机选取种植区域来分析。在试验基地随机间隔抽样统计了[1, 10]m2范围内的田间小麦麦穗数真实值,并以此作为田间小麦麦穗估计对比的基准。根据式(6),可以得到所选区域内不同面积范围的小麦麦穗数。图12为田间麦穗计数函数模型估计的准确率和误差率,从图中可以看出,随着田间小麦面积的增加,估计的准确率总体上呈上升趋势,误差率降低。在实际应用中,小麦的田间种植面积要远远大于试验所选择的面积,估计的准确率也会进一步提高,因此,本文的提出的田间麦穗计数函数模型方法对能够为小麦产量估计提供参考。

图12 田间小麦麦穗估计准确率及误差率

3 结 论

本文基于密度图估计的方法对自然环境下灌浆期的小麦进行麦穗计数,提出了一种在单幅麦穗图像上利用CSRNet估计麦穗密度图并进行计数的方法。通过数据预处理将麦穗初步从背景中分离出来,来提高密度图估计的质量。在训练模型过程中,利用了迁移学习的方法在公共数据集上进行预训练,将所采集的数据用于模型的调参和优化。同时根据试验所获得的数据构建了小麦种植面积和小麦麦穗数的函数关系模型。试验表明:

1)该算法对不同品种小麦的单幅麦穗图像的计数均具有较高的精度,平均精确度达到0.94,小麦麦穗计数值和真实值的决定系数为0.95。

2)预分割处理对麦穗计数有一定有效性,相比未进行预分割处理的数据,计数精度提高了3个百分点,MAE值和RMSE值也都有所降低。

3)构建的田间小麦麦穗函数估计模型,随小麦种植面积的增大,麦穗估计的准确度提高。

研究结果为实际应用过程中自动估计小麦麦穗数及小麦产量估计提供了参考。

[1] Ferrante A, Cartelle J, Savin R, et al. Yield determination, interplay between major components and yield stability in a traditional and a contemporary wheat across a wide range of environments[J]. Field Crops Res. 2017, 203: 114-127.

[2] 李毅念,杜世伟,姚敏,等. 基于小麦群体图像的田间麦穗计数及产量预测方法[J]. 农业工程学报,2018,34(21):185-194.

Li Yinian, Du Shiwei, Yao Min, et al. Method for wheatear counting and yield predicting based on image of wheatear population in field[J]. Transactions of the Chinese Society of Agricultural Engineering (Tsansactions of CSAE), 2018, 34(21): 185-195. (in Chinese with English abstract)

[3] 赵锋,王克俭,苑迎春. 基于颜色特征和AdaBoost算法的麦穗识别的研究[J]. 作物杂志,2014(1):141-144.

Zhao Feng, Wang Kejian, Yuan Yingchun. Study on wheat spike identifiction based on color features and Adaboost algorithm[J]. Crops, 2014(1): 141-144. (in Chinese with English abstract)

[4] Fernandez-Gallego A, Kefauver C, Gutiérrez, et al. Wheat ear counting in-field conditions: High throughput and low-cost approach using RGB images[J]. Plant Methods, 2018, 14(22): 21-33.

[5] Marcus Jansen, Tino Dornbusch, Stefan Paulus, et al. Field Scanalzyer-high precision phenotyping of field crops[C]// 4th International Plant Phenotyping Symposium 2016, CIMMYT, El Batan, Mexico, 2016: 1-2.

[6] Zhou C, Liang D, Yang X, et al. Recognition of wheat spike from field based phenotype platform using multi-sensor fusion and improved maximum entropy segmentation algorithms[J]. Remote Sens, 2018, 10(2): 246-270.

[7] Zhou C, Liang D, Yang X, et al. Wheat ears counting in field conditions based on multi-feature optimization and TWSVM[J]. Frontiers in Plant Science, 2018, 9: 1024-1040.

[8] 刘哲,黄文准,王利平. 基于改进K-means聚类算法的大田麦穗自动计数[J]. 农业工程学报,2019,35(3):174-181.

Liu Zhe, Huang Wenzhun, Wang Liping. Field wheat ear counting automatically based on improved K-means clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(3): 174-181. (in Chinese with English abstract)

[9] Hasan M M, Chopin J P, Laga H, et al. Detection and analysis of wheat spikes using convolutional neural networks[J]. Plant Methods, 2018, 14(1): 100-113.

[10] Madec S, Jin X, Lu H, et al. Ear density estimation from high resolution RGB imagery using deep learning technique[J]. Agric Forest Meteorol, 2019, 264: 225-234.

[11] Pound M P, Atkinson J A, Wells D M, et al. Deep learning for multi-task plant phenotyping[C]//2017 IEEE International Conference on Computer Vision Workshop, 2017: 2055-2063.

[12] 张领先,陈运强,李云霞,等. 基于卷积神经网络的冬小麦麦穗检测计数系统[J]. 农业机械学报,2019,50(3):144-150.

Zhang Lingxian, Chen Yunqiang, Li Yunxia, et al. Detection and counting system for winter wheat ears based on convolutional neural network[J]. Transactions of the Chinese Society for Agricultural Machinery, 2019, 50(3): 144-150. (in Chinese with English abstract)

[13] Fernandez-Gallego J, Buchaillot M, Aparicio Gutiérrez, et al. Aparicio Gutiérrez, et al. Automatic wheat ear counting using thermal imagery [J]. Remote Sensing. 2019, 11(7): 751-764.

[14] Sadeghi-Tehran P, Virlet N, Ampe E M, et al. DeepCount: in-field automatic quantification of wheat spikes using simple linear iterative clustering and deep convolutional neural networks[J]. Frontiers in Plant Science, 2019, 10: 1176-1192.

[15] Lempitsky V, Zisserman A. Learning to count objects in images[C]// Proceedings of the 23rd International Conference on Neural Information Processing Systems. Vancouver, British Columbia, Canada: Curran Associates Inc, 2010: 1324-1332.

[16] Sindagi V A, Patel V M. A survey of recent advances in cnn-based single image crowd counting and density estimation[J]. Pattern Recognition Letters, 2018, 107: 3-16.

[17] Lu H, Cao Z, Xiao Y, et al. TasselNet: Counting maize tassels in the wild via local counts regression network[J]. Plant Methods, 2017, 13(1): 79-95.

[18] Daniel Ooro-Rubio, Roberto J López-Sastre. Towards perspective-free object counting with deep learning[C]// Proceedings of the 14th European Conference on Computer Vision. Amsterdam, The Netherlands: Spinger, 2016: 615-629.

[19] Aedla R, Siddaramaiah D G, Reddy D V. A comparative analysis of histogram equalization based techniques for contrast enhancement and brightness preserving[J]. Int. J. Signal Process. Image Process. Pattern Recognit, 2013, 6(5): 353-366.

[20] Li Y, Zhang X, Chen D. CSRNet: Dilated convolutional neural networks for understanding the highly congested scenes[C]//Proceedings of 2018 IEEE conference on computer vision and pattern recognition, 2018: 1091-1100.

[21] Yu F, Koltun V. Multi-scale context aggregation by dilated convolutions[C]//International Conference on Learning Representations, 2016: 1-13.

[22] Simonyan K , Zisserman A . Very deep convolutional networks for large-scale image recognition[C]// International Conference on Learning Representations, 2015: 1-14.

[23] Boominathan L, Kruthiventi S S S, Babu R V. Crowdnet: A deep convolutional network for dense crowd counting[C]// Proceedings of 2016 ACM International Conference on Multimedia. Amsterdam, The Netherlands: ACM, 2016: 640-644.

[24] Weiss K, Khoshgoftaar T M, Wang D D. A survey of transfer learning[J]. Journal of Big Data, 2016, 3(1): 1-40.

[25] Tan C, Sun F, Kong T, et al. A survey on deep transfer learning [J]. Computer Science, 2018, 11141: 270-279.

[26] Wu J, Guijun Y, Han L, et al. Automatic counting of in situ rice seedlings from UAV images based on a deep fully convolutional neural network[J]. Remote Sensing, 2019, 11(6): 691-710.

[27] Zhang Y Y, Zhou D S, Chen S Q, et al. Single-image crowd counting via multi-column convolutional neural network[C]// Proceedings of 2016 IEEE Conference on Computer Vision and Pattern Recognition. Las Vegas, NV, USA: IEEE, 2016: 589-597.

[28] Wang D, Fu Y, Yang G, et al. Combined use of FCN and Harris corner detection for counting wheat ears in field conditions[J]. IEEE Access, 2019, 7: 178930-178941.

[29] Xiong H, Cao Z, Lu H, et al. TasselNetv2: In-field counting of wheat spikes with context-augmented local regression networks[J]. Plant Methods, 2019, 15: 150-164.

Estimation and counting of wheat ears density in field based on deep convolutional neural network

Bao Wenxia, Zhang Xin, Hu Gensheng, Huang Linsheng※, Liang Dong, Lin Ze

(,,230601,)

Wheat is one of the most important grain crops in the world. The stability of wheat yield is crucial to global food security. The final yield of wheat can be calculated by the number of ears per unit area. Using deep learning technology to accurately and automatically count the number of wheat ears can save a lot of manpower and material resources. The images of wheat ears from four different wheat varieties during grain filling period were collected, and 296 images with a total of 14 964 ears of wheat were selected to construct the WEE data set. The method of point labeling was used to label the wheat ears in the images. In order to quickly and accurately count the number of wheat ears in complex crowded scenes, a method of estimating the density map and counting the number of wheat ears in field wheat images was proposed. Firstly, histogram equalization and threshold segmentation were used to preprocess the collected field wheat images to reduce the influence of light and some complex backgrounds on counting. Then, according to the characteristics of dense wheat growth at grain filling period, the Congested Scene Recognition Network (CSRNet) was introduced to construct the wheat ear density map estimation model. The CSRNet network was composed of front-end and a back-end networks. The front-end network uses the pre-training model VGG16 to extract the features of the wheat images, and the back-end network uses the dilation convolution to generate the distribution density map while expanding the receptive field. In order to improve the accuracy of the model in the training process, the transfer learning method was used to pre-train the model by using the public wheat image data set, and the collected wheat image data set was used to adjust and optimize the model parameters. The trained model was used to generate the wheat ear density map of a single wheat image, and the wheat ears were counted according to the sum of all density values in the density map. Finally, according to the test data of a single wheat ear image, a wheat ear counting function was constructed to estimate the number of wheat ears in the field. Experiments were conducted on a total of 296 wheat images collected from four varieties (Annong170, Sumai 188, Lemai 608 and Ningmai 24). The Mean Absolute Error (MAE) and Root Mean Square Error (RMSE) were 16.44 and 17.89, respectively. The correlation coefficientRbetween the ear count values and the true values of the four varieties of wheat was about 0.9, indicating that the method in this paper has a higher accuracy for counting wheat ears in a single image. In addition, the experiment of estimating the number of wheat ears in the field showed that the error of estimation of wheat ears was smaller with the increase of area. The results of this study can provide the possibility of automatic estimation of the number of wheat ears in practical application process, and also provide a reference for wheat yield estimation.

convolutional neural network; computer vision; density map estimation; wheat ears counting; congested scene recognition network; transfer learning

鲍文霞,张鑫,胡根生,等. 基于深度卷积神经网络的田间麦穗密度估计及计数[J]. 农业工程学报,2020,36(21):186-193. doi:10.11975/j.issn.1002-6819.2020.21.022 http://www.tcsae.org

Bao Wenxia, Zhang Xin, Hu Gensheng, et al. Estimation and counting of wheat ears density in field based on deep convolutional neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(21): 186-193. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2020.21.022 http://www.tcsae.org

2020-07-13

2020-10-18

国家自然科学基金(61672032,41771463);安徽省高等学校自然科学研究重点项目(KJ2019A0030);农业生态大数据分析与应用技术国家地方联合工程研究中心开放课题项目(AE2018009)资助

鲍文霞,博士,副教授,主要从事农业与生态视觉分析与模式识别研究。Email:bwxia@ahu.edu.cn

黄林生,博士,教授,主要从事农业遥感技术与应用。Email:linsheng0808@163.com

10.11975/j.issn.1002-6819.2020.21.022

TP391.41

A

1002-6819(2020)-21-0186-08