基于改进的Census变换的立体匹配算法

闫 佳,曹玉东,曲 直,蔡希彪

基于改进的Census变换的立体匹配算法

闫 佳,曹玉东,曲 直,蔡希彪

(辽宁工业大学 电子与信息工程学院,辽宁 锦州 121001)

针对局部立体匹配算法误匹配率较高的缺陷,提出了一种基于改进型Census变换的立体匹配算法,通过采用不同尺度的Census变换窗口和改进代价匹配函数,可以输出具有更高匹配程度的视差图。首先,采用各向同性Sobel算子提取图像的边缘信息,以作为选取Census变换窗口的依据;然后,利用选取的窗口对图像进行相似度代价和梯度信息的代价计算;最后,融合相似度代价和梯度信息代价得到最终的代价匹配函数,进一步处理能够求得视差图。在Middlebury视觉网站上与其他局部立体匹配算法的匹配误差相比,实验结果表明,提出的算法优于其他局部立体匹配算法。

双目视觉;Census变换;立体匹配

近几年,双目视觉系统以立体匹配算法为基础,在智能机器人导航、无人驾驶、定位与地图构建(SLAM)、工业自动化等领域[1-3]得到了非常广泛的应用。立体匹配算法作为双目视觉系统中极为重要的部分,也是计算机视觉领域的许多科研学者乐以攻克的难题。其主要依靠双目摄像头来采集空间中的目标图像,以获取左右两幅相似但不相同的图像,通常称左图为参考图像,右图为匹配图像。依据两幅图像可以求得图像视差,根据求得的视差图能计算得到目标在物理空间中的信息,视差图的准确度直接影响了立体重建[4]的结果。

2000年,美国明德学院的Scharstein教授[5]发表文章首次提出立体匹配框架,并建立了一个权威的Middlebury立体视觉测评网站。短短几年的时间,立体匹配算法得到了飞速发展。在全局立体匹配算法中,经典的立体匹配算法有基于动态规划的立体匹配算法(DP)[6],基于置信度传播的立体匹配算法(BP)[7],基于平面约束的立体匹配算法[8]。全局立体匹配算法在算法时间复杂度较高的前提下,可以获得相对较低的匹配误差。

与全局立体匹配算法相比,局部立体匹配算法在实时性要求较高和算力一般的场景中更加适用。局部立体匹配算法通过匹配窗口去计算参考图像和匹配图像中为相同目标的可能性,经典的局部立体匹配方法有相似性测度函数有绝对差值和SAD(sum of absolute differences)算法、差值平方和SSD(sum of squared differences)算法、归一化互相关函数NCC(normalized cross correlation)、Census变换等。但经典的局部立体匹配算法匹配准确度较低而且对弱纹理以及深度不连续的图片区域敏感性较差,为了减小误匹配率,本文分析了常用的局部立体匹配算法。

1 立体匹配算法

立体匹配算法一般情况下被分为全局立体匹配算法以及局部立体匹配算法这2个大的类别。全局立体匹配算法通过构造一个全局能量函数来获得目标图像的全局最优视差数值,全局能量函数的表达式如下:

局部立体匹配算法通过构建一个局部的代价函数来对局部视差数值进行计算,与全局立体匹配算法代价函数相比,局部立体匹配算法不用考虑全局邻近像素点间的平滑程度,所以局部立体匹配算法的代价函数没有平滑约束项,只存在数据约束项。

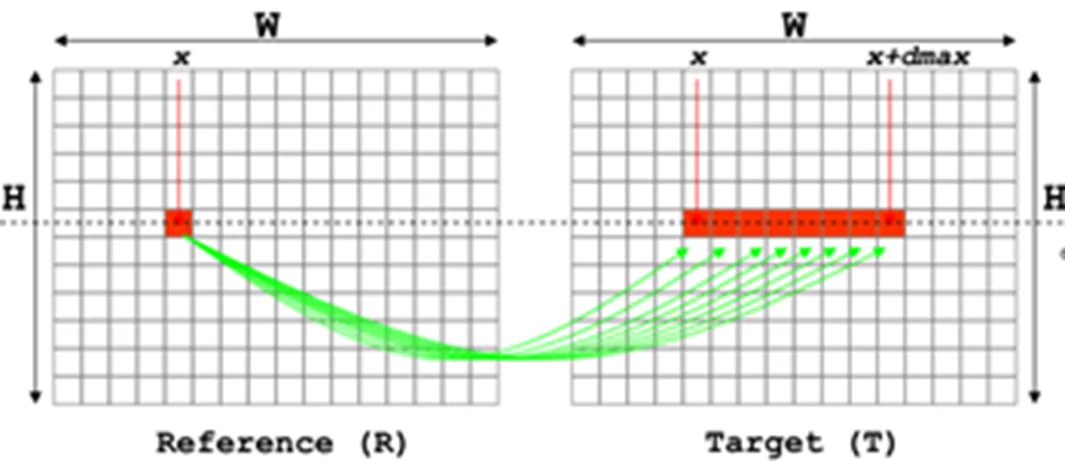

局部立体匹配算法常将待匹配的图像分割成大小相等的窗口,通过窗口可以获得图像中的灰度值信息、物体边缘信息,如图1所示。

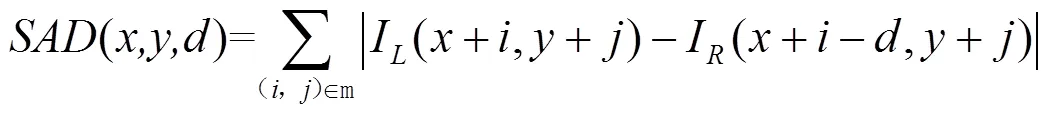

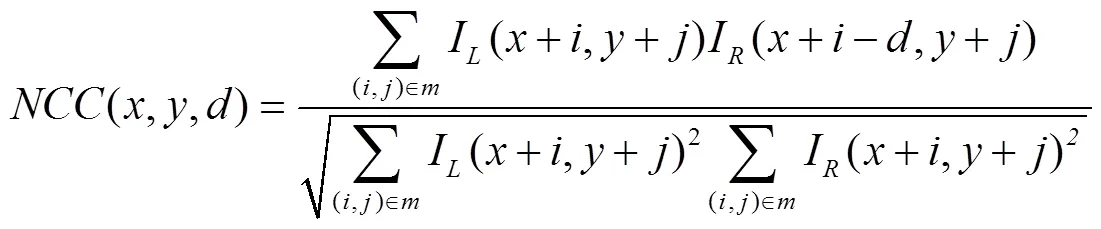

局部立体所以又叫作窗口匹配算法。通过比较左右2张待测图像中相对应点的领域窗口中的相关性程度,即可判断左右2张图像中的点为对应点的可能性。常见的用来描述区域的相似性测量函数有绝对差值和(SAD)、平方差和(SSD),归一化互相关函数(NCC),计算公式如下所示:

图1 划分窗口后的图像

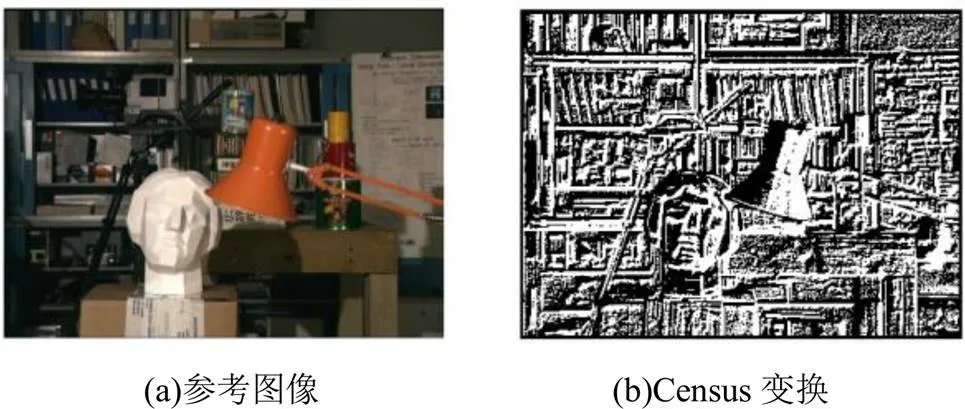

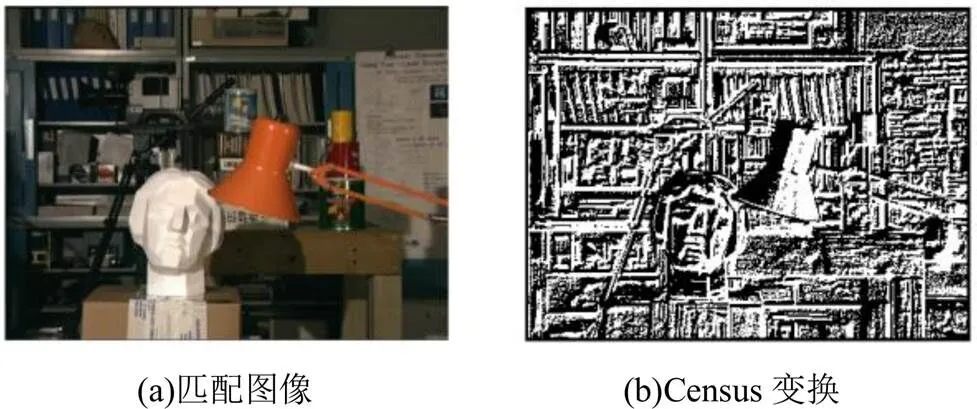

局部立体匹配算法中的另一种相似性测量函数是基于非参数变换的,主要包括Census变换和Rank变换[9-10]。Census变换因为能够有效地检测出图像中的边缘、角点特征等局部结构特征而被广泛应用,变换后的图像如图2、图3所示。

图2 参考图像及Census变换

图3 匹配图像及Census变换

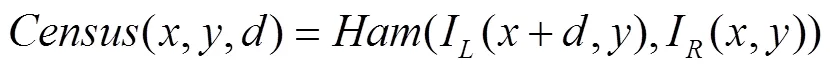

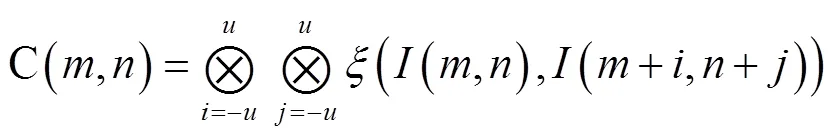

该方法能够充分地利用参考图像与匹配图像局部相关的特性,准确地检测出2张图片中的局部结构特征,其匹配代价函数表达式如下所示:

2 改进的Census变换立体匹配算法

在不显著增加算法复杂度的前提下,针对传统Census变换立体匹配算法中对图像中深度变化较大和纹理特征不明显的区域匹配精度不高的问题做了以下改进。通过采用改进型的Sobel算子[11]计算图像的边缘信息去自适应地调节窗口的尺寸来进行Census变换,以适应纹理及深度变化差别较大的图像区域。对深度不连续和图像边缘区域采用小窗口,对非边缘区域和深度变化不大的区域采用大窗口。

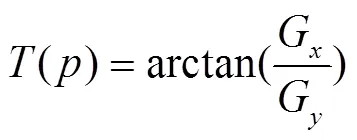

本文选用了改进的Sobel算子来计算图像的边缘,相比于传统Sobel算子,横向和纵向梯度算子的权值更为优秀,在对2个方向的边缘检测时的梯度幅度大小相同,因而能更加准确地获取图像的边缘信息。改进型的Sobel算子垂直和水平算子如图3所示。

图3 Sobel算子模板

式中:为图像矩阵;为每个卷积领域内的边缘像素的大小。

求出图像的边缘像素的大小后,依据求得的值在不同的区域采用不同大小的窗口尺寸进行Census变换,经过实验当阈值设定在80时,立体匹配的效果最好,窗口选择的规则为:

式中:为窗口的取值大小,在图像的窗口选择上,当图像的边缘较丰富时,即较大时,采用小的窗口以保护边缘信息。相反,当边缘信息较少时,采用大窗口。

窗口选定后,对参考图像和匹配图像分别进行Census变换,该变换过程类似局部二值模式,对窗口中心像素的数值与其领域的其他数值进行比较,窗口中邻域小于中心像素的点取1,大于中心像素值的点取0,关系式满足:

其中()为中心区域的像素点灰度值,()为邻域的像素值大小,通过关系式(7)拉伸可以得到对应的比特流码,表达式如下:

图4 改进型Census变换的过程

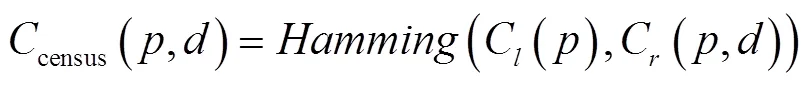

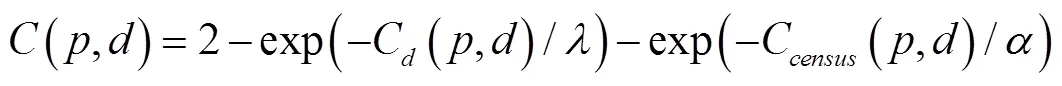

接下来通过计算Census变换的匹配代价码,求其汉明距离来得到左右2张图片的相似度,代价函数为:

为使Census变换在纹理较弱及深度不连续的区域匹配精度得以进一步提升,通过加入梯度信息进一步优化匹配能力,融合了梯度信息[12-13]的代价函数可以用下式表示:

而后通过代价聚合,以及视差优化[14]后可以获得最终的视差图,视差图可用来对图像进行三维重建。

3 实验结果与分析

3.1 实验环境搭建

平台采用了AMD_R5 3600x处理器,运行内存16G,软件使用Opencv以及Visual Studio 2015。数据集采用了明德学院的Middlebury立体视觉测评网站上的标准数据集,双目摄像头为Bumblebee2相机,该相机采用Sony CCD芯片,相机精度高且传输速度快。相机样张如图5所示。

图5 双目图像

3.2 改进的Census变换立体匹配实验

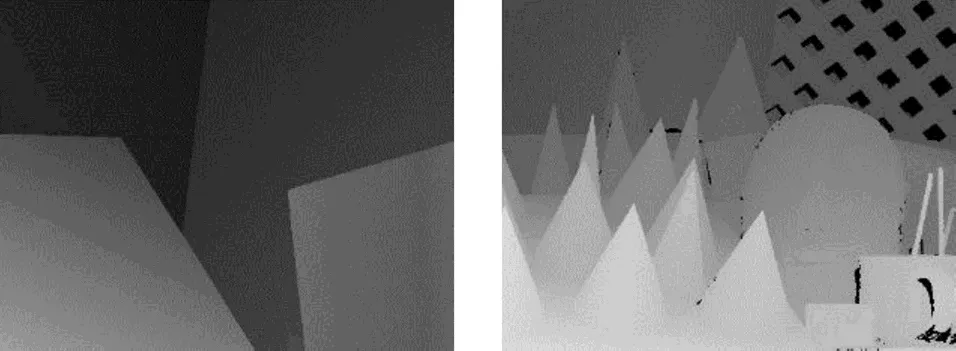

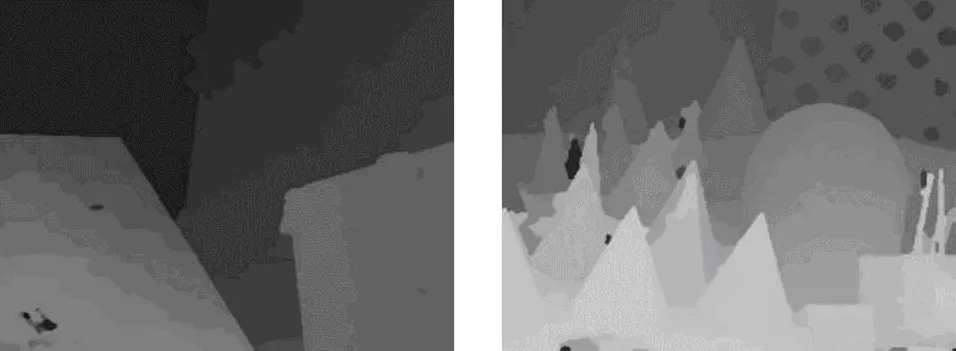

实验采用了Middlebury立体视觉测评网站上的(Cones,Tsukuba)图像测试集,代价匹配函数的参数选取对实验结果的影响至关重要,实验中窗口数值的选取分别为5和9两种类型的窗口,权重和截断值选取10和30,相似性参数选取0.05,可以得到图6~图10实验结果。

图6 原图

图7 Ground Truth

图8 SAD算法

图9 传统Census算法

图10 本文算法

图6~图10分别为原图、真实视差图、SAD算法结果、传统Census算法,以及本文算法结果,通过最终对比3种算法,可以初步发现改进型的Census有着更优秀的视差结果,对弱纹理以及深度不连续的区域响应更加准确。

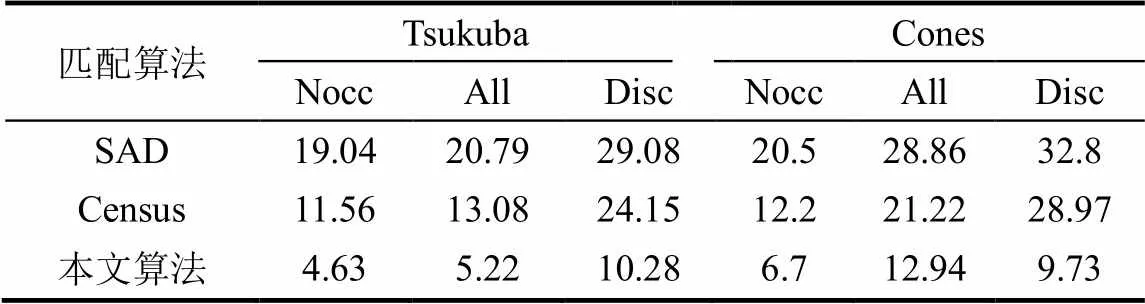

3.3 实验结果

借助Middlebury平台,本文对SAD算法/传统Census算法,以及本文立体匹配算法做了定量的分析,分别对其使用Nocc、All、Disc来比较各算法的性能。其中Nocc为图片中完整、不受物体遮挡的区域的误匹配率,All为整张图片的误匹配率,Disc为图片中深度跳跃较大区域的误匹配率,对比结果如表1。

表1 Tsukuba和Cones误匹配率结果对比 %

表1为图片Tsukuba和Cones的误匹配率对比结果,可以看到本文在2张测试图片中都有较好的匹配结果,本文的算法在Nocc(非遮挡区域误匹配率)、All(所有区域误匹配率)、Disc(深度不连续区域误匹配率)各方面性能均领先于SAD算法和传统的Census算法,而且所得视差图深度清晰,边缘连续,效果上优于其他对比算法。

表2是各种误匹配率的平均误匹配百分比,对比其他2种算法,本文的算法具有明显的优势,可以得到更优的视差图。

表2 平均误匹配率结果对比 %

4 结论

改进后的Census立体匹配算法相对于其他立体匹配算法,能够对图片中纹理不明显及深度变化较大的区域有着更加优秀的匹配结果,进而可以获得误匹配率较低的视差图,而良好的视差图直接决定了之后三维重建的结果。在适当增加算法复杂度的前提下,本文采用的不同大小窗口的变换方式对于有着不同内容的图片也有着良好的适应性。

[1] 陶凯. 基于双目视觉室内环境的机器人导航和避障算法研究[D]. 南京: 南京邮电大学, 2018.

[2] 张琦. 基于双目视觉的无人驾驶汽车测距、追踪与仿真研究[D]. 成都: 西南交通大学, 2019.

[3] 喻杨. 基于结构光和双目视觉的工件3D重建与测量[D]. 长沙: 湖南大学, 2018.

[4] Guan X, Chen J, Li X. 3D Reconstruction of Binocular Vision Using Distance Objective Generated from Two Pairs of Skew Projection Lines[J]. IEEE Access, 2017, 5: 27272-27280.

[5]Scharstein D, Szeliski R. A Taxonomy and Evaluation of Dense Two-Frame Stereo Correspondence Algorithms[J]. International Journal of Computer Vision, 2002, 47(1): 7-42.

[6] Veksler O. Stereo correspondence by dynamic programming on a tree[J]. Proc Cvpr IEEE, 2005, 2: 384-390..

[7] De H, Pf F. Efficient belief propagation for early vision[J]. International Journal of Computer Vision, 2006, 70(1): 41-54.

[8] 陈华, 王立军, 刘刚. 立体匹配算法研究综述[J]. 高技术通讯, 2020, 30(2): 157-165.

[9] Jun D, Lee J, Eem C, et al. Improved census transform for noise robust stereo matching[J]. Optical Engineering, 2016, 55(6): 63101-63107.

[10]龚文彪, 顾国华, 钱惟贤, 等. 基于颜色内相关和自适应支撑权重的立体匹配算法[J]. 中国激光, 2014, 41(8): 256-261.

[10] Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition[J]. Computer Science, 2014. https:// arxiv.org/pdf/1409.1556.

[11] 虎玲, 常霞, 纪峰. 图像边缘检测方法研究新进展[J]. 现代电子技术, 2018, 41(23): 32-37.

[12] 周喆, 沈建新, 韩鹏. 基于Census变换和引导滤波的立体匹配算法[J]. 应用光学, 2020, 41(1): 79-85.

[13] 谢伟, 周玉钦, 游敏. 融合梯度信息的改进引导滤波[J]. 中国图象图形学报, 2016, 21(9): 1119-1126.

[14] Zhan Y, Gu Y, Huang K, et al. Accurate Image-Guided Stereo Matching With Efficient Matching Cost and Disparity Refinement[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2016, 26(9): 1632-1645.

Stereo Matching Algorithm Based on Improved Census Transform

YANJia, CAO Yu-dong, QU Zhi, CAI Xu-biao

(School of Electronics & Information Engineering, Liaoning University of Technology, Jinzhou 121001, China)

Aiming at the defect of high mismatching rate of local stereo matching algorithm, a stereo matching algorithm based on improved Census transformation is proposed. Different scales of Census transformation window and improved cost matching function are adopted, and parallax map with higher matching degree can be output. Firstly, isotropic Sobel operator is used to extract the edge information of the image, which can be used as the basis to select Census transformation window. Then, the cost of similarity and gradient information is calculated by using the selected window. Finally, the similarity cost and gradient information cost are fused to obtain the final cost matching function, and after further processing the final parallax map can be obtained. The matching errors of other local stereo matching algorithms are compared with the errors of proposed algorithm on the Middlebury platform. The experimental results show that the proposed algorithm is superior to other local stereo matching algorithms.

binocular vision; Census transform; stereo matching

TP391

A

1674-3261(2021)01-0011-04

10.15916/j.issn1674-3261.2021.01.003

2020-06-15

国家自然科学基金项目(61772171);辽宁省自然科学基金项目(2019ZD0702)

闫 佳(1994-),男,河北张家口人,硕士生。

曹玉东(1971-),男,辽宁铁岭人,副教授,博士。

责任编校:孙 林