基于时空融合卷积神经网络的异常行为识别

王泽伟,高丙朋

(新疆大学 电气工程学院,新疆 乌鲁木齐 830047)

0 引 言

异常行为识别与检测在安防领域有着广泛的应用前景,与其它种类的行为识别相比,异常行为识别研究更具有实际意义。视频中的人类行为识别是近年来研究的热点,在很多领域都有着重要的应用价值,如智能监控、视频检索、智能人机交互等[1,2]。视频不仅具有外观信息还具有运动信息,因此结合时空信息对异常行为识别将具有更高的识别率。

根据所使用特征的方法可以将其分为两类:基于传统方法和基于深度学习的方法。与传统方法相比深度学习方法[3-5]识别准确率更高,鲁棒性更强。Zeiler等[6]使用视频帧RGB图像作为数据进行训练和测试,将卷积神经网络与行为识别任务相结合,使用UCF101数据集进行行为识别测试,识别率为64%。Annane等[7]提出一种双流卷积神经网络结构,获取帧与帧之间的运动信息,采用单帧RGB图像与光流图像共同作为训练数据,最后通过softmax输出结果,但是模型收敛速度较慢。

本文尝试采用双流卷积神经网络模型解决视频中异常行为分类问题,将时空CNN应用于细粒度异常行为识别任务中。提出了一种基于时空特征融合的方法,研究前期、中期、后期融合对识别率的影响以进一步提高异常行为识别的准确率。利用VGGNet16构建网络模型,使用UCF101数据集进行网络的预训练,将模型迁移学习到CASIA数据集上进行测试并与现有方法进行比较。

1 网络结构

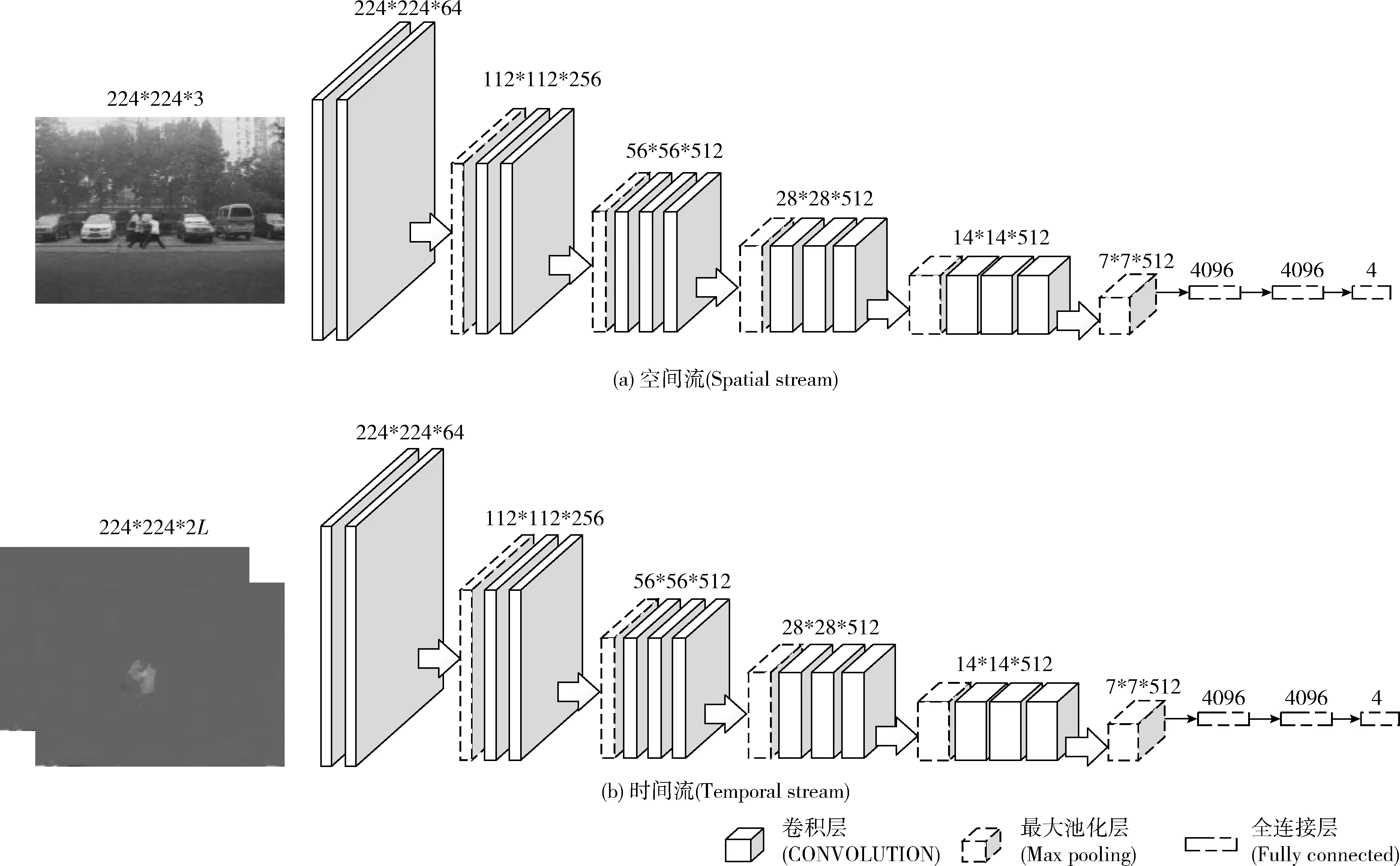

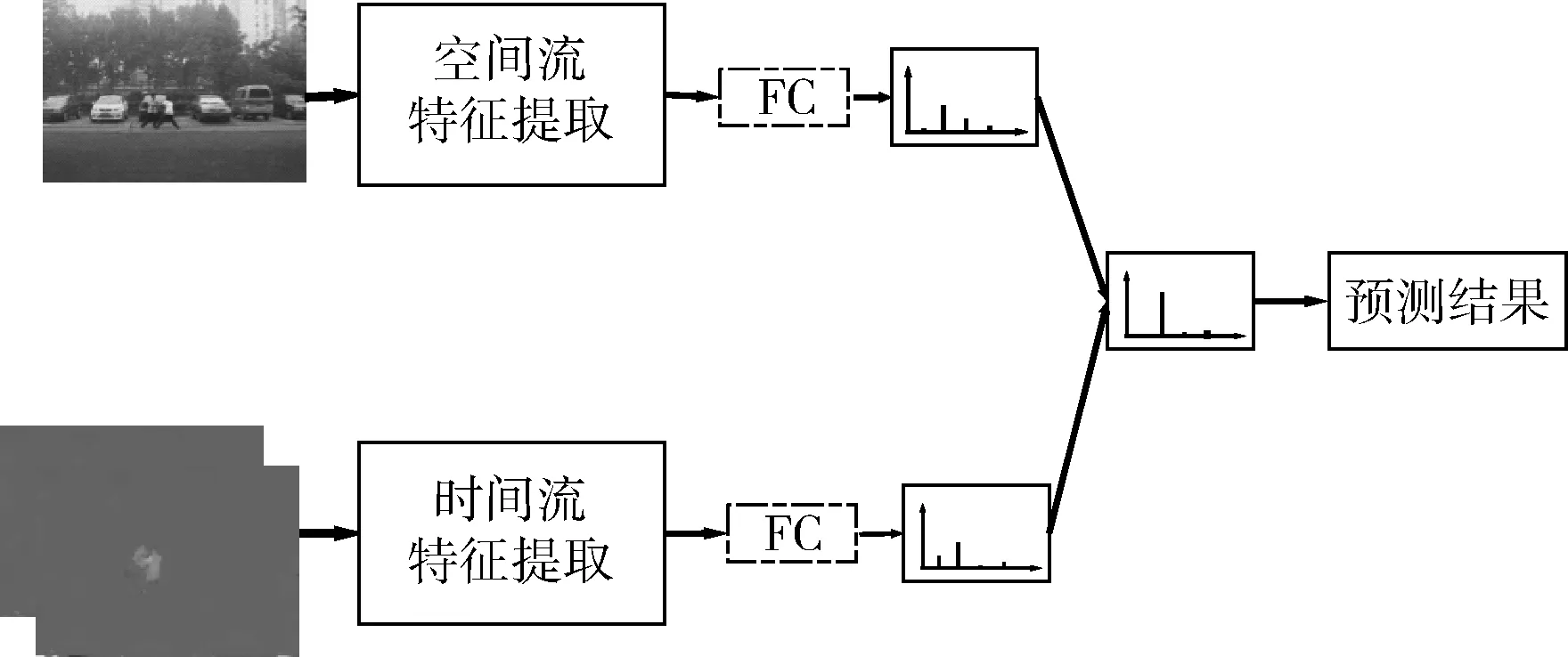

卷积神经网络是一种源于人工神经网络的深度学习方法,有着预处理工作较少,避免人工设计和提取特征,有较好的自学习能力和很强的自适应性的特点。本文充分考虑时间流信息对识别率的影响,设计一种双流卷积神经网络结构,空间流卷积神经网络和时间流卷积神经网络的结构如图1所示。

图1 双流卷积神经网络结构

空间流CNN可以从静止图像中有效地学习纹理、轮廓、兴趣点等外观信息,具有与Simonyan等[8]提出的VGGNet相同的结构。以224*224*3的单帧RGB图像为输入,输出不同异常行为类别的概率分布。空间流CNN由13个卷积层和3个全连接层构成。13个卷积层卷积核尺寸为3*3、步长为1,被堆叠成5个块。最大池化层内核尺寸为2*2,步长为2,连接在每个卷积块之后。全连接层可以将卷积特征映射到特征向量上。最后使用Softmax分类器,通过4个神经元输出不同异常行为类别的概率分布。

时间流CNN可以有效地学习运动信息,预测不同异常行为类别的概率,与空间流CNN具有相似的结构,只是它以224*224*2L大小的叠加光流作为输入。通过使用Brox等[9]提出的方法计算相邻L个视频帧之间位移光流的叠加。L个(L=10)连续帧的叠加光流形成2L通道输入du和dv是两帧之间位移矢量场的横轴和纵轴。推导如式(1)所示

(1)

其中,IT∈R×C×2L是时间流CNN的输入,R、C和L代表视频的行、列和帧长度。

2 融合方法

以单帧RGB图像和叠加的光流作为输入,空间流学习帧内静态线索,时间流学习帧间动态线索,每个流分别预测不同类别的概率。如何将空间流和时间流结合起来进行最终识别还需要进一步的研究,本文研究了3种不同的时空融合方法来结合两种流。

2.1 前期融合

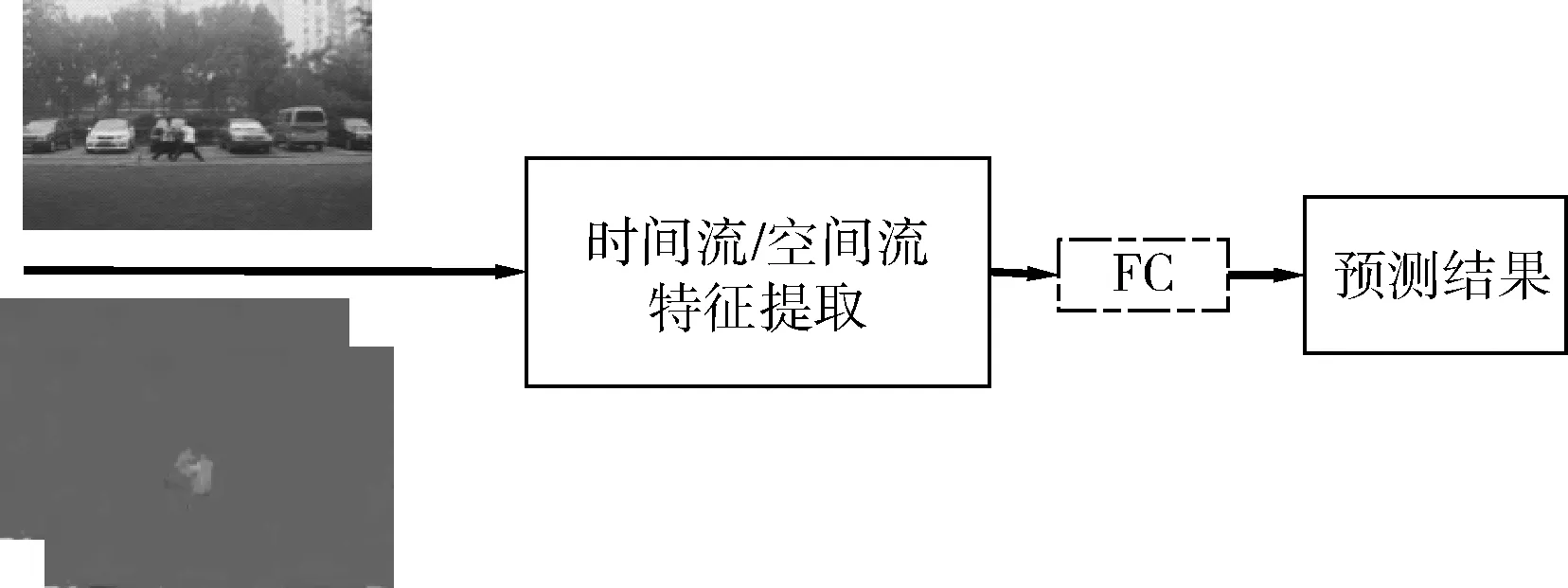

在前期的融合策略中,空间流和时间流是在网络开始时结合起来的。产生3+2L通道的输入(单帧RGB图像的3个通道和叠加光流的2L通道)。然后,整个网络(VGG16)以叠加的3+2L通道图像作为输入,提取时空特征,对不同的行为类别进行分类,其中FC为全连接层。图2显示了前期融合网络。

图2 前期融合流程

2.2 中期融合

与前期的融合策略相比,在中期融合策略中,单帧RGB图像及其叠加的光流分别输入空间流和时间流。两个流分别提取外观特征和运动特征。然后将提取的外观特征向量与运动特征向量进行线性组合,构成一个8192-D的时空特征向量。融合的时空特征可以表示为式(2)

f(2d-1)=fs t(d),

f(2d)=ftp(d)

(2)

其中,fs t代表4096-D外观特征,ftp代表4096-D运动特征,f是融合的时空特征。融合的时空特征f通过以下公式进行归一化如式(3)所示

(3)

图3 中期融合流程

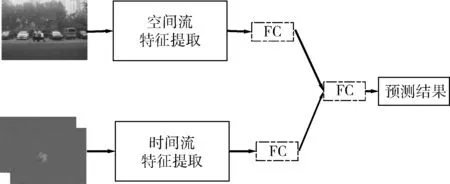

2.3 后期融合

对于后期融合,空间流和时间流中的SoftMax分类器直接用于分数融合,如图4所示。

图4 后期融合流程

我们定义fs t是空间流CNN提取的4096维矢量,ftp是时间流CNN提取的4096维矢量。概率p(j|fs t) 和p(j|ftp) 可通过Softmax分类器计算如式(4)和式(5)所示

(4)

(5)

根据贝叶斯原理[10],通过后期融合计算融合概率p(j|fs t,ftp)。 表示如式(6)所示

(6)

3 实验结果

本文所有实验均在一台机器上进行,实验条件为Intel Core-i5 8500 CPU、NVDIA1070 8G显卡、500G SSD/1T机械硬盘、Windows10操作系统,编程语言Python3.5。整个网络结构是通过Tensorflow框架实现的。

3.1 数据集介绍

在数据集方面,我们使用的是CASIA 行为数据集[11]。中科院自动化研究所模式识别国家重点实验室制作的CASIA行为数据集,视频中有个人行为,也有人人交互的行为。由正视、俯视、45°侧视这3种角度拍摄。收集了14种行为,其中有4种异常行为,包括打架、晕倒、抢劫和砸东西。4种异常行为如图5所示。

3.2 预处理数据

网络模型调参是通过学习一定量的样本数据完成的,不但训练过程的复杂程度较高,数据的计算量也相当的大。数据集中各类行为的数据量不足,导致在训练网络模型时易发生过拟合。为了提高模型的泛化能力,防止训练时发生过拟合,使模型更容易迁移学习到各类行为识别任务中,在模型训练前,需要对数据集进行扩充,不仅能提高数据容量,模型的学习效果也有相应的提高。

网络模型的输入分为两路,一路是单帧RGB图像,另一路是光流图像。我们通过随机水平翻转、随机剪裁、随机旋转和加入随机噪声的方式对单帧RGB图像进行数据扩充。而针对光流图像则通过图像的翻转、旋转和顺矢量方向逆转进行数据扩充。为了提高模型的收敛速率,训练前输入图像需要减去图像的样本均值。

对网络结构进行训练之前,我们使用OpenCV工具箱预先处理叠加的光流,用UCF101数据集分别预训练两个流。为了验证双流CNN可以有效地对异常行为进行识别,我们将在UCF101数据集上训练好的网络模型迁移到 CASIA数据集上,然后在CASIA数据集中微调两个流,进行识别,我们将在UCF101数据集上训练好的网络模型迁移到 CASIA数据集上,然后在CASIA数据集中微调两个流。

3.3 结果分析

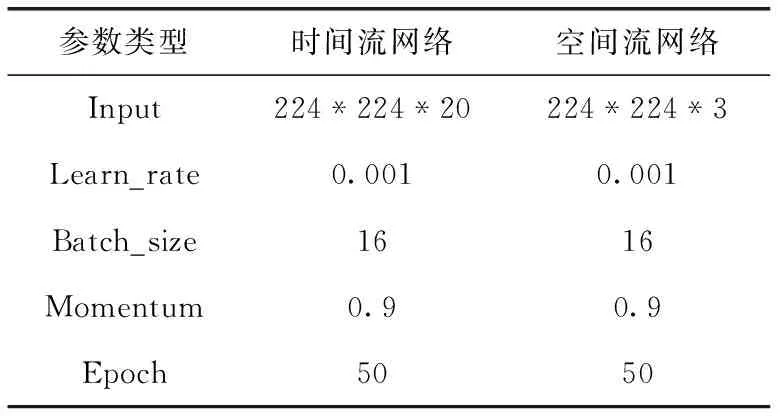

训练模型时间流和空间流的网络参数见表1,其中Input输入、Learn_rate是学习率、Batch_size是批处理参数、Momentum是冲量系数、Epoch是数据集全部通过卷积神经网络并返回的次数。

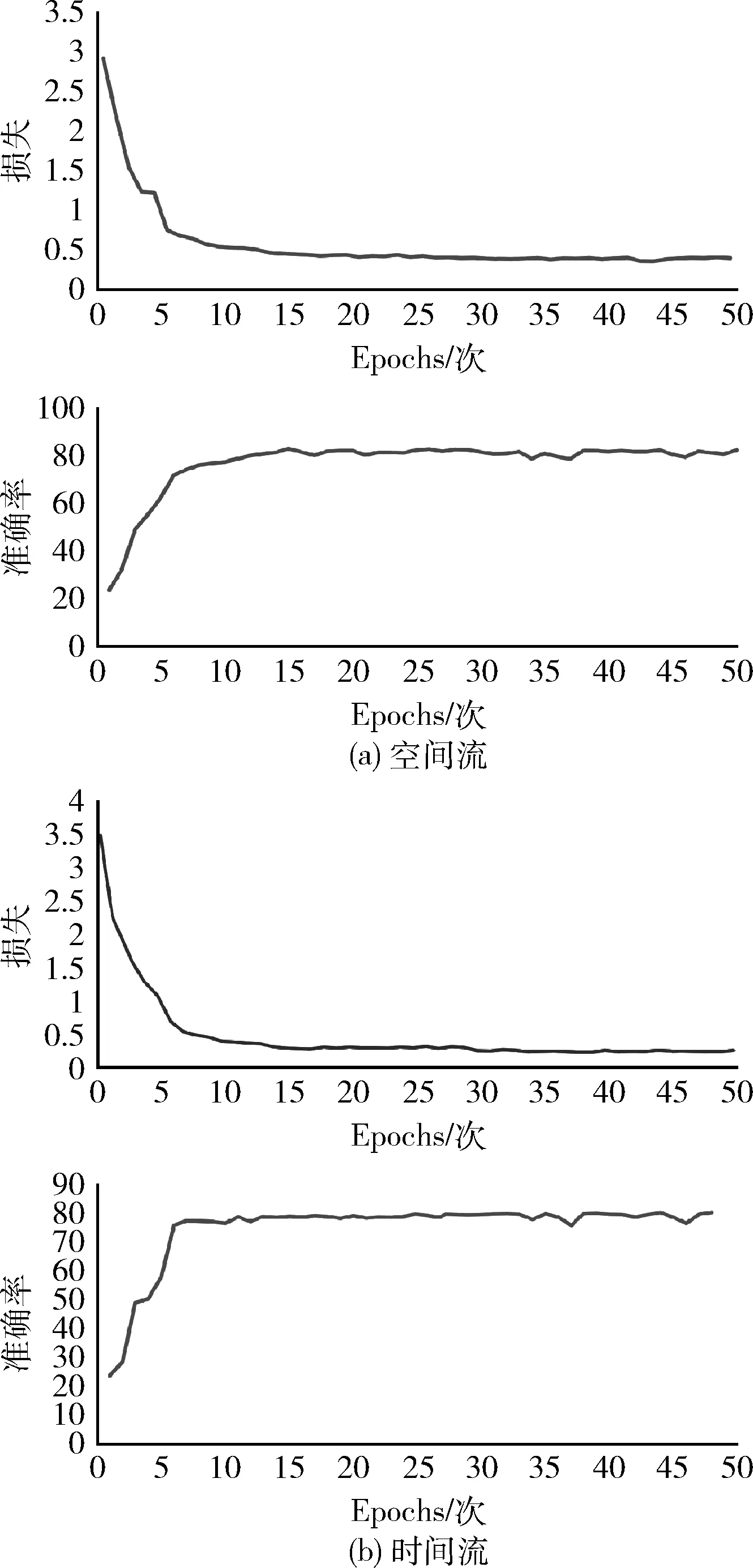

首先,我们对不同的行为分别进行标签,将75%划分为训练集25%划分为测试集,利用随机梯度下降法(SGD)对空间流和时间流进行训练。当训练超过25次Epoch时,时间流模型和空间流模型的准确率、Loss的变化率开始趋近平稳,模型的参数近似收敛到最优值附近。

通过图6的Loss值变化曲线可以看出该模型的收敛速度较快。在训练超过25个Epochs后,时间流和空间流的Loss值均下降并维持在0.5附近,时空双流卷积神经网络采用Dropout方法和L2范数正则化能有效避免网络训练过拟合,提高特征提取能力。

表1 时间流网络和空间流网络参数

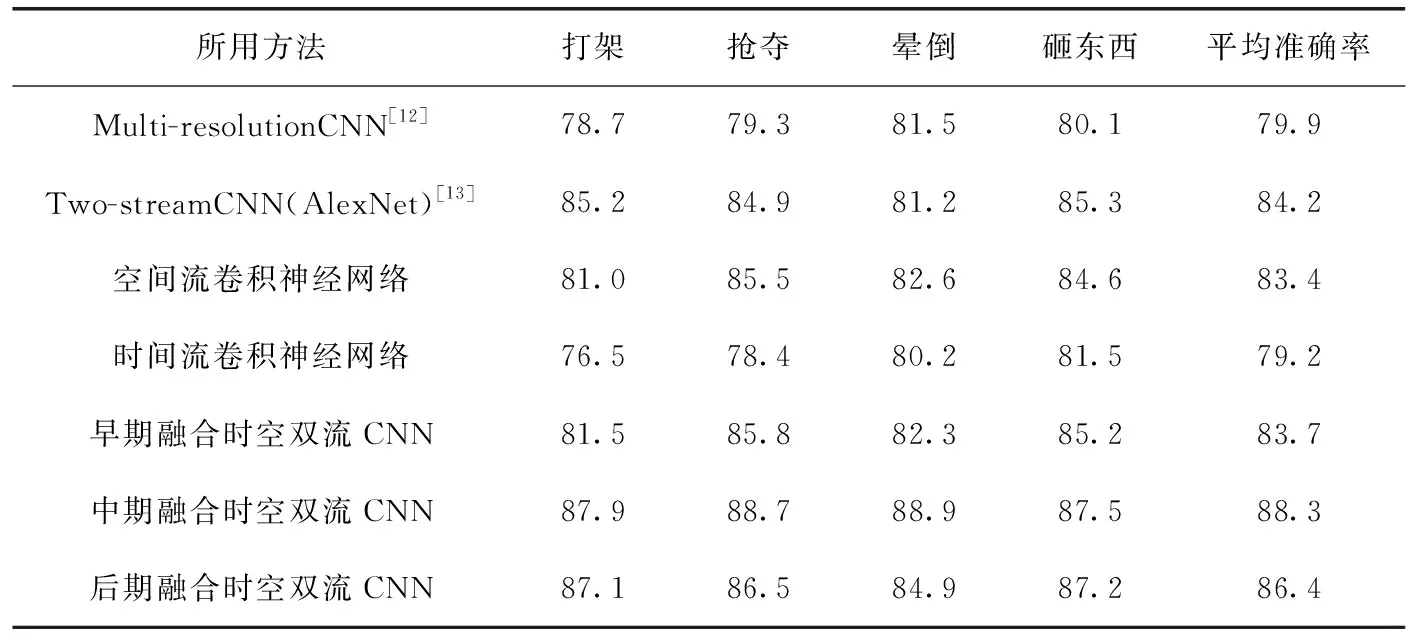

其次,为了验证时空融合卷积神经网络在行为分类任务上更具有优势,我们将所提出的体系结构与几种相应的方法进行了比较。实验包括多分辨率卷积神经网络方法和双流卷积神经网络方法。Karpathy等[12]使用叠加视频帧作为输入,训练多分辨率CNN识别人类行为。用该方法在CASIA数据集实验的平均准确率达到79.9%。Koesdwiady等[13]提出了一种基线方法,他们训练了一个双流Alexnet,将双流结构与分数融合结合起来。我们在CASIA数据集上对该方法进行了测试,平均准确率达到84.2%。我们还比较了不同时空融合方法的性能,我们提出的双流卷积神经网络与时空融合的方法在CASIA行为数据集上进行比较,实验结果见表2。由表2中数据可得,本文所提方法与多分辨率方法、双流卷积神经网络(Alexnet)方法相比识别率更高。其中,中期融合的方法与多分辨率方法比较,准确率从79.9%提高到88.3%,提高了8.4%。中期融合的方法与基于Alexnet双流结构的方法比较,准确率从84.2%提高到88.3%,提高了4.1%。

表2 几种方法准确率对比结果/%

最后,本文采用更深层次的卷积神经网络模型VGG16来获取异常行为识别的静态特征和动态特征。我们分别训练空间流卷积神经网络和时间流卷积神经网络。在测试阶段,空间流卷积神经网络的平均准确率为83.4%,时间流卷积神经网络的总平均准确率为79.2%,如图6所示。

图6 训练过程Loss曲线和测试过程准确率曲线

4 结束语

针对现有方法对时间信息利用不充分,本文提出一种基于时空融合的双流卷积神经网络视频异常行为识别方法。选择网络结构更深的VGG16模型替换原有的Alexnet模型。利用空间流卷积神经网络学习帧内外观信息,利用时间流卷积神经网络捕获帧间运动信息,研究了不同的融合方法,将空间流和时间流结合起来进行最终识别。为了验证所提方法的有效性,避免因训练样本不足导致模型过拟合现象,本文采用样本数据集扩充和迁移学习的方法,使用UCF101数据集对模型进行预训练,然后迁移学习到CASIA数据集上,对打架、抢夺、晕倒、砸东西等行为进行识别和分类。其中中期融合的准确率为88.3%,相比于既有的识别方法,本文提出的基于时空融合的双流卷积神经网络模型异常行为识别方法提取特征能力更强,识别准确率更高,具有实际应用意义。