基于PAF的深度图人体姿态估计

刘 涛, 杨 璐, 邵肖伟

(1 天津市先进机电系统设计与智能控制重点实验室(天津理工大学), 天津 300384; 2 机电工程国家级实验教学示范中心(天津理工大学), 天津 300384; 3 日本东京大学 空间信息科学中心, 柏市 2778568)

0 引 言

人体姿态估计是计算机视觉领域中一个重要的研究任务。该任务旨在定位人体部位的关节点(例如:头、肩膀、手腕等),并将关节点正确连接起来形成人体骨架。而对此展开研究、付诸应用则将对包括人体行为的理解[1-2]、人体的重识别[3]、人机交互等在内的诸多领域发展有着积极的意义。

过去,人体姿态识别多采用图结构模型(pictorial structure models),主要包括三大部分。首先通过图模型来描述人体的约束关系,其次使用人体部件观测模型对人体部件外观建立模型,最后依据约束信息和部件外观模型进行图结构的推理,从而估计人体姿态[4-5]。但是这些方法都不能很好地解决人体姿态估计的问题。

得益于深度学习的发展,卷积神经网络在图像领域中取得了可观的研究成果。近些年来,越来越多的人使用CNN来解决人体姿态估计问题。基于CNN的人体姿态估计大致可分为两大类:自上而下和自下而上。对此可阐释如下。

自上而下先检测图像中人的位置,生成包含人的边界框,然后对框中的人体进行姿态估计。文献[6]使用Faster-RCNN[7]检测图片中的人并生成边界框,使用全卷积的ResNet对每一个边界框中的任务预测关节点的热图(heatmap)和坐标进行补偿,融合这两部分信息得到人体关节点的定位。文献[8]使用对称的空间转换网络和参数化姿态非极大值抑制来解决定位误差和冗余检测的问题。文献[9]采用级联的金字塔结构增大网络的感受野来获得上下文信息,以此来检测遮挡的关节点。文献[10]则在网络中插入反卷积层来替代上采样和卷积组成的结构,将低分辨率的特征图扩张为原图大小。自上而下的方法依赖于人体检测的准确性,但在人体情况存在遮挡时,无法正确地进行估计。

自下而上则直接检测人体的关节点,根据关节点的热图、点与点之间连接的概率,根据图论知识将关节点分类到人,并且连接起来。文献[11-12]将人体部分连接关系转换为整数线性规划(integer linear program)来进行人体姿态的估计。文献[13]使用基于部件模型来处理语义层的推理和对象部分关联性。文献[14]采用嵌入式连接(Associative Embedding)将关节点的检测与分类组合到一个过程,实现端到端的网络。然而,自下而上需要建立复杂的推理过程。

综上,虽然人体姿态估计领域有许多的研究,但是大部分都是基于RGB图像,结合CNN针对深度图场景下的研究不多,文献[15]采用点云数据作为输入来解决深度图场景,但是点云数据获取远没有深度数据获取便利。并且深度图像在一些涉及私密环境下比RGB图像有更好的隐私保护性。针对深度图像场景下的人体姿态估计问题,本文使用自下而上,基于PAF[16]的人体姿态估计方法。通过构建卷积神经网络,进行关节点特征检测和PAF信息的提取,将这些信息通过图论匹配方法来构建人体姿态。

1 人体姿态模型

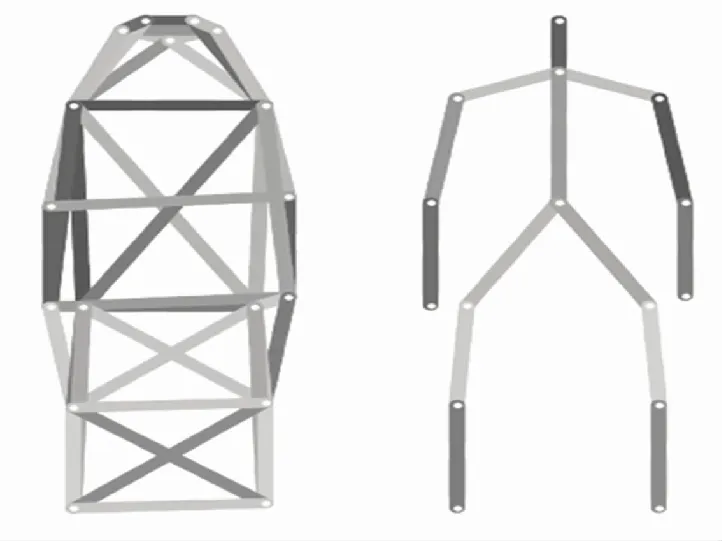

人体姿态估计包括检测人体的关节点,并正确地将这些关节点连接起来这两部分任务。一般关节点定义为:鼻、左眼、右眼、左耳、右耳、脖子、左肩、右肩、左肘、右肘、左腕、右腕、左髋、右髋、左膝、右膝、左脚踝、右脚踝。COCO[17]人体姿态模型的定义如图1所示。kinematic tree定义的人体姿态模型如图2所示。DensePose[18]所定义的人体姿态模型如图3所示。ITOP深度场景所定义的人体姿态模型如图4所示。

图1 COCO姿态 图2 kinematic tree姿态

2 算法

2.1 数据集

本文采用ITOP(Invariant-top view dataset)[19]数据集,ITOP数据集由点云数据转换为240×320的深度图片,包含2种视角,即:侧面图和俯视图,训练集两种视角分别为39 795张,测试集两种视角分别为10 501张。ITOP数据集的展示如图5所示。

图3 DensePose姿态 图4 ITOP姿态

图5 ITOP数据集

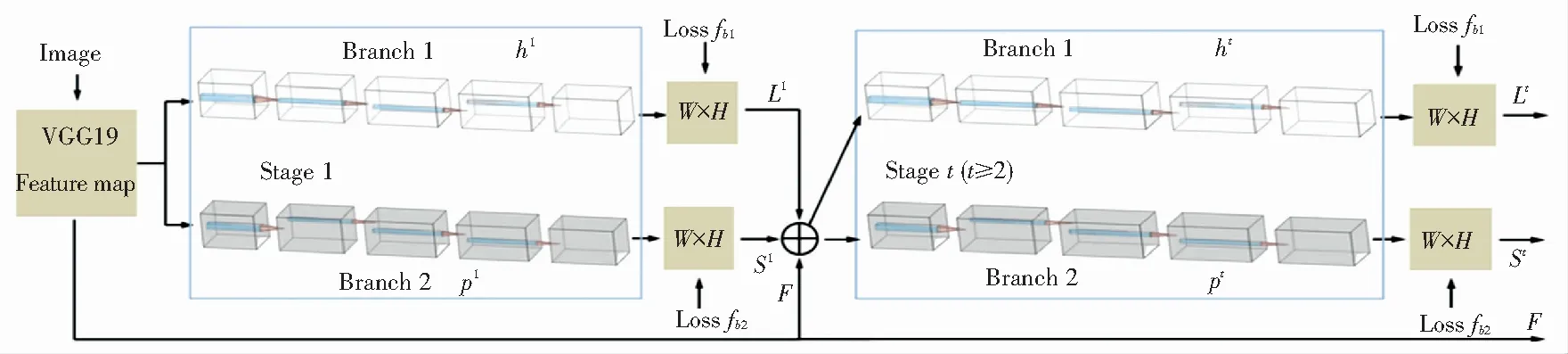

2.2 模型结构

图6展示了模型的结构。首先将图片输入到VGG19[20]中,得到特征图的集合F= (F1,F2,…,Fx),x代表特征图的个数。网络分为2个分支。第一个分支通过VGG19输出的特征图F产生对人体关节点的置信图,即L1=h1(F);第二个分支同样采用F产生关联域信息,即S1=p1(F)。h1和p1分别为第一阶段CNN的映射关系,这样的一个过程称为阶段1,下一个阶段将前一个阶段的输出与F结合作为输入:

Lt=ht(F,Lt-1,St-1),∀t≥2,

(1)

St=pt(F,Lt-1,St-1),∀t≥2,

(2)

其中,ht和pt分别表示第t阶段CNN的映射关系。

对于每一个阶段的每一个分支采用L2损失函数来估计预测位置和真实位置存在的差异。并且对于一些数据中关节点位置没有标注的情况,t阶段的损失函数可以表示为:

(3)

(4)

(5)

2.3 部件检测

(6)

图6 模型结构

2.4 部件关联域

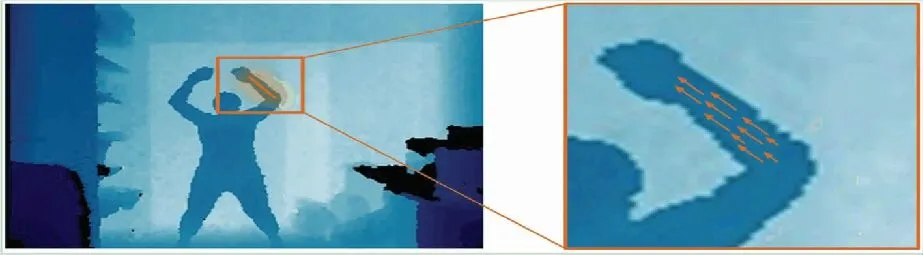

对于检测到的人体部件(头、肩等-即关节点),需要对身体部件的关联性进行置信度的预测(检测到的关节点是否属于同一人)。PAF是一个二维的向量场,保存着2个关节点连接间的位置信息和方向信息,研究得到的手肘到手的PAF信息如图7所示,包含了手肘到手腕的方向信息,得到的连接称为肢干。每个肢干对应着2个关节点的关联域。

图7 PAF信息

v=(xj2,i-xj1,i)/‖xj2,i-xj1,i‖2,

(7)

对于肢干上点的定义如下:

0≤v·(k-xj1,x)≤lc,i,

(8)

v⊥·(p-xj1,i)≤σl,

(9)

其中,肢干宽度σl为像素距离,肢干长度lc,i=‖xj2,i-xj1,i‖2,v⊥为v的垂直向量。

图8 PAF坐标

在测试过程中,计算沿着候选关节点位置线段上相应PAF的积分,来测量关节点之间的关联,得到每一段肢干的信息。即对于2个候选关节点dj1和dj2,从预测的关联域中取点u,通过取到的点来判断两关节点的关联性。计算时需用到的公式为:

(10)

其中,k(u)为关联域间的点,对应数学公式具体如下:

k(u)=(1-u)dj1+udj2.

(11)

2.5 基于PAF的姿态匹配

n∈{1,...,Nj2}},

(12)

对于肢干上一对关节点的最优匹配问题则可以转化为最大权值的二分图匹配(maximum weight bipartite graph matching)[22]问题。在图匹配问题中,图的节点为人体关节点的检测坐标,记为Dj1和Dj2,图的边(edges)是检测关节点之间可能存在的连接。每条边通过公式(11)进行加权计和运算,通过图中的2条边共享一个节点来选择边的子集,转化为找到边的最大权值。此时,其数学公式可写作如下运算形式:

(13)

其中,Ec为肢干c匹配的总权重;z为肢干c的子集;Emn为公式(10)中关节点之间的关联,公式(13)保证两点共用一个边。最后使用Hungarian算法[23]获得最佳匹配结果。

3 实验及结果分析

实验环境基于服务器下进行,显卡配置为4块12 GB的NVIDIA TITAN V,操作系统为Ubuntu16.04。代码语言选用Python和深度学习框架Pytorch。

训练时大小为每批次64,初始学习率为0.001,最大迭代次数为38 000,动量为0.9,权值衰减为10 000步,30 000步,每次衰减为原来的一半,优化方式为Adam,优化器参数为0.9,0.999,10e-8。

本文在ITOP数据上训练,对数据关节点进行处理,使其与COCO关节点检测数据格式相同,并采用COCO的人体姿态模型。网络训练的损失曲线图如图9所示。在网络迭代到前1 000次左右快速收敛,在后面的步数中缓慢下降,蓝色区域选取的为10 K~30 K的损失收敛情况,通过右边的小图为图9中蓝色方框框选出的详细结果图,损失在10 K时的0.035缓慢下降到30 K时的0.025;绿色区域为30 K~38 K的损失收敛情况,绿色折线图为区域的详细结果图,从30 K时的0.028左右缓慢收敛到0.020以下。

图9 训练损失图

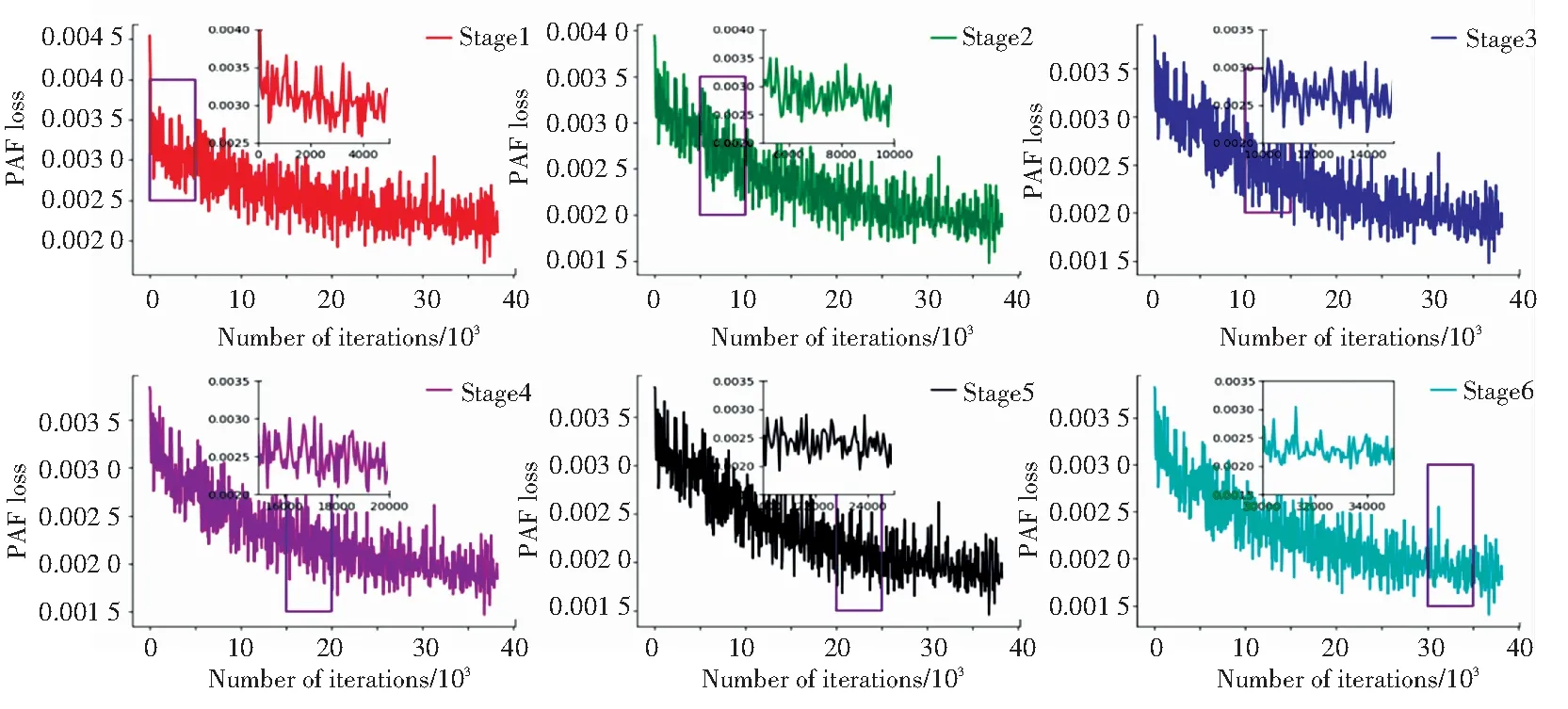

继而,研究又得到网络在各个阶段关节点热度图和PAF信息的损失曲线图如图10所示。图10中显示了每个阶段关节点热度图的损失曲线图收敛情况,分别选取了不同步数,从stage2中的0.003 5到最后stage6的0.002 5。每个阶段肢干PAF信息的损失曲线图收敛情况如图11所示,同样选取了不同步数时的结果。结果可知网络的总损失等于每个阶段关节点热度图损失值和肢干PAF损失值的总和。模型在测试集上的检测结果如图12所示。

图10 关节点热度损失图

图11 PAF损失图

图12 模型预测结果

4 结束语

基于深度图像的人体姿态估计具有非常大的研究意义,特别针对一些家庭等高度隐私的环境。本文采用PAF和CNN结合的方法,通过连接关节点信息和肢干信息来估计深度图下的人体姿态。在深度数据集上的实验表明,算法体现出了良好的性能,模型在测试集上预测的结果表明了算法在深度图场景下其能够准确的估计人体姿态。