线结构光视觉传感器机器人手眼关系标定

陆艺 沈添秀 郭小娟 郭斌

摘要:为实现对工业机器人手眼关系的标定,提出一种基于线结构光视觉传感器的手眼关系标定方法。该方法在标定时,将一个平面靶标作为参考物固定在工业机器人工作空间内,控制工业机器人末端运动以带动线结构光视觉传感器作多组变位姿运动,获取在不同位姿状态下的平面靶标图像并对其进行图像处理。通过对图像上固定特征点的测量,以及建立线结构光视觉传感器模型和手眼关系模型实现对线结构光内参数和手眼关系的标定。用棋盘格标定板进行测量实验验证,实验结果表明该方法准确度为0.036mm,即优于40μm,可用于工业机器人的测量应用。

关键词:手眼关系;线结构光传感器;标定;工业机器人

中图分类号:TP242.2 文献标志码:A 文章编号:1674-5124(2019)10-0006-04

0 引言

工业机器人广泛应用在工业制造领域,通常需要将测量传感器安装在机器人末端,以获取被测物的三维信息。因此可将线结构光视觉传感器安装于六轴工业机器人末端,构成基于线结构光的机器人视觉测量系统。该系统可通过控制机器人以不同位

收稿日期:2018-10-30;收到修改稿日期:2018-12-17

基金项目:浙江省基础公益研究计划项目(LGG18E050009);浙江省科技计划项目重大科技专项(2018001063)

作者简介:陆艺(1979-),男,江苏扬州市人,副教授,硕士,研究方向为精密检测技术、汽车零部件自动化测试。姿运动,从而对目标点进行测量获得测量坐标系与目标点之间位置关系。要实现上述测量过程,需要先对线结构光传感器内参数和机器人手眼关系进行标定。其中线结构光传感器内参数标定根据靶标不同分为三维标定[1-2]和二维标定[3]两种。三维标定靶标具有一定精度,但靶标成本和工艺要求高。二维靶标制作简单、效率高,标定精度能满足不同场合的测量需要。手眼关系标定方法通常有有限场景点法[4],平面靶标法[5-7],标准球法[8]等。其中手眼关系转换矩阵的求解可通过两步分离法[9]或单步法[10-11]得到,单步法可一步得到旋转向量、平移向量,两步分离法分两步得到旋转向量、平移向量,它存在累积误差。

为此提出基于线结构光视觉传感器的手眼关系标定的方法。该方法采用二维平面靶标进行标定,并通过单步法求解手眼关系。它简化工业机器人测量系统的标定过程,仅通过控制机器人末端作位姿运动同时得到摄像机内外参数,线结构光内参数以及手眼关系,保证较高精度。以研华LNC-56000型六轴工业机器人为实验平台进行标定和测量实验,验证该方法的有效性。

1 系统标定原理

1.1 线结构光视觉传感器模型

线结构光传感器数学模型如图1所示,该传感器包括CCD相机以及线激光器两部分。其中被测点尸在图像坐标系OUV下坐标为(u,v),在相机坐标系OcXcYcZc下坐标为(xc,yc,zc),在世界坐标系OwXwYwZw下坐标为(xw,yw,zw),像面坐标系为OXY,相机主点坐标为(u0,v0)。

结合上述模型,根据相机的投影变换模型,被测点尸在图像坐标系和相机坐标系的关系为式(1),相机坐标系和世界坐标系的关系为式(2):其中kx,ky为相机X轴、Y轴放大系数,MC为相机内参数矩阵,CMW为相机坐标和世界坐标转换关系外参数矩阵,包括旋转矩阵R和平移矩阵T。

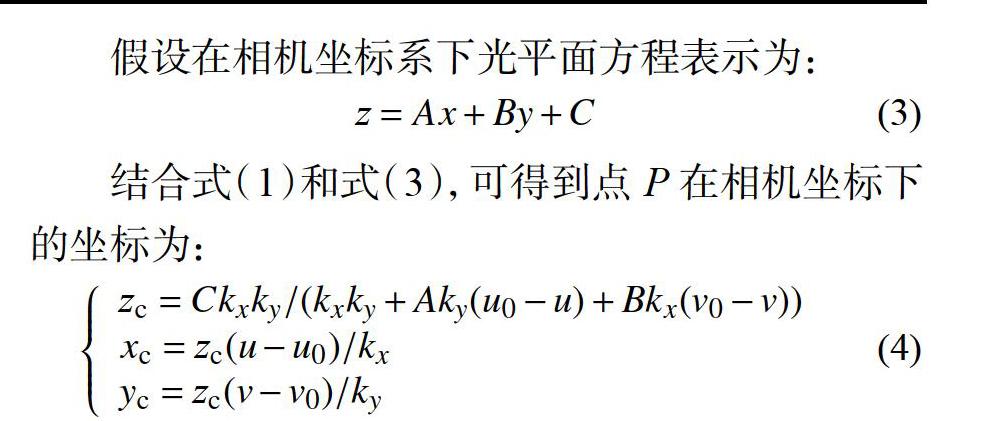

假设在相机坐标系下光平面方程表示为:

z=Ax+By+C(3)

结合式(1)和式(3),可得到点P在相机坐标下的坐标为:

根据以上过程,已知光平面在相机下的方程即可得知空间某一点在相机坐标系下的坐标。式中kx,ky,u0,v0即为需要标定的相机内参数,光平面方程系数A,B,C即为待标定的结构光内参数。

1.2 确定线结构光内参数

采用如图2所示的棋盘格标定板作为平面靶标,棋盘格为7×7的方形靶标,棋盘格大小为11mm×11mm。将标定板固定放置在工业机器人工作空间内,控制工业机器人带动线结构光传感器不同姿态得到靶标图像。通过张正友标定法[12]获得相机内外参数MC,CMW,即kx、ky、u0、v0和靶标坐标系与相机坐标系的转換矩阵。靶标上角点和激光条形成交点,这些交点都为光平面上的点,将它们作为标定线结构光内参数的标定特征点。由式(2)得到这些特征点在相机坐标系下的坐标。通过使机器人末端带动线结构光传感器运动到不同位置,获取多组标定特征点在相机坐标系下的坐标,由此可拟合相机坐标系下的光平面方程,获得线结构光内参数A、B、C。

1.3 手眼关系模型

把线结构光视觉传感器安装在工业机器人末端,由此构成机器人视觉测量系统。按照图3所示建立坐标系,其中Ob为机器人基坐标系,Qw为世界坐标系,Oe为工业机器人末端坐标系,Oc为相机坐标系。

由1.1和1.2可知,激光器投射出的光平面与被测物体相交形成光条,根据相机内参数及线结构光传感器内参数即可得到被测点在相机坐标系下的坐标。控制机器人运动到不同位姿,通过式(5)将被测点的坐标统一到世界坐标系即机器人基坐标系下,便可获得被测物体三维数据。

Pb=A60XPc(5)其中Pb为被测点P在机器人基坐标下的坐标;Pc为被测点尸在相机坐标系Oc下的坐标;A60为D-H[13]运动学建模的机器人末端坐标系De相对于基坐标系Ob的坐标转换矩阵;X为待标定的手眼关系矩阵即传感器坐标系Oc相对于机器人末端的坐标变换,为常矩阵。

1.4 手眼关系标定

同样使用棋盘格作为标定靶标,选取棋盘格上的固定点作为手眼标定特征点,把棋盘格固定在机器人工作空间内,机器人带动传感器不同位姿下拍摄该点,并使该点处于激光面上。由1.3可知该点在传感器坐标系下坐标记为Pc在机器人基坐标下的坐标记为Pb,手眼矩阵记为X,分别以齐次坐标表示它们为:

对固定点进行n次测量,则有:

可由式(9)建立方程组:

对上述方程组进行求解,可得到手眼矩阵X。

2 标定实验及结果

线结构光视觉传感器中选用分辨率为1280×960的相机,波长为650nm的红外线一字线激光器,搭建完成的机器人视觉测量系统。

针对线结构光的机器人视觉测量系统进行标定的实验步骤如下:1)在激光器关闭情况下,使机器人在不同位姿拍摄20张棋盘格图片,用于相机内外参数的标定,并使其中2个姿态得到图片能够适用于光平面标定(激光线与某行角点重合);2)在拍摄1)中的2个特殊位置的图片时打开激光器,得到带激光线的棋盘格靶标照片;3)利用1)中获取的图像,通过Matlab标定工具箱得到相机的内参数,以及2张特殊位置的外参数(棋盘格相对于相机的旋转矩阵);4)根据3),利用2)中的获取的带激光线特征点的图像数据标定线结构光内参数;5)打开激光器从不同位姿拍摄9组图像中包含固定点图片;6)根据4)中得到的结果,利用5)中的数据,得到手眼矩阵。按照上述标定步骤,得到摄像机内夕渗数为:

线结构光内参数为:

A=-0.4602;B=0.0049;C=481.6375

手眼矩阵为:

3 精度验证实验

在完成上述标定工作后,设计如下实验对测量系统精度进行验证。在图4中的两个位置对棋盘格所示角点A、B、…、F,G、H、…、L进行测量,验证线结构光内参数和手眼关系的标定结果。在机器人工作空间内放置棋盘格,棋盘格每个格子边长规格为11mm×11mm(准确度3μm)。由上述方法标定的线结构光视觉传感器读出各待测点在传感器坐标系下的三维坐标,并通过手眼关系结果转换到机器人基座标下,得到相应线段AB,BC,…,KL的测量尺寸,将实际测得尺寸与标准尺寸比较。验证实验示意图如图4所示。

分别在不同姿态下进行5次实验,实验结果统计如表1所示。从表中数据可知,取测量结果的平均值并求得其标准差为0.036mm,即该测量系统精度优于40μm。

4 结束语

本文构建了一种基于线结构光的工业机器人视觉测量系统,并针对该系统提出基于线结构光传感器的手眼关系标定,减小了因线结构光参数的变化对整体测量精度的影响,使用同一标定靶标简略了标定步骤。该方法在获取用于相机标定靶标图像时,同时得到标定线结构光内参数的图像,在不同位姿变化中,基于单点约束标定了手眼关系。最后通过测量棋盘格标定板进行精度验证,实验结果表明该方法具有较高测量精度即优于40μm,可以應用于工业机器人测量。

参考文献

[1]DUAN F J,LIU F M,YE S H.A new accurate method for thecalibration of line structured light sensor[J].Chinese Journalof Scientific Instrument,2000,21(1):108-110.

[2]WANG W,LI A,MA Z,et al.An automated method to robotcalibration using line-structure-light vision sensor[C]//IEEEInternational Conference on Automation and Logistics.IEEE,2009:1896-1899.

[3]FAN J,JING F,FANG Z,et al.A simple calibration methodof structured light plane parameters for welding robots[C]//Chinese Control Conference.2016:6127-6132.

[4]XU H X,WANG Y N,WAN Q,et al.A self-calf-brationapproach to hand-eye relation of robot[J].Robot,2008,30(4):373-378.

[5]KEFERSTEIN C P,MARXER M.Testing bench for lasertriangulation sensors[J].Sensor Review,1998,18(3):183-187.

[6]WEI Z,XIE M,ZHANG G.Calibration method for linestructured light vision sensor based on vanish points andlines[C]//International Conference on Pattern Recognition.IEEE,2010:794-797.

[7]沈波波,许嘉璐,孔明.基于线结构光的空调四通换向阀高度测量[J].中国测试,2018(3):33-37.

[8]LIU Z,LI X J,LI F J,et al.Calibration method for line-structured light vision sensor based on a single ball target[J].Optics and Lasers in Engineering,2015,69:20-28.

[9]解则晓,牟楠,迟书凯,等.结构光内参数和机器人手眼关系的同时标定[J].激光与红外,2017,47(9):1142-1148.

[10]熊会元,宗志坚,高群.一种线结构光视觉传感器手眼标定方法及仿真[J].系统仿真学报,2010(9):2223-2226.

[11]王金桥,段发阶,伯恩,等.线结构光扫描传感器结构参数一体化标定[J].传感技术学报,2014(9):1196-1201.

[12]ZHANG Z.A flexible new technique for cameracalibration[J].IEEE Transactions on Pattern Analysis&Machine Intelligence,2000,22(11):1330-1334.

[13]SHAH S V,SAHA S K,DUTT J K.Denavit-Hartenbergparameterization ofeuler angles[J].Journal ofComputational&Nonlinear Dynamics,2012,7(2):021006-021006-10.

(编辑:刘杨)