适用于数据分类的极限学习机优化算法

吴亚榕 王欢 李键红

摘 要:针对极限学习机参数优化问题,提出量子遗传算法优化极限学习机的方法(QGA-ELM)。在该方法中,对ELM的输入权值和隐含层阈值采用量子比特编码,并将其映射为QGA的染色体,QGA的适应度函数为对应ELM的分类精度;通过QGA的量子旋转门优化出输入权值与隐含层阈值,以此训练出分类精度更高的ELM,从而改善ELM的泛化性能。通过ELM和QGA-ELM对数据集的仿真结果对比表明,QGA-ELM有效地提升了ELM网络的分类精度。

关键词:极限学习机;量子遗传算法;量子旋转门;分类精度

DOI:10. 11907/rjdk. 191561

中图分类号:TP301

文献标识码:A文章编号:1672-7800(2019)006-0010-04

Abstract: In order to optimize the parameters of traditional extreme learning machine (ELM), a new ELM optimized by quantum genetic algorithm (QGA-ELM) was proposed. In this method, the input weights and hidden layer threshold vectors of the ELM were encoded by quantum bits and mapped to chromosomes of QGA, and the fitness function of QGA is the classification accuracy of the corresponding ELM. The input weights and hidden layer threshold vectors optimized by quantum rotation gate were used to train the ELM with higher classification accuracy, thereby improving the generalization performance of ELM. Comparing the simulation results of QGA-ELM and ELM, we draw the conclusion that QGA can effectively improve the classification accuracy of ELM network.

Key Words:extreme learning machine;quantum genetic algorithm;quantum rotation gate;classification accuracy

0 引言

数据分类是当今高新技术领域最重要的研究热点之一,其利用某些特征,对一组对象进行判别或分类。数据分类所涉及的信息往往存在高维度、影响因素多、关系复杂等特征,单靠人的思维往往难以有效地确定其规律,需要通过一定的数学方法借助计算机完成。 如何从这些复杂数据信息中发现更多、更有价值的关联信息,找到其内在规律,建立的模型能更好地反映研究对象的实际特征,容易与先验知识相融合,并能适应大规模数据处理要求,正逐渐成为当前数据分类的焦点。近年来,很多学者将基于神经网络的算法应用于数据分类研究中,例如,BP神经网络、离散HOPFIELD网络、支持向量机、自组织网络、模糊神经网络和广义神经网络等[1-8],取得了很多成果。由于神经网络大多采用梯度下降方法,往往存在训练速度慢、容易陷入局部极小值、学习率敏感性等不足,因此,探索一种训练速度快,能够获得准确的最优解且具有良好泛化性能的训练算法是提升神经网络性能的主要目标。

极限学习机是一种训练神经网络的有效方法,具有学习速度快、泛化性能好等优点[9-11]。该方法通过对单隐含层前馈网络的输入权值和隐含层节点的阈值随机赋值,用最小二乘法求解输出权值矩阵,极大提高了网络训练速度和泛化能力。但是随机产生的网络输入权值和隐含层节点阈值等参数不能保证训练出的ELM模型达到最优,从而影响模式识别精度。量子遗传算法(Quantum Genetic Algorithm)是一种基于量子计算原理与传统遗传算法[12-13]相结合的概率优化方法,它采用量子比特的概率幅表示方法对染色体进行编码,并利用量子逻辑门对染色体进行更新,表现出优于传统遗传算法的搜索性能[14-18]。

为了提高ELM模型的模式识别精度,本文提出了一种基于量子遗传算法优化的极限学习机算法。其主要创新点可以表述为:通过在极限学习机中引入遗传算法进行优化,把经量子遗传算法优化ELM输入权值的问题,转化成量子遗传算法选择最优染色体的过程。将QGA-ELM和ELM运用到数据分类上进行仿真实验,结果表明QGA-ELM算法的分类精度和泛化能力均远高于传统的ELM算法,验证了QGA-ELM算法的有效性。

1 极限学习机

典型的单隐含层前馈神经网络如图1所示,由输入层、隐含层和输出层组成,输入层与隐含层、隐含层与输出层神经元间全连接。

3.3 染色体选择

计算出每个染色体的适应度后,对种群中每个染色体进行量子旋转门操作,形成新一代染色体种群。当染色体进化到事先设定的最大迭代次数时,选出种群中最优染色体作为优化后ELM的输入权值和隐含层阈值。

4 实验及结果分析

4.1 實验数据描述

为了对QGA-ELM算法的泛化能力和分类性能进行评估,采用4个分类数据集进行实验。数据集皆取自UCI(Machine Learning Repository)。表1描述了4个数据集的基本信息,这4个数据集的特征数与类别数的组合具有比较典型的特征。Iris数据集的特征数与类别数取值都比较小;Wine数据集的特征数明显高于类别数;Breast Cancer数据集是典型的二值分类数据集;Wine Quality数据集的特征数与类别数取值都比较大。

4.2 实验参数设置

算法参数设置:种群数SP为40,最大迭代次数MAXGEN为100,变量比特长度CL为20,隐含层神经元数目HIDN为数据集样本总量SN的50%,训练集的样本数PN为数据集样本总量SN的70%,测试集的样本数TN为数据集样本总量SN的30%。

4.3 实验结果分析

针对数据分类问题,最重要的算法性能评价指标是分类精度。表2给出了ELM和QGA-ELM两种算法在4个数据集上的实验结果。从表2中显示的结果可以看出,通过QGA对ELM输入权值和隐含层阈值的优化,QGA-ELM算法的分类精度要高于ELM。

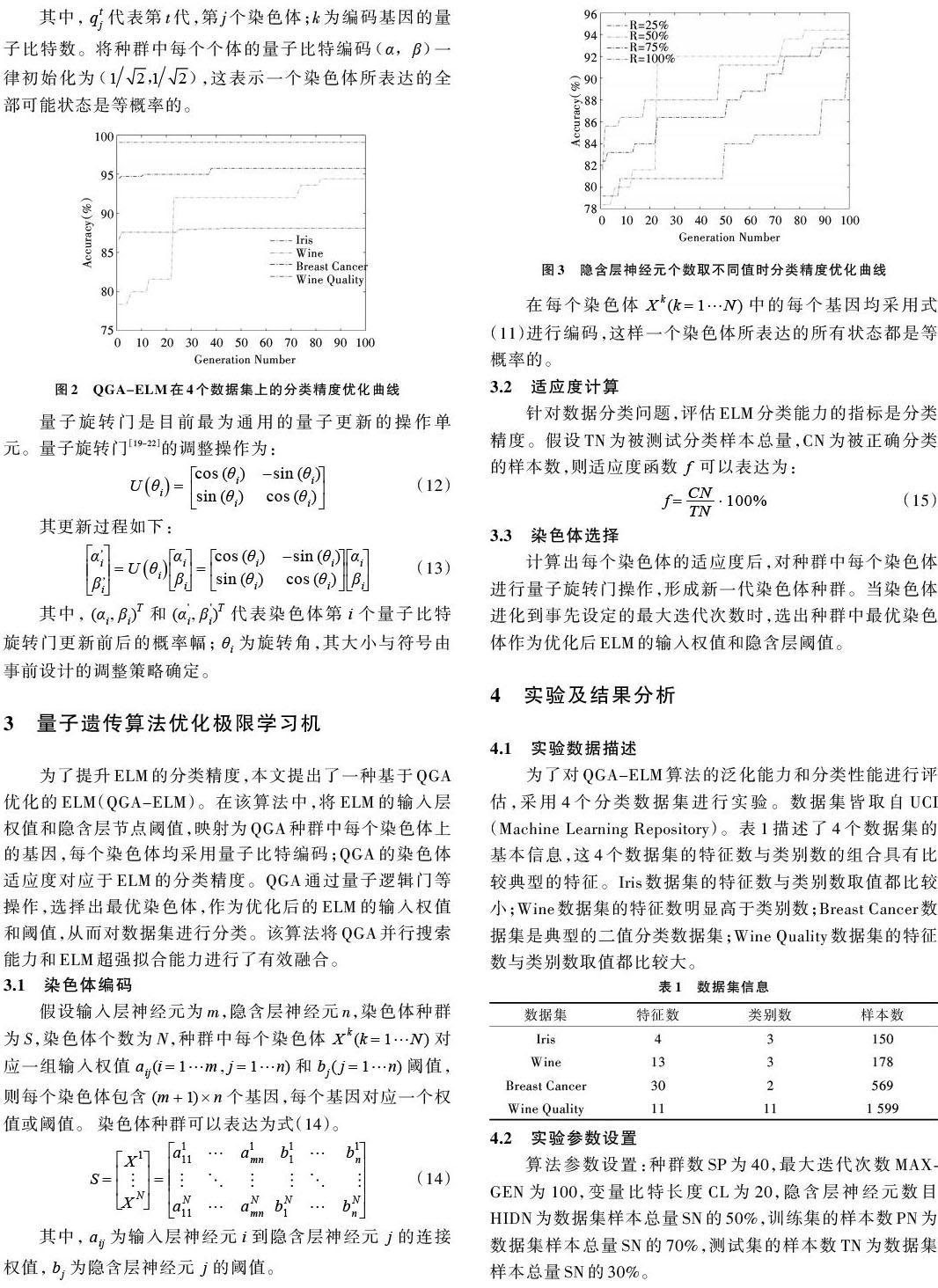

根据数据集各自所具有的不同特征,ELM可被优化的空间也各有不同。QGA-ELM在各数据集上的分类精度优化曲线如图2所示。在数据特征数和类别数较小的数据集(例如Iris)中,ELM自身的分类性能已经很好,可被优化的空间不大,QGA-ELM的分类性能较ELM的提升并不明显。在数据特征数和数据类别数相差较大的数据集中,尤其是特征数明显多于类别数的数据集(例如Wine和Breast Cancer),QGA-ELM的分类精度较ELM有较大提升。在隐含层神经元数保持不变的情况下,通过QGA算法的不断优化,可以找到一组输入权值和阈值初始化一个分类精度较高的ELM。值得一提的是,对于二值分类问题,ELM本身已经具有较好的分类性能,通过QGA的优化,可以使其分类性能得到进一步提升。 针对特征数与分类数取值都较大的数据集(例如Wine Quality),由于类别多,样本类别间的界限比较模糊,容易导致ELM分類精度不高,误差较大。从表2测试精度的对比结果可知,ELM在数据集Wine Quality上的分类精度较差,经过QGA的优化后,结果依然不够理想。

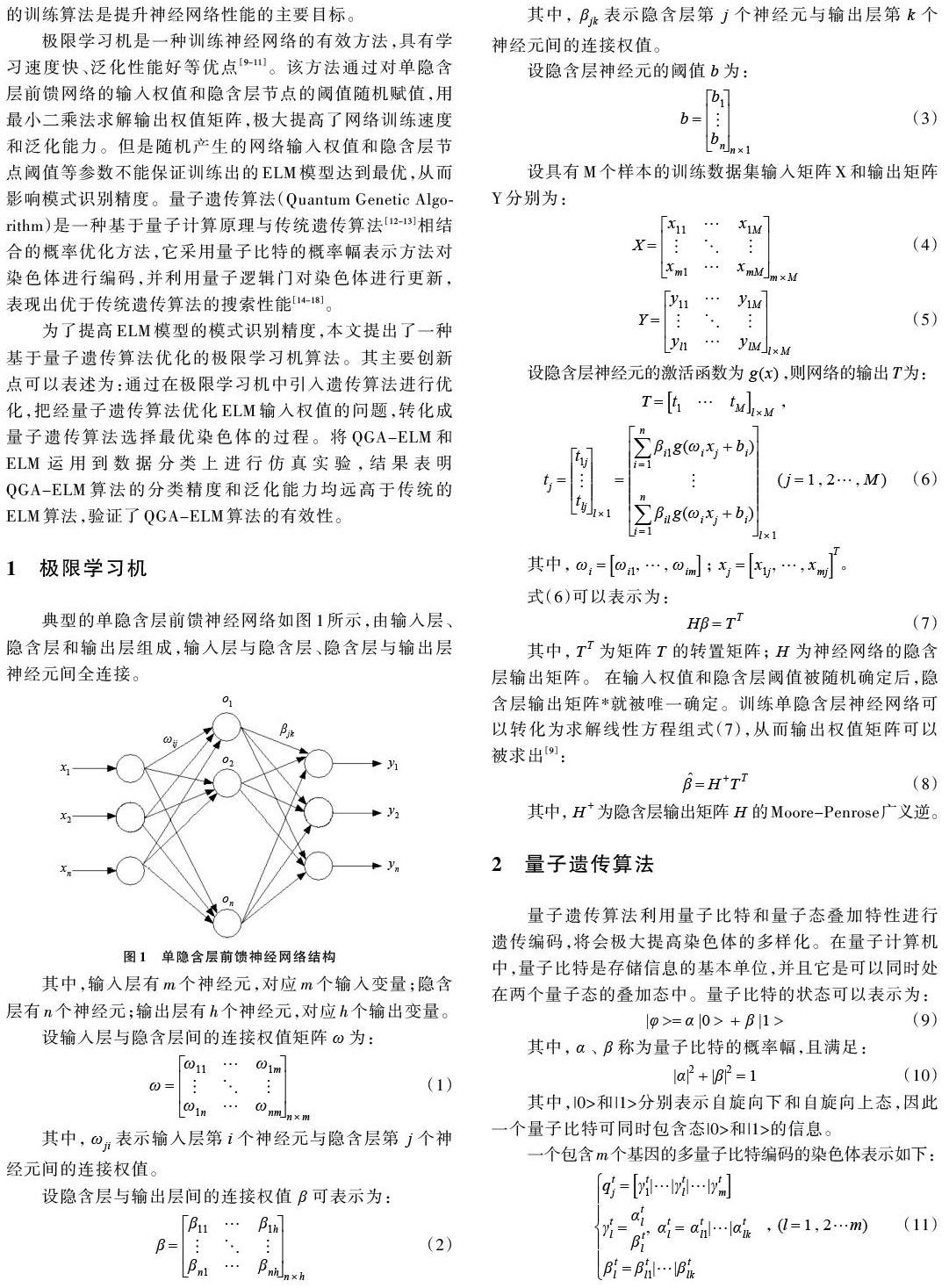

由于ELM的分类性能受隐含层神经元个数影响很大,不同的神经元个数取值会导致ELM分类精度的极大差异。以数据集Wine为例,图3给出隐含层神经元个数取值分别为样本总量的25%、50%、75%和100%时,分类精度随进化次数递增而变化的曲线,R为隐含层神经元个数HIDN与数据集样本总量SN的比值。如图3所示,在算法初始阶段,分类精度会随着神经元个数的增加逐次递增,神经元个数多会伴随高分类精度出现。而在进化代数超过20后,R取值为50%的QGA-GLM的分类精度均高于其它QGA- GLM,并在较高的分类精度上继续优化。由此可见,并不是隐含层神经元个数越多,就必然导致分类精度越高。

5 结语

常规ELM算法在进行数据分类问题时,由于其初始参数随机设定,从而影响ELM的泛化性能和分类精度。针对上述不足,本文提出了一种基于QGA算法优化ELM输入权值和阈值的QGA-ELM算法。在算法寻优过程中,采用改进的量子旋转角策略,提高了搜索效率和参数选择的多样性,使其分类精度得到有效提升。用4个典型的数据集进行测试,结果表明,在隐含层神经元个数选择合适的情况下,QGA-ELM对分类性能的优化非常明显。同时,针对不同数据集所具有的各自特征,QGA-ELM对分类性能优化的程度也不尽相同。针对数据集自身特征与ELM隐含层神经元个数之间复杂的关联关系,仍有待进一步研究。

参考文献:

[1] HUANG W,OH S K,PEDRYCZ W. Hybrid fuzzy wavelet neural networks architecture based on polynomial neural networks and fuzzy set/relation inference-based wavelet neurons[J]. IEEE Transactions on Neural Networks and Learning Systems,2017(1):1-11.

[2] CHUN L Y,SONG H,YANY J. Research on music classification based on MFCC and BP neural network[J]. ICIEAC-14,2014,215(s1-2):57-68.

[3] WANG J, POLYTECHNIC S. Research on computer network security classification based on discrete Hopfield network[J]. Journal of Anhui Vocational College of Electronics & Information Technology,2018.

[4] HAO P Y,CHIANG J H,TU Y K. Hierarchically SVM classification based on support vector clustering method and its application to document categorization[J]. Expert Systems with Applications,2007,33(3):627-635.

[5] ROUSSINOV D G. A scalable self-organizing map algorithm for textual classification: a neural network approach to thesaurus generation[J]. Communication Cognition&Artificial Intelligence Spring,1998(15):81-112.

[6] OZBAY Y,CEYLAN R,KARLIK B. A fuzzy clustering neural network architecture for classification of ECG arrhythmias[J]. Computers in Biology & Medicine,2006,36(4):376-388.

[7] WORKINEH A,DUGDA M,HOMAIFAR A,et al. GMDH and RBFGRNN networks for multi-class data classification[J]. International Journal of Applied Mathematics,2015,25(4):955-960.

[8] HAYKIN S. 神经网络与机器学习[M]. 北京:机械工业出版社,2011.

[9] HUANG G B,ZHU Q Y,SIEW C K. Extreme learning machine: theory and applications[J]. Neurocomputing,2006,70(1/3):489-501.

[10] HUANG G B,DING X J,ZHOU H M. Extreme learning for regression and multiclass classification[J]. IEEE Transactions on Systems Man and Cybernetics-Part B: Cybernetics,2012(2):513-529.

[11] SAVITHA R,SURESH S,SUNDARARAJAN N. Fast learning Circular Complex-valued Extreme Learning Machine (CC-ELM) for real-valued classification problems[M]. Elsevier Science Inc.,2012.

[12] VANLI N D,SAYIN M O,DELIBALTA I,et al. Sequential nonlinear learning for distributed multiagent systems via extreme learning machines[J]. IEEE Transactions on Neural Networks and Learning Systems,2016(2):1-13.

[13] GOLDBERG D E. Genetic algorithms in search,optimization and machine learning[M]. New York:Addison-Wesley,1989.

[14] ZHU X,XIONG J. Fault diagnosis of rotation machinery based on support vector machine optimized by quantum genetic algorithm[J]. IEEE Access,2018:1.

[15] 曲志堅,陈宇航,李盘靖,等. 基于多算子协同进化的自适应并行量子遗传算法[J]. 电子学报,2019,47(2):266-273.

[16] HAN K H,KIM J H. Genetic quantum algorithm and its application to combinatorial optimization problem[C]. Proc Int Congress Evol Comput. IEEE Press,2000:1354-1360.

[17] HAN K H, KIM J H. Quantum-inspired evolutionary algorithm for a class of combinatorial optimization[J]. IEEE Trans Evol Comput,2002,6(6):580-593.

[18] ZHANG Z F. Novel improved quantum genetic algorithm[J]. Comput Eng,2010,36(6):181-183.

[19] WEI Z,YE S. An improved quantum genetic algorithm and performance analysis[C]. Proc. of the 30th Chin Control Conf. ,2011:5368-5371.

[20] 蒋璐,张轩雄. 基于自适应差分遗传算法的BP神经网络优化[J]. 软件导刊,2018,17(11):30-33.

[21] YANG J A,ZHANG Z Q. Research of quantum genetic algorithm and its application in blind source separation[J]. Chin J Electron,2003,20(1):62-68.

[22] WEI Z,YE S. An improved quantum genetic algorithm and performance analysis[C]. Proc. of the 30th Chin Control Conf.,2011:5368-5371.

(责任编辑:孙 娟)