基于无人机的水肥一体化玉米出苗率估算方法与试验

刘 志,贺 正,苗芳芳,贾 彪

(宁夏大学 农学院,宁夏 银川 750021)

出苗率在很大程度上决定农作物的生长状况,同时也是农作物获得高产的一个重要参考因素[1]。因此,确定某一地块作物成苗程度,得知该地块的最佳出苗数量至关重要。我国西部宁夏地区春季多风少雨,土壤墒情相对较差,春播玉米的出苗率受到严重威胁,单位面积内玉米出苗率过低导致玉米减产[2]。种植户或农业技术工作人员通常在玉米苗期(第2叶或第3叶期)进行人工点数玉米植株的数量,以便及时补苗,但是对于大面积的田间种植,玉米植株数目统计工程量大,耗时费力,工作时间长,工作效率低,劳动成本高,且人工统计过程中容易出现误查漏数现象,统计出入大,最后得出的出苗率误差大[3],严重影响出苗率的计算精度[4-5],不利于玉米生产者及时采取有效的补救措施[6]。因此,急需一种省时、省力、高效、精确的出苗率获取方法。

目前,获取田间作物出苗率的方法大致可分为人工点数、机械手点数[7]、光电传感[8]和机器视觉4种[9]。其中,运用机器视觉技术获得某一地块作物幼苗数量来计算出苗率,不但省时省力,而且计算结果精确可靠[4]。因为玉米作物幼苗期的株型结构很适合垂直俯拍。与人工点数和机械手点数相比,基于机器视觉技术的设备(无人机搭载数码相机)进入田间地头,更有利于操作与控制,且测量数据精准。

随着无人机的日益成熟,使得无人机平台的新型近地遥感技术备受农业生产者青睐[10-11]。近年来,国内外学者利用无人机获取遥感信息进行作物生长监测、营养分析等研究,并取得了一定的成效[12-13]。如利用无人机遥感小麦、玉米等作物进行监测,建立了作物生长状况指标与图像特征值之间的关系模型[14-16]。但目前绝大部分学者都是根据不同作物的生长特征建立关系模型,针对玉米作物的无人机玉米出苗识别的研究较少,鉴于此,本文通过采用无人机获取滴灌水肥一体化玉米幼苗期(灌出苗水30 d后,玉米为2叶1心)图片,使用图像处理技术对无人机遥感图像进行识别与分析,提取玉米出苗情况,计算不同氮素处理的出苗率,并建立基于无人机与机器视觉的玉米出苗关系模型,为精准农业作物生产管理及时、准确地获取信息提供数据支撑。

1 材料与方法

1.1 研究区概况与试验设计

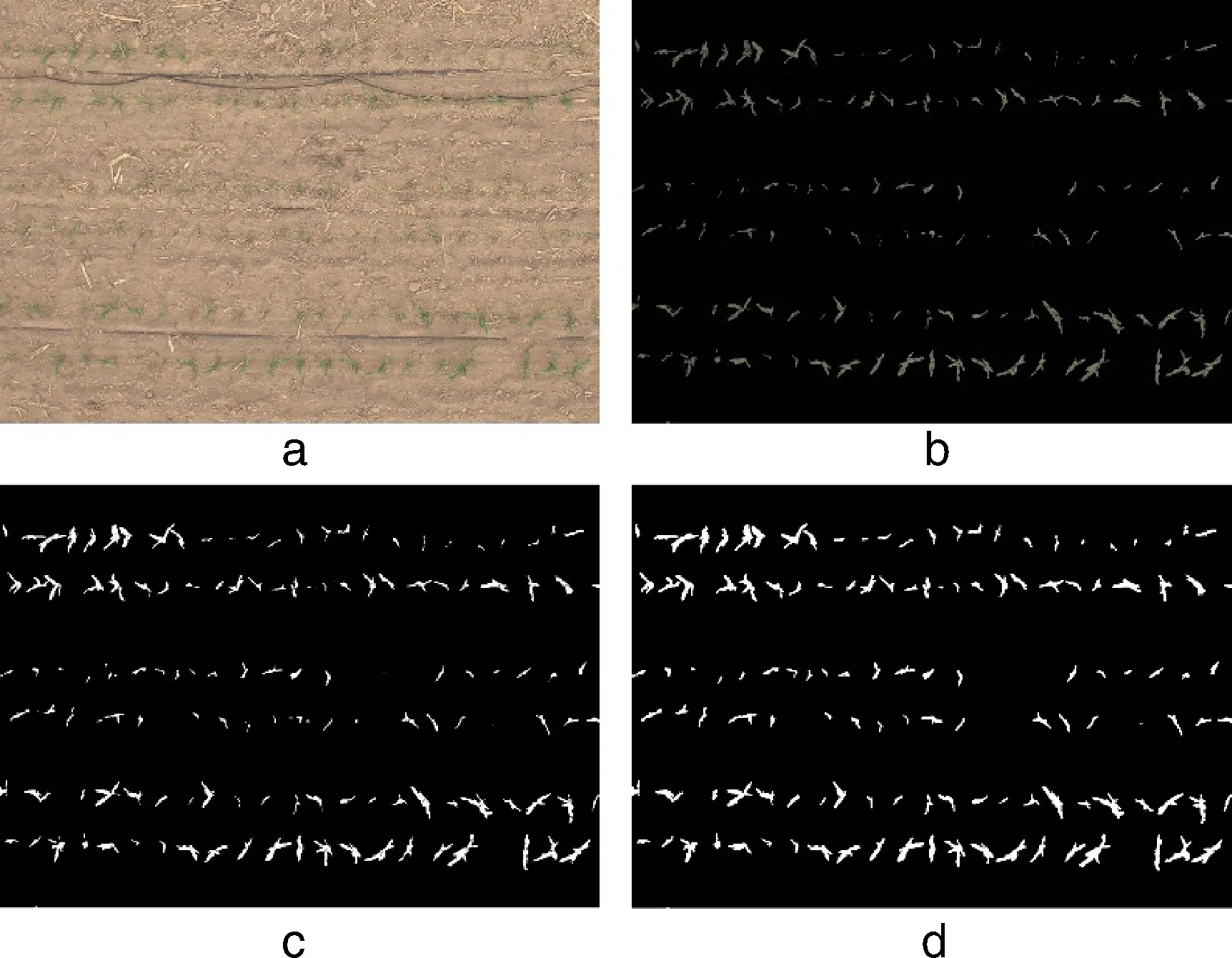

试验于2018年4—10月在宁夏农垦集团示范基地开展,如图1-a所示,试验地中心区域位于东经106°01′,北纬38°24′,平均海拔1 170 m。田间试验设置6个不同氮素处理,分别为N0(0 kg·hm-2)、N1(90 kg·hm-2)、N2(180 kg·hm-2)、N3(270 kg·hm-2)、N4(360 kg·hm-2)、N5(450 kg·hm-2),重复3次,各试验小区采取随机区组设计,小区面积为67.5 m2,每个小区种植8行玉米,采用宽窄行种植,宽行70 cm,窄行40 cm,株距为20 cm;区组间隔设1 m走道,铺设支管道的走道1.5 m,灌溉方式为基于水肥一体化技术的滴灌模式,各试验小区为独立的滴灌与施肥单元。滴灌管道铺设在窄行中间,种植密度为5 400 株·667m-2。试验区四周种植2~4行保护行,试验区总面积0.16 hm2,本试验采用无人机拍摄2个区组作为研究对象(图1-c)。试验区种植青贮玉米,供试品种为天赐19(TC19)。

1.2 图像获取

本试验选取专业级无人机(深圳市大疆创新科技有限公司的Inspire1),轴距559~581 mm,续航时间18~20 min,镜头f/2.8(20 mm等效焦距),质量(含电池)2 935 g,搭载数码相机型号为X3,传感器为SONY EXMOR 1/2.3″,有效像素为1 240万。

玉米幼苗生长期间,绿叶面积较小无法识别,绿叶面积过大则叶片会相互重叠进而影响无人机识别精度,所以本试验选取灌出苗水30 d后的2叶1心期。飞行应选择晴朗、无云的天气以提高无人机识别精度,尽可能避免在天气状况不良的条件下进行图像采集。在天气状况不良获取的图像如何处理是下一步研究的重点。

图像采集时间为2018年5月25日,播种后30 d上午11:00左右,获取无人机平台数码高清图像,拍摄当天晴空万里,风力2级,根据照明条件规划航线设置,通过对无人机拍摄高度、图像重叠度及拍摄悬停进行设置,拍摄照片数量航点数都会在DJI GS软件中自动计算生成。在每次飞行前手动调整光圈至f/4.0,相机曝光1/100 s,白平衡,IOS 100,焦距4 mm,飞行高度距地面5 m,拍摄时无人机镜头垂直地面,选择相机触发顺序采集每张相邻图像间距以使两个传感器轴的图像重叠大于85%。卫星地图与实际区域之间会存在偏差,规划航线时选择飞行器选点,航拍区域完全覆盖目标区域[17]。通过平板电脑载入已规划完成的航线任务,飞行航线为“S”型(图2)。由于一次任务拍摄航点有限,所以在区组中间设置了一个控制点。照片尺寸4 000×3 000像素,存储格式为JPG。

图2 无人机作业航线图Fig.2 Operation route map of unmanned aerial vehicle

1.3 图像处理

采用ORB(oriented fast and rotated brief)算法进行无人机采集图像的合成。ORB算法是将FAST(features from accelerated segment test)机器学习的角点检测方法与BRIEF(binary robust independent elementary features)特征描述子结合,通过改良并进行优化,保留图像特征,拟合形成ORB算法[18-19]。如图3所示,拍摄照片的位置不同、角度发生改变,导致重叠区发生微量明暗亮度数值的变化,拼接图像在接缝处出现明显“边缘效应”,为了解决上述问题,本文结合基于距离的加权平均的融合算法[19],通过计算重叠区域中的点到重叠区域左边界和右边界的距离比值来得到相应的权值,重叠区域的像素点值f(x,y)如公式(1)所示[18]:

(1)

通过重叠区域部分像素数值相应权重相加,减少色彩和亮度差,可缓解图像的不自然,使图像呈现平滑质感。本研究还利用Python和Open CV(open source computer vision library)面向对象的程序设计语言对图片颜色域进行识别,用于玉米幼苗与土壤背景的快速性分离运算。

1.4 数据处理与统计分析

采用Excel 2010进行数据整理,选用Origin 2018进行数据分析与作图,采用均方根误差(RMSE)、标准均方根误差(NRMSE)和决定系数

图3 图像边缘效应Fig.3 Edge effect of image

(R2)等指标作为模型估测和验证[16]。估测与验证模型的取决定系数越接近于1,相应的回归化的均方根误差与均方根误差越小,则模型评测越好,公式如下[16]:

(2)

(3)

(4)

2 结果与分析

2.1 基于ORB算法与距离加权融合算法的无人机图像合成

无人机采集的玉米有苗期原始图像(图4-b),通过ORB算法拼接后出现明显的广角效应,为了更好地寻找特征点进行匹配,滤除失误匹配点,本研究结合距离加权平局的拟合算法,计算重叠区域中的点到重叠区域左边界和右边界的距离比值来得到相应的权值(图4-c),并通过修正、提纯、合理优化、对齐拼接、算法合并拼接处理(如图4-d),既避免田间图像信息丢失,又有效更正了广角效应。为有效展现无人机拍摄玉米田间地块区组的精准区域,本研究每个区组拍摄113幅图像,并进行ORB算法与距离加权融合算法合成,便于后期精准统计玉米株数和计算出苗率。

如图5-a所示,利用Python和OPENCV面向对象的程序设计语言对玉米无人机图片颜色域进行识别,确定玉米植株幼苗叶片颜色色域HSV的阈值,使用颜色空间转换函数cvCvtColor函数实现RGB向HSV转换,从而获取无人机玉米幼苗期图像每个像素点的H、S、V颜色分量值,然后通过阈值判断,其纯度H量阈值为45°~85°时,可明显分离玉米幼苗冠层图像与土壤背景层图像(图5-b)。然后进行二值化图像处理如图5-c所示。获取二值化图像后,由于田间玉米出苗状况层次不齐,部分玉米幼苗进入三叶期,叶片图像过小或由于提取图像时部分玉米植株不明显,采用腐蚀膨胀法对图像进行膨胀处理,加强部分玉米小苗在图像中显示,去除孔洞使其更清晰,并采用异常值剔除法对杂草进行剔除,由于部分杂草也处于苗期,面积虽然过小,但也会被识别出来,所以本研究依据图像空间的分辨率,选用OPENCV删除二值图像中面积较小的连通域,访问二值图像每个点的值搜索二值图中的轮廓,从轮廓树中删除面积小于40个像素阈值MINAREA的轮廓,并开始遍历轮廓树,当连通域的中心点为白色时,而且面积较小则用黑色进行自动填充,得出深度优化后的玉米苗期图像(图5-d)。

a,无人机图像采集;b,原始图像;c,ORB算法;d,广角效应修正和裁剪。a, Image capture by unmanned aerial vehicle; b, Original image; c, ORB algorithm; d, Wide-angle effect correction and tailoring.图4 ORB算法与距离加权融合算法合成图Fig.4 ORB algorithm and stitching wide-angle optimization preprocessing

图5 玉米植株提取与深度优化图Fig.5 Extracted and advanced processing images of maize plants

2.2 玉米植株标记与计数

通过对玉米植株提取与深度优化(图5),可以较好地对玉米幼苗进行识别与提取。然后运用MATLAB八位连通域计算方法进行自动计算出苗数量,得出玉米出苗率状况,在本研究中,由于玉米种植按宽窄行进行,2行玉米种植在滴灌带的两侧,也就是播种模式的窄行处,为了自动精准区分出各试验小区玉米幼苗,计算机通过图像计数时,以每根滴灌带为单位进行玉米幼苗并识别与计数。计数路线是按空间信息转换而来的点创建并记录数据,计数路线由滴灌带两侧所包含的点累加,根据玉米幼苗行数y轴和x轴分割的目标转换点以及玉米种植时的株距进行分类和标记。使用ARCMAP 10.3沿着y轴连接具有相同标记的点与行间距来生成玉米幼苗识别记录路线。图6-a膨胀去杂处理,图6-b定义每株玉米幼苗,图6-c分类标记,图6-d连接点并平滑计数路线,结合二值图像精确计算各试验小区每条滴灌带上的玉米幼苗。

图6 玉米幼苗标记与计数局部图Fig.6 Partial image of marking and counting maize seedlings

2.3 基于无人机标记的玉米出苗率误差评估

为了验证无人机标记与计数方法的准确性,本研究共拍摄3个重复的2个区组,每个区组包含N0到N5,6个试验小区,每个小区包含4个滴灌带,共12个小区,48条滴灌带,均通过人工调查计数与无人机标记获取的数字图像分析处理来计数。玉米实际数量为2区组中实施不同氮素处理的人工调查计数的玉米植株数量,无人机标记为无人机搭载数码相机获取数字图像计数,进行建模和试验误差分析,误差计算公式如(5)所示[4]:

(5)

式中:ω为误差,R为人工调查的玉米植株数量,A为无人机搭载数码相机获取数字图像计数所得的玉米幼苗数量。

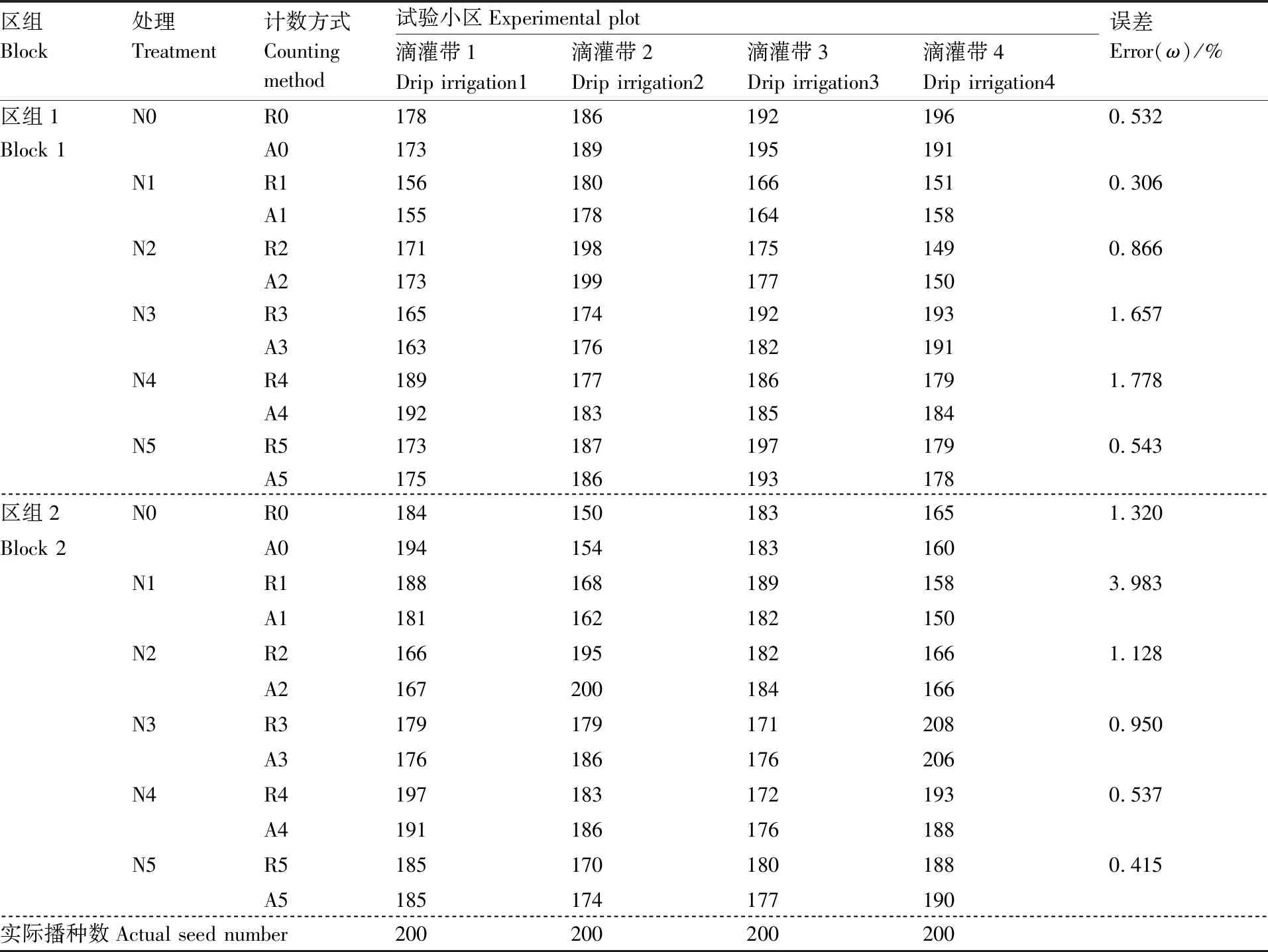

由表1计算结果可知,人工计数与无人机标记在图像识别的误差ω存在一定的误差,平均误差为1.168%。且无人机标记结果与人工计数之间满足线性回归分析模型。由表2结果可知,区组1与区组2试验结果均显示为无人机标记结果与人工计数获取的每个区组实施不同氮素处理小区的总玉米植株数量呈线性相关关系,且不同氮肥处理间参变量k、b均具有明显的规律性变化,其中k值随着施N量的增加而减小,b值随着施N量的增加而增加,即kN0>kN1>kN2>kN3>kN4>kN5,bN5>bN4>bN3>bN2>bN1>bN0;其决定系数R2>0.720。

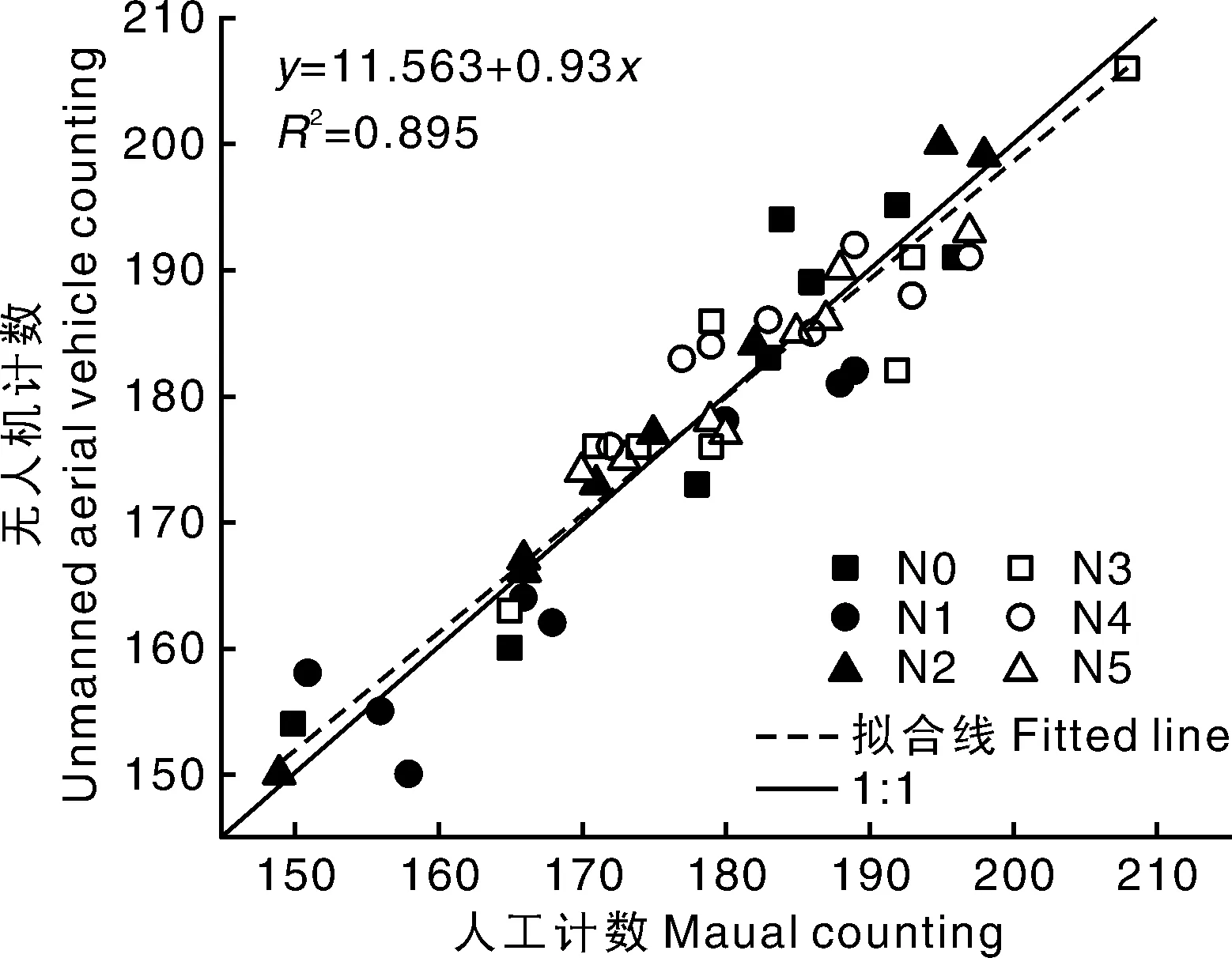

通过构建人工计数与无人机标记图像计数之间的线性关系模型(图7)可知,其决定系数等相关模型检验参数R2、RMSE和NRMSE分别为0.895、4.359和2.436%。线性模拟模型精确度相对较高,能准确地通过无人机平台获取玉米幼苗期植株数,并计算其出苗率。

表1 无人机标记误差分析结果

Table1Results of unmanned aerial vehicle marking error analysis

区组Block处理Treatment计数方式Countingmethod试验小区Experimental plot滴灌带1Drip irrigation1滴灌带2Drip irrigation2滴灌带3Drip irrigation3滴灌带4Drip irrigation4误差Error(ω)/%区组1N0R01781861921960.532Block 1A0173189195191N1R11561801661510.306A1155178164158N2R21711981751490.866A2173199177150N3R31651741921931.657A3163176182191N4R41891771861791.778A4192183185184N5R51731871971790.543A5175186193178区组2N0R01841501831651.320Block 2A0194154183160N1R11881681891583.983A1181162182150N2R21661951821661.128A2167200184166N3R31791791712080.950A3176186176206N4R41971831721930.537A4191186176188N5R51851701801880.415A5185174177190实际播种数Actual seed number200200200200

表2 无人机标记玉米出苗率函数关系

Table2Unmanned aerial vehicle marking maize emergence rate function

区组Block氮素水平Nitrogen level参数值Parameter valueskbRMSENRMSER2区组1 Block 1N01.087-17.3484.1232.1930.776N10.9991.5723.8082.3330.908N20.79633.8351.5810.9130.999N30.77839.5875.2922.9230.873N40.76139.8894.2132.3050.720N50.61074.5562.3451.2750.990区组2 Block 2N01.147-15.1465.9373.4820.895N11.1021.5087.0364.0030.997N21.01426.1572.7391.5450.999N30.85932.9904.6642.5310.914N40.83034.1044.6372.4900.926N50.56081.0112.6931.4900.857

图7 无人机与人工计数之间的关系Fig.7 Relationship between unmanned aerial vehicle counting and manual counting

3 讨论

玉米出苗率达不到播种的密度会造成玉米后期产量不足,玉米苗期植株矮小且脆弱,不利于大型机器进入点数[5-6]。近年来采用无人机搭载数码相机低空飞行标记的能力,弥补了现有人工点数和机械点数等方法的不足[4]。本研究通过无人机航拍影像获取玉米植株幼苗期植株图像,运用基于ORB算法与距离加权融合算法的无人机图像合成(图4),并运用Python和OPENCV面向对象的程序设计语言对玉米无人机图片颜色域进行识别,确定玉米植株幼苗H阈值范围,分离玉米图像与土壤背景层图像,采用灰度运算、二值化处理、膨胀处理和深度优化处理,得到玉米苗期图像(图5),然后运用MATLAB八位连通域计算方法进行自动计算出苗数量,对玉米幼苗植株标记与计数(图6),最终得出玉米出苗率。解决了无人机航拍过程中受到复杂环境如天气、噪声、叶片之间的遮挡等影响计数的问题[15],此方法是基于机器视觉传感的计数器,它们对玉米进行连续拍照,然后对图片进行分析处理,后得出玉米植株数量[12-14]。此方法很适合点数幼苗期的玉米植株数量,也适合无人机垂直拍摄,计数结果较精确[15]。

本研究结果表明,无人机搭载的数码相机进行分析点数结果满足线性函数关系模型(图7),通过表2的R2、RMSE和NRMSE可以看出,此模型可以作为无人机点数解决宁夏玉米出苗率运算,虽然有一定误差,但误差并不会因施氮肥量的增加而试验结果偏大,出苗率也并未因施氮素越多,玉米幼苗长得越大反而计数增多,是因为高施氮肥玉米幼苗相对较大,无人机图像识别越清晰,计数更为精确,误差也就越小。因此,由图7的计数结果可知,N0、N1、N2要比N3、N4、N5误差相对大。另外,由于无人机搭载高清相机像素毕竟存在一定的局域性,所以在玉米幼苗时期从田间获取遥感图像过程中,拍摄一组互相有重叠的局部图像,并进行图像拼接,通过算法生成包含着这组局部图像的一幅完整的宽视场图像[9]。本文采取无人机搭载数码相机,相比多光谱和高光谱传感器,虽然无法获取所有光谱信息,但是采用超高分辨率的成像特点对玉米出苗期植株精准识别与提取起到了至关重要的作用。

当无人机搭载数码相机分析点数结果小于人工点数数量时,误差产生的因素主要有2个,其一播种机播种时出现误差,小部分玉米种子并未播种到试验田土壤中去,导致使用手提式便携播种机进行一次补播,在玉米生长二叶期至三叶期进行无人机出苗点数时,补苗玉米叶片过小,导致其在图像处理识别过程中被误认为是噪声,忽略掉补播后的玉米幼苗,或者把玉米幼苗误算为杂草排除掉,使得补苗图像信息损失,产生误差;其二,首播的玉米种子,在三叶期间成长迅速,叶面积过大,和相邻玉米植株叶子有所重叠,在计算机二值图像处理算法中,重叠部分呈现白色,导致部分植株边缘提取失败,计算机误认为2株玉米或多株重叠玉米幼苗为一株,从而产生误差。当无人机分析点数结果大于人工实际点数数量结果时,产生误差的原因,第一是试验田中个别部分杂草由于生长过快,茎秆粗壮,叶面积过大,如黄花蒿、苍耳等杂草植物,在二值图像处理算法中会被认为是三叶期的玉米幼苗[4];第二是个别玉米幼苗在拍摄角度上,因光照较强,反射较强,数码相机在拍摄时不能拍摄出完整的玉米幼苗,产生茎叶相连部分导致边界提取被误判,从而产生误差。因此,基于无人机遥感技术获取农田作物信息是近年来研究的重点,还需要进一步开发无人机遥感信息获取系统获取农田作物长势信息,指导精准作业,实现对农作物精准管理,推动精准农业全面发展。

4 结论

(1)采用低空无人机捕获的超高分辨率RGB图像估算玉米出苗率。运用MATLAB二值图像与ARCMAP进行画行线点相结合,对玉米幼苗识别和分割方法可靠。

(2)建立回归分析模型是一种快速有效的玉米苗期计数方法,其相关系数R2、RMSE和NRMSE分别为0.895、4.359和2.436%。虽然存在一定的试验误差,误差不会随着无人机采集图像中玉米幼苗数量的增加而增大,但本研究有助于实际生产过程中对玉米植株的统计和出苗率的计算。

(3)本研究仅对单一玉米品种(TC19)进行人工与无人机出苗率建模,此方法为通用方法,公式参数是否适用于其他品种是下一步研究的重点。