社交媒体操纵的混合宣传模式研究*

■ 方师师

一、理解社交媒体操纵:现代宣传视角下的路径交汇

随着互联网关键性基础设施规模与平台应用服务模块的指数级增长,从平台媒体到社会参与,互联网正在改变世界范围内的政治话语。近年来,在各国的政治选举中,利用互联网和社交媒体组织竞选、宣传候选人信息、攻讦对手的情况屡见不鲜。①2016年俄罗斯通过社交媒体干预美国总统大选②,政治僵尸网络在英国公投期间支持其退出欧盟③,乌克兰危机中社交媒体的假新闻运动④,法国自动放大的马克隆维基解密事件⑤,德国联邦总统选举期间出现的社交机器人活跃和垃圾新闻频出⑥,这一系列事件使得这样一种传播现象备受关注。

2017年,包括美国在内,至少有18个国家在选举中遭遇了线上操纵和虚假信息策略。⑦有研究和证据表明,在这些事件期间,计算机协同人工控制的机器人账户传播了大量“虚假不实、具有误导性或严重政治偏向的信息”⑧,并对事件的走向和结果产生了巨大的影响。由牛津大学互联网研究所发起的“计算宣传研究项目”(Computational propaganda)报告称,截至2018年,已经有48个国家发现并报告存在社交媒体宣传操纵的情况,而2017年是28个。“计算宣传已经成为对抗民主制度最新也最为有力的工具之一”⑨。2017年11月由美国自由之家(Freedom House)发布的《2017网络自由度报告:社交媒体操纵危害民主》显示,“虚假信息”造成全球互联网自由度连续第七年下滑。⑩目前这一情势还在不断蔓延,未来将成为全球现象。

社交媒体操纵(Social Media Manipulation)也称“社交媒体宣传操纵”,主要是指“在社交媒体上使用自动化程序或者机器人进行蓄意宣传和虚假消息传播的情况”。作为一种典型的宣传模式,目前社交媒体操纵中的“宣传理念”和“宣传实践”还未得到系统地关注和分析。本文试图将这一新型宣传现象纳入到现代宣传研究的历史沿革与分析框架中,在理念梳理和实践比较的过程中深化对其的理解。文章认为,社交媒体操纵是一种“混合宣传”(Hybrid propaganda)模式,通过对社交媒体的使用显著提高了宣传主体的宣传能力与宣传效果。

习近平总书记在党的十九大报告中提出,要“加强互联网内容建设,建立网络综合治理体系,营造清朗的网络空间”“落实意识形态工作责任制,加强阵地建设和管理”。中央网信办新近出台的《互联网新闻信息服务新技术新应用安全评估管理规定》,也是根据“新技术新应用的新闻舆论属性、社会动员能力及由此产生的信息内容安全风险来确定评估等级”。由于社交媒体操纵具有强大的传播影响力、舆论组织力和社会动员力,能够把控人群对事物的认知、意见和观点,引导、煽动和组织社会情绪,就一些重要且复杂的议题通过分享和体验制造出所谓的社会共识,因此对这一现象的认知和了解,对于在线内容与信息治理也具有一定的参考价值。

二、聚焦灰色地带:“混合战争”理念中的社交媒体操纵

2017年12月12日,时任美国国务卿的雷克斯·蒂勒森(Rex Tillerson)公开表示,俄罗斯涉嫌干涉美国去年总统大选的行径是一种“混合战争”(Hybrid warfare)。根据美国司法部特别检察官罗伯特·穆勒(Robert Mueller)对于“通俄门”的调查,早在2014年,俄罗斯的“互联网研究机构”就开始系统地从事干预美国政治的行动。他们的战略目标是要在美国散播和煽动不和谐的声音,进而影响美国政治进程。其战略行动包括在2016年的总统选举中,伪造虚假的美国身份、经营社交媒体网页和团体、吸引用户、散播候选人的负面信息等。

将信息传播同“战争”相联系的说法,既不是第一次出现,也不是偶然为之。在历史上,宣传的诞生发展总与战争相伴相随,现代宣传的理念就起源于第一次世界大战。“一战之前,虽然有许多宣传现象,但是只能将其称之为宣传的前身或者叫雏形。”当前通过社交媒体进行的宣传和操纵,与现代战争中包括“新一代战争”(4th Generation warfare,6th Generation warfare)、“非对称战争”(Asymmetric Warfare)和“混合战争”的模式相适应和配合。其中“混合战争”的提法得到了最为广泛的赞同,北约通过这一术语来描述俄罗斯攻击乌克兰期间所展现出的新的作战属性:俄罗斯已经采取了这种“混合战争”手段,它是人们非常熟悉的常规战和新的更复杂的宣传和虚假信息活动的混合体,包括了俄罗斯通过与北约内部政治派别的金融联系和与非政府组织的接触来影响公众意见。

“混合战争”的理念区别于传统战争的核心在于,它是针对“经典外交与公开军事冲突间的‘灰色地带’所实施的战略行动”,信息战、电子战和网络战是其重要组成部分。俄罗斯的“混合战争”在对乌克兰的行动中得到了充分体现,如今已成为其新军事学说的一部分。这种新军事学说强调信息行动、虚假信息活动、利用目标人群的“抗议潜力”,以及使用特种部队和代理来避免触及常规军事行动的门槛。可以说,“混合战争”是在不引发实际战争的前提下,在和平时期对对手实施作战的重要组成部分。

在心理战的研究中,按照宣传的有效性将其分为黑色宣传、灰色宣传和白色宣传三个基本方面。其中“白色宣传”强调“简洁、直白和不断重复”,“黑色宣传”相反,它强调“烦扰、混淆和恐怖”。而“灰色宣传”则是介于白色宣传和黑色宣传之间,主要是指那些看起来内容模糊不清、信息来源不明的“错误信息”等。从一定程度上说,混合战争是针对信息传播的“灰色地带”,采用灰色与黑色宣传相结合的方式,但涉及的范围和内容更加隐蔽复杂。这种“混合”不仅是信息内容和来源的模糊,同时还包括对于作战国家政治、经济、军事、文化的全盘操纵。

三、动机、工具与组织网络:社交媒体操纵的混合实践

“在很大程度上,宣传观念决定着宣传的实践,而不是相反。”作为混合战争的一部分,社交媒体操纵成为目前破坏政治制度最新也是最具杀伤力的工具之一。在美国,研究人员们发现社交媒体上的机器人账户在2016年的总统大选中对于信息的传播具有可量化的显著影响力:“社交媒体机器人的开发者通过人为扩大政治候选人或者相关问题的流量,以制造共识性意见”“机器人大军凭借着对候选人相关内容的追踪与转发,帮助其在公众当中获得公信力及更为广泛的支持……对候选人拥有在线支持度的错觉还可能引发后续效应,包括引导民众对其表示实际支持。”美国研究人员通过对125万条美国大选期间的网络新闻报道的传播路径研究发现,高度扩散的右翼新闻宣传网络非常依赖社交媒体,约有60%的虚假新闻流量都来自脸书和推特的超链接。另一项对推特上1400万条美国总统竞选和选举信息的研究发现,机器人账户在虚假信息的传播过程中扮演着关键的角色。通过大数据驱动、算法模型并结合人工智能训练,这些虚假信息可以精准锁定个体目标,分发的效度与精准度更高。这样的“微宣传机器网络”制造出的传播效果,给人一种在网络上极其流行的假象,规模巨大、集中传播的“机械舆论”极有可能取代“有机共识”,将散布性的支持(Diffuse support)变成为特定的支持(Specific support),进而改变政治结构,以数量上的压倒性来建立特定的政治支持。

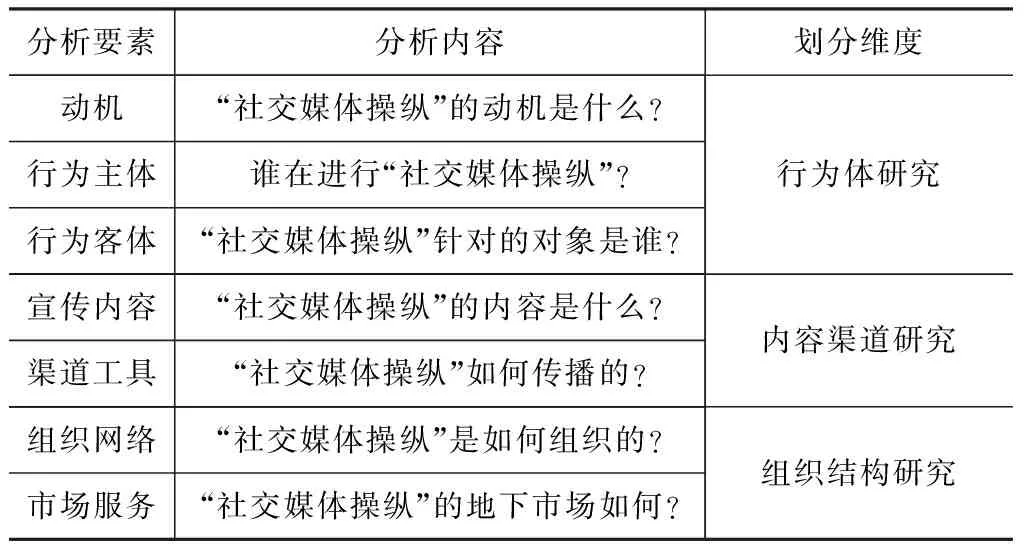

我们将社交媒体操纵划分为三个维度7种要素进行分析,分析要素、分析内容与划分维度如下,见表1所示。

表1 分析要素、分析内容与划分维度

(一)行为体研究

1.操纵动机聚焦政治

目前,社交媒体操纵的政治目的最为普遍。不稳定的政治环境为社交媒体操纵提供了巨大、丰富、多变的背景条件。例如在过去三年,乌克兰经历了对腐败和独裁政权的大规模抗议,部分领土被邻国吞并,东部省份武装冲突爆发,严重的经济危机,政治面临转型与改革等。而随着信息技术的快速发展,乌克兰已经成为欧洲多次信息战的前线,是首批面临严重信息危机的国家之一。在未来,经济利润将成为社交媒体宣传操纵更加优先的动机。各类推广虚假新闻传播的网站最重要的驱动力就是广告收入和点击流量,为此可以罔顾内容的真实性。

2.行为主体复合多元

在此次“通俄门”的调查中,13名俄罗斯国民与3家跟克里姆林宫有联系的网络公司被指控参与了这些活动——包括购买社交媒体上的广告,与特朗普竞选团队中“不知情的人”联系,一起协调政治活动,支持特朗普并污蔑民主党候选人希拉里·克林顿等。目前主要进行社交媒体操纵的行为主体包括政府部门的内部团队、政党政客的竞选团队、私人承包商、网络志愿者及付费水军,而不同主体所处的社会结构与角色分担也各不相同。

(1)政府部门的内部团队:在一些情况下,政府拥有自己的内部团队,成员被聘任为公职人员,可以在各部门内工作。2015年1月,英国宣布其77旅(British Army's 77th Brigade)会专注于在脸书和推特上对敌人进行“非致死性心理作战”(Non-lethal psychological operations),方式主要是通过“动态叙事”(Dynamic narratives)来打击恐怖组织的政治宣传。美国网络战群体DARPA(包括美国网络司令部、美国国际开发署、空军以及五角大楼),经由政府有组织的论坛作业来操纵社交媒体,试图改变公众舆论。在阿根廷和厄瓜多尔,网络部队的活动与总统办公室总有相关。

(2)政党政客的竞选团队:社交媒体操纵已经成为政党政客或者竞选候选人公共宣传的重要策略之一。在选举期间,他们会使用社交媒体影响公众观点,有意散布虚假信息,攻击反对党的言论。这和传统的“数字化宣传”策略不同,后者主要关注政党或者候选人自身的信息传播,向选民做广告,而社交媒体操纵会使用包括注册虚假账户在内的方式来增加关注量、点赞量、分享量和大量转推候选人言论,营造出一种“虚假的热度”。这一技巧早在2013年澳大利亚联合党宣传运动中就使用过。在菲律宾总统选举中,受雇的“键盘侠”会在网络上大量发布力挺杜特尔特的言论,这一过程在整个总统选举进程中都会持续发酵。

(3)私人与商业承包商:有时候政府会把一些网络宣传活动外包给私人承包商,这些工作通常是短期性的并且任务明确。比如美国政府会雇佣专业的数据公关公司来帮助他们处理出现在网络上的虚假消息。但很多时候私人承包商和国家公务员之间的界线并不清晰。在俄罗斯,网络调查机构会参与克里姆林宫的社交活动,“通俄门”的调查显示,位于俄罗斯圣彼得堡的“互联网研究机构”(Internet Research Agency)及其12名雇员,从2014年开始就对美国“展开了干预选举和政治进程的行动”。这家公司很早之前就被认为在俄罗斯干预美国大选的过程中扮演了关键角色,通过使用虚假社交媒体账户、花钱雇佣网络评论员等方式,推动舆论倒向特朗普。在“通俄门”的起诉书中,同时被起诉的还有商人叶甫根尼·普里高津(Yevgeniy Prigozhin)及他控制的两家公司“和睦管理”(Concord Management)与“和睦送餐”(Concord Catering)。起诉书中认为,普里高津和他的公司为“互联网研究机构”提供了“大量资金”,帮助其实施影响美国选举的计划。

(4)网络志愿者:一些社交媒体宣传大军由网络志愿者组成,他们既不是公务员,也不属于私人承包商。在许多情况下,志愿者队伍由青年人组成,他们积极地在网上传播政治观点,除了支持和分享,还会同政府合作,传播亲政府的信息和官方意识形态。比如阿塞拜疆的Ireli组织和俄罗斯的纳什组织等。在以色列,政府积极地和各类学生团体合作,包括犹太组织和其他亲以色列的群体组织等。

(5)付费水军:还有一部分网络部队是由政府雇佣来的,他们会根据工作量收取报酬。一般情况下被雇佣的水军在社会上都有一定声望,但印度的水军会雇佣一些市民帮助他们散布言论,因为他们的身份与政府关系不大,通常会被认为言论更加客观中立。

3.攻击对象内外兼有

现代宣传诞生于具有现代民主制度的资本主义国家,宣传为了配合战争动员,需要在不被大众觉察的前提下,巧妙地操纵受众的心理,让其心甘情愿地支持某种政策。目前,许多国家都会调用大量资源和人力来管理在线舆论,有时针对国内受众,有时针对外国公众。几乎每个威权国家都会通过社交媒体有组织地针对本国受众进行宣传,但最早参与舆论推动的却是民主国家,关于政治传播技术的创新也大多来自民主国家政党。几乎所有的民主国家都曾组织过针对外国公众的社交媒体宣传战,而针对本国选民的宣传基本上是由政党支持的。

俄罗斯线上影响美国大选的怀疑目前已经有据可查。2017年11月,美国参院司法委员会针对俄罗斯网络水军通过社交媒体试图影响2016年美国大选召开听证会,脸书、推特及谷歌三家公司被迫面对“在俄罗斯信息战中被当作工具”等问题。随着调查深入,一系列事实也陆续浮出水面:大选期间,俄罗斯的网络宣传机构通过脸书在互联网上传播的虚假新闻波及1亿2600万美国公民,在推特上发布了超过13.1万封电子邮件,并通过谷歌的YouTube网站上传了1000多个视频。

但政党对于本国公众也会使用同样的手段来维护自身权力。此次大选中,有证据显示,两党都使用了计算机控制的机器人账户来操控公共舆论,制造线上共识。共和党包括自称“右翼”和“主流”的成员在整个选举过程中都特别使用了数字政治工具。2018年3月,随着脸书“数据泄露门”事件的曝光,一家名为剑桥分析(Cambridge Analytica)的政治资讯与大数据分析公司也引发了全球关注。这家大数据公司在2016年美国大选期间,利用资深心理学教授亚历山大·科根(Alexander Kogan)开发的应用,搜集了8700万涉及不同国家脸书用户的资料数据用来进行选举预测和影响选民投票的活动。剑桥分析公司在2013年底曾获得美国亿万富翁、支持特朗普总统的金主罗伯特·墨瑟(Robert Mercer)1500万美元的投资,特朗普的前首席策略师斯蒂芬·班农(Steve Bannon)也是这家公司早期的董事会成员。据《纽约时报》报道,在2016年的大选中,剑桥分析公司为特朗普竞选团队提供了的服务包括:针对目标受众设计数字广告、筹措竞选资金、建模选民投票率、购买500万美元的电视广告及决定特朗普应去该哪里获取支持等。

(二)内容渠道研究

1.假新闻的类型学分析

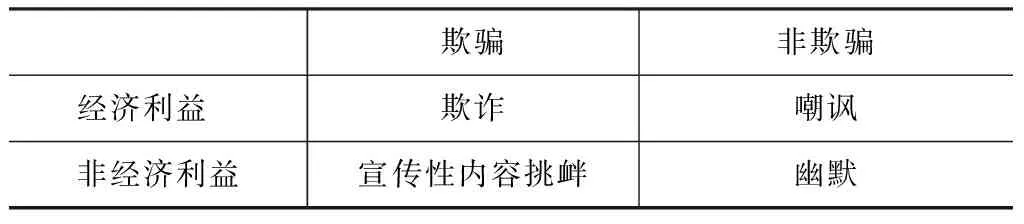

整体而言,社交媒体操纵传播的内容主要是虚假信息。根据美国亚利桑那大学詹姆斯·罗杰斯法学院发布的《识别和打击虚假新闻》研究报告,通过“是否意图欺骗读者”和“是否具有经济动机”两个标准确认了四种典型的虚假新闻的形态,分别是欺诈、宣传性内容、挑衅和嘲讽。其中“嘲讽”带有经济动机但并非为了欺骗;“宣传性内容”和“挑衅”具有一定的政治动机并意图欺骗,但没什么经济动机;而“欺诈”既有经济动机同时又为了欺骗读者。如表2所示。

欧洲委员会(Council EU)发布的《信息失序:走向跨学科的研究与政策制定框架》报告认为,“在互联网上传播的虚假不实、具有误导性或严重政治偏向的信息”是构成信息失序、带来信息污染的主要成分,而这些内容从正面支持、开喷骚扰、人身攻击、情感评论到所谓的“事实”核查等都有。目前,比较公认的属于“信息污染”的传播形态主要有三种类型:第一种是错误信息(Misinformation),是指通过社交媒体来分享“不真”的内容,但没有造成特定的伤害;第二种是虚假信息(Disinformation),是指自发分享的内容具有特定的目的性,并造成了一定的伤害,目的性一般有政治目的、经济目的及针对个人的人身攻击;第三种是恶意信息(malinformation),是指有目的、有组织、规模化地对信息进行设计、生产和传播,通过真人与社交媒体、机器人账户、平台算法的共同协作,高效率、病毒式地对网络空间进行“漫灌”,占据和淹没真实信息可能传播的时间与空间。

表2 四种典型虚假新闻的意图与经济动机分布

2.多渠道高度参与的传播网络

互联网和社交媒体时代,从事假新闻活动必须依靠三个要素才能取得成功,分别是:动机、服务工具和社交网络。与燃烧三要素相似,虚假新闻的传播要求这三个要素必须同时存在才能成功,缺乏任何一个都将使假新闻的传播非常困难,或者根本就不可能。

尽管长久以来,政治活动经常会采取蓄意宣传及传播虚假信息的方式,但利用自动化及相关算法在社交媒体上开发的机器人加快了虚假信息的传播速度,包括采用计算机辅助人工宣传、自动账户(机器人)传播、虚假线上身份网络、有组织的社交媒体操纵、算法操纵等方法。一些在线地下服务也非常具有吸引力,比如黑帽搜索引擎优化(Black Hat SEO),点击率欺诈,人力销售和机器人流量等。

在这个问题上,俄罗斯的“谎言灌喷”(Firehose of Falsehood)宣传模式堪称经典。这一模式注重大规模和多渠道,信息传播快速、连续、重复,但无视真实性与一致性。宣传的形式包括文字、视频、音频和静态图像,通过互联网、社交媒体、卫星电视和传统广播电视等进行全覆盖的立体传播。

高度参与的社交媒体是2016年虚假新闻如此成功背后的最大因素。《2016自动程序流量报告》显示,属于有害程序的“假冒者”(Impersonator)占比最多,接近总流量的四分之一。互联网上的海量资讯使用户的注意力成为稀缺资源,社交媒体在标题和内容设计上都尽量短小悚动,希望在最短的时间内最快抓住用户的注意力。这些都非常适合进行舆论操纵。

如果社交媒体平台上面充斥着虚假信息,很快平台将失去用户黏性。虽然虚假信息的病毒式传播在短期内会给平台带来一定流量,但长久来看,平台为了维护信息传播生态,不会允许虚假新闻的恣意泛滥。因此宣传者会采用其他手段维护其在社交媒体上的活跃度和能见度,比如漫游器和水军。为了达到吸引用户的目的,宣传者还会故意生产迎合受众需求和心理的内容,只要用户喜欢,哪怕其中存在偏见和错误,平台的推荐算法还会将更多的相似内容源源不断地推送给用户,而目前这样的操纵很难跟用户的实际行为区分开来。

比如在推特平台上,宣传的最好策略是尽可能让故事看起来是由很多分散的用户传播的,因此使用机器人账户、插入带有“##”的热帖标签等都是非常有效的方式。由于推特开放自身编程平台并允许用户设置匿名账户,因此更易受到机器人的影响。而对于脸书而言,由于其边际算法非常看重社交参数,因此获得较高点赞和分享的文章更有可能出现在新闻推送中。虽然推特和脸书这类平台已经采取了一系列举措遏制虚假新闻的传播,但同时也强调称自身并不该扮演编辑或者控制发布内容的角色。

(三)组织结构研究

1.网络水军组织化程度高

一般来说,进行社交媒体操纵的团队都有一个总体性的协作策略,包含创建政府官方应用、网站或内容传播平台;通过或真或假、或手动或自动的账户与社交媒体上的用户进行交互;创建具有实质性内容如图像、视频或博客的帖子。

网络水军经常进行团队能力建设活动。这些活动包括:

(1)对团队人员进行培训。政府将提供课程、老师甚至夏令营,以帮助网军更好地与社交媒体用户互动,改善和提升其内容制作、传播宣传等方面的技巧和能力。在俄罗斯,会聘用英语教师来教授网军正确的英语语法,以便同西方的社交媒体用户沟通;还有培训措施侧重于“政治经济学”方面,其目标是使网络团队能概述俄罗斯民众对当前事件的看法。在阿塞拜疆,年轻人被提供“如何写作博客”等社交媒体的相关培训,帮助他们在博客网站上更有效地吸引用户。

(2)为表现突出的个人提供奖金或激励。奖励制度是为了鼓励网军传播更多的信息,培训和奖励计划通常也会放在一起。在以色列,政府为学生提供亲以色列社会媒体活动的奖学金;在阿塞拜疆,积极参与青年组织活动的学生在政府机构中的晋升也会更加顺利。

(3)投资研究和开发相关的项目。一些民主国家的网络部队正投入到诸如“网络效应”等领域的研究和开发,研究信息如何在社交媒体上传播和扩大。例如2010年,美国的DARPA资助了一项890万美元的研究报告,通过追踪用户对网络内容的回应,了解如何使用社交媒体影响用户的行为。

(4)组织规模扩大化与属性社会化。随着时间的推移,网络部队的组织模式已经从涉及社交媒体舆论操纵实验的军事单位覆盖到与政府签订合同开展社交媒体宣传的战略传播公司。Centcom和技术安全公司HB Gary是美国政府雇佣的代表美国政府特别项目合约商。2011年,匿名组织称骇入HB Gary服务器,发现该公司为美国政府雇佣,开发了创立虚假社交媒体账号和水军的软件,这些账号被用来在有争议的问题上操纵民意。

2.地下黑市产业链完整

相比合法的内容营销,社交媒体操纵的地下服务虽然不是不可或缺的,但更具匿名性,可以帮助操纵者免责。随着社交媒体操纵的逐渐下渗,以虚假新闻的设计、制作、传播、营销和操作的地下黑市产业链条更加完整。

目前印度是世界上最大的僵尸粉丝生产国,BeSoEasy的操纵工具托管在GitHub上,可以贩卖自动机器人账户,作业平台包括脸书、推特、Instagram、Pinterest等社交平台。Quick Follow Now是一个英文网站,服务包括将各大社交平台上的内容与Soundcloud的关注、转推和收藏服务结合在一起。高级YouTube订阅套餐服务一次性收费为3150美元,可让客户获得100万个“高质量”阅览数与5万个“喜欢”。另一家100kfollowers网站则贩卖社交媒体关注者和YouTube视频流量数。

在俄罗斯,内容营销是合法服务,但搜索引擎和社交媒体上的广告依旧可以在地下论坛销售。地下市场就像是一个一站式服务商店,可以编造故事和事件,推销新闻,操纵只要符合客户要求而不论真假的材料等。论坛的服务供应链相当完整,从撰写新闻稿,到在媒体上宣传,采用或积极或消极的评论来保持势头,甚至还有客户定制模板。地下论坛还采用众包内容推广(Crowdsourcing the Promotion of Content)的形式创造性地操纵舆论。资金由数量可观的贡献者提供,虚假新闻的传播就被降低到仅仅是完成任务和推广内容,很少甚至完全不会再涉及其他资金。

对社交媒体或其他在线平台上的投票、竞赛和民意调查进行操纵是影响舆论最有效的手段之一。Siguldin系统本身能够绕过社交媒体、短信或者电子邮件中的安全检查,操纵互联网上的几乎任何投票系统。这一系统的费用取决于如何绕过安检:绕过IP地址、验证码等简单认证的大概需要1~1.5卢布,绕过社交媒体身份验证需要2~3卢布,需要详细在线注册的3~4卢布,而其他更加复杂的确认报价5卢布。类似删帖和刷粉的服务也有提供。Weberaser可以从互联网上取消或删除不合需求的内容或信息,或者从搜索引擎当中删掉最新的内容。任务越复杂,耗时越长,报价越贵。俄语或者机器翻译的内容报价3000卢布起,但删除英语内容报价要贵一倍。Jet-s平台可以操作网络投票或请愿,1万票报价6万卢布,2.5万票报价15万卢布。Slavavtope还可以操控更多平台。

此外,俄罗斯还有自己的可以自动兜售社交媒体垃圾邮件的软件套装。虽然在用户的控制下,单机运行这样的软件可能需要一段时间才能对广告产生影响,但是如果运营商可以访问支持该软件的僵尸网络,它的有效性将大大增强。在俄罗斯大规模、多渠道的媒体宣传中,甚至主流媒体都可以扮演一定的角色。但这样的行动需要大量资金支持,在信誉一般或者报纸的分类广告中发表文章需要1.5万卢布,如果不标是广告或者付费内容报价高达150万卢布。商业网站上4000~6000字的文章报价在30~55万卢布之间。

中东的地下市场也提供类似虚假信息生产与传播的地下服务,但存在地区差异。CoolSouk可以刷粉,粉丝既可以是真人账户也可以是机器人账户,25美元保证至少有500名真人账户。内容的费用因平台不同而各异,来自特定中东国家的赞赏和评论报价比较贵,但是不允许有种族、色情和非法的评论。YouTube上的视频,前1000次观看报价3美元,但是100万次观看报价则会高达999美元;推特上的订阅促销价格从30美元到150美元不等。另一个服务提供商Dr.Followers可以在脸书、推特、YouTube、Instagram等社交平台上提供自动推广服务。推特上外国人的转发500次报价2美元,但如果是阿拉伯或中东地区的转发,报价是130美元;脸书上的每月订阅报价25美元,但是来自阿拉伯或中东地区的订阅报价150美元,1万个“喜欢”最高报价达800美元。

四、混合宣传:社交媒体操纵的特征与影响

“宣传概念的产生过程,可以看作现代启蒙工程在传播领域的继续和具体化。现代性工程的表现之一是试图将整个社会作为一个可以精确管理的对象加以控制,追求最大效率,将个体变成整个社会机器的一颗螺丝钉,实现统一的目标。”此轮在互联网上进行的社交媒体操纵,其出发点和诉诸目标同现代意义上的宣传理念一脉相承,依然是试图“操纵公众观点,要么有意散布假消息,要么攻击那些支持反对党的言论”,并且通过技术手段大规模提升了网络信息内容的传播效果,“强化”(Reinforce)统摄性理念,并在此基础上形成了较为完整的黑色产业链,水军的组织化和制度化程度也日趋提高。我们将互联网时代这种宣传模式称为“混合宣传”,主要基于以下几个结论:

第一,社交媒体操纵是现代“混合战争”理念的重要组成部分。2017年美国纽约市立大学新闻教授、著名媒介博客Buzzmachine.com的博主杰夫·贾维斯(Jeff Jarvis)在自己博客中坦言,对于了解俄罗斯的社交媒体操纵,北约防务学院的《俄罗斯信息战争手册》和兰德智库的《俄罗斯的“谎言灌喷”宣传模式》都很有启发。在这两份资料中,俄罗斯的社交媒体操纵被概括为是一种“谎言灌喷”模式,在一定程度上是建立在苏联冷战时期的技术基础上的,重点是具有迷惑性(Obfuscation)和为了宣传者的利益对目标采取的行动。而在“混合战争”这一新军事思路时代,社交媒体操纵成为非战争时期非传统军事行动的关键组成,并在俄罗斯试图寻求全球实力控制的过程中迷惑、削弱、混乱其他竞争性力量。

第二,社交媒体操纵混杂了多种内容与传播形态,形成了错综的宣传网络。受全新的信息环境特点驱动,俄罗斯的社交媒体操纵使用的工具包括互联网和社交媒体,渠道则囊括处于不断发展中的专业和业余的信息服务行业及媒介产品。通过地下黑色产业链,以及对于社交媒体工具的组合使用,宣传者通过社交网络、平台媒体等制作、分发、跟踪、操纵信息的传播形态与传播效果,从合法的内容营销,到打擦边球的“舆情监测分析系统”,再到付费发/转/删帖、买流量、刷粉丝、在线刷票、点击率农场等,社交媒体操纵形成了一整套流程化的操作系统,每一个环节都错综复杂。

第三,社交媒体操纵混淆了事实与观点的边界,引发信息污染与信息失序。雅克·埃吕尔(Jacques Ellul)把“宣传”界定为:“由有组织的群体所使用的一系列手段,其目的是通过心理操纵,使大众中的个体达到心理上的统一,团结在一起,积极地或被动地参与该群体的行动”。他认为,“所有带有倾向性的讯息,不论是有意的还是无意的,都是宣传”。传统的宣传模式依然执着于对事实的追求,希望同受众建立信任关系;新宣传则更注重对事实的“使用”和对事实的诠释方法。但社交媒体操纵可以超越这两者,以大规模、多渠道、快速、连续、重复的方式对用户进行信息轰炸和漫灌,这样的宣传形态甚至可以无视真实性与一致性,因为信息量是如此巨大,用户靠个人能力根本无法去对信息进行一一核实,一旦对某个信息有了先入为主的“首因效应”,之后的信息核查和信息纠正很难再奏效,对于假新闻进行的各种“事实核查”几乎没有起到实质性效果,而这也严重损害了信息的传播秩序与生态环境。

而对于网络舆情来说,网络水军、网络部队、组织化的网络战在其中的作用和影响不可小觑。未来,网络社会中的舆论和舆情,在很大程度上已经不能简单地等同于网民的言论和声音,因为通过组织化的信息生产和机器账户的病毒式传播,完全制造出另外一种完全不同的舆论形态。

第四,社交媒体操纵将鼓动宣传和总体宣传融为一体,兼具短期和长期效应。埃吕尔还将宣传分为鼓动宣传(propaganda of agitation)和总体宣传(total propaganda)两种。鼓动宣传主要是指短期内的激起人们感情并能够造成立即的行为的宣传,主要诉诸感性认知;而总体宣传则是“涉及全部社会成员、涉及政治、经济、文化教育所有领域,综合使用所有媒介的宣传。”通过制造含有强大视觉冲击的符号,“植入一系列彼此冲突且充满矛盾的捏造事实”,社交媒体操纵可以在短期内迅速引发人们的强烈情绪,又可以通过多种传播渠道的综合使用,绵延不绝地持续地进行传播,除了“混淆视听”,社交媒体操纵还会使普通群众由于厌倦和失望而对政府政策漠不关心,带来政治疏离与政治冷漠。

[本文感谢深场实验室(DeepField Lab)的支持]

注释:

① Arnaudo,D.ComputationalPropagandainBrazil:SocialBotsDuringElections.Computational Propaganda Research Project Working Paper,2017.pp.5.

② Kollanyi,Bence,Philip N.Howard,and Samuel C.Woolley.BotsandAutomationOverTwitterDuringtheUSElection.COMPROP Data Memo,2016.p.2.

③ Cadwalladr,C.TheGreatBritishBrexitRobbery:HowOurDemocracyWasHijacked. The Guardian,https://www.theguardian.com/technology/2017/may/07/the-great-british-brexit-robbery-hijacked-democracy.,2017-05-07.

④ Khaldarova I,Pantti M.Fakenews:TheNarrativeBattleOvertheUkrainianConflict.Journalism Practice,vol.10,no.7,2016.pp.891-901.

⑤ Ferrara E.DisinformationandSocialBotOperationsintheRunuptothe2017FrenchPresidentialElection. First Monday,vol.22,no.8,2017.pp.1-2.

⑥ Kollanyi B,Howard P N.JunkNewsandBotsDuringtheGermanFederalPresidencyElection:WhatWereGermanVotersSharingOverTwitter? Computational Propaganda Project Working Paper Series,vol.7,2017,pp.1-5.

⑦⑩ House F.FreedomontheNet2017:ManipulatingSocialMediatoUndermineDemocracy.Freedom House,https://freedomhouse.org/report/freedom-net/freedom-net-2017.,2017-11.