铁路货车装载超限的无人机视觉检测技术

汪怡然,阮欣培,李鹏舜,李少爽,刘雪勇,杨 岳

(1.中南大学 交通运输工程学院, 长沙 410075;2.中南大学 信息科学与工程学院,长沙 410075)

铁路是国民经济基础性行业,保证铁路生产安全和运输效率意义重大。而在实际运输过程中,由于货车装载超限,经常影响邻线行车安全,甚至导致列车脱轨[1]。因此,需要一种简便有效的超限检测方法,帮助货检员精准确定货物超限位置和等级,以便有针对性地调整货物装载状态,制定更合理的运输方案。

目前,铁路货车的装载超限检测大多依靠人工测量完成,这种检测方式不仅速度慢、精度差,而且存在着一定的安全隐患[2]。国内外尝试采用红外[3]、激光[4]、雷达和光学理论测算[5]技术,研制出各种地面式[6]、手持式[7]和车载式检测设备,但这些检测设备价格昂贵且需要特殊布置的测量场景;测量精度依赖于所搭建机械的结构精度,不容易控制。另外,现有的检测手段仅能针对普通货物列车进行检测,对于使用特殊条件运输的超限货物列车无法按照需要调整检测标准。

针对上述缺陷,本文研究了一种高精度、低成本的超限检测方法,通过无人机获取货车装载的单目多视角图像,以此为基础进行货车装载外形的三维重建,并将货车装载的三维模型与超限检定模型进行比对,实现铁路货车货物装载的全面精确检测。

1 研究方案

无人机视觉检测技术通过人工操控或依照无人机飞行姿态模型,确定无人机的飞行轨迹,利用无人机针对待检货车拍摄多视角图像。基于拍摄到的图像,在图形工作站中还原货车等比例的三维实物模型,并与超限检定模型嵌套比对,根据模型三视图和三维透视图的显示情况,确定超限位置并判定超限等级,具体方案如图1所示。

图 1 货车装载超限的无人机视觉检测技术方案

2 无人机飞行姿态模型

为了获取货车装载的三维实物模型,无人机必须在不同方位获取待检测货车的多个图像。无人机的拍摄位置与拍摄图像张数将直接影响三维实物模型重建的速度与精度。若拍摄的图像过多,处理速度会大幅下降;若图像过少,则检测精度不高。为确定最佳拍摄位置,获得最优的检测结果,提出以下无人机飞行姿态模型。

2.1 模型假设与参数设置

(1)无人机拍摄时不能沿曲线移动,只能以“直上直下”的形式变换拍摄位置;

(2)定义一个长方体,该长方体能将铁路建筑限界刚好完全包裹。若此长方体的8个顶点皆位于拍摄范围内,则整列货车一定可以被完全拍入图像中。

设相机机位坐标为(x0,y0, z0),光轴与车辆横中心线所在平面夹角为α,与水平面的夹角为 β。

2.2 目标函数

(1)为确认空间点位于图像的拍摄范围,需要完成空间坐标向图像坐标的维度转换。用一个点O作为原点,使得实物上的点Q以及无人机相机的坐标分别表示为相对于点O的坐标(xw,yw, zw),(x0,y0, z0)。利用相机外参数矩阵可得:

式(1)中,(xc,yc, zc)表示空间点在相机坐标系OcXcYcZc中的坐标,cMw是外参数矩阵。

(2)根据小孔成像原理,利用相机内参数矩阵Min,将空间点转换为其在图像中的像素点位(u,v):

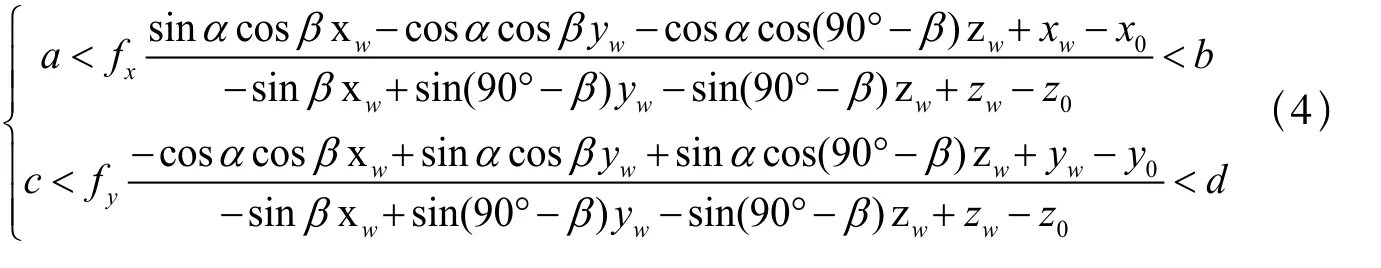

若a,b, c,d为图像4个边界距主点坐标的距离,要使得实物上的点Q在拍摄范围内,应有如下关系:

2.3 精度约束

根据三维模型重建原则,所提供的相邻两张图像的重合率不应该低于60%。若每张图像的拍摄范围表示为像素点的积分,则相邻两张图像的共同拍摄区域可表示为:

进而得到重合面积约束:

3 相机内参标定

无人机飞行姿态模型的求解关键在于求出无人机相机的内外参数矩阵,其中,外参数可以通过坐标系转换求得,而内参数需要借助MATLAB相机标定工具箱和靶标进行标定。

3.1 标定实验环境

在此次对摄像机内参数的标定实验中,采用基于平面标定板的相机标定方法[8]。在这种标定方法中,标定所用的靶标应满足下列要求:

(1)相对于周边环境,特征图案应易于识别,构图简单,易于视觉系统能够快速进行图像处理;

(2)图案应包含足够的信息,如点、线或区域。

在摄像机标定过程中,由于摄像机固定不动,平面靶标按不同姿态摆置,所以,摄像机的内部参数始终不变,发生变化的只是外部参数。标定实验可以多次采集平面靶标图像,然后计算出摄像机内参数。这种标定方法不仅对设备要求低,操作也比较简单,也不需要高精度的标定板,具有很强的鲁棒性,实用性比较强。

3.2 标定过程与结果

本次实验采用MATLAB相机标定工具箱[9],并根据实际情况对标定工具箱内部程序进行适当修改,实现棋盘格标定。靶面尺寸为2/3 inch,标定靶标为黑白棋盘格标定板,方格子数目为12×9,方格尺寸为30 mm×30 mm。标定流程如图2所示。

图 2 相机参数标定流程

(1)将摄像机水平放置并保证Z轴垂直,采集不同姿态的标定板图像。最后的标定效果与采集图像数量有关,为了获取更详细的镜头畸变信息,在保证标定图像质量的前提下,采集图像时应让棋盘占据尽可能多的画面,这样可提高最后标定结果的精度。

(2)通过Extract grid corners命令对多组平面标靶角点及网格点进行提取。每张图像以距离自己最远的顶点为起点,然后按照相同的顺序,依次手动选取标定板网格的4个角点,程序会根据所选角点对其他角点进行预测定位。根据角点预测结果,观察角点预测匹配是否最佳,对于匹配比较差的图像,可以添加畸变系数进行调整。

(3)通过优化算法,对自动提取的平面标靶中的网格点进行优化,最后提取亚像素的网格坐标。

(4)依次对12幅图像进行角点提取,通过网格点坐标计算摄像机内参数变化矩阵,对计算结果进行偏差估计并且使其可视化。

标定过程中,图像角点提取的误差过大,将会严重影响标定精度。可以通过如图3所示的误差分析图,找出误差主要来源的图像序号,再重新提取角点或直接剔除图像,以提高标定精度。

图 3 相机标定像素误差分析图

经过相机标定实验,得主点坐标为 [1 236.222 56 1 626.530 88],焦距坐标为[2 809.399 64 2 809.402 52],从而确定相机内参数如下:

获得相机内参数后,即可求解无人机飞行姿态模型,获取无人机最佳飞行轨迹和拍摄位置。

4 货车实物装载的三维模型重建

4.1 三维重建原理

由无人机拍摄所得的各张图像投影中心出发,经过一对同名点的两条直线会在空间中交会于一点,即该点在真实场景中的三维坐标。通过图像间对应像素间的视差,可反推出图像中目标物体的空间几何形状和位置,从而实现三维模型的重构。以图4为例,假设在两张图像上有一对同名点,位于左片的PL点和位于右片的PR点,则由两张图像的投影中心出发分别经过这一对同名点的两条直线在空间中交会于P,可以恢复出真实场景中物体表面上某一点的三维坐标[10]。

根据以上初步的配合比(02号)中水胶比和砂率按《水工混凝土试验规程》(SL352-2006)规定进行调整,水胶比增减0.05、砂率相应增减1%,得出01和03号调整后的配合比进行试配,如表6共3个配合比进行试配,表7为3组配合比试配后得出各项混凝土性能指标。

图 4 三维重建原理图

4.2 C64货车模型重建

此处,采用1台缩小版的C64敞车模型进行有关试验,其上搭载布袋和木箱模拟货物,检测货车装载超限情况。使用无人机环绕模型拍摄了110张图像后,导入三维重建软件PhotoScan中。系统将匹配出每张图像的拍摄视角和相机机位,并获得敞车模型点云。完成后续操作即可得到重建的敞车装载三维模型,重建结果与实物效果对比如图5所示。

图 5 货车装载实物与重建结果

5 基于3ds Max的限界检测与判定

5.1 建立超限检定模型

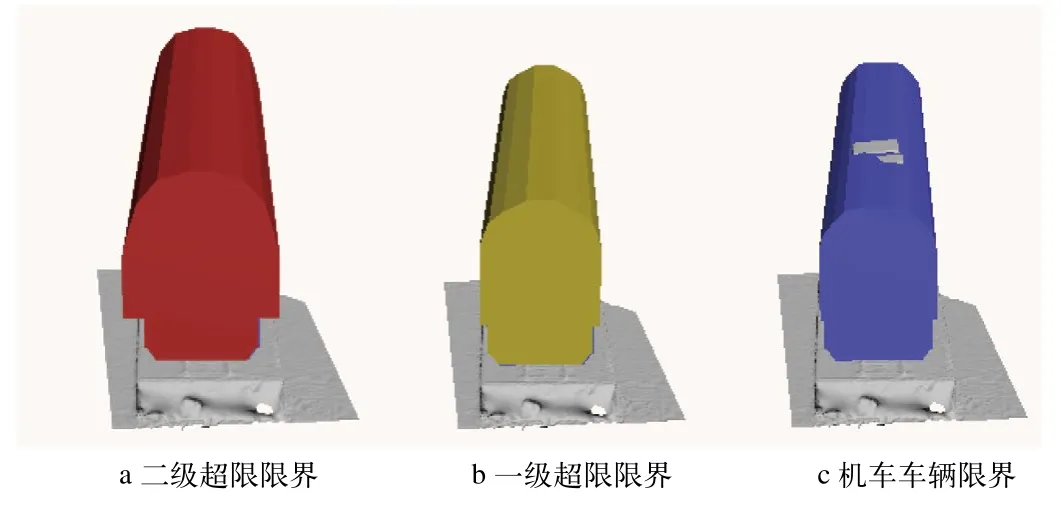

预先绘制用于超限判定的超限检定模型。考虑到铁路上将货车超限划分为3个等级,因此需要根据规定尺寸,分别绘制3个检定模型。如图6所示,得到的检定模型和实物模型表面颜色各不相同,为后期的超限检测判定提供了方便。绘制模型时,尺寸可根据需求调整,从而更好地适应不同运输条件下的货车装载超限检测。

5.2 检测与判定

将重建得到的三维货车模型导入3ds Max中,用旋转工具调整三维模型的角度,在材质编辑器中调整模型的透明度和颜色,根据实际情况设置3ds Max中的系统单位。

图 6 限界标准模型

(1)为了充分展现利用三维模型进行检测的优势,使得判定结果更为直观,需要将超限检定模型和货车模型按照同一基准嵌套,利用三维视图实现超限检测判定。正常情况下,载货货车应被三级限界层层包裹;若货物超限,则会突出相应的限界轮廓线,根据突出情况即可判定超限等级。由图7可见,此处货物超出了代表机车车辆限界的蓝色轮廓,整体判定为一级超限。超限的具体数值,可在三视图中使用测距功能量取,通过读取俯视图的y坐标差可得出超宽的具体数值,通过读取正视图的z坐标差可得出超高的具体数值。

图 7 整体超限判定

(2)通过透视图观察,可得到准确的超限位置和超限量。若货物未超出限界,则对应检定模型表面颜色均一、光滑;若货物超限,则表面会有灰色部分显现。如图8所示,此处由于货物属于一级超限,仅有机车车辆限界表面显现出灰色部分。这些灰色区域也就是需要进行调整的货物位置。

5.3 检测精度

如表1所示,量取重建敞车模型的相应数据,所得结果与手测值基本一致,误差在±2 mm左右,精度高,检测结果可信。

图 8 装载超限分析

表 1 货物装载检测精度

6 结束语

针对铁路货车装载状态,用无人机飞行姿态模型对航拍位置进行规划,运用无人机航拍和三维重建技术实现超限检测,大幅度提升了铁路货物装载超限检测的灵活性,降低了检测成本。本文所提出的超限检测手段相比于现有检测方法主要有以下优势:

(1)无人机视觉检测技术不同于传统的平面检测方式,通过重建出待检测货车的三维模型实现超限检测,操作简便,判定结果更为直观,精度较高。

(2)超限检定模型可根据不同运输条件灵活调整,比现有检测手段的适用范围广,检测成本低。

(3)能够准确判定货物超限等级、类型和装载位置,便于货检员有针对性地换装整理。

未来可以依据无人机飞行姿态模型预定义飞行轨迹,实现自动化的超限检测;根据铁路各运行区段的限界要求,建立超限检定模型数据库,将能更好地发挥无人机视觉检测技术的优越性。