基于车载视觉的驾驶员后视镜查看行为检测

黄 波,钟铭恩,2,吴平东,黄杰鸿,乔允浩

基于车载视觉的驾驶员后视镜查看行为检测

黄 波1,钟铭恩1,2,吴平东3,黄杰鸿1,乔允浩1

(1. 厦门理工学院机械与汽车工程学院,福建 厦门 361024;2. 厦门理工学院福建省客车先进设计与制造重点实验室,福建 厦门 361024;3. 北京理工大学机械与车辆学院,北京 100083)

车辆转向时驾驶员的后视镜查看行为是行车安全的必要措施之一,但目前关于该行为的检测技术应用尚属空白。为督促驾驶员在车辆转向时及时查看后视镜留意车辆侧后方的交通情况,基于车载单目视觉与图像处理技术提出一种自适应检测方法。首先,设计帧差搜索分割算法自动实现车辆启动期间的驾驶员脸颈初始区域定位和灰度初值计算,摆脱算法对驾驶员信息的依赖;设计胀缩分割算法快速实现车辆行驶期间的驾驶员脸颈区域定位和灰度均值计算。其次,提取脸颈外轮廓并定义了一种由颈部轮廓基点垂线划分的左右面积比特征参数,分析表明其受驾驶员头部姿态显著影响。最后,结合驾驶过程的眼动凝视数据揭示了该特征参数在驾驶员查看后视镜过程中的累积概率局部峰值分布规律,并提出一种基准特征值实时估算方法和后视镜查看行为阈值判定原理。实验结果表明,该方法适应于不同脸型,具有良好的抗干扰能力,综合检测准确率达96.1%。

交通安全;车载视觉;驾驶员;脸颈外轮廓;后视镜查看行为

随着我国机动车保有量的迅速增加,混合交通环境日益增多,交通参与者类型趋于多元化,道路交通事故率居高不下。统计表明,25%~30%的交通事故与低警觉驾驶直接相关,其中当车辆拐弯、变道、并线等转向操控时驾驶员未注意观察车辆侧后方交通情况是引发交通事故的典型原因[1-2]。实时检测和督促驾驶员在车辆转向时实施必要的后视镜查看行为对于减少这类交通事故具有现实意义。

目前,关于后视镜查看行为的检测技术或应用都尚属空白,相关研究主要涉及驾驶员头部姿态的识别。车载视觉技术由于具有非接触、不额外干扰驾驶员等特点是其首选检测方案。传统研究多基于人脸模型[3-6]或基于纹理、眼鼻局部微结构、脸部三角形等人脸细节特征[7-11]进行头部姿态估计。由于依赖人脸模型和脸部细节特征,算法适应能力有限且实时性相对较差。为此部分学者转向利用人脸轮廓进行头部识别跟踪[12-13]。由于仅处理轮廓,尽管在细节表达能力方面有所下降,但算法实时性获得显著改善。存在的问题是当驾驶员脸型改变(如更换其他驾驶员)或脸部细节变化较多(如眼镜等佩戴物遮挡)或摄像头成像角度改变(如调整座椅)时算法的准确度易受干扰。为克服此问题,本文应用车载视觉和图像处理技术实现驾驶员脸部、颈部连通图像区域(以下简称脸颈区域)的自适应分割和轮廓特征变化规律解析,提出一种驾驶员无关的、具有良好抗干扰能力的后视镜查看行为检测方法。

1 检测方案

为简化系统且避免对驾驶员造成额外干扰,采用无光源单目视觉技术。摄像头安装位置和角度可以任意,但应能够拍摄到驾驶员脸颈区域。漆黑环境下无法有效采集图像的问题可以应用红外成像方案加以解决。为不失一般性的重点研究图像处理算法和行为检测方法,本文仅考虑白天情况。基于所采集的视频图像,检测流程如下:

步骤1. 车辆启动时,利用帧差搜索分割算法自动实现驾驶员脸颈区域分割和皮肤灰度初值计算,为后续图像处理奠定参数基础。图像处理特点在于驾驶员无关特性,即无需预知驾驶员信息,缺点是搜索时间长导致实时性较差。

步骤2. 车辆行驶时,基于上次图像处理获得的参数结果,利用脸颈区域胀缩分割算法来快速实现驾驶员脸颈区域分割和皮肤灰度初值计算。图像处理特点是实时性好。若此时车辆无转向(本文以转向灯为触发信号),则重复步骤2保持脸颈区域动态跟踪。否则,继续步骤3。

步骤3. 提取当前脸颈区域的外轮廓并计算轮廓特征参数。

步骤4. 基于轮廓特征参数的累积分布概率,计算更新驾驶员分别查看车外左、右后视镜时的脸颈轮廓的基准特征值。目的在于使基准值能自动根据驾驶人员、坐姿、座椅位置、摄像头位置、拍摄角度等因素而调整。

步骤5. 对比当前图像中的脸颈轮廓特征参数和基准特征值,判断驾驶员头部是否处于观察车外后视镜的位姿,并进一步根据该位姿的持续时间判定是否实施了一次有效的后视镜查看行为。当判定该观察行为无效时进行提醒预警;反之不预警,而是应用此次后视镜查看行为过程中的轮廓特征参数序列更新其累积分布概率。

至此一次判断循环结束,返回步骤2继续下一循环,直到车辆熄火。

2 算法设计

2.1 脸颈区域帧差搜索分割算法

车辆启动时,车速近似为零,此时驾驶员身体移动将是所采集图像序列的主要变化内容,尤其以头部和上肢的移动最为显著。可根据具有一定时间间隔的两帧图像的差分结果确定运动范围并检测出运动目标[14-16]。基于此原理,设计驾驶员脸颈区域帧差分割算法如下:

以上结果表明:帧差搜索分割算法能够自动实现驾驶员脸颈区域的定位和分割,并计算出脸颈皮肤灰度均值,无需依赖任何预置参数信息。特别的是当驾驶员佩戴墨镜等遮挡物时仍有较好的识别效果,如图2所示。算法缺点是相对耗时,不适用于车辆行驶时。

2.2 脸颈区域胀缩分割算法

图1 初始脸颈区域的帧差搜索分割算法结果

图2 佩戴墨镜时的识别结果

图3 脸颈区域胀缩识别结果

以上结果表明胀缩分割算法具备脸颈区域的动态跟踪能力。由于算法简单和图像处理像素少,实时性很好,可适用于车辆快速行驶过程。

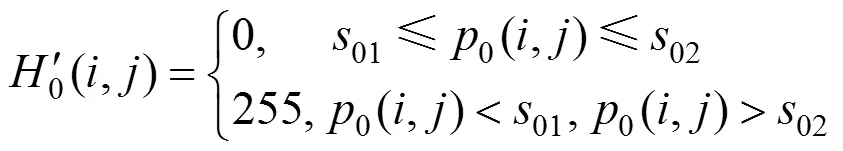

2.3 脸颈轮廓提取

图4 脸颈区域外轮廓曲线

从图4可知,脸颈轮廓不一定是光滑或圆滑的闭合曲线,可能因毛发、眼镜、口罩等影响而呈现不同数目和形状,因此根据轮廓曲线的面积来定义特征参数相比于尺度、形状等特性将更 可行。

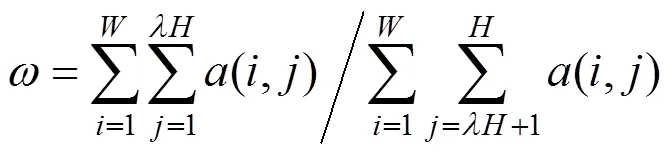

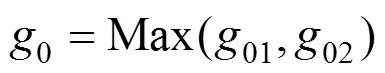

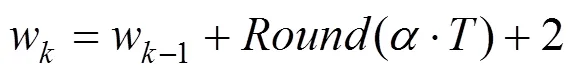

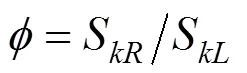

2.4 轮廓特征参数定义

以查看车辆右后视镜为例,驾驶员脸颈轮廓典线的典型变化如图5所示。

图5 查看右后视镜时脸颈轮廓的典型变化规律

((a) 为驾驶员查看车辆行驶方向前方;(b) 为向右扭头;(c) 为进一步向右扭头;(d) 为观察右后视镜状态;(e) 为保持右后视镜观察状态;(f) 为观察结束从右往前扭回头;(g) 为进一步从右往前扭回头;(h) 为恢复到查看车辆行驶方向前方。)

从图5可知:

测得在某驾驶员左右后视镜连续查看过程中随头部转角的典型变化规律如图6所示。

3 后视镜查看行为判定

3.1 累积概率局部峰值规律

不同驾驶员或车辆,由于脸型差异和摄像头安装位置和拍摄角度不同,基准特征值将不同;即使同一驾驶员驾驶同一车辆,由于座椅坐姿调整、发型变化、佩戴物品等原因都将导致基准特征值改变。显然不能通过预置先验参数值来给定基准值。

图7 驾驶过程眼动凝视点检测实验

图8 l=3时某驾驶视频的参数的概率分布

3.2 后视镜查看行为判定原理

分别定义查看左、右后视镜时的凝视系数为

4 验证分析

共招募32位驾驶员开展驾驶实验,脸型覆盖蛋形、方形、圆形和三角形4类,并部分设置眼镜(含墨镜)、帽子等佩戴物以及胡须、披肩发等显著毛发特征干扰源。要求各驾驶员查看后视镜时需保持1 s以上时长的后视镜凝视。实验车辆为2008年生产的大众牌5座经典宝来轿车,实验道路为厦门市集美新城市民广场主路多路口段。为进一步增加背景干扰源,开启车窗并在后排座椅随机安排人员乘坐。实验时副驾驶座乘员协助标记每次车辆转向操控的视频起止时间。视频帧率为25帧/秒,分辨率为640×480像素。针对每位驾驶员各截取50次车辆转向时的视频片段,共获得1 600个样本。据此可人为统计出各驾驶员在车辆转向时未查看后视镜的不良驾驶行为的次数。

表1结果表明:

(1) 车辆转向时驾驶员未查看后视镜的不良驾驶行为的综合检测准确率为96.1%,这表明本文所提出的检测方法具有良好的准确率。

(2) 针对蛋形、方形、圆形和三角形这四类常见脸型的综合检测准确率分别为95.2%、97.8%、95.4%和95.1%,说明检测方法具有驾驶员脸型无关特性,即具有良好的普适能力。

(3) 当驾驶员佩戴眼镜、帽子或者留有胡须时,检测准确率基本不受影响,说明本文检测方法具有良好的抗干扰能力。

(4) 但是当驾驶员具备披肩长发特征时,检测准确率大幅下降至81%左右。其原因在于驾驶过程中披肩发对脸颈皮肤的遮挡情况可能发生持续随机变化,导致轮廓特征参数偏离累积概率分布规律。任何可在驾驶过程中持续随机遮挡驾驶员脸颈皮肤的因素都将降低检测准确率,这也是本文所提检测方法有待改进的环节。

此外,实验中发现:①当驾驶员未扭头而是通过转动眼球斜视或余光查看后视镜时,检测准确率将下降至5.2%左右,对于这类情况本文检测方法将失效;②车辆转向期间,如果非驾驶座乘员有皮肤长时间保持贴近驾驶员脸颈部,综合检测准确率将临时下降至86.2%,但短时间贴近时对检测准确率基本无影响。

5 结 论

[1] World Health Organization. Global status report on road safety: Supporting a decade of action [M]. Geneva: WHO Press, 2013.

[2] 公安部交通管理局. 中华人民共和国道路交通事故统计年报(2013年度) [M]. 北京: 人民交通出版社, 2014.

[3] CHUTORIAN M E, TRRIVEDI M M. Head pose estimation and augmented reality tracking: an integrated system and evaluation for monitoring driver awareness [J].IEEE Transactions on Intelligent Transportation Systems, 2010, 11(2): 300-311.

[4] 张波, 王文军, 成波. 基于人脸3D模型的驾驶人头部姿态检测[J]. 汽车工程, 2016, 38(1): 53-71.

[5] 邱丽梅, 吴龙, 晋芳伟, 等. 基于稀疏模型的人脸姿态估计[J]. 图学学报, 2013, 34(04): 94-97.

[6] 赵刚强, 陈岭, 陈根才. 基于注册和多尺度表观模型的三维头部跟踪[J]. 浙江大学学报: 工学版, 2009, 43(9): 1597-1603.

[7] 陈振学, 常发亮, 刘春生, 等. 基于Adaboost算法和人脸特征三角形的姿态参数估计[J]. 武汉大学学报: 信息科学版, 2011, 36(10): 1164-1167.

[8] TAWARI A, MARTIN S, TRIVEDI M M. Continuous head movement estimator for driver assistance: Issues, algorithms, and on-road evaluations [J]. IEEE Transactions on Intelligent Transportation Systems, 2014, 15(15): 818-830.

[9] 付先平, 王亚飞, 袁国良, 等. 基于粒子滤波的驾驶员视线自动校准算法[J]. 计算机学报, 2015, 38(12): 2390-2399.

[10] 蒋建国, 胡珍珍, 詹曙. 基于深度数据的空间人脸旋转角度估计[J]. 图学学报, 2012, 33(04): 71-75.

[11] DOMAIKA F, DAVOINE F. On appearance based face and facial action tracking [J]. IEEE Transactions on Circuits & Systems for Video Technology, 2006, 16(9): 1107-1124.

[12] 周志宇, 杨卫成, 汪亚明, 等. 应用梯度矢量流Snake和灰预测的人脸轮廓跟踪[J]. 光学精密工程, 2011, 19(11): 2744-2752.

[13] 李月龙, 靳彦, 汪剑鸣, 等. 人脸特征点提取方法综述[J]. 计算机学报, 2016, 39(7): 1356-1374.

[14] 罗海波, 许凌云, 惠斌, 等. 基于深度学习的目标跟踪方法研究现状与展望[J]. 红外与激光工程, 2017, 46(5): 6-12.

[15] 李洪安, 杜卓明, 李占利, 等. 基于灰度与纹理特征的空中目标识别与跟踪[J]. 图学学报, 2016, 37(02): 224-229.

[16] 王静静, 林明秀, 魏颖. 基于灰度相关的帧间差分和背景差分相融合的实时目标检测[J]. 中南大学学报: 自然科学版, 2009, 40(s1): 142-148.

Apply Vehicle Vision to Detect Driver’s Rearview Mirror Watching Behaviors

HUANG Bo1, ZHONG Mingen1,2, WU Pingdong3, HUANG Jiehong1, QIAO Yunhao1

(1. School of Mechanical and Automotive Engineering, Xiamen University of Technology, Xiamen Fujian 361024, China;2. Fujian Provincial Key Laboratory of Bus Advanced Design and Manufacture, Xiamen University of Technology, Xiamen Fujian 361024, China;3. School of Mechanical and Vehicular Engineering, Beijing Institute of Technology, Beijing 100083, China)

The driver’s rearview mirror watching behavior is one of the necessary steps for driving safety when the vehicle is turning, however, the detection technology or application of this behavior is still absent. Thus an adaptive detection method of the drivers’ rearview mirror watching behaviors during the vehicle steering process was presented in this paper with the help of vehicle vision and image process technology for safety monitoring and reminding. A frame spatial gradient differences searching algorithm was designed to complete the initial parameters’ learning work on both the drivers’ face and neck regions when the vehicle engine was fired, while a expand-contract searching algorithm was invented to accomplish a fast recognition when the vehicle was moving. Contours of the driver's face and neck parts were extracted without segmentation. An area ration between left and right parts of the contours separated by a vertical line passing through the base point of neck contour was defined as a characteristic parameter. By analyzing the drivers’ eye movement data during driving, a discipline called local peak value distributing of the parameter’s cumulative probability was uncovered, which helped to build a real time eigenvalue reference estimation method and a threshold judging principle of the drivers’ rearview mirror watching behaviors. Experimental results showed that this method was not sensitive to the types and details of drivers' faces, and was robust to some disturbance, and the overall detection accuracy rate was 96.1%.

traffic safety; vehicle vision; driver; outer contour of face and neck; rearview mirror watching behavior

U 491.6

10.11996/JG.j.2095-302X.2018030477

A

2095-302X(2018)03-0477-08

2017-09-14;

2017-10-16

国家自然科学基金项目(61401382,61104225);福建省自然科学基金项目(2015J01672)

黄 波(1991–),男,福建莆田人,工程师,硕士。主要研究方向为机器视觉与图像处理技术研究。E-mail:1595338432@qq.com

钟铭恩(1980–),男,福建厦门人,副教授,博士。主要研究方向为驾驶安全与辅助技术研究。E-mail:zhongmingen@xmut.edu.cn