机动车辆辅助驾驶动态障碍物检测方法*

董大明

(山西交通职业技术学院,太原 030031)

0 引言

基于计算机视觉的动态障碍物检测算法利用摄取的车前视频图像在复杂背景下检测动态障碍物,从而估计出潜在的危险,具有重要应用价值,也是目标检测与跟踪领域的重点和难点,其背景的复杂多样性和摄像机的随车体运动增加了检测算法的难度,也对检测算法的鲁棒性和实时性提出了很高的要求。

动态障碍物检测主要采用背景模型法、运动场法和帧间差分法等。与背景差分法对背景模型的依赖和光流法的计算高复杂度相比,相邻帧间差分法用连续的二帧或者三帧图像逐像素差分消除背景影响,但其需要连续的相邻帧图像背景是相对静止的,为此,当摄像机随车运动时,须先进行相邻帧间图像的配准,即背景全局运动的补偿,文献[1]从理论上分析了全局背景补偿的参数估计值直接决定着帧间背景的配准精度,进而影响最后的目标检测效果。

李强等人[2]采用图像灰度编码方法实现快速匹配;施家栋等人[3]基于块匹配减少计算量,但当摄像机有非线性运动时,准确性受到影响。朱志文等人[4]采用金字塔和分块策略以及匹配过程的并行化来提升SIFT算子匹配的精度和效率,但受到主机CPU核数的限制,加速比的提升有限;闸旋[5]采用分块策略和GPGPU加速改进SIFT算子的计算效率实现大面阵影响的快速匹配;姚国标[6]利用MSER和Harris-Affine算法获取初始匹配,再使用最小二乘自适应迭代匹配,但匹配策略不够理想的问题,所以难以保证匹配效果。肖雄武[7]等人提出具有仿射不变性快速匹配方法,通过估算影像的相机轴定向参数计算出初始仿射矩阵,对影像进行纠正,然后进行SIFT匹配,匹配点对较为密集、均匀、且效率较高。Mortensen[8]等人结合全局信息的SIFT特征描述符,降低了由于局部信息相似造成的误匹配率,但计算量较大,而且不具有尺度不变性。

结合前人的研究成果,文中在帧间差分法基础上,提出基于改进SIFT算子背景补偿和改进假设检验方法的目标检测方法,算法通过影像金字塔和动态帧间特征点位置估计改进SIFT算法,提高参数估计的实时性,通过改进假设检验方法提高动态目标的检测准确性,实验验证了算法的有效性。

1 改进SIFT特征配准全局运动补偿

SIFT[9-10]特征点对图像的旋转、尺度缩放以及光照变化具有较好的稳定性,对目标的运动、遮挡、噪声等因素也有很好的鲁棒性[11],但其描述符维数和配准策略使得算法的匹配时间长,错匹配较多,实时性和稳定性不满足要求[12]。

为此,本节采用多分辨率影像金字塔和图像分块策略使得算法可以根据行车环境的复杂性选择合适的分辨率,以减少特征点数并保持点数稳定,其次采用相邻帧特征点位置估计对配准策略进行改进,提高算子对行车背景适应性算法的配准精度,满足算法的实时性要求。

1.1 多分辨率分析均衡特征点数

文中对图像五层多分辨率图像,首先对第一层低分辨率图像进行分块并提取SIFT特征点,当低分辨率图层块中的特征点数较少未达到预设阈值时,则将高一层分辨率图像对应块用于特征点提取和配准,这样提取特征点,一方面通过控制每个块内特征点数使特征点分布于整幅图像,避免了特征点密集对全局背景补偿参数整体产生影响,另一方面在处理不同复杂度背景时,可以提取相对稳定的特征点数,从而确保稳定的算法运行效率。

1.2 多层窗口对特征点描述符降维

文中根据文献[13]方法,采用如图1所示的邻域窗口来计算特征点描述符,以中央特征点为中心,每两个像素的宽度范围为一层,建立四层邻域。

以45°为间隔均分空间,累加邻域内8个方向范围内的梯度值,则特征点描述向量为4×8=32维,并按照区域位置对向量排序。像素累加时先灰度归一化以减少光照影响:

则最终计算得到的32维描述符向量为:

Fi兼顾向量隆维和反映邻域像素的距离贡献特性,因而对特征点的描述更准确。

1.3 基于位置估计的快速特征点配准

视频图像的相邻帧间时间间隔较短,因而,当图像生成影像金字塔时,其低分辨率图像的配准特征点之间变化并不大,基于此利用当前帧顶层图像的特征点位置作为下一帧配准特征点的预测值,并在其领域内搜索配准特征点。然后以这些配准特征点计算全局背景补偿参数的粗值,再以粗值进一步计算参数的精确值,完成图像精确配准。

1.3.1 改进全局运动参数估计

文中采用仿射参数模型计算补偿参数,其计算相对简单,对摄像机运动较小情况较适合,设特征点及其配准点之间的仿射变换关系为

其中,γ 为缩放因子,θ为旋转角,(c,d)为平移量。利用顶层配准特征点对,根据式(3)建立超定方程组,可以求解摄像机的参数。

1.3.2 基于两步位置预测的快速特征点配准

利用低分辨率的顶层图像特征点进行位置估计,然后在估计位置的邻域内对特征点进行配准,从而实现顶层图像特征点的快速配准,并计算式(3)的参数值作为粗值,然后利用式(3)粗值进一步对所有特征点进行位置估计和配准,计算式(3)的参数的精确值,其配准过程如下:

步骤1 将相邻帧图像分为矩形小块,块间不重叠,计算相邻两帧图像SIFT特征点及其描述符,为减少特征点分布不均的影响,仅对每个块内的一定数量特征点进行配准。

步骤4 当由于估计位置的邻域交叠等原因,使得配准过程出现多对一的情况时,采用式(5)的互相关系数进行重新配准,取相关系数最大的特征点。

其中,x(n),y(n)为待配准描述符。分块策略和位置估计的配准过程,减少了特征点配准的搜索范围,提高了配准速度,并通过位置邻域约束,避免两个位置相差较大的特征点误配准,同时使得特征点对在图像中分布较均匀。

运用特征点进行运动补偿时,存在误匹配特征点,即外点。文中采用RANSAC[14-15]的方法去除误匹配点,再利用最小二乘法求解出较更为准确的参数值。

2 目标检测

背景精确匹配后,动态背景下运动目标的检测可近似为摄影机固定下连续图像序列的动目标检测,文中采用三帧间差分的方法消除背景,并通过假设检验及密集度检测的方法消除背景中的干扰噪声点以确定动目标区域,最后通过边缘检测与目标区域相“与”实现动目标的最终检测。

2.1 三帧差法算法

三帧差分法能突出动目标的位置和轮廓信息,但由于摄影机随车抖动,光线及背景纹理变化等影响,差分后的背景图像仍存在噪声像素干扰,为此对差分图像进行形态学处理后,采用假设检验及密集度检测方法消除背景中的干扰噪声点以确定动目标区域。

2.2 运动目标区域检测

帧差后的图像噪声灰度im服从的高斯正态分布[16],取H0表示无运动目标区域的背景噪声,而备择假设H1则表示运动目标区域,根据3σ法则,当像素灰度在H0假设下时,其位于区间[-3σ,3σ]的概率小于 3‰,因此,以 c·3σ 为阈值,则有如下判断

其中,方差σ按下式计算

式中,Sk为第k帧帧差图像中无运动目标的背景区域,其选择对干扰像素的剔除影响较大,dm为Sk中像素灰度值,N为Sk中的像素数。M表示取连续M帧图像的平均值。

由于在采集的行车图像中,目标出现位置的概率相等,因而,固定选择图像中动目标出现概率较低的某些固定区域作为Sk[18]并不准确,为此结合图像配准过程,文中采用配准特征点对作为种子点,以其领域组成背景区Sk,计算σ。由于配准特征点对多分布在背景区域,因而以配准点邻域并集作为Sk可以较准确地估计σ2。

2.3 运动目标检测分割

运动目标区域中既有目标也包含部分的背景区域,为此,文中采用边缘检测与目标区域相“与”的方法精确确定目标最终区域。

首先对单帧图像进行边缘检测,得到既有运动目标的边缘也有背景物体的边缘图像,边缘像素值为1,非边缘像素值为0;然后将运动目标区域像素值设置为1,非运动目标区域像素值设置为0;将两图像对应像素相乘,则目标边缘被保留。通过一定的形态学运算,对相乘后的结果图像进行连接填充,则得到完整的运动目标。

3 实验验证

为了验证算法的有效性,在NVIDIA的Jetson TX2嵌入式智能平台(6核Tegra Parker处理器、256个CUDA、8GB LPDDR4内存)上利用OpenCV3.2库和Python进行实验,实验中,特征点配准图像分块大小为45个像素宽度,假设检验阈值c=1.1,M=10,窗口大小为5个像素。

3.1 算法性能对比实验

使用3种动态目标检测方法进行对比实验,方法1为传统的SIFT方法;方法2采用本文改进SIFT方法,但仅使用文献[18]中背景噪声干扰消除方法,文献[18]中计算σ时Sk取固定区域;方法3为本文方法。如图2所示,为简单背景和复杂背景下动态目标检测结果,图中红色标记的为文中算法检测目标区域,绿色标记的为方法1检测目标区域。可以看出,文中算法尽可能检测到运动目标的完整区域,消除背景干扰的影响,这主要是因为文中算法采用图像分块的方法,使得特征点分布较均匀,避免特征点集中对匹配参数整体造成偏差。从第二幅图检测结果看,当目标位于图像边缘位置时,文中方法则通过准确计算Sk区域,避免边缘位置目标漏检情况。从全部实验可以看出,在不同背景和目标分布情况下,本文算法都取得较好的动态目标检测结果。

3.2 算法运行效率对比实验

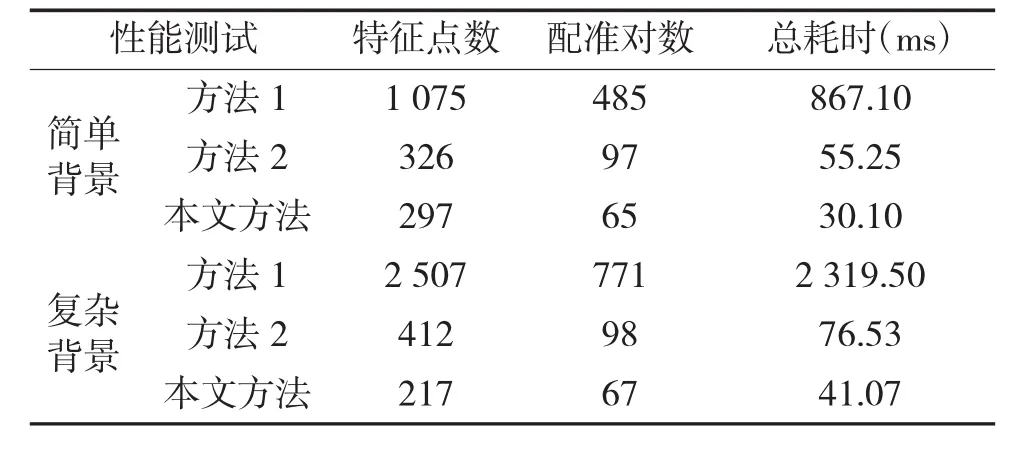

为测试算法的运行效率,仍取简单背景和复杂背景两组序列图像(降分辨率为1 024×768),实验时对每幅图像检测结果取50次运算平均值,3种算法实验结果如表1所示。

表1 对比实验目标检测结果

从表中特征点配准对数可以看出,本文方法通过影像金字塔对分辨率控制和图像分块策略对配准对数的约束,在不同背景下,算法取得的特征点数目和点对相对较稳定,从而确保算法运算耗时较为稳定,保证算法取得鲁棒的运行效率;同时配信点对数控制及相邻帧待配点位置估计又极大减少了算法的运行时间。从实验结果看,在25帧/s的图像采集帧率下,算法满足行车状态实时检测动目标的速率要求。

4 结论

为解决行车辅助驾驶系统动态目标检测时面临的复杂多变背景和系统的实时性要求,提出一种基于改进SIFT算子和改进三帧差分方法的动态目标实时检测算法,算法通过图像多分辨率控制和分块约束,约束配准点对数及分布,提高了全局背景补偿参数的估计速度和精度;通过改进背景区域选择方式,提高动态障碍物区域检测准确性,进而借助密集判断和动目标区域与边缘检测相“与”实现动态目标的快速高效检测。对比实验结果验证算法的有效性,满足系统对算法实时性要求。

参考文献:

[1]游安清,程义民.基于背景运动补偿的红外运动分析[J].强激光与粒子束,2003,15(5):431-434.

[2]李强,张钹.一种基于图像灰度的快速匹配算法[J].软件学报,2006,17(2):216-222.

[3]施家栋,王建中.动态场景中运动目标检测与跟踪[J].北京理工大学学报,2009,29(10):858-891.

[4]朱志文,沈占锋,骆剑承.改进SIFT点特征的并行遥感影像配准[J].遥感学报,2011,15(5):1024-1039.

[5]闸旋,王慧,程挺,等.一种基于分块策略的SIFT特征快速提取与匹配方法[J].测绘科学技术学报,2014,31(5):505-509.

[6]姚国标,邓喀中,艾海滨,等.倾斜立体影像自动准稠密匹配与三给重建算法[J].武汉大学学报(信息科学版),2014,39(7):843-849.

[7]肖雄武,郭丙轩,李德仁,等.一种具有仿射不变性的倾斜影像快速匹配方法 [J].测绘学报,2015,44(4):414-421.

[8]MORTENSEN E N,DENG H L,SHAPIRO L.A SIFT descriptor with global context[C]//Proc.Of CVPR'05.San Diego,California,USA:IEEE Press,2005.

[9]LOWE D G.Object recognition from local scale-invariant features [C]//IEEE Proceedings of the International Conference on Computer Vision,1999.

[10]LOWE D G.Distinctive image features from scale-invariant key points [J].The International Journal of Computer Vision,2004,60(2):91-110.

[11]MIKOLAJCZYK K,SCHMID C.A performance evaluation of local descriptors [J].IEEE Trans.Pattern Anal.Mach.Intell.,2005(13):1615-1630.

[12]KUMAR P,HENIKOFF S.Predicting the effects of coding non-synonymous variants on protein function using the SIFT algorithm [J].Nature Protocols,2009,4(7):1073-1081.

[13]刘佳,傅卫平,王雯,等.基于改进SIFT算法的图像匹配[J].仪器仪表学报,2013,34(5):1107-1112.

[14]曲天伟,安波,陈桂兰.改进的RANSAC算法在图像配准中的应用[J].计算机应用,2010,30(7):1849-1851.

[15]郭红玉,王鉴.一种基于RANSAC基本矩阵估计的图像匹配方法[J].红外,2008,29(2):5-8.

[16]赖作镁,王敬儒,张启衡.背景运动补偿和假设检验的目标检测算法[J].光学精密工程,2007,15(1):112-116.

[17]GAO T,LI G,LIAN S,et al.Tracking video objects with deature points-based particle filtering [J].Multimedia Tools Applications,2012,58(1):1-21.

[18]梅跃松,于剑桥,陈曦.移动背景下的运动目标跟踪[J].红外与激光工程,2011,40(4):757-761.