基于多尺度多特征的显著性区域检测

侯向丹 ,刘晓曼 ,刘洪普 ,连 珂

(1.河北工业大学 计算机科学与软件学院,天津 300401;2.河北省大数据计算重点实验室,天津 300401)

图像的显著性区域检测,是模拟人眼的视觉注意选择机制,进而提取图像中的感兴趣区域[1].所以,显著性检测在计算机视觉领域有着非常重要的地位,在图像分割、目标识别以及图像检索[2-4]等图像处理技术中都应用颇多.

目前的显著性区域检测方法大致可以分为两类.一种是自下而上的方法,采用底层的图像特征引导,从而提取出显著性区域.其中较为经典的当属ITTI模型[5],利用不同特征以及中央-周边差方法提取显著性区域.Achanta等[6]利用Lab空间特征的中央-周边差算子计算得到显著性区域.Cheng等[7]提出基于全局对比度的显著性检测方法.还有Guo等[8]利用四元相位谱方法提取显著性区域.另一种是自上而下的方法,基于具体的任务或者目标来进行显著性计算,Tong等[9]利用图像特征得到显著图,进而通过构造的强分类器自上而下得到最终显著图.另外,将自下而上与自上而下这两类方法结合起来进行显著性检测的算法也有很多.

1 结合多尺度多特征的显著性检测

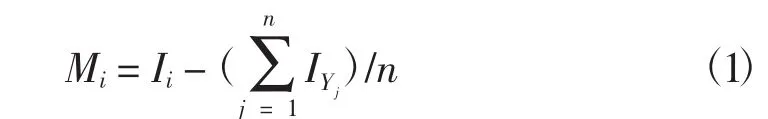

Achanta等[6]提出的FT算法流程图如图1所示,它首先进行颜色空间转换后通过高斯差分滤波作预处理,之后分别计算像素点的Lab特征和图像的Lab空间平均特征向量,将它们的欧氏距离作为其显著性值,最终生成显著图.该算法的求解过程非常简单,运算量小,但是从结果来看,该算法得到的显著性区域与非显著区域亮度差异并不明显[10],所以本文提出基于多尺度多特征的显著性区域检测算法,从而增强了显著性区域的提取效果.

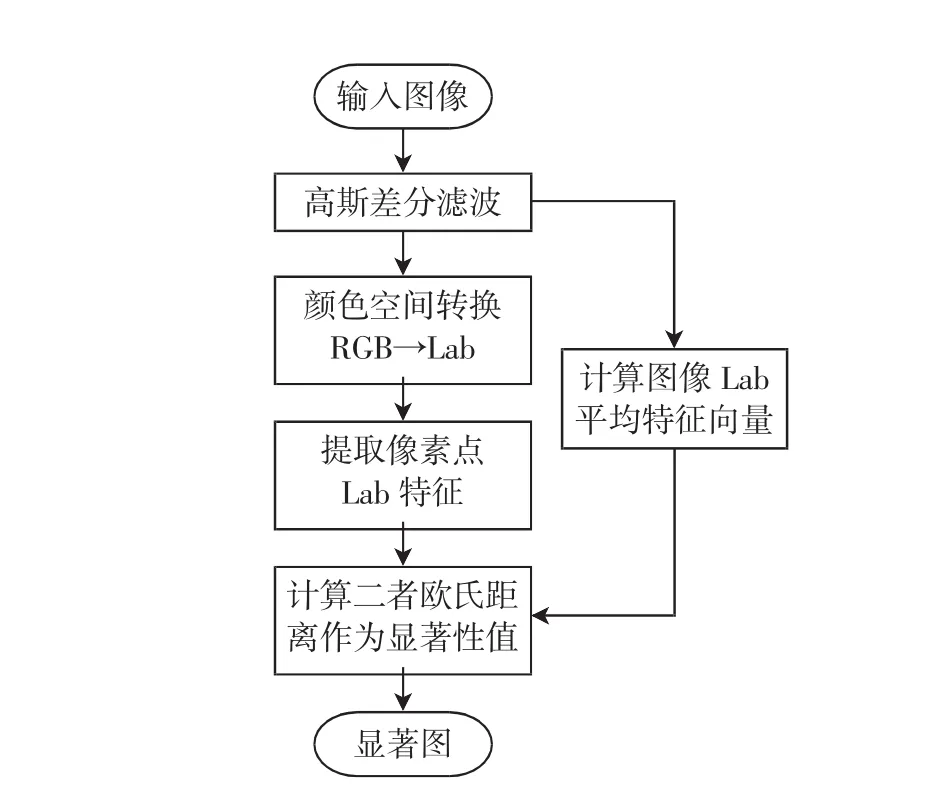

本文提出的基于多尺度多特征的显著性区域检测算法,主要是在FT算法的基础上在两个方面进行了改进.1)为突出特征点同时能更好地计算颜色特征差异,通过计算像素点在八邻域区域内的亮度差异以及和背景的颜色差异,将不同尺度得到的显著值融合生成融合特征显著图S1.2)为使显著性区域轮廓更清晰以及充分融合图像的多特征,采用基于熵率的超像素分割方法将图像分割成超像素块,在此基础上提取超像素的亮度特征、颜色特征、纹理特征,然后采用线性回归方法,学习得到简单的超像素显著度模型,融合超像素的多特征计算得到超像素特征显著图S2.最后,将融合特征显著图S1和超像素特征显著图S2结合得到最终显著图S,本文算法流程图如图2所示.

1.1 融合特征显著图

利用局部自动阈值选取方法在像素点的八邻域中筛选出与之亮度值之差大于T的n个点,用Yj(j=1,…,n) 表示,随之求得一个优化的八邻域亮度平均值,然后计算其与像素点亮度的差值,这样做增加了像素点在八邻域中的显著度.像素点的八邻域特征显著度计算为

式中:Mi为像素点的八邻域特征显著度;Ii为像素点的亮度.

另外,对于颜色空间,选择Lab空间进行计算,首先利用简单的阈值分割将图像大致分为两个区域——背景和前景,然后计算每一个像素点与背景的颜色差异,依据人眼对色彩刺激的感知特性,采用CMC色差来表示.人眼对颜色刺激的心理感知属性可以分为明度L,彩度Cab,以及色调角hab.其中明度对应Lab空间的亮度L,彩度Cab和色调角hab分别对应颜色空间颜色的色品坐标(a,b)和原点的距离和斜率.计算公式为

图1 FT算法流程图Fig.1 The flow chart of FT

图2 本文算法流程图Fig.2 The flow chart of the algorithm in this paper

CMC色差公式是由Clarke等[11]在1984年提出的,改进了JPC79在中性色和深色的目视效果和计算值之间的差值较大的缺陷,视觉一致性较好,被许多国家和组织广泛使用.计算方法为

式中:△ECMC为像素点与背景的颜色差异;SL、SC、SH为权重函数.

式中:Lstd,Cab,std,hab,std为标准色样的色度参数.

由此,计算像素点i的颜色显著度Ni,其中LABi为像素点的Lab特征,LABb背景的Lab特征

在图3所示原图基础上,将八邻域尺度的亮度差异显著度Mi和全局尺度的颜色差异显著度Ni叠加得到S1,至此,生成如图4所示的融合特征显著图S1.

图3 原图Fig.3 Original image

图4 融合特征显著图S1Fig.4 Saliency map of fusion features S1

1.2 超像素特征显著图

超像素是大的像素,可以看做是具有相似特征的像素的集合.采用Liu等[12]提出的一种基于熵率的超像素分割方法将原图分块,超像素分割结果如图5所示.这种方法用基于图论的思想来获取分割结果,即采用一个带权的无向图代替原图像,将原图像的每个像素当作无向图的一个结点,利用两个结点的相似性作为结点之间的权重,构造了一种图上随机游走的熵率和平衡项相结合的目标函数,通过迭代最大化该目标函数得到分割结果,熵率使分割的结果紧凑且具有区域一致性,平衡项使分割的结果形状规则且尺寸类似.由此,将原图像分割为具有不同特征的超像素块,以便进一步处理.

为了得到进一步的区域显著图,利用基于熵率的超像素分割结果,假设图像被分为n个超像素,分别提取每一个像素块的亮度特征SIi,颜色特征SCi,纹理特征STi,然后分别计算每一个像素块与其他像素块的亮度差异Li、色彩差异Si和纹理差异Wi,最终求得其显著度Hi.

式中:亮度差异为明度L的差异,颜色差异采用CMC

图5 超像素分割结果Fig.5 Super pixel segmentation results

色差计算,纹理差异则利用Gabor滤波器提取的不同尺度、不同方向的纹理特征来计算.

每个像素块的显著度为

式中:θi为各特征差异所占的权重,由线性回归方法学习得到.人为设定超像素的显著度作为输出结果,输入值为亮度差异Li,颜色差异Si和纹理差异Wi,θ1、θ2、θ3分别为它们的权重系数,θ0为平衡误差,由此学习得到一个简单的超像素显著度模型,根据线性回归所得结果计算样本的显著图.

最后,把结合超像素的多种特征计算得到的利用显著度表示的灰度图像作为超像素特征显著图S2,如图6所示.

最终将融合八邻域尺度的亮度差异和全局尺度的颜色差异得到的融合特征显著图S1和融合超像素多种特征计算得到的超像素特征显著图S2叠加,形成最终显著图S,如图7所示.

图6 超像素特征显著图S2Fig.6 Saliency map of super pixel features S2

图7 最终显著图SFig.7 Final saliency map S

2 实验结果及分析

为评价本文算法的性能指标和有效性,在MSRA-1000,ECSSD,THUR15K 3个公开数据集上与现有的8 种算法 FT[6],AC[13],IT[5],GB[14],AIM[15],SEG[16],SIM[17],SUN[18]进行了视觉对比及定量评价.实验均在2.6 GHz CPU、4 GB内存的个人计算机、Matlab2014a环境上实现.

在超像素块的参数n取5时,本文算法的效率最高.

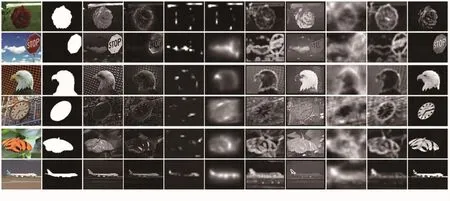

在3个数据集上对本文算法Ours与其他8种算法做了实验结果的视觉对比,如图8所示.对比图表明:IT模型的提取效果较差,检测的显著性区域面积较小、且较为分散;FT和AC模型所提取的显著性区域并不是非常明显,且存在误判的现象;GB和SIM这2种算法所检测出的结果较为模糊;由AIM、SEG和SUN这3种模型的结果可以看出,几种算法对于背景的弱化效果较差.而本文所提算法的结果能够有效弱化冗杂的背景,特别是在背景复杂的图像中,也能检测出图像中的显著性区域,显著性区域信息保留完整,得到的目标清晰,且边缘明显.

图8 本文算法与现有的8种算法对比Fig.8 Comparison between the algorithm in this paper and the existing eight algorithm

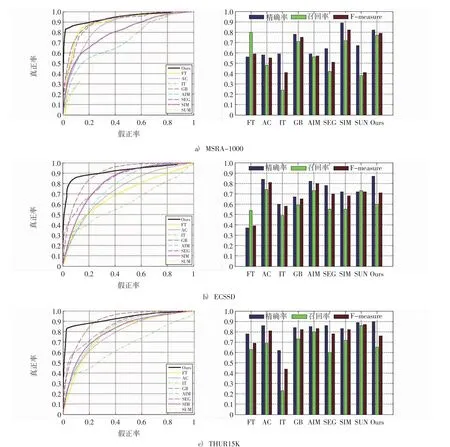

为进一步评价算法的性能指标,在3个数据集上对算法采用ROC曲线比较,以精确率P,召回率R,F-measure值3个指标进行评价,如图9所示.ROC曲线的横坐标表示在所有实际为阳性的样本中,被正确地判断为阳性的比率,纵坐标则表示在所有实际为阴性的样本中,被错误地判断为阳性的比率.精确率P是对于预测的结果来说的,表示预测为正的样本中本来是正样本的比例.召回率R是对于原样本来说的,表示原样本中的正样本中被预测为正样本的比例.F-measure值是精确率和召回率的调和均值:

图9 不同算法的ROC曲线比较Fig.9 Comparison of ROC curves of different algorithms

如图9所示,在3个数据集上的实验结果可以看出,本文算法在ECSSD和THUR15K这2个数据集上的结果,精确率都高于其他8种算法,但是召回率R和F值并无明显优势,在MSRA-1000数据集上的精确率和召回率稍逊于SIM算法,但优于其它7种算法.但从图8的视觉对比图来看,本文所提算法的显著性区域的提取结果比SIM算法更清晰、目标更突出.从ROC曲线对比结果来看,在MSRA-1000数据集上,本文算法的曲线明显覆盖面积大于其它曲线,在其余两个数据集上的结果,本文算法的曲线基本位于其它7种算法的上方,也更加靠近左上角,但与GB算法差距并不明显,不过从视觉对比图来看,GB算法提取出的显著性区域目标模糊,边界不清晰,在这一方面本文算法具有明显优势.综上所述,说明本文算法的性能要优于其他几种算法.

3 结束语

提出了一种基于多尺度多特征的显著性区域检测方法,充分考虑了图像不同尺度的因素,首先利用人眼的视觉注意规律,结合亮度差异和颜色差异计算得到不同尺度的融合特征显著图,其次在超像素分割的基础上,提取超像素的多特征,进一步计算出超像素特征显著图,最终将两部分进行结合得到最终显著图.在MSRA-1000,ECSSD,THUR15K 3个数据集上进行的实验表明此方法所得到的显著性区域轮廓清晰并且准确率和召回率都有一定程度的优势.

[1]Mancas M,Ferrera V P,Riche N,et al.From Human Attention to Computational Attention[M].New York:Springer,2016.

[2] Lempitsky V,Kohli P,Rother C,et al.Image segmentation with a bounding box prior[C]//IEEE,International Conference on Computer Vision.DBLP,2009:277-284.

[3] Fang Y,Chen Z,Lin W,et al.Saliency Detection in the compressed domain for adaptive image retargeting[J].IEEE Transactions on Image Processing A Publication of the IEEE Signal Processing Society,2012,21(9):3888-3901.

[4] Jian M W,Dong J Y,Ma J.Image retrieval using wavelet-based salient regions[J].Imaging Science Journal the,2015,59(4):219-231.

[5] Itti L,Koch C,Niebur E.A model of saliency-based visual attention for rapid scene analysis[J].IEEE Transactions on Pattern Analysis&Machine Intelligence,1998,20(11):1254-1259.

[6] Achanta R,Hemami S,Estrada F,et al.Frequency-tuned salient region detection[C]//Computer Vision and Pattern Recognition,IEEE,2009:1597-1604.

[7] Cheng M M,Mitra N J,Huang X,et al.Global contrast based salient region detection[J].IEEE Transactions on Pattern Analysis&Machine Intelligence,2015,37(3):569.

[8] Guo C L,Zhang L M.A novel muitiresolution spatiotemporal saliency detection model and its applications in image and video compression[J].IEEE Transactions on Image Processing,2010,19(1):185-198.

[9] Tong N,Lu H,Xiang R,et al.Salient object detection via bootstrap learning[C]//Computer Vision and Pattern Recognition.IEEE,2015:1884-1892.

[10]孙晓飞,潘文文,王霞.典型的图像显著性检测算法分析和比较[J].黔南民族师范学院学报,2014,34(5):100-105.

[11]Clarke F J J,Mcdonald R,Rigg B.Modification to the JPC79 Colour-difference Formula[J].Coloration Technology,1984,100(4):128-132.5.

[12]Liu M Y,Tuzel O,Ramalingam S,et al.Entropy rate superpixel segmentation[C]//Computer Vision and Pattern Recognition.IEEE,2011:2097-2104.

[13]Achanta R,Estrada F,Wils P,et al.Salient region detection and segmentation[C]//International Conference on Computer Vision Systems.Springer-Verlag,2008:66-75.

[14]Harel J,KochC,PeronaP.Graph-based visual saliency[C]//Advances in Neural Information Processing Systems.Cambridge,MA:MIT Press,2007:545-552.[DOI:10.1.1.70.2254]

[15]Bruce N D B,Rahman S,Carrier D.Sparse coding in early visual representation:From specific properties to general principles[J].Neurocomputing,2016,171:1085-1098.

[16]RahtuE,KannalaJ,SaloM,et al.Segmenting Salient Objects from Images and Videos[M].Computer Vision-ECCV 2010,Springer Berlin Heidelberg,2010:366-379.

[17]Murray N,Vanrell M,Otazu X,et al.Saliency estimation using a non-parametric low-level vision model[C]//Computer Vision and Pattern Recognition.IEEE,2011:433-440.

[18]Zhang L,Tong M H,Marks T K,et al.SUN:A Bayesian framework for saliency using natural statistics[J].Journal of Vision,2008,8(7):32,1-20.