自然光照下智能叶菜收获机作业参数的获取

伍渊远,尚 欣,张呈彬,谢新义

(宁夏大学 机械工程学院,宁夏 银川 750021)

自然光照下智能叶菜收获机作业参数的获取

伍渊远,尚 欣*,张呈彬,谢新义

(宁夏大学 机械工程学院,宁夏 银川 750021)

针对智能叶菜收获机作业过程中需自主获取导航参数与割台高度调整参数的问题,提出了利用机器视觉技术获取这两种作业参数的方法。首先对自主获取导航参数进行研究,将采集的叶菜田图像进行预处理、获取导航离散点,利用稳健回归法对离散点进行线性拟合进而获得导航控制参数,以便收获机调整作业方向;然后对于割台高度调节参数,将叶菜割茬图像预处理及割茬高度特征提取以获得割茬高度,利用割茬高度作为收获机割台高度调整的参数。结果表明,导航线准确识别率为97%,留茬高度的平均测量误差为8 mm,最大相对误差为11.9%。说明该方法在自然光照下,能有效获取作业方向参数和留茬高度,为无人驾驶式收获机的智能、精准作业提供了技术支持。

机器视觉;智能收获机;导航参数;割茬高度

随着信息技术、传感技术的发展应用,农业装备智能化已经成为未来发展的必然趋势[1-3]。叶菜收获机在其作业过程中对作业参数的自主获取技术是实现叶菜收获机智能化、无人化的关键,而叶菜收获机作业中导航参数与割台高度调整参数作为关键作业参数,直接影响到智能叶菜收获机的作业轨迹与收获质量,故对叶菜收获机自动获取导航参数与割台高度调整参数的研究对实现叶菜收获机的完全智能化具有重要意义。智能农业装备导航研究主要集中在GPS导航和机器视觉这两种方式[4-5]。GPS导航虽可进行大范围的路径规划,但其抗干扰能力弱,基于机器视觉的导航技术提供的相对坐标使导航更加灵活[6-8]。因此,利用机器视觉获取导航参数已有不少研究,但其运用于实践时仍存在实时性、稳定性差的问题。同时,随着近年来精准农业的兴起,机器视觉系统在提供导航信息的同时还能搜集更多有关作物的信息,如:作物形态结构参数、病虫害信息的获取等,因此能为精准农业的实施和农业装备完全智能化提供更可靠的支撑[9]。故机器视觉技术能为叶菜收获机自主获取更多作业参数提供解决途径,通过机器视觉识别叶菜收获作业中割茬高度用以控制割台高度调整是实现智能叶菜收获机自动获取割台高度调整参数的有效手段。虽已有国内外学者利用机器视觉技术对核桃、马铃薯、结球甘蓝等农产品的形态特征检测方法进行了研究,但检测目的还局限于实现农产品品质外形检测及分类分级上[10-14],对采用机器视觉技术实时检测收获作业中作物割茬高度用以实现叶菜收获机及时自动调整割台的研究还未见报道。针对上述问题,本文利用机器视觉技术着重对叶菜收获机自主获取导航参数与割茬高度参数的算法开展研究,提出一种准确、稳健、快速的算法以满足叶菜收获机自主作业实时性要求,并依此设计一种切割装置高度控制系统。

1 导航参数的获取

首先对作物图像进行预处理得到二值图像,然后将其划分为若干个水平图像条并选取目标窗口,分别对每图像条进行垂直投影确定作物行中心得到导航离散点,使用稳健回归法对导航离散点进行线性拟合获得导航参数,如图1所示。

1.1 图像预处理

对图像的预处理有着非常重要的作用,预处理阶段得到的图像的质量高低直接影响到后续对图像特征提取的效果好坏,这也是图像处理中的一个难题。

1.1.1 图像灰度化

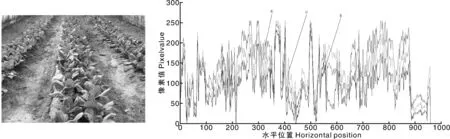

将叶菜田间采集到的图像分析发现作物的颜色呈绿色,而土壤表现为非绿色,如图2所示。对田间图像特征分析发现,作物的绿(G)颜色分量较高,土壤背景的红(R)分量较高,田间彩色图像中水平线剖面的红(R)、绿(G)、蓝(B)颜色分量如图1所示。因此,为了突出作物图像中的绿色分量值、抑制背景,常用图像灰度化方法为超绿色法[15-16],如图3所示。

1.1.2 图像阈值分割

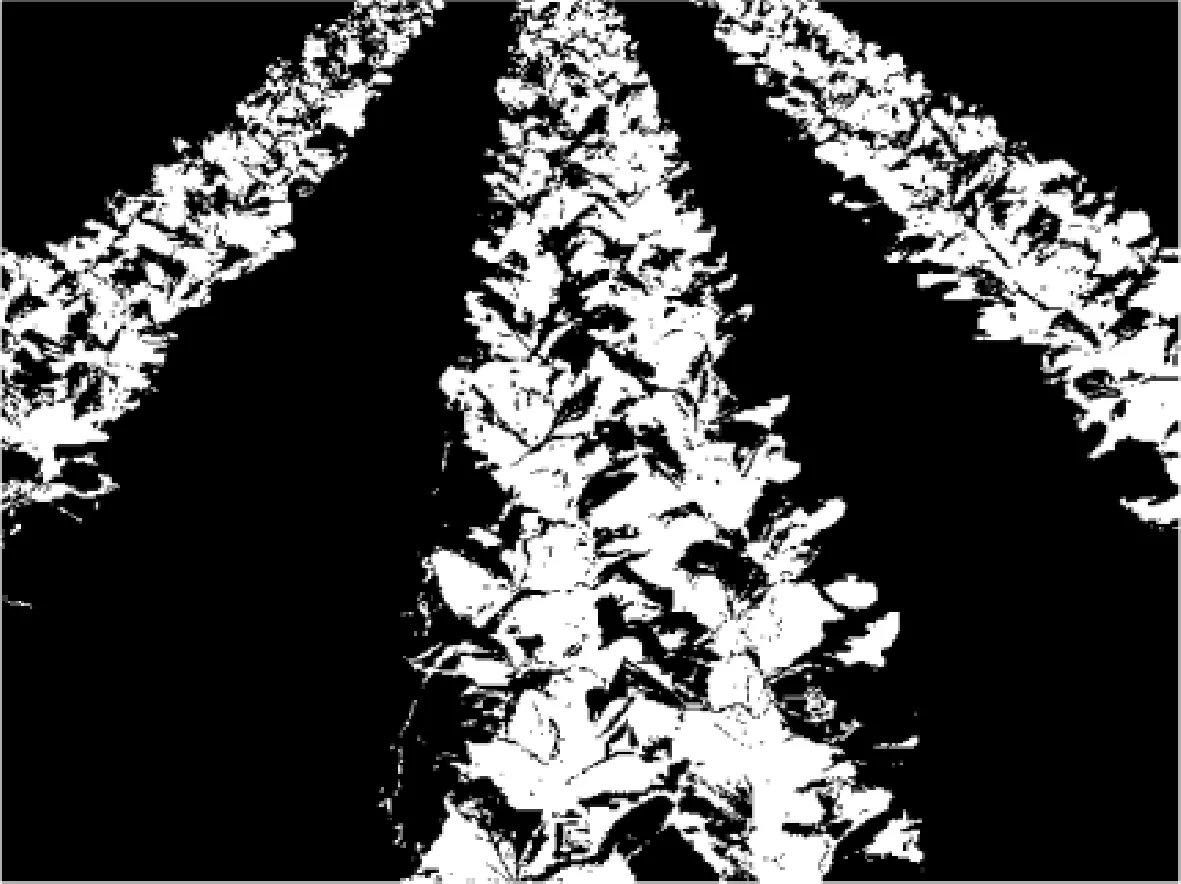

在将彩色图像转换为灰度图像后,需要对其进行分割以便提取图像中目标。目前研究中常用分割方法有:最大类间方差法(Otsu法)、动态阈值法、K-Means算法等。Otsu算法计算简单、稳定有效,能使用于图像特点与质量相异的场合;动态阈值分割法利用子区域独立分割的思想,对小区域分割效果很好且适用于光照不均匀的图像,但是不太适用于对实时性要求较高的图像处理中[17];K-Means具有一定的自适应性,且不受噪声与局部边缘变化的影响,但该算法易受聚类中心的数目以及初始类中心的影响。综合分析研究采用Otsu算法,实现图像分割阈值的自动获取,图像分割得到的二值图中土壤背景与作物区分明显,如图4所示。

图1 导航参数获取算法流程图Fig.1 Flow chart of navigation parameter acquisition algorithm

图2 田间图像与水平线剖面颜色信息Fig.2 Color information of the field image

图3 田间灰度图像Fig.3 Gray image of the field

1.1.3 二值图像除噪处理

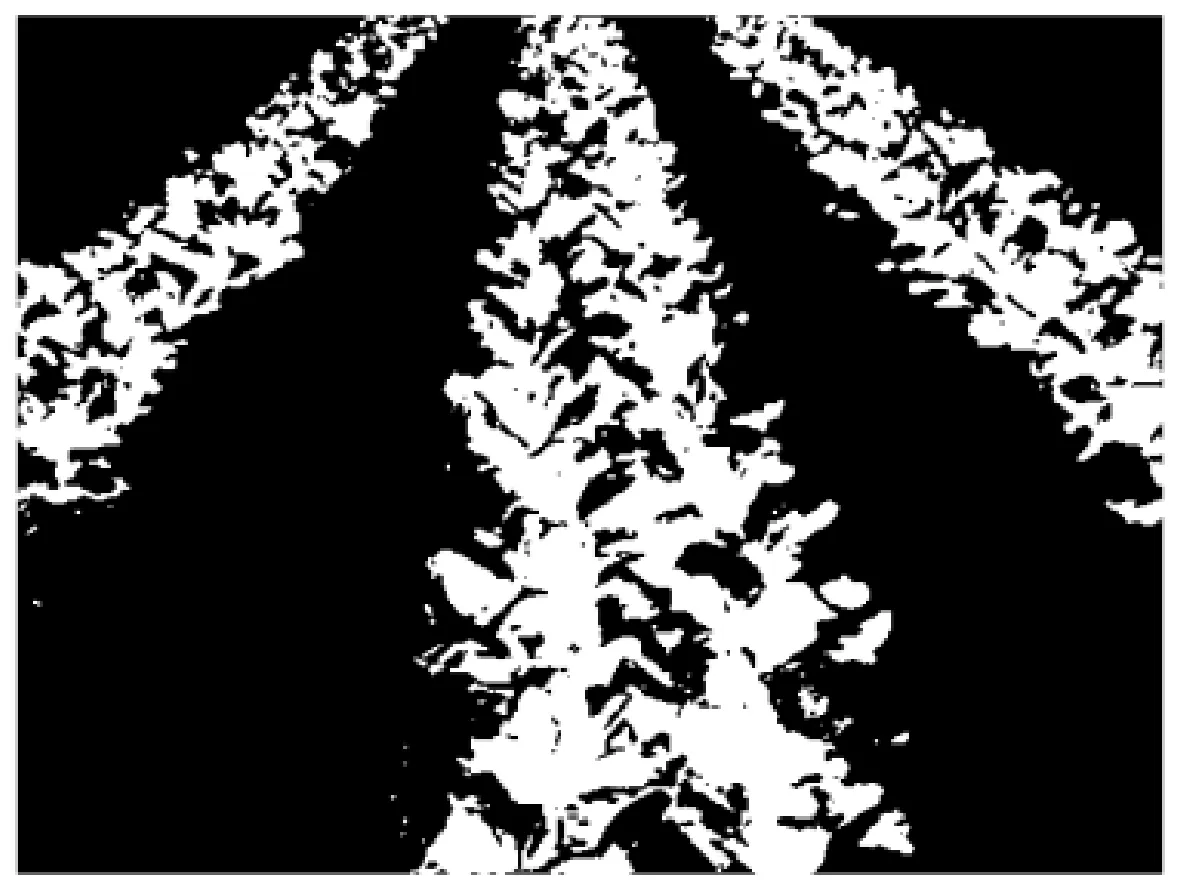

由于田间杂草、枯叶、光线等影响,采集到的图像质量往往不够高,如图4所示,得到的二值图像噪声较多。文中采用5×5的窗口进行中值滤波去除其噪声,处理后图像噪点明显减少,结果如图5所示。

图4 田间图像分割结果Fig.4 Results of field image segmentation

图5 中值滤波图像Fig.5 Median filter image

1.2 导航路径识别

1.2.1 获取导航离散点

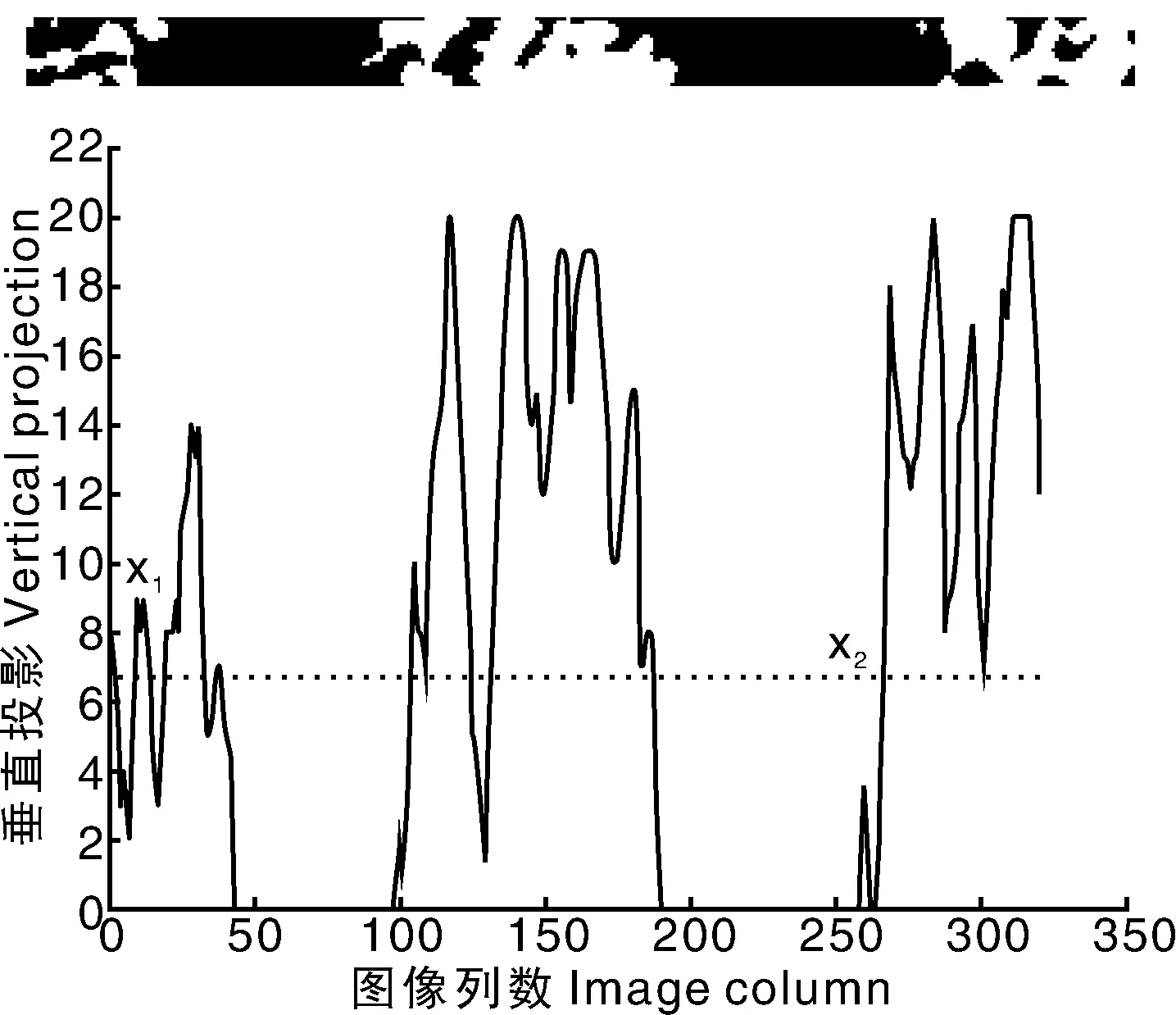

在叶菜大规模种植中作物行通常呈直线状,行与行间几乎呈平行关系,且作物行之间距离基本相等。由于摄像机安装在智能收获机的正中间,因此可利用采集到的图像中间的作物行的一组中间点作为导航离散点。采集到的图像中作物行在远方有收敛趋势,故将图像水平划分为若干等高度的图像条后理想状态下每一图像条上必然有作物存在。之后对每一图像条进行垂直投影,得到相应的垂直投影曲线[18]。计算每一图像条的白色像素均值,由其均值分别判断最左边作物行的左边缘点和最右边作物行的右边缘点,求出左边缘点与右边缘点的中间点即为作物行的中心点。本方法具体实现过程如下:

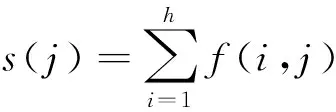

设图像高为H,宽为B。由于采集到的图像的中间总是存在作物行,因此选取图像中心1/3区域为处理窗口,处理区图像宽度为l(l=B/3),如图6所示。此处理方法可以避免由于采集到的图像中出现作物行不对称导致导航线提取时出现较大误差的情况。将目标窗口图像等距水平划分为若干大小为l×h的图像条。f(i,j)为图像条上(i,j)处的灰度值,s(j)为图像条上第j列垂直投影后得到的投影值,m为图像条中所有投影值的平均值。计算公式为:

(1)

(2)

式中:i=1,2,3,…,h;j=1,2,3,…,l。

1)图像条划分取h=20(单位为像素),即划分为l×20的若干图像条,如图7所示。

2)对每图像条窗口从左到右逐列扫描,求出每列中白色像素个数s(j),并计算出各图像条平均值m,如图7。

图6 目标窗口Fig.6 Objective window

图7 第1行图像条及其垂直投影Fig.7 Strip of image and its vertical projection curve

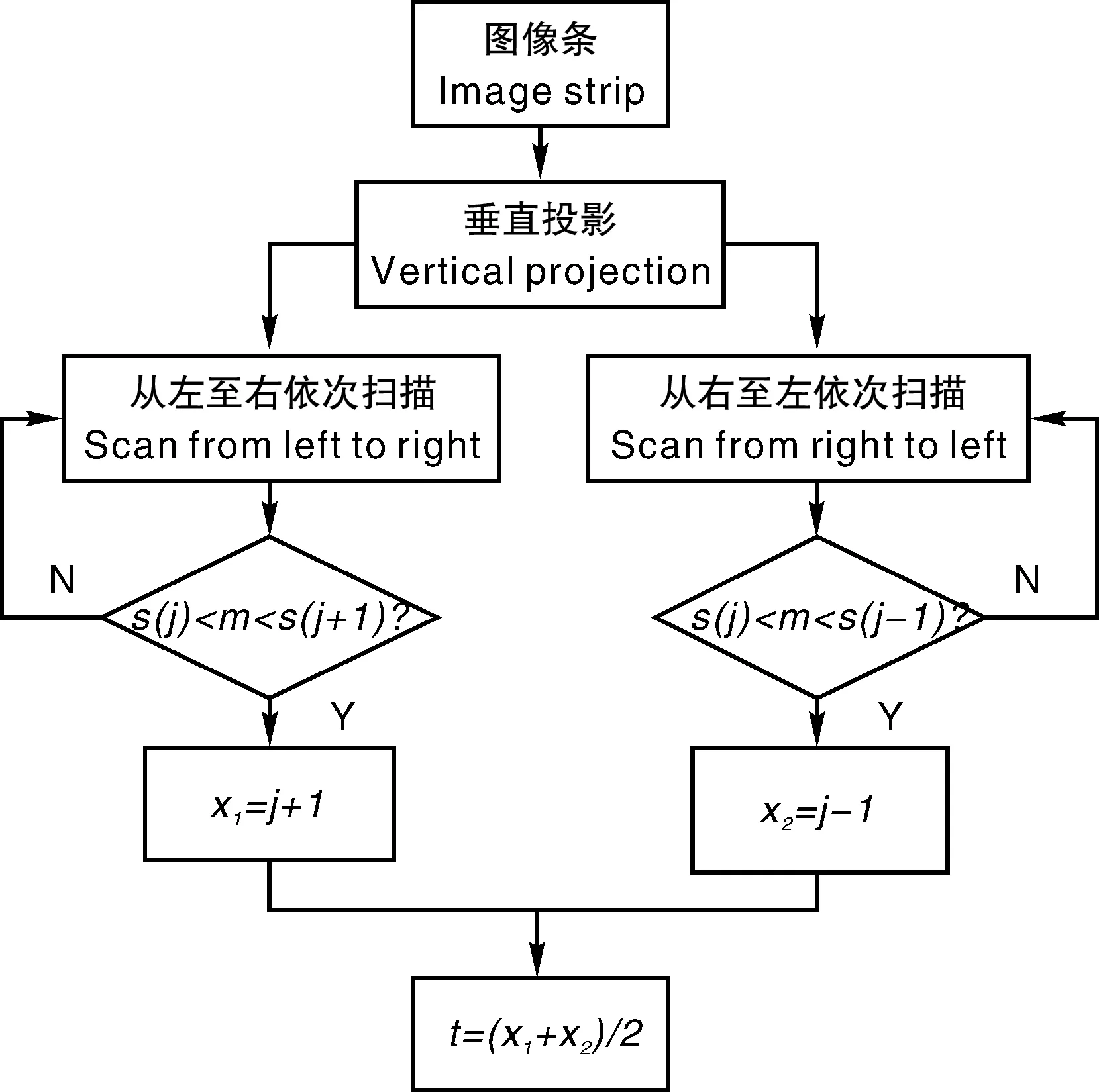

3)对各图像条s(j)分别先从左至右扫描,求处理窗口作物行左边缘点,然后从右至左扫描求得作物行右边缘点。实现方法为:从左至右依次判断若s(j) 4)分别对每图像条求中间点位置t,方法为:t=(x1+x2)/2,t即为每一图像条的导航离散点位置,导航离散点获取算法流程见图8。 1.2.2 获取导航线参数 在获取导航路径时研究中常用:最小二乘法、Hough变换等。综合分析,实验采用回归系数较好,模式较稳定,拟合效果较理想的稳健回归法对导航离散点拟合得到导航参数。 1.3 导航控制参数计算 通过获得的导航线参数可以得到所需的导航控制参数。导航控制参数主要包含实际导航路线与智能收获机轴线的侧向位移偏差和角度偏差[19]。基于单目机器视觉智能收获机的路径信息与导航控制参数信息转换示意图如图9所示。 图8 导航离散点获取算法流程图Fig.8 Flow chart of navigation discrete point acquisition algorithm 图9 位移偏差与角度偏差示意图Fig.9 Schematic diagram of displacement deviation and angular deviation 如图9中,原点O为摄像机中心点,y轴为智能收获机轴线方向,虚线为得到的导航路径,L为智能收获机轴线与导航路径的位移偏差,α为导航路径与收获机的角度偏差。根据摄像机坐标系与图像坐标系关系及小孔成像原理,可将图像坐标系中的L和α转换到世界坐标系相应参考路径的L′和α′。转换公式如下: (3) (4) 式中:k1、k2为摄像机内部参数,可通过摄像机标定获得;β为摄像机倾角;X0为图像坐标系中导航路径与x轴的交点。据此公式便可由图像坐标系中导航路径得到世界坐标系中的导航参数。 在叶菜收获机作业过程中,由于地形、叶菜品种等因素的影响,会导致叶菜收获的割茬出现不同的高度,甚至出现不符合收获要求的割茬,因此就要求智能叶菜收获机能有根据割台高度调整参数自动调整割台的功能。文中对割台高度调整参数的获取研究,是利用机器视觉技术对叶菜收获过程中的割茬进行高度特征提取,将获取的割茬高度通过相应的转换作为割台高度调整参数传送给割台调整系统。故文中研究重点是机器视觉对割茬高度的获取。 2.1 割茬高度检测系统设计 对于不同种类叶菜作物,收获机收割后其留茬高度基本是不同的。因此综合考虑检测精度和经济效益,设计出一种基于视觉识别的收获机割台高度智能控制系统,如图10。其中CCD相机负责采集待测作物图像,并将采集到的图像信号转换成数字信号传输到计算机中。计算机对输入的信号进行处理、运算输出割台位移信号h0,经过指令电位器后变为电压信号u,同时割台位移信号h经过反馈电位器得到反馈电压u′,则由桥式电路将偏差电压信号u″=u-u′算出,当u″为零时工作台不发生移动。当计算机发出新的指令时,指令位移信号实际需要调整的距离信号h0与割台位移信号h会产生偏差电压信号u″,此偏差信号被转化成不同占空比的PWM信号,经PWM放大器的功率放大后,控制电磁阀开度,由输出流量去控制切割装置移动,直到u″信号为零时,切割装置停止运动。其控制原理图如图11所示。 高度计算公式为: H=H0-H1。 (5) 其中H1=n×l,对得到的预处理图像从上向下进行逐行扫描,得出第一行有像素为1的行,确定此行数值n;l为每个像素代表的实际尺寸长度,由标定得到;H0为图像高度,由于是定焦距拍摄目标,所以H0可通过标定得到。 2.2 系统标定 为确定测量系统中每一个像素代表的目标尺寸大小,需对测量系统标定。首先在白板上标出横纵坐标轴,每点坐标间距为10 mm,然后将白板贴在平整的墙上,使x、y轴分别平行于地面和铅垂线;固定好的摄像头要求其镜头中心与板上坐标轴中心在同一高度,且垂直于平板所在平面,需保证平面到摄像头前段距离为固定值W=305 mm,调整焦距使图像清晰,并固定焦距不变;然后采集图像,经过计算便可求出每个像素垂直方向代表实际尺寸为:l=0.63 mm。 1, 待测作物; 2,CCD相机;3,计算机;4,电位器;5,收获机切割装置1, Tested crop;2,CCD camera;3, Computer;4,Potentiometer;5,Harvester cutting device图10 智能控制系统示意图Fig.10 Schematic diagram of intelligent control system 图11 割台高度控制系统原理图Fig.11 Schematic diagram of cutting height control system 2.3 割茬图像处理 利用标定好的高度测量系统对割茬高度图像进行采集。然后对采集到的割茬图像进行预处理,以达到对图像分割和背景去除,如图12所示。对割茬图像预处理采用2 GRB颜色特征将其进行灰度化,利用Otsu 法将灰度图像二值化,并运用中值滤波对二值图像处理去除噪声。为了准确计算割茬形态结构参数,在图像分割完成后,必须完全去除背景,所以文中在采用3×3单位矩阵对二值图像进行一次腐蚀处理。最终分割图像如图12所示。图像中的残留背景被有效去除,得到的图像效果较好,割茬目标形状变化不大。然后对得到的分割图像从上向下依次扫描,得出第一行有像素为1的行,确定此行为n。 图12 留茬原图像及预处理图像Fig.12 Original image and preprocessed image 图像处理由PC机完成,配置为:CPU主频率2.3 GHz,内存4 GB。采用MATLAB R2014a仿真。 3.1 导航路径获取实验 为了验证算法的通用性和合理性,于宁夏大学贺兰试验基地随机采集了30张不同时间段的叶菜田间图像来验证,图像尺寸为960×720。图像处理依次按照所述的图像预处理、划分目标窗口及图像条、获取导航离散点、稳健回归拟合导航线,试验结果表明,97%的图像都可以检测出导航线来,每一条导航线都代表作物行中心线,整个过程平均耗时为0.26 s,实验结果如图13所示。 3.2 高度识别实验 在自然光照下,于银川市西夏区分别模拟大白菜、油麦菜、结球甘蓝被收割后的不同留茬高度场景,利用标定好的测量系统,对每一场景下的叶菜高度进行了试验。首先将大白菜、油麦菜、结球甘蓝分别分为A组、B组、C组。分别对每一组的作物模拟随机截取三个不同高度的留茬。对A组三个不同高度的留茬依次编号为:A1、A2、A3;对B组三个不同高度的留茬依次编号为:B1、B2、B3;对C组三个不同高度的留茬依次编号为:C1、C2、C3。然后利用刻度尺人工测量出每组作物留茬高度实际值,再使用标定好的测量系统对其进行图像采集、处理、高度运算,分别进行3次,取平均值,部分割茬图像处理结果见图14所示。两种方法进行对比,结果如表1所示。对高度测量的评价方法采用相对误差来衡量。由表1可以看出,视觉系统检测到的作物留茬高度比其真实高度要小。综合分析可知,造成此情况是因为在图像预处理阶段对图像的腐蚀处理去掉了作物的部分边缘轮廓,且在人工测量的过程中不可避免的人为误差和系统误差都会造成上述情况出现。 图13 导航线提取结果Fig.13 Image results 图14 预处理结果Fig.14 Pretreatment result 表1高度测量结果对比 Table1Comparison of height measurement results 测量方法Measuringmethod编号NumberA1A2A3B1B2B3C1C2C3人工测量Manualmeasurement/cm26.517.611.328.219.615.116.011.06.0视觉测量Systemmeasurement/cm26.416.611.626.917.913.315.411.26.6测量误差Measurementerror/cm0.11.00.31.31.71.80.60.20.6相对误差Relativeerror/%0.385.682.654.618.6711.923.751.8210.00 1)获取导航参数算法,利用划分若干图像条的方法进行垂直投影获取导航离散点然后稳健回归得到导航参数稳定有效。 2)对留茬高度获取时,对系统标定过程中产生的误差会严重影响到系统后续对割茬高度测量的准确性,同时在利用视觉测量过程中人为因素导致的不确定性对视觉系统的影响也较大。后续研究中可集中在降低外界因素对视觉测量系统的不利影响上。由系统测量得到留茬高度后便可根据实际情况调整收获机工作台到合适收割高度。 3)试验结果表明,导航线提取过程平均耗时为0.26 s,导航线准确识别率为97%,留茬高度识别平均测量误差为8 mm,最大相对误差为11.9%,基本满足智能叶菜收获机自主作业要求,为研究无人驾驶式叶菜智能收获机提供了视觉基础。 [1] 周济. 智能制造——“中国制造2025”的主攻方向[J]. 中国机械工程, 2015,26(17):2273-2284. ZHOU J. Intelligent mannfacturing-Main direction of “Made in China 2025”[J].ChinaMechanicalEngineering, 2015,26(17):2273-2284. (in Chinese with English abstract) [2] 罗维. 国务院印发《中国制造2025》全面推进制造强国战略[J]. 上海金属, 2015(4):69. LUO W. The State Council issued the “made in China 2025” comprehensively promote the manufacturing strategy[J].ShanghaiMetals, 2015(4):69. (in Chinese) [3] 王俊,杜冬冬,胡金冰,等. 蔬菜机械化收获技术及其发展[J]. 农业机械学报, 2014, 45(2):81-87. WANG J, DU D D, HU J B, et al. Vegetable mechanized harvesting technology and its development[J].TransactionsoftheChineseSocietyforAgriculturalMachinery, 2014, 45(2):81-87. (in Chinese with English abstract) [4] CHEN B, TOJO S, WATANABE K. Machine vision for a micro weeding robot in a paddy field[J].BiosystemsEngineering, 2003, 85(4):393-404. [5] 陈艳,张漫,马文强,等. 基于GPS和机器视觉的组合导航定位方法[J]. 农业工程学报, 2011, 27(3):126-130. CHEN Y, ZHANG M, MA W Q, et al. Positioning method of integrated navigation based on GPS and machine vision[J].TransactionsoftheChineseSocietyofAgriculturalEngineering, 2011, 27(3): 126-130. (in Chinese with English abstract) [6] 胡静涛,高雷,白晓平,等. 农业机械自动导航技术研究进展[J]. 农业工程学报, 2015, 31(10):1-10. HU J T, GAO L, BAI X P, et al. Review of research on automatic guidance of agricultural vehicles[J].TransactionsoftheChineseSocietyofAgriculturalEngineering, 2015, 31(10): 1-10. (in Chinese with English abstract) [7] 刘阳,高国琴. 农业机械视觉导航基准线识别研究进展[J]. 农机化研究, 2015(5):7-13. LIU Y, GAO G Q. Research development of vision-based guidance directrix recognition for agriculture vehicles[J].JournalofAgriculturalMechanizationResearch, 2015(5):7-13. (in Chinese with English abstract) [8] 孟庆宽,何洁,仇瑞承,等. 基于机器视觉的自然环境下作物行识别与导航线提取[J]. 光学学报, 2014(7):172-178. MENG Q K, HE J, QIU R C, et al. Crop recognition and navigation line detection in natural environment based on machine vision[J].ActaOpticaSinica, 2014(7):172-178. (in Chinese with English abstract) [9] 刁智华,王会丹,魏伟. 机器视觉在农业生产中的应用研究[J]. 农机化研究, 2014(3):206-211. DIAO Z H, WANG H D, WEI W. Summary of research on machine vision application in agricultural production[J].JournalofAgriculturalMechanizationResearch, 2014(3):206-211. (in Chinese with English abstract) [10] 刘建军,姚立健,彭樟林. 基于机器视觉的山核桃等级检测技术[J]. 浙江农业学报, 2010, 22(6):854-858. LIU J J, YAO L J, PENG Z L. Detection technique for cathay hickory grade based on machine vision[J].ActaAgriculturaeZhejiangensis, 2010, 22(6):854-858. (in Chinese with English abstract) [11] AL OHALI Y. Computer vision based date fruit grading system: Design and implementation[J].JournalofKingSaudUniversity-ComputerandInformationSciences, 2011, 23(1):29-36. [12] ELMASRY G, CUBERO S, MOLTO E, et al. In-line sorting of irregular potatoes by using automated computer-based machine vision system[J].JournalofFoodEngineering, 2012, 112(1-2):60-68. [13] 李恺,杨艳丽,刘凯,等. 基于机器视觉的红掌检测分级方法[J]. 农业工程学报, 2013, 29(24):196-203. LI K, YANG Y L, LIU K, et al. Determination and grading of Anthurium based on machine vision[J].TransactionsoftheChineseSocietyofAgriculturalEngineering, 2013, 29(24): 196-203. (in Chinese with English abstract) [14] 李鸿强,孙红,李民赞. 基于机器视觉的结球甘蓝形状鉴别方法[J]. 农业机械学报, 2015,46(S1):141-146. LI H Q, SUN H, LI M Z. Identification of cabbage ball shape based on machine vision[J].TransactionsoftheChineseSocietyforAgriculturalMachinery, 2015,46(S1):141-146. (in Chinese with English abstract) [15] 袁加红,朱德泉,孙丙宇,等. 基于机器视觉的水稻秧苗图像分割[J]. 浙江农业学报, 2016, 28(6):1069-1075. YUAN J H, ZHU D Q, SUN B Y, et al. Machine vision based segmentation algorithm for rice seedling[J].ActaAgriculturaeZhejiangensis, 2016, 28(6):1069-1075. (in Chinese with English abstract) [16] SEGAARD H T, OLSEN H J. Determination of crop rows by image analysis without segmentation[J].Computers&ElectronicsinAgriculture, 2003, 38(2):141-158. [17] 田海韬,赵军,蒲富鹏. 马铃薯芽眼图像的分割与定位方法[J]. 浙江农业学报, 2016, 28(11):1947-1953. TIAN H T, ZHAO J, PU F P. A method for recognizing potato’s bud eye[J].ActaAgriculturaeZhejiangensis, 2016, 28(11):1947-1953. (in Chinese with English abstract) [18] 何洁,孟庆宽,张漫,等. 基于边缘检测与扫描滤波的农机导航基准线提取方法[J]. 农业机械学报, 2014,45(S1):265-270. HE J, MENG Q K,ZHANG M, et al. Crop baseline extraction method for off-road vehicle based on boundary detection and scan-filter[J].TransactionsoftheChineseSocietyforAgriculturalMachinery, 2014,45(S1):265-270. (in Chinese with English abstract) [19] 迟德霞,任文涛,由佳翰,等. 水稻插秧机视觉导航信息获取试验[J]. 沈阳农业大学学报, 2015, 46(5): 575-580. CHI D X, REN W T, YOU J H, et al. Experiment on acquisition of navigation information of unmanned rice transplanter based on machine vision[J].JournalofShenyangAgriculturalUniversity, 2015, 46(5): 575-580. (in Chinese with English abstract) (责任编辑张 韵) Acquisitionofoperationparametersofintelligentleafvegetableharvesterundernaturallighting WU Yuanyuan, SHANG Xin*, ZHANG Chengbin, XIE Xinyi (SchoolofMechanicalEngineering,NingxiaUniversity,Yinchuan750021,China) Aiming at the problem of obtaining navigation parameters and the height of cutting platform parameters autonomously during the operation of intelligent leaf vegetable harvester, the method of obtaining two kinds of job parameters by machine vision was proposed. Firstly, the autonomous navigation parameters were studied, the collected images of leaf vegetables were pretreated and the navigation discrete points were obtained. The robust regression method was used to linearly fit the discrete points to obtain the navigation control parameters so that the harvester could adjust the direction of the work. Then the parameters for the height of the cutting table, image preprocessing and stubble height feature extraction of leafy vegetables were adjusted. The stubble height was used as the parameter of the height of the cutting table of the harvester. The results showed that the accurate line recognition rate was 97%, and the relative error of stubble height was 8 mm, the maximum relative error was 11.9%. It showed that the method could effectively extract the direction parameters and stubble height under natural light, which provided technical support for intelligent and accurate operation of unmanned harvester. machine vision; intelligent harvester; navigation parameter; stubble height 伍渊远,尚欣,张呈彬,等. 自然光照下智能叶菜收获机作业参数的获取[J].浙江农业学报,2017,29(11): 1930-1937. 10.3969/j.issn.1004-1524.2017.11.21 2017-05-02 宁夏回族自治区西部一流学科建设项目(机械工程);宁夏大学研究生创新项目(GIP2017019) 伍渊远(1992—),男,四川达州人,硕士研究生,主要从事智能农业装备研究。E-mail: keatswu@163.com *通信作者,尚欣,E-mail: XKshangx@163.com S126;TP242 A 1004-1524(2017)11-1930-08

2 割台高度调整参数的获取

3 结果与分析

4 结论

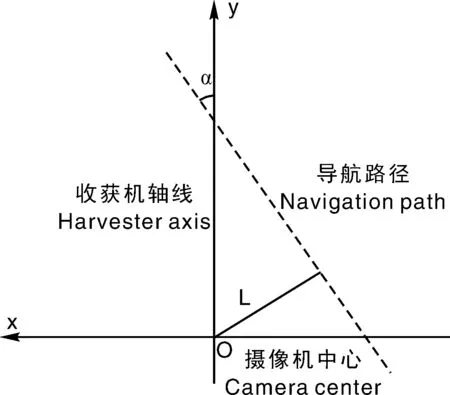

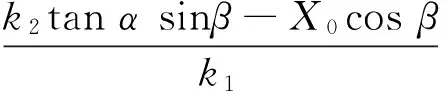

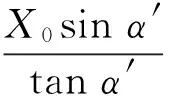

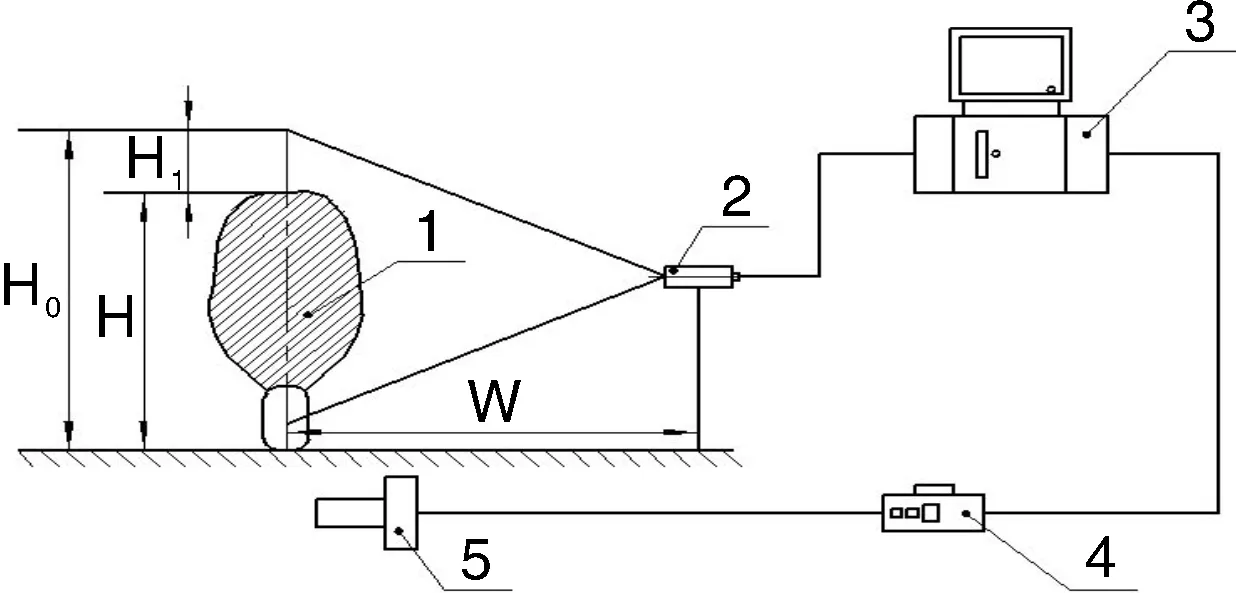

———2020 款中农博远玉米收获机值得期待