基于高斯混合模型的人群异常检测

于明+郭团团

摘要:近年来,公众场所安全问题得到了广泛关注,视频监控下的人群异常检测成为智能监控的研究热点。现实场景中的人群异常检测具有容易受到光照亮度变化影响、可能存在大量遮挡以及人群密度大等研究难点。提出一种基于高斯混合模型的人群异常检测方法,能有效应用于复杂的室外场景。首先通过预处理阶段求得视频帧的感兴趣区域(ROI),再在感兴趣区域中计算人群光流,并在此基础上融合SIFT特征,利用图像分块提取特征。对不同分块建立对应的高斯混合模型,进而用模型判断特征点是否属于异常事件。实验结果证明,该方法对于UMN数据库中人群的四散奔跑以及UCSD数据库中人行横道上出现汽车和自行车等异常事件有较高的识别率。

关键词关键词:人群异常检测;感兴趣区域;SIFT特征;光流法;高斯混合模型

DOIDOI:10.11907/rjdk.171847

中图分类号:TP319

文献标识码:A文章编号文章编号:16727800(2017)011011407

0引言

近年来,人群异常检测在智能监控视频中扮演着越来越重要的角色。异常本身是指行为不规则、不寻常、偏离正常类型,例如摔倒、斗殴、逆行、闯入禁止区域等[1]。因此,在不同应用上,异常定义方式不同。本文在监控视频场景下对异常的定义是低概率发生的事件,或者是出现次数很少的事件[23]。

面对监控视频中的高密度人群场景,异常检测面临着3大挑战:①异常与正常定义比较模糊;②高密度人群中存在遮挡情况,行为动作难以分析;③视频监控场景具有多样性,以及视频监控角度不同造成区域运动大小不一致。由于存在这些挑战,导致传统的行人动作分析技术不能直接用于人群异常检测,而人群异常检测又在保障公众场所人身安全上具有重要意义,所以异常检测成为热门的研究方向,一系列检测方法被不断提出。大量相关方法都指出,现实场景具有时间和空间两个特性,异常也具有这两个特性,通常将异常分为时间异常事件和空间异常事件。

时间异常是指在一定时间内视频中物体的速度违背了正常规律的事件,其最明显的表现是视频前后帧的物体位置变化幅度较大。对于时间异常,传统的检测方法有基于轨迹分析的、基于光流法的与基于能量的方法,它们都利用了异常的时间特性[47]。基于轨迹的检测算法通过多目标跟踪算法跟踪行人运动,用运动轨迹表示人群场景,然后用概率模型对人群场景进行建模[8];基于光流法的检测算法通过构建光流直方图判断异常;基于能量的方法通过提取人群的混沌不变量构建概率模型,以最大似然估计判断人群中是否发生异常。空间异常是指出现在场景中未定义的形状,例如人行横道上出现汽车等。形状在异常检测中也起着重要作用,可以利用目标轮廓、纹理特征等检测视频中出现的不规则物体[911]。目前最流行的方法是结合视频的时空两方面特性,从时空块上提取特征表示基本事件,用机器学习的方法训练得到一个正常事件的模型,不满足该模型的事件则判断为异常事件[2]。常用的机器学习方法有Principal Components Analysis(PCA)、Hidden Markov Model(HMM)、Support Vector Machine(SVM)等。Weixin Li[11]通过整合时间和空间上的异常判断异常,并且这种时空结合的方法可以适用于不同场景。

对于视频监控场景下的人群异常检测,从规模上可以分为全局异常和局部异常。全局异常是指场景中所有目标触发了低概率事件,例如人群四处逃散,即是智能监控系统中需求最迫切的一种应用,直接关系到人身安全。通常将人群看作一个整体,通过分析整体运动趋势或能量检测异常。由于在全局异常中,异常表现比较明显,相对于局部异常比较容易检测。局部异常指场景中少数目标运动状态偏离周围正常状态的事件,其检测具有更大的挑战性。检测出局部异常也意味着在视频中将异常定位,这也是人群异常检测中的一个重要研究方向。局部异常的特点是相对于周围事件,该目标点与周围目标点特征相似度较低,例如穿梭在正常行走的人群中玩滑板的人,存在给周围目标带来威胁的可能性。本文提出一种新方法来检测这两种异常,对于全局异常,在光流法的基础上结合Scale Invariant Feature Transform(SIFT)特征,SIFT特征能对图像的旋转、尺度缩放、亮度变化保持不变性,对于存在遮挡的、稀疏或拥挤人群场景能起到很好的检测效果。然后利用高斯混合模型对其进行建模,训练正常事件的高斯混合模型,不属于该模型的则判定为异常;对于局部异常,将视频图像分块,通过检测子块的异常,从而定位出视频的局部异常。

由于监控视频下不同区域行人的运动特征不同,提出一种基于混合高斯模型的方法。首先通过预处理阶段求出视频的运动区域,减少了背景噪声对检测带来的干扰,同时提高了计算效率,利用光流法和SIFT算法求物体速度大小。然后对图像进行网格化,对每个分块建立相应的混合高斯模型表示该块的正常运动信息,使每个图像块都有对应的高斯混合模型,以此检测相应图像分块是否屬于异常。本文方法能很好地适用于不同场景。

1异常检测研究现状

近年来,智能视频监控中人群异常检测的研究取得了很大进展,现有大多数方法的基本检测过程可以归纳为:①基本事件表示;②模型建立。目前已有很多成熟技术成功运用到了人群异常检测,例如行人检测、行人动作分析、背景建模、跟踪算法等都为基本事件表示提供了有力支持。对于基本事件表示,大致可分为基于轨迹、基于光流、基于纹理特征等方法。

基于轨迹分析的算法有很多,Neil Johnson[12]较早提出的通过比较新轨迹和一系列典型轨迹的方法,先学习由图像序列产生的目标轨迹,再判断不规则行为;在此基础上,Weiming Hu[13]提出一种新的多目标跟踪算法,然后用层次聚类算法对轨迹建模,进而检测异常。跟踪算法面临的挑战是目标易出现遮挡或者与周围目标差异较小,多目标跟踪算法的精确度将直接影响后续检测效果;HT Nguyen[8]通过整合时间空间上下文信息,提出了一种更具有鲁棒性的多目标跟踪算法;Ismail Haritaoglu[14]提出在运动轨迹的基础上,结合形状特征分析行人动作,实时监测异常。由于基于轨迹的异常检测算法依赖于目标跟踪,所以这些算法都局限于稀疏场景下,很难适用于人群密度高的场景;Shandong Wu[4]提出一种新的方法,该方法克服了高密度人群给轨迹分析带来的困难,首先获得人群具有代表性的轨迹,然后通过提取代表性轨迹的混沌不变性特征构建概率模型来分析人群是否异常。基于光流法的检测算法通常是将高密度人群看作一个整体加以分析[15]。例如Yang Liu[6]通过光流法计算人群运动速度,以动态阈值的方式判断人群情况。但人群异常种类多样,如人群恐慌、地铁口逆行、自行车或滑板穿梭于行人中,因此将光流法与其它模型结合成为研究热点;Ernesto L Andrade[16]克服了异常种类难以预测的困难,通过计算人群光流,结合HMM模型的方式进行异常判断;Ramin Mehran[7]采用将光流与社会力模型结合的方式分析人群整体,进行人群异常检测;在最近的研究方法中,蔡瑞初[17]利用光流直方图与时间递归神经网络结合的方式进行人群异常检测。以上方法都依赖于运动信息而忽略了目标大小和形状信息等纹理特征,纹理特征在人群密度、行人检测、运动分割上起到重要作用,可为人群异常检测提供有力支持。常用的纹理特征有目标轮廓、大小、边缘方向直方图、LBP以及灰度共生矩阵等[9,18]。Antoni B Chan[19]在视频运动分割中较早提出了混合动态纹理特征MDT,该特征结合了运动信息和外貌信息,很好地将两种不同形态分割开,例如分割水、火这两种不同运动状态;Vijay Mahadevan[10]则将MDT(Mixture of Dynamic Textures)模型运用于视频监控中的人群异常检测。受GMM背景建模思想启发,作者用MDT模型代替GMM(Gaussian Mixture Model)模型,从时间异常和空间异常两方面对监控视频进行分析,从而判断异常;Weixin Li[11]进一步改进和完善了混合动态纹理特征,提出HMDT(Hierarchical Mixture of Dynamic Texture)模型,克服了异常在不同人群规模下定义模糊的问题,同时还引入了条件随机场,但该方法计算耗时较长,实时性较差。endprint

在人群异常检测模型建立阶段,目前使用比较广泛的有社会力模型、隐马尔可夫模型、马尔科夫随机场、SVM、神经网络等[7]。Helbing[20]较早提出了社会力模型,以较高精确度模拟人群动态;Ramin Mehran[7]将社会力模型应用在人群异常检测上,通过计算人群场景运动粒子社会力提取相互力,将人群看作整体,用粒子平流的方法分析视频中人群是否存在异常,但该方法检测的异常种类受限。HMM和MRF(Markov Random Filed)模型也是比较流行的模型。岳猛[21]提出一种将狄利克雷多项式共轭模型与隐马尔科夫模型结合的方法进行异常检测;Tao Xiang[22]通过建立多目标的HMM模型进行异常判断。虽然HMM模型能有效地检测异常,但模型建立阶段面临的挑战是场景中的人群在不间断地变化,模型也需要不断更新;为了克服这一困难,Jaechul Kim[23]提出一种基于时空的马尔科夫随机场模型,随着新目标进入场景,模型参数也会时时更新,从而能更好地适应真实的人群场景。值得注意的是,大多数方法仍没有较好地解决监控视频下不同区域运动状态不同给检测带来的干扰。本文通过分块构建高斯混合模型的方法,对不同区域训练对应的模型,很好地解决了异常检测问题。

2异常检测算法

本文提出的异常检测算法用光流特征和SIFT特征表示人群运动,对图像进行分块,将特征划分到对应的子块中,对每个子块建立高斯混合模型,用高斯混合模型判断该子块是否属于异常。

2.1预处理

预处理阶段的主要目的是缩小图像分析范围,减少噪声干扰。人群异常检测主要是检测行人状态是否遵循正常规律变化,可见异常只发生在视频中的运动区域。通过预处理可以把检测区域进一步定位到运动区域上,从而有效地减少背景等其它因素对异常检测带来的影响。Yang Liu[6]在对视频处理前进行了前景提取,缩小了检测范围,但现有的前景提取方法存在漏检问题,会对后续处理造成一定影响。本文在此基础上用形态学方法对检测结果进行处理,扩大范围使其能完全包含运动目标,减少漏检现象。常见的运动目标检测方法有帧差法、光流法、背景差分法。本文采用由Stauffer和Grimson提出的高斯混合模型(Gaussian Mixture Model,GMM),这是目前使用最为广泛的运动物体检测方法。

高斯混合模型是基于像素点的背景建模方法,对监控图像Ii中每个像素点位置建立k个高斯混合模型,使图像中每个像素点位置都对应k个高斯混合模型。本文中k=5,每个高斯混合模型共有4个参数:优先级s、权重w、均值m和方差v。将后续图像Ii,i=i+1,…,N中每个像素点的灰度值和该像素点相应位置的k个高斯混合模型逐个进行匹配,然后根据该图像每个像素点的匹配情况更新该点相应位置的高斯混合模型。匹配和更新公式如下:

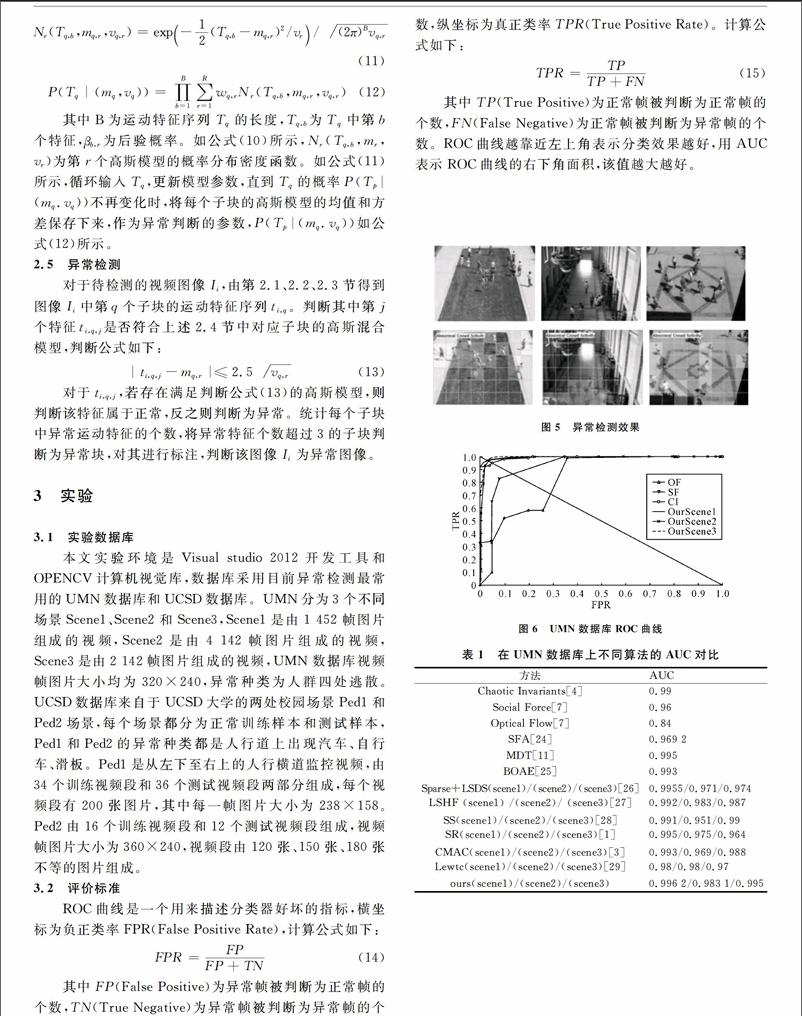

3.3UMN数据库实验结果

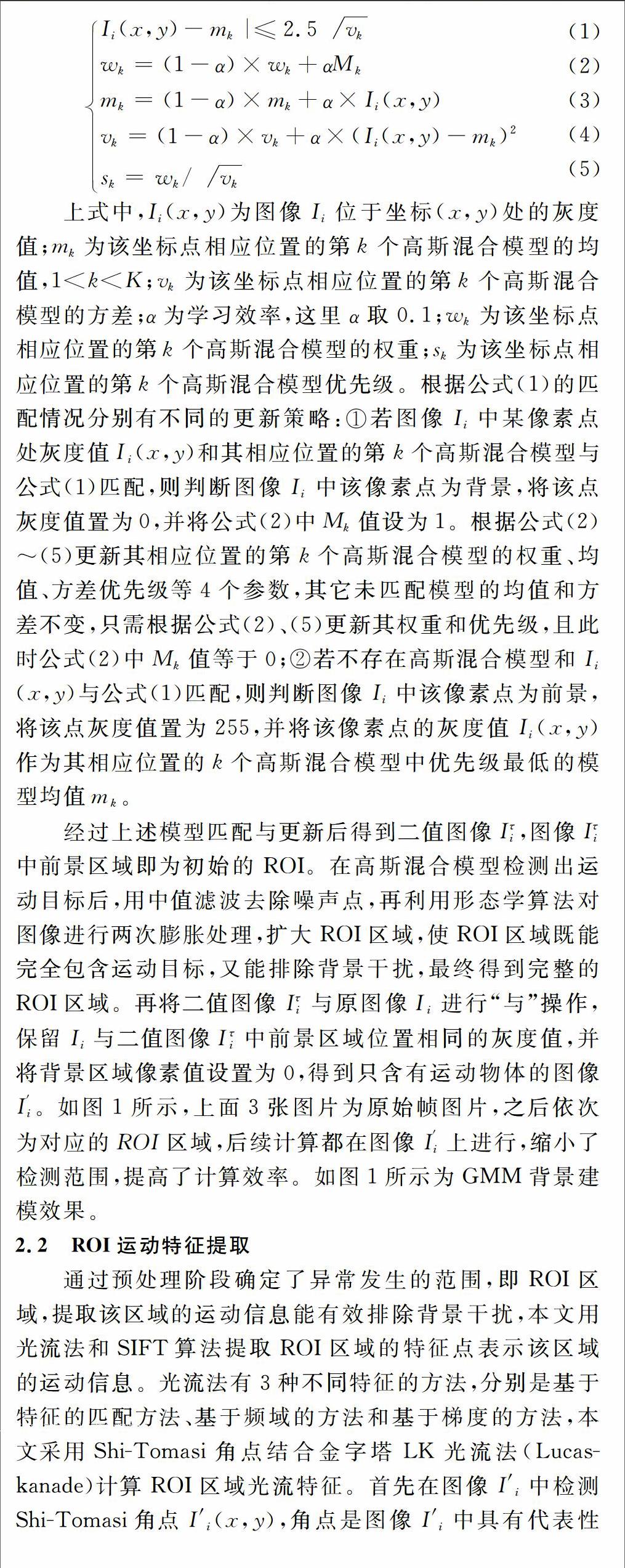

本文首先在UMN数据库上进行检测,验证其有效性,效果如图5所示。

图5异常检测效果

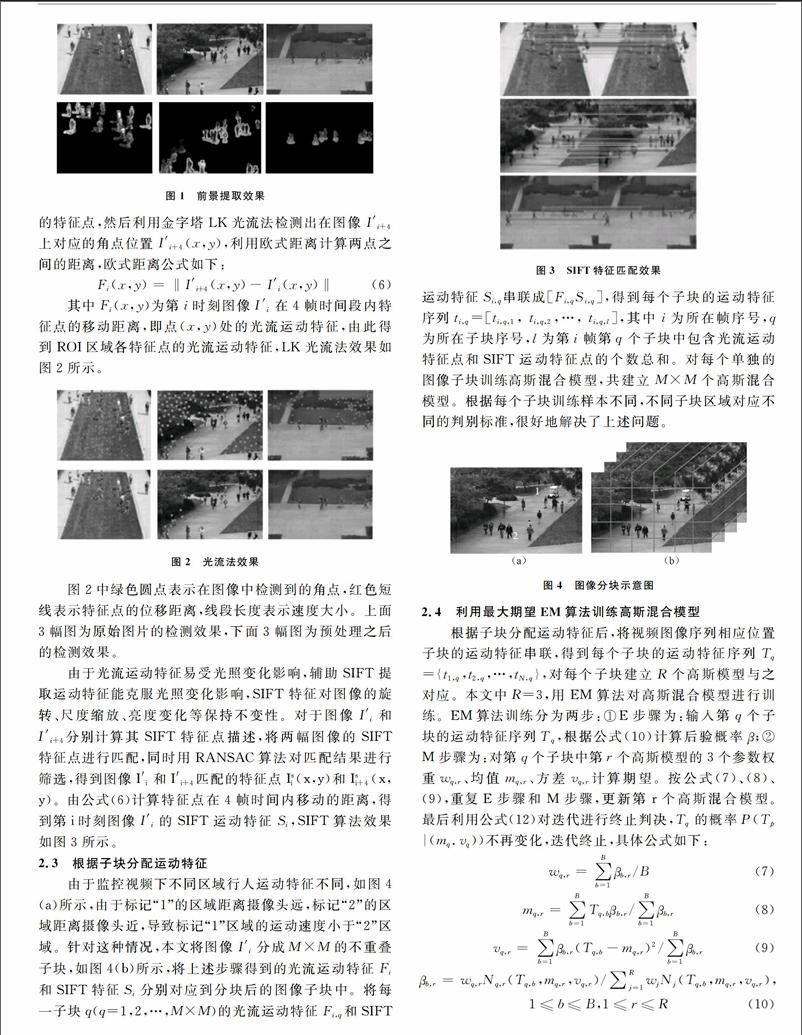

图5是UMN数据库中3个场景下的人群活动状态,异常类型是人群四处逃散,红色区域是异常发生的区域。图6展示了异常检测的ROC曲线。

由图5可以看出,本文提出的方法能有效检测人群四处逃散这一异常举动,并且图像中的红色分块很好地定位了异常发生的位置,验证了本文方法的有效性。图6展示了不同方法在UMN数据库上的ROC曲线,本文方法在3个场景中的ROC曲线处于其它方法的左侧,效果最好。由表1可以看出,本文方法在3个场景下的AUC值均优于其它方法。由不同方法在UMN数据库上的AUC值及ROC曲线的对比结果,可见本文方法在UMN数据库的3个场景下的检测结果均优于对比方法。

3.4UCSD数据库实验结果

本文首先在Ped1场景的帧级和像素级上检测异常。帧级别异常检测是指以数据库中每一张图片为单位,检测的有效性为是否能正确判断该帧存在异常事件;像素级别异常检测指以视频帧中的像素为单位,检测的有效性为至少检测出该帧中异常像素点的40%以上,异常检测效果如图7所示。

图7UCSD数据库Ped1场景下异常检测效果

图7展示了在Ped1场景下本文方法的检测效果,红色区域为检测出异常的区域,可见本文方法能有效地将人行道上运动的汽车、自行车和滑板等检测出来。Ped1场景的ROC曲线如图8所示。在UCSD数据库Ped1、Ped2场景下的不同算法AUC对比分别如表2、表3所示。

图8Ped1场景ROC曲线

图9展示了本文方法在Ped2场景上的检测效果,可以看出本文方法能有效检测出高密度场景中的汽车、自行车等异常事件。图10展示了Ped2 场景下不同方法的ROC曲线,可以看出本文方法的ROC曲线位于所有方法的最左侧,效果最好。表3展示了本文方法与其它方法的AUC值对比,本文方法的AUC值为0.94,效果最好。实验结果表明,本文方法检测效果优于其它对比方法。

4结语

本文提出了一种基于高斯混合模型的人群异常检测方法,首先通过预处理去除了给后续运动特征提取带来干扰的背景因素,以光流法和SIFT算法结合的方式提取高密度人群的运动特征,克服了遮挡和光照变化的影响。然后对图像进行分块,对每个分块训练高斯混合模型,使图像每个子块都有对应的高斯混合模型,从而判断图像子块中是否存在异常,克服了监控视频中不同区域行人运动状态不同的问题。通过实验,证明本文方法针对典型的人群异常类型如人群恐慌四散、人行横道上的自行车等都能取得很好的检测效果,并且能适用于多个不同场景。未来将在此基础上研究更多的基本事件表示方法,例如目标位置、轮廓和方向梯度直方圖等,以更好地表示基本事件。另外需要将运动信息和纹理信息在时空上更有效地结合起来,以进一步提高异常检测效果。随着应用要求的提高,研究无监督的异常检测算法,提高异常检测的实时性也是一个重要研究方向。endprint

參考文献参考文献:

[1]YANG CONG,JUNSONG YUAN,et al.Sparse reconstruction cost for abnormal event detection[C].IEEE Conference on Computer Vision and Pattern Recognition,Providence,RI,2011:34493456.

[2]吴新宇,郭会文,李楠楠,等.基于视频的人群异常事件检测综述[J].电子测量与仪器学报,2014,28(6):575584.

[3]YING ZHANG,HUCHUAN LU,LIHE ZHANG,et al.Combining motion and appearance cues for anomaly detection[J].Pattern Recognition,2016,51:443452.

[4]SHANDONG WU,BRIAN E MOORE,MUBARAK SHAH,et al. Chaotic invariants oflagrangian particletrajectories for anomaly detection in crowded scenes[C]. IEEE Conference on Computer Vision and Pattern Recognition,San Francisco,CA,2010:20542060.

[5]M S KEMOUCHE,N AOUF,et al. A Gaussian mixture based optical flow modeling for object detection[C]. 3th International Conference on Crime Detection and Prevention,London:2009:16.

[6]YANG LIU,XIAOFENG LI,et al. Abnormal crowd behavior detection based on optical flow and dynamic threshold[C]. 11th World Congress on Intelligent Control and Automation(WCICA),shenyang,2014:29022906.

[7]RAMIN MEHRAN,ALEXIS OYAMA,MUBARAK SHAH.Abnormal crowd behavior detection using social force model[C].IEEE Conference on Computer Vision and Pattern Recognition,Miami,FL,2009:935942.

[8]HT NGUYEN,QIANG JI,et al.Spatiotemporal context for robust multitarget tracking[J]. IEEE Transactions on Pattern Analysis Machine Intelligence,2007:5264.

[9]VIKAS REDDY,CONRAD SANDERSON,et al.Improved anomaly detection in crowded scenes via cellbased analysis of foreground speed, size and texture[C].IEEE Computer Society Conference on Computer Vision and Pattern Recognition Workshops,Colorado Spring,CO,2011:5561.

[10]VIJAY MAHADEVAN,WEIXIN LI,VIRAL BHALODIA,et al. Anomaly detection in crowded scenes[C].IEEE,Conference on Computer Vision and Pattern Recognition, San Francisco,USA,2010:19751981.

[11]WEIXIN LI,VIJAY MAHADEVAN,et al.Anomaly detection and localization in crowded scenes[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2014,36(1):1832.

[12]NEIL JOHNSON,DAVID HOGG.Learning the distribution of object trajectories for event recognition[C].British Conference on Machine Vision,1996:609615.

[13]WEIMING HU,XUEJUAN XIAO,ZHOUYU FU,et al. A system for learning statistical motion patterns[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2006,28(9):14501464.

[14]ISMAIL HARITAOGLU,DAVID HARWOOD,et al.Realtime surveillance of people and their activities[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(8):809830.endprint

[15]J L BARRON,D J FLEET,et al.Performance of optical flow techniques[J].International Journal of Computer Vision,1994,12(1):4377.

[16]ERNESTO L ANDRADE,SCOTT BLUNSDEN,et al.Modelling crowd scenes for event detection[C].18th IEEE Conference on Pattern Recognition,Hong Kong,2006:175178.

[17]蔡瑞初,谢伟浩,郝志峰,等.基于多尺度时间递归神经网络的人群异常检测[J].软件学报,2015,26(11):28842896.

[18]MRIDULA J,KUNDAN KUMAR,et al.Combining GLCM features and markov random field model for colour textured image segmentation[C].International Conference on Devices and Communications,Mesra,2011:15.

[19]ANTONI B CHAN,et al. Modeling,clustering,and segmenting video with mixtures of dynamic textures[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2008,30(5):909926.

[20]D HELBING,et al. Social force model for pedestrian dynamics[J].Physical Review E,1995,

51(5):42824286.

[21]岳猛,郭春生.基于DMCHMM模型的视频异常行为检测[N].杭州电子科技大学学报,2014,34(3):2124.

[22]TAO XIANG,SHAOGANG GONG.Incremental and adaptive abnormal behaviour detection[J].

Computer Vision and Image Understanding,2008,111(1):5973.

[23]JAECHUL KIM,KRISTEN GRAUMAN.Observe locally, infer globally: a spacetime MRF for detecting abnormal activities with incremental updates[C].IEEE Conference on Computer Vision and PatternRecognition,Miami,FL,2009:29212928.

[24]XING HU,SHIQIANG HU,et al.Video anomaly detection using deep incremental slow feature analysis network[J]. let Computer Vision,2016,10(4):258256.

[25]XING HU,SHIQIANG HU,et al.Abnormal event detection in crowded scenes via bagofatomiceventsbased topic model[J].Turkish Journal of Electrical Engineering and Computer Sciences,2016,24(4):26382653.

[26]YANG CONG,JUNSONG YUAN,et al.Abnormal event detection in crowded scenes using sparse representation[J].Pattern Recognition,2013,46(7):18511864.

[27]YING ZHANG,HUCHUAN LU,et al.Video anomaly detection based on locality sensitive hashing filters[J].Pattern Recognition,2015.

[28]YANG HU,YANGMUZI ZHANG,et al.Unsupervised abnormal crowd activity detection using semiparametric scan statistic[C].IEEE Conference on Computer Vision and Pattern Recognition Workshops,Portland,OR,2013:767774.

[29]MYO THIDA,HOWLUNG ENG,et al.Laplacian eigenmap with temporal constraints for local abnormality detection in crowded scenes[J].IEEE Transactions on Cybernetics,2013,43(6):21472156.

責任编辑(责任编辑:黄健)endprint