视频背景音乐选配的人工神经网络模型

郄子涵,常淑惠

(1.河北衡水第一中学,河北衡水053000;2.河北农业大学信息科学与技术学院,河北保定071001)

视频背景音乐选配的人工神经网络模型

郄子涵1,常淑惠2

(1.河北衡水第一中学,河北衡水053000;2.河北农业大学信息科学与技术学院,河北保定071001)

根据视频场景的情感特征添加契合的背景音乐,一般需要丰富的专业知识和经验。为提高视频编辑制作的效率和质量,构建了背景音乐选配的感性检索系统。通过分析归纳出刻画视频场景的10个情感特征因素和在乐谱中能够识别的8个音乐数据特征因素,分别作为模型的输入和输出,并整理出50组样本数据作为模型的训练样本,通过样本数据训练多层前馈BP神经网络,建立起视频场景与音乐特征适佳匹配的关联模型。实例验证结果表明该模型能够有效地为视频场景自动检索配置背景音乐,从而减少视频背景音乐筛选的工作量。

背景音乐;视频编辑;人工神经网络;自动检索

随着计算机多媒体技术的迅速发展,视频制作已经成为每个普通人都可以亲自动手操作的工作。人们随时可以用手机、数码摄像机、照相机等记录生活、学习以及工作中的点点滴滴,发到QQ空间、微信朋友圈上,有时也会在闲暇时制作编辑一下,将得意之作通过微博等与更多的人分享[1]。目前视频已成为一个巨大的产业。以2015年为代表年,网络视频开始以“井喷”状态爆发,据相关统计数据显示,该年上线播出的原创视频或节目数量高达300余万条,节目类型呈多样化,网络视频市场发展前景一片[2]。有机构分析预计2016年中国在线视频行业市场规模将达到570亿元[3]。在视频制作中,常常需要为画面配背景音乐。情景和背景音乐应该完美结合,即使同一场景配不同的背景音乐,其效果也会有很大不同。因此一些较大制作的片子会有专门的音乐制片人,大大提高了制作成本并使得制作周期较长[3]。事实上很多电影或视频的背景音乐采用了已有的优秀的音乐作品,但音乐的选择需要花费大量时间和精力[4][5]。现在,很多大型门户网站和专门的音乐网站提供了音乐的检索功能,但大多只是音乐作品分类或按音乐名、作曲家名字检索,尚没有按印象或感觉进行检索的音乐数据库。

因此,本研究的主旨是建立可以从大量已有的优秀音乐作品中检索出与视频情景印象相契合的背景音乐的系统模型,为视频制作提供高效的辅助工具。主要思想是以模糊概念描述视频场景的印象,用人工神经网络建立场景印象与背景音乐之间的映射关系,即用人工神经网络作为“黑盒”来描述两者之间的非线性模糊关系。

1 音乐与情感

1.1 音乐的情感

我们喜欢听音乐的理由之一是所有音乐作品都带有一定的情感色彩,并且音乐能唤起我们的某种情感。当然,同样的一首乐曲引起的情感及情感强弱并不完全相同,同一个人在不同的状况或不同的情景下听同一作品的感觉也不尽相同。然而在对于音乐作品的情感反应上是有超越个体差异的共性的东西的。正因如此,很多人会因同一首曲子一起落泪,或者一起鼓起勇气,共同战斗。

1.2 音乐的特征与情感

Hevner把对音乐情感描述的词语分为8类,共包含了67个词组,并按照在情感上依次递进、平滑过渡的原则建立了音乐情感环模型,如图1所示[6]。这8类词组构成一个感情递进模型,相邻分类之间在感情上平滑过渡,共同构成环状情感模型对音乐作品的情感进行了系统的阐述。环中板块的对侧具有一定反义特征。

图1 Hevner的情感环模型

2 人工神经网络模型

2.1 多层前馈神经网络模型

目前人们已经提出了许多种神经网络模型,其中多层前馈BP网络是应用最为广泛,影响力最大的一种,该算法最早由PDP(Parallel Distributed Processing)小组于1985年提出,其工作原理的核心内容为误差的反向传播,其工作过程的关键部分是在感知器中增加隐含层,并采用广义δ—算法作为主要学习方式[7]。该模型对老的感知器模型进行了改进,使得BP网络更加灵活,可以以任意精度近似任意连续函数。结构上表现为多层神经网络的拓扑结构,相邻层之间为单向完全连接,结构如图2和图3所示。BP网络应用的广泛性表现在其输入和输出节点数量的可变性上,节点数量的不受限使得诸如图像处理、逻辑映射、信号检测、函数逼近等问题经过处理可利用BP网络进行求解,即利用BP网络的特点寻找原始数据与特定解元之间的最优对应关系[8]。

图2 多层前馈神经网络结构

图3 单个神经网络节点(神经元)

2.2 多层前馈神经网络的误差反向传播算法

BP算法的学习过程按照其信号传输的类型及工作原理可分解为两部分,即信号的传播由两部分构成:正向传播和反向传播。算法的学习过程由输入层、隐节点层、输出层三部分构成,信号正向传播时,输入样本通过输入层进入隐节点层,在隐节点层进行样本信息的处理,处理结果由输出层输出,如果处理结果未达到期望值,则工作状态转变为误差的反向传播,误差信息返回隐节点层进行修正,如此形成信息处理的有效循环,直至误差信息满足期望[9][10]。

由于常规的BP神经网络算法是逐一地对每一个数据样本进行处理,会造成根据前一个样本的调整好网络权重后,计算下一个样本时,权重又针对当前样本进行修正,此时的权重分布已不再适合前面的样本数据,如此会前后影响,计算效率较低,故本研究采用了批处理的形式。即:一次输入所有样本,并计算所有样本产生的输出误差,根据所有样本的总效果来修正权重(公式1)。

本文的计算采用了MATLAB神经网络工具箱中相应的函数[11]。

3 视频背景音乐的感性检索系统

3.1 检索系统的结构组成

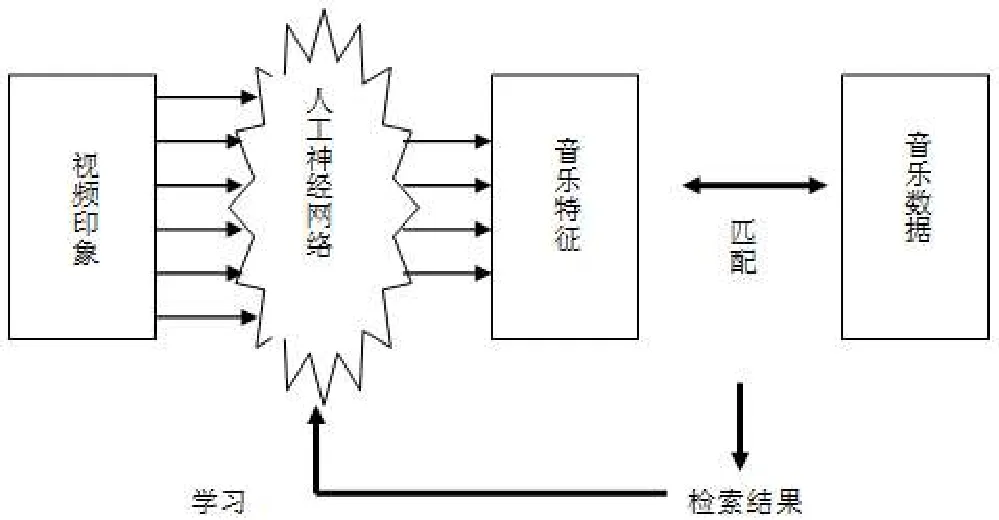

该系统的结构示意图见图4。

首先,由系统分析音乐数据库中音乐的特征并存储起来;其次,找到足够的可作为背景音乐的乐曲,抽出背景音乐的特征,请专门人员给出这些背景乐曲对应的视频特征,将特征量化后,作为学习示例训练人工神经网络,从而建立起视频印象与背景音乐间的对应关系。当一段新的视频需要配背景音乐时,输入视频的印象特征(用户对视频的主观印象),经神经网络正向计算就可以得到所需背景音乐的音乐特征,根据音乐特征可以在音乐数据库中找到与所需音乐特征最接近的候选音乐。

图4 检索系统的结构组成示意图

3.1.1 音乐数据特征

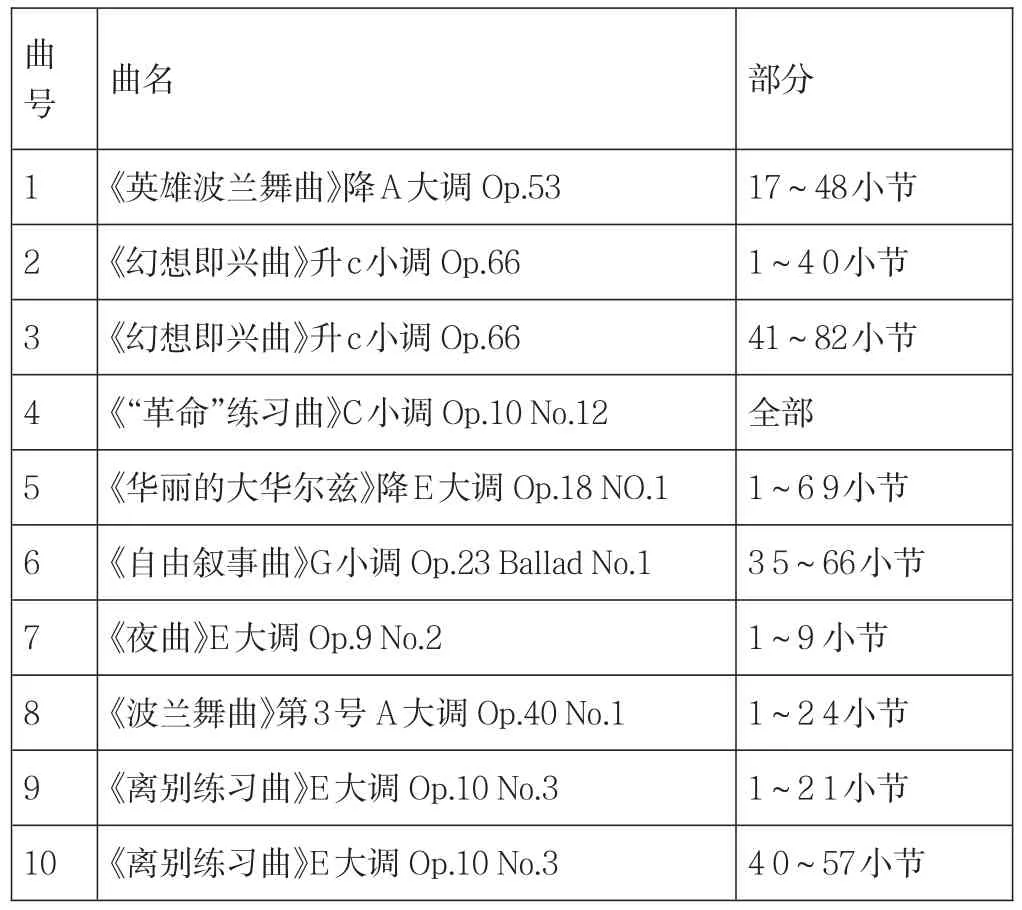

归纳了18首钢琴曲中的整首或部分音乐(2分钟左右)的特征,主要包括能从乐谱中识别出来的音调、强弱、拍子、音高和旋律5个因素。其中,强弱以五线谱的F、P等强弱符号区分;拍子以音符的长短表示;音高根据高中低音符数分别占总音符数的比例确定。其中对前10首乐曲(表1),整理出50个分析示例,以用于人工神经网络的训练。

3.1.2 视频印象的表现

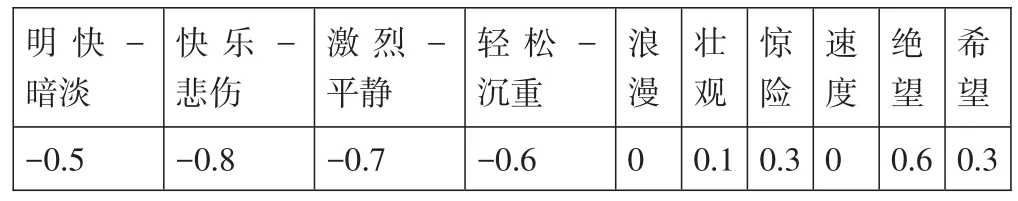

从视频画面中感受到的印象是主观的,人们一般用模糊的自然语言来描述。这里以4条有对照的形容词和6条一般形容词来刻画视频给人的印象:①明快-暗淡、②快乐-悲伤、③激烈-平静、④轻松-沉重;⑤浪漫、⑥壮观、⑦惊险、⑧速度、⑨绝望、⑩希望。

表1 部分音乐数据

对于前4条有对照的形容词,用户可以输入的值的范围为-1~1间的实数,后六条输入范围为0~1间的实数。例如:非常明快的曲子取值为1.0,偏暗淡的取值-0.3。

3.1.3 训练数据与神经网络模型参数

针对3.1.1中提到的50个音乐数据,通过曲谱分析和统计,得到50×8的数据阵列。另外,请3位有配乐经验的人员,分别给出每一个示例所对应的10个视频印象值,最后取其平均值,归一化后作为神经网络的输入数据。采用的神经网络结构与参数如表2所示。

表2 神经网络的结构与参数设置

4 实例应用与分析

4.1 应用实例Ⅰ

美国电影《危险小天使》(The Good Son)中,有一段儿主人公马克忍不住母亲去世的悲痛,在叔母怀里哭泣的场景。本文把这段场景用表3中的数值进行量化描述。将其输入建好的人工神经网络模型后,得到对应的音乐特征值,系统自动从乐曲库中检索到与特征值接进的3首乐曲,见表4。

表3 输入值Ⅰ

表4 检索结果Ⅰ

表4中的3首曲子都是适合平静、悲伤气氛的,说明该系统具有有效性。

4.2 应用实例Ⅱ

同样在《危险小天使》中有一段哥哥把妹妹带到溜冰场,要杀害妹妹的场景。将这段场景的视频印象描述为表5中的数值,输入建好的人工神经网络模型后,得到对应的音乐特征值,系统自动从乐曲库中检索到与特征值接进的3首乐曲,如表6所示。

表5 输入值Ⅱ

表6 检索结果Ⅱ

这次检索的结果尚可,但不十分理想,分析原因主要是用于神经网络训练的示例还比较少,需要增加训练实例。

5 结论

本文针对视频场景的背景音乐的感性检索问题,应用人工神经网络模型进行了建模尝试。得到以下结论:

(1)多层前馈BP神经网络能够较好地模拟视频场景印象与音乐特征间的对应关系,可以用于视频背景音乐的选配;

(2)数学模型的精度和有效性需要以训练实例的完备性来保障,即:训练样本应足够多;

(3)根据BP神经网络建立的模型,可以是一个不断学习的模型,在应用中,用户有了更好的选择,或者收集到经典的与视频契合度高的音像作品时,可以将其作为新的训练样本,进一步训练神经网络,从而使模型的能力不断增强。

目前只抽取归纳了较少一些乐曲的特征,这使得检索系统的能力还比较有限,今后需要进一步优化模型,并且研究更有效率的音乐感性特征的抽取方法和技术。

[1]郭成贺.自拍视频加背景音乐噪音变和谐[J].电脑爱好者:普及版,2011(2):93.

[2]魏党军.推动网络视听内容的供给侧改革[N/OL].慧聪广电, 2016-01-08.http://info.broadcast.hc360.com/2016/01/ 080837652682.shtml.

[3]中国产业调研网.2016-2021年中国网络视频行业现状研究分析及市场前景预测报告[R].CIR.cn.2016.

[4]朱博程.配乐之美浅谈各类型配乐创作经验[J].数码影像时代,2015(8):38-39.

[5]亓文会.背景音乐简单做[J].计算机教与学(IT搜索),2003 (09):42.

[6]王玉婷.基于Hevner情感环模型的虚拟乐舞研究[D].哈尔滨工业大学,2013.

[7]郄志红.大坝安全监测资料正反分析的智能软计算方法及其应用[D].天津大学,2005.

[8]韩力群.人工神经网络教程[M].北京邮电大学出版社, 2006.

[9]郄志红,吴鑫淼,郑旌辉,等.一种基于人工神经网络的水库水温分层模式判别方法[J].农业工程学报,1999(3):204-208.

[10]刘冉,卢本捷.神经网络训练算法的对比与应用[J].软件, 2011,32(10):29-34.

[11]罗成汉.基于MATLAB神经网络工具箱的BP网络实现[J]. 2004,21(5):109-111.

An Artificial Neural Network Model for Video Background Music Selection

QIE Zi-han1,CHANG Shu-hui2

(1.Hengshui Hebei No.1 Middle School,Hengshui 053000,China;2.College of Information Science and Technology of Agricul⁃ture University of Hebei,Baoding 071001,China)

According to the emotional characteristics of the video scene to add the appropriate background music,generally re⁃quires a wealth of professional knowledge and experience.In order to improve the efficiency and quality of video editing,an emo⁃tional retrieval system Based on background music selection is constructed.Through the analysis of the 10 characteristics of the video scene and the 8 data feature can be identified in music,these are used as inputs and outputs of the model,and 50 groups of sample data were collected as the training samples.Based on the training of multilayer feedforward BP neural network with sample data,the correlation model of video scene and music feature matching is established.The experimental results show that the pro⁃posed model can effectively configure the background music for the automatic retrieval of video scene,and thus reduce the work⁃load of video background music screening.

background music;video editing;artificial neural network;automatic retrieval

TP183

A

1009-3044(2017)21-0173-03

2017-06-11

郄子涵(2000—),女,河北衡水一中;常淑惠(1971—),女,河北农业大学信息与科技学院,教授,主要研究方向为人工智能及应用。