基于MCMC粒子滤波的目标跟踪算法研究∗

高菲

(宝鸡职业技术学院宝鸡721000)

基于MCMC粒子滤波的目标跟踪算法研究∗

高菲

(宝鸡职业技术学院宝鸡721000)

针对于贝叶斯框架下的视频目标跟踪算法的应用,结合MCMC粒子滤波算法的运算消耗,对运动模型、观测模型进行了研究,改进二值模型与颜色模型相结合的算法,颜色模型中的建模只采用其中的一通道来实现,减少了观测模型运算消耗,提高了运算速度。

粒子滤波算法;视频目标跟踪;颜色模型;二值模型;运动模型

Class NumberTN713

1 引言

基于粒子滤波算法的视频目标跟踪一直是当前研究的热点,而MCMC粒子滤波算法更是近几年研究热点,究其原因是MCMC算法能有效处理高维状态空间所带来的问题,本文对MCMC算法进行了深入研究,在MCMC采样下的粒子滤波跟踪算法,为了降低计算复杂度,对在观测模型中的颜色模型进行了优化,只采用RGB图像的R通道进行计算。

2 目标运动模型

对于粒子滤波来说,要实现目标状态的预测,需要构建目标的运动模型。目标运动的随意性较强,如何构建一个有效的运动模型用于目标状态预测,将有助于减少搜索次数。

1)通用运动模型

用于人体跟踪中常用的通用运动模型有:匀速运动模型、随机增量运动模型、多项式运动模型和仿射变换运动模型等。

如果目标在连续帧间运动幅度不大的话,用通用运动模型就能获得比较理想的效果。另外搜索方法本身并没有严格要求运动预测的精确度,只要能够保证跟踪结果在预测范围内就行。

2)专用运动模型

本文将粒子的传播看成是随机过程,采用的是一阶自回归模型,方程表示为

其中,xt为时刻的目标状态,wt-1是归一化噪声,A、B为一个常量。显然,当A=1时,t时刻粒子状态为t-1时刻的状态叠加一个噪声量。

3 目标观测模型

一般跟踪的目标摄像头是固定的,这样观测模型可以用场景的二值特征和颜色特征相结合的方式,在整幅图像中定义每一个像素的观测模型为Zp,t=(),其中∈{0,1},当时表示该像素为背景,当时表示该像素为前景。则观测模型似然值为

3.1 二值观测模型

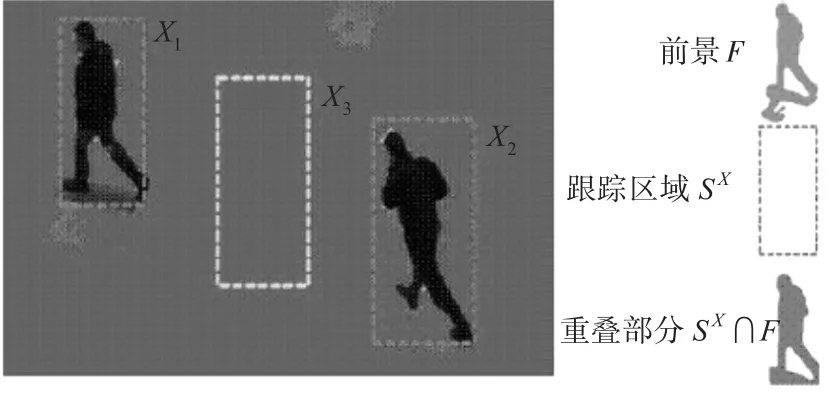

二值观测模型的主要作用是判断目标跟踪。该模型通过前景分割技术,分割算法将图像划分为前景像素集F和背景像素集B,图像中总的像素集I用表示,I=F∪B。如图1所示,前景像素集构成了二值前景观测模型,背景像素集构成了背景观测模型。

图1二值前景观测模型

通过给定一个多目标状态Xt和分割后的前景,即二值模型来计算不同目标(Sx)的重叠区域与分割图像中前/背景区域的距离。其中重叠类型有:

1)前景查准率vF:由多目标状态Sx前景区域F的相交部分的空间支持,再除以多目标状态Sx(多目标状态区域的像素个数)。表示为

2)前景查全率ρF:目标状态Sx和前景区域F的相交部分的空间支持(相交的像素个数),再除以前景区域F,表示如下:

3)背景查准率vB:表示所有目标状态Sx与背景区域B的相交部分的空间支持(相交部分的像素个数),再除以多目标状态Sx(多目标状态区域的像素个数),表示如下:

4)背景查全率ρB:所有目标状态Sx与背景区域B的相交部分的空间支持(相交部分的像素个数),再除以背景区域B(背景区域所占像素总数),用公式表示如下:

如果不正确的放置目标,或者不正确的目标数都会导致似然度很低,也就无法匹配所提议的目标。图2中包含有两个行人,经过前景分割后已将这两个行人分割出来,绿色区域表示的是背景像素,而前景的像素还是用原来的值表示。

图2二值前景观测模型的图解

对于前景、背景相结合的二值似然函数定义为:

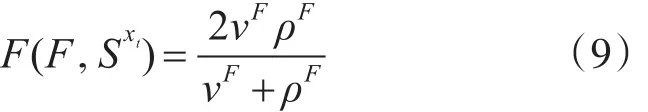

λ是一个超参数,一般由经验取值,大多数情况下取-2~-20。F(F,Sxt)是F-测量算子,具体求取方法如下:

vF和ρF的求取参照式(2)和式(3),图2给出了求取vF和ρF参数的图解方法,求解过程参照图1所给的模板作为相应的参数。

如果跟踪器假设该帧中有两个目标,X1和X2出现在场景中,vF和ρF所得的值就将与预期的值相差不大(如图2左上角部分)。如果跟踪器假设增加一个目标X3,则会导致测量精度vF的值(如图2下半部分)变小。当假设场景中只有一个目标X1时,会导致查全率ρF的值变小(如图2右上部分)。

3.2 颜色观测模型

颜色模型的主要作用是保证随着时间推移还能识别所有目标,它也需要局部二值特征来辅助建模。颜色观测模型采用HSV颜色特征,通过前景分割区域和背景分割区域观测而得。假设前景和背景相互独立,则颜色似然函数可以定义为

其中,右式第一项(前景颜色似然值)决定检测到的目标与在线学习模型的匹配程度,而第二项(背景颜色似然)决定背景与离线学习模型的匹配程度。

前景颜色似然的似然值可以用以下公式表示:

其中,d2F是学习模型与观测直方图的巴特沃斯(Bhattacharya)距离[29],而λF表示一个超函数。

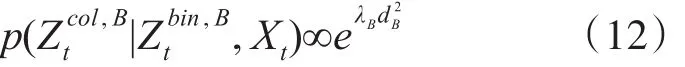

背景颜色似然的作用是拒绝那些没有跟踪到的目标状态配置,它的定义如下:

其中λB和d2B定义与λF和d2F相似,只是表示的是背景像素。

4 MCMC粒子滤波算法目标跟踪算法应用

4.1 状态空间的定义

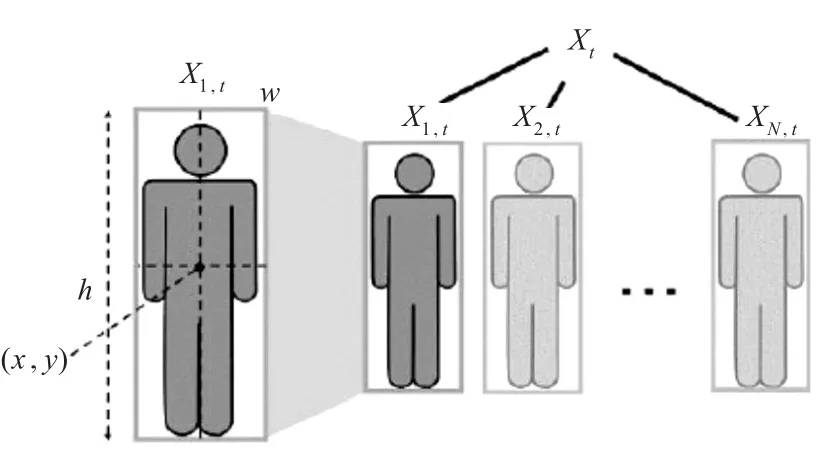

时刻t的多目标状态表示为,Xt={Xi,t,i∈Γt},其中Γt表示目标索引集,令mt=|Γt|表示目标数。每一个目标Xi,t都是转换空间ℜNx中的连续向量,其中ℜNx

表示经仿射变换后的一个四维子空间,包括水平转换、垂直转换(x,y),垂直高度(h)和水平宽度(w)。如图2所示,假设t时刻时场景中有N个目标,每个目标表示为Xi,t,i=1,2,…,N。每个目标的状态都由高度、宽度、中心位置组成,表示为,Xi,t=(),N个目标状态组成的目标集合用Xt表示,Xt={X1,t,X2,t,…,XN},其图解表示过程参照图3。

图3状态空间图t

4.2 MCMC粒子滤波视频目标跟踪系统框图

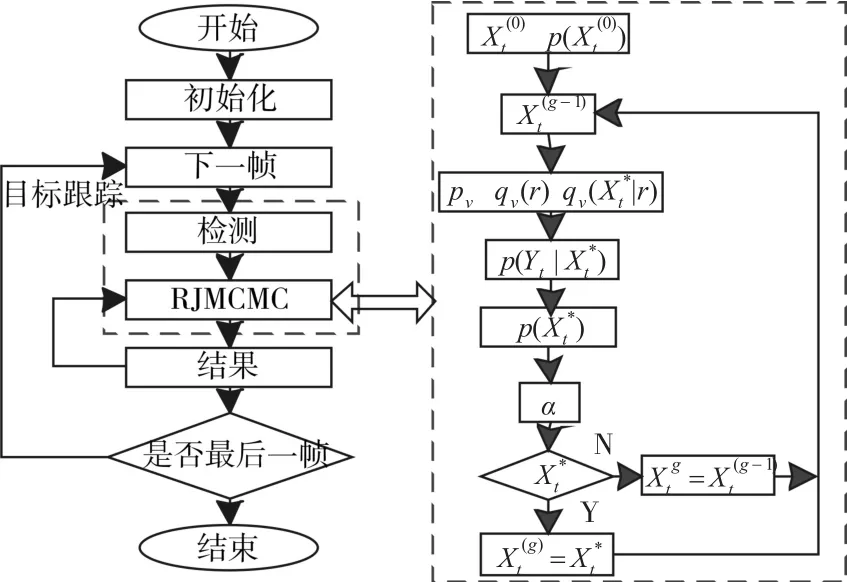

首先用MCMC粒子滤波算进行单目标跟踪实验。MCMC粒子滤波的视频目标跟踪框图如图4所示。开始阶段先对跟踪目标进行初始化,初始化方法是当场景中出现运动目标时,手动选择要跟踪的目标状态。然后由目标检测和MCMC抽样共同完成目标跟踪任务,其中目标检测采用混合高斯模型背景建模(GMM)方法实现。最后抽样迭代得到最佳的目标状态X*t。

图4基于MCMC视频目标跟踪框图

另外还采用RJMCMC粒子滤波算法进行多跟踪实验,RJMCMC粒子滤波视频多目标跟踪算法的框图如图5所示。开始阶段先对跟踪目标进行初始化,初始化过程先用混合高斯模型(GMM)背景建模,再通过自动检测目标检测到场景中有确定目标后,输入后续每一帧,在后续每一帧中由检测及RJMCMC抽样共同完成目标跟踪的任务。用RJM⁃CMC迭代抽样,计算目标的先验分布与似然度量,最后计算出最佳目标状态X*t。

图5RJMCMC视频多目标跟踪框图

4.3 相关参数设置

RJMCMC运动类型的选择依赖于前一时刻的状态Xi-1,通过时变先验分布来实现的。对于Birth运动类型的先验值选择p(v=birth)=[0.02,0.05];Death运动类型的先验值p(v=death)= [0.0002,0.005],并且当有目标在出口区时,该值增大,当目标状态集中两个目标的距离ds小于某个阈值时,Swap运动类型选择概率增大一般取p(v=swap)=[0.01,0.03]。

当运动类型选择的是Death运动类型时,选择移除哪一个目标是根据最小欧氏距离的立方来选择的。当运动类型选择的是Swap运动类型时,目标和目标可能被选择作为Swap交换对象的概率为p(v=swap)。当选择的运动类型是Update运动类型时,对所有目标用均匀分布采样来选择要Update的目标。

5 基于MCMC粒子滤波单目标视频跟踪实验结果与分析

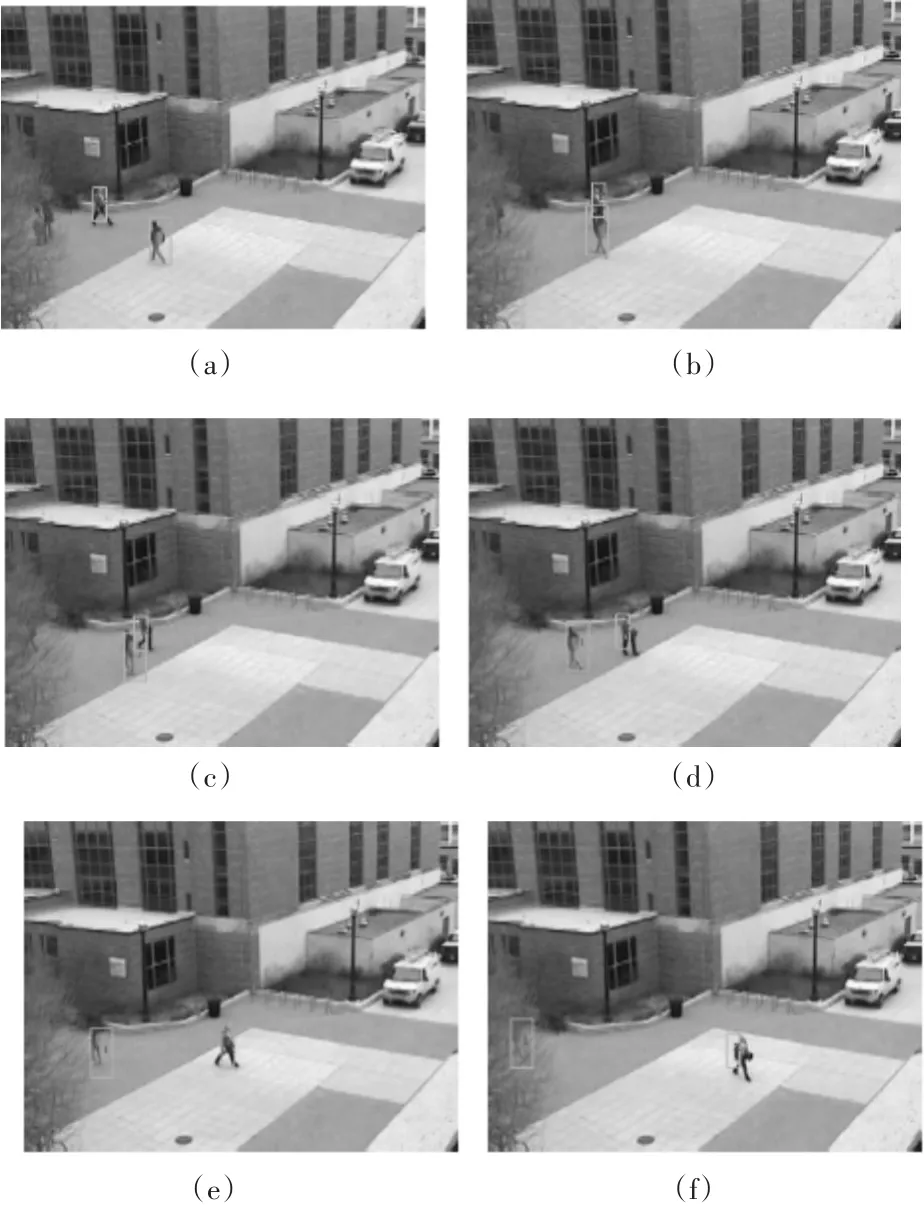

图6的各张图像中可以看出MCMC算法具有比较高的跟踪精度。

图6基于MCMC粒子滤波的视频目标跟踪

本实验过程,目标状态的定义按照第3节的所给定的目标状态作为模板,即每个目标的状态用有中心位置(x,y)、宽度w、高度h来表示。

目标跟踪的运动模型采样一阶自回归模型(ARP),即对于第个目标Xi,t=Xi,t-1+W,对于每一个分量表示为xi,t=xi,t-1+N(0,),yi,t= yi,t-1+N(0,),wi,t=wi,t-1+N(0,)和hi,t= hi,t-1+N(0,)。其中干扰项是均值为0标准正太分布,且取σx=σy=5,垂直尺度的标准差为σh= 0.005,水平尺度的标准差为σw=0.003。

目标的观测模型采用的基于二值模型与颜色模型相结合的观测模型。在颜色模型中,通过计算相应像素的RGB颜色直方图,但为了节省计算时间,本实验只计算了RGB通道中的R通道的颜色直方图,并以此通道的颜色直方图通过巴士距离来计算提议分布与当前分布之间的距离。其中,两个超参数的值的选择是通过经验获取λB=40,λB=40。

实验中,采样次数为200次,采样后丢弃前面25%的老化样本,选取后面75%次采样作为后验概率分布估计。

6 基于RJMCMC粒子滤波视频多目标跟踪实验结果与分析

为了测试RJMCMC粒子滤波的性能,采用了一段室外监控视频进行分析。图像序列采用的是OTCBVS Benchmark数据集。该视频中每帧图像大小为320×240,实验结果如图7所示。

图7RJMCMC跟踪试验结果

图7(a)中有两个目标,在经过(b)和(c)阶段两个目标出现了相互遮挡的情况,但从(d)的显示可以看出该跟踪器还是能够稳健地跟踪原来的目标,并没有出现因相互影响而跟踪错误情况。从(f)来看出,由于摄像机的位置,目标1相当一部分被摄像机前的树枝给遮挡住了,但跟踪器还是能够稳健的跟踪到该目标。也就是说采用RJMCMC算法具有一定的鲁棒性。

本实验过程中,目标状态的定义按照第3节所给定的目标状态作为模板,即每个目标的状态用有中心位置(x,y)、宽度w、高度h来表示。

目标跟踪的运动模型采样一阶自回归模型(ARP),即对于第i个目标Xi,t=Xi,t-1+W,对于每一个分量表示为xi,t=xi,t-1+N(0,),yi,t= yi,t-1+N(0,),wi,t=wi,t-1+N(0,)和hi,t= hi,t-1+N(0,)。其中干扰项是均值为0标准正太分布,且取σx=σy=3,垂直尺度的标准差为σh= 0.008,水平尺度的标准差为σw=0.01。

目标的观测模型采用的是基于二值模型与颜色模型相结合的观测模型。在颜色模型中,通过计算相应像素的RGB颜色直方图,但为了节省计算时间,本实验只计算了RGB通道中的R通道的颜色直方图,并以此通道的颜色直方图通过巴士距离来计算提议分布与当前分布之间的距离。其中,两个超参数的值得选择是通过经验获取λB=20,λB=15。在实验中,MCMC采样次数设为400次,采样后丢弃前面25%的老化样本。

首先通过运动目标检测算法对跟踪的状态进行初始化,接着用RJMCMC进行多次采样,并得到多个粒子表示的后验概率分布。

7 结语

先对基于贝叶斯框架的目标跟踪所用的两个关键模型——运动模型和观测模型进行了介绍,同时,对本文所用到的运动模型和观测模型给出了论证。另外,还对本文所定义的目标状态进行了说明,接下来用实验论证了MCMC粒子滤波算法在视频多目标跟踪中的应用。实验证明,MCMC粒子滤波具有一定的鲁棒性,达到了预期的目标跟踪要求。但由于MCMC的计算复杂度,并不能够实现实时性的要求,这还需要后续的研究以实现实时性的要求。

[1]B.McCane,K.Novins,D.Crannitch,and B.Galvin.On Benchmarking Optical Flow[J].Computer Vision and Im⁃age Understanding,2001,84(1):126-143.

[2]D.G.Lowe.Distinctive Image Features from Scale Invari⁃ant Features[J].International Journal of Computer Vision(IJCV),2004,60(2):91-110.

[3]N.R.PAL,S.K.PAL.A Review on image segmentation⁃techniques[J].Pattern Recognition,1993,26:1277-1294.

[4]J.Beutel,H.L.Kundel,R.L.V.Metter.Handbook of Med⁃icalImaging[M].Bellingham,WA,2001.

[5]HornB.K.P,SchunckB.G.Determiningopticalflow.AI17,1981:185-204.

[6]H.Ning,T.Tan,L.Wang,W.Hu.Kinematics-based Tracking of HumanWalking in Monocular Video Wequenc⁃es[J].Image and Vision Computing,2004,22(5):429-441.

[7]S.X.Ju,M.J.Black,Y.Yacoob.Card board People:A Parameterized Model ofArticulated Image Motion[C]//Pro⁃ceedings of International Conference onAutomatic Face and Gesture Recognition.1996,Killington:38-44.

Research on Target Tracking Algorithm Based on MCMC Particle Filter

GAO Fei

(Baoji Professional Technology Institute,Baoji721000)

According to the application of video target tracking algorithm in the bayesian framework,in combination of opera⁃tion consumption of the MCMC particle filter algorithm,the motion model and observation model are studied.The algorithm of the bi⁃nary model and the color model combining is improved.Only one channel is used to realize in the modeling of the color model,which reduces the observation model operation cost and improves the operation speed.

particle filter algorithm,video target tracking,color model,binary model,motion model

TN713

10.3969/j.issn.1672-9722.2017.07.018

2017年1月4日,

2017年2月18日

高菲,女,硕士研究生,研究方向:计算机教育。