一种小模数齿轮边缘检测效果评价方法

周泽恒,叶树亮,朱维斌

(中国计量大学 计量测试工程学院 工业与商贸计量技术研究所,浙江 杭州 310018)

一种小模数齿轮边缘检测效果评价方法

周泽恒,叶树亮,朱维斌

(中国计量大学 计量测试工程学院 工业与商贸计量技术研究所,浙江 杭州 310018)

利用机器视觉评定小模数齿轮精度时,在齿轮整体图像中提取的边缘特征信息不能直接描述图像中的单独目标,需要后续识别算法去适应局部的多变特征.为此提出一种基于特征图像的边缘检测效果评价方法来获取丰富的局部图像信息,用于评定小模数渐开线齿轮视觉测量系统中轮廓提取的精度.首先根据齿轮图像中渐开线齿廓边缘的函数特性建立特征图像模型;然后使用基于Zernike矩的亚像素边缘检测算法获取小模数渐开线齿轮特征图像的边缘;最后结合构建特征图像的标准函数,量化特征图像的边缘检测结果与标准函数间的偏差,用以评价边缘检测的效果.实验表明,运用小模数齿轮的特征图像评价基于Zernike矩的亚像素边缘检测算法,渐开线齿廓的检测精度优于0.58 pixel.

Zernike矩;边缘检测;特征图像;边缘评价;小模数齿轮

小模数齿轮由于尺寸小、齿槽间隙小等机械特点,使用传统接触式测量十分困难,然而非接触的视觉测量方法却可以从原理上解决这个问题,将机器视觉成果引入齿轮测量领域已成为了一个重要的发展趋势[1].边缘检测技术一直以来都是视觉测量领域的研究热点,常用的边缘检测算法是考查图像像素邻域内灰度的变化,利用一阶、二阶导数算子将边缘定位在像素级精度上.随着实际应用中对精度要求的增加,像素级的边缘检测算法无法满足实际需要,越来越多的专家致力于亚像素级算法的研究,其中利用矩的原理来进行边缘检测应用最广泛,Zernike正交矩[2](Zernike orthogonal moment-ZOM)因为计算速度快且精度高,得到了更多的重视与应用.

判断各种边缘检测算子对轮廓信息提取的准确性,需要一个能够客观评价检测结果的标准.客观边缘评价方法可分为两类.一类是无基准图评价方法,这一类方法通常是基于边缘像素邻域的局部相关性来评价图像边缘的质量,最早是由Kitchen和Rosenfeld[3]提出,以边缘像素的局部一致性作为评价指标;Zhu[4]在此基础上通过统计的方法以图像的连续性和单边性作为评价指标;林卉和舒宁[5]等人也根据边缘局部相关性的特点提出了一种基于连通成分的边缘评价方法.另一类是基于基准图的评价方法,通常需要生成边缘基准图,再以此判断检测结果的漏检、错检、重检以及边缘偏移等情况从而完成评价.最早由Fram和Deutsch[6]提出,以正确检测率作为评价指标;之后Pratt[7]提出了一种综合评价边缘检测效果的品质因数P作为评价指标;段玉波和陈静石[8]在Wang[9]等人提出的结构相似度(SSIM)基础上总结了一种结合SSIM、边缘可靠性、边缘连续性的基准边缘图像评价指标EIdx.由于上述指标依赖于真实边缘信息,需要构建作为基准的边缘图像,一些研究者由此提出了边缘基准图的生成方法:Yitzhaky和Peli[10]使用ROC曲线和Chi-square统计来构造边缘基准图;李张帆[11]等人结合置信度来融合不同算法下的预选基准图来构建边缘基准图.对比两类客观边缘评价方法,第一类方法无法判断出边缘检测的虚假边缘;第二类方法能更全面、可靠地量化边缘检测结果的偏差,但是效率相对较低.在对小模数齿轮图像的边缘检测效果进行评价时,考虑测量精度要求,采用更准确的基准边缘图评价方法[12].

本文以Zernike正交矩为小模数齿轮图像边缘检测手段,根据渐开线齿轮图像的自身特征,提出针对性的边缘检测效果评价方法,利用齿轮各个边缘特征的标准函数构建评价特征图像模型[13],通过比对基于Zernike正交矩边缘检测结果与基准特征图像的函数模型,量化图像边缘检测算法精度,并以此作为验证边缘检测性能的依据.

1 齿轮图像亚像素边缘检测

在小模数齿轮视觉测量系统中,需要完成图像采集、预处理、边缘检测以及齿轮参数计算等任务,实现小模数齿轮的精度评定.边缘检测技术是系统图像处理中的重要环节[14],提取的边缘是否能反映真实边缘情况将直接影响齿轮相关参数计算以及精度评定的结果.选择合适的边缘检测算法并量化边缘检测结果与真实边缘的偏差具有重要意义,因此需要评价图像边缘检测的效果.

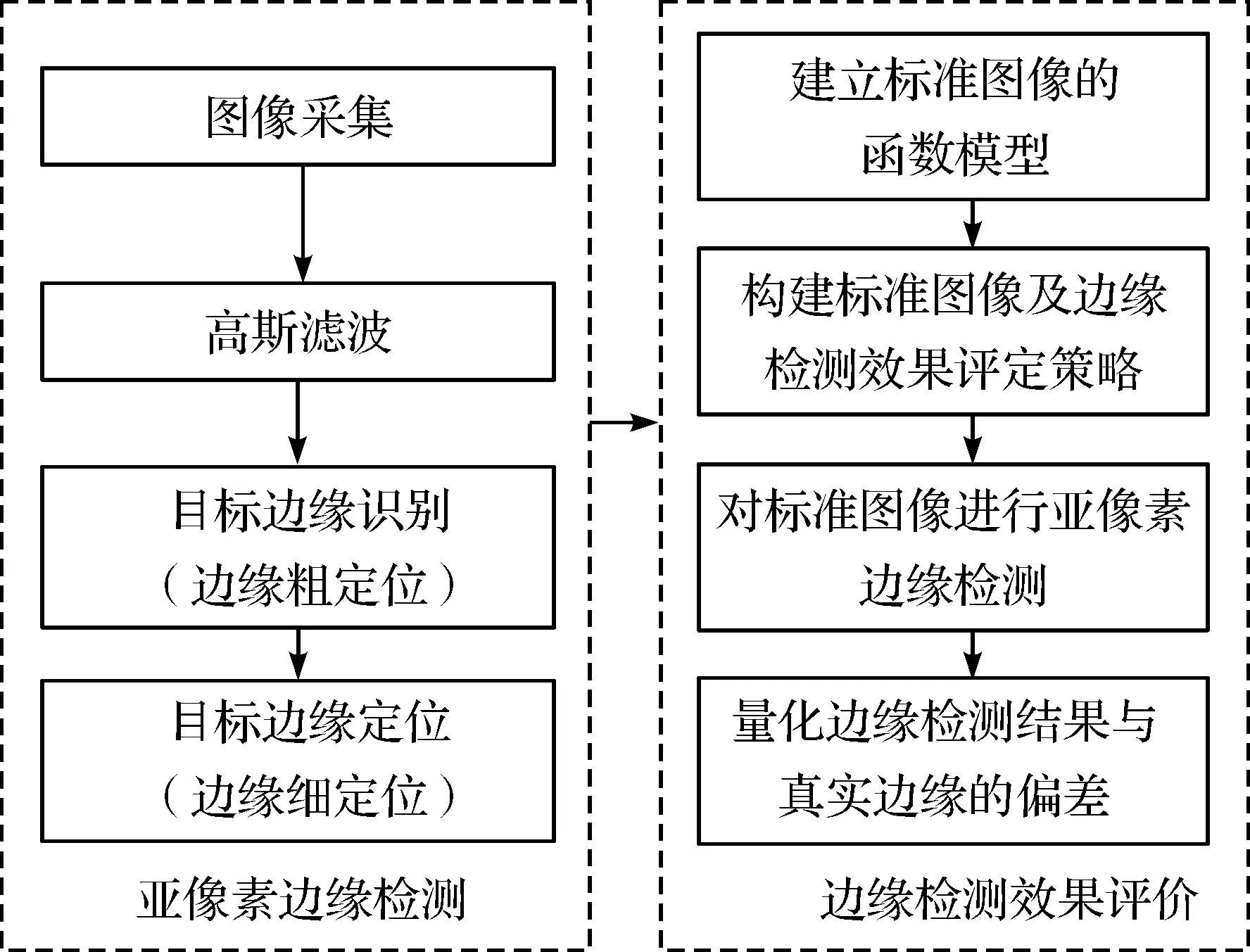

为评价亚像素边缘检测的效果,需要在系统完成亚像素边缘检测时,实现对检测结果的评价,系统的亚像素边缘检测及其评价流程如图1.亚像素边缘检测时需要对系统采集的图像进行高斯滤波,再对图像边缘进行粗定位和细定位;对边缘检测结果的评价采用基准边缘图的评价方法,通过构建基准图像及评定策略,量化基准图像的亚像素边缘检测结果与真实边缘的偏差.

本文所研究的边缘检测技术及效果评价方法均针对基于Zernike矩的亚像素边缘检测算法,该算法具有良好的检测精度和较强的抗噪能力,计算效率相对较高.通过计算图像中三个不同阶次的Zernike矩,在单位圆中建立理想阶跃灰度模型,将模型的4个参数映射到Zernike矩中,再以此计算出边缘所在直线的参数,从而获得亚像素级坐标.

算法首先需建立图像f(x,y)的n阶m重Zernike矩[15]

(1)

∬x2+y2≤1f′(x,y)ydxdy=0.

(2)

图1 亚像素边缘检测与视觉测量效果评价流程图Figure 1 Flowchart of sub-pixel edge detection and the visual measurement effect evaluating

(3)

式(3)中lm[Z11],Re[Z11]分别是Z11的虚部和实部,由此可以求得角θ

(4)

以理想阶跃灰度模型的4个参数与三个阶次Zernike矩的映射关系建立方程,求得图像边缘到中心像素的距离[16]l

(5)

(6)

2 齿轮特征图像评价方法原理

根据国标GBT 10095.1—2008中齿轮精度的评定标准可知,用以评价齿轮精度的参数计算结果是μm(微米)级别.由文献[17]可知利用视觉检测系统的自标定技术能够求得物理尺寸与相机像素尺寸的比值,相机分辨率越高,单位像素对应的物理尺寸越小.为评价齿轮精度参数,视觉测量系统需要提供高分辨率的图像.而实现小模数齿轮视觉测量系统中亚像素边缘检测效果的评价方法,难点在于构建齿轮整体的高分辨率基准图像工作量大,对计算机硬件要求高.同时从齿轮整体图像中提取的边缘特征信息不能描述图像中的局部齿廓信息,需要后续识别算法去适应局部的多变特征.而采用局部特征的设计思想描述不同类型的目标区域,能够获取丰富的局部图像信息,同时也使特征信息具有更强的代表性.为此提出一种基于特征图像的边缘检测效果评价方法,根据齿轮特征的相关设计参数以及数学模型建立特征边缘图像,并以此作为基准边缘图来评价小模数齿轮图像边缘检测的效果.基准边缘图不受到光学系统、实验环境噪声的影响[18],且特征图像的尺寸相对更小,对硬件的要求更低,计算效率更高.因此根据被检测齿轮边缘的函数特性,利用标准函数建立渐开线齿廓的特征图像模型.

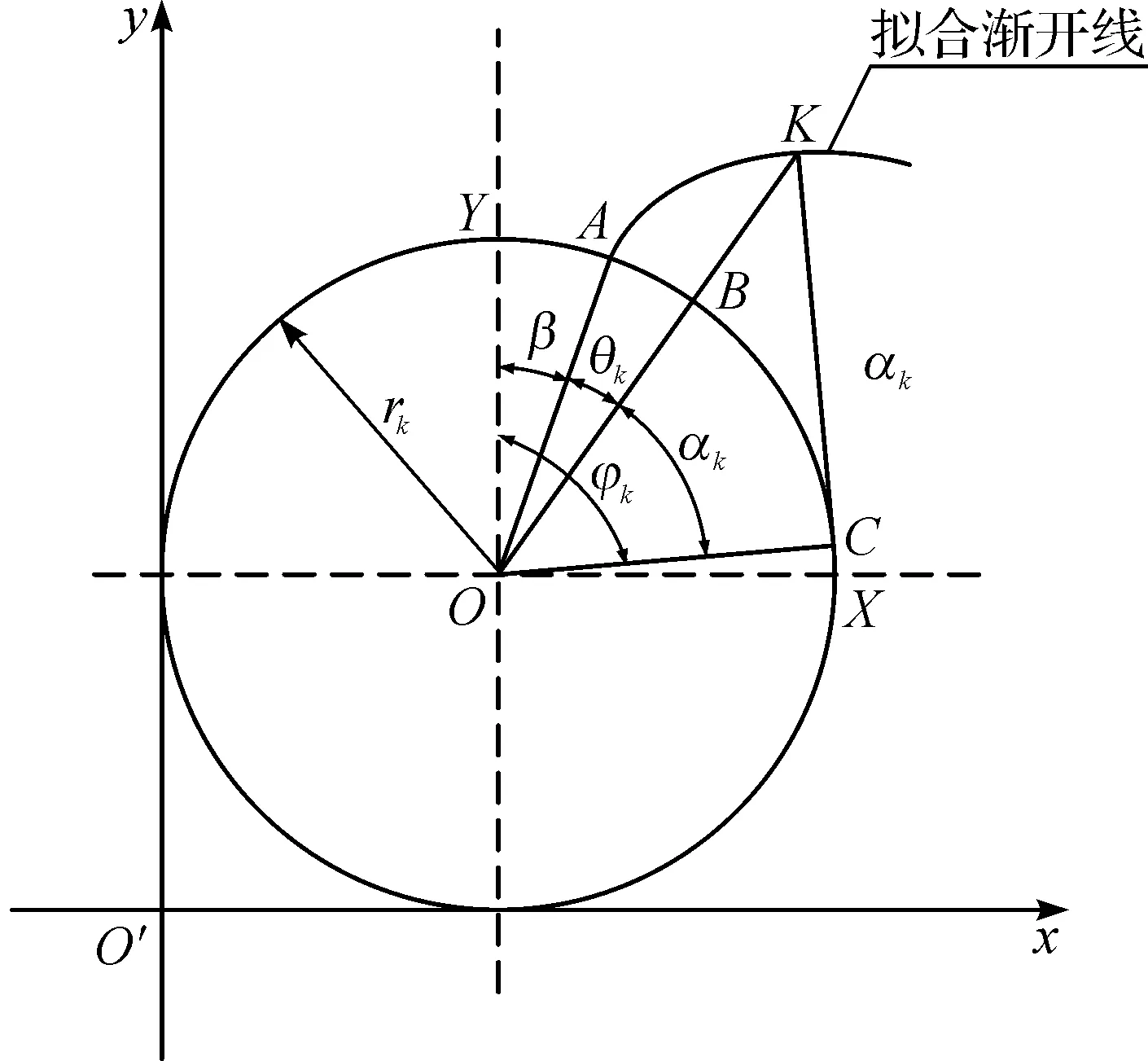

θk=tanαk-αk,

(7)

(8)

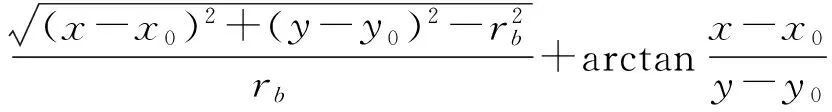

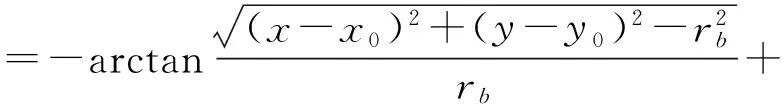

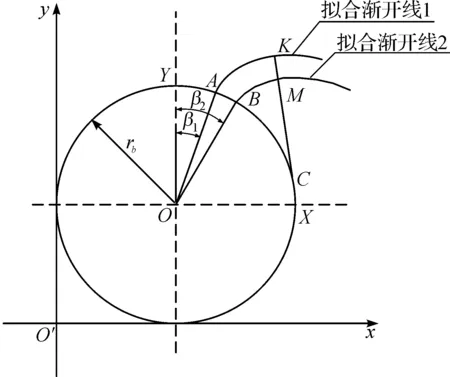

由于图2中拟合渐开线齿廓对应的角度β不变,可以确定渐开线左齿廓上任意一点K(x,y)满足式(10),即左齿廓的函数模型.

(9)

图2 渐开线齿廓拟合原理图Figure 2 Schematic diagram of involute profile fitting

根据上式推导,同理可得齿轮渐开线右齿廓的函数模型为

(10)

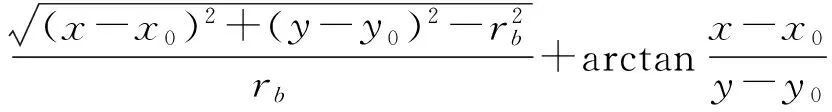

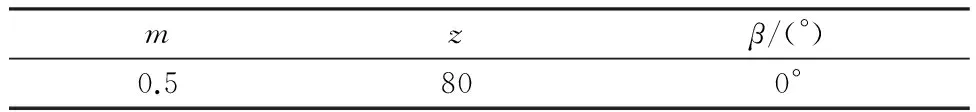

由式(9)可知渐开线模型函数的设计参数包括模数m,齿数z,压力角α(通常取值为20°),角度和齿轮几何中心(x0,y0)(取坐标原点).图3是基准渐开线齿廓特征模型图,图像尺寸为972×972,其设计参数如表1.模型函数的形状可通过改变模数m与齿数z的值来调整;起始角度可通过改变设计参数β的值来调整.

图3 基准渐开线齿廓特征模型图Figure 3 Feature model of standard involute profile

表1 渐开线齿廓特征模型的设计参数

为评价渐开线特征模型的边缘检测精度,根据式(9)建立渐开线齿廓模型,模型中的齿廓特征边缘是理想的,其齿廓总偏差Fα(包容实际齿廓边缘的两条标准渐开线间的距离)为0,故实际边缘检测结果的Fα可作为精度评定的指标,如图4.

图4 渐开线齿廓偏差示意图Figure 4 Schematic diagram of involute profile deviation

设亚像素齿廓边缘点的集合为(xi,yi),i=1,2,…,n,过任意齿廓点(xi,yi)的拟合渐开线起点与坐标原点间的直线和y轴正方向的夹角为βi.令βmin=min{βi|i=1,2,…,n},βmax=max{βi|i=1,2,…,n},根据齿廓总偏差定义求得

Fα=rb(βmax-βmin).

(11)

3 实验结果与数据分析

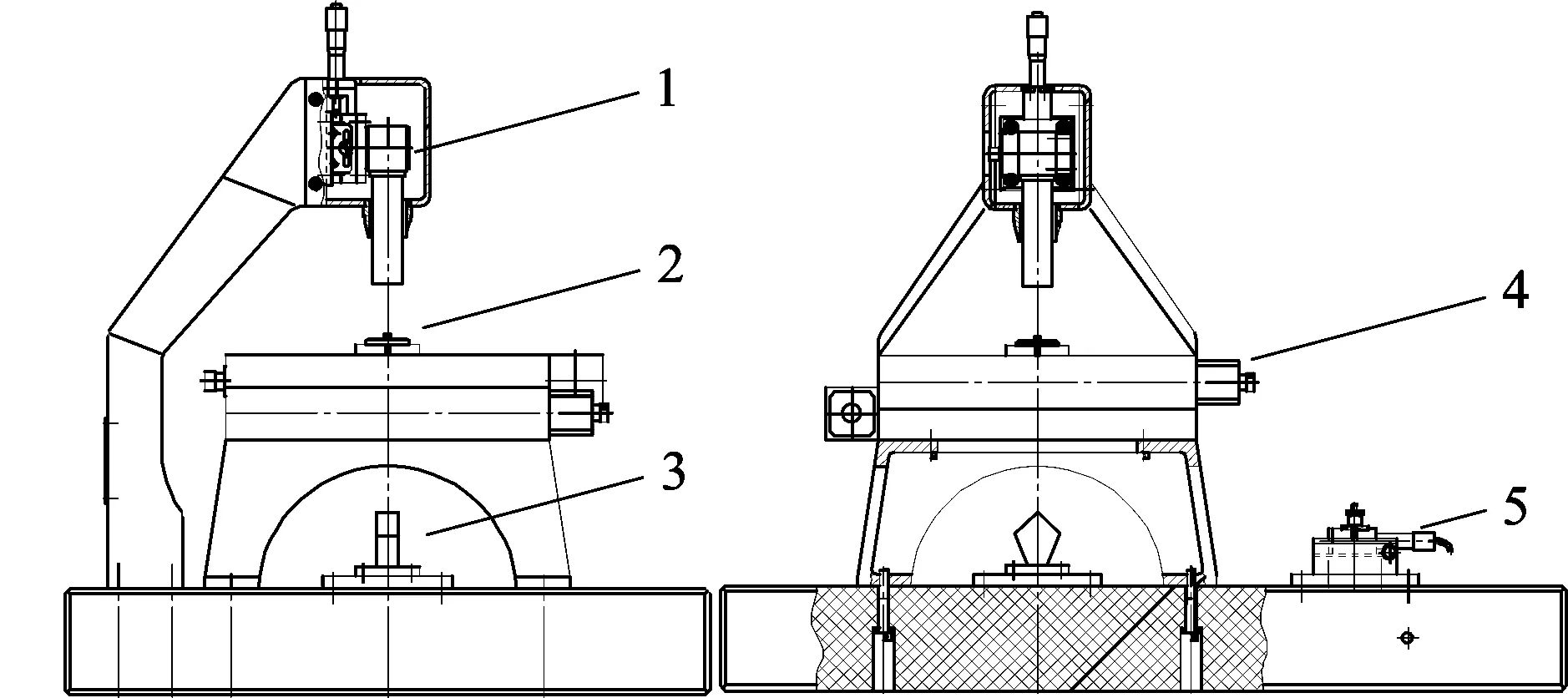

小模数齿轮视觉测量系统如图5.系统采用的背光源能抑制齿轮表面反射光对图像采集的影响,由LED平行光源以及五角棱镜构成.被测小模数齿轮固定在二维运动平台上.由于系统采用的高分辨率工业相机视场较小,导致被测齿轮无法一次成像.故需要通过控制二维运动平台使工业相机采集小模数齿轮不同位置的图像,并通过图像拼接来获取小模数齿轮的完整信息.根据前文中建立的特征图像模型及边缘检测效果评价方案,评价基于Zernike矩的亚像素边缘检测效果.

1—工业相机;2—被测小模数齿轮;3—五角棱镜;4—二维运动平台;5—LED平等光管图5 小模数齿轮视觉测量系统Figure 5 Vision measurement system of small module gear

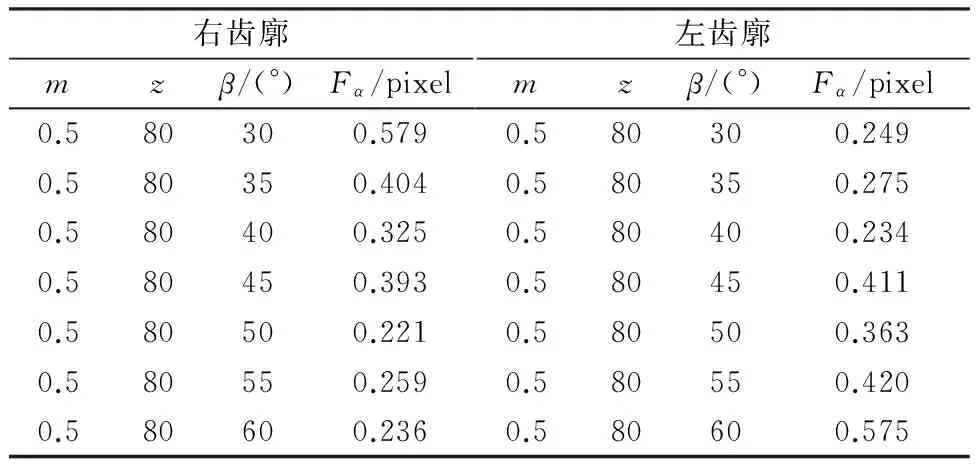

根据公式(9)、(10)建立的渐开线齿廓特征图像模型,设计不同的参数β,使用公式(11)计算并记录各个工况中左、右齿廓边缘参数检测评定效果,如表2.由表2可知,在不同角度β的工况下,特征图像模型的边缘检测评价指标Fα均小于0.58 pixel.在模数为0.5,齿数为80的齿轮渐开线齿廓图像模型中,当角度β在30°~60°的区间变化时,左齿廓的评价指标Fα与右齿廓的评价指标始终是相反的变化趋势.

表2 渐开线齿廓特征图像模型的边缘检测效果评价

4 结 语

为评价小模数渐开线齿轮视觉测量系统中轮廓提取技术的精度,提出基于特征图像的边缘检测效果评价方法.该方法根据齿轮图像中渐开线齿廓边缘的函数特性建立特征图像模型;然后使用基于Zernike矩的亚像素边缘检测算法获取小模数渐开线齿轮特征图像的边缘;最后结合构建特征图像的标准函数,量化特征图像的边缘检测结果与标准函数间的偏差.利用本文提出的评价方法对Zernike矩亚像素边缘效果进行验证实验,结果显示检测渐开线齿廓的偏差小于0.58pixel.该评价方法不仅可以量化边缘检测结果的偏差,同时对硬件的要求低、计算效率高,故在小模数齿轮视觉测量以及其他相关图像处理技术领域具有良好的实际应用价值.

[1] 叶树亮,张玉德,张炜.齿轮视觉检测中的尺度与方向相关性联合降噪[J].光学精密工程,2014,22(6):1622-1630. YE S L, ZHANG Y D, ZHANG W. Scale and directional correlation combined denoiseing in gear visual inspection[J].Optics and Precision Engineering,2014,22(6):1622-1630.

[2] 李金泉,王建伟,陈善本.一种改进的Zernike正交矩亚像素边缘检测算法[J].光学技术,2003,29(4):500-503. LI J Q, WANG J W, CHEN S B. Improved algorithm of subpixel edge detection using Zernike orthogonal moments[J].Optical Technique,2003,29(4):500-503.

[3] KITCHEN L, ROSENFELD A. Edge evaluation using local edge coherence[J].IEEE Transactions on Systems Man & Cybernetics,1981,11(9):597-605.

[4] ZHU Q M. Efficient evaluation of edge conne-ctivity and width uniformity[J].Image and Vision Computing,1996,14(1):21-34.

[5] 林卉,舒宁,赵长胜.一种新的基于连通成分的边缘评价方法[J].国土资源遥感,2003(2):37-40. LIN H, SHU N, ZHAO C S. A new evaluation method based on connection components[J].Remote Sensing for Land & Resources,2003(2):37-40.

[6] FRAM J R, DEUTSCH E S. On the quantitative evaluation of edge detection schemes and their comparison with human performance[J].IEEE Transactions on Computers,1975,24(6):616-628.

[7] WILLIAM K P. Digital Image Processing[M].New York: John Wiley & Sons,1978:269-433.

[8] 段玉波,陈静石.一种新的图像边缘检测客观评价方法[J].图像处理技术,2016,35(3):57-62. DUAN Y B, CHEN J S. A new objective method of evaluation in the image edge detection[J].Image Processing Technology,2016,35(3):57-62.

[9] WANG Z, BOVIK A C, SHEIKH H R, et al. Image quality assessment from error visibility to structural similarity[J].IEEE Transactions on Image Processing,2004,13(4):600-612.

[10] YITZHAKY Y, PELI E. A method for objective edge detection evaluation and detector parameter selection[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2003,25(8):1027-1033.

[11] 李张帆,张必银,张天序.基于置信度融合的边缘检测性能评价基准图计算[J].计算机工程,2007,33(18):208-210. LI Z F, ZHANG B Y, ZHANG T X. Ground truth calculation for edge detection evaluation by image fusion based on confidence measures[J].Compurter Engineering,2007,33(18):208-210.

[12] 磨少清.边缘检测及其评价方法的研究[D].天津:天津大学,2011. MO S Q. Research on Edge Detecion and Its Evaluation[D].Tianjin: Tianjin University,2011.

[13] 刘国栋,刘炳国,陈凤东,等.亚像素定位算法精度评价方法的研究[J].光学学报,2009,29(12):3446-3451. LIU G D, LIU B G, CHEN F D, et al. Study on the method of the accuracy evaluation of sub-pixel location operators[J].Acta Optica Sinica,2009,29(12):3446-3451.

[14] 沈海珍.基于机器视觉的小模数齿轮轮廓信息提取算法研究[D].杭州:中国计量大学,2015. SHEN H Z. Based on Machine Vision of Small Module Gear Contour Information Extraction Algorithm Research[D].Hangzhou: China Jiliang University,2015.

[15] 崔继文,谭久彬.基于Zernike矩的亚像素边缘定位算法[J].光学技术,2005,31(5):779-785. CUI J W, TAN J B. Algorithm for edge sub-pixel location based on Zernike moment[J].Optical Technique,2005,31(5):779-785.

[16] GHOSAL S, MEHROTRA R. Orthogonal moment operators for subpixel edge detection[J].Pattern Recognition,1993,26(2):295-306.

[17] 张玉德.小模数齿轮视觉检测系统中的自标定技术研究[D].杭州:中国计量大学,2014. ZHANG Y D. Research of Self-calibration for Small Modulus Gears Visual Measuring System[D].Hangzhou: China Jiliang University,2014.

[18] 徐胜华,刘纪平,王勇,等.基于主轴分析和EDISON-Zernike矩的彩色图像亚像素边缘检测[J].仪器仪表学报,2008,29(11):2273-2277. XU S H, LIU J P,WANG Y, et al. Sub-pixel edge detection of color image based on principal axis analysis and EDISON-Zernike moment[J].Chinese Journal of Scientific Instrument,2008,29(11):2273-2277.

A feature image-based method for evaluating small modulus gear sub-pixel edge-detection effectiveness

ZHOU Zeheng, YE Shuliang, ZHU Weibin

(Institute of Industry and Trade Measurement Technique, College of Metrology and Measurement Engineering, China Jiliang University, Hangzhou 310018, China)

When machine vision is used to evaluate the accuracy of a small-modulus gear, the edge feature information extracted from the whole gear image cannot directly describe an individual target in the image. An identification algorithm is needed to adapt to the variable local features subsequently. We presented a feature image-based method for receiving the effectiveness of edge detection to fetch abundant local image information and evaluate the profile extraction accuracy of the small-modulus involute gear vision measurement system. Firstly, a feature image model based on the functional features of the involute tooth profile edges in the gear image was created. Then, the Zernike-moment sub-pixel edge detection algorithm was used to fetch the edges of the small-modulus involute gear feature image. At last, based on the standard function for constructing the feature image, the deviation between the edge detection result of the feature image and that of the standard function was quantified so as to evaluate the edge detection effectiveness. The experiment shows that, when the feature image of the small-modulus gear is used to evaluate the Zernike-moment sub-pixel edge detection algorithm, the detection accuracy of the involute tooth profile is better than 0.58 pixels.

Zernike moment; edge detection; feature image; edge evaluation; small-modulus gear

2096-2835(2017)01-0029-06

10.3969/j.issn.2096-2835.2017.01.005

2017-01-04 《中国计量大学学报》网址:zgjl.cbpt.cnki.net

国家质检总局公益性行业科研专项(No.201210001-3).

周泽恒(1992- ),男,四川省成都人,硕士研究生,主要研究方向为精密测量.E-mail:ibegintd@163.com 通信联系人:叶树亮,男,教授.E-mail:IITMI_paper@126.com

TP391

A