基于双目视觉的焊接零件位姿误差检测

胡国勇,彭小波HU Guo-yong, PENG Xiao-bo(深圳大学 机电与控制工程学院,深圳 510006)

基于双目视觉的焊接零件位姿误差检测

胡国勇,彭小波

HU Guo-yong,PENG Xiao-bo

(深圳大学 机电与控制工程学院,深圳 510006)

叶盘零件在焊接后,需要检测出多余的余量进行精加工。为了检测出多余的余量,需要对零件进行位姿测量。针对这一需要,设计了一种双目视觉的方法。首先在叶片毛坯上精加工出凸台用于位姿误差检测,并贴上标记点。再识别出标记点的圆心,并首先用灰度相关进行匹配,再用极线约束删除错误的匹配。最后利用C++和Opencv开发出系统,设计了试验并分析结果。

机器视觉;线性摩擦焊;位姿检测;椭圆拟合

0 引言

近年来,线性摩擦焊在加工领域中发挥着越来越大的作用,具有传统的焊接无法相比的优点。线性摩擦焊的焊缝强度能达到与焊件材料等强度,能实现不规则零件的焊接并且质量稳定[1]。在零件焊接后,需要对零件的位姿情况进行测量。根据位姿情况,与理想模型比较得到多余余量,生成数控机床精加工刀轨。双目视觉测量是非接触式测量,具有测量速度快和效率高等优点[2]。

1 位姿检测问题的描述

1.1对焊接零件位姿描述

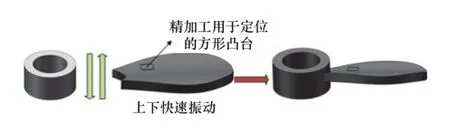

本文主要是针对焊接零件前后位姿变化的检测。首先在叶片毛坯上精加工方形凸台工艺结构如图1所示,用于叶片的定位。

图1 螺旋桨线性摩擦焊示意图

在焊接前,先把叶盘用专门的夹具固定在和盘心理想情况下的位置。然后用双目视觉位姿测量系统对凸台位姿情况进行检测;首先选取凸台的一个顶点,三条竖直边界做X,Y,Z轴的坐标系,获取凸台坐标系与相机坐标系的R矩阵和T矩阵。对凸台工艺结构上的特征进行拍照获取图像。从而获得叶盘在理想位姿情况上相对于凸台坐标系的三维坐标。在焊接后,对焊接后的凸台进行拍照获取图像,再进行三维坐标计算。最后已知前后获得三维坐标,计算出焊接后与理想位置的情况,即在凸台坐标系的三个平移参量X,Y,Z和绕凸台坐标系Rx,Ry,Rz的角度情况。

本文中的位姿检测系统就是首先通过双目立体视觉检测出叶片某些关键点的X、Y、Z的坐标值,根据坐标值进行位姿解算求解出三个坐标轴方向的位移和三个状态的转角,测得的数据同已有的CAD设计模型相比较后得出焊接后的叶盘与原本设计的模型的偏差值。最后通过数控编程,生成刀轨进行精加工。图3红色透明部分就是所多出来的余量。

图2 双目视觉系统对焊接后的零件位姿测量示意图

图3 焊接位姿情况确定后的零件与理想零件模型对比

图4 位姿问题描述流程图

1.2位姿求解

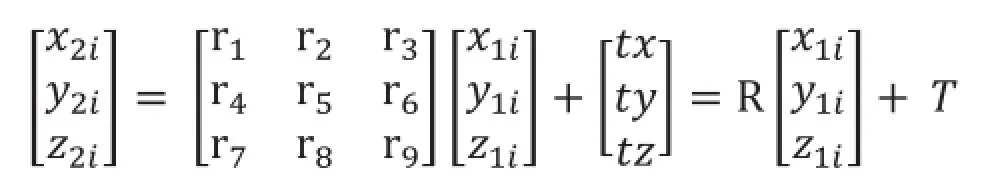

设标记点的在焊接前理想位置的三维坐标点集P1i=(xli,yli,zli),焊接后标记点的三维坐标点集为P2i=(x2i,y2i,z2i)。所以P点在焊接前的坐标值经过一个旋转矩阵和一个平移矩阵,形成了焊接后的坐标值,如下式:

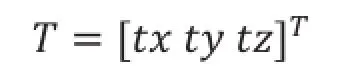

其中,向量T是一个三维向量。

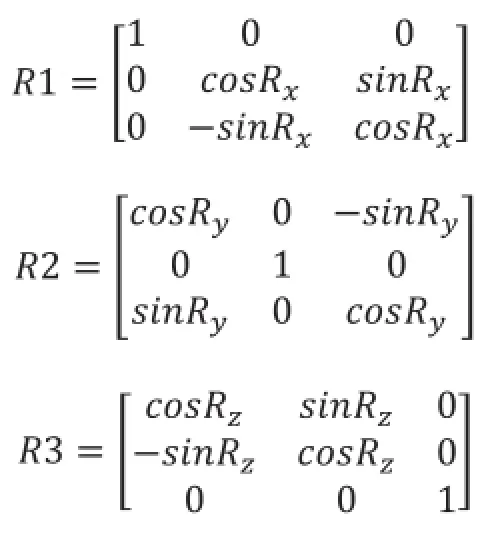

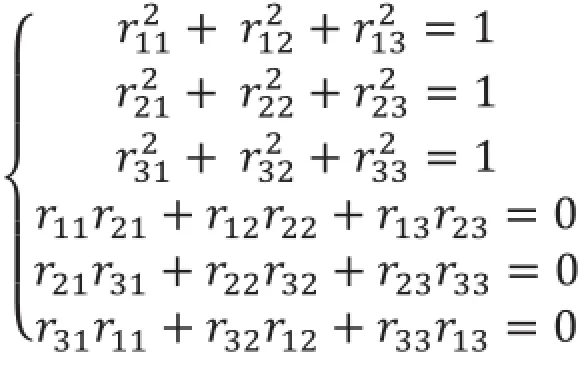

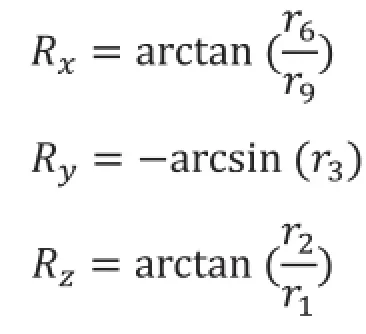

平移向量T即是两件焊接前后位置平移情况,R矩阵是3×3的矩阵,其中九个元素是由三个角度的三角(Rx,Ry,Rz)函数组成。Rx,Ry,Rz分别是绕凸台坐标系X、Y、Z轴的三个旋转角度,详细的旋转过程为:先绕Z轴旋转,其次绕Y轴转动,最后绕X轴转动,以右手定则为正方向。所以分别绕X、Y、Z轴转动的矩阵为R1,R2,R3,旋转矩阵R=R1R2R3。

旋转矩阵R有9个未知数,但是未知数不是孤立的,可以用3个参数表达,R矩阵中要满足以下约束:

本文求得的参数位姿变化过程是:先按(Rx,Ry,Rz)旋转,再按照。根据定义得,旋转矩阵R的各元素的表达式为:

2 双目原理与相机标定

2.1双目视觉数学模型

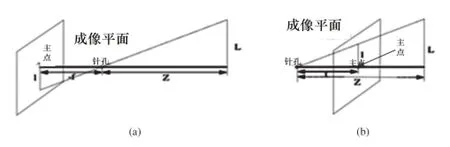

虽然现在的相机镜头都是由一组镜头组成,但是其模型还是可以看作针孔模型,如图5(a)所示,为了简化模型,把成像平面往右移,如图5(b)所示。图6为平行光轴双目立体视觉[3]。

图5 针孔相机模型

图6 双目视觉模型

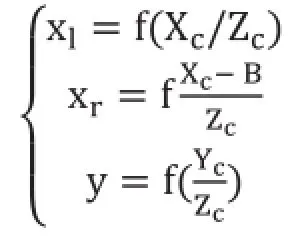

左相机和右相机的中心投影是Oc、Or,两光轴平行,X轴的方向一致。Oc、Or之间的距离B称为基线距。两相机分别拍摄空间目标点P,则左相机成像平面获得的像素点P1=(x1,y1),在右相机的成像平面获得的像素点Pr=(xr,yr),以左相机坐标系为世界坐标系,则目标点P的三维坐标为(Xz,Yc,Zc)。基于双目相机结构中的极线约束原理知y1=yr=y,所以由三角测量法得到如下关系式:

由上一节中的转换公式可以计算出P点相对于左相机的三维坐标值为:

其中x1-xr为视差,是通过两个像素点的像素坐标转换成物理坐标的值,Xc,Yc,Zc为目标点相对于左相机坐标系的三维坐标值。以上就是基于平行光轴双目视觉获取空间目标点的三维坐标值的数学模型。

2.2相机标定

由于加工生产相机时,相机的CCD传感器和透镜都会产生误差,这样会造成上一节中每个坐标系变换中的内部参数的误差[4]。比如在CCD传感器固定在相机上时,中心位置可能无法对准传感器中心,会造成相机两个内参数和不准确。文章采用张正友相机标定法[5]。下面是相机标定的参数。

表1 内参数标定结果

3 标记圆识别与匹配

3.1标记圆识别

用于标记圆是采用椭圆,求取圆心为特征点的方法,本文设计了一种新的标记圆识别拟合方法。步骤如下:

1)首先用聚类分析的方法对图像进行分割[6]。因为本文选取的标记圆与实际的背景环境对比度相差比较大的鲜艳颜色的圆,所以可以用标记圆的颜色信息进行分割,本节采用K均值聚类算法。

2)聚类后可能其他并不会完全地只分割出椭圆。所以接着用canny算子对聚类后的图像边进行边缘提取,形成轮廓与点集。对轮廓和点集进行用最小二乘法进行拟合,方法如下:

(1)获取每条轮廓的程度(每条轮廓所包含点的数量),舍弃程度小于20个像素点的轮廓。

(2)设置循环次数,每个轮廓随机抽出六个点,用最小二乘法求椭圆5个参数。

(3)筛选每个轮廓的椭圆最佳参数,筛选方法:给定一组参数,获得椭圆的任意一点,以这点为中心,取3×3的像素区域,在区域存在论点,计数器加1,最后求出计数器值与椭圆周长的比值,用于最佳参数的筛选。

(4)根据比值选出最优的椭圆参数。

(5)根据椭圆大小,删除伪椭圆,选出真正的标记圆。

图7为标记圆识别算法几个步骤处理后的图片。

3.2标记点匹配

在识别出左右相机成像图片上的标记圆后,需要将两幅图中的标记圆圆心建立一一对应的关系,为后续的三维坐标值的计算做准备。因为本文考虑的目标物体存在平移和小角度旋转关系的图像匹配,所以本文采用的匹配算法的步骤是:

1)首先用灰度相关匹配进行首次匹配。

2)用极线约束[7]对首次匹配中有错误的点进行剔除。

在实验验证中,选用7个标记圆随机摆放位置,验证匹配算法的准确度。并且选用本文实验模型,在凸台上放置四个点的模型,对其在不同角度位姿进行实验。图8中有出现错误匹配的情况。

图8 有错误匹配的灰度相关匹配

图9 极限约束匹配删除错误匹配

图10 模型匹配

表2 匹配准确率

4 实验与分析

4.1系统软硬件介绍与实验方案设计

图11为本系统搭建的硬件结构,本系统为单相机双目结构,即相机能在某一方向移动,形成双目效果。选用佳能相机,像素为720×480。

图11 单相机双目硬件系统

软件编程部分,主要分为界面设计与算法设计两个方面,界面设计主要是考MFC进行编写与设计,整个设计界面如图12所示,整个界面的布局较为简单,分为用户交互部分和图像效果显示部分。主要有图像显示窗口、三维坐标显示区、交互按键区、位姿结果显示区和MATLAB标定参数输入区五大部分。其中图像显示区分别是左右两幅图像的显示窗口;三维坐标显示区是显示每个特征标记点的三维坐标;交互按键区有读入图像、特征检测与匹配和位姿解算等操作;结果显示区是显示位姿的旋转角和平移量;标定参数输入区是输入第二章中用MATLAB标定得到的数据。

图12 系统操作界面

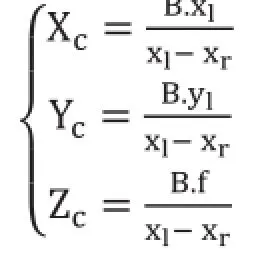

为了仿真焊接件上的凸台结构,制作了一个凸台模型如图13(a)所示,凸台长49.3mm,宽55.01mm,高2.0mm,顶面贴上标记圆。为了方便测量实际位置,在实验平台上显示出坐标系,其中坐标系每个为2mm。下面为系统精度试验步骤:

1)凸台左上角顶点和两条边线分别与实验平台上的坐标系原点横轴和纵轴重合。凸台坐标系设定为以左上角顶点为圆心,横向边线为x轴,纵向边线为y轴,z轴为向着图像朝外。计算出凸台坐标系与相机坐标系的R矩阵和T矩阵,由于凸台厚度为2mm,所以实验平台上的坐标系相对于凸台坐标系T矩阵中,原点相对于z轴减2mm。

2)在对x平移参量精度测量时,在实验平台在y轴不变的情况下,每测量一次位置向x轴移动一格,在测量x轴时,同时记录z轴的数据。测量y轴的平移参量精度也是如此。

3)在测量旋转变量时,在其他参数不变的时候,分布测量绕z轴、x轴和y轴的实验数据。

图13 实验准备图

【】【】

4.2实验结果

随机选取16组实验结果,通过实验得出:在位置情况检测上,在x轴方向上,平均误差为0.193mm,其中最大误差为0.46mm;在y轴方向上,平均误差0.197mm,其中最大误差为0.41mm;在z轴方向上平均误差为0.459mm,其中最大误差为1.75mm。综合以上测量结果说明x和y轴方向上精度较高,能达到0.5mm,在z轴方向上精度较差,达到2mm,这也是因为z轴坐标值与匹配精确度有关系。

在姿态检测上,绕z轴旋转角度上,平均误差为0.386°,最大误差为0.75°,精度在1°内;在绕x轴旋转角度上,平均误差为0.786°,最大误差为1.38°,精度在1.5°内;在绕y轴旋转角度上,其中测得平均误差为0.535,最大误差为1.38°,精度1.5°内。由于实验系统的搭建会存在一定的系统误差,导致测量精度也会受到一定的影响。

5 结论

研究了基于双目视觉对焊接零件位姿误差检测系统,建立了双目数学模型。针对准确快速识别多椭圆的难点,设计了准确提取椭圆的方法,并进行实验验证。还针对叶盘模型,设计了位姿检测误差系统,并进行仿真实验。

[1] 张悦.钛合金整体叶盘盘铣加工刀具设计与分析研究[D].哈尔滨理工大学,2015.

[2] 吴哲岑.基于双目立体视觉的特征点提取与定位方法研究[D].吉林大学,2015.

[3] 赖小波.机器人双目立体视觉若干关键理论问题及其技术实现研究[D].浙江大学,2010.

[4] Zhang,Z.A flexible new technique for camera calibration[J]. Pattern Analysis and Machine Intelligence,IEEE Transactions on,2000,22(11):1330-1334.

[5] Blas F.Review of 20 years of range sensor development[J]. Electron Imaging,2004,13(1):231240.

[6] 孙吉贵,刘杰,赵连宇.聚类算法研究[J].软件学报,2008,19(1):48-61.

[7] 邓志燕,陈炽坤.利用外极线约束的图像匹配新算法[J].工程图学学报,2009,30(5):104-107.

Position and pose error detection of welding parts based on binocular vision

TP39

B

1009-0134(2016)06-0077-05

2016-03-25

胡国勇(1991 -),男,广东韶关人,硕士,研究方向为机器视觉。